[本主题是预发行文档,可能会更改。]

通过提示,你可以为业务自动化和代理创建自定义生成 AI 工具。 确保这些工具的准确性、可靠性和效率至关重要。 批量测试提示旨在使你能够在整个平台上验证和改进 AI 工具中使用的提示。

重要

- 这是一项面向生产环境的预览功能。

- 生产就绪预览需要满足补充使用条款。

- 提示在由 Azure OpenAI Service 提供支持的 GPT 模型上运行。

- 此功能可能尚未在你的区域中可用。 有关详细信息,请参阅区域或美国政府环境的“功能可用性”部分中的“提示”部分。

- 此功能可能会受到使用限制或容量限制。

批处理测试的核心功能

批处理测试提供了一种系统的方法,用于验证各种数据集的提示。 您可以:

- 上传或生成用于全面评估的测试数据集。

- 定义用于判断测试结果的评估条件。

- 执行批处理测试以评估测试数据集中的提示行为。

- 比较一段时间内的结果,以确保持续改进。

- 查看并调整自动评估,以确保与特定需求保持一致。

准确性分数是根据测试结果计算的,提供经验数据来信任 AI 工具。

如何使用批处理测试

使用以下步骤为提示设置和运行批处理测试。

定义测试用例

访问提示列表:

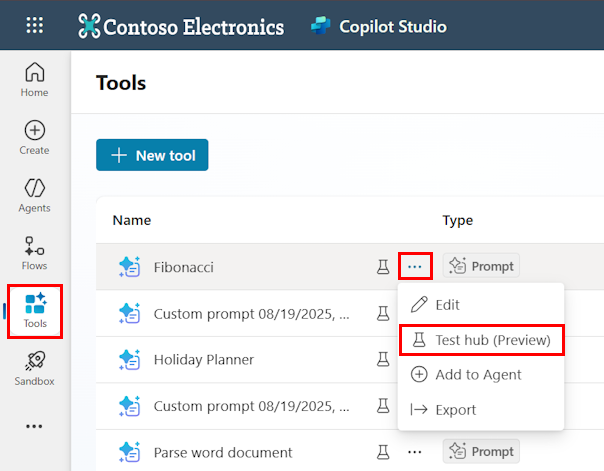

- 在 Copilot Studio 中,选择 Tools,然后筛选提示。

- 在Power Apps和Power Automate中,选择AI 中心。

在提示词名称旁边,选择三个点(...)。

选择“测试中心”(预览版)。

下面是 Copilot Studio 中 Tools 屏幕的示例:

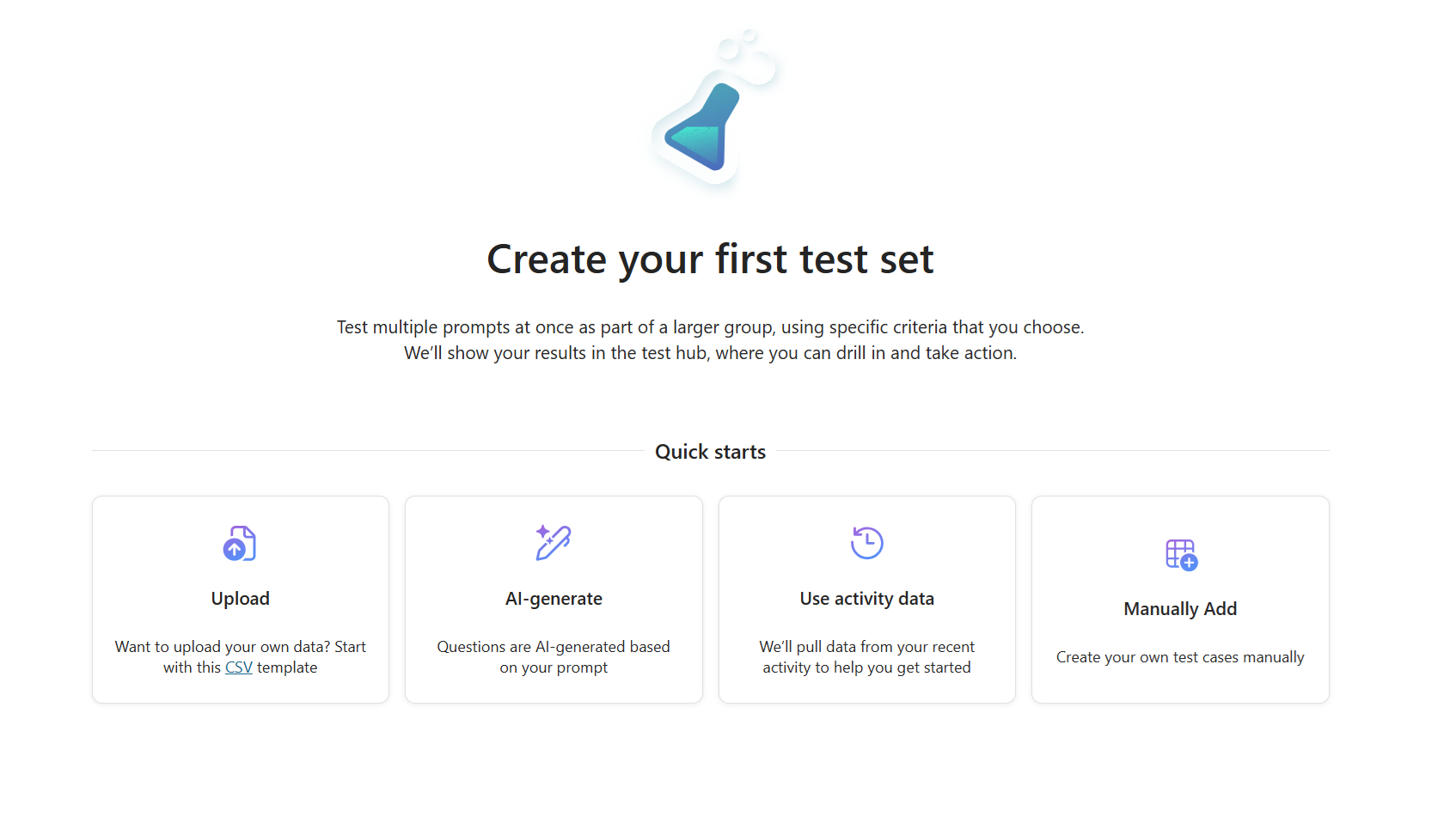

在 Copilot Studio 中,测试中心如以下屏幕截图所示:

使用可用选项之一添加测试用例:

- 上传:允许使用 csv 文件上传测试用例。 如果要检查需要上传的文件的格式,请选择“下载测试数据架构”。

- AI-generate:允许基于提示使用 AI 生成测试用例。

- 使用活动数据:允许你提取最近的提示活动,以帮助你入门。

- 手动添加:允许手动创建测试用例。

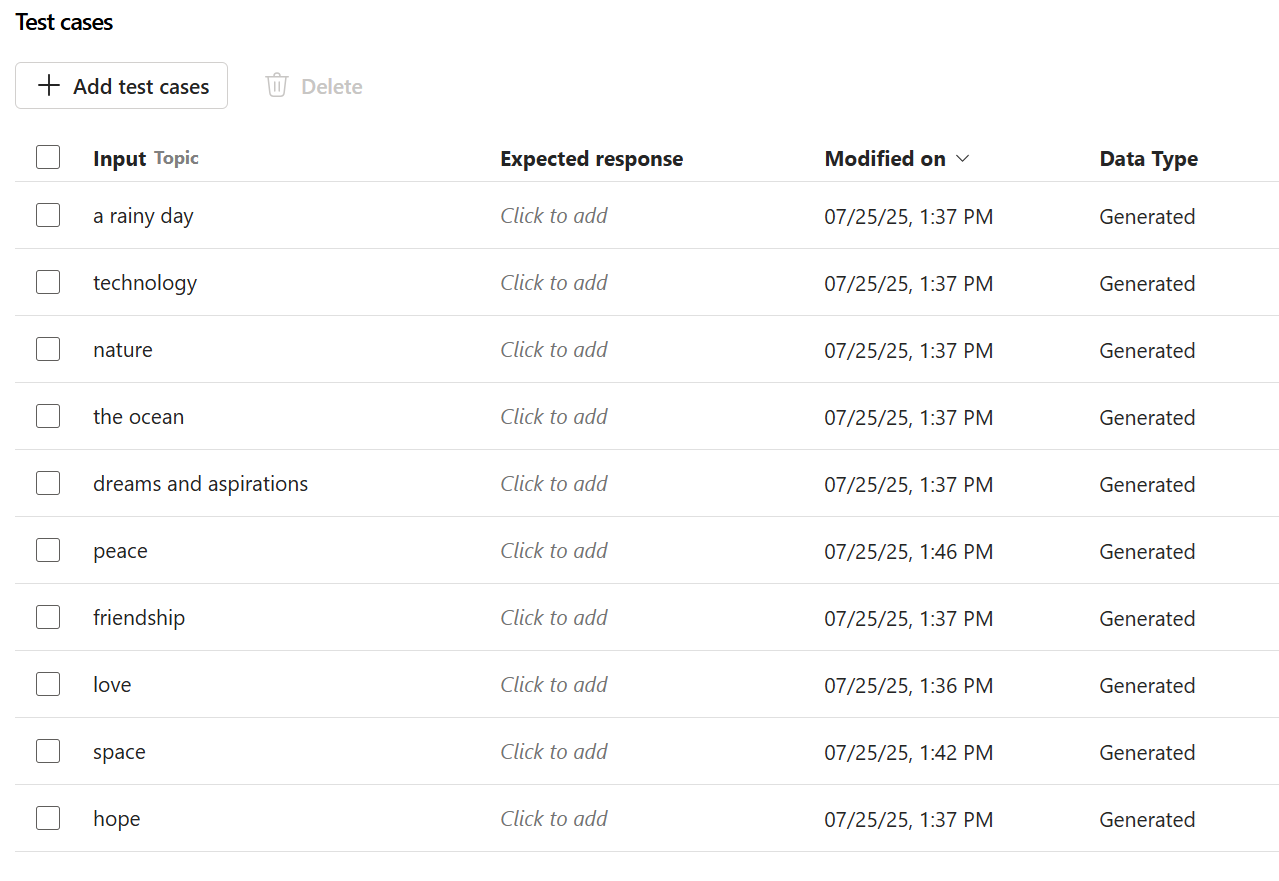

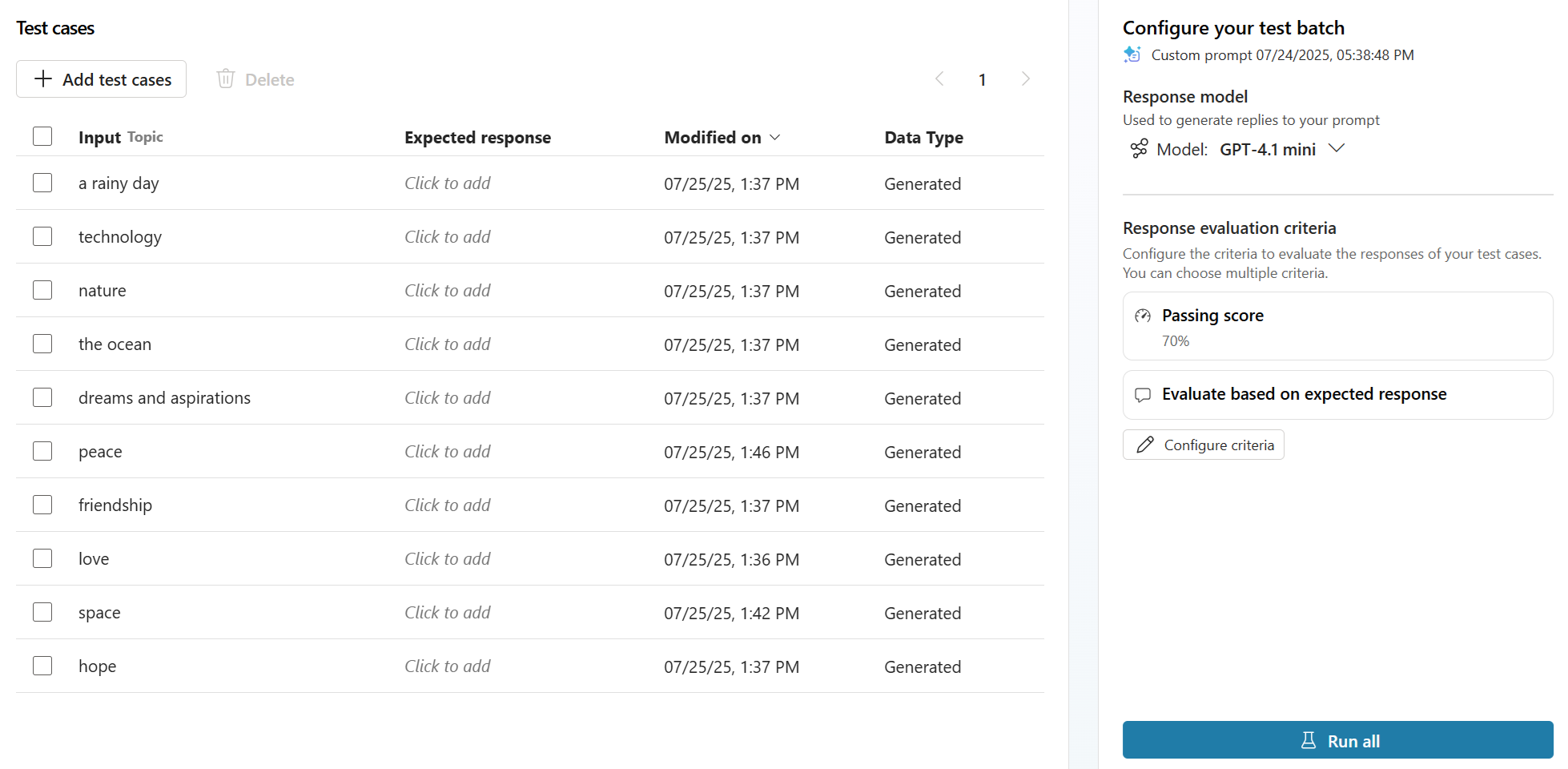

任何选项都有助于创建能够运行的测试用例列表:

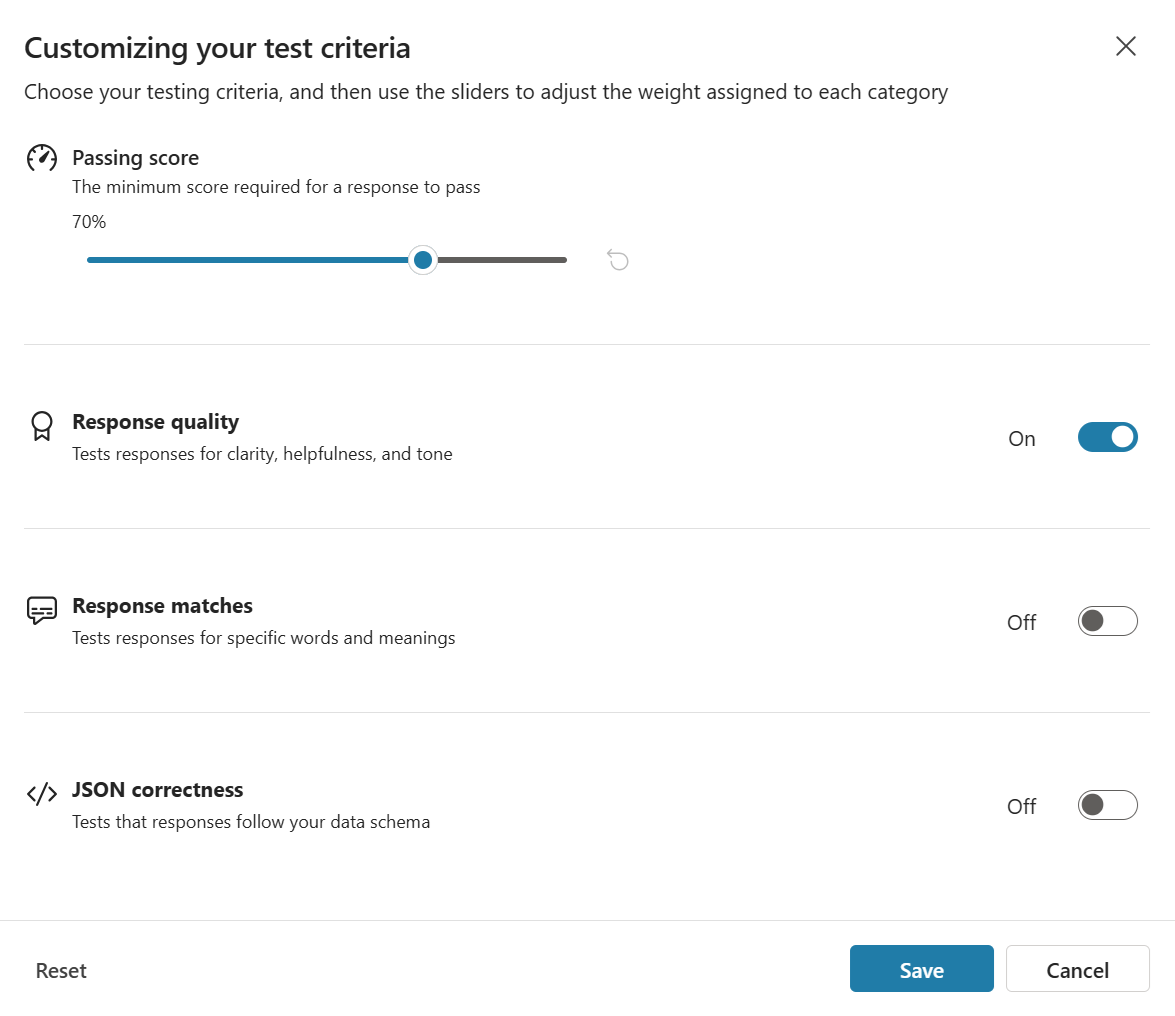

设置评估条件

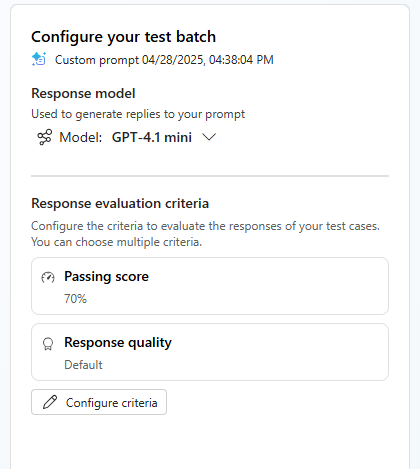

创建测试用例后,选择右侧配置部分中的配置 条件 :

定义 及格分数,这是响应需要达到的最低分数,才能通过。

选择以下预生成条件之一:

- 响应质量:测试响应,以便清晰、有用和语气

- 响应匹配:测试特定字词和含义的响应

- JSON 正确性:测试响应遵循数据架构

这些条件和通过分数决定了在评估过程中如何评估测试用例输出。

运行批处理测试

在测试用例屏幕中,选择“ 全部运行 ”以在所有测试用例上运行评估,或选择要运行的测试用例,然后选择“ 运行”选择。

测试中心根据预定义标准评估结果,提供对提示性能的见解。

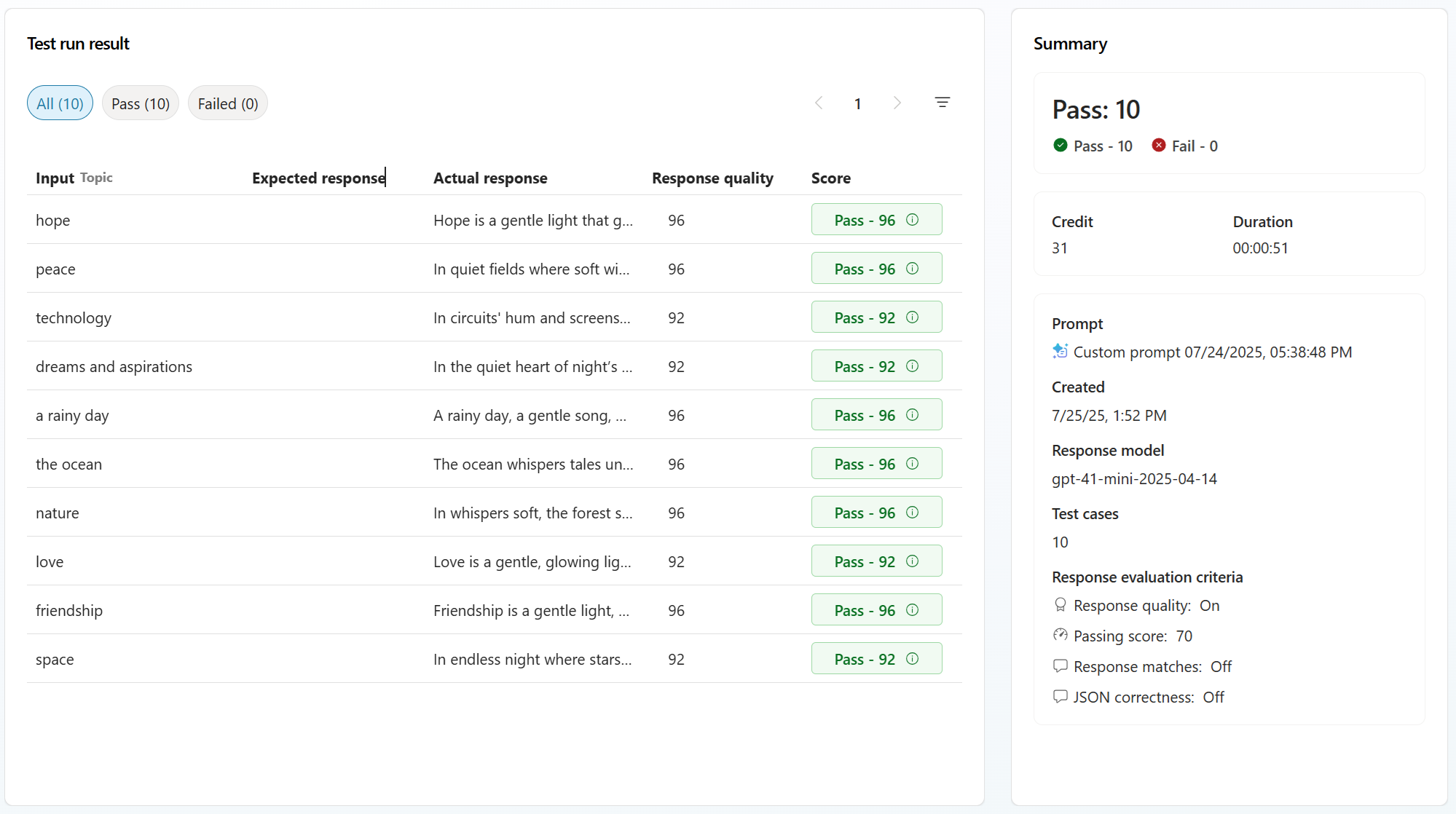

测试用例评估完成后,将显示结果屏幕:

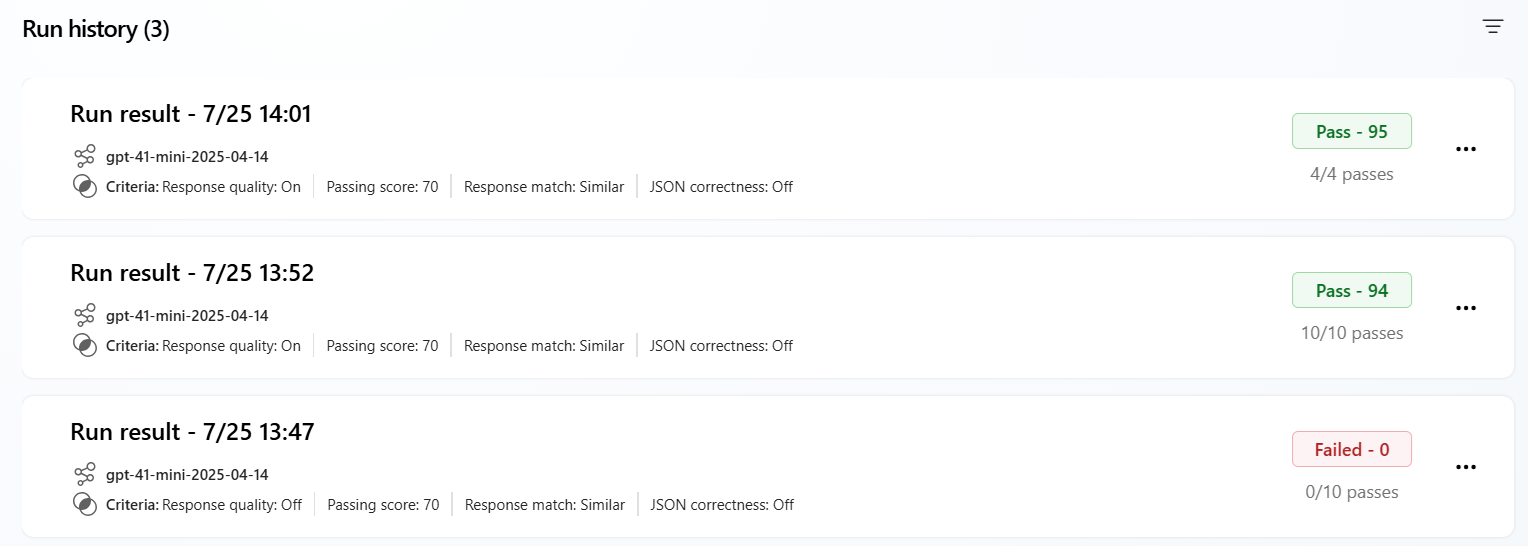

若要访问以前的评估运行,请在 Copilot Studio 中选择屏幕顶部的提示名称,或在 Power Apps 或 Power Automate 中选择 Run history。

若要查看详细信息,请选择评估过程。

运行历史记录允许监视和分析一段时间内的测试结果,包括:

- 跟踪多个测试运行中准确率分数的进度。

- 比较不同运行的结果以识别趋势或回归。

- 了解特定测试结果被判定为通过或失败的原因,从而提供更详细的诊断信息。

对测试案例评估进行迭代,并监控每次评估运行间的显著变化。