注意

混合现实学院教程设计时考虑了 HoloLens (第一代) 和混合现实沉浸式头戴显示设备。 因此,我们认为,对于仍在为这些设备进行开发指南的开发人员来说,保留这些教程非常重要。 这些教程未使用用于HoloLens 2的最新工具集或交互进行更新。 系统会维护这些设备以继续使用受支持的设备。 将来将发布一系列新的教程,演示如何针对HoloLens 2进行开发。 发布这些教程时,会更新此通知,其中包含指向这些教程的链接。

本课程介绍如何使用Azure认知服务以及Microsoft人脸 API 向混合现实应用程序添加人脸识别功能。

Azure人脸 API 是一项Microsoft服务,它为开发人员提供最先进的人脸算法(全部在云中)。 人脸 API 有两个主要功能:具有属性的人脸检测和人脸识别。 它允许开发人员为人脸设置一组组,然后将查询图像发送到服务,以确定人脸属于谁。 有关详细信息,请访问Azure人脸识别页。

完成本课程后,你将获得一个混合现实 HoloLens 应用程序,该应用程序可以:

- 使用 点击手势 使用板载 HoloLens 相机启动图像捕获。

- 将捕获的图像发送到Azure人脸 API 服务。

- 接收 人脸 API 算法的结果。

- 使用简单的用户界面显示匹配人员的姓名。

它介绍如何将人脸 API 服务的结果获取到基于Unity的混合现实应用程序中。

在应用程序中,如何将结果与设计集成由你决定。 本课程旨在教你如何将Azure服务与Unity项目集成。 你的工作是利用从本课程中获得的知识来增强混合现实应用程序。

设备支持

| 课程 | (/previous-versions/mixed-reality/hololens-1/hololens1-hardware) HoloLens | 沉浸式头戴显示设备 |

|---|---|---|

| MR 和 Azure 304:人脸识别 | ✔️ | ✔️ |

注意

虽然本课程主要侧重于 HoloLens,但你也可以将本课程中学到的内容应用于Windows Mixed Reality沉浸式 (VR) 头戴显示设备。 由于沉浸式 (VR) 头戴显示设备没有辅助摄像头,因此你需要将外部摄像头连接到电脑。 随着课程的学习,你将看到有关可能需要采用的任何更改的说明,以支持沉浸式 (VR) 头戴显示设备。

先决条件

注意

本教程面向具有 Unity 和 C# 基本经验的开发人员。 此外,本文档中的先决条件和书面说明表示在撰写 2018 年 5 月 () 时测试和验证的内容。 你可以自由使用最新软件(如 安装工具 一文中所述),但不应假定本课程中的信息与你在较新的软件中发现的信息完全匹配,而不是下面列出的信息。

对于本课程,建议使用以下硬件和软件:

- 与Windows Mixed Reality兼容的开发电脑,用于沉浸式 (VR) 头戴显示设备开发

- 启用了开发人员模式的Windows 10 Fall Creators Update (或更高版本)

- 最新Windows 10 SDK

- Unity 2017.4

- Visual Studio 2017

- 启用了开发人员模式的Windows Mixed Reality沉浸式 (VR) 头戴显示设备或Microsoft HoloLens

- 连接到电脑的相机 (,用于沉浸式头戴显示设备开发)

- 用于Azure设置和人脸 API 检索的 Internet 访问

准备工作

- 为了避免在生成此项目时遇到问题,请尝试在根文件夹或近根文件夹中创建本教程中提到的项目, (长文件夹路径可能会导致生成时) 出现问题。

- 设置并测试 HoloLens。 如果需要支持设置 HoloLens, 请务必访问 HoloLens 设置一文。

- 在开始开发新的 HoloLens 应用时,最好执行校准和传感器优化 (有时可以帮助每个用户) 执行这些任务。

有关校准的帮助,请参阅 HoloLens 校准一文的此链接。

有关传感器优化的帮助,请参阅 HoloLens 传感器优化一文的此链接。

第 1 章 - Azure门户

若要在 Azure 中使用人脸 API 服务,需要配置要提供给应用程序的服务实例。

首先,登录到 Azure 门户。

注意

如果还没有Azure帐户,则需要创建一个。 如果你在课堂或实验室环境中遵循本教程,请向讲师或监考人员请求有关设置新帐户的帮助。

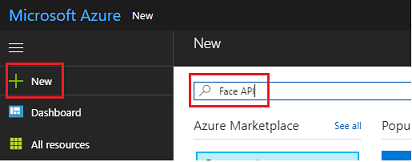

登录后,选择左上角的“ 新建 ”,然后搜索 “人脸 API”,然后按 Enter。

注意

在较新的门户中,“ 新建 ”一词可能会替换为 “创建资源”。

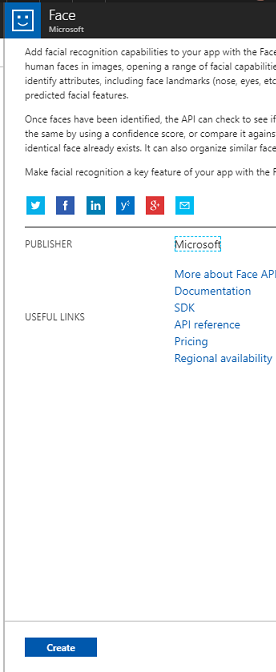

新页面提供 人脸 API 服务的说明。 在此提示符的左下角,选择“ 创建 ”按钮,以创建与服务的关联。

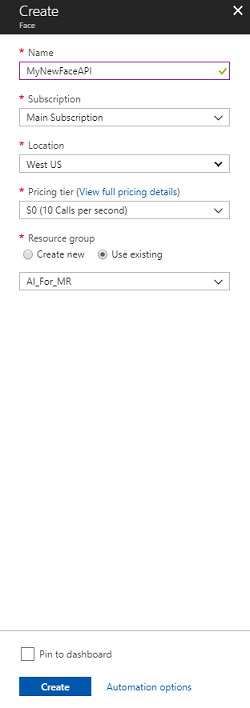

选择“ 创建”后:

插入服务实例的所需名称。

选择订阅。

如果这是首次创建 人脸 API 服务,请选择适合你的定价层,则应可以使用名为 F0) 的免费层 (。

选择资源组或创建新 资源组 。 资源组提供了一种监视、控制访问、预配和管理Azure资产集合计费的方法。 例如,建议将与单个项目关联的所有Azure服务保留 (,例如,这些实验室) 在通用资源组) 下。

若要详细了解Azure资源组,请访问资源组一文。

稍后使用的 UWP 应用 Person Maker 需要使用“美国西部”进行定位。

您还需要确认您了解适用于此服务的条款和条件。

选择“ 创建”。*

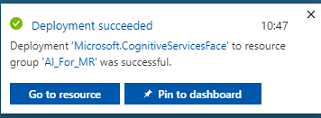

选择“创建”*后,必须等待创建服务,可能需要一分钟时间。

创建服务实例后,门户中会显示一条通知。

选择通知以浏览新的服务实例。

准备就绪后,选择通知中的“ 转到资源 ”按钮,浏览新的服务实例。

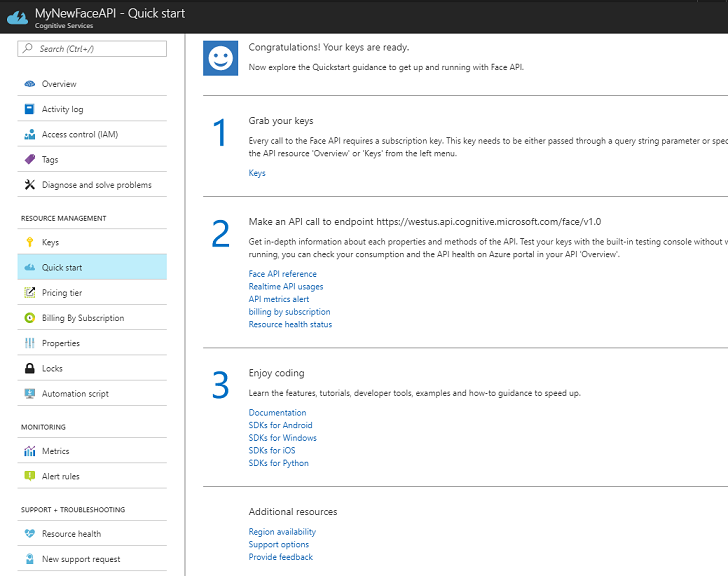

在本教程中,应用程序需要调用服务,这是通过使用服务的订阅“密钥”完成的。 在人脸 API 服务的“快速启动”页中,第一点是“获取密钥”的第一点。

在“ 服务 ”页上,选择蓝色的 “密钥 ”超链接 ((如果位于“快速启动”页) ),或者选择左侧 (服务导航菜单中的“密钥 ”链接() “密钥”图标表示)。以显示密钥。

注意

记下其中一个密钥并对其进行保护,因为稍后需要用到它。

第 2 章 - 使用“Person Maker”UWP 应用程序

请确保下载名为 Person Maker 的预生成 UWP 应用程序。 此应用不是本课程的最终产品,只是一个工具,可帮助你创建Azure条目,这是后续项目所依赖的。

Person Maker 允许创建Azure条目,这些条目与人员和人员组相关联。 应用程序将所有所需的信息都以一种格式放置,FaceAPI 稍后可以使用该格式来识别你添加的人员的人脸。

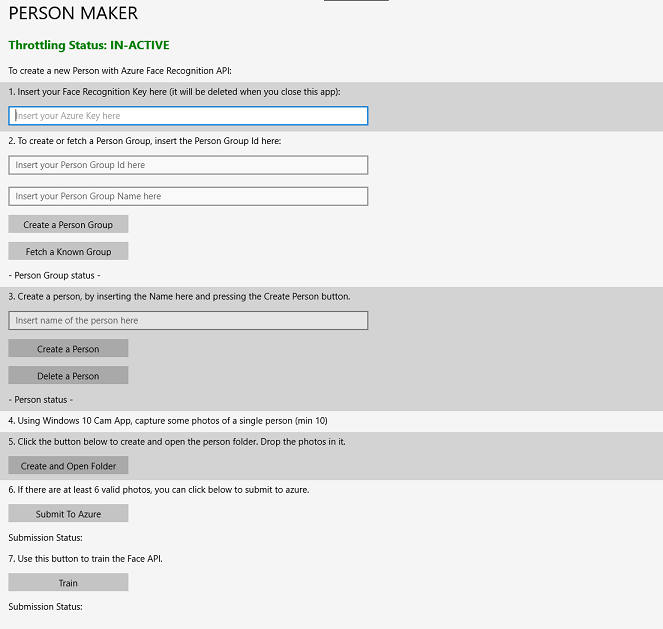

[重要] Person Maker 使用一些基本限制,以帮助确保免费 订阅层的每分钟服务调用次数不超过。 发生限制时,顶部的绿色文本将更改为红色并更新为“ACTIVE”;如果是这种情况,只需等待应用程序 (它将等到它接下来可以继续访问人脸服务,当可以再次) 再次使用它时更新为“IN-ACTIVE”。

此应用程序使用 Microsoft.ProjectOxford.Face 库,使你能够充分利用人脸 API。 此库作为 NuGet 包免费提供。 有关详细信息和类似的 API ,请务必访问 API 参考文章。

注意

这些只是所需的步骤,有关如何执行这些作的说明在文档的更下一步。 Person Maker 应用允许你:

创建 人员组,该组由要与之关联的多个人员组成。 使用 Azure 帐户,可以托管多个人员组。

创建 人员,它是人员组的成员。 每个人都有许多与之关联的 人脸 图像。

将人脸图像分配给人员,以允许Azure人脸 API 服务通过相应的人脸识别人员。

训练Azure人脸 API 服务。

若要训练此应用以识别人员,需要 10 张要添加到“人员组”的每个人的特写照片。 Windows 10 Cam 应用可以帮助你完成这些工作。 必须确保每张照片清晰, (避免模糊、遮挡或与主题) 太远,照片采用 jpg 或 png 文件格式,图像文件大小不大于 4 MB 且不低于 1 KB。

注意

如果你遵循本教程,请不要使用自己的脸进行训练,因为当你打开 HoloLens 时,你无法看自己。 使用同事或同学的面孔。

正在运行 的人员创建者:

打开 PersonMaker 文件夹,然后双击 PersonMaker 解决方案 以使用 Visual Studio 将其打开。

打开 PersonMaker 解决方案后,请确保:

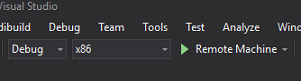

“ 解决方案配置” 设置为 “调试”。

解决方案平台设置为 x86

目标平台是本地计算机。

可能还需要 还原 NuGet 包 (右键单击 解决方案 并选择“ 还原 NuGet 包 ”) 。

单击“ 本地计算机 ”,应用程序将启动。 请注意,在较小的屏幕上,所有内容可能不可见,不过你可以进一步向下滚动以查看它。

从Azure内的人脸 API 服务中插入Azure身份验证密钥。

插入:

- 要分配给人员组的 ID。 ID 必须为小写,不带空格。 记下此 ID,因为稍后在Unity项目中需要此 ID。

- 要分配给人员组的名称 (可以有空格) 。

按 “创建人员组 ”按钮。 按钮下方应会显示一条确认消息。

注意

如果出现“拒绝访问”错误,检查为Azure服务设置的位置。 如本文前面所述,此应用专为“美国西部”设计。

重要

你注意到,还可以单击“ 提取已知组 ”按钮:如果你创建了一个人员组,并且希望使用该组,而不是创建一个新组,则这是适用于的。 请注意,如果单击“创建具有已知 组的人员组 ”,也会提取一个组。

插入要创建的人员的名称。

单击“ 创建人员 ”按钮。

按钮下方应会显示一条确认消息。

如果要删除之前创建的人员,可以将姓名写入文本框中,然后按 “删除人员”

确保知道要添加到组中的人员的 10 (10 张) 照片的位置。

按 “创建”和“打开文件夹” ,打开与该人员关联的文件夹的 Windows 资源管理器。 在 文件夹中添加 10 (10) 图像。 这些格式必须为 JPG 或 PNG 文件格式。

单击“提交到Azure”。 计数器显示提交状态,完成后后跟一条消息。

计数器完成并显示确认消息后,单击“ 训练 ”以训练服务。

该过程完成后,即可进入Unity。

第 3 章 - 设置Unity项目

下面是使用混合现实进行开发的典型设置,因此,它是其他项目的良好模板。

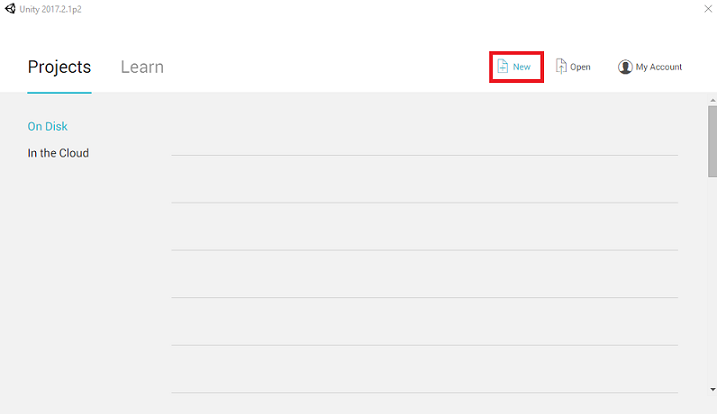

打开Unity并单击“新建”。

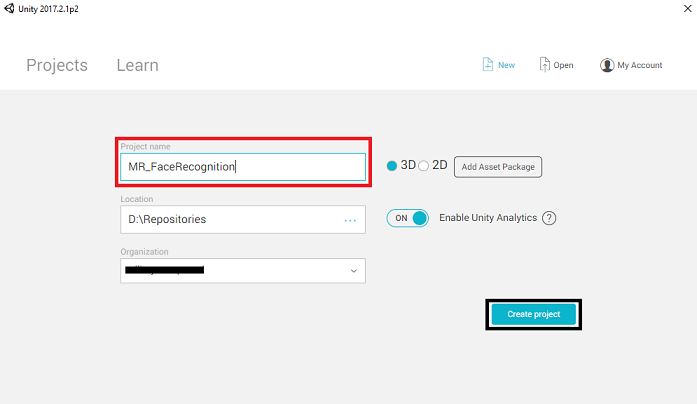

现在需要提供Unity项目名称。 插入 MR_FaceRecognition。 确保项目类型设置为 3D。 将 “位置” 设置为适合你 (记住,离根目录更近更) 。 然后,单击“ 创建项目”。

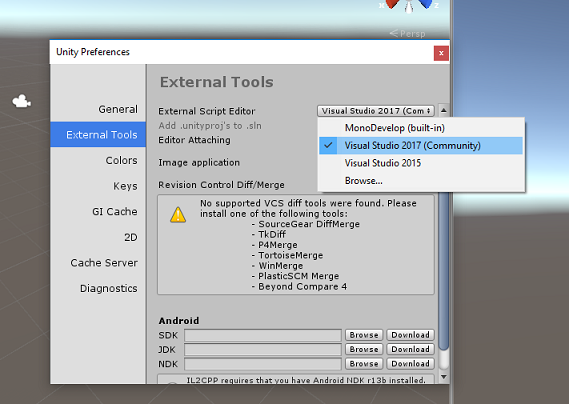

打开Unity后,值得一看的是,默认脚本编辑器设置为 Visual Studio。 转到 “编辑 > 首选项” ,然后从新窗口中导航到“ 外部工具”。 将 外部脚本编辑器 更改为 Visual Studio 2017。 关闭 “首选项” 窗口。

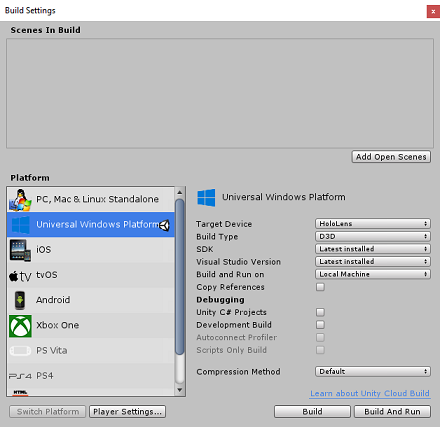

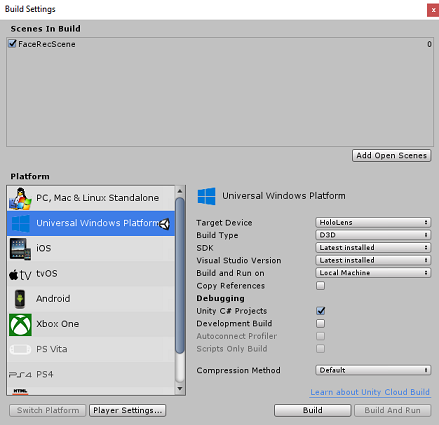

接下来,转到“文件>生成设置”,并通过单击“切换平台”按钮将平台切换为通用 Windows 平台。

转到 “文件 > 生成设置” ,并确保:

目标设备 设置为 HoloLens

对于沉浸式头戴显示设备,请将 “目标设备” 设置为 “任何设备”。

生成类型 设置为 D3D

SDK 设置为 “最新安装”

Visual Studio 版本 设置为 “最新安装”

“生成和运行” 设置为 “本地计算机”

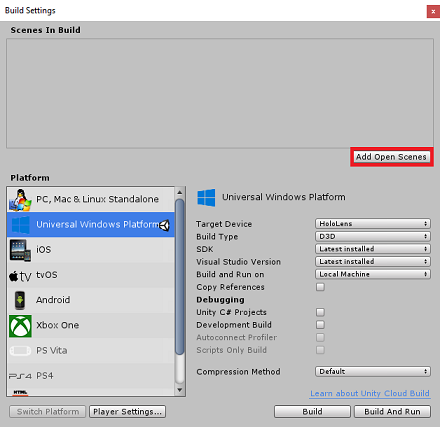

保存场景并将其添加到生成。

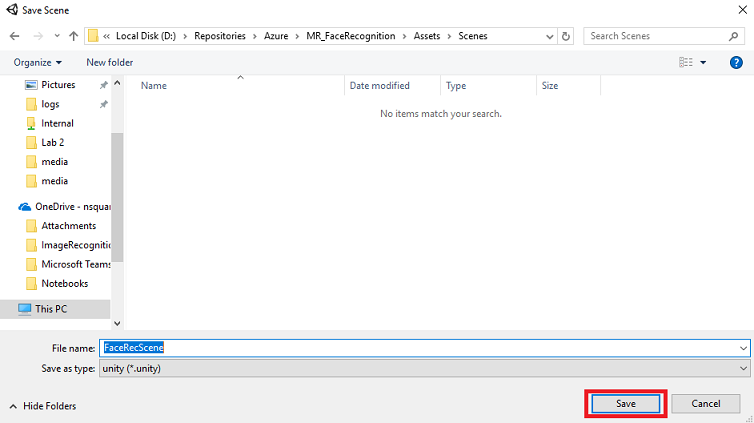

选择 “添加打开场景”。 此时会显示一个保存窗口。

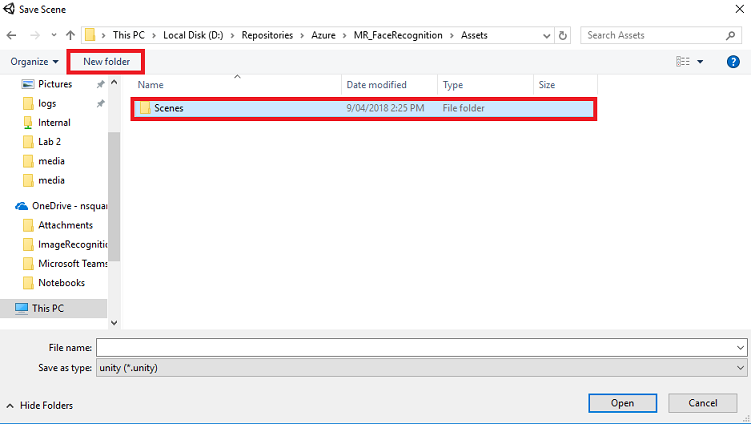

选择“ 新建文件夹 ”按钮,以创建新文件夹,将其命名为 Scenes。

打开新创建的 场景 文件夹,然后在 “文件名:文本”字段中,键入 FaceRecScene,然后按 “保存”。

生成设置中的其余设置目前应保留为默认值。

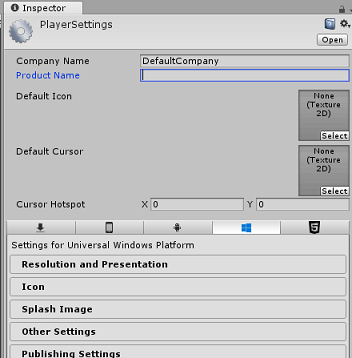

在 “生成设置” 窗口中,单击“ 播放器设置” 按钮,相关面板将在 检查器 所在的空间中打开。

在此面板中,需要验证一些设置:

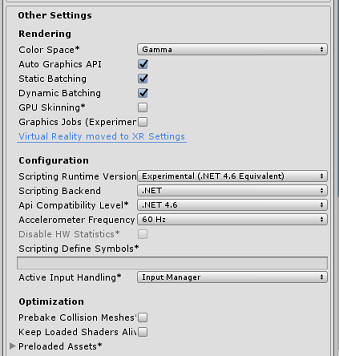

在 “其他设置” 选项卡中:

脚本运行时版本 应为 实验 # A0.NET 4.6 等效) 。 更改此项会触发重启编辑器的需要。

脚本后端 应为 .NET

API 兼容级别 应为 .NET 4.6

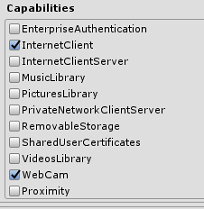

在“发布设置”选项卡的“功能”下,检查:

InternetClient

摄像头

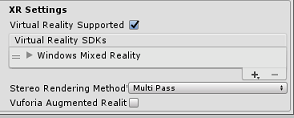

在面板下,在“发布设置) ”下的“XR 设置” (,勾选“支持虚拟现实”,确保已添加Windows Mixed Reality SDK。

返回到“生成设置”,Unity C# 项目不再灰显;勾选旁边的复选框。

关闭“生成设置”窗口。

保存场景和项目 (文件 > 保存场景/文件 > 保存项目) 。

第 4 章 - 主相机设置

重要

如果想要跳过本课程Unity设置组件,并直接进入代码,请随意下载此 .unitypackage,并将其作为自定义包导入项目中。 该包还包括第 5 章中介绍的 Newtonsoft DLL 的导入。 导入后,可以从 第 6 章继续作。

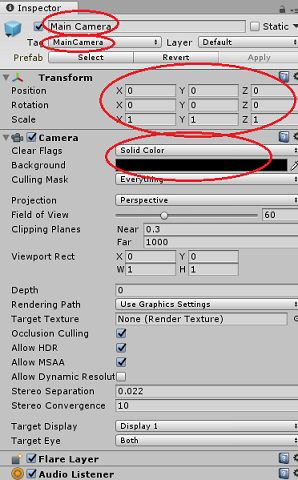

在 “层次结构 ”面板中,选择“ 主相机”。

选择后,可以在检查器面板中看到主相机的所有组件。

Camera 对象必须命名为“主相机”, (记下拼写!)

主相机 标记 必须设置为 MainCamera (记下拼写!)

确保 “转换位置 ”设置为 0、0、0

将 清除标志 设置为 纯色

将相机组件 的背景 色设置为 黑色,Alpha 0 (十六进制代码: #00000000)

第 5 章 - 导入 Newtonsoft.Json 库

重要

如果在 上一章中导入了“.unitypackage”,则可以跳过本章。

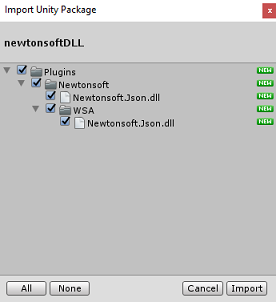

为了帮助你反序列化接收并发送到机器人服务的对象,需要下载 Newtonsoft.Json 库。 在此Unity包文件中,你会发现已使用正确的 Unity 文件夹结构组织的兼容版本。

若要导入库,请执行以下作:

下载 Unity 包。

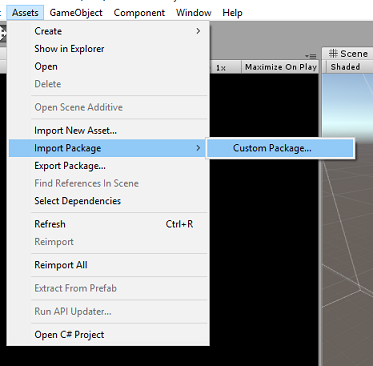

单击“ 资产”、“ 导入包”、“ 自定义包”。

查找下载的Unity包,然后单击“打开”。

确保已勾选包的所有组件,然后单击“ 导入”。

第 6 章 - 创建 FaceAnalysis 类

FaceAnalysis 类的目的是托管与Azure人脸识别服务通信所需的方法。

- 向服务发送捕获图像后,它会对其进行分析,识别其中的人脸,并确定是否有人属于已知人员。

- 如果找到已知人员,则此类在场景中将其名称显示为 UI 文本。

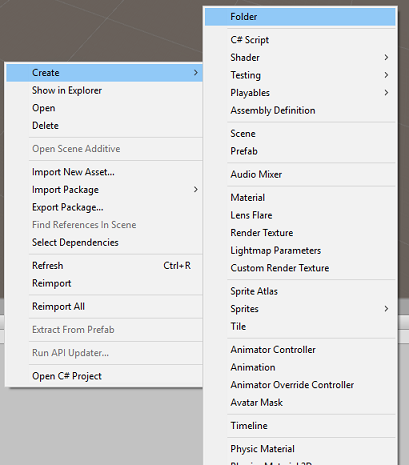

创建 FaceAnalysis 类:

右键单击“项目面板”中的 “资产”文件夹 ,然后单击“ 创建>文件夹”。 调用文件夹 脚本。

双击创建的文件夹将其打开。

右键单击文件夹内,然后单击“ 创建>C# 脚本”。 调用脚本 FaceAnalysis。

双击新的 FaceAnalysis 脚本,使用 Visual Studio 2017 将其打开。

在 FaceAnalysis 类上方输入以下命名空间:

using Newtonsoft.Json; using System.Collections; using System.Collections.Generic; using System.IO; using System.Text; using UnityEngine; using UnityEngine.Networking;现在需要添加用于反序列化的所有对象。 这些对象需要添加到 FaceAnalysis 脚本外部, (下大括号) 下方。

/// <summary> /// The Person Group object /// </summary> public class Group_RootObject { public string personGroupId { get; set; } public string name { get; set; } public object userData { get; set; } } /// <summary> /// The Person Face object /// </summary> public class Face_RootObject { public string faceId { get; set; } } /// <summary> /// Collection of faces that needs to be identified /// </summary> public class FacesToIdentify_RootObject { public string personGroupId { get; set; } public List<string> faceIds { get; set; } public int maxNumOfCandidatesReturned { get; set; } public double confidenceThreshold { get; set; } } /// <summary> /// Collection of Candidates for the face /// </summary> public class Candidate_RootObject { public string faceId { get; set; } public List<Candidate> candidates { get; set; } } public class Candidate { public string personId { get; set; } public double confidence { get; set; } } /// <summary> /// Name and Id of the identified Person /// </summary> public class IdentifiedPerson_RootObject { public string personId { get; set; } public string name { get; set; } }不使用 Start () 和 Update () 方法,因此请立即将其删除。

在 FaceAnalysis 类中,添加以下变量:

/// <summary> /// Allows this class to behave like a singleton /// </summary> public static FaceAnalysis Instance; /// <summary> /// The analysis result text /// </summary> private TextMesh labelText; /// <summary> /// Bytes of the image captured with camera /// </summary> internal byte[] imageBytes; /// <summary> /// Path of the image captured with camera /// </summary> internal string imagePath; /// <summary> /// Base endpoint of Face Recognition Service /// </summary> const string baseEndpoint = "https://westus.api.cognitive.microsoft.com/face/v1.0/"; /// <summary> /// Auth key of Face Recognition Service /// </summary> private const string key = "- Insert your key here -"; /// <summary> /// Id (name) of the created person group /// </summary> private const string personGroupId = "- Insert your group Id here -";注意

将 密钥 和 personGroupId 替换为服务密钥和之前创建的组的 ID。

添加 Awake () 方法,该方法初始化 类,将 ImageCapture 类添加到主相机并调用 Label 创建方法:

/// <summary> /// Initialises this class /// </summary> private void Awake() { // Allows this instance to behave like a singleton Instance = this; // Add the ImageCapture Class to this Game Object gameObject.AddComponent<ImageCapture>(); // Create the text label in the scene CreateLabel(); }添加 CreateLabel () 方法,该方法创建 Label 对象以显示分析结果:

/// <summary> /// Spawns cursor for the Main Camera /// </summary> private void CreateLabel() { // Create a sphere as new cursor GameObject newLabel = new GameObject(); // Attach the label to the Main Camera newLabel.transform.parent = gameObject.transform; // Resize and position the new cursor newLabel.transform.localScale = new Vector3(0.4f, 0.4f, 0.4f); newLabel.transform.position = new Vector3(0f, 3f, 60f); // Creating the text of the Label labelText = newLabel.AddComponent<TextMesh>(); labelText.anchor = TextAnchor.MiddleCenter; labelText.alignment = TextAlignment.Center; labelText.tabSize = 4; labelText.fontSize = 50; labelText.text = "."; }添加 DetectFacesFromImage () 和 GetImageAsByteArray () 方法。 前者请求人脸识别服务检测提交的图像中的任何可能的人脸,而后者需要将捕获的图像转换为字节数组:

/// <summary> /// Detect faces from a submitted image /// </summary> internal IEnumerator DetectFacesFromImage() { WWWForm webForm = new WWWForm(); string detectFacesEndpoint = $"{baseEndpoint}detect"; // Change the image into a bytes array imageBytes = GetImageAsByteArray(imagePath); using (UnityWebRequest www = UnityWebRequest.Post(detectFacesEndpoint, webForm)) { www.SetRequestHeader("Ocp-Apim-Subscription-Key", key); www.SetRequestHeader("Content-Type", "application/octet-stream"); www.uploadHandler.contentType = "application/octet-stream"; www.uploadHandler = new UploadHandlerRaw(imageBytes); www.downloadHandler = new DownloadHandlerBuffer(); yield return www.SendWebRequest(); string jsonResponse = www.downloadHandler.text; Face_RootObject[] face_RootObject = JsonConvert.DeserializeObject<Face_RootObject[]>(jsonResponse); List<string> facesIdList = new List<string>(); // Create a list with the face Ids of faces detected in image foreach (Face_RootObject faceRO in face_RootObject) { facesIdList.Add(faceRO.faceId); Debug.Log($"Detected face - Id: {faceRO.faceId}"); } StartCoroutine(IdentifyFaces(facesIdList)); } } /// <summary> /// Returns the contents of the specified file as a byte array. /// </summary> static byte[] GetImageAsByteArray(string imageFilePath) { FileStream fileStream = new FileStream(imageFilePath, FileMode.Open, FileAccess.Read); BinaryReader binaryReader = new BinaryReader(fileStream); return binaryReader.ReadBytes((int)fileStream.Length); }添加 IdentifyFaces () 方法,该方法请求 人脸识别服务 识别之前在提交的图像中检测到的任何已知人脸。 请求返回已标识人员的 ID,但返回姓名:

/// <summary> /// Identify the faces found in the image within the person group /// </summary> internal IEnumerator IdentifyFaces(List<string> listOfFacesIdToIdentify) { // Create the object hosting the faces to identify FacesToIdentify_RootObject facesToIdentify = new FacesToIdentify_RootObject(); facesToIdentify.faceIds = new List<string>(); facesToIdentify.personGroupId = personGroupId; foreach (string facesId in listOfFacesIdToIdentify) { facesToIdentify.faceIds.Add(facesId); } facesToIdentify.maxNumOfCandidatesReturned = 1; facesToIdentify.confidenceThreshold = 0.5; // Serialize to Json format string facesToIdentifyJson = JsonConvert.SerializeObject(facesToIdentify); // Change the object into a bytes array byte[] facesData = Encoding.UTF8.GetBytes(facesToIdentifyJson); WWWForm webForm = new WWWForm(); string detectFacesEndpoint = $"{baseEndpoint}identify"; using (UnityWebRequest www = UnityWebRequest.Post(detectFacesEndpoint, webForm)) { www.SetRequestHeader("Ocp-Apim-Subscription-Key", key); www.SetRequestHeader("Content-Type", "application/json"); www.uploadHandler.contentType = "application/json"; www.uploadHandler = new UploadHandlerRaw(facesData); www.downloadHandler = new DownloadHandlerBuffer(); yield return www.SendWebRequest(); string jsonResponse = www.downloadHandler.text; Debug.Log($"Get Person - jsonResponse: {jsonResponse}"); Candidate_RootObject [] candidate_RootObject = JsonConvert.DeserializeObject<Candidate_RootObject[]>(jsonResponse); // For each face to identify that ahs been submitted, display its candidate foreach (Candidate_RootObject candidateRO in candidate_RootObject) { StartCoroutine(GetPerson(candidateRO.candidates[0].personId)); // Delay the next "GetPerson" call, so all faces candidate are displayed properly yield return new WaitForSeconds(3); } } }添加 GetPerson () 方法。 通过提供人员 ID,此方法随后请求 人脸识别服务 返回已识别人员的姓名:

/// <summary> /// Provided a personId, retrieve the person name associated with it /// </summary> internal IEnumerator GetPerson(string personId) { string getGroupEndpoint = $"{baseEndpoint}persongroups/{personGroupId}/persons/{personId}?"; WWWForm webForm = new WWWForm(); using (UnityWebRequest www = UnityWebRequest.Get(getGroupEndpoint)) { www.SetRequestHeader("Ocp-Apim-Subscription-Key", key); www.downloadHandler = new DownloadHandlerBuffer(); yield return www.SendWebRequest(); string jsonResponse = www.downloadHandler.text; Debug.Log($"Get Person - jsonResponse: {jsonResponse}"); IdentifiedPerson_RootObject identifiedPerson_RootObject = JsonConvert.DeserializeObject<IdentifiedPerson_RootObject>(jsonResponse); // Display the name of the person in the UI labelText.text = identifiedPerson_RootObject.name; } }请记住,在返回到Unity编辑器之前保存更改。

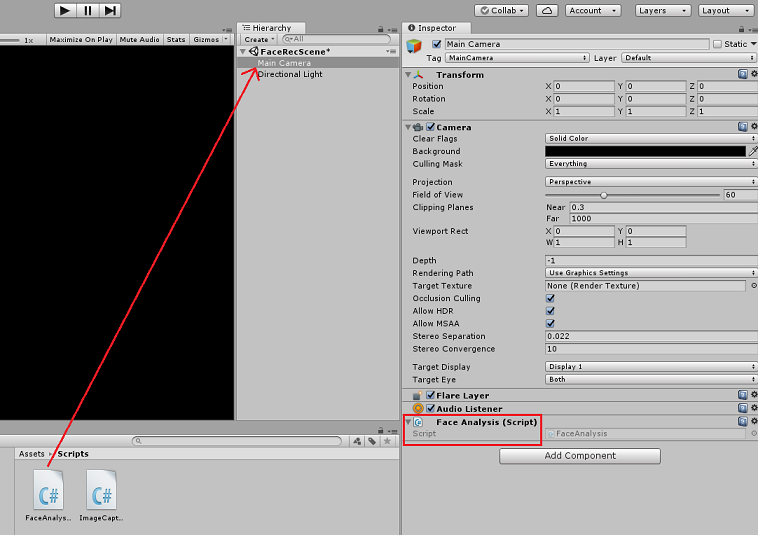

在“Unity编辑器”中,将 FaceAnalysis 脚本从“项目”面板中的“脚本”文件夹拖动到“层次结构”面板中的“主相机”对象。 新脚本组件已添加到主相机。

第 7 章 - 创建 ImageCapture 类

ImageCapture 类的用途是托管与Azure人脸识别服务通信所需的方法,以分析捕获的图像、识别其中的人脸并确定它是否属于已知人员。 如果找到已知人员,则此类在场景中将其名称显示为 UI 文本。

创建 ImageCapture 类:

在创建的 “脚本” 文件夹中右键单击,然后单击“ 创建”、“ C# 脚本”。 调用脚本 ImageCapture。

双击新的 ImageCapture 脚本,使用 Visual Studio 2017 将其打开。

在 ImageCapture 类上方输入以下命名空间:

using System.IO; using System.Linq; using UnityEngine; using UnityEngine.XR.WSA.Input; using UnityEngine.XR.WSA.WebCam;在 ImageCapture 类中,添加以下变量:

/// <summary> /// Allows this class to behave like a singleton /// </summary> public static ImageCapture instance; /// <summary> /// Keeps track of tapCounts to name the captured images /// </summary> private int tapsCount; /// <summary> /// PhotoCapture object used to capture images on HoloLens /// </summary> private PhotoCapture photoCaptureObject = null; /// <summary> /// HoloLens class to capture user gestures /// </summary> private GestureRecognizer recognizer;添加初始化 类并允许 HoloLens 捕获用户手势所需的 Awake () 和 Start () 方法:

/// <summary> /// Initialises this class /// </summary> private void Awake() { instance = this; } /// <summary> /// Called right after Awake /// </summary> void Start() { // Initialises user gestures capture recognizer = new GestureRecognizer(); recognizer.SetRecognizableGestures(GestureSettings.Tap); recognizer.Tapped += TapHandler; recognizer.StartCapturingGestures(); }添加在用户执行点击手势时调用的 TapHandler () :

/// <summary> /// Respond to Tap Input. /// </summary> private void TapHandler(TappedEventArgs obj) { tapsCount++; ExecuteImageCaptureAndAnalysis(); }添加 ExecuteImageCaptureAndAnalysis () 方法,以开始图像捕获过程:

/// <summary> /// Begin process of Image Capturing and send To Azure Computer Vision service. /// </summary> private void ExecuteImageCaptureAndAnalysis() { Resolution cameraResolution = PhotoCapture.SupportedResolutions.OrderByDescending ((res) => res.width * res.height).First(); Texture2D targetTexture = new Texture2D(cameraResolution.width, cameraResolution.height); PhotoCapture.CreateAsync(false, delegate (PhotoCapture captureObject) { photoCaptureObject = captureObject; CameraParameters c = new CameraParameters(); c.hologramOpacity = 0.0f; c.cameraResolutionWidth = targetTexture.width; c.cameraResolutionHeight = targetTexture.height; c.pixelFormat = CapturePixelFormat.BGRA32; captureObject.StartPhotoModeAsync(c, delegate (PhotoCapture.PhotoCaptureResult result) { string filename = string.Format(@"CapturedImage{0}.jpg", tapsCount); string filePath = Path.Combine(Application.persistentDataPath, filename); // Set the image path on the FaceAnalysis class FaceAnalysis.Instance.imagePath = filePath; photoCaptureObject.TakePhotoAsync (filePath, PhotoCaptureFileOutputFormat.JPG, OnCapturedPhotoToDisk); }); }); }添加在照片捕获过程完成时调用的处理程序:

/// <summary> /// Called right after the photo capture process has concluded /// </summary> void OnCapturedPhotoToDisk(PhotoCapture.PhotoCaptureResult result) { photoCaptureObject.StopPhotoModeAsync(OnStoppedPhotoMode); } /// <summary> /// Register the full execution of the Photo Capture. If successful, it will begin the Image Analysis process. /// </summary> void OnStoppedPhotoMode(PhotoCapture.PhotoCaptureResult result) { photoCaptureObject.Dispose(); photoCaptureObject = null; // Request image caputer analysis StartCoroutine(FaceAnalysis.Instance.DetectFacesFromImage()); }请记住,在返回到Unity编辑器之前保存更改。

第 8 章 - 生成解决方案

若要对应用程序执行彻底测试,需要将其旁加载到 HoloLens 上。

在此之前,请确保:

- 第 3 章中提到的所有设置都已正确设置。

- 脚本 FaceAnalysis 附加到主相机对象。

- 身份验证密钥和组 ID 都在 FaceAnalysis 脚本中设置。

此时,你已准备好生成解决方案。 生成解决方案后,即可部署应用程序。

若要开始生成过程,请执行以下命令:

单击“文件”、“保存”,保存当前场景。

转到“文件”,“生成设置”,单击“添加打开场景”。

请确保勾选Unity C# 项目。

按“生成”。 执行此作后,Unity会启动一个文件资源管理器窗口,你需要在其中创建并选择要在其中生成应用的文件夹。 立即在 Unity 项目中创建该文件夹,并将其称为 App。 然后选择“应用”文件夹后,按“选择文件夹”。

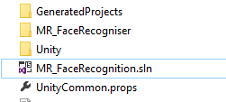

Unity开始生成项目,请输出到 App 文件夹。

Unity完成生成 (可能需要一些时间) ,它将在生成位置打开一个文件资源管理器窗口。

打开 App 文件夹,然后打开新的项目解决方案 (,如上所示,MR_FaceRecognition.sln) 。

第 9 章 - 部署应用程序

若要在 HoloLens 上部署,请:

需要 HoloLens (的 IP 地址用于远程部署) ,并确保 HoloLens 处于 开发人员模式。 为此:

- 佩戴 HoloLens 时,打开“设置”。

- 转到 “网络 & Internet > Wi-Fi > 高级选项”

- 记下 IPv4 地址。

- 接下来,导航回 “设置”,然后导航到 “更新开发人员 & 安全性 > ”

- 将开发人员模式设置为“打开”。

导航到新的Unity版本 (“应用”文件夹) ,并使用 Visual Studio 打开解决方案文件。

在“解决方案配置”中,选择“ 调试”。

在“解决方案平台”中,选择“ x86远程计算机”。

转到 “生成”菜单 ,然后单击“ 部署解决方案”,将应用程序旁加载到 HoloLens。

你的应用现在应显示在 HoloLens 上已安装的应用列表中,准备好启动!

注意

若要部署到沉浸式头戴显示设备,请将 “解决方案平台 ”设置为 “本地计算机”,并将 “配置” 设置为 “调试”,并将 x86 设置为 “平台”。 然后,使用 “生成”菜单,选择“ 部署解决方案”,部署到本地计算机。

第 10 章 - 使用应用程序

佩戴 HoloLens,启动应用。

查看向 人脸 API 注册的人员。 请确保:

- 此人的脸不是太远,而且清晰可见

- 环境照明不太暗

使用点击手势捕获人员图片。

等待应用发送分析请求并接收响应。

如果成功识别此人,则此人的姓名将显示为 UI 文本。

可以每隔几秒钟使用点击手势重复捕获过程。

已完成Azure人脸 API 应用程序

恭喜,你构建了一个混合现实应用,应用Azure人脸识别服务来检测图像中的人脸,并识别任何已知人脸。

奖励练习

练习 1

Azure人脸 API 功能强大,最多可以检测单个图像中的 64 人脸。 扩展应用程序,以便它可以识别其他许多人员中的两个或三张人脸。

练习 2

Azure人脸 API 还能够提供各种属性信息。 将此集成到应用程序中。 与 情感 API 结合使用时,它可能更有趣。