適用於: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

提示

Data Factory in Microsoft Fabric 是下一代的 Azure Data Factory,擁有更簡單的架構、內建 AI 及新功能。 如果你是資料整合新手,建議先從 Fabric Data Factory 開始。 現有的 ADF 工作負載可升級至 Fabric,以存取資料科學、即時分析與報告等新能力。

Data Factory 管線中的 HDInsight Pig 活動,會在您自己的或隨選的 HDInsight 叢集上執行 Pig 查詢。 本文是以資料轉換活動一文為基礎,該文提供了資料轉換和系統支援的轉換活動的一般概覽。

想了解更多,請先閱讀Azure Data Factory或Synapse Analytics的介紹,並在閱讀本文前完成教學:資料轉換。

使用 UI 將 HDInsight Pig 活動新增至管線

若要在管線中使用 HDInsight Pig 活動,請完成下列步驟:

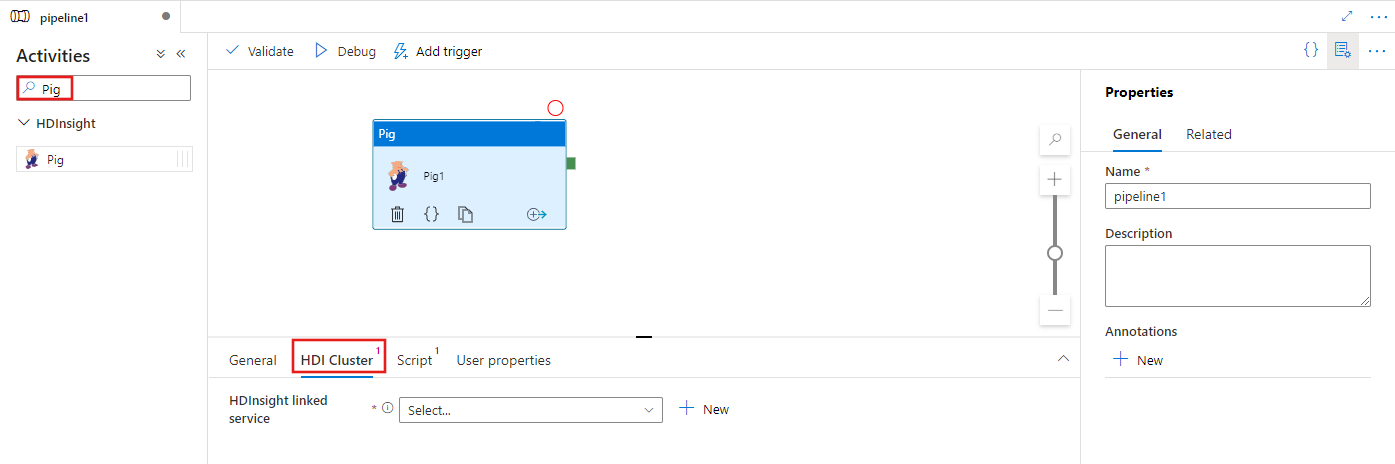

在管線的 Activities 窗格中搜尋 Pig,然後將 Pig 活動拖曳到管線畫布上。

如果畫布上的新 Pig 活動尚未選取,請選取它。

選取 [HDI 叢集] 索引標籤,選取或建立 HDInsight 叢集的新連結服務,該叢集會用來執行 MapReduce 活動。

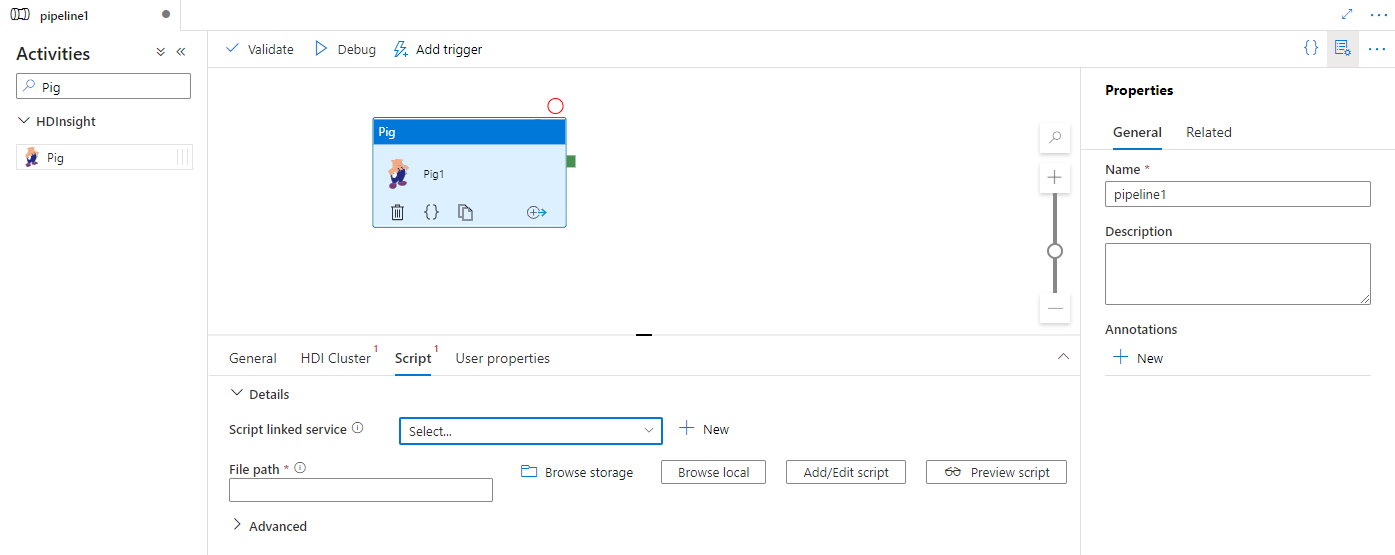

選取 Script 標籤以選擇或建立新的腳本連接服務,連接到您的腳本所託管的 Azure Storage 位置。 指定要在其中執行的類別名稱,以及儲存體位置中的檔案路徑。 您也可以設定進階詳細資料,包含偵錯設定、引數,以及要傳遞至指令碼的參數。

語法

{

"name": "Pig Activity",

"description": "description",

"type": "HDInsightPig",

"linkedServiceName": {

"referenceName": "MyHDInsightLinkedService",

"type": "LinkedServiceReference"

},

"typeProperties": {

"scriptLinkedService": {

"referenceName": "MyAzureStorageLinkedService",

"type": "LinkedServiceReference"

},

"scriptPath": "MyAzureStorage\\PigScripts\\MyPigScript.pig",

"getDebugInfo": "Failure",

"arguments": [

"SampleHadoopJobArgument1"

],

"defines": {

"param1": "param1Value"

}

}

}

語法詳細資料

| 屬性 | 描述 | 必要 |

|---|---|---|

| 名稱 | 活動的名稱 | Yes |

| 說明 | 說明活動用途的文字 | No |

| 型別 | 在 Hive 活動中,活動類型為 HDInsightPig | Yes |

| linkedServiceName | 參考已註冊為連結服務的 HDInsight 叢集。 若要深入了解此已連結的服務,請參閱計算已連結的服務一文。 | Yes |

| scriptLinkedService | 參考用來儲存要執行之 Pig 指令碼的 Azure Storage 連結服務。 此處僅支援 Azure Blob Storage 及 ADLS Gen2 連接的服務。 如果您未指定此連結服務,則使用 HDInsight 連結服務中定義的 Azure Storage Linked Service。 | No |

| scriptPath | 提供 scriptLinkedService 所引用的 Azure Storage 中腳本檔案的路徑。 檔案名稱有區分大小寫。 | No |

| getDebugInfo | 指定何時將日誌檔案複製到 HDInsight 叢集所使用的 Azure Storage(或由 scriptLinkedService 指定)。 允許的值:無、總是或失敗。 預設值:無。 | No |

| 引數 | 指定 Hadoop 作業的引數陣列。 引數會以命令列引數的方式傳遞給每項工作。 | No |

| 定義 | 在 Pig 腳本中將參數指定為鍵值對以供引用。 | No |

相關內容

請參閱下列文章,其說明如何以其他方式轉換資料: