適用於: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

提示

試用 Microsoft Fabric 中的 Data Factory,這是適用於企業的全方位分析解決方案。 Microsoft Fabric 涵蓋從資料移動到資料科學、即時分析、商業智慧和報告的所有項目。 了解如何免費開始新的試用!

在本教學課程中,您會使用 Azure 入口網站來建立資料處理站。 您接著會使用資料複製工具建立管線,以累加方式在 Azure Blob 儲存體間複製全新和變更的檔案。 這會使用 LastModifiedDate 來判斷要複製的檔案。

完成此處的步驟之後,Azure Data Factory 會掃描來源存放區中的所有檔案,依 LastModifiedDate 套用檔案篩選條件,並只將全新或上次後已更新的檔案,複製到目的地存放區。 請注意,如果 Data Factory 掃描大量檔案,您仍應預期需要很長的時間。 即使複製的資料量減少,檔案掃描也相當費時。

附註

如果您不熟悉 Data Factory,請參閱 Data Factory 簡介。

在本教學課程中,您將完成下列工作:

- 建立資料處理站。

- 使用複製資料工具建立管線。

- 監視管線和活動執行。

必要條件

- Azure 訂用帳戶:如果您沒有 Azure 訂用帳戶,請在開始前建立免費帳戶。

- Azure 儲存帳戶:使用 Blob 儲存作為來源與匯出資料存放區。 如果您沒有 Azure 儲存體帳戶,請按照建立儲存體帳戶中的指示。

在 Blob 儲存體中建立兩個容器

請完成下列步驟,為本教學課程準備 Blob 儲存體:

建立名為 source 的容器。 您可以使用各種工具來執行此工作,例如 Azure 儲存體總管。

建立名為 destination 的容器。

建立資料處理站

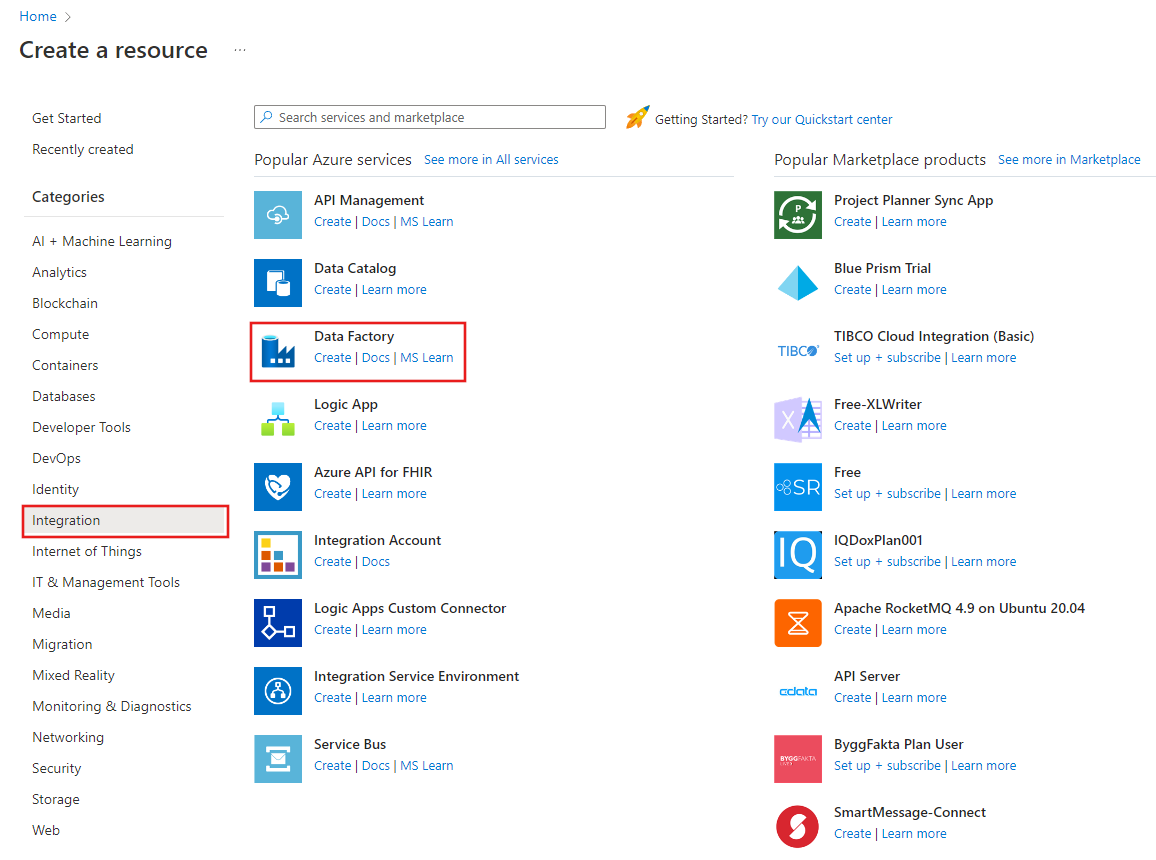

在頂端功能表上,選取 [建立資源>分析>Data Factory ] :

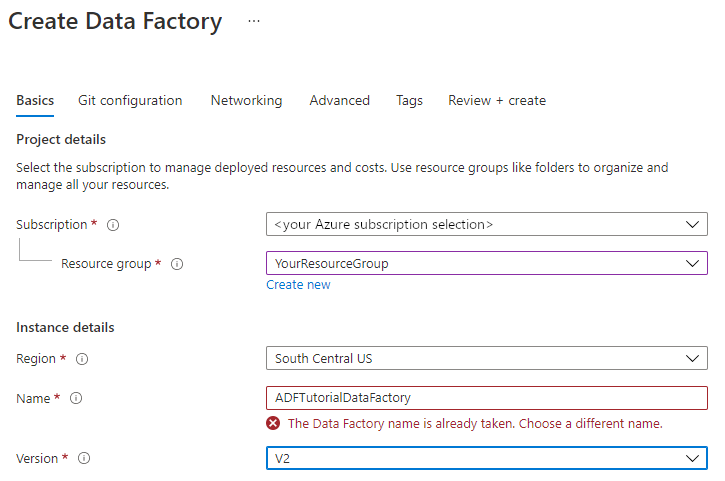

在 [新增資料處理站] 頁面的 [名稱] 下,輸入 ADFTutorialDataFactory。

資料處理站名稱必須為全域唯一名稱。 您可能會收到此錯誤訊息:

如果您收到有關名稱值的錯誤訊息,請輸入不同的資料處理站名稱。 例如,使用您的名稱ADFTutorialDataFactory。 如需 Data Factory 成品的命名規則,請參閱 Data Factory 命名規則。

在 [訂用帳戶] 中,選取您要用來建立新資料處理站的 Azure 訂用帳戶。

在 [資源群組] 中,採取下列任一步驟:

選取 [使用現有項目],然後在清單中選取現有資源群組。

選取 [新建],然後為資源群組輸入名稱。

若要了解資源群組,請參閱使用資源群組管理您的 Azure 資源。

在 [版本] 下,選取 [V2]。

在 [位置] 下,選取資料處理站的位置。 清單中只會顯示支援的位置。 資料處理站使用的資料存放區 (如 Azure 儲存體和 Azure SQL Database) 和計算 (如 Azure HDInsight) 可位於其他位置和區域。

選取 [建立]。

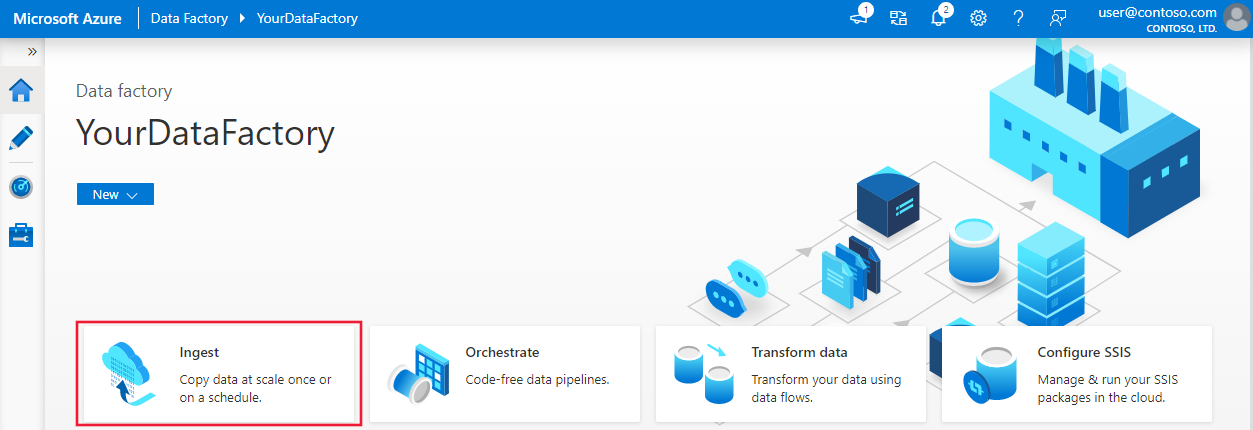

建立資料處理站之後,該資料處理站首頁隨即顯示。

若要在另一個索引標籤中開啟 Azure Data Factory 使用者介面 (UI),請在 [開啟 Azure Data Factory Studio] 圖格上選取 [開啟]:

![Azure Data Factory 的首頁,具有 [開啟 Azure Data Factory Studio] 圖格。](../reusable-content/ce-skilling/azure/media/data-factory/data-factory-home-page.png)

使用複製資料工具建立管線

在 Azure Data Factory 首頁上,選取 [內嵌] 圖格以開啟資料複製工具:

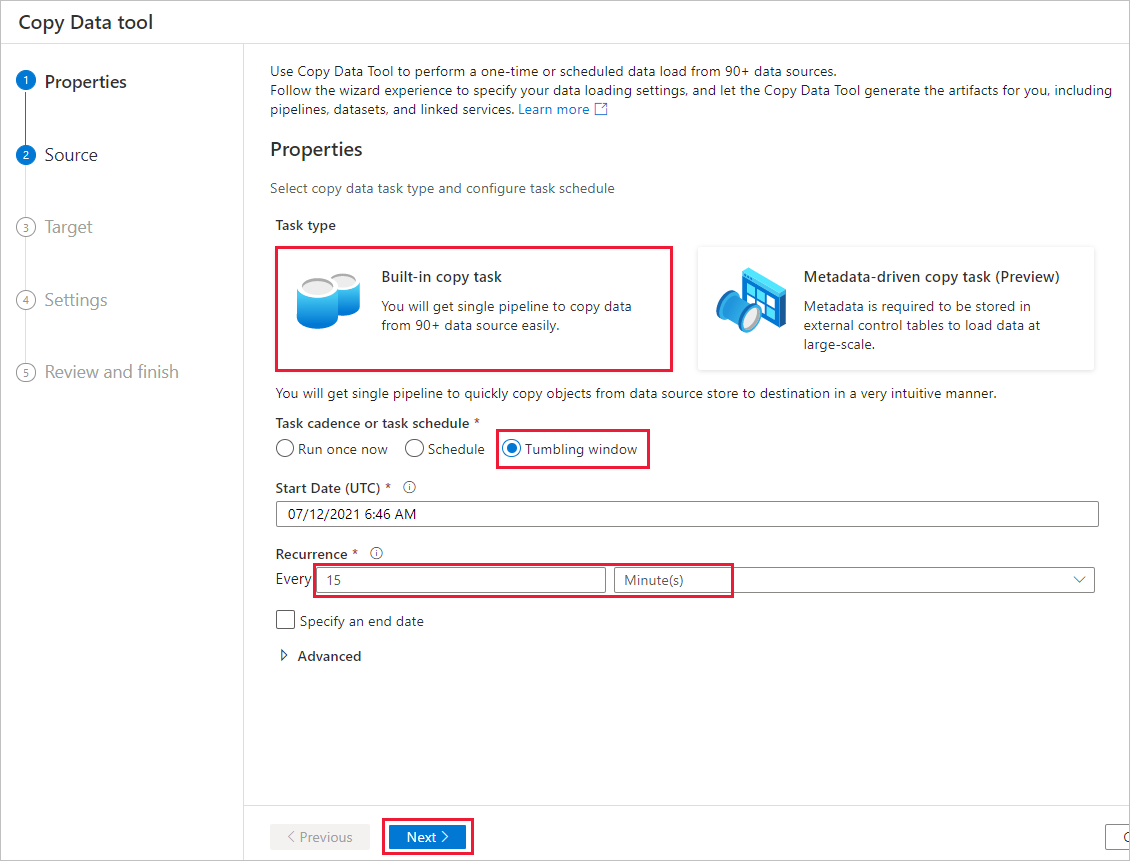

在 [屬性] 頁面上,採取下列步驟:

在 [工作類型] 下方,選取 [內建複製工作]。

在 [工作頻率或工作排程] 下方,選取 [輪轉視窗]。

在 [重複性] 節內,輸入 [15 分鐘]。

選取 [下一步]。

在 [來源資料存放區] 頁面上,完成下列步驟:

選取 [+ 新增連線] 以新增連線。

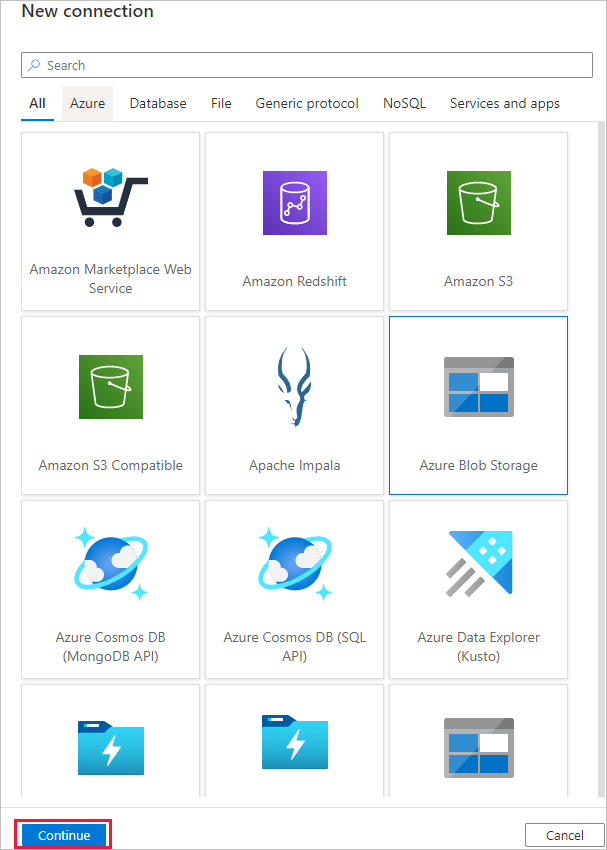

從資源庫選取 [Azure Blob 儲存體],然後選取 [繼續]:

在 [新連線 (Azure Blob 儲存體)] 頁面上,從 [Azure 訂用帳戶] 清單中選取您的 Azure 訂用帳戶,並從 [儲存體帳戶名稱] 清單選取您的儲存體帳戶。 測試連線,然後選取 [建立]。

在 [連線] 區塊中選取新建立的連線。

在 [檔案或資料夾] 區段中,選取 [瀏覽],並選擇 source 資料夾,然後選取 [確定]。

在 [檔案載入行為] 下方,選取 [累加式載入:LastModifiedDate],然後選擇 [二進位複製]。

選取 [下一步]。

![顯示 [源數據存放區] 頁面的螢幕快照。](media/tutorial-incremental-copy-lastmodified-copy-data-tool/source-data-store-page.png)

在 [目的地資料存放區] 頁面上,完成下列步驟:

選取您建立的 AzureBlobStorage 連線。 這是與來源資料存放區相同的儲存體帳戶。

在 [資料夾路徑] 區段中,瀏覽並選取 destination 資料夾,然後選取 [確定]。

選取 [下一步]。

![顯示 [目的地資料存放區] 頁面的螢幕快照。](media/tutorial-incremental-copy-lastmodified-copy-data-tool/destination-data-store-page.png)

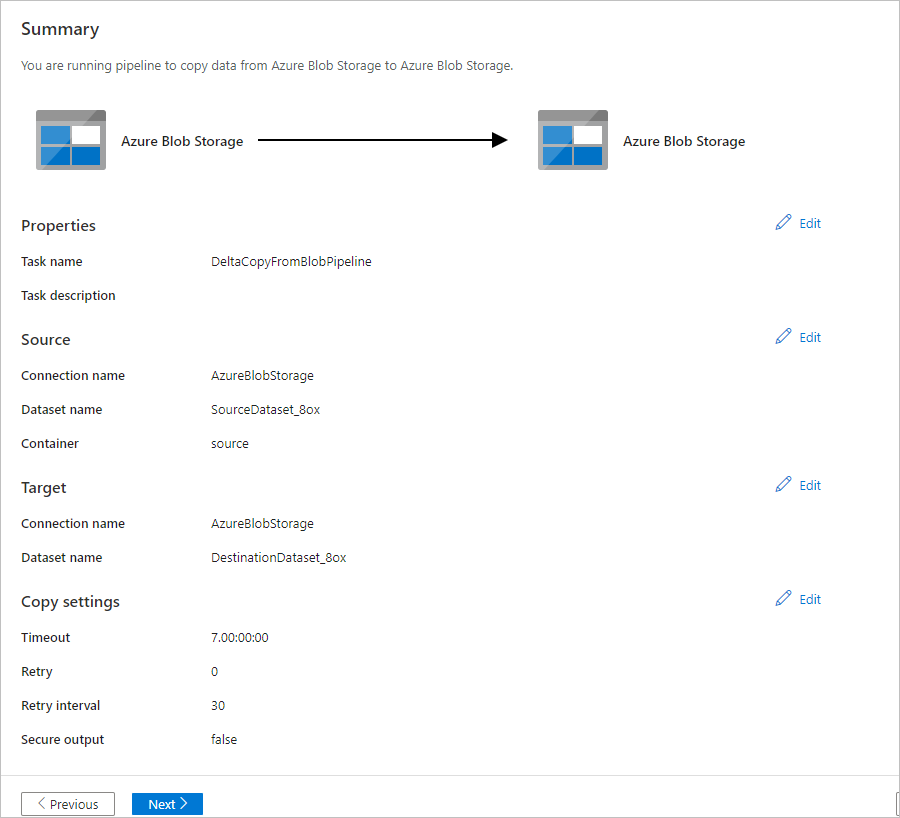

在 [設定] 頁面上的 [工作名稱] 下方,輸入DeltaCopyFromBlobPipeline,然後選取 [下一步]。 Data Factory 會使用指定的工作名稱建立管線。

![顯示 [設定] 頁面的螢幕擷取畫面。](media/tutorial-incremental-copy-lastmodified-copy-data-tool/settings-page.png)

在 [摘要] 頁面上檢閱設定,然後選取 [下一步]。

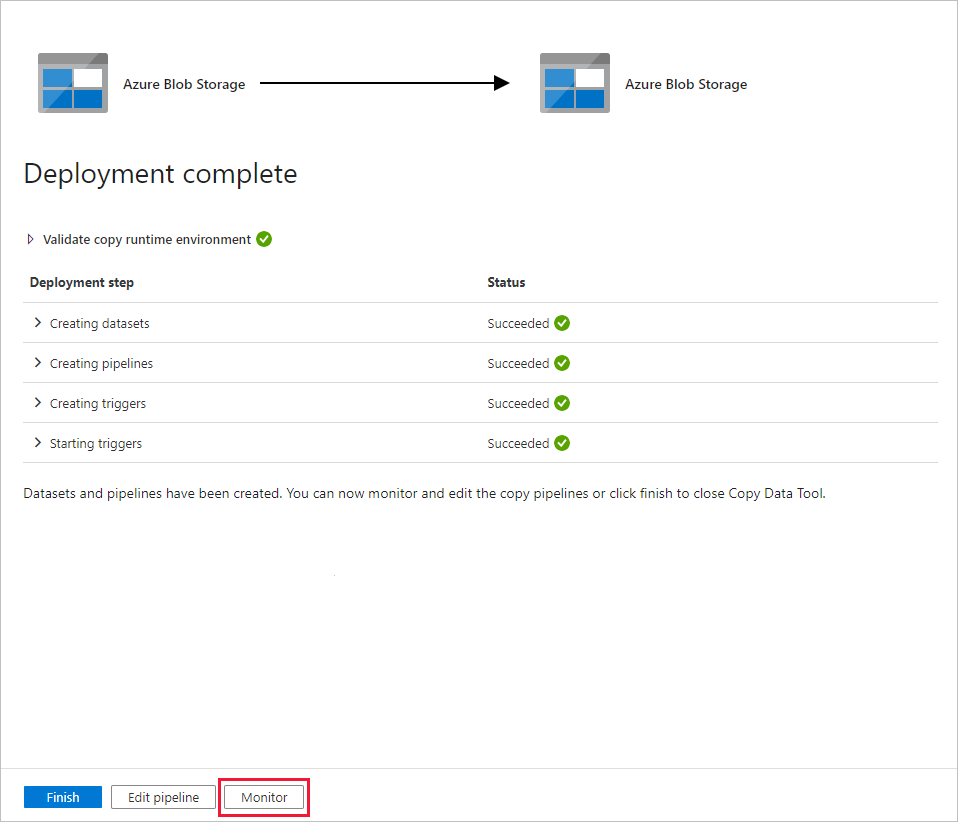

在部署頁面上選取 監視 來監視管道(任務)。

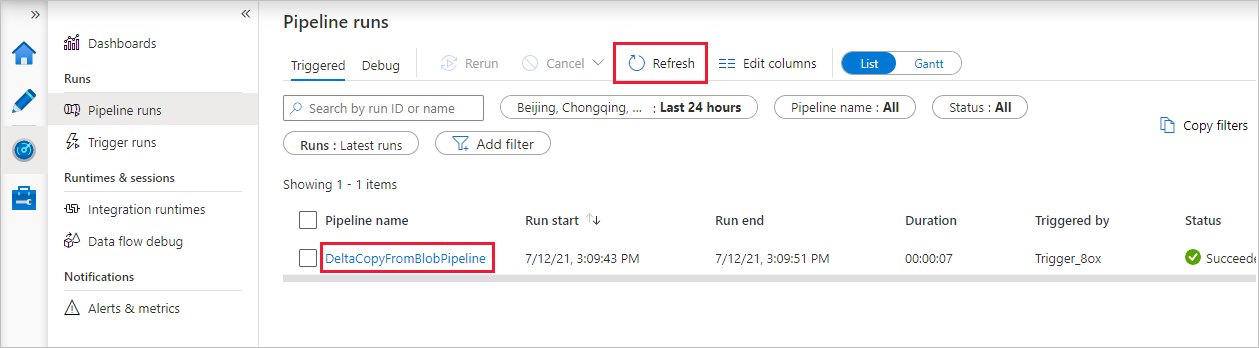

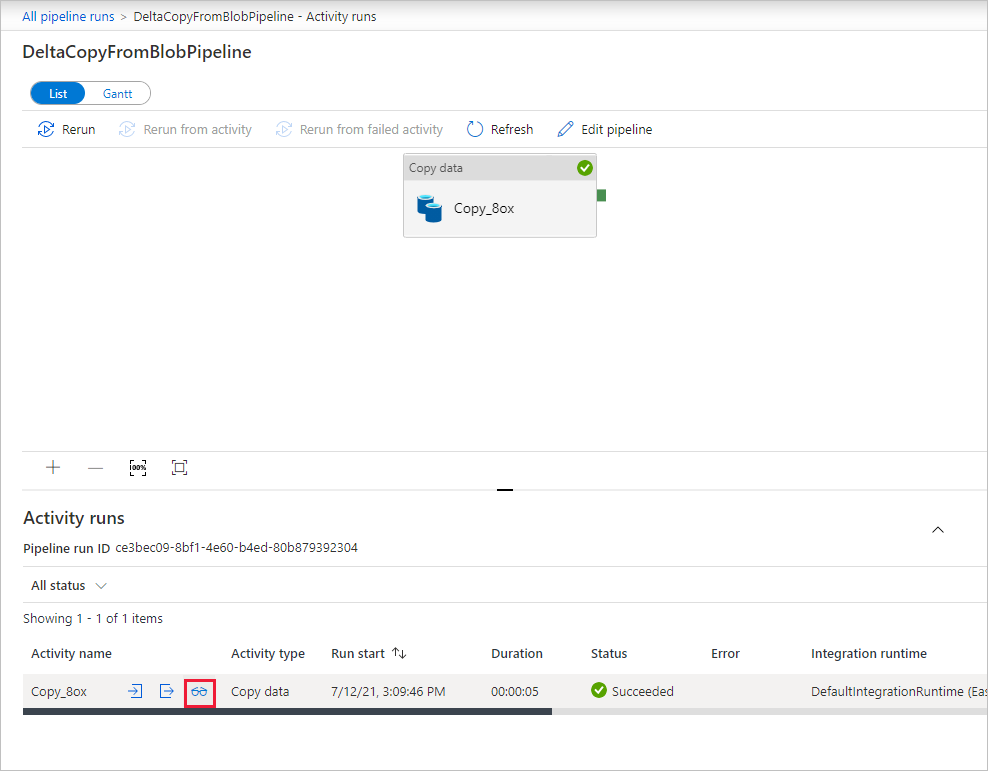

請注意,系統會自動選取左側的 [監視] 索引標籤。 應用程式會切換至 [監視] 索引標籤。您會看到管線的狀態。 選取 [重新整理] 可重新整理清單。 選取 [管線名稱] 下方的連結,以檢視活動執行詳細資料,或再次執行管線。

管線中只有一個活動 (複製活動),所以您只會看到一個項目。 如需複製作業的詳細資訊,請在 [活動執行] 頁面上,選取 [活動名稱] 欄位中的 [詳細資料] 連結 (眼鏡圖示)。 如需屬性的詳細資訊,請參閱複製活動概觀。

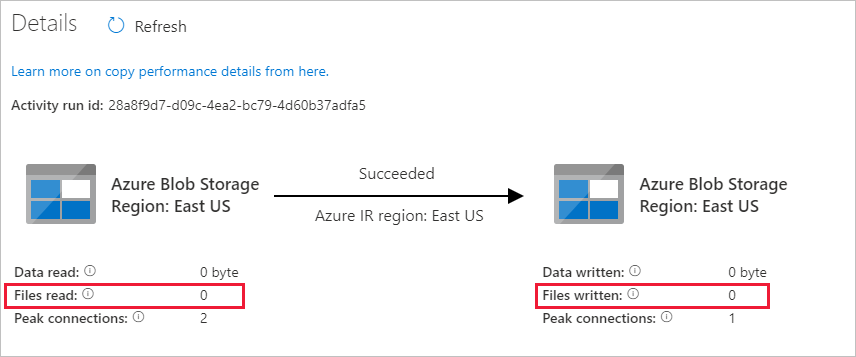

因為 Blob 儲存體帳戶中的來源容器中沒有檔案,所以您不會看到任何檔案複製到帳戶中的目的地容器:

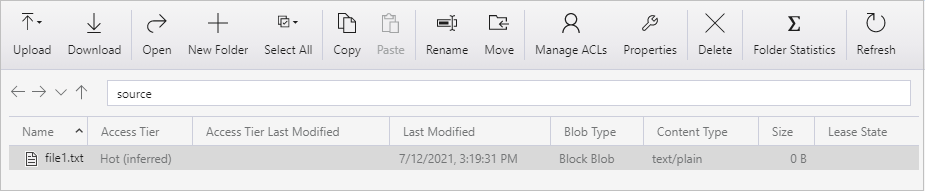

建立空白文字檔,並將其命名為 file1.txt。 將此文字檔上傳到儲存體帳戶中的來源容器。 您可以使用各種工具來執行這些工作,例如 Azure 儲存體總管。

若要回到 [管線執行] 檢視,請在 [活動執行] 頁面的階層連結功能表中,選取 [所有管線執行] 連結,然後等待再次自動觸發相同管線。

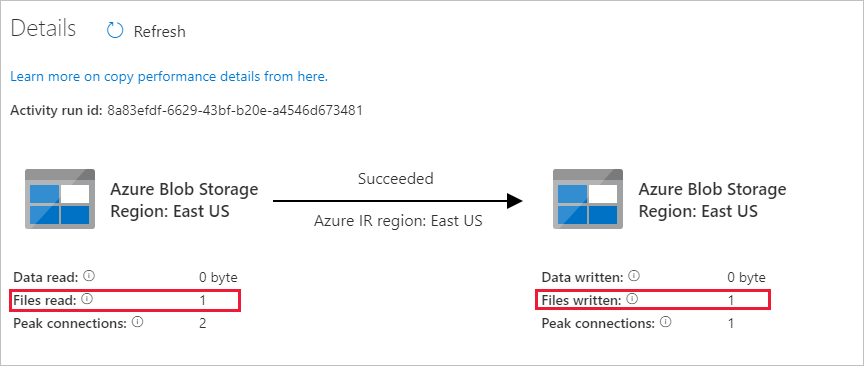

第二個管線執行完成時,請按照先前所述的相同步驟,檢閱活動執行詳細資訊。

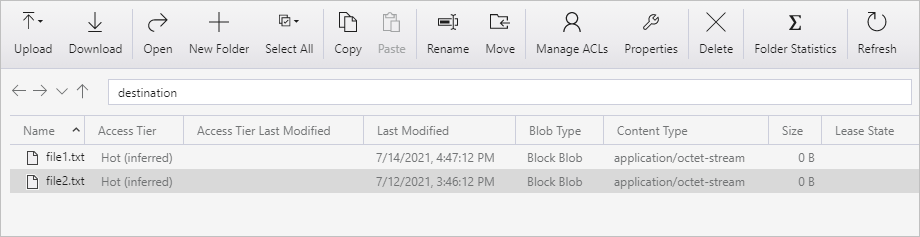

您會看到一個檔案 (file1.txt) 已從來源容器複製到 Blob 儲存體帳戶的目的地容器:

建立另一個空白文字檔,並將其命名為 file2.txt。 將此文字檔上傳到 Blob 儲存體帳戶中的來源容器。

針對第二個文字檔重複步驟 11 和 12。 您將看到在此管線執行期間,只有新檔案 (file2.txt) 從來源容器被複製到您儲存帳戶的目標容器。

您也可以使用 Azure 儲存體總管來掃描檔案,確認只複製一個檔案:

相關內容

移至以下教學課程,了解如何使用 Azure 上的 Apache Spark 叢集來轉換資料: