Microsoft Fabric 中的資料工程可讓使用者設計、建置和維護基礎結構與系統,讓組織能夠收集、儲存、處理和分析大量資料。

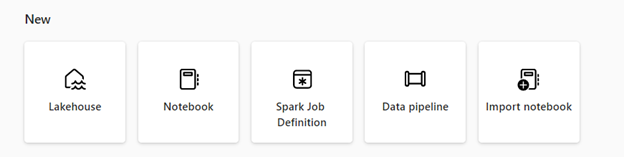

Microsoft Fabric 提供各種資料工程功能,以確保資料易於存取、組織良好而且具有高品質。 若要存取數據工程首頁,請從瀏覽窗格中選取 [工作負載],然後選取 [數據工程 ] 圖格。 從資料工程的首頁上,您可以:

使用 Lakehouse 建立和管理資料

設計管道,將資料複製到 Lakehouse 中

使用 Spark 工作定義將批次/串流工作提交至 Spark 叢集

使用筆記本寫入程式碼,以擷取、準備和轉換資料

Lakehouse

Lakehouses 是可讓組織使用各種工具和架構,在單一位置儲存和管理結構化和非結構化資料,以處理和分析該資料的資料架構。 這些工具和架構可以包含 SQL 型查詢和分析,以及機器學習和其他進階分析技術。

Apache Spark 工作定義

Spark 作業定義是一組指示,可定義如何在 Spark 叢集上執行作業。 其中包含輸入和輸出資料來源、轉換和 Spark 應用程式的組態設定等資訊。 Spark 工作定義可讓您將批次/串流工作提交至 Spark 叢集、將不同的轉換邏輯套用至 Lakehouse 上裝載的資料,以及其他許多項目。

Notebook

筆記本是互動式計算環境,可讓使用者建立及共用包含即時程式碼、方程式、視覺效果和敘事文字的文件。 該平台允許使用者以各種程式設計語言(包括 Python、R 和 Scala)寫入和執行程式碼。 您可以將筆記本用於資料擷取、準備、分析和其他資料相關工作。

管線

管線是一系列步驟,可收集、處理資料,並將其從原始形式轉換成可用於分析和決策的格式。 它們是資料工程的重要元件,因為它們提供一種以可靠、可調整且有效率的方式將資料從來源移至目的地的方式。

當您註冊 Fabric 試用版時,可以在 Microsoft Fabric 免費使用資料工程。 您也可以購買 Microsoft Fabric 容量 或 Fabric 預留容量

相關內容

開始使用資料工程:

- 若要深入了解 Lakehouse,請參閱「什麼是 Microsoft Fabric 中的 Lakehouse?」

- 若要開始使用 lakehouses,請參閱<在 Microsoft Fabric 中建立 Lakehouse>。

- 若要深入了解 Apache Spark 工作定義,請參閱<什麼是 Apache Spark 工作定義?>

- 若要開始使用 Apache Spark 工作定義,請參閱<如何在 Fabric 中建立 Apache Spark 工作定義>。

- 若要進一步了解筆記本,請參閱<創建和執行筆記本>。

- 若要開始使用管線複製活動,請參閱<如何使用複製活動複製資料>。