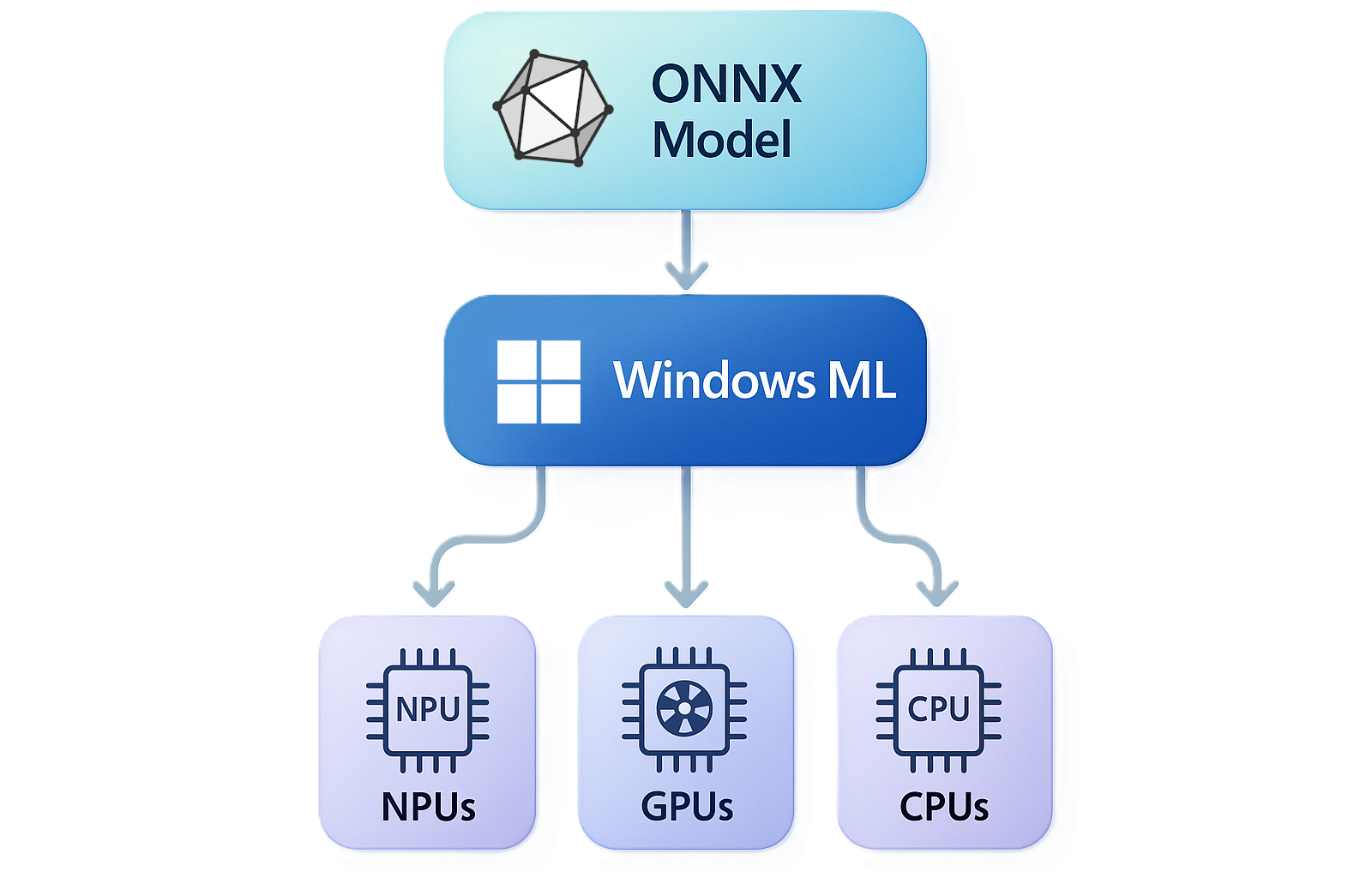

Windows ML 是 Windows 統一且高效能的本地 AI 推論框架,由 ONNX 執行環境驅動。 透過 Windows 機器學習,你可以在本地執行 AI 模型,並透過 Windows 管理並保持更新的可選執行提供者,加速對 NPU、GPU 和 CPU 的推論。 你可以用 PyTorch、TensorFlow/Keras、TFLite、scikit-learn 以及其他框架來搭配 Windows ML 的模型。

主要優點

Windows ML 讓將 AI 推論直接帶入任何 Windows 應用程式變得簡單:

- 在裝置上運行 AI — 模型可在使用者硬體本地運行,保持資料隱私,消除雲端成本,且無需網路連線即可運作。

- 使用你已有的模型 ——帶上 PyTorch、TensorFlow、scikit-learn、Hugging Face 等平台的模型。

- 硬體加速,由 Windows 促進——Windows ML 允許你透過 Windows Update 安裝並保持更新的執行提供者,存取 IHV 專屬的 NPU、GPU 和 CPU——無需將執行提供者打包在你的應用程式中。

- 一個執行時環境,許多應用程式 — 可選擇性地使用 Windows ML 作為共享系統元件,以保持應用程式的輕量化,並讓所有裝置上的應用程式共享相同的最新執行時環境,而不是每個應用程式捆綁自己的副本。

- 業界頂尖效能 — Windows ML 在 NPU 與 GPU 上提供頂尖效能,與專用 SDK 如 RTX 的 TensorRT 或高通的 AI Engine Direct 不相上下。 效能結果會依硬體配置與型號而異——請參閱 加速 AI 模型 以獲得硬體專屬指引。

為什麼要用 Windows ML 而不是 Microsoft ORT?

Windows ML 是 Windows 支援並維護的 ONNX 執行環境 (ORT) 的版本,提供系統全域安裝版本或自成一體版本:

- 相同的 ONNX API — 不修改現有的 ONNX 執行時程式碼

- Windows 支援 — 由 Windows 團隊支援與維護

- 廣泛的硬體支援 — 可在 Windows PC(x64 與 ARM64)及任何硬體配置的 Windows Server 上運行

- 可選的較小應用程式大小 ——選擇依框架部署,並在不同應用程式間共享執行時,而不是自己打包備份

- 可選的常青更新 ——選擇依賴框架的部署,使用者將透過 Windows Update 獲得最新的執行環境

此外,Windows ML 允許你的應用程式 動態取得最新的執行提供者 ,加速你的 AI 模型,而不必在應用程式中攜帶 EP,也不必為不同硬體分別建立獨立建置。

請參考「 開始使用 Windows ML 」來自己試試看!

NPU、GPU 與 CPU 上的硬體加速

Windows ML 讓你能存取執行提供者,加速現代 Windows PC 中三種矽片類別的推論:

- NPU — 電池效率高、持續的裝置推論,擁有 Copilot+ PC 上最強大的 NPU

- GPU — 高吞吐量工作負載,如影像、影片及生成式 AI,通常能在獨立 GPU 上提供最大效能

- CPU — 通用備援,加上優化 IHV 的 CPU 加速

關於完整的硅至EP映射、驅動程式需求及EP採購選項,請參見 加速AI模型。

系統需求

OS :Windows 應用程式 SDK支援的Windows版本- 架構:x64 或 ARM64

- 硬體:任何 PC 配置(CPU、整合/獨立 GPU、NPU)

備註

所有支援的 Windows 版本均支援 CPU 與 GPU(透過 DirectML)。 針對 NPU 及特定 GPU 硬體的硬體優化執行提供者,需 Windows 11 版本 24H2(build 26100)或更高版本。 詳情請參見 Windows ML 執行提供者。

效能最佳化

最新版本的 Windows ML 直接與專用的 GPU 與 NPU 執行提供者協作,提供與過去專用 SDK 如 TensorRT for RTX、AI Engine Direct 及 Intel Extension for PyTorch 相當的純粹效能。 我們設計 Windows ML 以達到業界頂尖的 GPU 與 NPU 效能,且不需您的應用程式發佈專屬 IHV 的 SDK。 效能結果會依硬體配置與型號而異——請參閱 加速 AI 模型 以獲得硬體專屬指引。

將模型轉換為 ONNX

你可以將其他格式的模型轉換成 ONNX,這樣就能在 Windows ML 中使用。 想了解更多,請參考 Foundry 工具包,裡面有 Visual Studio Code 關於如何將模型轉換成 ONNX 格式 的文件。 另請參閱 ONNX 執行階段教學課程 ,以取得將 PyTorch、TensorFlow 和 Hugging Face 模型轉換為 ONNX 的詳細資訊。

模型分布

Windows ML 提供彈性的 AI 模型分發選項:

- 跨應用程式共享模型 - 從任何 CDN 動態下載並分享模型,無需綁定大型檔案

- 本機模型 - 將模型檔案直接包含在應用程式套件中

與 Windows AI 生態系統的整合

Windows ML 是更廣泛 Windows AI 平台的基礎:

- Windows AI API - 用於常見任務的內建模型

- Foundry Local - 即用型 AI 模型

- 自訂模型 - 進階情境下直接Windows ML API 存取

提供意見反應

發現問題或有建議嗎? 在 Windows 應用程式 SDK GitHub 上搜尋或建立問題。