إشعار

يتطلب الوصول إلى هذه الصفحة تخويلاً. يمكنك محاولة تسجيل الدخول أو تغيير الدلائل.

يتطلب الوصول إلى هذه الصفحة تخويلاً. يمكنك محاولة تغيير الدلائل.

التقييم ضروري لضمان التزام وكيلك بمعايير الجودة والسلامة قبل النشر. من خلال إجراء التقييمات أثناء التطوير، تحدد أساسا لأداء وكيلك ويمكنك تحديد حدود قبول، مثل معدل نجاح الالتزام بالمهمة 85%، قبل إصداره للمستخدمين.

في هذا المقال، تتعلم كيفية إجراء تقييم موجه للوكيل ضد وكيل Foundry باستخدام مقيمين مدمجين للجودة والسلامة وسلوك الوكيل. تحديدا، أنت:

- قم بإعداد عميل SDK للتقييم.

- اختر المقيمين من حيث الجودة والسلامة وسلوك الوكيل.

- أنشئ مجموعة بيانات اختبار وأجر تقييما.

- فسر النتائج ودمجها في سير عملك.

نصيحة

للتقييم العام لنماذج وتطبيقات الذكاء الاصطناعي التوليدي، بما في ذلك المقيمين المخصصين، ومصادر البيانات المختلفة، وخيارات SDK الإضافية، انظر تشغيل التقييمات من SDK.

المتطلبات المسبقه

- مشروع Foundry مع وكيل.

- نشر Azure OpenAI مع نموذج GPT يدعم إكمال المحادثة (على سبيل المثال،

gpt-4oأوgpt-4o-mini). - Azure مستخدم الذكاء الاصطناعي في مشروع Foundry.

ملاحظة

بعض ميزات التقييم لها قيود إقليمية. راجع المناطق المدعومة لمزيد من التفاصيل.

إعداد العميل

قم بتثبيت مجموعة تطوير البرمجيات الخاصة ب Foundry وإعداد المصادقة:

pip install "azure-ai-projects>=2.0.0"

أنشئ عميل المشروع. تفترض عينات الكود التالية أنك تشغلها في هذا السياق:

import os

from azure.identity import DefaultAzureCredential

from azure.ai.projects import AIProjectClient

endpoint = os.environ["AZURE_AI_PROJECT_ENDPOINT"]

model_deployment = os.environ["AZURE_AI_MODEL_DEPLOYMENT_NAME"]

credential = DefaultAzureCredential()

project_client = AIProjectClient(endpoint=endpoint, credential=credential)

client = project_client.get_openai_client()

اختيار المقيمين

المقيمون هم وظائف تقوم بتقييم استجابات وكيلك. يستخدم بعض المقيمين نماذج الذكاء الاصطناعي كحكام، بينما يستخدم آخرون قواعد أو خوارزميات. لتقييم الوكيل، اعتبر هذه المجموعة:

| Evaluator | ما الذي يقيس |

|---|---|

| الالتزام بالمهمة | هل يتبع الوكيل تعليمات نظامه؟ |

| Coherence | هل الرد منطقي ومنظم جيدا؟ |

| عنف | هل يحتوي الرد على محتوى عنيف؟ |

لمزيد من المقيمين المدمجين، انظر:

- مقيمو الوكلاء — تقييم مدى فعالية الوكلاء في إدارة المهام والأدوات ونية المستخدم.

- مقيمو الجودة — يقيسون الجودة العامة للردود المولدة.

- مقيمو تشابه النصوص — يقارنون النص المولد مع الإجابات المرجعية باستخدام مقاييس معالجة اللغة الطبيعية.

- مقيمو السلامة — تحديد المحتوى والمخاطر الأمنية المحتملة في الإنتاج المولد.

لبناء مقيمين خاصين، راجع المقيمين المخصصين.

إنشاء مجموعة بيانات اختبار

أنشئ ملف JSONL مع استعلامات اختبار لوكيلك. يحتوي كل سطر على كائن JSON مع query حقل:

{"query": "What's the weather in Seattle?"}

{"query": "Book a flight to Paris"}

{"query": "Tell me a joke"}

قم بتحميل هذا الملف كمجموعة بيانات في مشروعك:

dataset = project_client.datasets.upload_file(

name="agent-test-queries",

version="1",

file_path="./test-queries.jsonl",

)

أجر تقييما

عندما تجري تقييما، ترسل الخدمة كل استعلام اختبار إلى وكيلك، وتلتقط الرد، وتطبق المقيمين المختارين لتقييم النتائج.

أولا، قم بتكوين مقيمينك. يحتاج كل مقيم إلى خريطة بيانات تخبره أين يجد المدخلات:

-

{{item.X}}يشير إلى حقول من بيانات الاختبار الخاصة بك، مثلquery. -

{{sample.output_items}}يشير إلى الاستجابة الكاملة للوكيل، بما في ذلك استدعاءات الأدوات. -

{{sample.output_text}}تشير فقط إلى نص الرد.

المقيمون المدعومون بالذكاء الاصطناعي، مثل الالتزام بالمهمة والتماسك، يتطلب نشر نموذج في initialization_parameters. قد يتطلب بعض المقيمين حقول إضافية، مثل ground_truth تعريفات الأدوات. لمزيد من المعلومات، راجع وثائق المقيم.

testing_criteria = [

{

"type": "azure_ai_evaluator",

"name": "Task Adherence",

"evaluator_name": "builtin.task_adherence",

"data_mapping": {

"query": "{{item.query}}",

"response": "{{sample.output_items}}",

},

"initialization_parameters": {"deployment_name": model_deployment},

},

{

"type": "azure_ai_evaluator",

"name": "Coherence",

"evaluator_name": "builtin.coherence",

"data_mapping": {

"query": "{{item.query}}",

"response": "{{sample.output_text}}",

},

"initialization_parameters": {"deployment_name": model_deployment},

},

{

"type": "azure_ai_evaluator",

"name": "Violence",

"evaluator_name": "builtin.violence",

"data_mapping": {

"query": "{{item.query}}",

"response": "{{sample.output_text}}",

},

},

]

بعد ذلك، أنشئ التقييم. يحدد التقييم مخطط بيانات الاختبار ومعايير الاختبار. يعمل كحاوية لعدة محاولات. جميع الأنظمة التي تعمل تحت نفس التقييم وتتوافق مع نفس المخطط وتنتج نفس مجموعة المقاييس. هذا الاتساق مهم لمقارنة النتائج عبر الجولات.

data_source_config = {

"type": "custom",

"item_schema": {

"type": "object",

"properties": {

"query": {"type": "string"},

},

"required": ["query"],

},

"include_sample_schema": True,

}

evaluation = client.evals.create(

name="Agent Quality Evaluation",

data_source_config=data_source_config,

testing_criteria=testing_criteria,

)

وأخيرا، أنشئ سلسلة ترسل استعلامات الاختبار إلى الوكيل وتطبق المقيمين:

eval_run = client.evals.runs.create(

eval_id=evaluation.id,

name="Agent Evaluation Run",

data_source={

"type": "azure_ai_target_completions",

"source": {

"type": "file_id",

"id": dataset.id,

},

"input_messages": {

"type": "template",

"template": [{"type": "message", "role": "user", "content": {"type": "input_text", "text": "{{item.query}}"}}],

},

"target": {

"type": "azure_ai_agent",

"name": "my-agent", # Replace with your agent name

"version": "1", # Optional; omit to use latest version

},

},

)

print(f"Evaluation run started: {eval_run.id}")

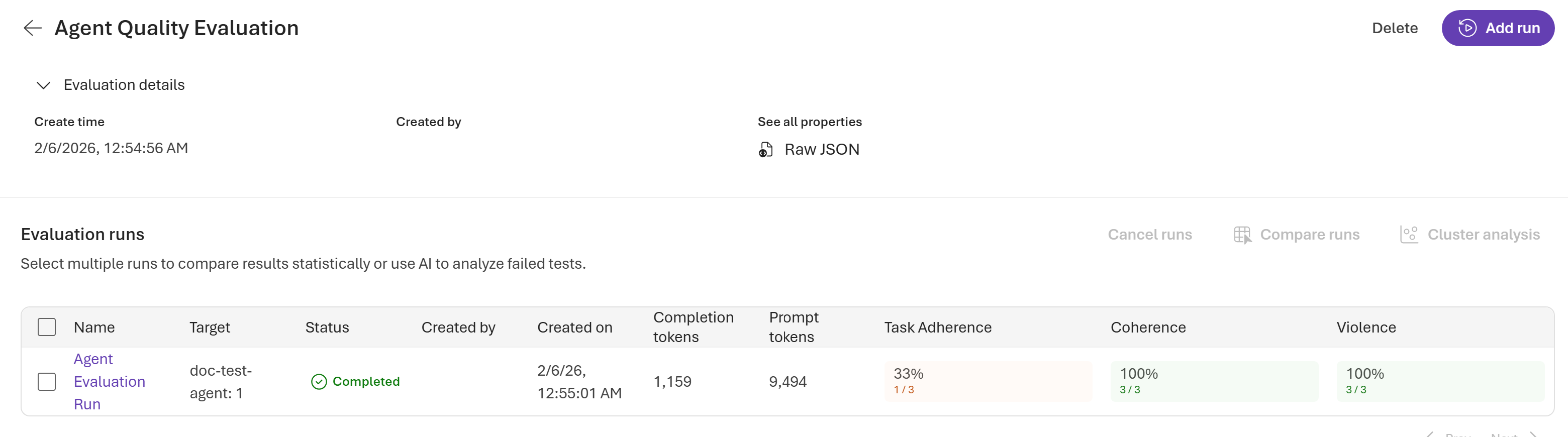

تفسير النتائج

عادة ما تكتمل التقييمات خلال دقائق قليلة، حسب عدد الاستفسارات. قم بإجراء استطلاع للإكمال واسترجاع رابط التقرير لعرض النتائج في بوابة مايكروسوفت فاوندري تحت تبويب التقييمات :

import time

# Wait for completion

while True:

run = client.evals.runs.retrieve(run_id=eval_run.id, eval_id=evaluation.id)

if run.status in ["completed", "failed"]:

break

time.sleep(5)

print(f"Status: {run.status}")

print(f"Report URL: {run.report_url}")

النتائج المجمعة

على مستوى التشغيل، يمكنك رؤية بيانات مجمعة، بما في ذلك عدد النجاح والرسوب، واستخدام الرموز لكل نموذج، والنتائج لكل مقيم:

{

"result_counts": {

"total": 3,

"passed": 1,

"failed": 2,

"errored": 0

},

"per_model_usage": [

{

"model_name": "gpt-4o-mini-2024-07-18",

"invocation_count": 6,

"total_tokens": 9285,

"prompt_tokens": 8326,

"completion_tokens": 959

},

...

],

"per_testing_criteria_results": [

{

"testing_criteria": "Task Adherence",

"passed": 1,

"failed": 2

},

... // remaining testing criteria

]

}

خرج مستوى الصف

كل عملية تقييم تعيد عناصر مخرجات لكل صف في مجموعة بيانات الاختبار الخاصة بك، مما يوفر رؤية تفصيلية لأداء وكيلك. تشمل العناصر المخرجة الاستعلام الأصلي، استجابة الوكيل، نتائج المقيم الفردية مع الدرجات والمنطق، واستخدام الرموز:

{

"object": "eval.run.output_item",

"id": "1",

"run_id": "evalrun_abc123",

"eval_id": "eval_xyz789",

"status": "completed",

"datasource_item": {

"query": "What's the weather in Seattle?",

"response_id": "resp_abc123",

"agent_name": "my-agent",

"agent_version": "10",

"sample.output_text": "I'd be happy to help with the weather! However, I need to check the current conditions. Let me look that up for you.",

"sample.output_items": [

... // agent response messages with tool calls

]

},

"results": [

{

"type": "azure_ai_evaluator",

"name": "Task Adherence",

"metric": "task_adherence",

"label": "pass",

"reason": "Agent followed system instructions correctly",

"threshold": 3,

"passed": true,

"sample":

{

... // evaluator input/output and token usage

}

},

... // remaining evaluation results

]

}

ادمجها في سير عملك

- خط أنابيب CI/CD: استخدم التقييم كبوابة جودة في خط النشر الخاص بك. للاطلاع على التكامل التفصيلي، انظر Run تقييمات مع GitHub Actions.

- مراقبة الإنتاج: راقب وكيلك في الإنتاج باستخدام التقييم المستمر. للحصول على تعليمات الإعداد، راجع إعداد التقييم المستمر.

تحسين ومقارنة الإصدارات

استخدم التقييم لتحسين وكيلك الخاص:

- قم بإجراء تقييم لتحديد نقاط الضعف. استخدم تحليل التجمعات لاكتشاف الأنماط والأخطاء.

- عدل تعليمات أو أدوات الوكيل بناء على النتائج.

- أعد تقييم وقارن الجولات لقياس التحسن.

- كرر ذلك حتى يتم تحقيق معايير الجودة.