Erste Schritte mit dem Chat mithilfe Ihres eigenen Datenbeispiels für Python

In diesem Artikel erfahren Sie, wie Sie den Chat mit Ihrem eigenen Datenbeispiel für Python bereitstellen und ausführen. In diesem Beispiel wird eine Chat-App mit Python, Azure OpenAI Service und Retrieval Augmented Generation (RAG) in Azure AI Search implementiert, um Antworten auf Mitarbeitervorteile in einem fiktiven Unternehmen zu erhalten. Die App wird mit PDF-Dateien wie dem Mitarbeiterhandbuch, einem Leistungsdokument und einer Liste von Unternehmensrollen und Erwartungen versehen.

Indem Sie die Anweisungen in diesem Artikel befolgen, werden Sie:

- Eine Chat-App in Azure bereitstellen.

- Antworten auf zu den Mitarbeitervergünstigungen erhalten.

- Einstellungen ändern, um das Verhalten auf Antworten zu ändern.

Nachdem Sie dieses Verfahren abgeschlossen haben, können Sie mit dem Ändern des neuen Projekts mit Ihrem benutzerdefinierten Code beginnen.

Dieser Artikel ist Teil einer Sammlung von Artikeln, die Ihnen zeigen, wie Sie eine Chat-App mit Azure OpenAI Service und Azure AI Search erstellen.

Weitere Artikel in der Sammlung sind:

Hinweis

In diesem Artikel wird mindestens eine KI-App-Vorlage als Grundlage für die Beispiele und Anleitungen im Artikel verwendet. KI-App-Vorlagen bieten Ihnen gut gepflegte, einfach bereitzustellende Referenzimplementierungen, die helfen, einen qualitativ hochwertigen Ausgangspunkt für Ihre KI-Apps zu gewährleisten.

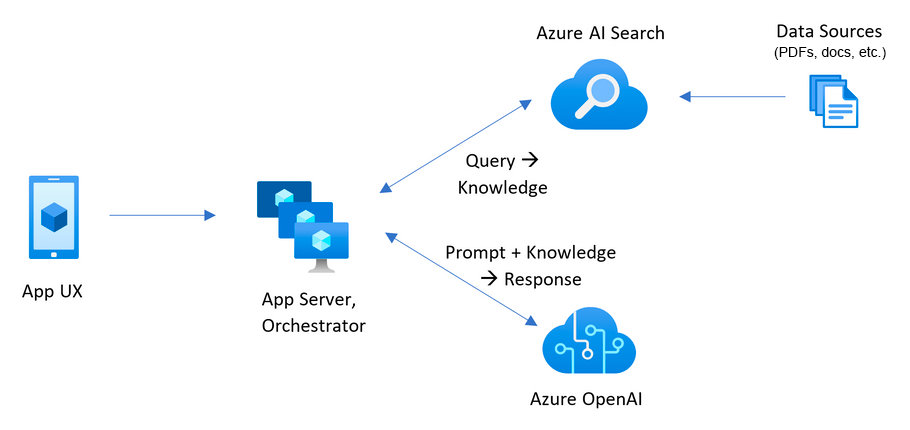

Übersicht über die Architektur

Eine einfache Architektur der Chat-App wird im folgenden Diagramm gezeigt:

Zu den wichtigsten Komponenten der Architektur gehören:

- Eine Webanwendung zum Hosten der interaktiven Chaterfahrung.

- Eine Azure AI Search-Ressource, um Antworten aus Ihren eigenen Daten zu erhalten.

- Ein Azure OpenAI-Dienst, der Folgendes bereitstellt:

- Schlüsselwörter, um die Suche in Ihren eigenen Daten zu verbessern.

- Antworten aus dem OpenAI-Modell.

- Einbettungen aus dem ada-Modell

Kosten

Die meisten Ressourcen in dieser Architektur verwenden einen Basic- oder Verbrauchspreistarif. Die Verbrauchspreise basieren auf der Nutzung, was bedeutet, dass Sie nur für ihre Nutzung bezahlen. Um diesen Artikel abzuschließen, gibt es eine Gebühr, aber sie ist gering. Wenn Sie mit dem Artikel fertig sind, können Sie die Ressourcen löschen, um das Entstehen von Gebühren zu beenden.

Erfahren Sie mehr über die Kosten im Beispielrepo.

Voraussetzungen

Eine Entwicklungscontainerumgebung ist mit allen Abhängigkeiten verfügbar, die zum Abschließen dieses Artikels erforderlich sind. Sie können den Entwicklungscontainer in GitHub Codespaces (in einem Browser) oder lokal mit Visual Studio Code ausführen.

Um diesen Artikel zu verwenden, benötigen Sie die folgenden Voraussetzungen:

- Azure-Abonnement: Kostenloses Azure-Konto

- Azure-Kontoberechtigungen: Ihr Azure-Konto muss über Microsoft.Authorization/roleAssignments/Schreibberechtigungen verfügen, z. B. Benutzerzugriffsadministrator oder Besitzer.

- Zugriff auf Azure OpenAI im gewünschten Azure-Abonnement gewährt. Derzeit wird der Zugriff auf diesen Dienst nur auf Antrag gewährt. Sie können den Zugriff auf Azure OpenAI beantragen, indem Sie das Formular unter https://aka.ms/oai/access ausfüllen. Öffnen Sie ein Problem in diesem Repository, um uns bei einem Problem zu kontaktieren.

- GitHub -Konto

Öffnen Sie die Entwicklungsumgebung

Beginnen Sie jetzt mit einer Entwicklungsumgebung, in der alle Abhängigkeiten installiert sind, um diesen Artikel abzuschließen.

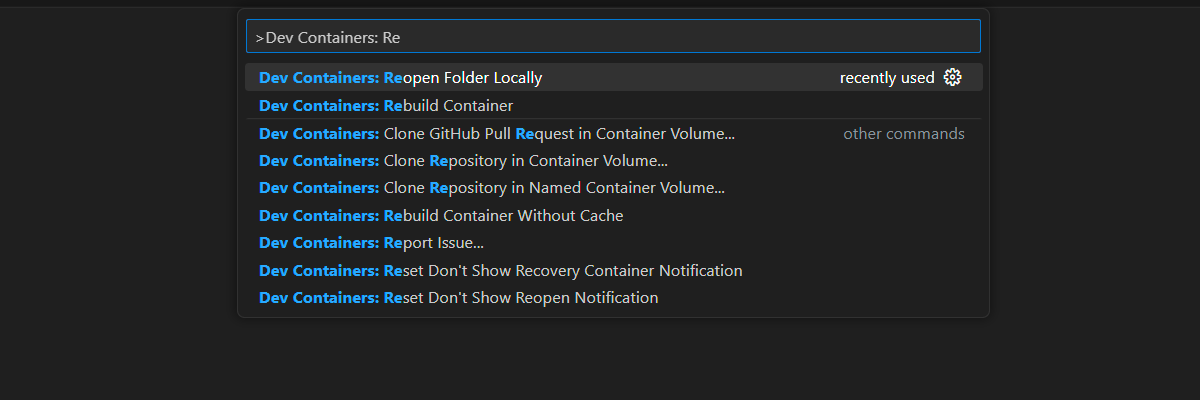

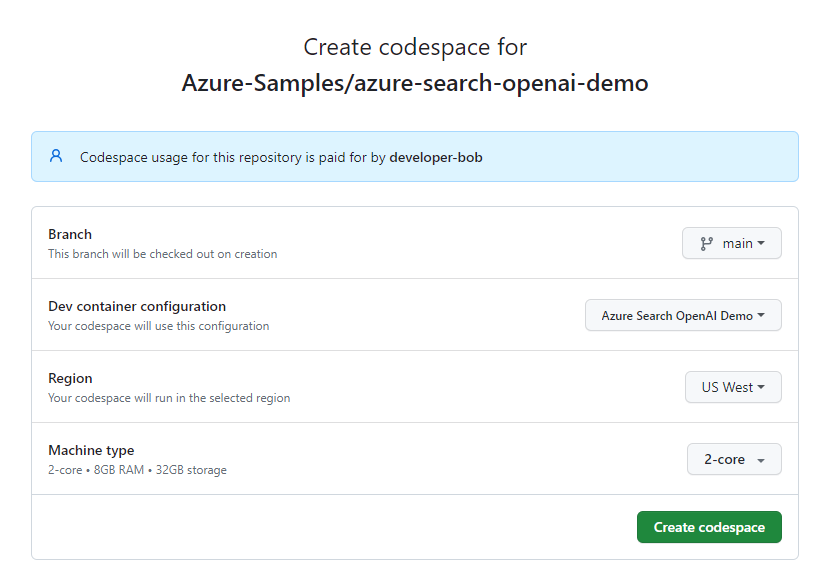

GitHub Codespaces führt einen von GitHub verwalteten Entwicklungscontainer mit Visual Studio Code für Web als Benutzeroberfläche aus. Verwenden Sie für die einfachste Entwicklungsumgebung GitHub Codespaces, damit Sie die richtigen Entwicklertools und Abhängigkeiten vorinstalliert haben, um diesen Artikel abzuschließen.

Wichtig

Alle GitHub-Konten können Codespaces für bis zu 60 Stunden pro Monat mit zwei Kerninstanzen kostenlos verwenden. Weitere Informationen finden Sie im Artikel zu monatlich enthaltener Speicherkapazität und Kernstunden in GitHub Codespaces.

Starten Sie den Prozess, um einen neuen GitHub Codespace im Branch

maindes GitHub-RepositorysAzure-Samples/azure-search-openai-demozu erstellen.Klicken Sie mit der rechten Maustaste auf die folgende Schaltfläche, und wählen Sie den Link in neuen Fenstern öffnen aus, damit sowohl die Entwicklungsumgebung als auch die Dokumentation gleichzeitig verfügbar sind.

Überprüfen Sie auf der Seite Codespace erstellen die Codespace-Konfigurationseinstellungen, und wählen Sie dann Neuen Codespace erstellen aus.

Warten Sie den Start des Codespaces ab. Dieser Startvorgang kann einige Minuten dauern.

Melden Sie sich am unteren Bildschirmrand am Terminal mit der Azure Developer CLI bei Azure an.

azd auth loginKopieren Sie den Code vom Terminal und fügen Sie ihn dann in einen Browser ein. Befolgen Sie die Anweisungen zum Authentifizieren mit Ihrem Azure-Konto.

Die verbleibenden Aufgaben in diesem Artikel finden im Kontext dieses Entwicklungscontainers statt.

Bereitstellen und Ausführen

Das Beispiel-Repository enthält alle Code- und Konfigurationsdateien, die Sie zum Bereitstellen einer Chat-App in Azure benötigen. Die folgenden Schritte führen Sie durch den Prozess der Bereitstellung des Beispiels in Azure.

Bereitstellen einer Chat-App in Azure

Wichtig

In diesem Abschnitt erstellte Azure-Ressourcen verursachen sofortige Kosten, in erster Linie durch die Azure KI-Suche-Ressource. Diese Ressourcen können Kosten verursachen, selbst wenn Sie den Befehl unterbrechen, bevor er vollständig ausgeführt wird.

Führen Sie den folgenden Azure Developer CLI-Befehl aus, um die Azure-Ressourcen bereitzustellen und den Quellcode bereitzustellen:

azd upWenn Sie aufgefordert werden, einen Umgebungsnamen einzugeben, halten Sie ihn kurz und klein geschrieben. Beispiel:

myenv. Sie wird als Teil des Ressourcengruppennamens verwendet.Wenn Sie dazu aufgefordert werden, wählen Sie ein Abonnement aus, in dem die Ressourcen erstellt werden sollen.

Wenn Sie aufgefordert werden, einen Ort zum ersten Mal auszuwählen, wählen Sie einen Ort in Ihrer Nähe aus. Dieser Speicherort wird für die meisten Ressourcen einschließlich Hosting verwendet.

Wenn Sie zur Eingabe eines Speicherorts für das OpenAI-Modell oder für die Document Intelligence-Ressource aufgefordert werden, wählen Sie den Speicherort aus, der Ihnen am nächsten kommt. Wenn derselbe Speicherort wie Ihr erster Speicherort verfügbar ist, wählen Sie diesen Speicherort aus.

Warten Sie 5 oder 10 Minuten nach der Bereitstellung der App, bevor Sie fortfahren.

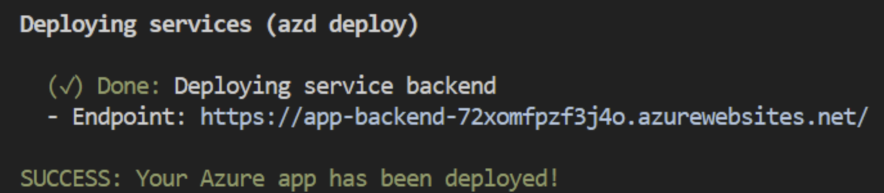

Nachdem die Anwendung erfolgreich bereitgestellt wurde, wird eine URL im Terminal angezeigt.

Wählen Sie diese URL aus, die als

(✓) Done: Deploying service webappbeschriftet ist, um die Chatanwendung in einem Browser zu öffnen.

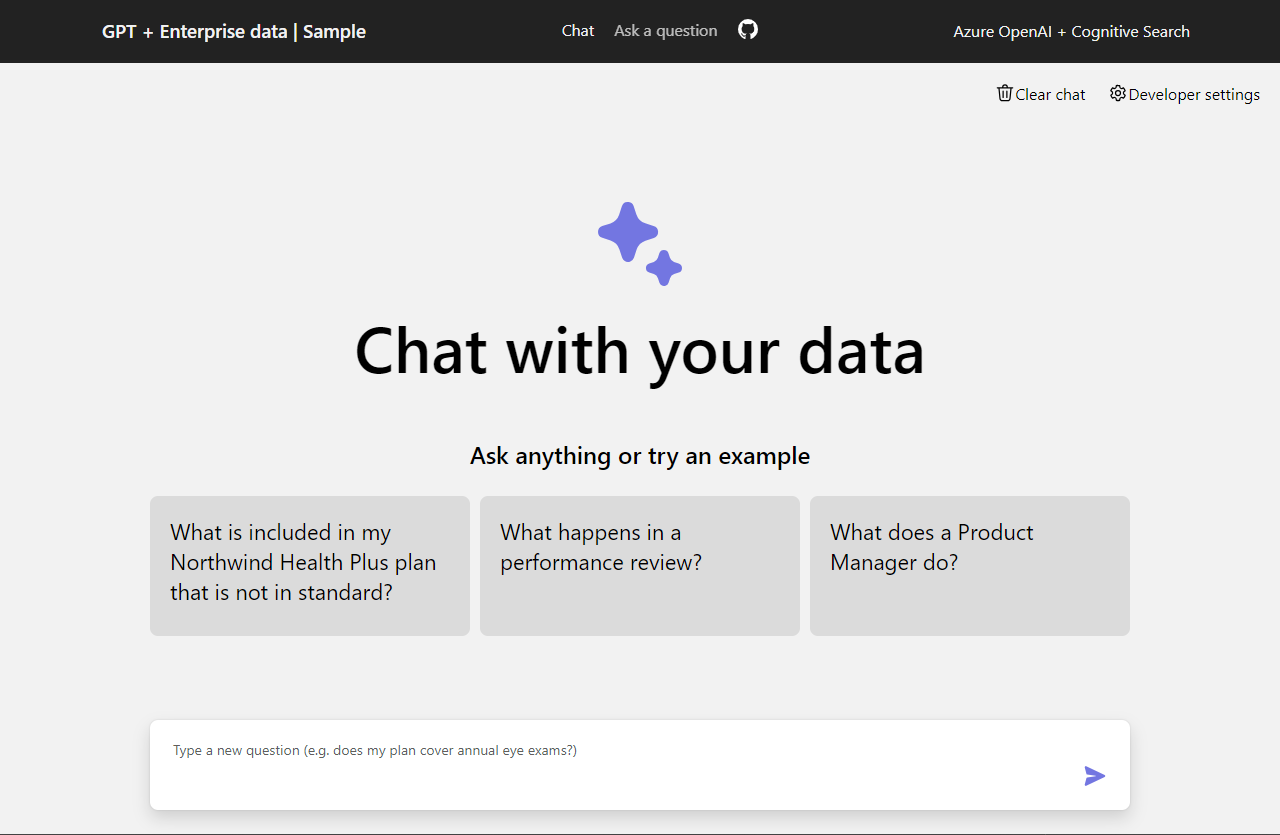

Verwenden der Chat-App zum Abrufen von Antworten aus PDF-Dateien

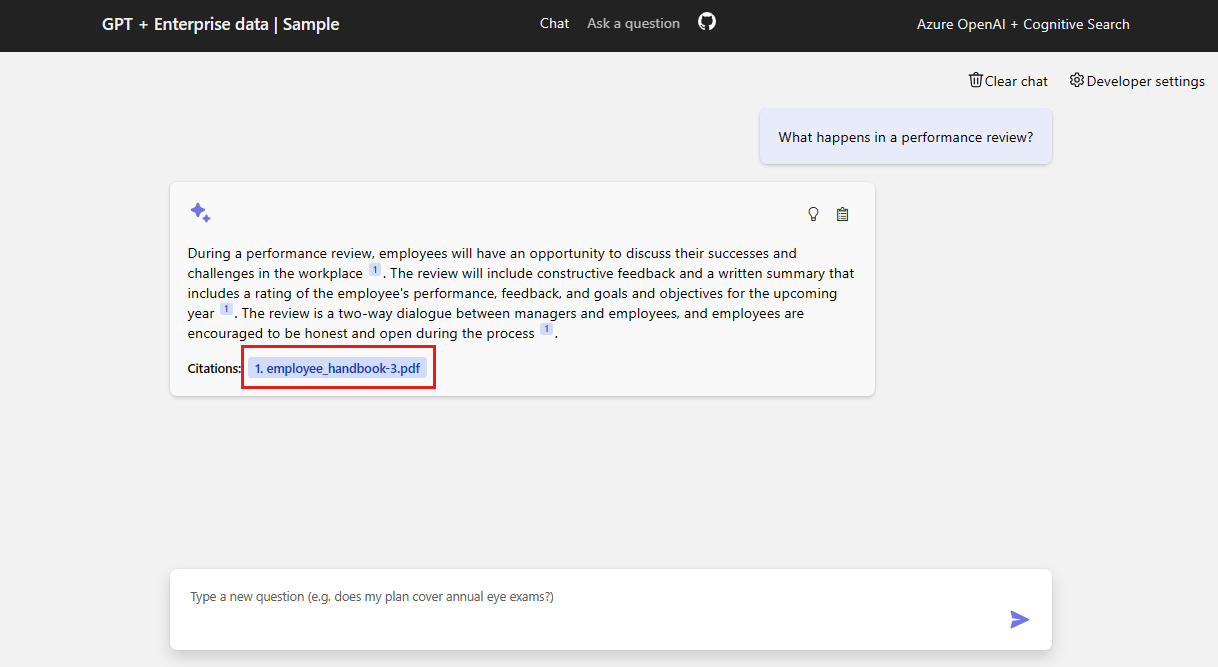

Die Chat-App wird vorab mit Informationen zu den Leistungen für Mitarbeiter aus PDF-Dateien befüllt. Sie können die Chat-App verwenden, um Fragen zu den Leistungen zu stellen. Die folgenden Schritte führen Sie durch den Prozess der Verwendung der Chat-App. Ihre Antworten können variieren, wenn die zugrunde liegenden Modelle aktualisiert werden.

Wählen Oder geben Sie im Browser an, was geschieht in einer Leistungsüberprüfung? im Chattextfeld.

Wählen Sie in der Antwort ein Zitat aus.

Verwenden Sie im rechten Bereich die Registerkarten, um zu verstehen, wie die Antwort generiert wurde.

Tab Beschreibung Gedankenprozess Dies ist ein Skript der Interaktionen im Chat. Sie können die Systemaufforderung ( content) und Ihre Benutzerfrage (content) anzeigen.Unterstützender Inhalt Dazu gehören die Informationen zur Beantwortung Ihrer Frage und des Quellmaterials. Die Anzahl der Quellenmaterialzitate wird in den Entwicklereinstellungen angegeben. Der Standardwert ist 3. Quellenangaben Dadurch wird die ursprüngliche Seite angezeigt, die das Zitat enthält. Wenn Sie fertig sind, wählen Sie die ausgewählte Registerkarte erneut aus, um den Bereich zu schließen.

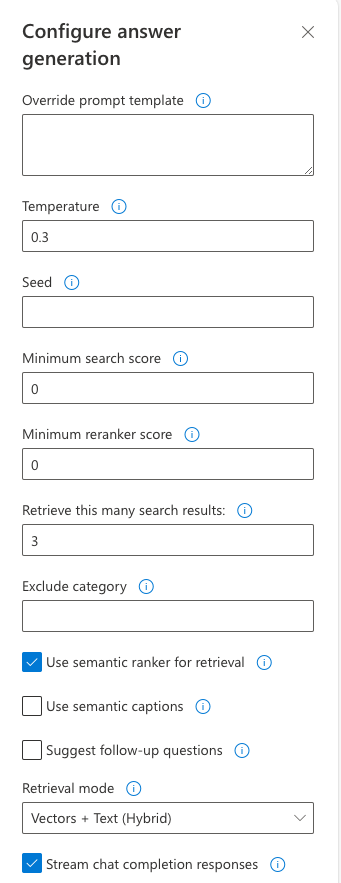

Verwenden von Chat-App-Einstellungen zum Ändern des Verhaltens von Antworten

Die Intelligenz des Chats wird durch das OpenAI-Modell und die Einstellungen bestimmt, die für die Interaktion mit dem Modell verwendet werden.

| Einstellung | Beschreibung |

|---|---|

| Außerkraftsetzen der Eingabeaufforderungsvorlage | Überschreibt die Eingabeaufforderung, die verwendet wird, um die Antwort basierend auf der Frage und den Suchergebnissen zu generieren. |

| Temperatur | Legt die Temperatur der Anforderung auf die LLM fest, die die Antwort generiert. Höhere Temperaturen führen zu kreativeren Reaktionen, aber sie können weniger geerdet werden. |

| Minimale Suchbewertung | Legt eine Mindestbewertung für Suchergebnisse fest, die von der Azure AI-Suche zurückgegeben werden. Der Bewertungsbereich hängt davon ab, ob Sie nur Hybrid (Standard), Vektoren oder nur Text verwenden. |

| Minimale Rerankerbewertung | Legt eine Mindestbewertung für Suchergebnisse fest, die aus dem semantischen Reranker zurückkehren. Die Bewertung liegt immer zwischen 0 und 4. Je höher die Bewertung ist, desto semantischer relevanter ist das Ergebnis für die Frage. |

| Abrufen dieser vielen Suchergebnisse | Legt die Anzahl der Suchergebnisse fest, die aus der Azure AI-Suche abgerufen werden sollen. Weitere Ergebnisse können die Wahrscheinlichkeit erhöhen, die richtige Antwort zu finden, kann aber dazu führen, dass das Modell "in der Mitte verloren geht". Sie können diese Quellen sehen, die im Gedankenprozess und unterstützende Inhaltsregisterkarten des Zitats zurückgegeben werden. |

| Kategorie ausschließen | Gibt eine Kategorie an, die aus den Suchergebnissen ausgeschlossen werden soll. Im Standarddatensatz werden keine Kategorien verwendet. |

| Verwenden des semantischen Rankers für den Abruf | Aktiviert den semantischen Rangfolger von Azure AI Search, ein Modell, das Suchergebnisse basierend auf der semantischen Ähnlichkeit mit der Abfrage des Benutzers neu bewertet. |

| Verwenden von semantischen Beschriftungen | Sendet semantische Beschriftungen anstelle des vollständigen Suchergebnisses an die LLM. Eine semantische Beschriftung wird während des Semantikrangs aus einem Suchergebnis extrahiert. |

| Vorschlagen von Anschlussfragen | Fordert die LLM auf, Nachverfolgungsfragen basierend auf der Abfrage des Benutzers vorzuschlagen. |

| Abrufmodus | Legt den Abrufmodus für die Azure AI Search-Abfrage fest. Vektoren + Text (Hybrid) verwendet eine Kombination aus Vektorsuche und Volltextsuche, Vectors verwendet nur die Vektorsuche, und Text verwendet nur die Volltextsuche. Hybrid ist im Allgemeinen optimal. |

| Antworten zum Streamen von Chatabschluss | Streamt die Antwort kontinuierlich auf die Chat-UI, während sie generiert wird. |

Die folgenden Schritte führen Sie durch den Prozess der Änderung der Einstellungen.

Wählen Sie im Browser die Registerkarte "Entwicklereinstellungen " aus.

Aktivieren Sie das Kontrollkästchen Anschlussfragen vorschlagen und stellen Sie die gleiche Frage erneut.

What happens in a performance review?Der Chat hat vorgeschlagene Nachverfolgungsfragen wie z. B. folgendes zurückgegeben:

1. What is the frequency of performance reviews? 2. How can employees prepare for a performance review? 3. Can employees dispute the feedback received during the performance review?Deaktivieren Sie auf der Registerkarte Einstellungen die Option Semantischen Ranker zum Abrufen verwenden.

Stellen Sie die gleiche Frage erneut?

What happens in a performance review?Was ist der Unterschied in den Antworten?

Mit dem semantischen Rangierer: Während einer Leistungsüberprüfung bei Contoso Electronics haben Mitarbeiter die Möglichkeit, ihre Erfolge und Herausforderungen am Arbeitsplatz zu besprechen (1). Die Überprüfung wird positives und konstruktives Feedback geben, um Mitarbeitern bei der Entwicklung und Entwicklung in ihren Rollen zu helfen (1). Der Mitarbeiter erhält eine schriftliche Zusammenfassung der Leistungsüberprüfung, die eine Bewertung ihrer Leistung, ihres Feedbacks und der Ziele für das kommende Jahr (1) enthält. Die Leistungsüberprüfung ist ein bidirektionaler Dialog zwischen Führungskräften und Mitarbeitern (1).

Ohne den semantischen Rangierer: Während einer Leistungsüberprüfung bei Contoso Electronics haben Mitarbeiter die Möglichkeit, ihre Erfolge und Herausforderungen am Arbeitsplatz zu besprechen. Positives und konstruktives Feedback wird bereitgestellt, um Mitarbeitern bei der Entwicklung und Entwicklung in ihren Rollen zu helfen. Eine schriftliche Zusammenfassung der Leistungsüberprüfung wird gegeben, einschließlich einer Bewertung der Leistung, des Feedbacks und der Ziele für das kommende Jahr. Die Überprüfung ist ein bidirektionaler Dialog zwischen Führungskräften und Mitarbeitern (1).

Bereinigen von Ressourcen

Bereinigen von Azure-Ressourcen

Die in diesem Artikel erstellten Azure-Ressourcen werden Ihrem Azure-Abonnement in Rechnung gestellt. Wenn Sie nicht erwarten, dass diese Ressourcen in Zukunft benötigt werden, löschen Sie sie, um weitere Gebühren zu vermeiden.

Führen Sie den folgenden Azure Developer CLI-Befehl aus, um die Azure-Ressourcen zu löschen und den Quellcode zu entfernen:

azd down --purge --force

Die Schalter bieten:

purge: Gelöschte Ressourcen werden sofort endgültig gelöscht. Auf diese Weise können Sie das Azure OpenAI-TPM wiederverwenden.force: Der Löschvorgang erfolgt im Hintergrund, ohne dass die Zustimmung des Benutzers erforderlich ist.

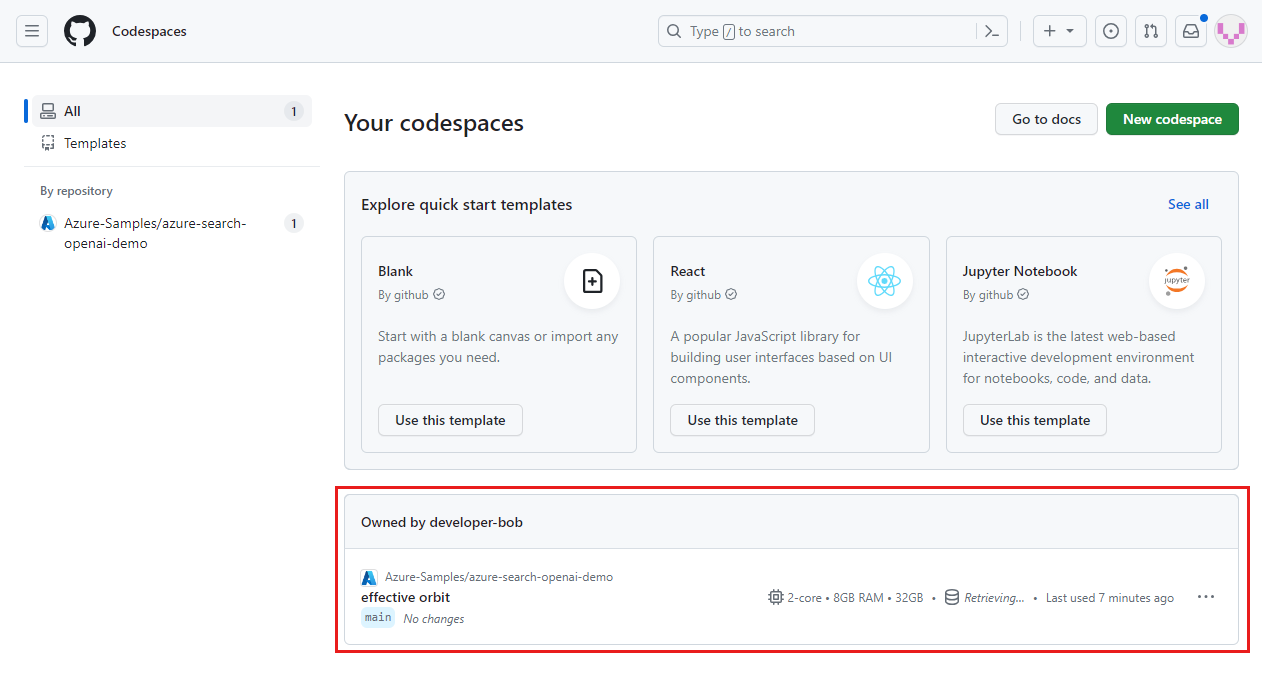

Bereinigen von GitHub-Codespaces

Durch das Löschen der GitHub Codespaces-Umgebung wird sichergestellt, dass Sie die Anzahl der kostenlosen Berechtigungsstunden pro Kern maximieren können, die Sie für Ihr Konto erhalten.

Wichtig

Weitere Informationen zu den Berechtigungen Ihres GitHub-Kontos finden Sie im Artikel zu monatlich enthaltener Speicherkapazität und Kernstunden in GitHub Codespaces.

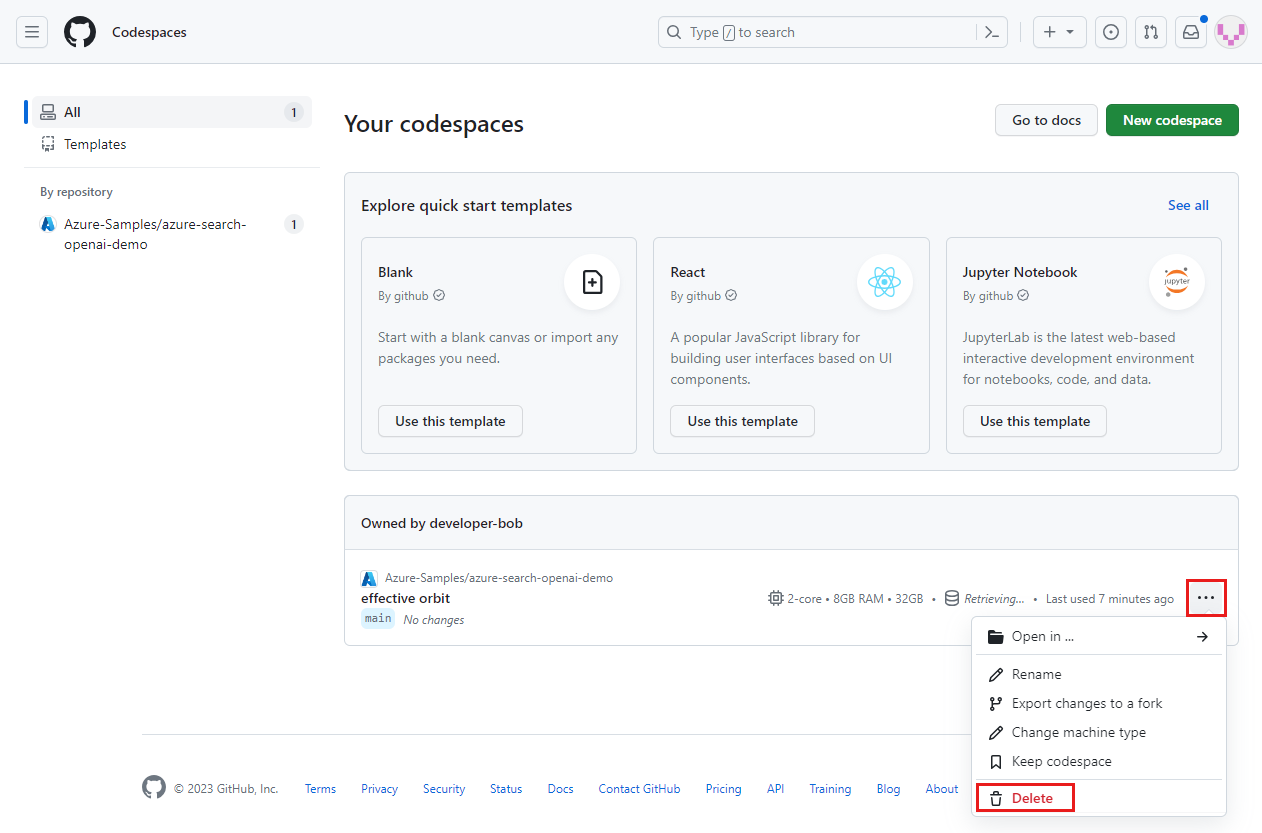

Melden Sie sich beim GitHub Codespaces-Dashboard (https://github.com/codespaces) an.

Suchen Sie Ihre derzeit ausgeführten Codespaces, die aus dem GitHub-Repository

Azure-Samples/azure-search-openai-demostammen.

Öffnen Sie das Kontextmenü für den Codespace, und wählen Sie dann Löschen aus.

Hilfe erhalten

Dieses Beispiel-Repository bietet Informationen zur Problembehandlung.

Wenn Ihr Problem nicht behoben ist, protokollieren Sie Ihr Problem bei den Problemen des Repositorys.

Nächste Schritte

- Abrufen des Quellcodes für das in diesem Artikel verwendete Beispiel

- Erstellen einer Chat-App mit Azure OpenAI Best Practice-Lösungsarchitektur

- Zugriffssteuerung in generativen KI-Apps mit Azure KI-Suche

- Erstellen einer unternehmensbereiten OpenAI-Lösung mit Azure API Management

- Übertreffen der Vektorsuche mit hybridem Abruf und Rangfolgefähigkeiten

Feedback

Bald verfügbar: Im Laufe des Jahres 2024 werden wir GitHub-Issues stufenweise als Feedbackmechanismus für Inhalte abbauen und durch ein neues Feedbacksystem ersetzen. Weitere Informationen finden Sie unter https://aka.ms/ContentUserFeedback.

Feedback senden und anzeigen für