Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Welche Produktangebote von Microsoft nutzen KI?

Microsoft verfügt über eine Vielzahl von KI-Angeboten, die in zwei Gruppen unterteilt werden können: einsatzbereite generative KI-Systeme wie Copilot und KI-Entwicklungsplattformen, auf denen Sie Ihre eigenen generativen KI-Systeme erstellen können.

Azure KI dient als gemeinsame Entwicklungsplattform und bietet eine Grundlage für verantwortungsvolle Innovationen mit Datenschutz, Sicherheit und Compliance auf Unternehmensniveau.

Weitere Informationen zu den KI-Angeboten von Microsoft finden Sie in der folgenden Produktdokumentation:

Wie gilt das Modell der gemeinsamen Verantwortung für KI?

Wie bei anderen Cloudangeboten ist die Entschärfung von KI-Risiken eine gemeinsame Verantwortung von Microsoft und Kunden. Abhängig von den KI-Funktionen, die in Ihrem organization implementiert werden, verschieben sich die Zuständigkeiten zwischen Microsoft und dem Kunden.

Das folgende Diagramm veranschaulicht die Zuständigkeitsbereiche zwischen Microsoft und unseren Kunden entsprechend der Art der Bereitstellung.

Weitere Informationen finden Sie unter Modell der gemeinsamen Verantwortung für künstliche Intelligenz (KI).

Informationen dazu, wie Microsoft Kunden bei der Durchführung ihres Teils des Modells der gemeinsamen Verantwortung unterstützt, finden Sie unter So unterstützen wir unsere Kunden beim verantwortungsvollen Aufbau von KI (S. 22).

Wie steuert Microsoft die Entwicklung und Verwaltung von KI-Systemen?

KI ist für Microsoft nicht neu. Wir treiben seit Jahren Innovationen in KI-Systemen voran. Unsere Initiative für verantwortungsvolle KI war der Kern unserer KI-Bemühungen und wurde durch die Veröffentlichung des Slate-Artikels von Satya Nadella im Jahr 2016 gestartet und hat dazu geführt, dass wir heute bei der Operationalisierung verantwortungsvoller KI sind.

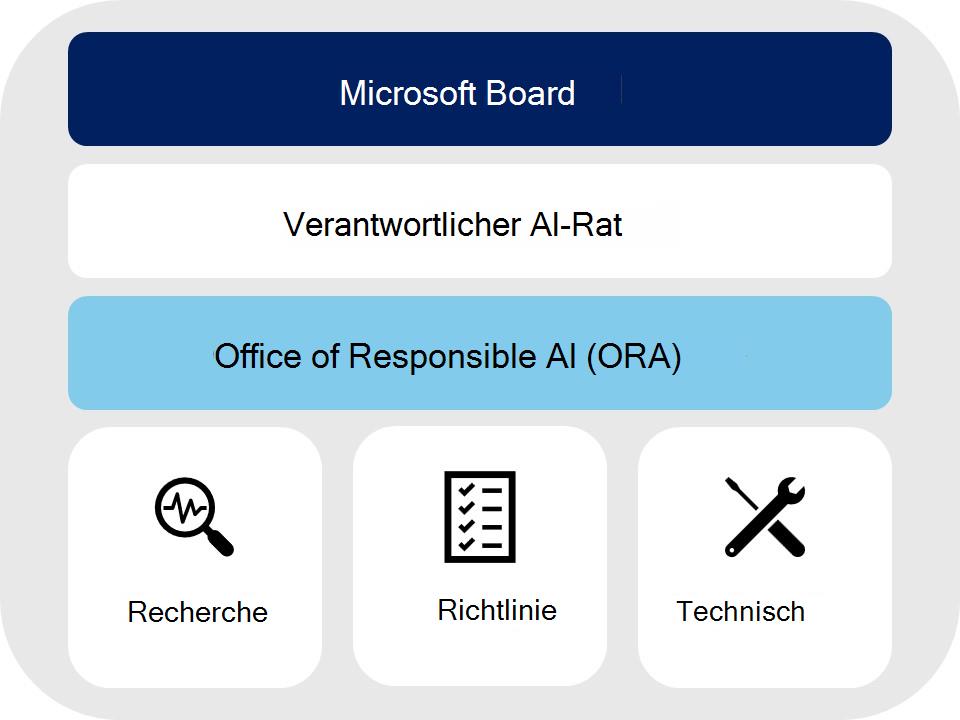

Kein Team oder organization ist allein dafür verantwortlich, die Einführung verantwortungsvoller KI-Praktiken voranzutreiben. Wir kombinieren einen verbundbasierten Bottom-up-Ansatz mit starker Top-Down-Unterstützung und -Aufsicht durch die Unternehmensleitung, um unsere Richtlinien, Governance und Prozesse zu fördern. Spezialisten in Forschung, Politik und Technik bündeln ihr Fachwissen und arbeiten an hochmodernen Praktiken zusammen, um sicherzustellen, dass wir unsere eigenen Verpflichtungen erfüllen und gleichzeitig unsere Kunden und Partner unterstützen.

- Microsoft Board: Unser Management für verantwortungsvolle KI beginnt mit CEO Satya Nadella und kaskadiert über das Führungsteam und das gesamte Microsoft-Team. Das Umwelt-, Sozial- und Public Policy-Komitee des Verwaltungsrats bietet Aufsichts- und Orientierungshilfen für richtlinien und programme für verantwortungsvolle KI.

- Responsible AI Council: Unter der Leitung von Vice Chair und President Brad Smith und Chief Technology Officer Kevin Scott bietet der Responsible AI Council führungskräften und Vertretern aus Forschung, Politik und Technik ein Forum, in dem sie sich regelmäßig mit den größten Herausforderungen im Zusammenhang mit KI auseinandersetzen und fortschritte bei unseren Richtlinien und Prozessen für verantwortungsvolle KI vorantreiben können.

- Office of Responsible AI (ORA): ORA ist damit beauftragt, prinzipienbewusste KI in die Praxis umzusetzen, was sie mit fünf Schlüsselfunktionen erreichen. ORA legt unternehmensweite interne Richtlinien fest, definiert Governancestrukturen, stellt Ressourcen für die Einführung von KI-Praktiken bereit, überprüft sensible Anwendungsfälle und hilft bei der Gestaltung öffentlicher Richtlinien rund um KI.

- Forschung: Forscher im Komitee für KI Ethics and Effects in Engineering and Research (Aether), Microsoft Research und engineering teams halten das programm für verantwortungsvolle KI durch Vordenker an der Spitze der Probleme.

- Richtlinie: ORA arbeitet mit Projektbeteiligten und Richtlinienteams im gesamten Unternehmen zusammen, um Richtlinien und Verfahren zu entwickeln, um unsere KI-Prinzipien beim Erstellen von KI-Anwendungen einzuhalten.

- Engineering: Entwicklungsteams erstellen KI-Plattformen, Anwendungen und Tools. Sie geben Feedback, um sicherzustellen, dass Richtlinien und Verfahren technisch durchführbar sind, innovative Verfahren und neue Technologien entwickeln und verantwortungsvolle KI-Praktiken im gesamten Unternehmen skalieren.

Welche Prinzipien dienen als Grundlage für das RAI-Programm von Microsoft?

Microsoft hat sechs menschenzentrierte Prinzipien entwickelt, um eine Kultur des Bewusstseins, des Lernens und der Innovation in Themen mit verantwortungsvoller KI zu fördern. Diese sechs KI-Prinzipien bilden die Grundlage für das RAI-Programm von Microsoft und die Richtlinien, die ORA entwickelt.

Weitere Informationen zu den Prinzipien verantwortungsvoller KI finden Sie unter Verantwortungsvolle KI.

Wie implementiert Microsoft die von ORA definierten Richtlinien?

Das Responsible AI Standard (RAI Standard) ist das Ergebnis langfristiger Bemühungen, Kriterien für die Produktentwicklung und das Risikomanagement für KI-Systeme festzulegen. Es setzt die RAI-Prinzipien in die Tat um, indem Ziele, Anforderungen und Praktiken für alle von Microsoft entwickelten KI-Systeme definiert werden.

- Goals: Definieren, was es bedeutet, unsere KI-Prinzipien einzuhalten

- Anforderungen: Definieren, wie wir unsere KI-Prinzipien einhalten müssen

- Methoden: Die Hilfen, mit denen die Anforderungen erfüllt werden

Die Standard treibende Kraft im RAI-Standard ist die Folgenabschätzung, bei der das Entwicklungsteam die Ergebnisse für jede Zielanforderung dokumentieren muss. Für die Ziele der Datenschutz-& Sicherheit und Inklusion gibt die RAI-Standard an, dass die Anforderung mit den bestehenden Datenschutz-, Sicherheits- und Barrierefreiheitsprogrammen, die bereits bei Microsoft vorhanden sind, konform ist, und alle KI-spezifischen Anleitungen zu befolgen, die sie möglicherweise haben.

Den vollständigen RAI-Standard finden Sie in der Dokumentation zu den allgemeinen Anforderungen von Microsoft Responsible AI Standard.