Nota

El acceso a esta página requiere autorización. Puede intentar iniciar sesión o cambiar directorios.

El acceso a esta página requiere autorización. Puede intentar cambiar los directorios.

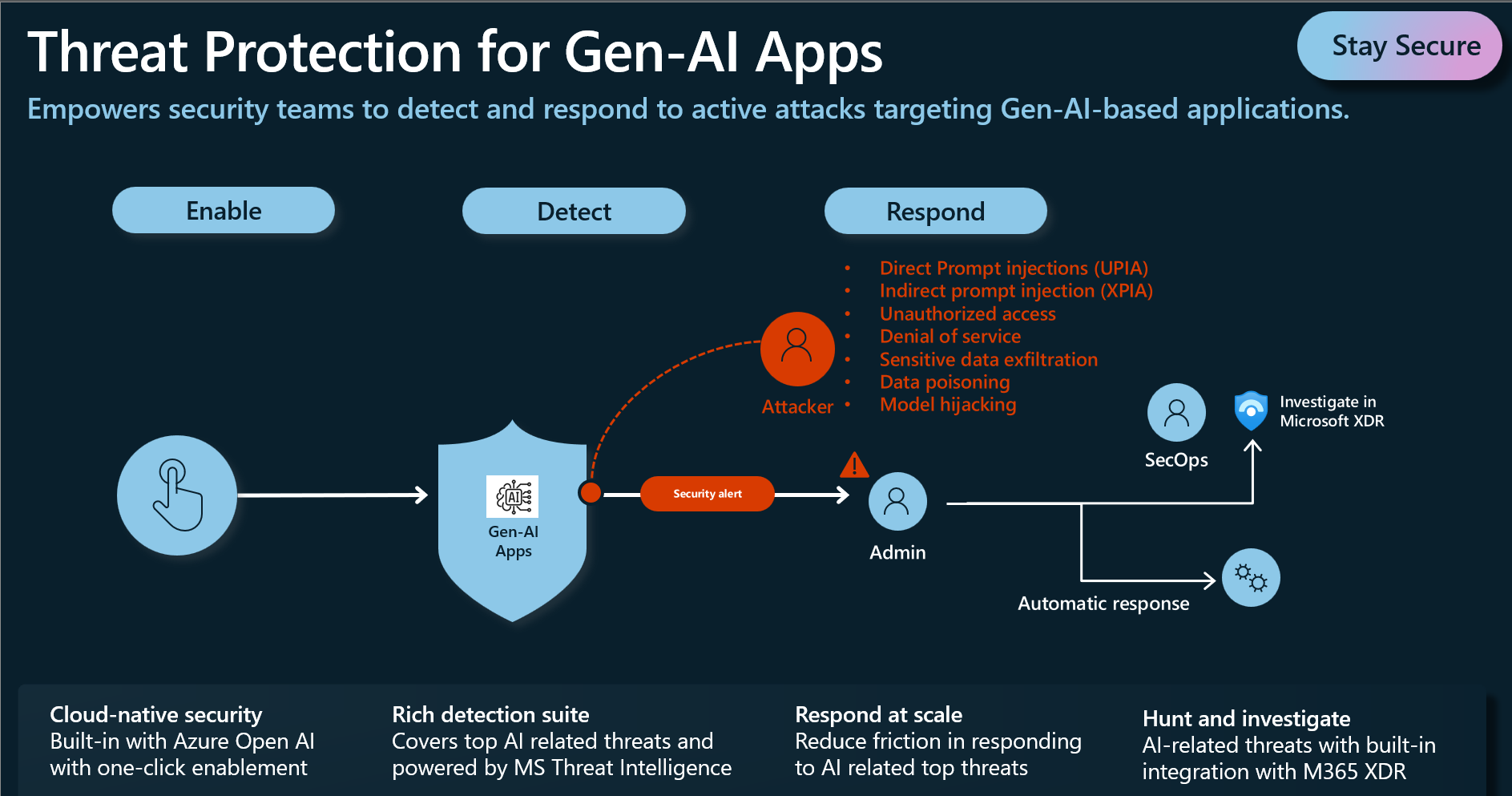

La protección contra amenazas de Microsoft Defender for Cloud para los servicios de inteligencia artificial identifica las amenazas a las aplicaciones de inteligencia artificial generativas en tiempo real y ayuda a responder a los problemas de seguridad.

La protección contra amenazas de inteligencia artificial de Defender for Cloud funciona con escudos de avisos de seguridad de contenido de Azure AI y la inteligencia sobre amenazas de Microsoft para proporcionar alertas de seguridad para amenazas como la pérdida de datos, la intoxicación de datos, el jailbreak y el robo de credenciales.

Integración de Defender XDR

La protección contra amenazas para los servicios de inteligencia artificial se integra con la XDR de Defender, lo que permite a los equipos de seguridad centralizar las alertas de cargas de trabajo de IA en el portal de XDR de Defender.

Los equipos de seguridad pueden correlacionar las alertas e incidentes de la carga de trabajo de IA en el portal de Defender XDR para comprender el ámbito completo de un ataque, incluidas las actividades malintencionadas relacionadas con sus aplicaciones de IA generativa.

Disponibilidad

| Aspecto | Detalles |

|---|---|

| Estado de la versión: | Disponibilidad general (GA) |

| Disponibilidad de características: | - Supervisión de actividades (alertas de seguridad) - Evidencia inmediata (alertas de seguridad) |

| Precios: | Defender for AI Services se factura como se muestra en la página de precios. También puede calcular los costos con la calculadora de costos de Defender for Cloud. Los servicios de Defender para AI incluyen una prueba piloto gratuita de 30 días, con un límite de un máximo de 75 mil millones de tokens analizados. La facturación comenzará si se alcanza el límite dentro del período de 30 días. |

| Servicios de IA admitidos: | Modelos compatibles con Azure OpenAI Modelos compatibles con el servicio Azure AI Model Inference **Defender for Cloud solo admite tokens de texto en esta fase (los tokens de imagen y audio no se examinan) |

| Roles y permisos necesarios: | Para habilitar la detección de amenazas en el nivel de suscripción, necesita roles de propietario (propietario de la suscripción) o roles específicos con las acciones de datos correspondientes. |

| Nubes: |