Nota

O acceso a esta páxina require autorización. Pode tentar iniciar sesión ou modificar os directorios.

O acceso a esta páxina require autorización. Pode tentar modificar os directorios.

SE APLICA A: Todos los niveles de API Management

Puede importar los puntos de conexión del modelo de IA implementados en Microsoft Foundry en la instancia de API Management como API. Use directivas de puerta de enlace de IA y otras funcionalidades de API Management para simplificar la integración, mejorar la observabilidad y mejorar el control sobre los puntos de conexión del modelo.

Para más información sobre cómo administrar las API de IA en API Management, consulte:

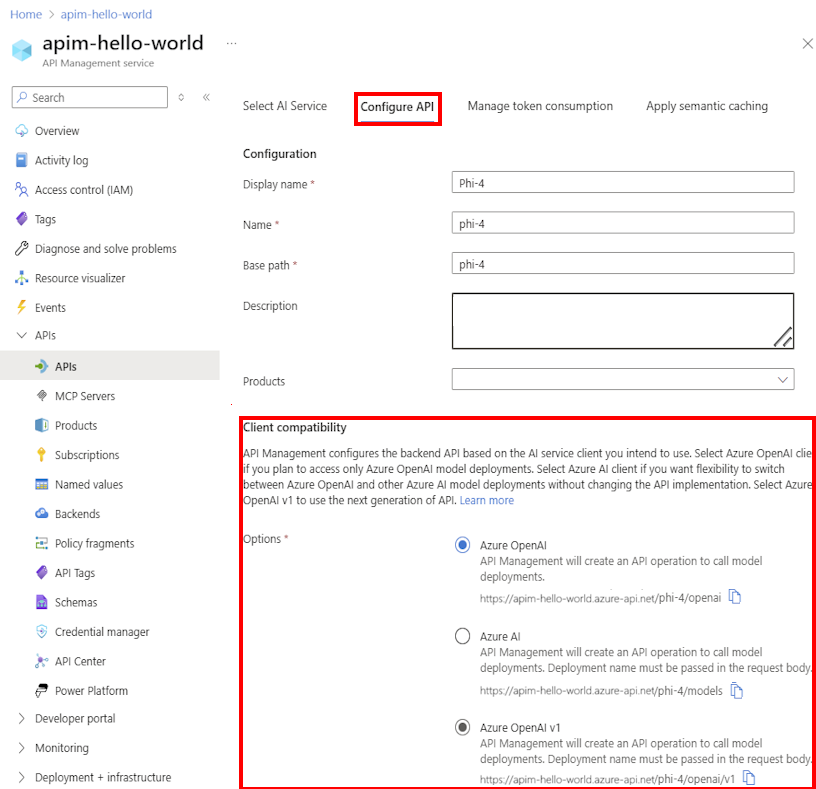

Opciones de compatibilidad de cliente

API Management admite las siguientes opciones de compatibilidad de cliente para las API de IA de Microsoft Foundry. Al importar la API mediante el asistente, elija la opción adecuada para la implementación del modelo. La opción determina cómo los clientes llaman a la API y cómo la instancia de API Management enruta las solicitudes a la herramienta Foundry.

Azure OpenAI: administre Azure OpenAI en las implementaciones del modelo de Microsoft Foundry.

Los clientes llaman a la implementación en un

/openaipunto de conexión como/openai/deployments/my-deployment/chat/completions. La ruta de la solicitud incluye el nombre de la implementación. Use esta opción si la herramienta Foundry solo incluye implementaciones de modelos de Azure OpenAI.Azure AI: administre los puntos de conexión del modelo en Microsoft Foundry que se exponen a través de la API de inferencia de modelos de Azure AI.

Los clientes llaman a la implementación en un

/modelspunto de conexión como/my-model/models/chat/completions. El cuerpo de la solicitud incluye el nombre de la implementación. Use esta opción si quiere flexibilidad para cambiar entre los modelos expuestos a través de la API de inferencia de modelos de IA de Azure y los implementados en Azure OpenAI en foundry Models.Azure OpenAI v1 : administre Azure OpenAI en implementaciones de modelos de Microsoft Foundry mediante la API de Azure OpenAI versión 1.

Los clientes llaman a la implementación en un punto de conexión del modelo de Azure OpenAI v1, como

openai/v1/my-model/chat/completions. El cuerpo de la solicitud incluye el nombre de la implementación.

Prerrequisitos

Una instancia existente de API Management. Crea una si todavía no lo has hecho.

Una herramienta Foundry en su suscripción con uno o más modelos implementados. Algunos ejemplos son los modelos implementados en Microsoft Foundry o Azure OpenAI.

Si desea habilitar el almacenamiento en caché semántico para la API, consulte Habilitación del almacenamiento en caché semántico de respuestas para los requisitos previos.

Si desea aplicar comprobaciones de seguridad de contenido en la API, consulte Aplicación de comprobaciones de seguridad de contenido en solicitudes LLM para requisitos previos.

Importación de microsoft Foundry API mediante el portal

Siga estos pasos para importar una API de IA a API Management.

Al importar la API, API Management configura automáticamente:

- Operaciones para cada uno de los puntos de conexión de la API REST.

- Una identidad asignada por el sistema con los permisos necesarios para acceder a la implementación de la herramienta Foundry.

- Un recurso backend y una directiva set-backend-service que dirige las solicitudes de API al punto de conexión de Azure AI Services.

- Autenticación en el back-end mediante la identidad administrada asignada por el sistema de la instancia.

- (opcionalmente) Directivas que le ayudarán a supervisar y administrar la API.

Para importar una API de Microsoft Foundry a API Management:

En Azure Portal, vaya a la instancia de API Management.

En el menú de la izquierda, en API, seleccioneAPI >+ Agregar API.

En Crear a partir de recurso de Azure, seleccione Microsoft Foundry.

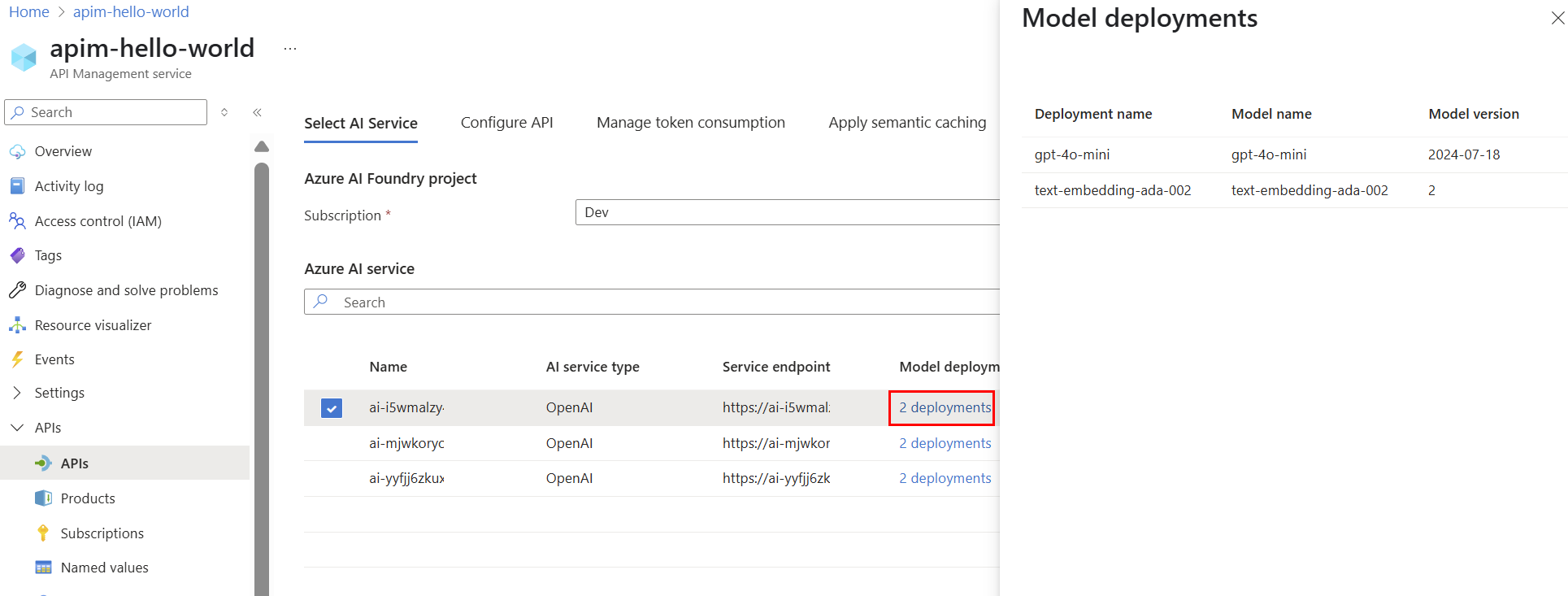

En la pestaña Seleccionar servicio de IA :

En la pestaña Configurar API :

Escriba un Nombre para mostrar y una Descripción opcional para la API.

En Ruta de acceso base, escriba una ruta de acceso que la instancia de API Management usa para acceder al punto de conexión de implementación.

Opcionalmente, seleccione uno o varios productos para asociarlos a la API.

En Compatibilidad de cliente, seleccione una de las siguientes opciones en función de los tipos de cliente que quiera admitir. Consulte Opciones de compatibilidad de cliente para obtener más información.

- Azure OpenAI: seleccione esta opción si los clientes solo necesitan acceder a Azure OpenAI en implementaciones de modelos de Microsoft Foundry.

- Azure AI: seleccione esta opción si los clientes necesitan acceder a otros modelos de Microsoft Foundry.

- Azure OpenAI v1 : seleccione esta opción si desea usar la versión 1 de la API de Azure OpenAI con las implementaciones del modelo foundry.

Seleccione Siguiente.

En la pestaña Administrar consumo de tokens , opcionalmente, escriba la configuración o acepte los valores predeterminados que definen las siguientes directivas para ayudar a supervisar y administrar la API:

En la pestaña Aplicar almacenamiento en caché semántico , opcionalmente escriba la configuración o acepte valores predeterminados que definan las directivas para ayudar a optimizar el rendimiento y reducir la latencia de la API:

En la pestaña Seguridad de contenido de IA , opcionalmente escriba la configuración o acepte los valores predeterminados para configurar el servicio De seguridad del contenido de Azure AI para bloquear las solicitudes con contenido no seguro:

Seleccione Revisar.

Una vez que el portal valide la configuración, seleccione Crear.

Prueba de la API de IA

Para asegurarse de que la API de IA funciona según lo previsto, pruóbela en la consola de prueba de API Management.

Seleccione la API que creó en los pasos anteriores.

Seleccione la pestaña Prueba.

Seleccione una operación compatible con la implementación del modelo. En la página se muestran los campos de los parámetros y los encabezados.

Escriba los parámetros y los encabezados según sea necesario. En función de la operación, es posible que tenga que configurar o actualizar un cuerpo de la solicitud. Este es un cuerpo de solicitud de ejemplo básico en una operación de finalización de chat:

{ "model": "any", "messages": [ { "role": "user", "content": "Help me plan a trip to Paris", "max_tokens": 100 } ] }Nota:

En la consola de prueba, API Management agrega automáticamente un encabezado Ocp-Apim-Subscription-Key y establece la clave de suscripción para la suscripción de acceso completo integrada. Esta clave proporciona acceso a todas las API de la instancia de API Management. Para mostrar opcionalmente el encabezado Ocp-Apim-Subscription-Key , seleccione el icono "ojo" junto a la solicitud HTTP.

Seleccione Enviar.

Cuando la prueba se realiza correctamente, el back-end responde con un código de respuesta HTTP correcto y algunos datos. La respuesta incluye datos de uso de tokens para ayudarle a supervisar y administrar el consumo de tokens del modelo de lenguaje.

Contenido relacionado

- Limitaciones de importación de API

- Importación de una especificación de OpenAPI

- Importación de una API de SOAP

- Importar una API de SOAP y convertir en REST

- Importar una API de servicio de aplicaciones

- Importación de una API de aplicación de contenedor

- Importación de WebSocket API

- Importación de GraphQL API

- Importación de un esquema GraphQL y configuración de solucionadores de campos

- Importación de una API de aplicación de funciones

- Importación de una API de aplicación lógica

- Importación de un servicio Service Fabric

- Importación de una API de Microsoft Foundry

- Importar una API de OpenAI Azure

- Importación de una API de LLM

- Importación de una API de OData

- Exportación de una API REST como servidor MCP

- Exposición de un servidor MCP existente

- Importación de una API de agente de A2A

- Importación de metadatos de SAP OData

- Importación de una API de gRPC

- Edición de una API