הערה

הגישה לדף זה מחייבת הרשאה. באפשרותך לנסות להיכנס או לשנות מדריכי כתובות.

הגישה לדף זה מחייבת הרשאה. באפשרותך לנסות לשנות מדריכי כתובות.

מאמר זה מסביר פירושים והנדסת פירושים כמושגים עיקריים שיעזרו לך ליצור יכולות בינה מלאכותית חזקות שניתן להשתמש בהן ב-Copilot Studio.

חשוב

- בקשות משתמשות במודלים מופעלים באמצעות Azure Foundry.

- יכולת זו עשויה להיות כפופה למגבלות שימוש או לוויסות הקיבולת.

דרישות מוקדמות

- הסביבה שלך נמצאת ברשימת האזורים הזמינים.

- אתה זקוק לCopilot קרדיטים.

- Microsoft Dataverse מותקן בסביבה.

מהי הנחיה

בקשה מורכבת בעיקר מהוראה בשפה טבעית שאומרת למודל בינה מלאכותית גנרטיבי לבצע משימה. המודל פועל בהתאם לבקשה כדי לקבוע את המבנה והתוכן של הטקסט שהוא צריך ליצור. הנדסת בקשות היא תהליך היצירה והמיקוד של הבקשה המשמשת את המודל.

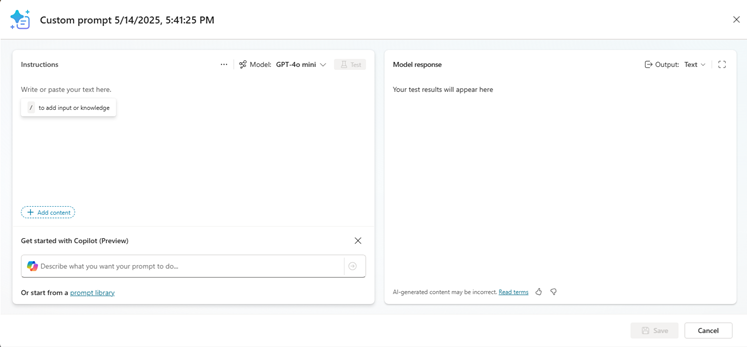

חוויית בונה בקשות מאפשרת ליוצרים לבנות, לבדוק ולשמור בקשות לשימוש חוזר. בחוויה זו, באפשרותך גם להשתמש במשתנה קלט ותוני ידע כדי לספק נתוני הקשר דינאמיים בזמן ריצה. באפשרותך לשתף הנחיות אלה עם אנשים אחרים ולהשתמש בהם כסוכנים, זרימות עבודה או יישומים.

ניתן להשתמש בהנחיות אלה עבור משימות רבות או תרחישים עסקיים רבים, כגון סיכום תוכן, חלוקת נתונים לקטגוריות, חילוץ ישויות, תרגום שפות, הערכת סנטימנט או גיבוש תגובה תלונה. לדוגמה, באפשרותך לבקש לבחור פריטי פעולה מהודעות הדואר האלקטרוני של החברה ולהשתמש בהם בזרימת עבודה של Power Automate כדי לבנות אוטומציה של עיבוד דואר אלקטרוני.

ב Copilot Studio, ניתן להשתמש בהנחיות ככלי סוכן כדי לשפר את חוויית הצ'אט או לאפשר אוטומציות מתקדמות של בינה מלאכותית או צמתי זרימת עבודה כדי להפיך שימוש בפעולות בינה מלאכותית באוטומציות דטרמיניסטיות.

פיקוח אנושי

פיקוח אנושי הוא שלב חשוב בעת עבודה עם תוכן שנוצר ממודל בינה מלאכותית גנרטיבי. מודלים אלה מתרגלים לכמויות אדירות של נתונים ועשויים להכיל שגיאות והטיות. אדם צריך לסקור אותו לפני שאתה מפרסם אותו באינטרנט, שולח אותו ללקוח או משתמש בו כדי ליידע החלטה עסקית. פיקוח אנושי עוזר לך לזהות שגיאות פוטנציאליות והטיות. בנוסף, הוא מוודא שהתוכן רלוונטי למקרה השימוש המיועד ותואם לערכים של החברה.

סקירה אנושית יכולה גם לעזור לזהות בעיות במודל עצמו. לדוגמה, אם המודל יוצר תוכן שאינו רלוונטי למקרה השימוש המיועד, ייתכן שיהיה עליך להתאים את הבקשה.

AI אחראי

אנו מחויבים ליצור בינה מלאכותית אחראית בתכנון. העבודה שלנו מונחית על ידי מערך מרכזי של עקרונות: הוגנות, מהימנות ובטיחות, פרטיות ואבטחה, כוללנות, שקיפות ואחריות. אנחנו מציבים עקרונות אלה לתרגול ברחבי החברה כדי לפתח ולפרוס בינה מלאכותית שיש לה השפעה חיובית על החברה. אנו נוהלי גישה מקיפה, המשלבים מחקר חדשני, הנדסה יוצאת דופן ופיקוח אחראי. לצד המחקר המוביל של OpenAI בנושא היישור של בינה מלאכותית, אנו מתקדמים למסגרת לפריסה הבטוחה של טכנולוגיות הבינה המלאכותית שלנו שמטרתן לסייע להדריך את התעשייה לקראת תוצאות אחראיות יותר.

קבל מידע נוסף על שקיפות בהערה שלTransparency עבור Azure OpenAI.