Megjegyzés

Az oldalhoz való hozzáféréshez engedély szükséges. Megpróbálhat bejelentkezni vagy módosítani a címtárat.

Az oldalhoz való hozzáféréshez engedély szükséges. Megpróbálhatja módosítani a címtárat.

Ebben a cikkben megtudhatja, hogy mely lehetőségek állnak rendelkezésre az alapmodellek lekérdezési kéréseinek írására, és hogyan küldheti el őket a végpontot kiszolgáló modellnek. Lekérdezheti a Databricks és a Databricksen kívüli alapmodellek által üzemeltetett alapmodelleket.

A hagyományos ML- vagy Python-modellek lekérdezési kéréseivel kapcsolatban lásd az egyéni modellek végpontjait kiszolgáló lekérdezést.

Mosaic AI Model Serving, amely támogatja a Foundation Models API-ket és külső modelleket az alapmodellek eléréséhez. A Modellkiszolgáló egységes OpenAI-kompatibilis API-t és SDK-t használ a lekérdezéshez. Ez lehetővé teszi a támogatott felhők és szolgáltatók számára, hogy kipróbálhassák és testreszabhassák az éles környezetre szánt alapmodelleket.

Lekérdezési beállítások

A Mozaik AI-modell-kiszolgáló a következő lehetőségeket kínálja a lekérdezési kérések alapmodelleket kiszolgáló végpontokra való küldéséhez:

| Metódus | Részletek |

|---|---|

| OpenAI-ügyfél | Egy Mozaik AI-modellszolgáltatás végpontja által üzemeltetett modell lekérdezése az OpenAI-ügyfél használatával. Adja meg a modellek kiszolgálási végpontjának nevét model bemenetként. Támogatja az Alapmodell API-k vagy külső modellek által elérhetővé tett csevegési, beágyazási és befejezési modelleket. |

| AI-függvények | Modellkövetkeztetés meghívása közvetlenül az SQL-ből az ai_query SQL-függvény használatával. Lásd: Példa : Alapmodell lekérdezése. |

| Felhasználói felület kiszolgálása | Válassza a Lekérdezésvégpont lehetőséget a Kiszolgáló végpont lapon. JSON formátumú modell bemeneti adatainak beszúrása, majd kattintson Kérelem küldésegombra. Ha a modellhez egy bemeneti példa van naplózva, a Példa megjelenítése parancsot használva töltse be. |

| REST API | A modell meghívása és lekérdezése a REST API használatával. Részletekért lásd: POST /serving-endpoints/{name}/invocations . A több modellt kiszolgáló végpontokra irányuló pontozási kérelmekről a végpont mögötti egyes modellek lekérdezése című témakörben olvashat. |

| MLflow Deployments SDK | A modell lekérdezéséhez használja az MLflow Deployments SDK predict() függvényét. |

| Databricks Python SDK | A Databricks Python SDK egy réteg a REST API tetején. Kezeli az alacsony szintű részleteket, például a hitelesítést, így könnyebben kezelhetők a modellek. |

Követelmények

- Végpontot kiszolgáló modell.

- Databricks-munkaterület egy támogatott régióban.

- Ha pontozási kérelmet szeretne küldeni az OpenAI ügyfélen, a REST API-n vagy az MLflow Deployment SDK-n keresztül, rendelkeznie kell egy Databricks API-jogkivonattal.

Fontos

A Databricks éles környezetekben ajánlott biztonsági gyakorlatként javasolja a gépek közötti OAuth-jogkivonatok használatát a hitelesítéshez.

Teszteléshez és fejlesztéshez a Databricks a munkaterület felhasználói helyett a szolgáltatásnevekhez tartozó személyes hozzáférési jogkivonat használatát javasolja. Szolgáltatási főszereplők jogkivonatainak létrehozásához lásd a Szolgáltatási főszereplők jogkivonatainak kezelése című részt.

Csomagok telepítése

Miután választott egy lekérdezési módszert, először telepítenie kell a megfelelő csomagot a clustersére.

OpenAI-ügyfél

Az OpenAI kliens használatához a databricks-openai csomagot telepíteni kell a fürtre. Ez a csomag egy OpenAI-ügyfelet biztosít, amely automatikusan konfigurálja az engedélyezést a generatív AI-modellek lekérdezésére. Futtassa a következő parancsokat a jegyzetfüzetében vagy a helyi terminálban:

pip install -U databricks-openai

A következőre csak akkor van szükség, ha a csomagot Databricks-jegyzetfüzetbe telepíti

dbutils.library.restartPython()

REST API

A Kiszolgáló REST API-hoz való hozzáférés a Databricks Runtime for Machine Learningben érhető el.

MLflow Deployments SDK

!pip install mlflow

A következőre csak akkor van szükség, ha a csomagot Databricks-jegyzetfüzetbe telepíti

dbutils.library.restartPython()

Databricks Python SDK

A Pythonhoz készült Databricks SDK már telepítve van az összes Olyan Azure Databricks-fürtön, amely a Databricks Runtime 13.3 LTS-t vagy újabb verziót használja. Azoknál az Azure Databricks-fürtöknél, amelyek a Databricks Runtime 12.2 LTS-t és az alatta lévő verziókat használják, először telepíteni kell a Databricks SDK-t a Pythonhoz. Lásd: Databricks SDK for Python.

Alapmodell-típusok

Az alábbi táblázat a tevékenységtípus alapján összefoglalja a támogatott alapmodelleket.

Fontos

A Meta-Llama-3.1-405B-Instruct ki lesz állítva,

- 2026. február 15-től a pay-per-token munkaterhelésekhez.

- 2026. május 15-től kezdődően kiosztott átviteli sebesség számítási feladatai.

Kérjük, tekintse meg a kivezetett modelleket az ajánlott cseremodell megtekintéséhez és útmutatást ahhoz, hogyan hajthatja végre az átállást az elavulás során.

| Tevékenység típusa | Leírás | Támogatott modellek | Mikor érdemes használni? Ajánlott használati esetek |

|---|---|---|---|

| Általános célú | A természetes, többfordulós beszélgetések megértésére és részvételére tervezett modellek. Ezek az emberi párbeszéd nagy adathalmazaira vannak finomhangolva, így környezetfüggő válaszokat hozhatnak létre, nyomon követhetik a beszélgetések előzményeit, és koherens, emberi jellegű interakciókat biztosíthatnak különböző témakörökben. | A databricks által üzemeltetett alapmodellek a következők:

A támogatott külső modellek a következők:

|

Olyan forgatókönyvekhez ajánlott, ahol természetes, több lépcsős párbeszédre és kontextusfüggő megértésre van szükség:

|

| Beágyazások | A beágyazási modellek olyan gépi tanulási rendszerek, amelyek összetett adatokat – például szöveget, képeket vagy hangokat – alakítanak át kompakt numerikus vektorokká, úgynevezett beágyazásokká. Ezek a vektorok rögzítik az adatok alapvető funkcióit és kapcsolatait, lehetővé téve a hatékony összehasonlítást, a fürtözést és a szemantikai keresést. | A databricks által üzemeltetett alapmodell az alábbiakat támogatja: A támogatott külső modellek a következők:

|

Olyan alkalmazásokhoz ajánlott, ahol elengedhetetlen a szemantikai megértés, a hasonlóság összehasonlítása, valamint az összetett adatok hatékony lekérése vagy fürtözése:

|

| Vízió | A vizuális adatok feldolgozására, értelmezésére és elemzésére tervezett modellek– például képek és videók – így a gépek "láthatják" és megérthetik a vizuális világot. | A databricks által üzemeltetett alapmodellek a következők:

A támogatott külső modellek a következők:

|

Mindenhol ajánlott, ahol a vizuális információk automatizált, pontos és méretezhető elemzése szükséges:

|

| Érvelés | Az emberhez hasonló logikai gondolkodás szimulálására tervezett fejlett AI-rendszerek. Az érvelési modellek olyan technikákat integrálnak, mint a szimbolikus logika, a valószínűségi érvelés és a neurális hálózatok a környezet elemzéséhez, a feladatok lebontásához és a döntéshozataluk magyarázatához. | A databricks által üzemeltetett alapmodell az alábbiakat támogatja:

A támogatott külső modellek a következők:

|

Mindenhol ajánlott, ahol a vizuális információk automatizált, pontos és méretezhető elemzése szükséges:

|

Függvényhívás

A Databricks-függvényhívás OpenAI-kompatibilis, és csak az Foundation Model API-k részeként és a külső modelleketkiszolgáló végpontok kiszolgálása során érhető el. További információ: Függvényhívás az Azure Databricksben.

Strukturált kimenetek

A strukturált kimenetek OpenAI-kompatibilisek, és csak az alapmodell API-k részeként szolgáló modell alatt érhetők el. További részletekért lásd az Azure Databricks strukturált kimeneteit.

Gyorsítótárazás kérése

Az alapmodell API-k részeként a Databricks által üzemeltetett Claude-modellek esetében támogatott a gyors gyorsítótárazás.

A lekérdezési kérelmekben megadhatja a cache_control paramétert a következő gyorsítótárazáshoz:

- Szöveges tartalomüzenetek a

messages.contenttömbben. - Gondolkodó üzenetek tartalma a

messages.contenttömbben. - A képek tartalomblokkjai a

messages.contenttömbben. - Eszközhasználat, eredmények és definíciók a

toolstömbben.

Lásd Foundation modell REST API referenciája.

Szövegtartalom

{

"messages": [

{

"role": "user",

"content": [

{

"type": "text",

"text": "What's the date today?",

"cache_control": { "type": "ephemeral" }

}

]

}

]

}

ReasonContent

{

"messages": [

{

"role": "assistant",

"content": [

{

"type": "reasoning",

"summary": [

{

"type": "summary_text",

"text": "Thinking...",

"signature": "[optional]"

},

{

"type": "summary_encrypted_text",

"data": "[encrypted text]"

}

]

}

]

}

]

}

ImageContent

A képüzenet tartalmának forrásként a kódolt adatokat kell használnia. Az URL-címek nem támogatottak.

{

"messages": [

{

"role": "user",

"content": [

{

"type": "text",

"text": "What’s in this image?"

},

{

"type": "image_url",

"image_url": {

"url": "data:image/jpeg;base64,[content]"

},

"cache_control": { "type": "ephemeral" }

}

]

}

]

}

EszközhívásTartalom

{

"messages": [

{

"role": "assistant",

"content": "Ok, let’s get the weather in New York.",

"tool_calls": [

{

"type": "function",

"id": "123",

"function": {

"name": "get_weather",

"arguments": "{\"location\":\"New York, NY\"}"

},

"cache_control": { "type": "ephemeral" }

}

]

}

]

}

Megjegyzés:

A Databricks REST API OpenAI-kompatibilis, és különbözik az antropikus API-tól. Ezek a különbségek az alábbihoz hasonló válaszobjektumokra is hatással vannak:

- A kimenet a

choicesmezőben lesz visszaadva. - Streamelési adattömb formátuma. Minden adattömb ugyanazt a formátumot követi, amelyben

choicesa válaszdeltaszerepel, és a használat minden adattömbben vissza lesz adva. - A leállítás oka a

finish_reasonmezőben lesz visszaadva.- Antropikus felhasználások:

end_turn,stop_sequence,max_tokenséstool_use - A Databricks a következőket használja:

stop,stop,lengthéstool_calls

- Antropikus felhasználások:

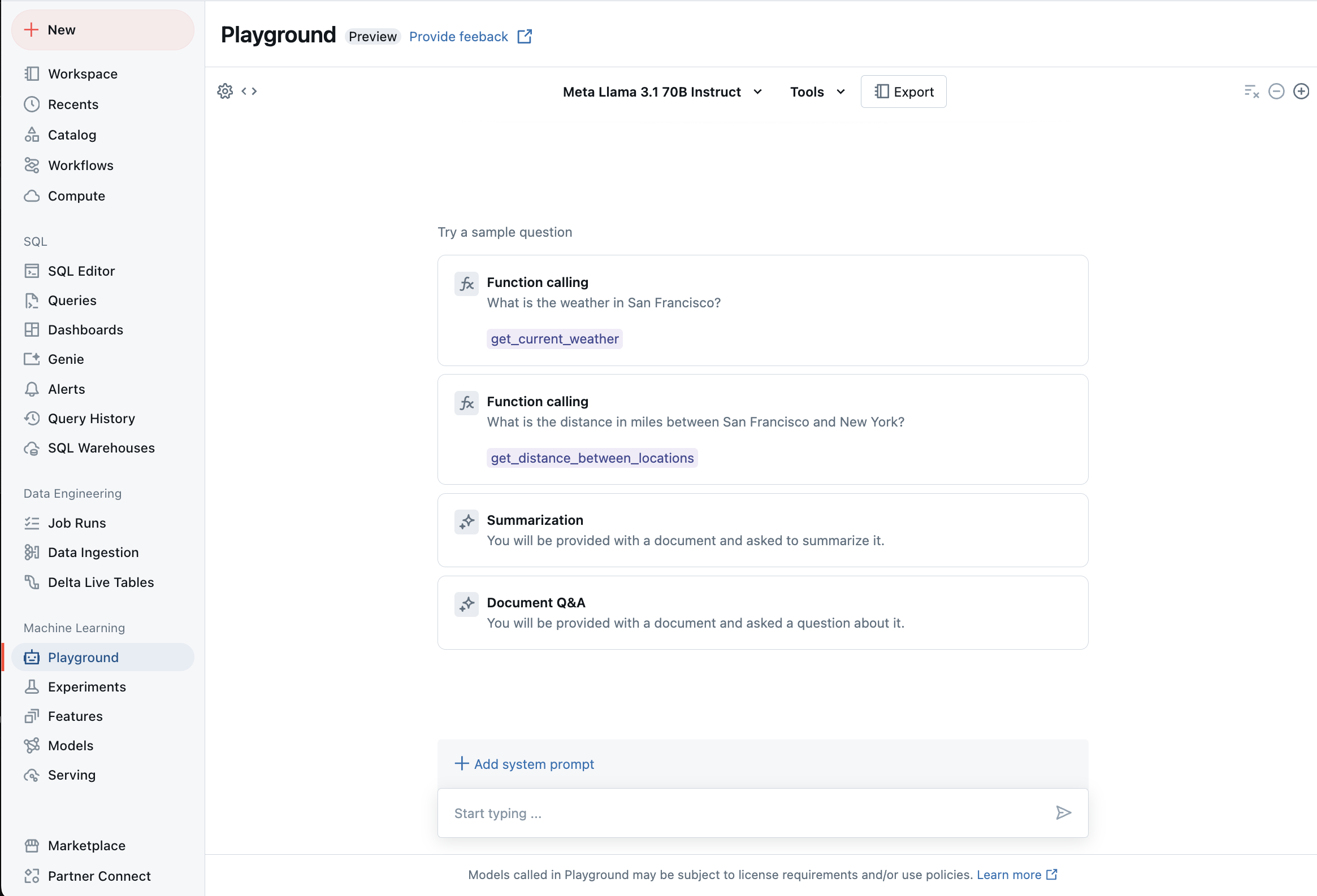

Csevegés támogatott LLM-ekkel az AI Playground használatával

A támogatott nagy nyelvi modelleket az AI Playground használatával használhatja. Az AI-játszótér egy csevegéshez hasonló környezet, ahol tesztelheti, kérheti és összehasonlíthatja az Azure Databricks-munkaterületről származó LLM-eket.

További erőforrások

- Kiszolgált modellek monitorozása Unity AI Gateway-kompatibilis következtetési táblák használatával

- Kötegelt következtetési folyamatok üzembe helyezése

- Databricks alapmodell API-k

- Külső modellek a Mozaik AI-modell szolgáltatásban

- Oktatóanyag: Külső modellvégpontok létrehozása OpenAI-modellek lekérdezéséhez

- Az Foundation Model API-kban elérhető Databricks által üzemeltetett alapmodellek

- Alapmodell – REST API-referencia