Bevezetés az Azure Databricks-munkafolyamatok használatába

Az Azure Databricks Workflows vezényli az adatfeldolgozási, gépi tanulási és elemzési folyamatokat a Databricks Adatintelligencia-platformon. A munkafolyamatok teljes körűen felügyelt vezénylési szolgáltatásokat használnak a Databricks platformmal integrálva, beleértve az Azure Databricks-feladatokat is, hogy nem interaktív kódot futtasson az Azure Databricks-munkaterületen és a Delta Live Tablesben a megbízható és karbantartható ETL-folyamatok létrehozásához.

A munkafolyamatok Databricks-platformmal való vezénylésének előnyeiről a Databricks-munkafolyamatok című témakörben olvashat bővebben.

Példa Azure Databricks-munkafolyamatra

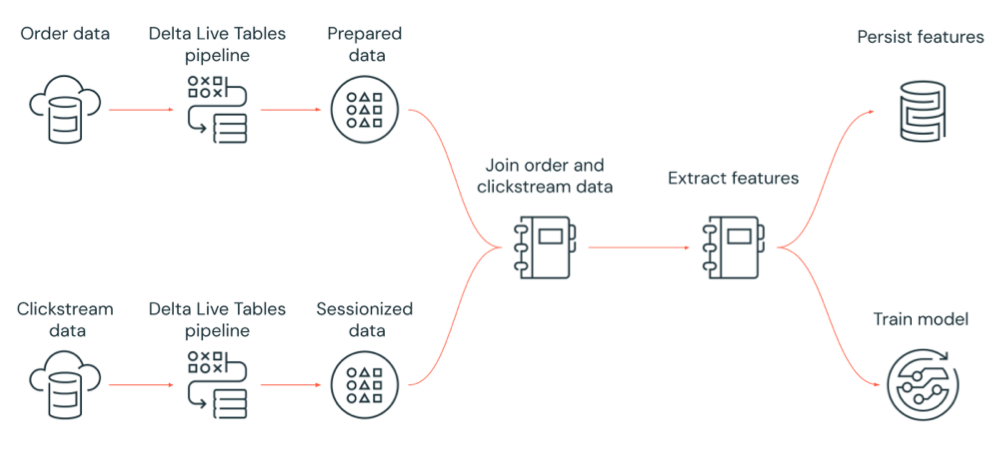

Az alábbi ábra egy Azure Databricks-feladat által vezényelt munkafolyamatot szemléltet:

- Futtasson egy Delta Live Tables-folyamatot, amely betölti a nyers kattintásfolyam-adatokat a felhőbeli tárolóból, megtisztítja és előkészíti az adatokat, munkamenetesíti az adatokat, és megőrzi a végső munkamenet-alapú adatokat a Delta Lake-re.

- Futtasson egy Delta Live Tables-folyamatot, amely betölti az adatokat a felhőbeli tárolóból, megtisztítja és átalakítja az adatokat feldolgozásra, és megőrzi a végső adatkészletet Delta Lake-ként.

- Csatlakozzon a sorrendhez és a munkamenet-alapú kattintásfolyam-adatokhoz, és hozzon létre egy új adatkészletet az elemzéshez.

- Funkciók kinyerése az előkészített adatokból.

- A funkciók megőrzéséhez és egy gépi tanulási modell betanítása érdekében párhuzamosan hajthat végre feladatokat.

Mi az Az Azure Databricks-feladatok?

Az Azure Databricks-feladatokkal adatfeldolgozási és elemzési alkalmazásokat futtathat egy Azure Databricks-munkaterületen. A feladat állhat egyetlen tevékenységből, vagy egy nagy, többfeladatos, összetett függőségekkel rendelkező munkafolyamat is lehet. Az Azure Databricks végzi a feladatok összehangolását, a fürtkezelést, a monitorozást és a hibajelentést az összes feladathoz. A feladatokat azonnal, rendszeresen, könnyen használható ütemezési rendszeren keresztül futtathatja, amikor új fájlok érkeznek egy külső helyre, vagy folyamatosan, hogy a feladat egy példánya mindig fusson. A feladatokat interaktív módon is futtathatja a jegyzetfüzet felhasználói felületén.

Feladatokat a Feladatok felhasználói felületen, a Databricks parancssori felületén vagy a Jobs API meghívásával hozhat létre és futtathat. A felhasználói felület vagy az API segítségével javíthatja és ismét futtathatja a sikertelen vagy törölt feladatokat. A feladatfuttatási eredményeket a felhasználói felület, a parancssori felület, az API és az értesítések (például e-mail, webhook célhely vagy Slack-értesítések) használatával figyelheti.

A Databricks parancssori felületének használatáról a Mi a Databricks parancssori felület? A Jobs API használatáról a Jobs API-t tekintheti meg.

Az alábbi szakaszok az Azure Databricks Jobs fontos funkcióit ismertetik.

Fontos

- Egy munkaterület legfeljebb 1000 egyidejű tevékenységfuttatásra korlátozódik.

429 Too Many Requestsválasz jelenik meg, ha olyan futtatást kér, amelyet a rendszer nem tud azonnal elindítani. - A munkaterület egy órán belül létrehozható feladatainak száma legfeljebb 10000 lehet (beleértve a "futtatások elküldését"). Ez a korlát a REST API- és jegyzetfüzet-munkafolyamatokkal létrehozott feladatokra is vonatkozik.

Adatfeldolgozás és elemzés megvalósítása feladatfeladatokkal

Az adatfeldolgozási és elemzési munkafolyamatot feladatokkal valósíthatja meg. A feladatok egy vagy több tevékenységből állnak. Létrehozhat olyan feladatfeladatokat, amelyek jegyzetfüzeteket, JARS-eket, Delta Live Tables-folyamatokat vagy Python-, Scala-, Spark-küldési és Java-alkalmazásokat futtatnak. A feladatfeladatok a Databricks SQL-lekérdezéseit, riasztásait és irányítópultjait is vezényelhetik elemzések és vizualizációk létrehozásához, vagy a dbt-tevékenység használatával dbt-átalakításokat futtathat a munkafolyamatban. Az örökölt Spark Submit-alkalmazások is támogatottak.

Egy másik feladatot futtató feladathoz is hozzáadhat egy feladatot. Ez a funkció lehetővé teszi, hogy egy nagy folyamatot több kisebb feladatra bontson, vagy általánosított modulokat hozzon létre, amelyeket több feladat újra felhasználhat.

A tevékenységek végrehajtási sorrendjét a tevékenységek közötti függőségek megadásával szabályozhatja. A feladatokat konfigurálhatja úgy, hogy egymás után vagy párhuzamosan fussanak.

Feladatok interaktív, folyamatos vagy feladat-eseményindítók használatával történő futtatása

A feladatokat interaktív módon futtathatja a Feladatok felhasználói felületéről, AZ API-ból vagy a parancssori felületről, vagy folyamatos feladatokat is futtathat. Létrehozhat egy ütemezést a feladat rendszeres futtatásához, vagy futtathatja a feladatot, amikor új fájlok érkeznek egy külső helyre, például az Amazon S3-ba, az Azure Storage-ba vagy a Google Cloud Storage-ba.

Feladat előrehaladásának figyelése értesítések használatával

Értesítéseket kaphat, ha egy feladat vagy tevékenység elindul, befejeződik vagy meghiúsul. Értesítéseket küldhet egy vagy több e-mail-címre vagy rendszercélra (például webhook-célhelyekre vagy Slackre). Lásd: E-mail- és rendszerértesítések hozzáadása feladateseményekhez.

Feladatok futtatása az Azure Databricks számítási erőforrásaival

A Databricks-fürtök és az SQL-raktárak biztosítják a számítási erőforrásokat a feladatokhoz. A feladatokat feladatfürttel, teljes célú fürttel vagy SQL-raktárral is futtathatja:

- A feladatfürt egy dedikált fürt a feladathoz vagy az egyes feladatokhoz. A feladat használhat olyan feladatfürtöt, amelyet minden tevékenység megosztott, vagy konfigurálhat fürtöt az egyes tevékenységekhez, amikor létrehoz vagy szerkeszt egy tevékenységet. Egy feladatfürt akkor jön létre, amikor a feladat vagy tevékenység elindul és leáll, amikor a feladat vagy tevékenység véget ér.

- A teljes célú fürtök olyan megosztott fürtök, amelyek manuálisan indulnak el és fejeződnek be, és több felhasználó és feladat is megosztható.

Az erőforrás-használat optimalizálása érdekében a Databricks egy feladatfürt használatát javasolja a feladatokhoz. A fürtindításra való várakozással töltött idő csökkentése érdekében fontolja meg egy teljes körű fürt használatát. Lásd: Az Azure Databricks számítási feladatainak használata.

Sql Warehouse használatával futtathat Databricks SQL-feladatokat, például lekérdezéseket, irányítópultokat vagy riasztásokat. SQL-raktárral is futtathat dbt-átalakításokat a dbt-feladattal.

Következő lépések

Az Azure Databricks-feladatok használatának első lépései:

Hozza létre első Azure Databricks-feladatát a rövid útmutatóval.

Megtudhatja, hogyan hozhat létre és futtathat munkafolyamatokat az Azure Databricks Jobs felhasználói felületével.

Megtudhatja, hogyan futtathat feladatokat anélkül, hogy kiszolgáló nélküli munkafolyamatokkal kellene konfigurálnia az Azure Databricks számítási erőforrásait.

További információ a feladatok futtatásának monitorozásáról az Azure Databricks Jobs felhasználói felületén.

További információ a feladatok konfigurációs beállításairól .

További információ a munkafolyamatok Azure Databricks-feladatokkal történő kiépítéséről, kezeléséről és hibaelhárításáról:

- Megtudhatja, hogyan kommunikálhat az Azure Databricks-feladatok tevékenységei között tevékenységértékekkel.

- Ebből a cikkből megtudhatja, hogyan adhatja át a feladatokkal kapcsolatos kontextust feladat-tevékenységekbe feladatparaméter-változókkal.

- Megtudhatja, hogyan konfigurálhatja a feladattevékenységeket feltételes futtatásra a tevékenység függőségeinek állapota alapján.

- Megtudhatja, hogyan háríthatja el és javíthatja ki a sikertelen feladatokat.

- Értesítést kaphat, ha a feladat futása elindul, befejeződik vagy sikertelen lesz a feladatfuttatási értesítésekkel.

- A feladatokat egyéni ütemezés szerint indíthatja el, vagy folyamatos feladatot futtathat.

- Megtudhatja, hogyan futtathatja az Azure Databricks-feladatot, amikor új adatok érkeznek fájlbetöltési eseményindítókkal.

- Megtudhatja, hogyan használhatja a Databricks számítási erőforrásait a feladatok futtatásához.

- Ismerje meg a Jobs API frissítéseit a munkafolyamatok Azure Databricks-feladatokkal való létrehozásának és kezelésének támogatásához.

- Útmutatók és oktatóanyagok segítségével többet tudhat meg az adat-munkafolyamatok Azure Databricks-feladatokkal való implementálásáról.

Mi az a Delta Live Tables?

Feljegyzés

A Delta Live Tableshez prémium csomag szükséges. További információért forduljon a Databricks-fiók csapatához.

A Delta Live Tables egy keretrendszer, amely leegyszerűsíti az ETL- és streamelési adatfeldolgozást. A Delta Live Tables az adatok hatékony betöltését biztosítja az automatikus betöltő, AZ SQL és a Python felületek beépített támogatásával, amelyek támogatják az adatátalakítások deklaratív megvalósítását, valamint támogatják az átalakított adatok Delta Lake-be írását. Ön határozza meg az adatokon végrehajtandó átalakításokat, a Delta Live Tables pedig a feladatvezénylést, a fürtkezelést, a monitorozást, az adatminőséget és a hibakezelést kezeli.

Első lépésként tekintse meg a Delta Live Tables bemutatása című témakört.

Azure Databricks-feladatok és Delta Live Tables

Az Azure Databricks Jobs és a Delta Live Tables átfogó keretrendszert biztosít a teljes körű adatfeldolgozási és elemzési munkafolyamatok létrehozásához és üzembe helyezéséhez.

Az adatok betöltéséhez és átalakításához használja a Delta Live Tableset. Az Azure Databricks-feladatok segítségével vezényelheti a Databricks platformon egy vagy több adatfeldolgozási és elemzési feladatból álló számítási feladatokat, beleértve a Delta Live Tables betöltési és átalakítási feladatait.

Munkafolyamat-vezénylési rendszerként az Azure Databricks Jobs a következőket is támogatja:

- Feladatok futtatása aktivált alapon, például munkafolyamat ütemezés szerint történő futtatása.

- Adatelemzés SQL-lekérdezésekkel, gépi tanulással és adatelemzéssel jegyzetfüzetekkel, szkriptekkel vagy külső kódtárakkal stb.

- Egyetlen feladatból álló feladat futtatása, például jar-ban csomagolt Apache Spark-feladat futtatása.

Munkafolyamat vezénylése az Apache AirFlow-tal

Bár a Databricks az Azure Databricks Jobs használatát javasolja az adat-munkafolyamatok vezényléséhez, az Apache Airflow használatával is kezelheti és ütemezheti az adat-munkafolyamatokat. Az Airflow használatával egy Python-fájlban definiálhatja a munkafolyamatot, az Airflow pedig felügyeli a munkafolyamat ütemezését és futtatását. Lásd: Azure Databricks-feladatok vezénylése az Apache Airflow használatával.

Munkafolyamat-vezénylés az Azure Data Factoryvel

Az Azure Data Factory (ADF) egy felhőalapú adatintegrációs szolgáltatás, amellyel adattárolási, áthelyezési és feldolgozási szolgáltatásokat írhat automatizált adatfolyamokba. Az ADF használatával egy Azure Databricks-feladatot vezényelhet egy ADF-folyamat részeként.

Ha meg szeretné tudni, hogyan futtathat egy feladatot az ADF webes tevékenységével, beleértve az Azure Databricks-beli hitelesítésT az ADF-ből, olvassa el az Azure Databricks-feladatok vezénylését az Azure Data Factoryből.

Az ADF beépített támogatást is biztosít a Databricks-jegyzetfüzetek, Python-szkriptek vagy kód ADF-folyamatokban lévő JAR-ekben csomagolt futtatásához.

A Databricks-jegyzetfüzetek ADF-folyamatokban való futtatásáról a Databricks-jegyzetfüzet futtatása az Azure Data Factory Databricks-notebook-tevékenységével, majd az adatok átalakítása Databricks-jegyzetfüzet futtatásával című témakörben olvashat.

Ha tudni szeretné, hogyan futtathat Python-szkripteket egy ADF-folyamatban, olvassa el az Adatok átalakítása Python-tevékenység Azure Databricksben való futtatásával című témakört.

Ha meg szeretné tudni, hogyan futtathat JAR-ban csomagolt kódot egy ADF-folyamatban, olvassa el az Adatok átalakítása JAR-tevékenység azure Databricksben való futtatásával című témakört.

Visszajelzés

Hamarosan elérhető: 2024-ben fokozatosan kivezetjük a GitHub-problémákat a tartalom visszajelzési mechanizmusaként, és lecseréljük egy új visszajelzési rendszerre. További információ: https://aka.ms/ContentUserFeedback.

Visszajelzés küldése és megtekintése a következőhöz: