Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

Dalam artikel ini, Anda mempelajari opsi mana yang tersedia untuk menulis permintaan kueri untuk model fondasi dan cara mengirimnya ke titik akhir penyajian model Anda. Anda dapat mengkueri model fondasi yang dihosting oleh Databricks dan model fondasi yang dihosting di luar Databricks.

Untuk permintaan kueri model ML atau Python tradisional, lihat Kueri yang melayani titik akhir untuk model kustom.

Mosaic AI Model Serving mendukung API Model Foundation dan model eksternal untuk mengakses model fondasi. Model Serving menggunakan API dan SDK yang kompatibel dengan OpenAI terpadu untuk mengkuerinya. Hal ini memungkinkan untuk bereksperimen dengan dan menyesuaikan model fondasi untuk produksi di seluruh cloud dan penyedia yang didukung.

Opsi kueri

Mosaic AI Model Serving menyediakan opsi berikut untuk mengirim permintaan kueri ke titik akhir yang melayani model fondasi:

| Metode | Detail-detail |

|---|---|

| Klien OpenAI | Menjalankan kueri pada model yang dihosting oleh endpoint Mosaic AI Model Serving menggunakan klien OpenAI. Tentukan nama titik akhir penyajian model model sebagai input. Didukung untuk model obrolan, penyematan, dan penyelesaian yang disediakan oleh API Model Foundation atau model eksternal. |

| Fungsi AI | Panggil inferensi model langsung dari SQL menggunakan ai_query fungsi SQL. Lihat Contoh: Mengkueri model fondasi. |

| Menampilkan UI | Pilih Titik akhir kueri dari halaman Titik akhir penayangan . Sisipkan data input model format JSON dan klik Kirim Permintaan. Jika model memiliki contoh input yang dicatat, gunakan Tampilkan Contoh untuk memuatnya. |

| REST API | Panggil dan kueri model menggunakan REST API. Lihat POST /serving-endpoints/{name}/invocations untuk detailnya. Untuk permintaan penilaian ke titik akhir yang melayani beberapa model, lihat Mengkueri model individual di belakang titik akhir. |

| SDK MLflow untuk Penyebaran | Gunakan fungsi predict() MLflow Deployments SDK untuk mengkueri model. |

| Databricks Python SDK | Databricks Python SDK adalah lapisan di atas REST API. Ini menangani detail tingkat rendah, seperti autentikasi, sehingga lebih mudah untuk berinteraksi dengan model. |

Persyaratan

- Model yang melayani titik akhir.

- Ruang kerja Databricks di wilayah yang didukung.

- Wilayah API Model Fondasi

- Wilayah model eksternal

- Untuk mengirim permintaan penilaian melalui klien OpenAI, REST API, atau SDK Penyebaran MLflow, Anda harus memiliki token API Databricks.

Penting

Sebagai praktik terbaik keamanan untuk skenario produksi, Databricks merekomendasikan agar Anda menggunakan token OAuth mesin-ke-mesin untuk autentikasi selama produksi.

Untuk pengujian dan pengembangan, Databricks merekomendasikan penggunaan token akses pribadi milik perwakilan layanan alih-alih pengguna ruang kerja. Untuk membuat token untuk perwakilan layanan, lihat Mengelola token untuk perwakilan layanan.

Menginstal paket

Setelah memilih metode kueri, Anda harus terlebih dahulu menginstal paket yang sesuai ke kluster Anda.

Klien OpenAI

Untuk menggunakan klien OpenAI, databricks-openai paket perlu diinstal pada kluster Anda. Paket ini menyediakan klien OpenAI dengan otorisasi yang dikonfigurasi secara otomatis untuk mengkueri model AI generatif. Jalankan hal berikut ini di buku catatan atau terminal lokal Anda:

pip install -U databricks-openai

Berikut ini hanya diperlukan saat menginstal paket pada Databricks Notebook

dbutils.library.restartPython()

REST API

Akses ke Serving REST API tersedia di Databricks Runtime untuk Pembelajaran Mesin.

SDK MLflow untuk Penyebaran

!pip install mlflow

Berikut ini hanya diperlukan saat menginstal paket pada Databricks Notebook

dbutils.library.restartPython()

Databricks Python SDK

Databricks SDK untuk Python sudah diinstal pada semua kluster Azure Databricks yang menggunakan Databricks Runtime 13.3 LTS atau lebih tinggi. Untuk kluster Azure Databricks yang menggunakan Databricks Runtime 12.2 LTS dan di bawahnya, Anda harus menginstal Databricks SDK untuk Python terlebih dahulu. Lihat Databricks SDK untuk Python.

Jenis model fondasi

Tabel berikut ini meringkas model fondasi yang didukung berdasarkan jenis tugas.

Penting

Meta-Llama-3.1-405B-Instruct akan dihentikan.

- Mulai 15 Februari 2026 untuk beban kerja bayar per token.

- Mulai 15 Mei 2026 untuk beban kerja dengan throughput yang telah ditentukan.

Lihat Model yang sudah dihentikan untuk model penggantian yang direkomendasikan dan panduan tentang cara migrasi selama masa penghentian.

| Jenis tugas | Deskripsi | Model yang didukung | Kapan harus digunakan? Kasus penggunaan yang direkomendasikan |

|---|---|---|---|

| Tujuan umum | Model yang dirancang untuk memahami dan terlibat dalam percakapan multi-giliran alami. Mereka disempurnakan pada himpunan data besar dialog manusia, yang memungkinkan mereka menghasilkan respons yang relevan secara kontekstual, melacak riwayat percakapan, dan memberikan interaksi yang koheren dan seperti manusia di berbagai topik. | Berikut ini adalah model fondasi yang dihosting Databricks yang didukung:

Berikut ini adalah model eksternal yang didukung:

|

Direkomendasikan untuk skenario di mana dialog alami multi-giliran dan pemahaman kontekstual dibutuhkan.

|

| Embeddings | Model penyematan adalah sistem pembelajaran mesin yang mengubah data kompleks—seperti teks, gambar, atau audio—menjadi vektor numerik ringkas yang disebut penyematan. Vektor ini menangkap fitur dan hubungan penting dalam data, memungkinkan perbandingan, pengklusteran, dan pencarian semantik yang efisien. | Berikut ini adalah model fondasi yang dihosting Databricks yang didukung: Berikut ini adalah model eksternal yang didukung:

|

Direkomendasikan untuk aplikasi di mana pemahaman semantik, perbandingan kesamaan, dan pengambilan atau pengklusteran data kompleks yang efisien sangat penting:

|

| Penglihatan | Model yang dirancang untuk memproses, menginterpretasikan, dan menganalisis data visual—seperti gambar dan video sehingga mesin dapat "melihat" dan memahami dunia visual. | Berikut ini adalah model fondasi yang dihosting Databricks yang didukung:

Berikut ini adalah model eksternal yang didukung:

|

Di mana pun analisis otomatis, akurat, dan dapat diskalakan dari informasi visual diperlukan, direkomendasikan:

|

| Penalaran | Sistem AI tingkat lanjut yang dirancang untuk mensimulasikan pemikiran logis seperti manusia. Model penalaran mengintegrasikan teknik seperti logika simbolis, penalaran probabilistik, dan jaringan neural untuk menganalisis konteks, memecah tugas, dan menjelaskan pengambilan keputusannya. | Berikut ini adalah model fondasi yang dihosting Databricks yang didukung:

Berikut ini adalah model eksternal yang didukung:

|

Di mana pun analisis otomatis, akurat, dan dapat diskalakan dari informasi visual diperlukan, direkomendasikan:

|

Pemanggilan fungsi

Pemanggilan Fungsi Databricks kompatibel dengan OpenAI dan hanya tersedia selama penyajian model sebagai bagian dari API Model Foundation dan titik akhir penyajian yang melayani model eksternal. Untuk detailnya, lihat Panggilan fungsi di Azure Databricks.

Output terstruktur

Output terstruktur kompatibel dengan OpenAI dan hanya tersedia selama model berfungsi sebagai bagian dari API Model Foundation. Untuk detailnya, lihat Output terstruktur di Azure Databricks.

Penembolokan perintah

Prompt caching didukung untuk model Claude yang dihosting Databricks sebagai bagian dari Foundation Model APIs.

Anda dapat menentukan cache_control parameter dalam permintaan kueri Anda untuk menyimpan cache berikut:

- Pesan konten teks dalam

messages.contentarray. - Memikirkan konten pesan dalam

messages.contentarray. - Blok konten gambar dalam

messages.contentarray. - Penggunaan alat, hasil, dan definisi dalam

toolsarray.

Lihat Referensi API REST model dasar.

TextContent

{

"messages": [

{

"role": "user",

"content": [

{

"type": "text",

"text": "What's the date today?",

"cache_control": { "type": "ephemeral" }

}

]

}

]

}

ReasonContent

{

"messages": [

{

"role": "assistant",

"content": [

{

"type": "reasoning",

"summary": [

{

"type": "summary_text",

"text": "Thinking...",

"signature": "[optional]"

},

{

"type": "summary_encrypted_text",

"data": "[encrypted text]"

}

]

}

]

}

]

}

ImageContent

Konten pesan gambar harus menggunakan data yang dikodekan sebagai sumbernya. URL tidak didukung.

{

"messages": [

{

"role": "user",

"content": [

{

"type": "text",

"text": "What’s in this image?"

},

{

"type": "image_url",

"image_url": {

"url": "data:image/jpeg;base64,[content]"

},

"cache_control": { "type": "ephemeral" }

}

]

}

]

}

ToolCallContent

{

"messages": [

{

"role": "assistant",

"content": "Ok, let’s get the weather in New York.",

"tool_calls": [

{

"type": "function",

"id": "123",

"function": {

"name": "get_weather",

"arguments": "{\"location\":\"New York, NY\"}"

},

"cache_control": { "type": "ephemeral" }

}

]

}

]

}

Nota

Databricks REST API kompatibel dengan OpenAI dan berbeda dari API Anthropic. Perbedaan ini juga berdampak pada objek respons seperti berikut ini:

- Output dikembalikan di

choiceskolom. - Format gugus streaming. Semua gugus mematuhi format yang sama di mana

choicesberisi responsdeltadan penggunaan dikembalikan di setiap gugus. - Alasan berhenti dikembalikan di

finish_reasonkolom.- Anthropic menggunakan:

end_turn,stop_sequence,max_tokens, dantool_use - Databricks masing-masing menggunakan:

stop,stop,length, dantool_calls

- Anthropic menggunakan:

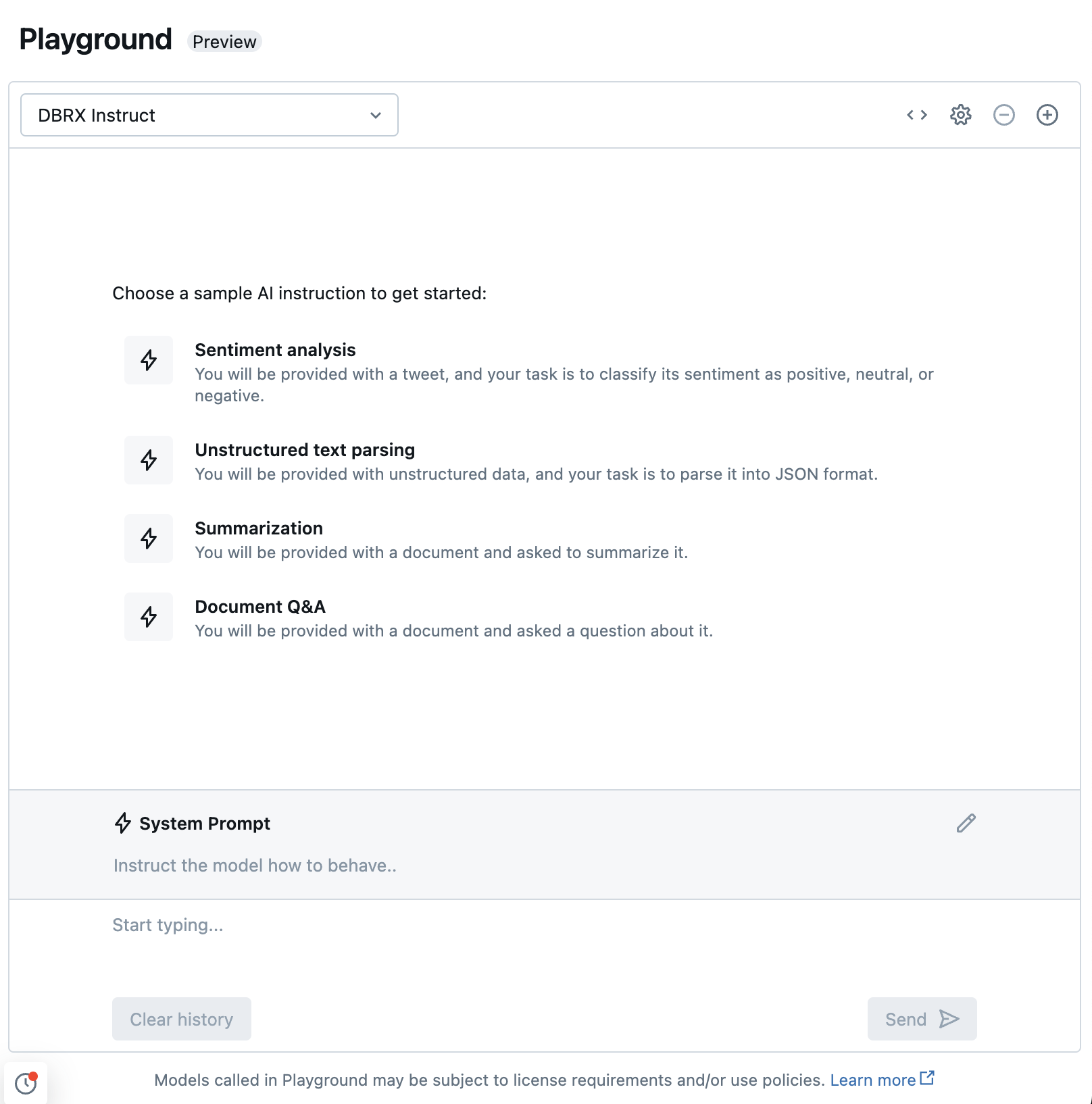

Mengobrol dengan LLM yang didukung menggunakan AI Playground

Anda dapat berinteraksi dengan model bahasa besar yang didukung menggunakan AI Playground. AI Playground adalah lingkungan seperti obrolan tempat Anda dapat menguji, meminta, dan membandingkan LLM dari ruang kerja Azure Databricks Anda.

Sumber Daya Tambahan:

- Memantau model yang dilayani menggunakan tabel inferensi dengan dukungan Unity AI Gateway

- Menjalankan alur inferensi batch

- API Foundation Model Databricks

- Model eksternal dalam Mosaic AI Model Serving

- Tutorial: Membuat titik akhir model eksternal untuk mengkueri model OpenAI

- Model fondasi yang dihosting Databricks tersedia di API Model Foundation

- Referensi API REST model dasar