Manajemen postur keamanan AI (Pratinjau)

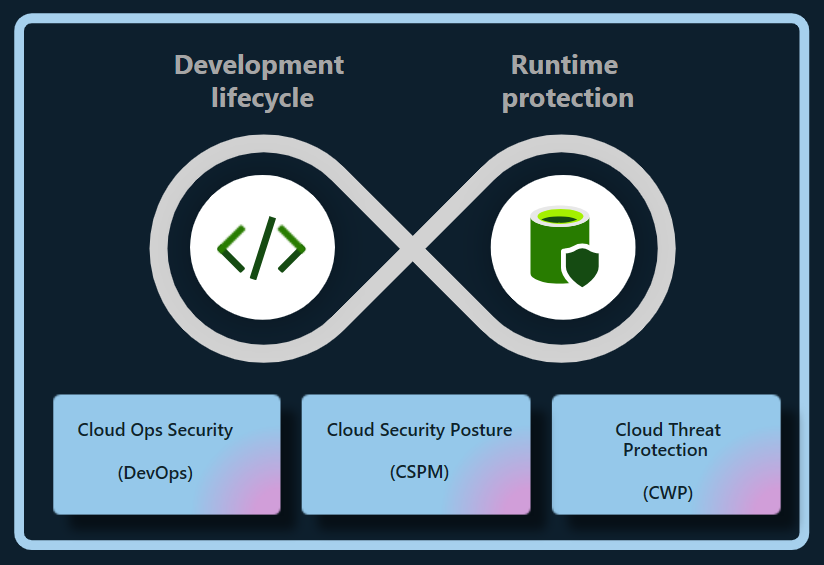

Paket Defender Cloud Security Posture Management (CSPM) dalam Microsoft Defender untuk Cloud menyediakan kemampuan manajemen postur keamanan AI yang mengamankan aplikasi AI generatif buatan perusahaan, multi, atau hybrid cloud (saat ini Azure dan AWS), di seluruh siklus hidup aplikasi. Defender untuk Cloud mengurangi risiko terhadap beban kerja AI lintas cloud dengan:

- Menemukan AI Bill of Materials (AI BOM) generatif, yang mencakup komponen aplikasi, data, dan artefak AI dari kode ke cloud.

- Memperkuat postur keamanan aplikasi AI generatif dengan rekomendasi bawaan dan dengan menjelajahi dan memulihkan risiko keamanan.

- Menggunakan analisis jalur serangan untuk mengidentifikasi dan memulihkan risiko.

Penting

Untuk mengaktifkan kemampuan manajemen postur keamanan AI pada akun AWS yang sudah:

- Tersambung ke akun Azure Anda.

- Mengaktifkan Defender CSPM.

- Memiliki jenis izin yang ditetapkan sebagai Akses hak istimewa terkecil.

Anda harus mengonfigurasi ulang izin pada konektor tersebut untuk mengaktifkan izin yang relevan menggunakan langkah-langkah berikut:

- Di portal Microsoft Azure navigasikan ke halaman Pengaturan Lingkungan dan pilih konektor AWS yang sesuai.

- Pilih Konfigurasikan akses.

- Pastikan jenis izin diatur ke Akses hak istimewa paling sedikit.

- Ikuti langkah 5 - 8 untuk menyelesaikan konfigurasi.

Menemukan aplikasi AI generatif

Defender untuk Cloud menemukan beban kerja AI dan mengidentifikasi detail BOM AI organisasi Anda. Visibilitas ini memungkinkan Anda mengidentifikasi dan mengatasi kerentanan dan melindungi aplikasi AI generatif dari potensi ancaman.

Defenders for Cloud secara otomatis dan terus menemukan beban kerja AI yang disebarkan di seluruh layanan berikut:

- Azure OpenAI Service

- Pembelajaran Mesin Azure

- Amazon Bedrock

Defender untuk Cloud juga dapat menemukan kerentanan dalam dependensi pustaka AI generatif seperti TensorFlow, PyTorch, dan Langchain, dengan memindai kode sumber untuk kesalahan konfigurasi Infrastruktur sebagai Kode (IaC) dan gambar kontainer untuk kerentanan. Memperbarui atau menambal pustaka secara teratur dapat mencegah eksploitasi, melindungi aplikasi AI generatif, dan menjaga integritasnya.

Dengan fitur-fitur ini, Defender untuk Cloud memberikan visibilitas penuh beban kerja AI dari kode ke cloud.

Mengurangi risiko pada aplikasi AI generatif

Defender CSPM memberikan wawasan kontekstual tentang postur keamanan AI organisasi. Anda dapat mengurangi risiko dalam beban kerja AI Anda menggunakan rekomendasi keamanan dan analisis jalur serangan.

Menjelajahi risiko menggunakan rekomendasi

Defender untuk Cloud menilai beban kerja AI dan mengeluarkan rekomendasi sekeliling identitas, keamanan data, dan paparan internet untuk mengidentifikasi dan memprioritaskan masalah keamanan penting dalam beban kerja AI.

Mendeteksi kesalahan konfigurasi IaC

Keamanan DevOps mendeteksi kesalahan konfigurasi IaC, yang dapat mengekspos aplikasi AI generatif terhadap kerentanan keamanan, seperti kontrol akses yang terlalu terbuka atau layanan yang diekspos secara tidak sengaja secara publik. Kesalahan konfigurasi ini dapat menyebabkan pelanggaran data, akses tidak sah, dan masalah kepatuhan, terutama saat menangani peraturan privasi data yang ketat.

Defender untuk Cloud menilai konfigurasi aplikasi AI generatif Anda dan memberikan rekomendasi keamanan untuk meningkatkan postur keamanan AI.

Kesalahan konfigurasi yang terdeteksi harus diperbaiki di awal siklus pengembangan untuk mencegah masalah yang lebih kompleks di kemudian hari.

Pemeriksaan keamanan IaC AI saat ini meliputi:

- Menggunakan Titik Akhir Privat Azure AI Service

- Membatasi Titik Akhir Layanan Azure AI

- Menggunakan Identitas Terkelola untuk Akun Layanan Azure AI

- Menggunakan autentikasi berbasis identitas untuk Akun Layanan Azure AI

Menjelajahi risiko dengan analisis jalur serangan

Analisis jalur serangan mendeteksi dan mengurangi risiko terhadap beban kerja AI, terutama selama tahap grounding (menautkan model AI ke data tertentu) dan menyempurnakan (menyesuaikan model yang telah dilatih sebelumnya pada himpunan data tertentu untuk meningkatkan performanya pada tugas terkait), di mana data mungkin diekspos.

Dengan memantau beban kerja AI terus menerus, analisis jalur serangan dapat mengidentifikasi kelemahan dan potensi kerentanan dan menindaklanjuti rekomendasi. Selain itu, ini meluas ke kasus di mana data dan sumber daya komputasi didistribusikan di Seluruh Azure, AWS, dan GCP.

Konten terkait

Saran dan Komentar

Segera hadir: Sepanjang tahun 2024 kami akan menghentikan penggunaan GitHub Issues sebagai mekanisme umpan balik untuk konten dan menggantinya dengan sistem umpan balik baru. Untuk mengetahui informasi selengkapnya, lihat: https://aka.ms/ContentUserFeedback.

Kirim dan lihat umpan balik untuk