Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

Dalam tutorial ini, Anda membangun alur untuk memindahkan OData dari sumber Northwind ke tujuan lakehouse dan mengirim pemberitahuan email saat alur selesai.

Prasyarat

Untuk memulai, Anda harus menyelesaikan prasyarat berikut:

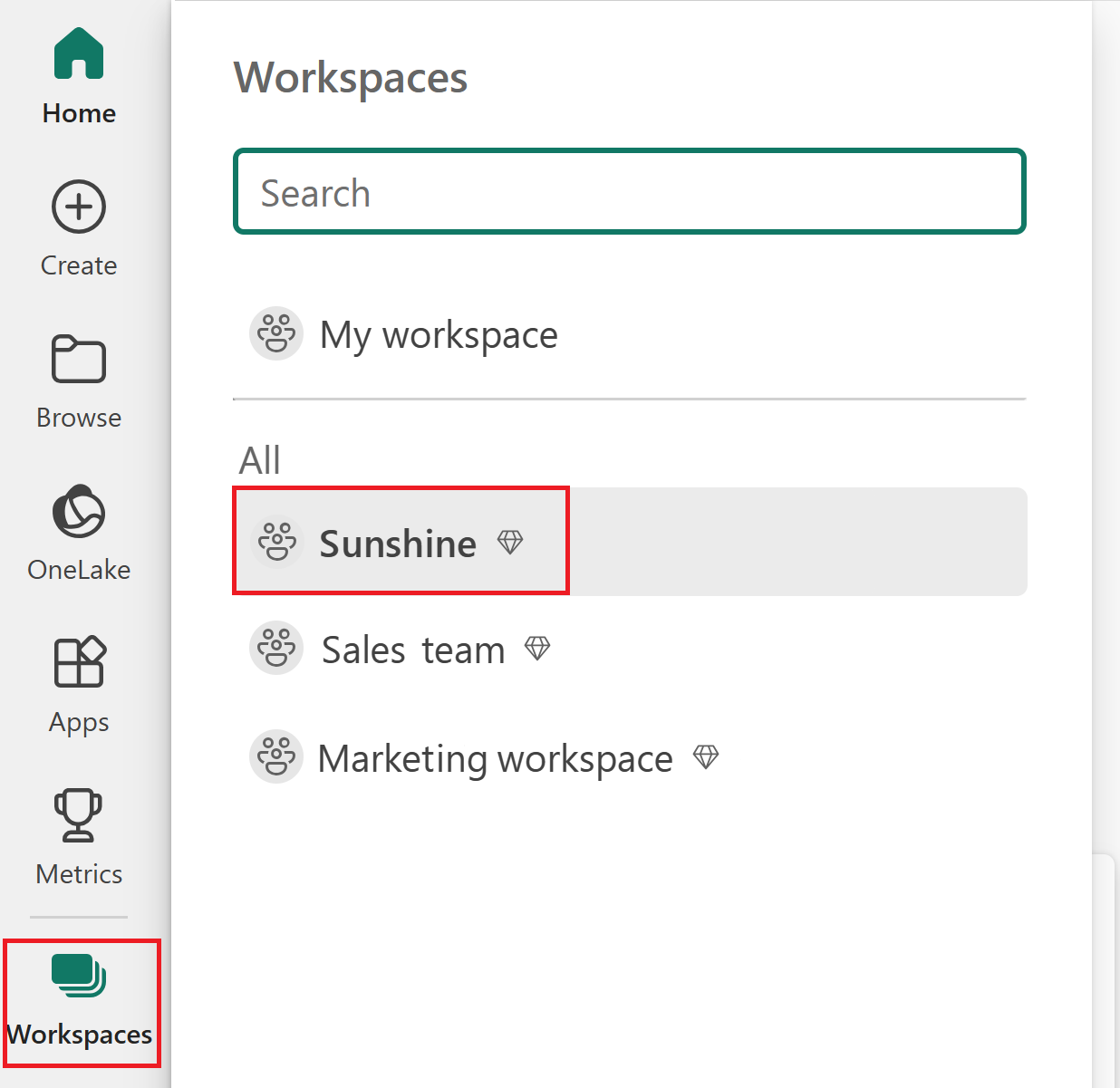

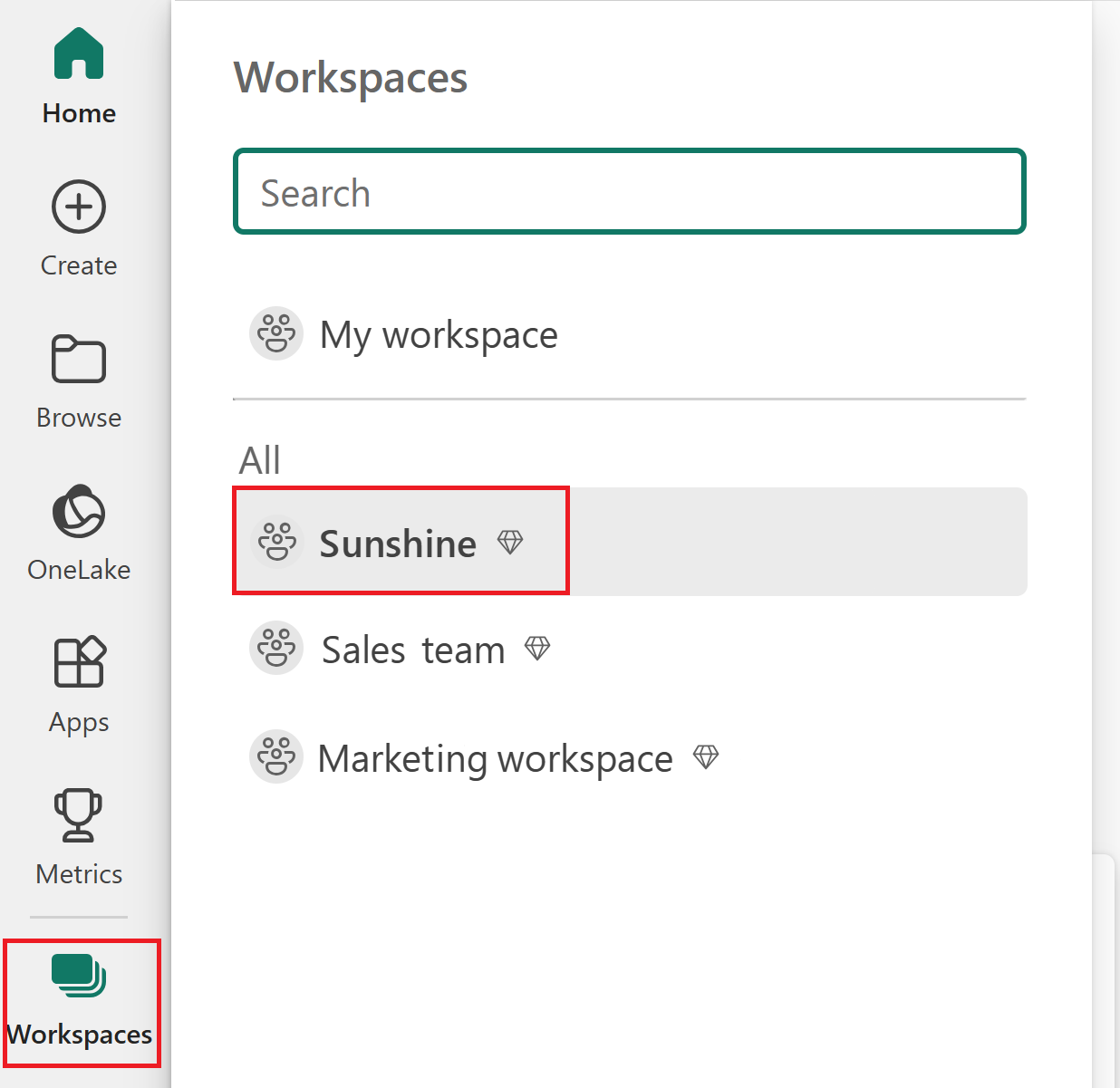

- Pastikan Anda memiliki Ruang Kerja yang diaktifkan Microsoft Fabric yang bukan ruang kerja saya default.

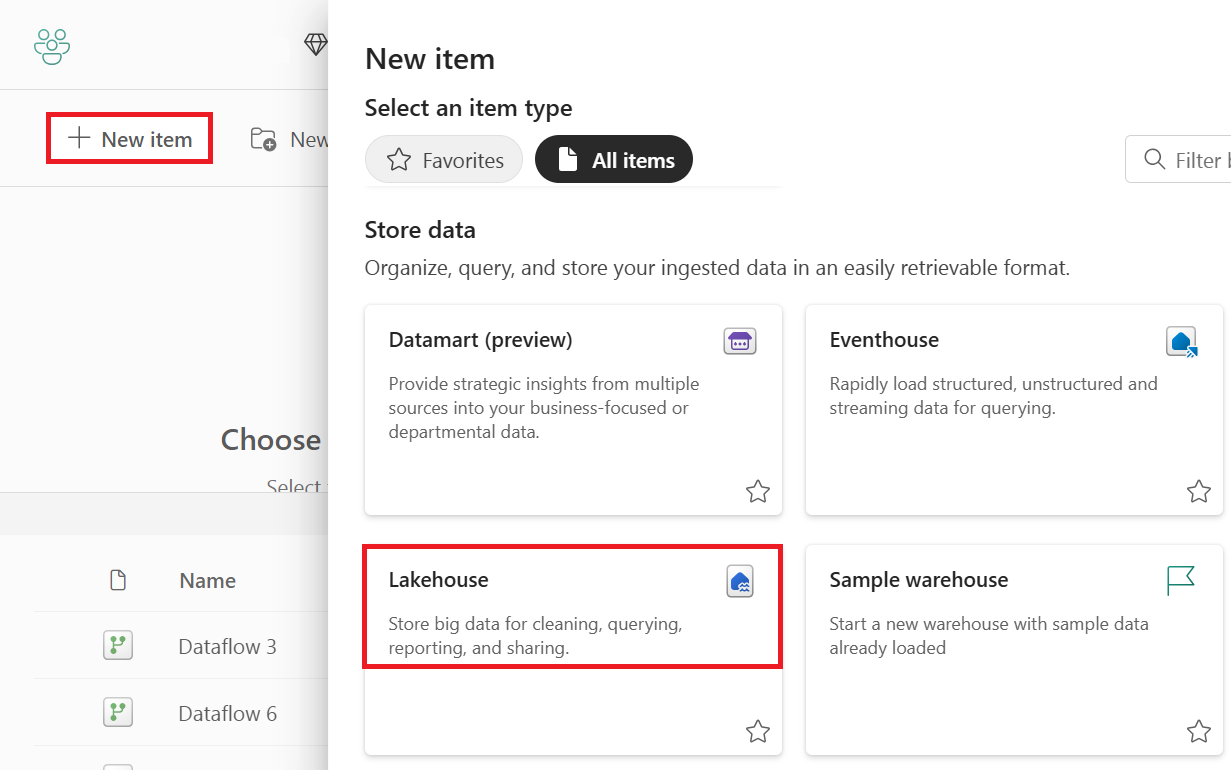

Membuat Lakehouse

Untuk memulai, pertama-tama Anda perlu membuat lakehouse. Lakehouse adalah data lake yang dioptimalkan untuk analitik. Dalam tutorial ini, Anda membuat lakehouse yang digunakan sebagai tujuan untuk aliran data.

Buka ruang kerja yang diaktifkan Fabric Anda.

Pilih Lakehouse di menu buat.

Masukkan Nama untuk lakehouse.

Pilih Buat.

Sekarang Anda telah membuat lakehouse dan anda sekarang dapat menyiapkan aliran data.

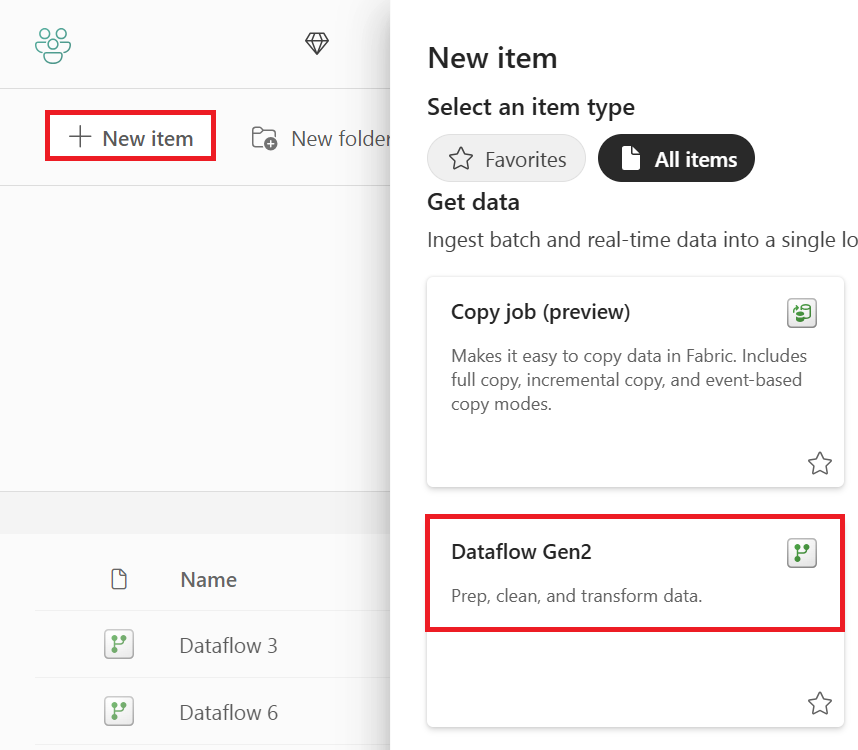

Membuat aliran data

Aliran data adalah transformasi data yang dapat digunakan kembali yang dapat digunakan dalam alur. Dalam tutorial ini, Anda membuat aliran data yang mendapatkan data dari sumber OData dan menulis data ke tujuan lakehouse.

Buka ruang kerja yang diaktifkan Fabric Anda.

Pilih Aliran Data Gen2 di menu buat.

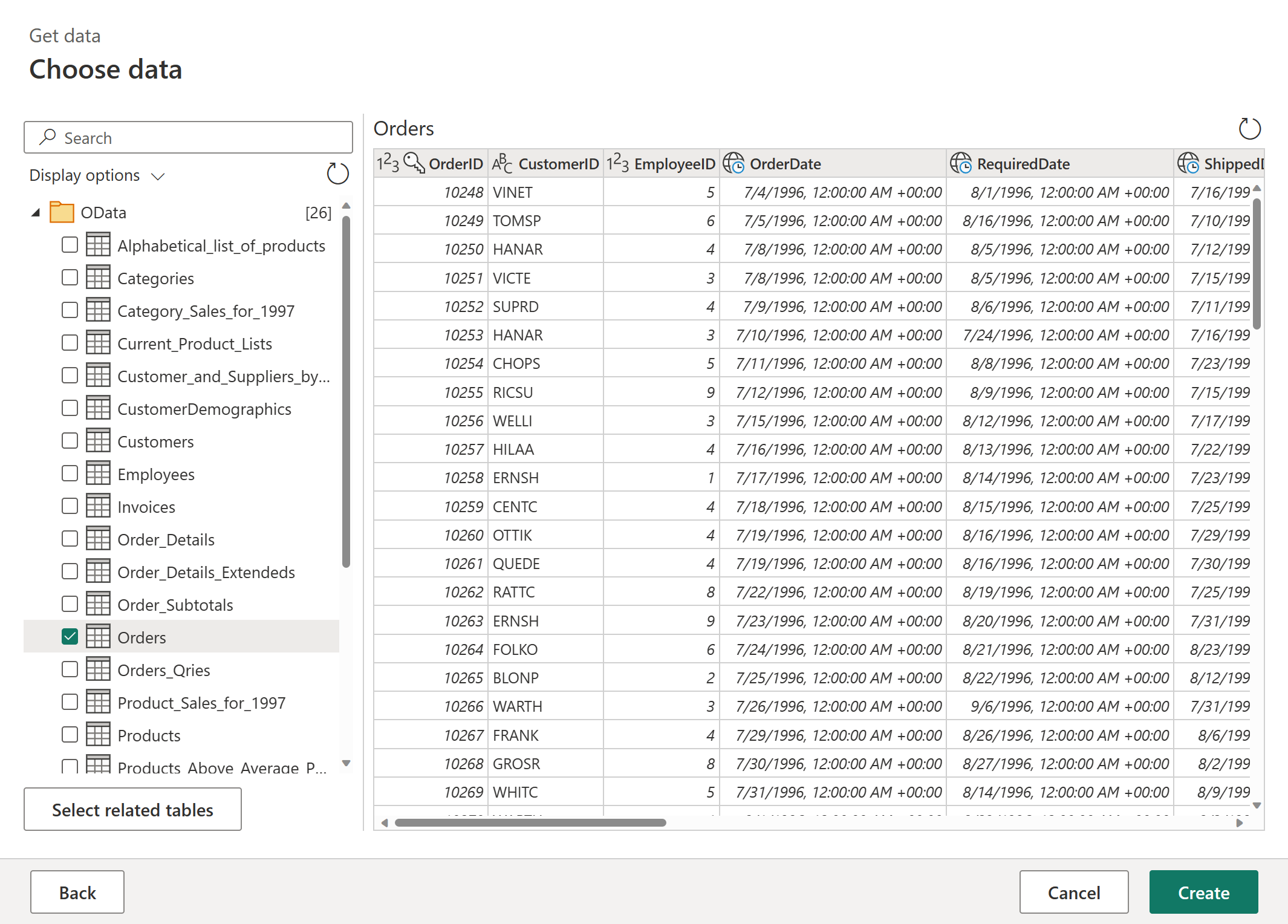

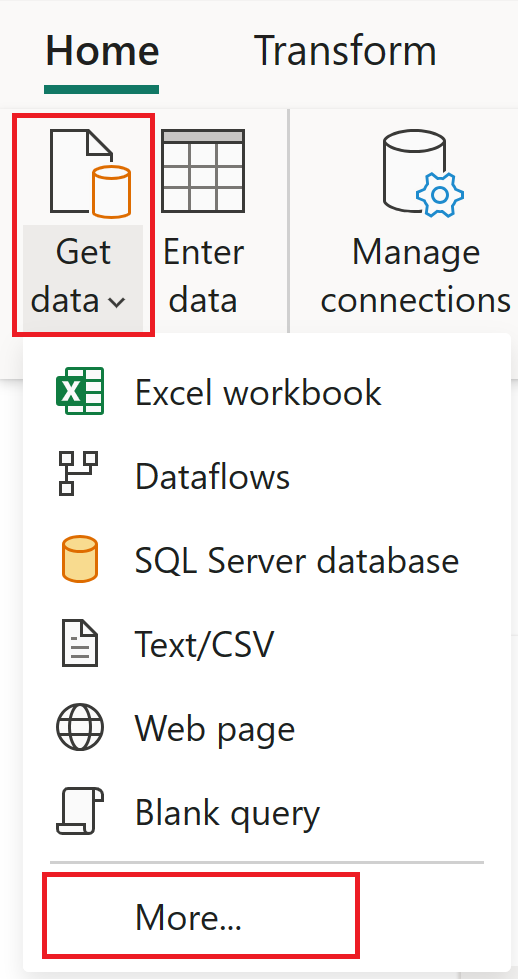

Menyerap data dari sumber OData.

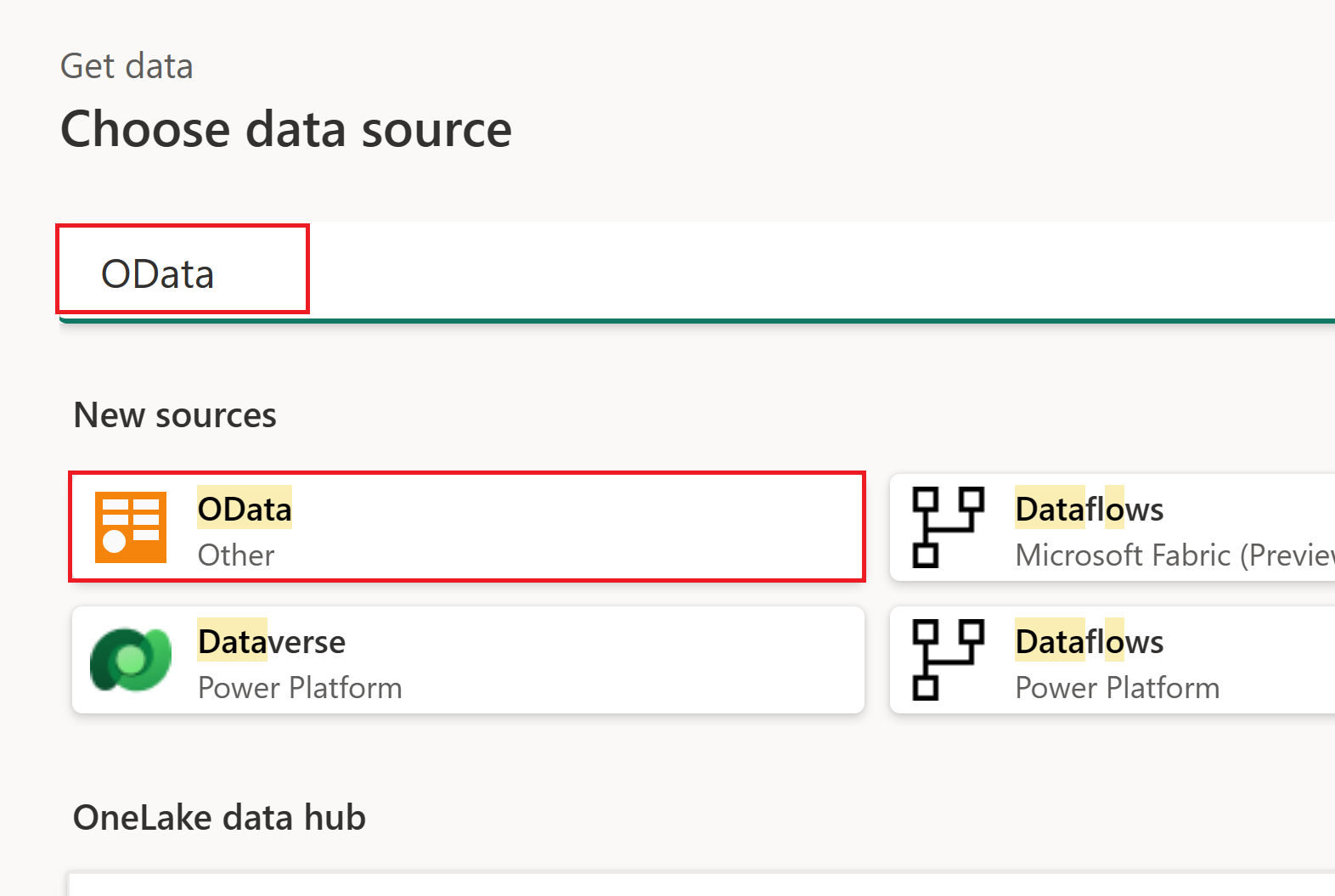

Pilih Dapatkan data, lalu pilih Lainnya.

Dari Pilih sumber data, cari OData, lalu pilih konektor OData.

Masukkan URL sumber OData. Untuk tutorial ini, gunakan layanan sampel OData.

Pilih Selanjutnya.

Pilih Entitas yang ingin Anda serap. Dalam tutorial ini, gunakan entitas Pesanan .

Pilih Buat.

Sekarang setelah Anda menyerap data dari sumber OData, Anda dapat menyiapkan tujuan lakehouse.

Untuk menyerap data ke tujuan lakehouse:

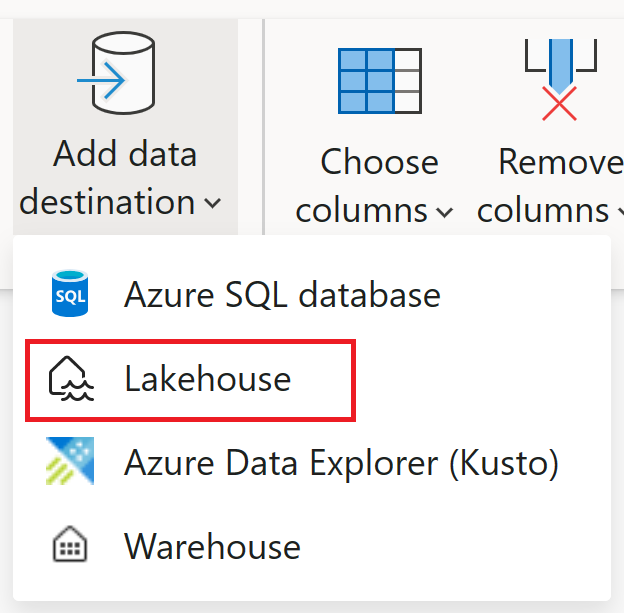

Pilih Tambahkan tujuan data.

Pilih Lakehouse.

Konfigurasikan koneksi yang ingin Anda gunakan untuk menyambungkan ke lakehouse. Pengaturan default baik-baik saja.

Pilih Selanjutnya.

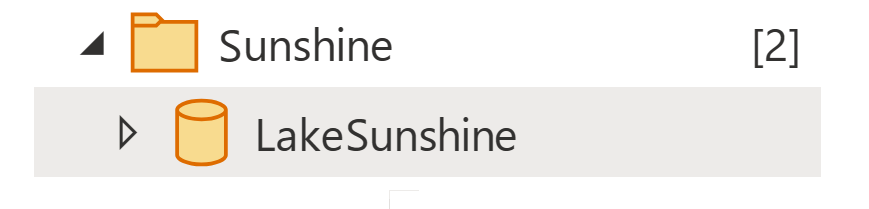

Navigasi ke ruang kerja tempat Anda membuat lakehouse.

Pilih lakehouse yang Anda buat di langkah-langkah sebelumnya.

Konfirmasikan nama tabel.

Pilih Selanjutnya.

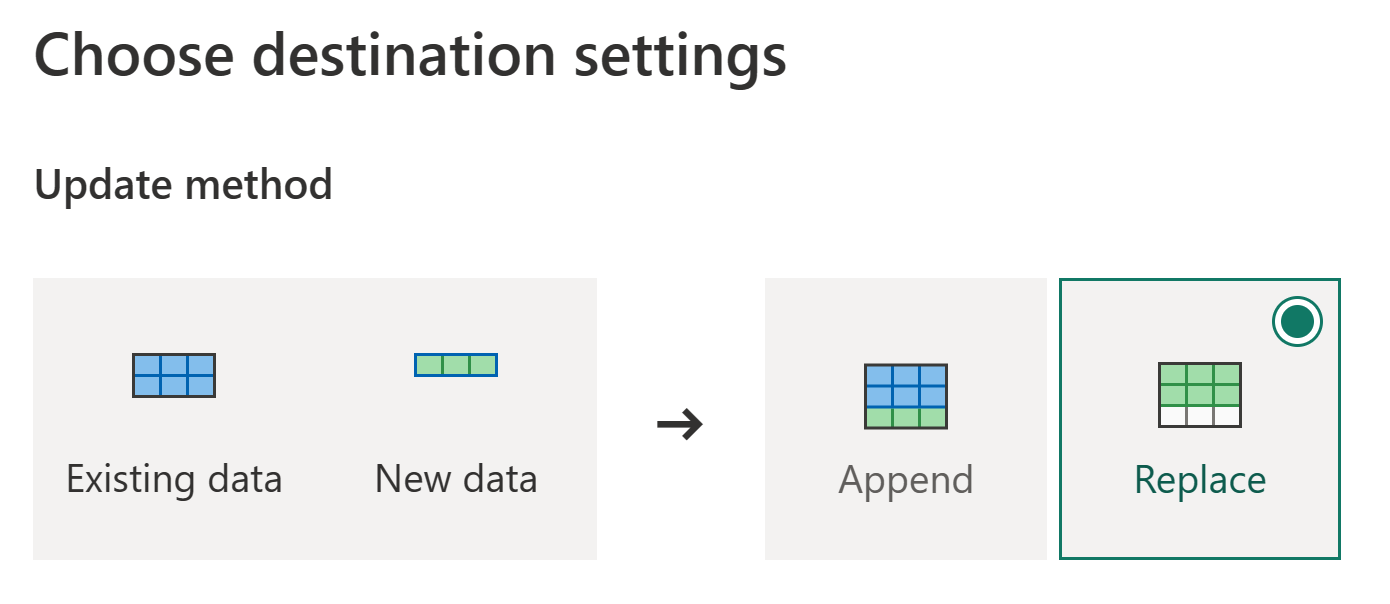

Konfirmasi metode pembaruan dan pilih Simpan pengaturan.

Terbitkan aliran data.

Penting

Ketika Dataflow Gen2 pertama dibuat di ruang kerja, item Lakehouse dan Warehouse disediakan bersama dengan titik akhir analitik SQL terkait dan model semantik. Item ini dibagikan oleh semua aliran data di ruang kerja dan diperlukan agar Dataflow Gen2 beroperasi, tidak boleh dihapus, dan tidak dimaksudkan untuk digunakan langsung oleh pengguna. Item adalah detail implementasi Dataflow Gen2. Item tidak terlihat di ruang kerja, tetapi mungkin dapat diakses dalam pengalaman lain seperti pengalaman Notebook, SQL-endpoint, Lakehouse, dan Warehouse. Anda dapat mengenali item dengan awalannya dalam nama. Awalan item adalah 'DataflowsStaging'.

Sekarang setelah Anda menyerap data ke tujuan lakehouse, Anda dapat menyiapkan alur Anda.

Membuat alur

Pipeline adalah alur kerja yang dapat digunakan untuk mengotomatiskan pemrosesan data. Dalam tutorial ini, Anda membuat alur yang menjalankan Dataflow Gen2 yang Anda buat di prosedur sebelumnya.

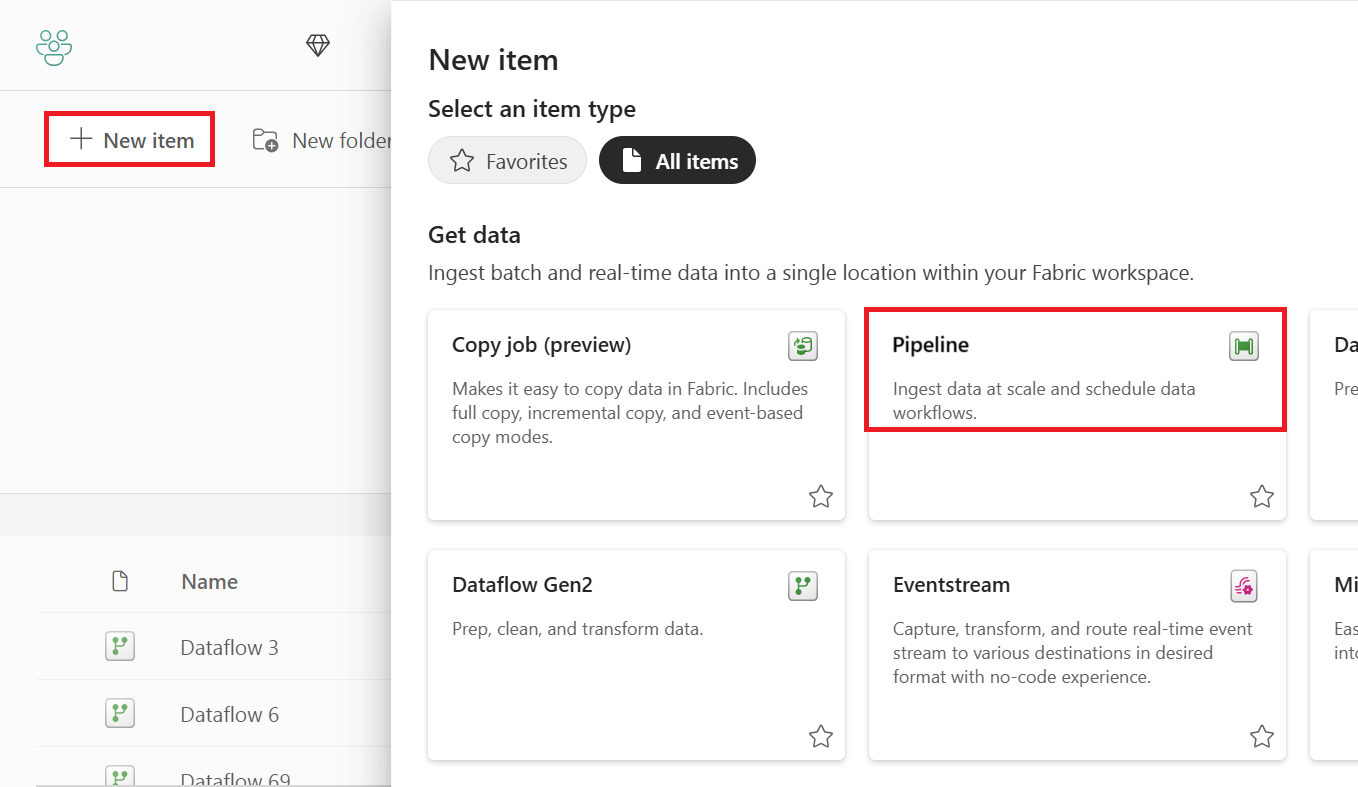

Navigasi kembali ke halaman gambaran umum ruang kerja dan pilih Alur di menu buat.

Berikan Nama untuk alur.

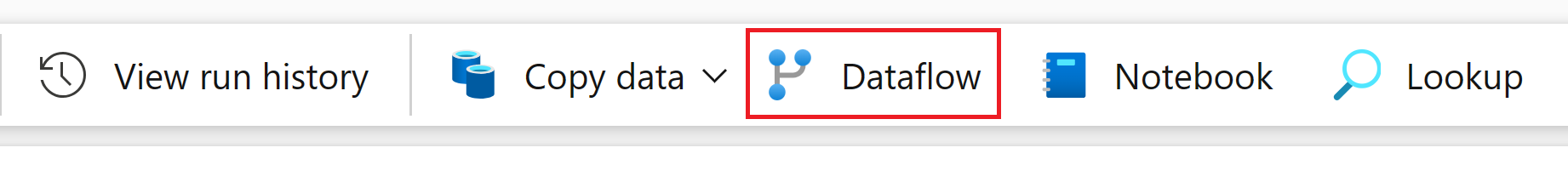

Pilih aktivitas Aliran Data.

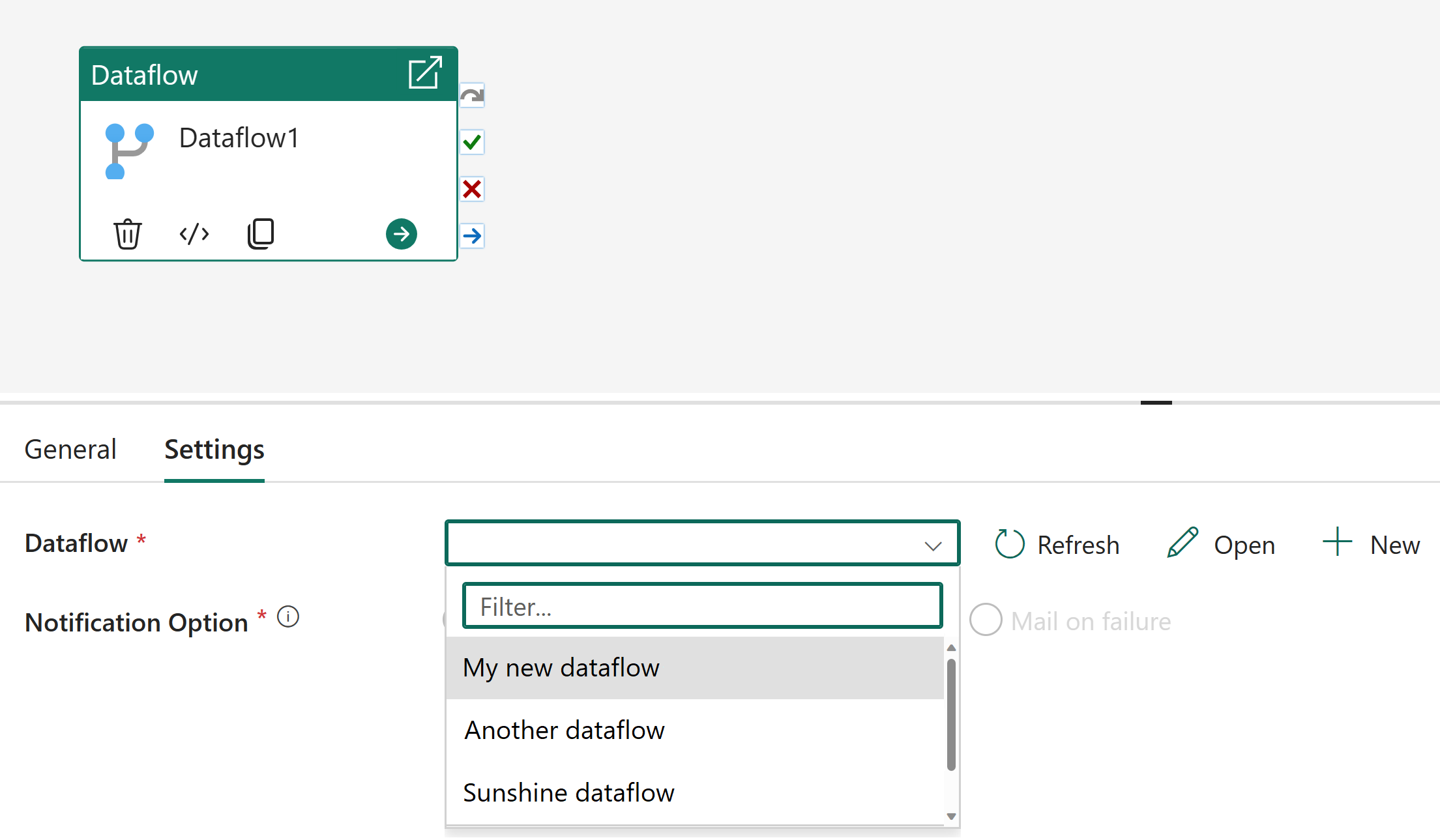

Pilih Aliran Data yang Anda buat di prosedur sebelumnya di daftar dropdown Aliran Data di bawah Pengaturan.

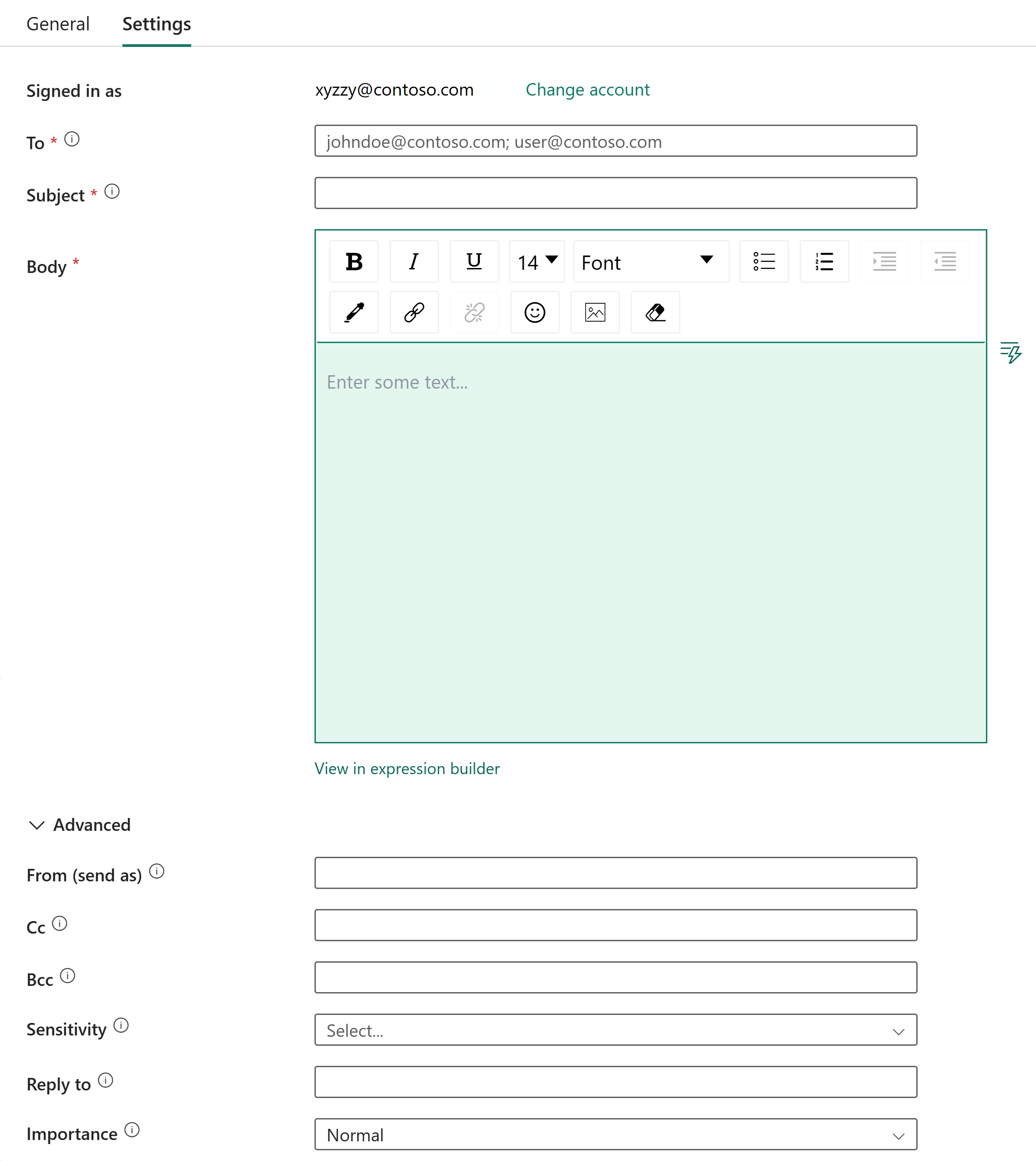

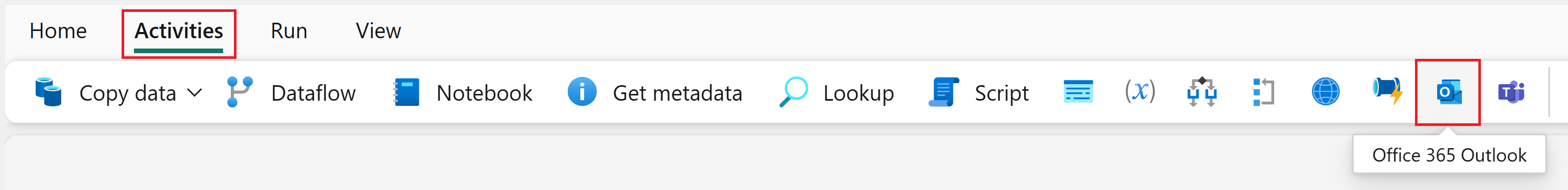

Tambahkan aktivitas Office 365 Outlook.

Konfigurasikan aktivitas Office 365 Outlook untuk mengirim pemberitahuan email.

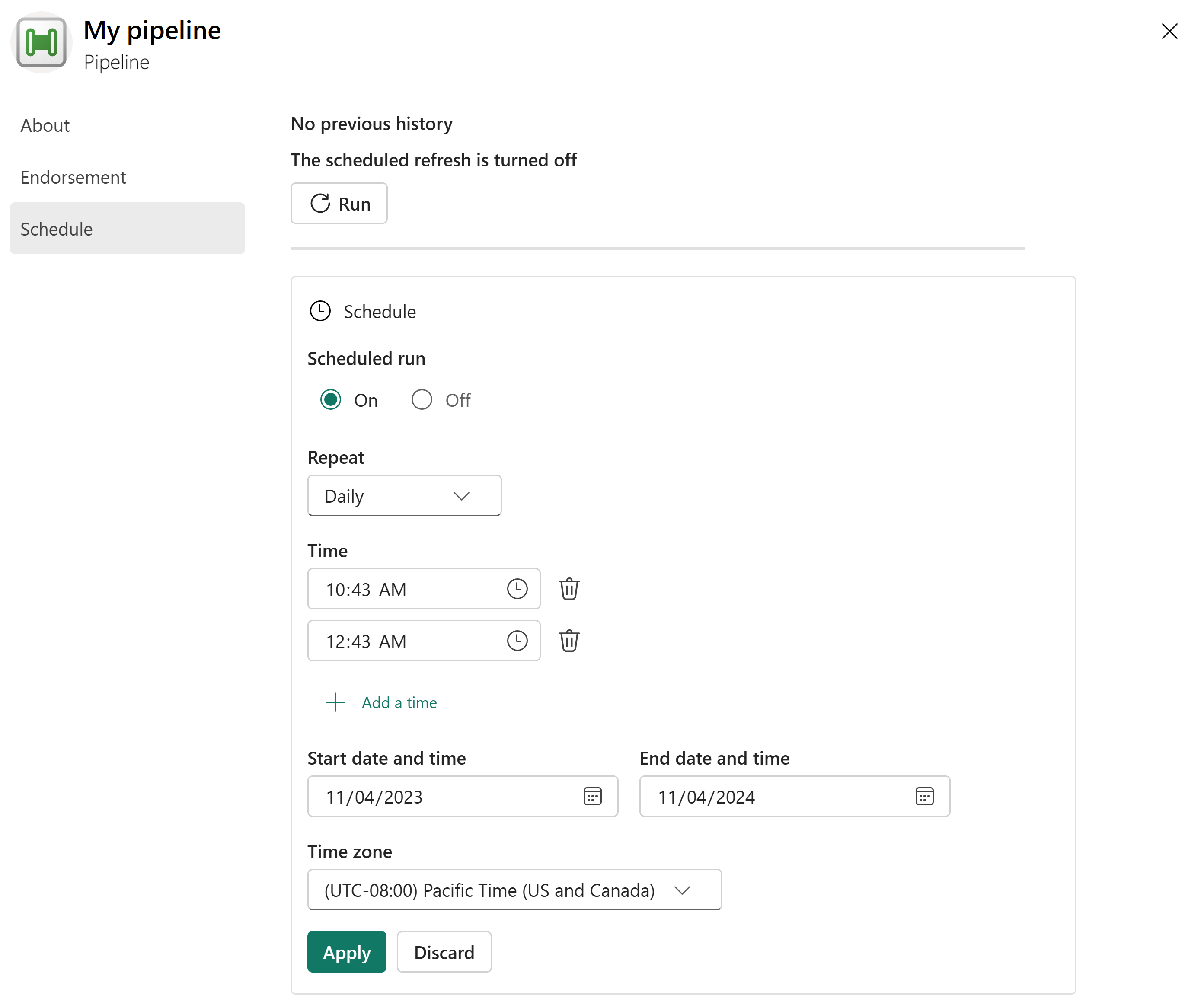

Menjalankan dan menjadwalkan alur

Di bagian ini, Anda menjalankan dan menjadwalkan alur. Jadwal ini memungkinkan Anda menjalankan alur sesuai jadwal.

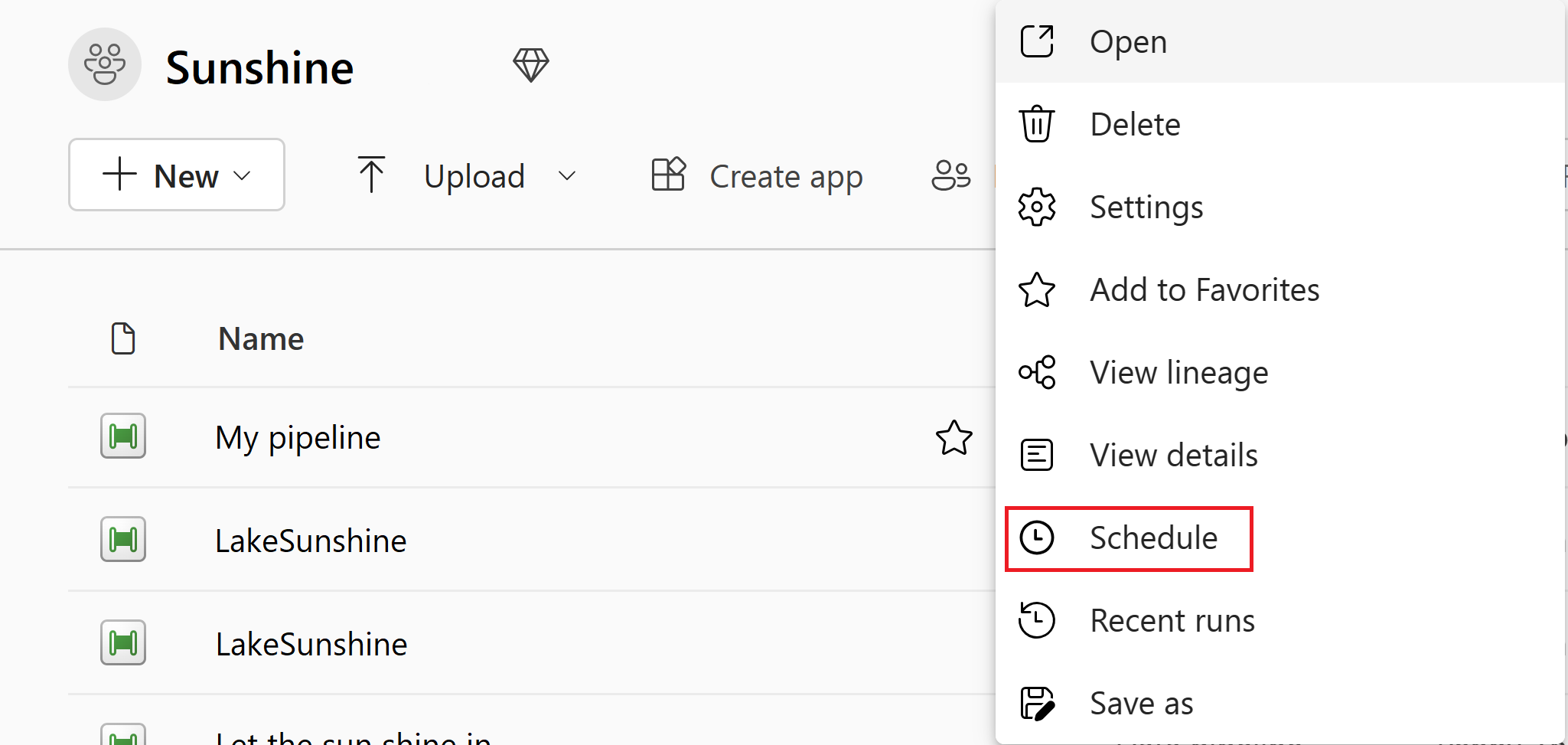

Buka ruang kerja Anda.

Buka menu dropdown alur yang Anda buat di prosedur sebelumnya, lalu pilih Jadwalkan.

Di Eksekusi terjadwal, pilih Aktif.

Silakan berikan jadwal yang ingin Anda gunakan untuk menjalankan pipeline.

- Ulangi, misalnya, setiap Hari atau setiap Menit.

- Saat dipilih Setiap Hari, Anda juga dapat memilih Waktu.

- Mulai Pada Tanggal tertentu.

- Akhiri Pada Tanggal tertentu.

- Pilih Zona Waktu.

Lalu pilih Terapkan untuk menerapkan perubahan.

Anda sekarang telah membuat pipeline yang berjalan sesuai jadwal, memperbarui data di lakehouse, dan mengirimi Anda pemberitahuan email. Anda dapat memeriksa status alur dengan masuk ke Hub Monitor. Anda juga dapat memeriksa status alur dengan masuk ke Alur dan memilih tab Jalankan riwayat di menu dropdown.

Konten terkait

Sampel ini menunjukkan kepada Anda cara menggunakan aliran data dalam alur dengan Data Factory di Microsoft Fabric. Anda mempelajari cara untuk:

- Membuat aliran data.

- Buat alur yang memanggil aliran data Anda.

- Jalankan dan jadwalkan pipeline Anda.

Selanjutnya, lanjutkan untuk mempelajari selengkapnya tentang memantau eksekusi alur Anda.