Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

Artikel ini menjelaskan cara menggunakan kemampuan yang khusus untuk melindungi aplikasi AI dan data yang berinteraksi dengannya.

- Lindungi data sensitif Anda dalam permintaan pengguna dan data yang dihasilkan AI

- Pertahanan terhadap ancaman yang muncul seperti injeksi perintah

Ini adalah artikel ketiga dalam sebuah seri. Jika Anda belum menyelesaikan tugas di Menyiapkan keamanan AI dan Menemukan aplikasi dan data AI, mulailah dengan artikel ini untuk menyiapkan lingkungan Anda dengan kemampuan yang ditentukan dalam artikel ini.

Gunakan artikel ini bersama dengan sumber daya ini:

- Cloud Adoption Framework (CAF) untuk AI — Proses untuk mengamankan AI

Microsoft menyediakan serangkaian kemampuan yang luas untuk melindungi aplikasi dan data AI. Artikel ini membahas ini dalam dua kategori—perlindungan data dan perlindungan ancaman.

Dua tabel berikut menjelaskan ilustrasi dan juga menelusuri langkah-langkah penerapan kemampuan ini.

Tabel 1—Kemampuan perlindungan data

| Langkah | Tugas | Ruang Lingkup |

|---|---|---|

| 1 | Terapkan kontrol pengaturan pembagian berlebihan pada SharePoint untuk dengan cepat mengecualikan situs dan data sensitif dari jangkauan aplikasi AI. | Situs dan file di seluruh lingkungan Microsoft 365 Anda. |

| 2 | Gunakan Manajemen Postur Keamanan Data (DSPM) untuk AI untuk mempelajari tempat terjadinya pembagian berlebih dan untuk menemukan celah dalam cakupan kebijakan Anda untuk label sensitivitas dan kebijakan DLP. | Kopilot, agen, dan aplikasi AI lainnya yang menggunakan model bahasa besar (LLM) pihak ketiga, termasuk situs AI kompatibel. Aplikasi AI di penyedia cloud lain melalui Purview SDK. |

| 3 | Terus membuat kemajuan pada label sensitivitas dan kebijakan pencegahan kehilangan data (DLP). | Situs, file, dan perangkat di seluruh lingkungan Microsoft 365 Anda. Aplikasi SaaS saat terintegrasi dengan Defender untuk Aplikasi Cloud. Aplikasi AI di Azure dan penyedia cloud lainnya melalui Purview SDK. |

| 4 | Dalam Insider Risk Management (IRM), terapkan templat Risky AI untuk mengidentifikasi perilaku berisiko di aplikasi AI. | Situs web AI generatif. Microsoft 365 Copilot, Microsoft Copilot, Copilot Studio, Foundry Tools. Aplikasi AI di penyedia cloud lain melalui Purview SDK. |

| 5 | Mengonfigurasi Perlindungan Adaptif untuk Insider Risk Management untuk meningkatkan perlindungan data berdasarkan risiko pengguna | Situs, file, dan perangkat di seluruh lingkungan Microsoft 365 Anda. |

Tabel 2—Kemampuan perlindungan ancaman

| Langkah | Tugas | Ruang Lingkup |

|---|---|---|

| 1 | Gunakan Aplikasi Defender for Cloud untuk memberi tahu Anda saat aplikasi AI baru digunakan, untuk menghitung skor risiko untuk aplikasi AI, dan untuk mengizinkan atau memblokir aplikasi ini di lingkungan Anda. Defender for Cloud Apps memberikan perlindungan tambahan untuk Microsoft 365 Copilot. | Aplikasi SaaS AI |

| 2 | Defender untuk Cloud Temukan beban kerja AI yang disebarkan di lingkungan Anda dan dapatkan wawasan keamanan dengan Microsoft Defender for Cloud |

Aplikasi AI yang dibangun secara khusus berbasis Azure AI |

Melindungi data AI

Kemampuan ini membantu Anda mempelajari dan mengurangi risiko teratas yang terkait dengan pembagian data, penggunaan data sensitif, dan perilaku pengguna yang berisiko secara efisien. Kemampuan ini berfokus pada perlindungan untuk aplikasi dan data AI di lingkungan Anda.

Langkah 1—Menerapkan kontrol berbagi berlebihan SharePoint

Kontrol oversharing SharePoint menyertakan kontrol yang disertakan dalam SharePoint, seperti izin terlingkup, dan kemampuan add-on di SharePoint Advanced Management untuk meningkatkan tata kelola konten untuk perjalanan penyebaran Microsoft Copilot. Kontrol pembagian berlebih di SharePoint membantu Anda:

- Batasi sementara pencarian Copilot ke daftar situs yang Anda tentukan (Pencarian SharePoint Terbatas).

- Identifikasi situs yang berpotensi berisi data yang dibagikan secara berlebihan atau konten sensitif (laporan tata kelola akses data).

- Benderai situs sehingga pengguna tidak dapat menemukannya melalui Pencarian di seluruh Salinan atau Organisasi (Penemuan Konten Terbatas di Manajemen Tingkat Lanjut SharePoint).

- buat kebijakan situs tidak aktif untuk mengelola dan mengurangi situs tidak aktif secara otomatis (Manajemen Tingkat Lanjut SharePoint).

- Membatasi akses ke situs SharePoint dan OneDrive kepada pengguna dalam grup tertentu (kebijakan kontrol akses terbatas di Manajemen Tingkat Lanjut SharePoint).

Untuk mulai menggunakan kontrol oversharing, gunakan sumber daya berikut.

| Tugas | Sumber daya yang disarankan |

|---|---|

| Tinjau ilustrasi dan deskripsi kontrol oversharing yang dapat Anda gunakan dengan Microsoft 365 Copilot | Arsitektur perlindungan data dan audit Microsoft 365 Copilot |

| Cetak biru yang dapat diunduh untuk mencegah berbagi informasi pribadi berlebihan | Cetak biru Microsoft 365 Copilot untuk berbagi berlebihan |

| Pelajari tentang Manajemen Tingkat Lanjut SharePoint | Microsoft SharePoint Premium - Gambaran umum Manajemen Tingkat Lanjut SharePoint |

Langkah 2--Lindungi data melalui DSPM untuk AI

Gunakan DSPM sebagai alat bagi AI untuk mempelajari lokasi berbagi informasi berlebihan dan untuk menemukan kekurangan dalam cakupan kebijakan Anda terkait label sensitivitas dan kebijakan DLP.

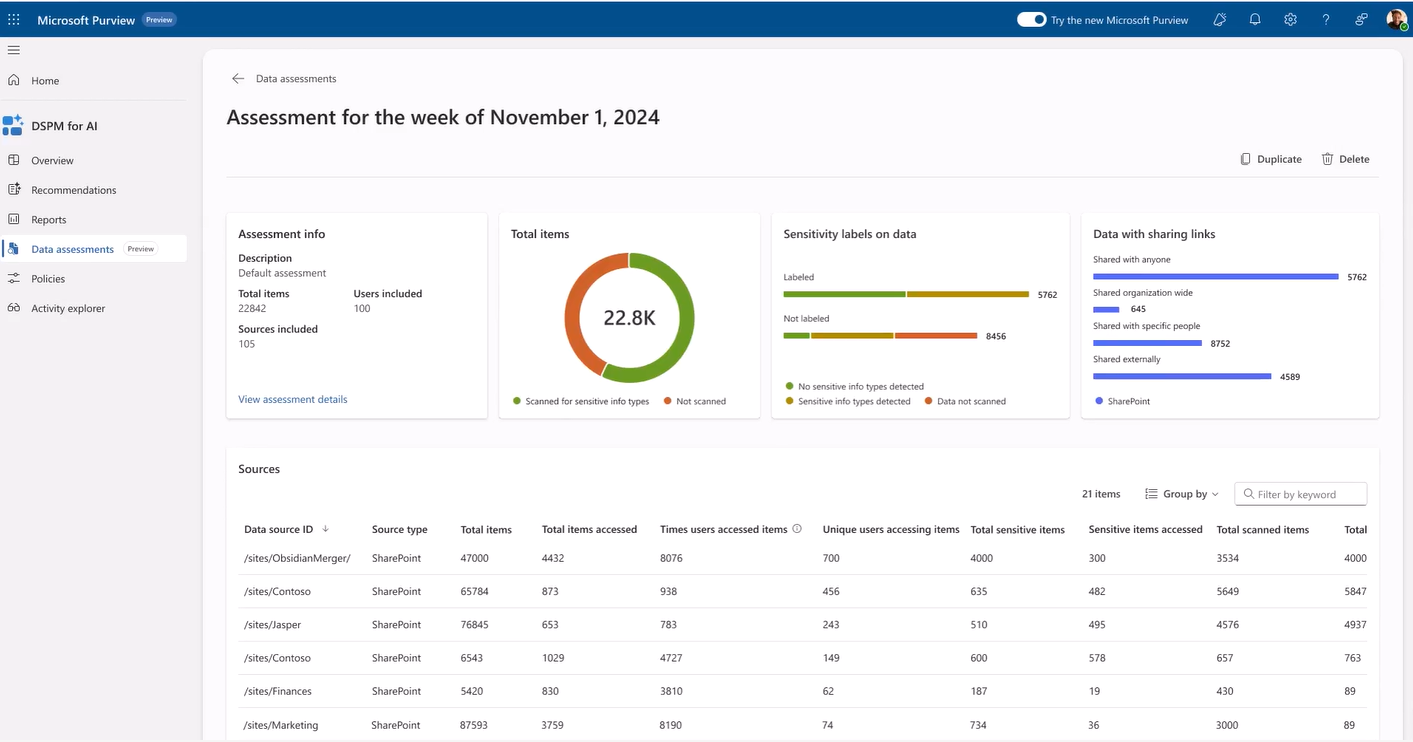

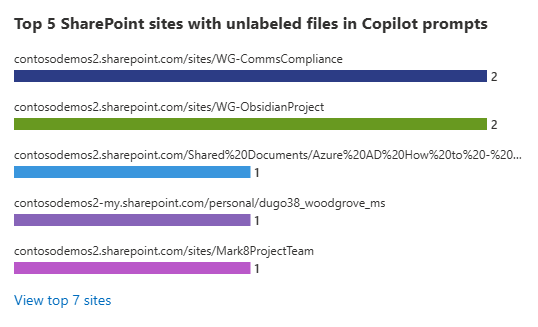

Tempat yang bagus untuk memulai adalah laporan Penilaian Minggu Ini.

Anda dapat menyelidiki laporan individual untuk mempelajari lebih lanjut tentang lokasi celah dalam kontrol pembagian berlebih, label, dan kebijakan DLP sehingga Anda dapat dengan cepat mengatasi masalah ini.

Untuk setiap laporan, DSPM untuk AI memberikan rekomendasi untuk meningkatkan keamanan data Anda. Gunakan tautan Tampilkan semua rekomendasi , atau Rekomendasi dari panel navigasi untuk melihat semua rekomendasi yang tersedia untuk penyewa Anda, dan statusnya.

Gunakan sumber daya berikut untuk melindungi aplikasi dan data AI dengan DSPM untuk AI.

| Tugas | Sumber daya yang disarankan |

|---|---|

| Pelajari tentang DSPM untuk AI | Cara menggunakan DSPM untuk AI |

| Pelajari tentang prasyarat dan cara kerja kebijakan satu klik dan kebijakan default | Pertimbangan untuk DSPM untuk AI |

| Untuk aplikasi AI di penyedia cloud lainnya, pelajari cara menguji integrasi dengan DSPM untuk AI dengan menggunakan Purview SDK | Cara menguji aplikasi AI yang terintegrasi dengan Purview SDK |

Langkah 3—Terus identifikasi celah dalam label sensitivitas dan kebijakan DLP

Dalam Mempersiapkan keamanan AI, Anda menggunakan alat manajemen postur keamanan data Microsoft Purview, DSPM dan DSPM untuk AI, untuk memprioritaskan perlindungan untuk data sensitif Anda. Lanjutkan mengunjungi kembali alat-alat ini untuk mengidentifikasi kesenjangan dalam cakupan kebijakan Anda dan untuk menemukan di mana Anda perlu terus berinvestasi dalam menerapkan label sensitivitas dan kebijakan DLP. Selain itu, perluas label sensitivitas dan kebijakan DLP ke aplikasi SaaS dengan menggunakan Defender untuk Aplikasi Cloud.

Gunakan sumber daya berikut untuk membuat kemajuan dengan Microsoft Purview.

| Tugas | Sumber daya yang disarankan |

|---|---|

| Pelajari tentang strategi penyebaran yang direkomendasikan untuk perlindungan informasi | Menyebarkan solusi perlindungan informasi dengan Microsoft Purview |

| Memperluas label sensitivitas dan kebijakan DLP ke aplikasi SaaS dengan menggunakan Aplikasi Defender for Cloud | Perlindungan informasi balasan untuk aplikasi SaaS |

| Tentukan label dan kebijakan sensitivitas Anda yang akan melindungi data organisasi Anda |

Mulai menggunakan label sensitivitas Membuat dan mengonfigurasi label sensitivitas dan kebijakannya Membatasi akses ke konten dengan menggunakan label sensitivitas untuk menerapkan enkripsi |

| Memberi label dan melindungi data untuk aplikasi dan layanan Microsoft 365 |

Mengelola label sensitivitas di aplikasi Office Mengaktifkan label sensitivitas untuk file di SharePoint dan OneDrive |

| Menyesuaikan kebijakan DLP Anda | Membuat dan Menyebarkan kebijakan pencegahan kehilangan data |

| Untuk aplikasi AI yang dikembangkan di Azure atau penyedia cloud lainnya, pelajari cara menerapkan label sensitivitas dan kebijakan DLP dengan menggunakan Purview SDK |

Apa itu Purview SDK Menggunakan API Microsoft Graph Purview Cara menguji aplikasi AI yang terintegrasi dengan Purview SDK |

Langkah 4—Terapkan templat AI Berisiko di Insider Risk Management (IRM)

Microsoft Purview Insider Risk Management (IRM) menyertakan templat kebijakan yang telah ditentukan sebelumnya yang dapat Anda terapkan ke lingkungan Anda, termasuk penggunaan AI Berisiko. Templat IRM adalah kondisi kebijakan yang telah ditentukan sebelumnya yang menentukan jenis indikator risiko dan model penilaian risiko yang digunakan oleh kebijakan.

Kebijakan penggunaan AI Berisiko dapat membantu mendeteksi dan mengaktifkan penilaian risiko untuk permintaan dan respons di seluruh alat AI di organisasi Anda. IRM membantu Anda menyelidiki dan mengambil tindakan pada aktivitas risiko yang terkait dengan AI.

Gunakan sumber daya berikut untuk mulai menggunakan Insider Risk Management dan untuk menerapkan templat kebijakan penggunaan AI Berisiko.

| Tugas | Sumber daya yang disarankan |

|---|---|

| Mulai menggunakan Insider Risk Management dan pelajari tentang skenario teratas yang menguntungkan organisasi Anda | Pelajari tentang manajemen risiko insider |

| Menerapkan templat AI Berisiko | Pelajari tentang templat kebijakan manajemen risiko orang dalam | Microsoft Learn |

| Pelajari tentang skenario utama untuk AI dan lihat contoh laporan | Manajemen Risiko Insider memberdayakan visibilitas penggunaan AI berisiko dan investigasi keamanan |

| Untuk aplikasi AI yang dikembangkan dengan Purview SDK, uji integrasi Insider Risk Management | Cara menguji aplikasi AI yang terintegrasi dengan Purview SDK |

Langkah 5—Mengonfigurasi Perlindungan Adaptif untuk Manajemen Risiko Insider

Perlindungan Adaptif di Microsoft Purview Insider Risk Management secara dinamis menetapkan tingkat risiko kepada pengguna dan kemudian menerapkan kebijakan yang Anda buat untuk pengguna dengan risiko sedang atau ditingkatkan. Kebijakan dapat menerapkan peningkatan tindakan pencegahan kehilangan data, mempertahankan konten yang dihapus, atau menerapkan persyaratan akses bersyariah yang lebih tinggi.

Gunakan sumber daya berikut untuk mulai menggunakan Perlindungan Adaptif.

| Tugas | Sumber daya yang disarankan |

|---|---|

| Mulai menggunakan Insider Risk Management dan pelajari tentang skenario teratas yang menguntungkan organisasi Anda | Pelajari tentang manajemen risiko insider |

| Pelajari tentang skenario utama untuk AI dan lihat contoh laporan | Manajemen Risiko Insider memberdayakan visibilitas penggunaan AI berisiko dan investigasi keamanan |

| Menerapkan templat AI Berisiko | Pelajari tentang templat kebijakan manajemen risiko orang dalam |

| Menyelidiki dan bertindak terhadap aktivitas risiko orang dalam |

Menyelidiki aktivitas manajemen risiko orang dalam Mengambil tindakan pada kasus manajemen risiko orang dalam |

Mendapatkan manfaat maksimal dari perlindungan ancaman untuk AI

Defender for Cloud Apps dan Defender for Cloud menyertakan kemampuan untuk memberi Anda informasi tentang penggunaan aplikasi AI baru dan untuk menerapkan kontrol yang sesuai.

Langkah 1—Gunakan Defender for Cloud Apps untuk melakukan triase dan melindungi penggunaan aplikasi AI

Artikel sebelumnya dalam seri ini, Temukan Aplikasi AI, dan Data, yang berfokus pada penggunaan Defender for Cloud Apps untuk menemukan aplikasi AI di lingkungan Anda. Artikel ini mendorong organisasi untuk menggunakan Defender for Cloud Apps agar tetap berada di atas penggunaan aplikasi AI baru dengan menilai risiko yang ditimbulkan ini ke lingkungan Anda, memberi sanksi atau memblokir aplikasi ini, dan menerapkan kontrol sesi ke aplikasi.

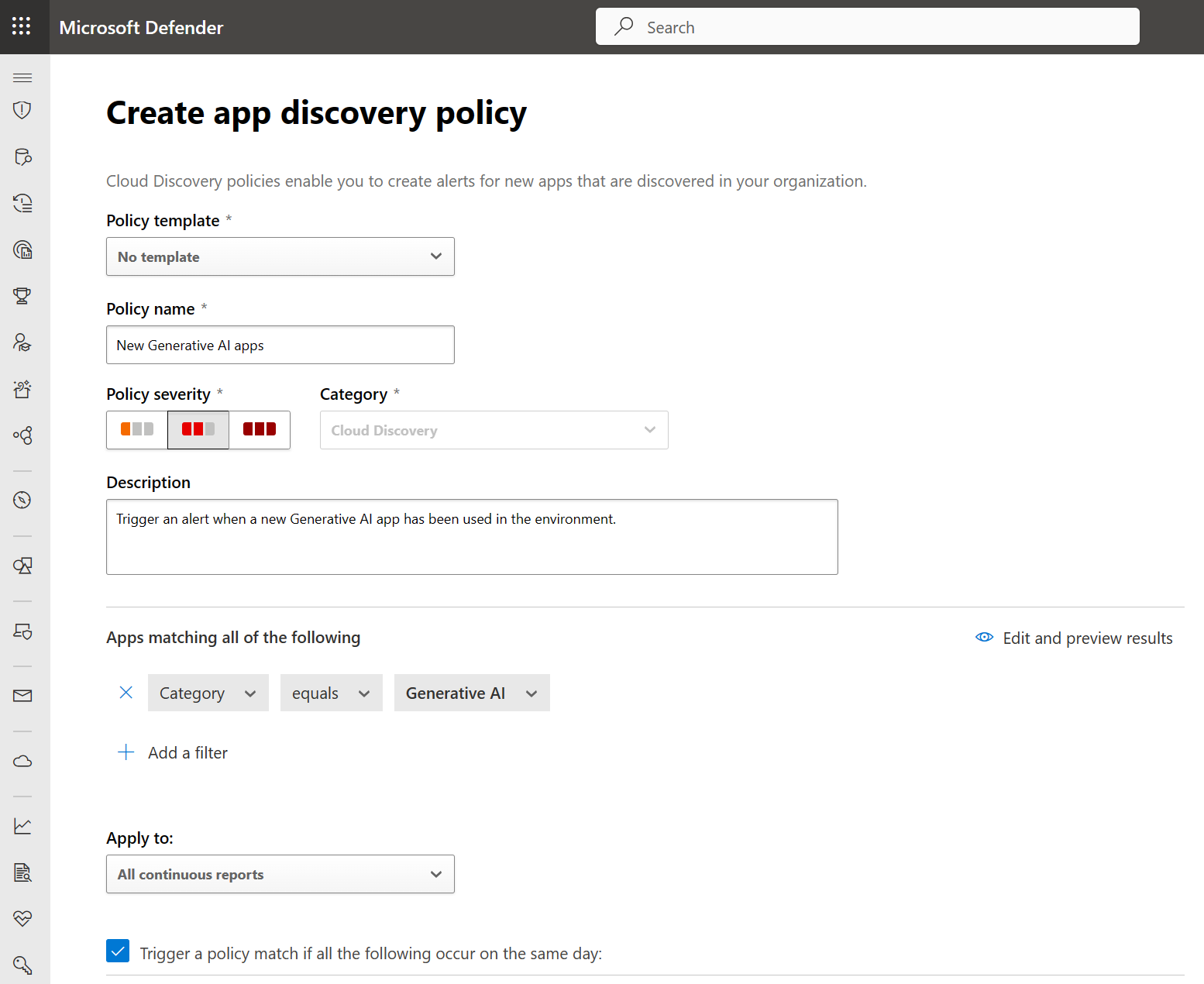

Pertama, buat kebijakan untuk memicu pemberitahuan secara otomatis saat aplikasi AI Generatif baru digunakan di organisasi Anda.

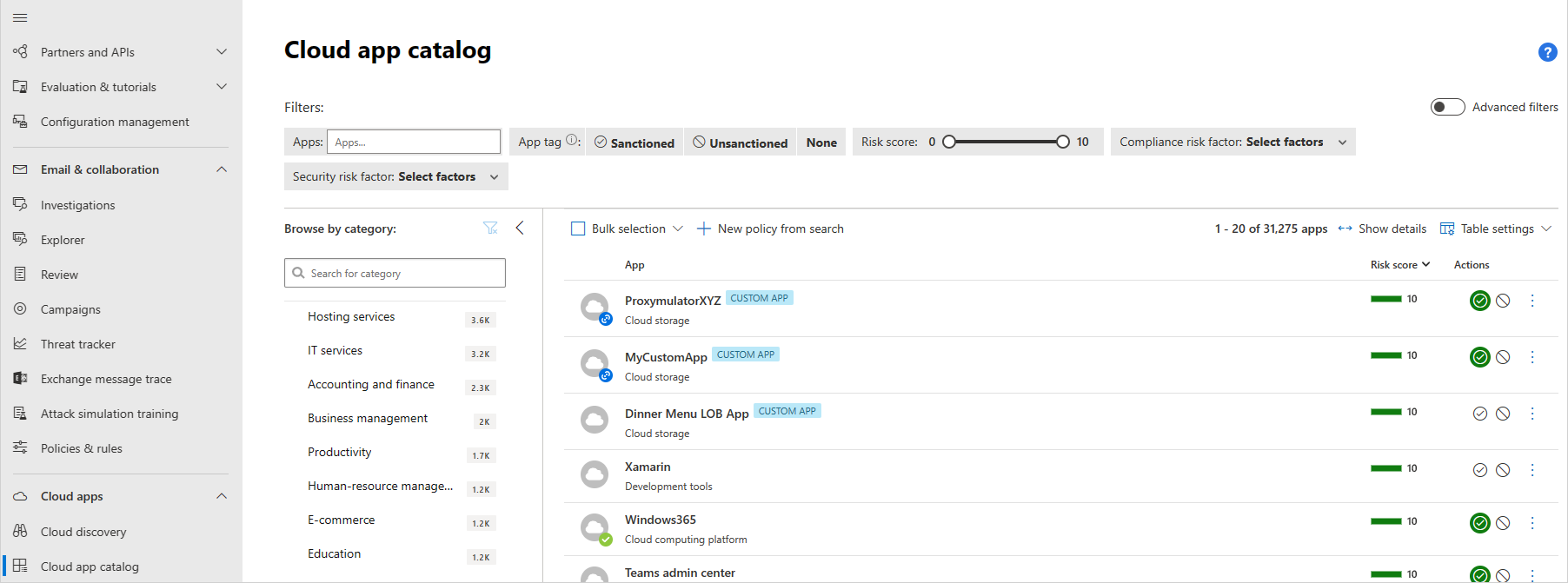

Selanjutnya, evaluasi skor risiko untuk aplikasi yang baru saja ditemukan. Anda juga dapat menyesuaikan skor risiko. Misalnya, organisasi yang sangat diatur mungkin ingin mengubah bobot atribut tertentu dari skor risiko. Anda juga dapat mengubah skor risiko.

Putuskan apakah akan memberi sanksi atau memblokir setiap aplikasi. Organisasi dapat memilih untuk memblokir penggunaan aplikasi karena berbagai alasan. Beberapa khawatir bahwa data sensitif akan secara tidak sadar dibagikan dengan aplikasi dan diekspos nanti ke audiens di luar organisasi. Hal ini dapat menyebabkan organisasi memblokir penggunaan semua aplikasi AI yang tidak dikelola. Meskipun organisasi lain perlu memastikan semua aplikasi yang digunakan sesuai dengan standar yang berbeda, seperti SOC2, atau HIPAA.

Terakhir, untuk aplikasi yang Anda beri sanksi, putuskan apakah Anda ingin menerapkan kebijakan sesi untuk kontrol dan visibilitas yang lebih besar. Kebijakan sesi memungkinkan Anda menerapkan parameter pada cara aplikasi cloud digunakan oleh organisasi Anda. Misalnya, Anda dapat mengonfigurasi kebijakan sesi yang hanya memungkinkan perangkat terkelola untuk mengakses aplikasi AI. Contoh yang lebih sederhana dapat mengonfigurasi kebijakan untuk memantau lalu lintas dari perangkat yang tidak dikelola sehingga Anda dapat menganalisis risiko lalu lintas ini sebelum menerapkan kebijakan yang lebih ketat.

Dalam ilustrasi ini:

- Akses ke aplikasi cloud yang diizinkan dari pengguna dan perangkat di dalam organisasi Anda dirutekan melalui Defender for Cloud Apps, di mana kebijakan sesi dapat diterapkan pada aplikasi tertentu.

- Aplikasi cloud yang belum Anda beri sanksi atau secara eksplisit tidak terpengaruh.

Defender for Cloud Apps juga menyediakan deteksi khusus untuk Microsoft 365 Copilot. Tim keamanan dapat mendeteksi interaksi mencurigakan pengguna dengan Copilot dan merespons serta mengurangi ancaman. Misalnya, ketika pengguna mengakses data sensitif melalui Copilot dari alamat IP berisiko, Defender for Cloud Apps memicu pemberitahuan untuk menandai aktivitas mencurigakan ini dengan detail penting termasuk teknik serangan MITRE, alamat IP, dan bidang lain yang dapat digunakan tim keamanan untuk menyelidiki pemberitahuan ini lebih lanjut.

Gunakan sumber daya berikut sebagai langkah berikutnya.

| Tugas | Sumber daya yang disarankan |

|---|---|

| Tinjau langkah 5-8 dalam alur penyebaran Defender for Cloud Apps ini | Menemukan dan mengelola aplikasi cloud |

| Tinjau tutorial video ini tentang mengelola aplikasi | Menemukan Aplikasi AI Generatif mana yang Digunakan di Lingkungan Anda Menggunakan Aplikasi Defender for Cloud - YouTube |

| Membuat kebijakan penemuan aplikasi | Membuat kebijakan penemuan cloud |

| Menilai skor risiko untuk aplikasi yang baru ditemukan | Katalog aplikasi cloud dan skor risiko |

| Sanksi atau blokir aplikasi baru | Mengatur aplikasi yang ditemukan |

| Menerapkan kebijakan sesi ke aplikasi AI untuk kontrol dan visibilitas yang lebih besar | Membuat kebijakan sesi |

| Pelajari cara menggunakan perlindungan ancaman untuk Microsoft 365 Copilot | Deteksi ancaman baru untuk Microsoft Copilot untuk Microsoft 365 |

Langkah 2—Menerapkan perlindungan AI di Defender for Cloud

Artikel sebelumnya dalam seri ini, Temukan Aplikasi dan data AI, berfokus pada penemuan beban kerja dan model AI generatif yang berjalan di lingkungan Anda. Artikel ini berfokus pada perlindungan aplikasi GenAI di seluruh siklus hidup aplikasi, saat Anda membangun dan menggunakan aplikasi AI kustom Anda.

Organisasi memilih untuk mengembangkan aplikasi GenAI baru dan menyematkan AI ke dalam aplikasi yang ada untuk meningkatkan efisiensi dan produktivitas bisnis. Penyerang semakin ingin mengeksploitasi aplikasi untuk mengubah tujuan yang dirancang dari model AI dengan serangan baru seperti injeksi prompt, serangan dompet, pencurian model, dan keracunan data, sambil meningkatkan kerentanan terhadap risiko yang diketahui seperti pelanggaran data dan penolakan layanan. Tim keamanan perlu disiapkan dan memastikan mereka memiliki kontrol keamanan yang tepat untuk aplikasi dan deteksi AI mereka yang mengatasi lanskap ancaman baru.

Pertahanan Microsoft untuk Cloud membantu organisasi mengamankan lingkungan hibrid dan multicloud mereka dari kode ke cloud. Defender untuk cloud mencakup kemampuan postur keamanan dan perlindungan ancaman untuk memungkinkan organisasi melindungi aplikasi GenAI buatan perusahaan mereka di seluruh siklus hidup aplikasi:

- Secara berkelanjutan menemukan komponen aplikasi GenAI dan artefak AI mulai dari kode hingga cloud.

- Jelajahi dan remediasi risiko terhadap aplikasi GenAI dengan rekomendasi bawaan untuk memperkuat postur keamanan.

- Mengidentifikasi dan memulihkan kombinasi beracun dalam aplikasi GenAI menggunakan analisis jalur serangan.

- Lakukan deteksi pada aplikasi GenAI yang menggunakan perisai prompt Azure AI Content Safety, sinyal intelijen ancaman dari Microsoft, dan pemantauan kegiatan kontekstual.

- Berburu dan menyelidiki serangan di aplikasi GenAI dengan integrasi bawaan dengan Pertahanan Microsoft.

Mulailah dengan kemampuan manajemen postur keamanan AI di Defender Cloud Security Posture Management (CSPM). Defender CSPM secara otomatis dan berkelanjutan menemukan beban kerja AI yang disebarkan dengan visibilitas tanpa agen dan terperinci ke kehadiran dan konfigurasi model AI, SDK, dan teknologi yang digunakan di seluruh layanan AI seperti Azure OpenAI Service, Azure Machine Learning, dan Amazon Bedrock.

CSPM terus memunculkan masalah keamanan kontekstual dan menyarankan rekomendasi keamanan berbasis risiko yang disesuaikan untuk memprioritaskan kesenjangan penting di seluruh beban kerja AI Anda. Rekomendasi keamanan yang relevan juga muncul dalam sumber daya Azure OpenAI itu sendiri di portal Microsoft Azure, memberikan pengembang atau pemilik beban kerja akses langsung ke rekomendasi dan membantu memulihkan lebih cepat.

Kemampuan analisis jalur serangan dapat mengidentifikasi risiko canggih terhadap beban kerja AI termasuk skenario keamanan data di mana data grounding atau penyempurnaan diekspos ke internet melalui gerakan lateral dan rentan terhadap keracunan data.

Selanjutnya, Tetap aman dalam waktu operasional dengan perlindungan terhadap ancaman untuk beban kerja AI. Defender for Cloud menyertakan perlindungan ancaman untuk beban kerja AI. Perlindungan ancaman untuk AI menggunakan integrasi asli Azure OpenAI Service, perisai permintaan Azure AI Content Safety, dan inteligensi ancaman Microsoft untuk memberikan pemberitahuan keamanan kontekstual dan dapat ditindak lanjuti. Perlindungan ancaman untuk pekerjaan AI memungkinkan tim keamanan memantau aplikasi yang didukung Azure OpenAI mereka selama waktu proses untuk aktivitas berbahaya yang terkait dengan serangan injeksi langsung dan tidak langsung, kebocoran data sensitif dan keracunan data, serta penyalahgunaan dompet atau serangan penolakan layanan.

Gunakan sumber daya berikut untuk langkah berikutnya.

| Tugas | Sumber daya yang disarankan |

|---|---|

| Tinjau skenario teratas yang dijelaskan dalam blog ini | Mengamankan Aplikasi AI Generatif dengan Pertahanan Microsoft untuk Cloud |

| Gunakan CSPM untuk mendapatkan visibilitas terhadap risiko AI di lingkungan Anda |

Lindungi sumber daya Anda dengan Defender CSPM Tinjau dasbor keamanan Data dan AI (Pratinjau) |

| Mengaktifkan perlindungan ancaman untuk beban kerja AI (pratinjau) | Mengaktifkan perlindungan ancaman untuk beban kerja AI (pratinjau) Pemberitahuan untuk beban kerja AI (Pratinjau) |

Langkah selanjutnya untuk mengamankan AI

Setelah melindungi aplikasi dan data AI di organisasi Anda, langkah selanjutnya adalah mengatur aplikasi AI untuk memenuhi persyaratan kepatuhan peraturan:

- Menilai dan memperkuat kesiapan kepatuhan Anda terhadap peraturan.

- Terapkan kontrol untuk mengatur penggunaan aplikasi dan data AI.

Lihat artikel berikutnya dalam seri ini: Bagaimana cara mengatur AI untuk kepatuhan?