Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Importante

L'inserimento dei dati tramite il plug-in di output Logstash con le regole di raccolta dati è attualmente disponibile in anteprima pubblica. Questa funzionalità viene fornita senza un contratto di servizio. Per altre informazioni, vedere Condizioni supplementari per l'utilizzo per microsoft Azure anteprime.

il plug-in di output Logstash di Microsoft Sentinel supporta le trasformazioni della pipeline e la configurazione avanzata tramite le regole di raccolta dati . Il plug-in inoltra i log da origini dati esterne in tabelle personalizzate o standard in Log Analytics o Microsoft Sentinel.

Questo articolo illustra come configurare il plug-in Logstash per trasmettere i dati in Log Analytics o Microsoft Sentinel usando dcr, con controllo completo sullo schema di output.

Con il plug-in è possibile:

- Controllare la configurazione dei nomi e dei tipi di colonna.

- Eseguire trasformazioni in fase di inserimento, ad esempio filtro o arricchimento.

- Inserire log personalizzati in una tabella personalizzata o inserire un flusso di input Syslog nella tabella Syslog di Log Analytics.

L'inserimento nelle tabelle standard è limitato solo alle tabelle standard supportate per l'inserimento di log personalizzati.

Per altre informazioni sull'uso del motore di raccolta dati Logstash, vedere Introduzione a Logstash.

Panoramica dell'architettura

Il motore Logstash è composto da tre componenti:

- Plug-in di input: raccolta personalizzata di dati da varie origini.

- Plug-in filtro: manipolazione e normalizzazione dei dati in base ai criteri specificati.

- Plug-in di output: invio personalizzato di dati raccolti ed elaborati a varie destinazioni.

Nota

- Microsoft supporta solo il plug-in di output Logstash fornito Microsoft Sentinel descritto qui. Il plug-in corrente è microsoft-sentinel-log-analytics-logstash-output-plugin, v2.1.0. È possibile aprire un ticket di supporto per eventuali problemi relativi al plug-in di output.

- Microsoft non supporta plug-in di output Logstash di terze parti per Microsoft Sentinel o qualsiasi altro plug-in Logstash o componente di qualsiasi tipo.

- Vedere i prerequisiti per il supporto della versione logstash del plug-in.

Il plug-in invia dati in formato JSON all'area di lavoro Log Analytics usando l'API di inserimento log. I dati vengono inseriti in log personalizzati o in una tabella standard.

- Altre informazioni sull'API di inserimento log.

Distribuire il plug-in di output Microsoft Sentinel in Logstash

Per configurare il plug-in, seguire questa procedura:

- Esaminare i prerequisiti

- Installare il plug-in

- Creare un file di esempio

- Creare le risorse correlate a DCR necessarie

- Configurare il file di configurazione Logstash

- Riavviare Logstash

- Visualizzare i log in ingresso in Microsoft Sentinel

- Monitorare i log di controllo del plug-in di output

Prerequisiti del plug-in Logstash

Installare una versione supportata di Logstash. Il plug-in supporta le versioni logstash seguenti:

- 7.0 - 7.17.13

- 8.0 - 8.9

- 8.11 - 8.15

- 8.19.2

- 9.0.8

- 9.1.10

- 9.2.4 - 9.2.5

Nota

Se si usa Logstash 8, è consigliabile disabilitare ECS nella pipeline.

Verificare di avere un'area di lavoro Log Analytics con almeno i diritti di collaboratore.

Verificare di disporre delle autorizzazioni per creare oggetti DCR nell'area di lavoro.

Installare il plug-in

Il plug-in di output Microsoft Sentinel è disponibile nella raccolta Logstash in RubyGems.

Seguire le istruzioni nel documento Logstash Working with plugins per installare il plug-in microsoft-sentinel-log-analytics-logstash-output-plugin . Per eseguire l'installazione in un'installazione di Logstash esistente, eseguire il comando seguente:

logstash-plugin install microsoft-sentinel-log-analytics-logstash-output-pluginSe il sistema Logstash non ha accesso a Internet, seguire le istruzioni nel documento Gestione plug-in offline di Logstash per preparare e usare un pacchetto di plug-in offline. Ciò richiede la creazione di un altro sistema Logstash con accesso a Internet.

Creare un file di esempio

In questa sezione viene creato un file di esempio in uno di questi scenari:

- Creare un file di esempio per i log personalizzati

- Creare un file di esempio per inserire i log nella tabella Syslog

Creare un file di esempio per i log personalizzati

In questo scenario si configura il plug-in di input Logstash per inviare eventi a Microsoft Sentinel. Questo esempio usa il plug-in di input del generatore per simulare gli eventi. È possibile usare qualsiasi altro plug-in di input.

In questo esempio il file di configurazione Logstash è simile al seguente:

input {

generator {

lines => [

"This is a test log message"

]

count => 10

}

}

Per creare il file di esempio, seguire questa procedura:

Copiare la configurazione del plug-in di output seguente nel file di configurazione Logstash.

output { microsoft-sentinel-log-analytics-logstash-output-plugin { create_sample_file => true sample_file_path => "<enter the path to the file in which the sample data will be written>" #for example: "c:\\temp" (for windows) or "/tmp" for Linux. } }Assicurarsi che il percorso del file a cui si fa riferimento esista già, quindi avviare Logstash.

Il plug-in scrive dieci record in un file di esempio denominato

sampleFile<epoch seconds>.jsonnel percorso configurato quando sono presenti 10 eventi da campionare o quando il processo Logstash viene chiuso normalmente. Ad esempio: c:\temp\sampleFile1648453501.json. Di seguito è riportato un file di esempio creato dal plug-in:[ { "host": "logstashMachine", "sequence": 0, "message": "This is a test log message", "ls_timestamp": "2022-03-28T17:45:01.690Z", "ls_version": "1" }, { "host": "logstashMachine", "sequence": 1 ... ]Il plug-in aggiunge automaticamente queste proprietà a ogni record:

-

ls_timestamp: ora in cui il record viene ricevuto dal plug-in di input -

ls_version: versione della pipeline Logstash.

È possibile rimuovere questi campi quando si crea il DCR.

-

Creare un file di esempio per inserire i log nella tabella Syslog

In questo scenario si configura il plug-in di input Logstash per inviare eventi syslog a Microsoft Sentinel.

Se i messaggi syslog non sono già stati inoltrati nel computer Logstash, è possibile usare il comando logger per generare messaggi. Ad esempio (per Linux):

logger -p local4.warn --rfc3164 --tcp -t CEF "0|Microsoft|Device|cef-test|example|data|1|here is some more data for the example" -P 514 -d -n 127.0.0.1Ecco un esempio per il plug-in di input Logstash:

input { syslog { port => 514 } }Copiare la configurazione del plug-in di output seguente nel file di configurazione Logstash.

output { microsoft-sentinel-log-analytics-logstash-output-plugin { create_sample_file => true sample_file_path => "<enter the path to the file in which the sample data will be written>" #for example: "c:\\temp" (for windows) or "/tmp" for Linux. } }Assicurarsi che il percorso del file esista già, quindi avviare Logstash.

Il plug-in scrive dieci record in un file di esempio denominato

sampleFile<epoch seconds>.jsonnel percorso configurato quando sono presenti 10 eventi da campionare o quando il processo Logstash viene chiuso normalmente. Ad esempio: c:\temp\sampleFile1648453501.json. Di seguito è riportato un file di esempio creato dal plug-in:[ { "logsource": "logstashMachine", "facility": 20, "severity_label": "Warning", "severity": 4, "timestamp": "Apr 7 08:26:04", "program": "CEF:", "host": "127.0.0.1", "facility_label": "local4", "priority": 164, "message": "0|Microsoft|Device|cef-test|example|data|1|here is some more data for the example", "ls_timestamp": "2022-04-07T08:26:04.000Z", "ls_version": "1" } ]Il plug-in aggiunge automaticamente queste proprietà a ogni record:

-

ls_timestamp: ora in cui il record viene ricevuto dal plug-in di input -

ls_version: versione della pipeline Logstash.

È possibile rimuovere questi campi quando si crea il DCR.

-

Creare le risorse DCR necessarie

Per configurare il plug-in Logstash basato su DCR Microsoft Sentinel, creare prima di tutto le risorse correlate a DCR.

In questa sezione vengono create risorse da usare per il DCR, in uno di questi scenari:

- Creare risorse DCR per l'inserimento in una tabella personalizzata

- Creare risorse DCR per l'inserimento in una tabella standard

Creare risorse DCR per l'inserimento in una tabella personalizzata

Per inserire i dati in una tabella personalizzata, seguire questa procedura (in base all'esercitazione Inviare dati a Azure monitorare i log usando l'API REST (portale di Azure):

Esaminare i prerequisiti.

Analizzare e filtrare i dati di esempio usando il file di esempio creato nella sezione precedente.

Assegnare le autorizzazioni al DCR.

Ignorare il passaggio Invia dati di esempio.

Se si verificano problemi, vedere la procedura di risoluzione dei problemi.

Creare risorse DCR per l'inserimento in una tabella standard

Per inserire i dati in una tabella standard, ad esempio Syslog o CommonSecurityLog, si usa un processo basato sull'esercitazione Inviare dati a Monitoraggio di Azureare i log usando l'API REST (modelli di Resource Manager). Mentre l'esercitazione illustra come inserire dati in una tabella personalizzata, è possibile modificare facilmente il processo per inserire i dati in una tabella standard. I passaggi seguenti indicano le modifiche rilevanti nei passaggi.

Esaminare i prerequisiti.

-

Ignorare il passaggio Crea nuova tabella nell'area di lavoro Log Analytics. Questo passaggio non è rilevante quando si inserisce dati in una tabella standard, perché la tabella è già definita in Log Analytics.

Creare il DCR. In questo passaggio:

- Specificare il file di esempio creato nella sezione precedente.

- Utilizzare il file di esempio creato per definire la

streamDeclarationsproprietà . Ognuno dei campi nel file di esempio deve avere una colonna corrispondente con lo stesso nome e il tipo appropriato (vedere l'esempio seguente). - Configurare il valore della

outputStreamproprietà con il nome della tabella standard anziché la tabella personalizzata. A differenza delle tabelle personalizzate, i nomi di tabella standard non hanno il_CLsuffisso . - Il prefisso del nome della tabella deve essere

Microsoft-anzichéCustom-. In questo esempio il valore dellaoutputStreamproprietà èMicrosoft-Syslog.

Assegnare le autorizzazioni a un DCR.

Ignorare il passaggio Invia dati di esempio.

Se si verificano problemi, vedere la procedura di risoluzione dei problemi.

Esempio: DCR che inserisce i dati nella tabella Syslog

Tenere presenti questi punti:

- I

streamDeclarationsnomi e i tipi di colonna devono corrispondere ai campi di file di esempio, ma non è necessario specificarli tutti. Nel DCR seguente, ad esempio, iPRIcampi etypels_versionvengono omessi dallastreamDeclarationscolonna . - La

dataflowsproprietà trasforma l'input nel formato di tabella Syslog e imposta suoutputStreamMicrosoft-Syslog.

{

"$schema": "https://schema.management.azure.com/schemas/2019-04-01/deploymentTemplate.json#",

"contentVersion": "1.0.0.0",

"parameters": {

"dataCollectionRuleName": {

"type": "String",

"metadata": {

"description": "Specifies the name of the Data Collection Rule to create."

}

},

"location": {

"defaultValue": "[resourceGroup().location]",

"type": "String",

"metadata": {

"description": "Specifies the location in which to create the Data Collection Rule."

}

},

"workspaceResourceId": {

"type": "String",

"metadata": {

"description": "Specifies the Azure resource ID of the Log Analytics workspace to use."

}

}

},

"resources": [

{

"type": "Microsoft.Insights/dataCollectionRules",

"apiVersion": "2021-09-01-preview",

"name": "[parameters('dataCollectionRuleName')]",

"location": "[parameters('location')]",

"properties": {

"streamDeclarations": {

"Custom-SyslogStream": {

"columns": [

{ "name": "ls_timestamp", "type": "datetime" },

{ "name": "timestamp", "type": "datetime" },

{ "name": "message", "type": "string" },

{ "name": "facility_label", "type": "string" },

{ "name": "severity_label", "type": "string" },

{ "name": "host", "type": "string" },

{ "name": "logsource", "type": "string" }

]

}

},

"destinations": {

"logAnalytics": [

{

"workspaceResourceId": "[parameters('workspaceResourceId')]",

"name": "clv2ws1"

}

]

},

"dataFlows": [

{

"streams": ["Custom-SyslogStream"],

"destinations": ["clv2ws1"],

"transformKql": "source | project TimeGenerated = ls_timestamp, EventTime = todatetime(timestamp), Computer = logsource, HostName = logsource, HostIP = host, SyslogMessage = message, Facility = facility_label, SeverityLevel = severity_label",

"outputStream": "Microsoft-Syslog"

}

]

}

}

],

"outputs": {

"dataCollectionRuleId": {

"type": "String",

"value": "[resourceId('Microsoft.Insights/dataCollectionRules', parameters('dataCollectionRuleName'))]"

}

}

}

Configurare il file di configurazione Logstash

Il plug-in supporta due metodi di autenticazione: entità servizio (credenziali client) e identità gestita (senza password). Scegliere il metodo più adatto all'ambiente.

Autenticazione dell'entità servizio

Per configurare il file di configurazione Logstash per inserire i log in una tabella personalizzata usando l'autenticazione dell'entità servizio, recuperare questi valori:

| Campo | Come recuperare |

|---|---|

client_app_Id |

Valore Application (client) ID creato nel passaggio 3 quando si creano le risorse DCR, in base all'esercitazione usata in questa sezione. |

client_app_secret |

Il valore del segreto client creato nel passaggio 5 quando si creano le risorse DCR, in base all'esercitazione usata in questa sezione. |

tenant_id |

ID tenant della sottoscrizione. È possibile trovare l'ID tenant in Home > Microsoft Entra ID > Panoramica informazioni > di base. |

data_collection_endpoint |

Valore dell'URI logsIngestion nel passaggio 3 quando si creano le risorse DCR, in base all'esercitazione usata in questa sezione. |

dcr_immutable_id |

Valore del DCR immutableId nel passaggio 6 quando si creano le risorse DCR, in base all'esercitazione usata in questa sezione. |

dcr_stream_name |

Per le tabelle personalizzate, come illustrato nel passaggio 6 quando si creano le risorse DCR, passare alla visualizzazione JSON del DCR e copiare la dataFlows>streams proprietà. Vedere nell'esempio dcr_stream_name seguente. Per le tabelle standard, il valore è Custom-SyslogStream. |

Dopo aver recuperato i valori necessari:

- Sostituire la sezione di output del file di configurazione Logstash creato nel passaggio precedente con l'esempio seguente.

- Sostituire le stringhe segnaposto nell'esempio seguente con i valori recuperati.

- Assicurarsi di modificare l'attributo

create_sample_fileinfalse.

Esempio: Configurazione del plug-in di output dell'entità servizio

output {

microsoft-sentinel-log-analytics-logstash-output-plugin {

client_app_Id => "<enter your client_app_id value here>"

client_app_secret => "<enter your client_app_secret value here>"

tenant_id => "<enter your tenant id here>"

data_collection_endpoint => "<enter your logsIngestion URI here>"

dcr_immutable_id => "<enter your DCR immutableId here>"

dcr_stream_name => "<enter your stream name here>"

create_sample_file=> false

sample_file_path => "c:\\temp"

}

}

Autenticazione dell'identità gestita (senza password)

Quando managed_identity è impostato su true, il plug-in viene autenticato senza un segreto client. Il plug-in rileva automaticamente il meccanismo di identità appropriato in fase di esecuzione nell'ordine seguente:

-

Identità del carico di lavoro del servizio Azure Kubernetes: se le variabili

AZURE_CLIENT_IDdi ambiente ,AZURE_TENANT_IDeAZURE_FEDERATED_TOKEN_FILEsono presenti (impostate automaticamente dal servizio Azure Kubernetes), il plug-in esegue uno scambio di token OIDC. -

Azure Arc: se il Azure Connected Machine Agent (

azcmagent) viene rilevato nell'host, il plug-in usa l'endpoint di identità gestita Azure Arc per i server ibridi e locali. - IMDS: in caso contrario, il plug-in torna al servizio di metadati dell'istanza di Azure (IMDS) per Azure macchine virtuali e VM.

Configurazione necessaria per l'identità gestita:

| Campo | Descrizione |

|---|---|

managed_identity |

Boolean, false per impostazione predefinita.

true Impostare su per abilitare l'autenticazione senza password. |

data_collection_endpoint |

Stringa. URI logsIngestion per dce. |

dcr_immutable_id |

Stringa. DCR immutableId. |

dcr_stream_name |

Stringa. Nome del flusso di dati. |

managed_identity_object_id |

Facoltativo. Stringa, vuota per impostazione predefinita. ID oggetto di un'identità gestita assegnata dall'utente. Obbligatorio quando la macchina virtuale ha più identità assegnate dall'utente. Omettere per l'identità gestita assegnata dal sistema. |

Esempio: Identità gestita assegnata dal sistema

output {

microsoft-sentinel-log-analytics-logstash-output-plugin {

managed_identity => true

data_collection_endpoint => "<enter your DCE logsIngestion URI here>"

dcr_immutable_id => "<enter your DCR immutableId here>"

dcr_stream_name => "<enter your stream name here>"

}

}

Esempio: Identità gestita assegnata dall'utente

output {

microsoft-sentinel-log-analytics-logstash-output-plugin {

managed_identity => true

managed_identity_object_id => "<enter the object ID of your user-assigned identity>"

data_collection_endpoint => "<enter your DCE logsIngestion URI here>"

dcr_immutable_id => "<enter your DCR immutableId here>"

dcr_stream_name => "<enter your stream name here>"

}

}

Nota

- Quando si usa Azure Arc, il processo Logstash deve essere eseguito come utente membro del

himdsgruppo per leggere il token di verifica. Per altre informazioni, vedere Azure documentazione sull'identità gestita di Arc. - Per motivi di sicurezza, non usare in modo implicito valori di configurazione sensibili allo stato, ad

client_app_secretesempio nel file di configurazione Logstash. Archiviare informazioni riservate in un archivio chiavi Logstash. - Quando si imposta una stringa vuota come valore per un'impostazione proxy, viene annullata qualsiasi impostazione proxy a livello di sistema.

Configurazione facoltativa

| Campo | Descrizione | Valore predefinito |

|---|---|---|

azure_cloud |

Utilizzato per specificare il nome del cloud Azure in uso. I valori disponibili sono: AzureCloud, AzureChinaCloude AzureUSGovernment. |

AzureCloud |

key_names |

Specifica una matrice di stringhe. Specificare questo campo se si vuole inviare un subset delle colonne a Log Analytics. | Nessuno (il campo è vuoto) |

plugin_flush_interval |

Definisce la differenza di tempo massima (in secondi) tra l'invio di due messaggi a Log Analytics. | 5 |

retransmission_time |

Imposta la quantità di tempo in secondi per la ritrasmissione dei messaggi dopo l'invio non riuscito. | 10 |

retransmission_delay |

Il ritardo in secondi tra ogni tentativo di ripetizione dei tentativi durante l'invio dei dati di log non riesce. Aumentare questo valore per ridurre la frequenza delle richieste durante gli scenari di limitazione (HTTP 429). | 2 |

compress_data |

Quando questo campo è True, i dati dell'evento vengono compressi prima di usare l'API. Consigliato per le pipeline a velocità effettiva elevata. |

False |

proxy |

Specificare l'URL proxy da usare per tutte le chiamate API. | Nessuno (il campo è vuoto) |

proxy_aad |

Specificare l'URL proxy da usare per le chiamate API a Microsoft Entra ID. Esegue l'override dell'impostazione proxy . |

Nessuno (il campo è vuoto) |

proxy_endpoint |

Specificare l'URL proxy da usare per le chiamate API all'endpoint di raccolta dati. Esegue l'override dell'impostazione proxy . |

Nessuno (il campo è vuoto) |

Riavviare Logstash

Riavviare Logstash con la configurazione del plug-in di output aggiornata. Verificare che i dati siano inseriti nella tabella corretta in base alla configurazione DCR.

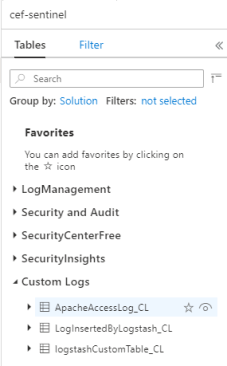

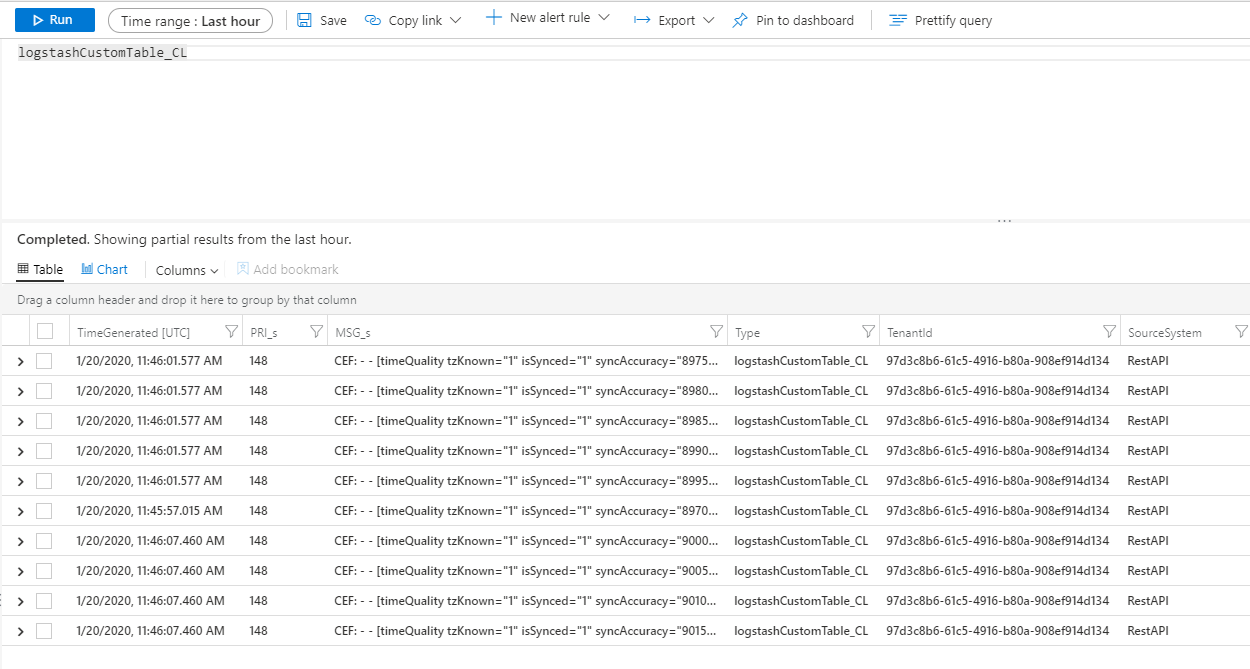

Visualizzare i log in ingresso in Microsoft Sentinel

Per verificare che i dati di log raggiungano l'area di lavoro, seguire questa procedura:

Verificare che i messaggi vengano inviati al plug-in di output.

Dal menu di spostamento Microsoft Sentinel selezionare Log. Sotto l'intestazione Tabelle espandere la categoria Log personalizzati . Trovare e selezionare il nome della tabella specificata (con un

_CLsuffisso) nella configurazione.

Per visualizzare i record nella tabella, eseguire una query sulla tabella usando il nome della tabella come schema.

Monitorare i log di controllo del plug-in di output

Per monitorare la connettività e l'attività del plug-in di output Microsoft Sentinel, abilitare il file di log Logstash appropriato. Vedere il documento Logstash Directory Layout per il percorso del file di log.

Se non vengono visualizzati dati in questo file di log, generare e inviare alcuni eventi in locale tramite i plug-in di input e filtro per assicurarsi che il plug-in di output stia ricevendo dati. Microsoft Sentinel supporta solo i problemi relativi al plug-in di output.

Sicurezza di rete

Definire le impostazioni di rete e abilitare l'isolamento della rete per il plug-in di output Microsoft Sentinel Logstash.

Tag del servizio di rete virtuale

Microsoft Sentinel plug-in di output supporta Azure tag del servizio di rete virtuale. Sono necessari tag AzureMonitor e AzureActiveDirectory .

Azure Rete virtuale tag del servizio possono essere usati per definire i controlli di accesso di rete nei gruppi di sicurezza di rete, Firewall di Azure e route definite dall'utente. Usare i tag del servizio anziché indirizzi IP specifici quando si creano regole di sicurezza e route. Per gli scenari in cui non è possibile usare Azure Rete virtuale tag del servizio, i requisiti del firewall sono indicati di seguito.

Requisiti del firewall

Nella tabella seguente sono elencati i requisiti del firewall per gli scenari in cui non è possibile usare Azure tag del servizio di rete virtuale.

| Cloud | Endpoint | Finalità | Porta | Direzione | Disabilita ispezione HTTP |

|---|---|---|---|---|---|

| Azure Commerciale | https://login.microsoftonline.com |

Server di autorizzazione (Microsoft Identity Platform) | Porta 443 | In uscita | Sì |

| Azure Commerciale | https://<data collection endpoint name>.<Azure cloud region>.ingest.monitor.azure.com |

Endpoint raccolta dati | Porta 443 | In uscita | Sì |

| Azure per enti pubblici | https://login.microsoftonline.us |

Server di autorizzazione (Microsoft Identity Platform) | Porta 443 | In uscita | Sì |

| Azure per enti pubblici | Sostituire '.com' precedente con '.us' | Endpoint raccolta dati | Porta 443 | In uscita | Sì |

| Microsoft Azure gestito da 21Vianet | https://login.chinacloudapi.cn |

Server di autorizzazione (Microsoft Identity Platform) | Porta 443 | In uscita | Sì |

| Microsoft Azure gestito da 21Vianet | Sostituire '.com' precedente con '.cn' | Endpoint raccolta dati | Porta 443 | In uscita | Sì |

Cronologia delle versioni del plug-in

2.1.0

- Correzione della normalizzazione degli eventi.

2.0.0

- Il plug-in è stato refactoring da Ruby a Java.

- Aggiunta dell'autenticazione ManagedIdentity.

- È stata spostata la codebase da GitHub a Azure DevOps.

- Codebase chiusa.

1.2.0

- Aggiunge il supporto dell'autenticazione dell'identità gestita per Azure macchine virtuali/VM (assegnate dal sistema e assegnate dall'utente tramite IMDS).

- Aggiunge il supporto dell'identità del carico di lavoro del servizio Azure Kubernetes tramite lo scambio di token OIDC.

- Aggiunge Azure supporto dell'identità gestita arc per server ibridi e locali.

- Rileva automaticamente il metodo di autenticazione in fase di esecuzione in base all'ambiente (identità del carico di lavoro env vars, agente Arc o fallback IMDS).

- Esegue la migrazione del client HTTP da

exconarest-clientper migliorare la compatibilità dell'ecosistema dei plug-in JRuby e Logstash. - Rinomina Azure riferimenti ad Active Directory in Microsoft Entra ID.

1.1.4

- Limita

exconla versione della libreria a una versione inferiore a 1.0.0 per garantire che la porta venga sempre usata quando si usa un proxy.

1.1.3

- Sostituisce la

rest-clientlibreria usata per la connessione a Azure con laexconlibreria.

1.1.1

- Aggiunge il supporto per Azure cloud us government e Microsoft Azure gestito da 21Vianet in Cina.

1.1.0

- Consente di impostare valori proxy diversi per le connessioni API.

- Aggiorna la versione per l'API di inserimento log a 2023-01-01.

- Rinomina il plug-in in microsoft-sentinel-log-analytics-logstash-output-plugin.

1.0.0

- Versione iniziale per il plug-in di output Logstash per Microsoft Sentinel. Questo plug-in usa le regole di raccolta dati (DCR) con Azure'API di inserimento log di Monitoraggio.

Problemi noti

Quando si usa Logstash installato in un'immagine Docker di Lite Ubuntu, potrebbe essere visualizzato l'avviso seguente:

java.lang.RuntimeException: getprotobyname_r failed

Per risolvere questo errore, installare il pacchetto netbase nel dockerfile:

USER root

RUN apt install netbase -y

Per altre informazioni, vedere Regressione JNR in Logstash 7.17.0 (Docker).For more information, see JNR regression in Logstash 7.17.0 (Docker).

Se la frequenza degli eventi dell'ambiente è bassa, aumentare il valore di plugin_flush_interval a 60 o più. È possibile monitorare il payload di inserimento usando le metriche DCR. Per altre informazioni su plugin_flush_interval, vedere la tabella di configurazione Facoltativa .

Limitazioni

L'inserimento nelle tabelle standard è limitato solo alle tabelle standard supportate per l'inserimento di log personalizzati.

Le colonne del flusso di input nella

streamDeclarationsproprietà devono iniziare con una lettera. Se si avvia una colonna con altri caratteri (ad esempio@o_), l'operazione ha esito negativo.Il

TimeGeneratedcampo datetime è obbligatorio. È necessario includere questo campo nella trasformazione KQL.Per altri possibili problemi, vedere la sezione relativa alla risoluzione dei problemi nell'esercitazione.