AI を利用する Microsoft の製品オファリングはどれですか?

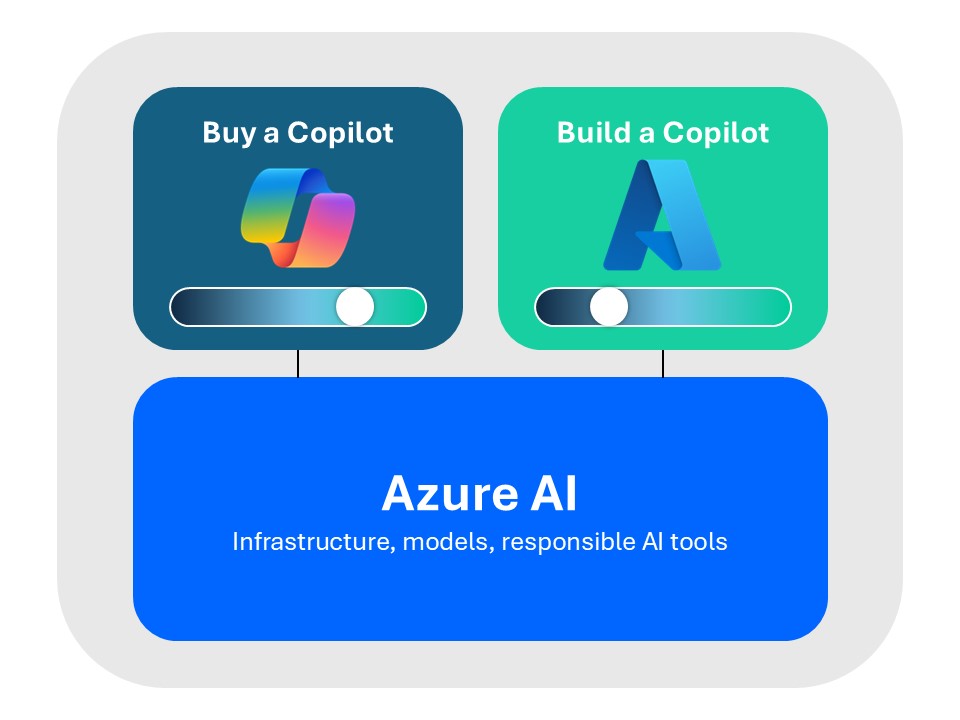

Microsoft には、Copilot などのすぐに使用できるジェネレーティブ AI システムと、独自のジェネレーティブ AI システムを構築できる AI 開発プラットフォームという 2 つのグループに幅広く分類できるさまざまな AI オファリングがあります。

Azure AI は、一般的な開発プラットフォームとして機能し、エンタープライズ レベルのプライバシー、セキュリティ、コンプライアンスを備えた責任あるイノベーションの基盤を提供します。

Microsoft の AI オファリングの詳細については、次の製品ドキュメントを参照してください。

共有責任モデルは AI にどのように適用されますか?

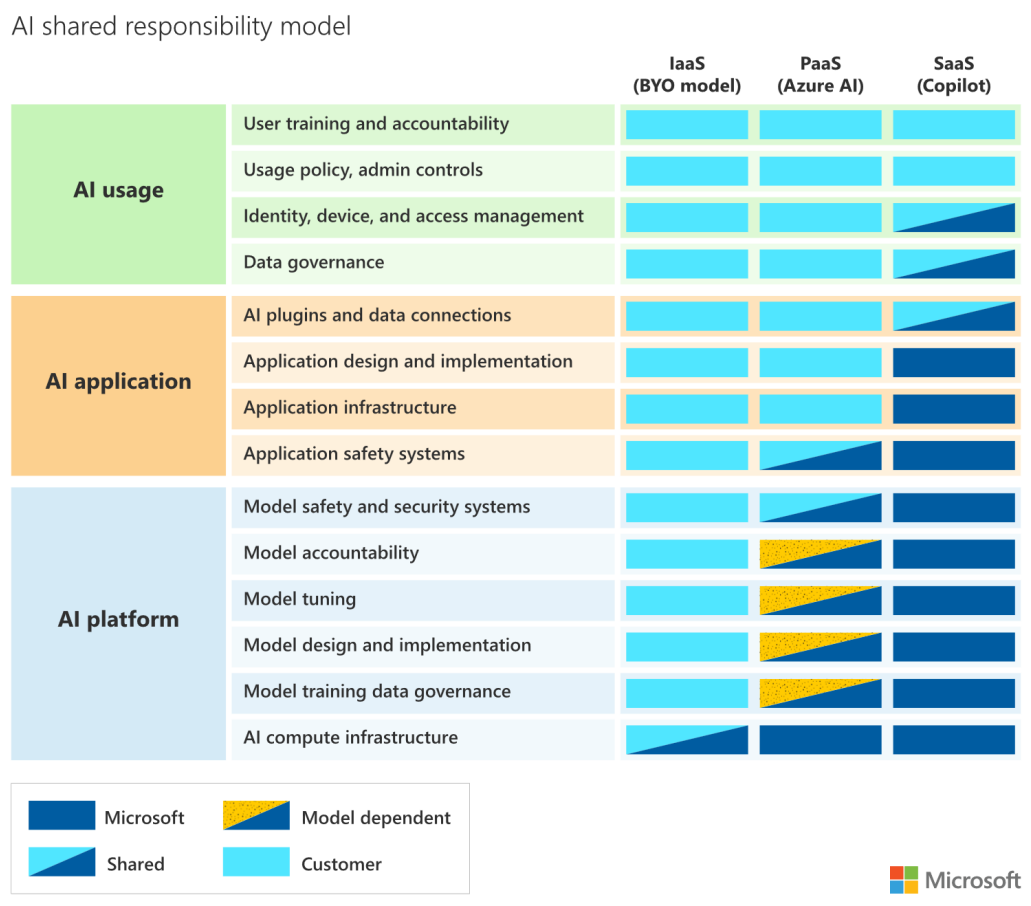

他のクラウド オファリングと同様に、AI リスクの軽減は、Microsoft とお客様の間で共有される責任です。 organization内で実装される AI 機能に応じて、Microsoft と顧客の間で責任がシフトします。

次の図は、展開の種類に応じて、Microsoft とお客様の間の責任領域を示しています。

詳細については、人工知能 (AI) 共有責任モデルに関するページを参照してください

Microsoft が共有責任モデルの一部を実行する際にお客様をサポートする方法については、「責任を 持って AI を構築する方法 (pg. 22)」を参照してください。

Microsoft は AI システムの開発と管理をどのように管理していますか?

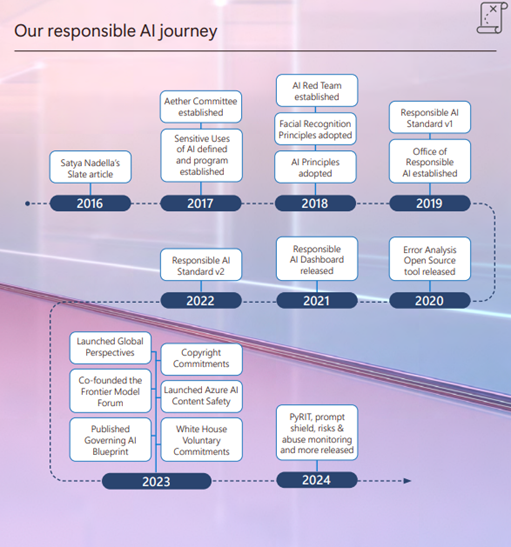

AI は Microsoft にとって新しいわけではありません。私たちは何年もの間、AIシステムのイノベーションを推進してきました。 私たちの責任ある AI イニシアチブは、AI の取り組みの中核であり、2016 年に Satya Nadella のスレート記事のリリースによって開始され、責任ある AI を運用する現在の場所に至っています。

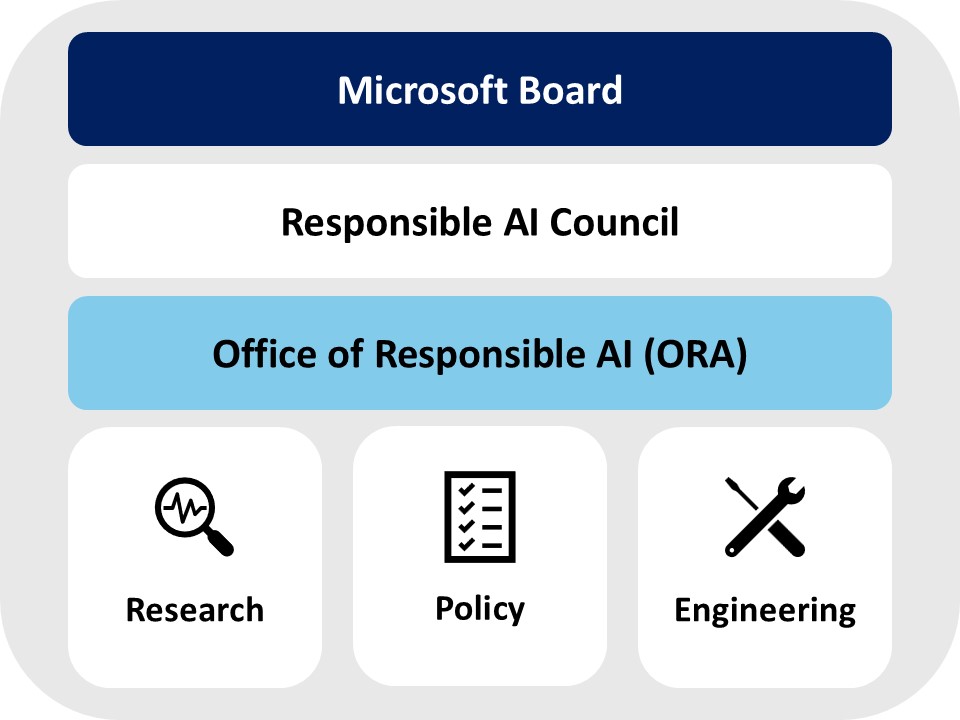

責任ある AI プラクティスの導入を推進する責任を負うチームやorganizationは一切ありません。 Microsoft では、フェデレーションされたボトムアップ アプローチと、会社のリーダーシップによる強力なトップダウン サポートと監督を組み合わせて、ポリシー、ガバナンス、プロセスを促進します。 研究、政策、エンジニアリングの専門家は、専門知識を組み合わせ、最先端のプラクティスに協力して、お客様とパートナーを同時にサポートしながら、独自のコミットメントを確実に満たします。

- Microsoft Board: 責任ある AI の管理は、CEO の Satya Nadella から始まり、上級リーダーシップ チームとすべての Microsoft に連鎖します。 取締役会の環境・社会・公共政策委員会は、責任ある AI のポリシーとプログラムに関する監督とガイダンスを提供しています。

- 責任ある AI カウンシル: 副委員長兼社長のブラッド・スミスと最高技術責任者のケビン・スコットが、責任ある AI カウンシルは、AI を取り巻く最大の課題に定期的に取り組み、責任ある AI のポリシーとプロセスの進歩を促進するために、ビジネス リーダーと研究、ポリシー、エンジニアリングの代表者のためのフォーラムを提供します。

- 責任ある AI (ORA) のオフィス: ORA は、責任ある AI 原則を実践し、5 つの主要な機能を通じて実現します。 ORA は、会社全体の内部ポリシーを設定し、ガバナンス構造を定義し、AI プラクティスを採用するためのリソースを提供し、機密性の高いユース ケースをレビューし、AI に関するパブリック ポリシーを形成するのに役立ちます。

- 研究: AI 倫理とエンジニアリングと研究の効果 (Aether) 委員会、Microsoft Research、およびエンジニアリング チームの研究者は、思考リーダーシップを通じて、責任ある AI プログラムを問題の最先端に維持します。

- ポリシー: ORA は、組織全体の利害関係者やポリシー チームと協力して、AI アプリケーションを構築する際に AI 原則を維持するためのポリシーとプラクティスを開発します。

- エンジニアリング: エンジニアリング チームは、AI プラットフォーム、アプリケーション、ツールを作成します。 彼らは、ポリシーとプラクティスが技術的に実現可能であることを確認し、新しいプラクティスと新しいテクノロジを革新し、責任ある AI プラクティスを組織全体でスケーリングするためのフィードバックを提供します。

Microsoft の RAI プログラムの基礎となる原則は何ですか?

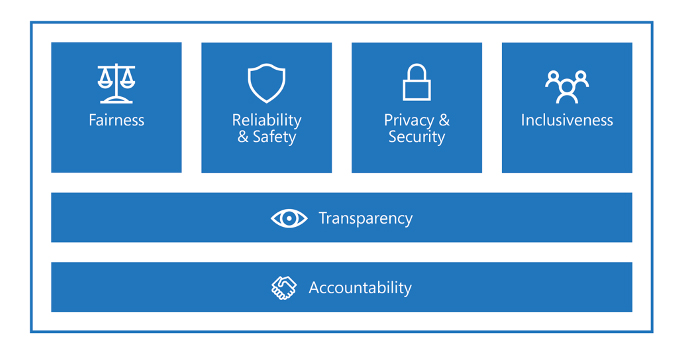

Microsoft は、責任ある AI トピックに関する認識、学習、イノベーションの文化を促進するために、人間中心の 6 つの原則を開発しました。 これらの 6 つの AI 原則は、Microsoft の RAI プログラムの基礎を築き、ORA が開発するポリシーです。

責任ある AI の原則の詳細については、「 責任ある AI」を参照してください。

Microsoft は ORA によって定義されたポリシーをどのように実装しますか?

責任ある AI Standard (RAI Standard) は、AI システムの製品開発とリスク管理の基準を確立するための長期的な努力の結果です。 これは、Microsoft によって開発されたすべての AI システムの目標、要件、プラクティスを定義することで、RAI の原則を実行します。

- Goals: AI 原則を維持する意味を定義する

- 要件: AI 原則を維持する方法を定義する

- プラクティス: 要件を満たすのに役立つ支援

RAI Standardのメイン推進力は影響評価であり、開発チームは目標要件ごとに結果を文書化する必要があります。 プライバシー & セキュリティと包括性の目標については、RAI Standardは、Microsoft に既に存在する既存のプライバシー、セキュリティ、アクセシビリティ プログラムに準拠し、AI 固有のガイダンスに従う必要があることを示しています。

RAI の完全なStandardについては、Microsoft 責任ある AI Standard一般的な要件に関するドキュメントを参照してください。

リソース

- Microsoft 365 ISO 42001

- 責任ある AI 透明性アニュアル レポート

- Service Trust Portal – AI リソース