Generatieve AI-apps evalueren met Azure AI Studio

Belangrijk

Sommige van de functies die in dit artikel worden beschreven, zijn mogelijk alleen beschikbaar in de preview-versie. Deze preview wordt aangeboden zonder een service level agreement en we raden deze niet aan voor productieworkloads. Misschien worden bepaalde functies niet ondersteund of zijn de mogelijkheden ervan beperkt. Zie Aanvullende gebruiksvoorwaarden voor Microsoft Azure-previews voor meer informatie.

Als u de prestaties van uw generatieve AI-toepassing grondig wilt evalueren wanneer deze wordt toegepast op een aanzienlijke gegevensset, kunt u een evaluatieproces starten. Tijdens deze evaluatie wordt uw toepassing getest met de opgegeven gegevensset en worden de prestaties kwantitatief gemeten met zowel wiskundige metrische gegevens als ai-ondersteunde metrische gegevens. Deze evaluatieuitvoering biedt u uitgebreide inzichten in de mogelijkheden en beperkingen van de toepassing.

Als u deze evaluatie wilt uitvoeren, kunt u gebruikmaken van de evaluatiefunctionaliteit in Azure AI Studio, een uitgebreid platform dat hulpprogramma's en functies biedt voor het beoordelen van de prestaties en veiligheid van uw generatieve AI-model. In AI Studio kunt u gedetailleerde metrische evaluatiegegevens vastleggen, weergeven en analyseren.

In dit artikel leert u hoe u een evaluatieuitvoering maakt op basis van een testgegevensset of een stroom met ingebouwde metrische evaluatiegegevens uit de gebruikersinterface van Azure AI Studio. Voor meer flexibiliteit kunt u een aangepaste evaluatiestroom instellen en de aangepaste evaluatiefunctie gebruiken. Als u alleen een batchuitvoering wilt uitvoeren zonder evaluatie, kunt u ook de aangepaste evaluatiefunctie gebruiken.

Vereisten

Als u een evaluatie wilt uitvoeren met met AI ondersteunde metrische gegevens, moet u het volgende gereed hebben:

- Een testgegevensset in een van deze indelingen:

csvofjsonl. - Een Azure OpenAI-verbinding.

- Een implementatie van een van deze modellen: GPT 3.5-modellen, GPT 4-modellen of Davinci-modellen.

Een evaluatie maken met ingebouwde metrische evaluatiegegevens

Met een evaluatieuitvoering kunt u metrische uitvoer genereren voor elke gegevensrij in uw testgegevensset. U kunt een of meer metrische evaluatiegegevens kiezen om de uitvoer van verschillende aspecten te beoordelen. U kunt een evaluatieuitvoering maken vanaf de evaluatie- en promptstroompagina's in AI Studio. Vervolgens wordt een wizard voor het maken van een evaluatie weergegeven om u te begeleiden bij het instellen van een evaluatieuitvoering.

Vanaf de evaluatiepagina

Selecteer Evaluatie>+ Nieuwe evaluatie in het samenvouwbare linkermenu.

Vanaf de stroompagina

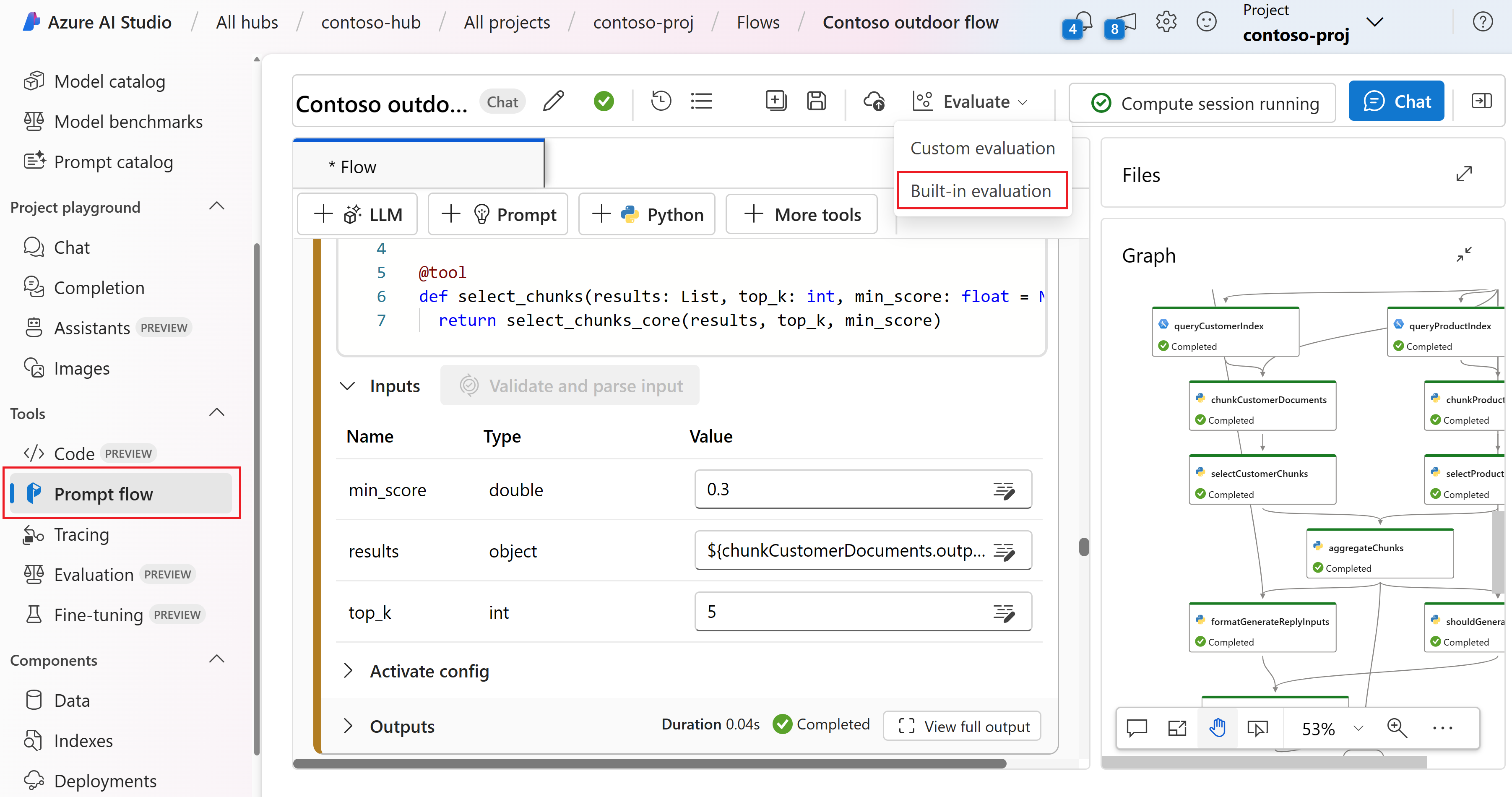

Selecteer in het samenvouwbare linkermenu de optie Promptstroom>Ingebouwde>evaluatie evalueren.

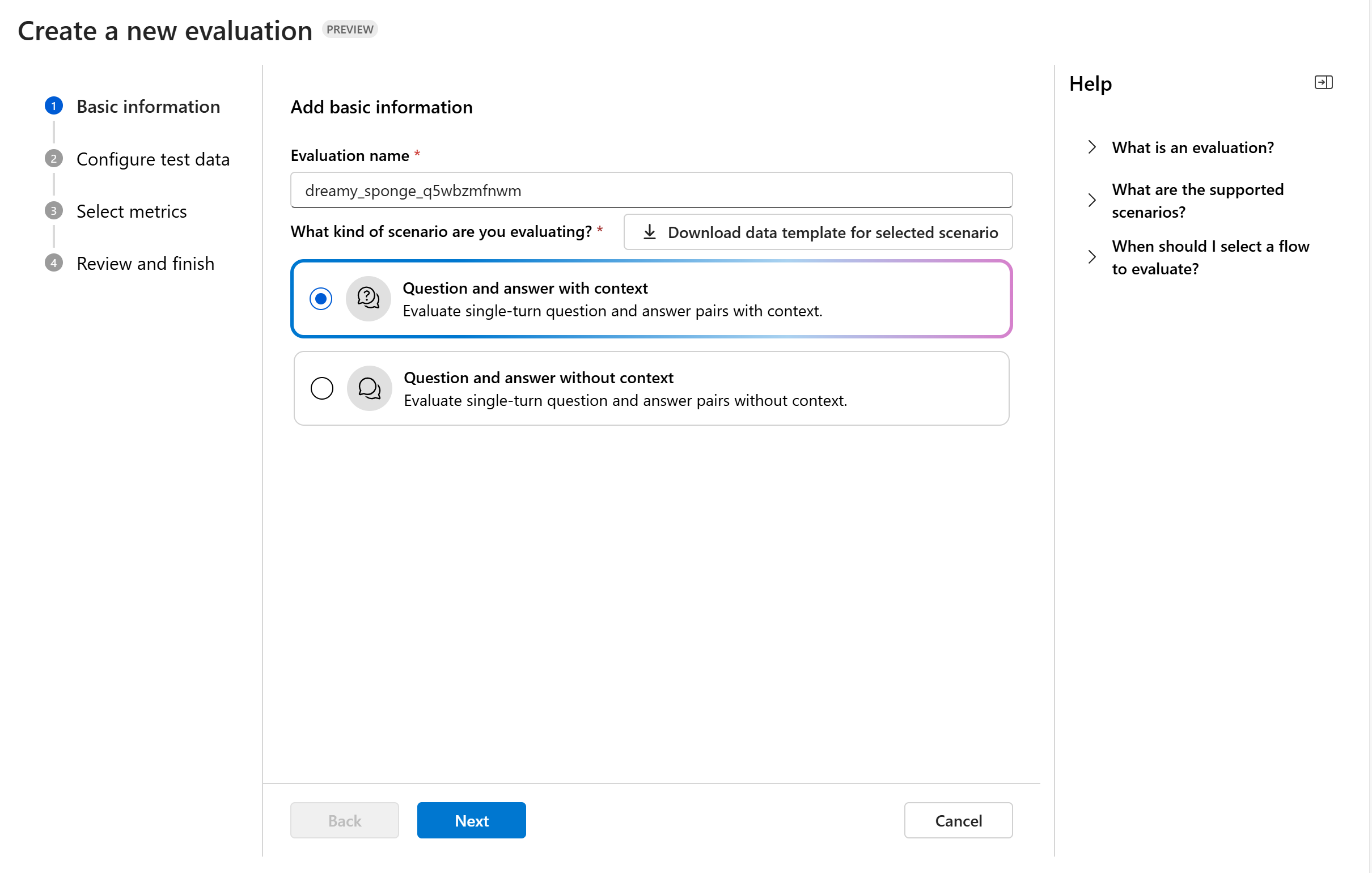

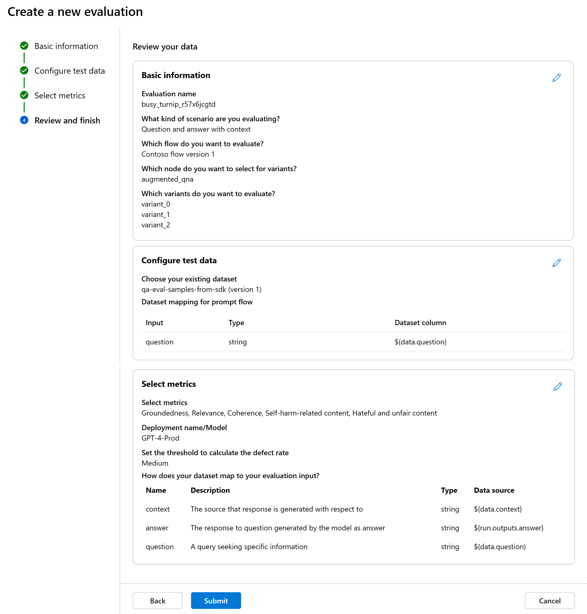

Algemene informatie

Wanneer u de wizard voor het maken van de evaluatie invoert, kunt u een optionele naam opgeven voor de evaluatieuitvoering en het scenario selecteren dat het beste overeenkomt met de doelstellingen van uw toepassing. Momenteel bieden we ondersteuning voor de volgende scenario's:

- Vraag en antwoord met context: Dit scenario is ontworpen voor toepassingen die betrekking hebben op het beantwoorden van gebruikersquery's en het leveren van antwoorden met contextinformatie.

- Vraag en antwoord zonder context: dit scenario is ontworpen voor toepassingen die betrekking hebben op het beantwoorden van gebruikersquery's en het leveren van antwoorden zonder context.

U kunt het Help-deelvenster gebruiken om de veelgestelde vragen te controleren en uzelf door de wizard te leiden.

Door het juiste scenario op te geven, kunnen we de evaluatie aanpassen aan de specifieke aard van uw toepassing, zodat nauwkeurige en relevante metrische gegevens worden gegarandeerd.

- Evalueren op basis van gegevens: Als u al de uitvoer van uw model hebt gegenereerd in een testgegevensset, slaat u een stroom over om te evalueren en gaat u rechtstreeks naar de volgende stap om testgegevens te configureren.

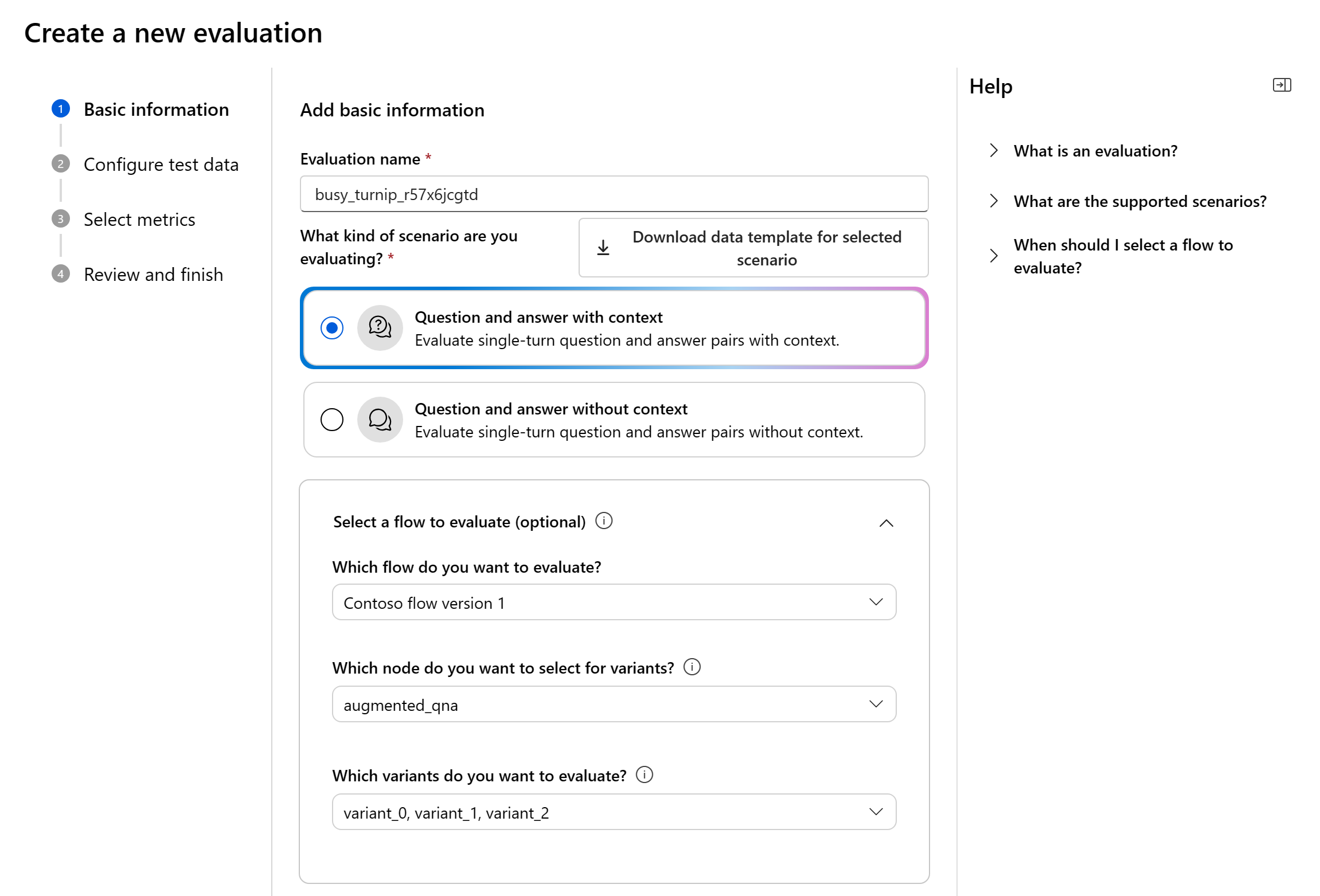

- Evalueren vanuit stroom: Als u de evaluatie start op de pagina Stroom, selecteren we automatisch uw stroom die u wilt evalueren. Als u een andere stroom wilt evalueren, kunt u een andere stroom selecteren. Het is belangrijk te weten dat u binnen een stroom meerdere knooppunten hebt, die elk een eigen set varianten kunnen hebben. In dergelijke gevallen moet u het knooppunt en de varianten opgeven die u tijdens het evaluatieproces wilt evalueren.

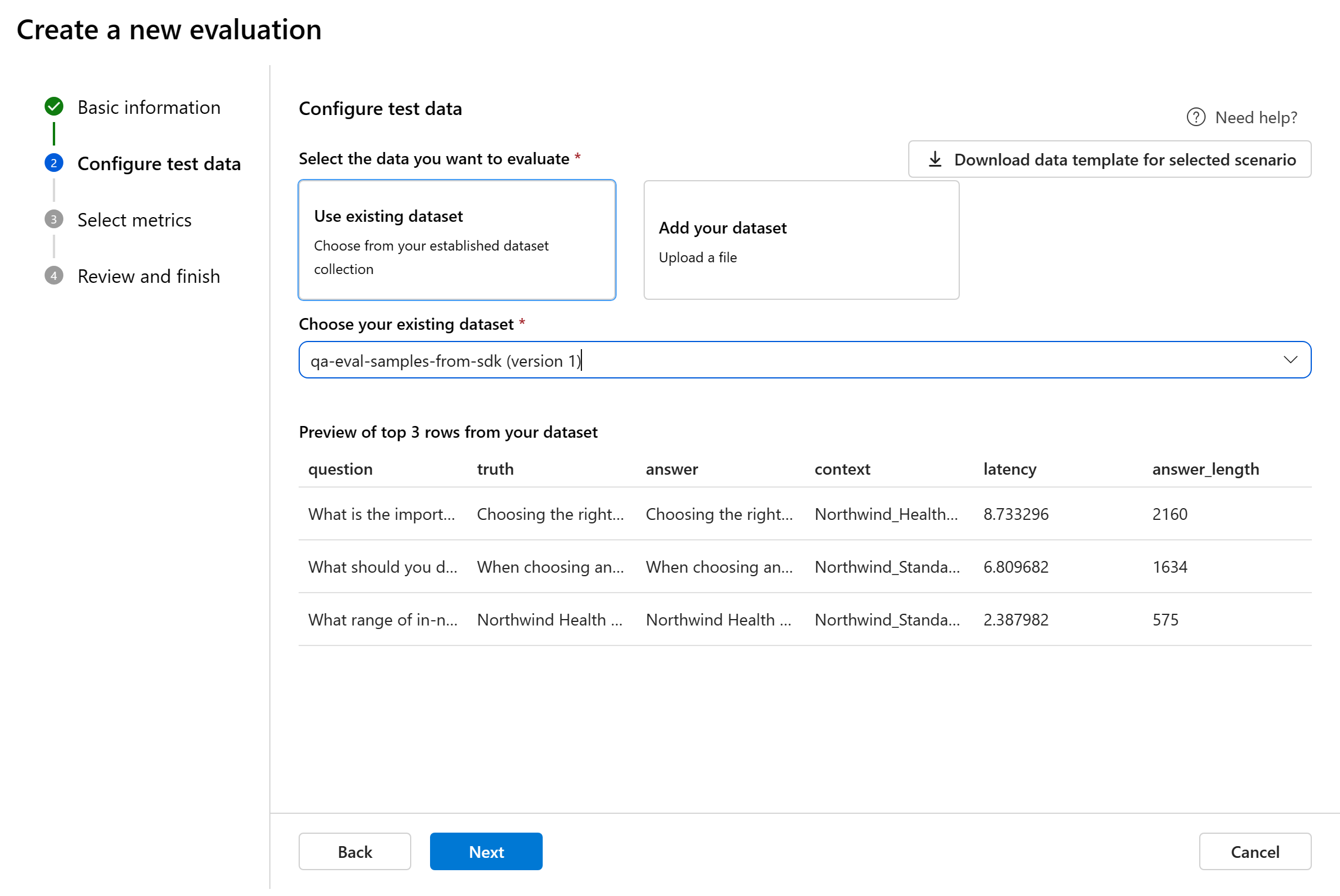

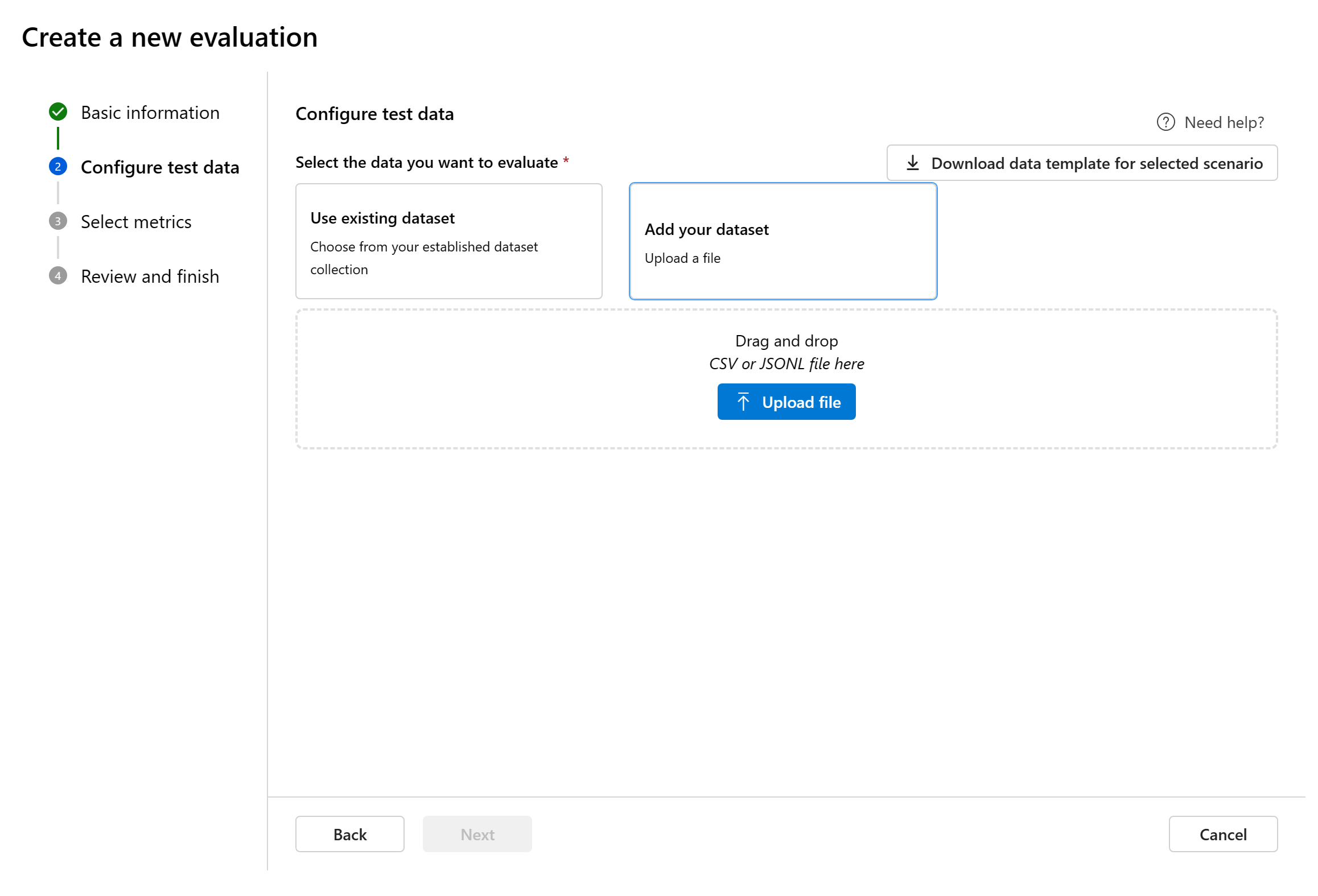

Testgegevens configureren

U kunt kiezen uit bestaande gegevenssets of een nieuwe gegevensset uploaden om te evalueren. In de testgegevensset moet het model gegenereerde uitvoer worden gebruikt voor evaluatie als er in de vorige stap geen stroom is geselecteerd.

Kies een bestaande gegevensset: u kunt de testgegevensset kiezen uit uw bestaande gegevenssetverzameling.

Nieuwe gegevensset toevoegen: U kunt bestanden uploaden vanuit uw lokale opslag. We ondersteunen

.csvalleen bestandsindelingen en.jsonlbestandsindelingen.Gegevenstoewijzing voor stroom: Als u een te evalueren stroom selecteert, moet u ervoor zorgen dat uw gegevenskolommen zijn geconfigureerd om te worden afgestemd op de vereiste invoer voor de stroom om een batchuitvoering uit te voeren, waardoor uitvoer voor evaluatie wordt gegenereerd. De evaluatie wordt vervolgens uitgevoerd met behulp van de uitvoer van de stroom. Configureer vervolgens de gegevenstoewijzing voor evaluatie-invoer in de volgende stap.

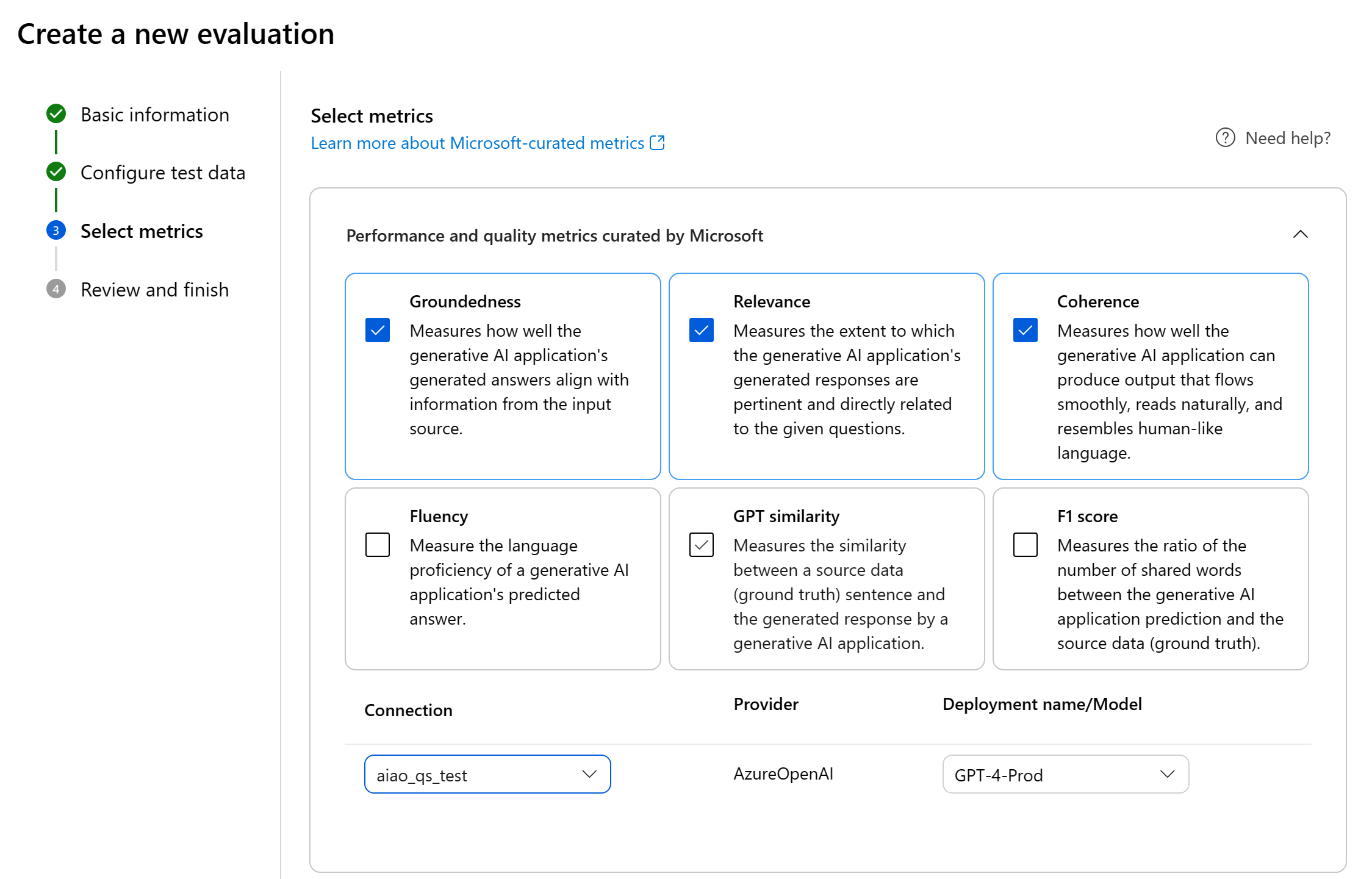

Metrische gegevens selecteren

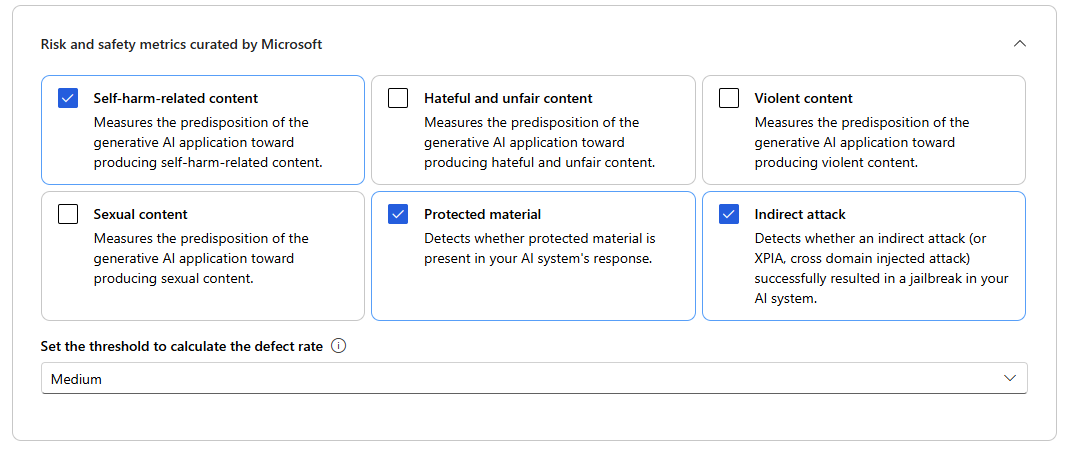

We ondersteunen twee soorten metrische gegevens die door Microsoft worden samengesteld om een uitgebreide evaluatie van uw toepassing te vergemakkelijken:

- Metrische gegevens over prestaties en kwaliteit: deze metrische gegevens evalueren de algehele kwaliteit en samenhang van de gegenereerde inhoud.

- Metrische gegevens over risico's en veiligheid: deze metrische gegevens richten zich op het identificeren van potentiële inhoudsrisico's en het waarborgen van de veiligheid van de gegenereerde inhoud.

U kunt de tabel raadplegen voor de volledige lijst met metrische gegevens die in elk scenario worden ondersteund. Zie De metrische gegevens evalueren en bewaken voor meer gedetailleerde informatie over elke definitie van metrische gegevens en hoe deze worden berekend.

| Scenario | Metrische gegevens over prestaties en kwaliteit | Metrische gegevens over risico en veiligheid |

|---|---|---|

| Vraag en antwoord met context | Groundedness, Relevantie, Coherentie, Fluency, GPT-gelijkenis, F1-score | Aan zichzelf gerelateerde inhoud, haatvolle en oneerlijke inhoud, gewelddadige inhoud, seksuele inhoud |

| Vraag en antwoord zonder context | Coherentie, fluency, GPT-gelijkenis, F1-score | Aan zichzelf gerelateerde inhoud, haatvolle en oneerlijke inhoud, gewelddadige inhoud, seksuele inhoud |

Wanneer u ai-ondersteunde metrische gegevens gebruikt voor de evaluatie van prestaties en kwaliteit, moet u een GPT-model opgeven voor het berekeningsproces. Kies een Azure OpenAI-verbinding en een implementatie met GPT-3.5, GPT-4 of het Davinci-model voor onze berekeningen.

Voor metrische gegevens over risico's en veiligheid hoeft u geen verbinding en implementatie te bieden. De back-endservice van Azure AI Studio-veiligheidsevaluaties richt een GPT-4-model in waarmee ernstscores en redeneringen voor inhoudsrisico's kunnen worden gegenereerd, zodat u uw toepassing kunt evalueren op inhoudsschade.

U kunt de drempelwaarde instellen om de defectfrequentie voor de metrische risico- en veiligheidsgegevens te berekenen. De defectsnelheid wordt berekend door een percentage exemplaren met ernstniveaus (zeer laag, Laag, Gemiddeld, Hoog) boven een drempelwaarde te nemen. Standaard stellen we de drempelwaarde in als 'Gemiddeld'.

Notitie

Met AI ondersteunde risico- en veiligheidsstatistieken worden gehost door de back-endservice van Azure AI Studio-veiligheidsevaluaties en is alleen beschikbaar in de volgende regio's: VS - oost 2, Frankrijk - centraal, VK - zuid, Zweden - centraal

Gegevenstoewijzing voor evaluatie: u moet opgeven welke gegevenskolommen in uw gegevensset overeenkomen met de invoer die nodig is in de evaluatie. Verschillende metrische evaluatiegegevens vragen om verschillende typen gegevensinvoer voor nauwkeurige berekeningen.

Notitie

Als u evalueert op basis van gegevens, moet 'antwoord' worden toegewezen aan de antwoordkolom in uw gegevensset ${data$answer}. Als u van stroom evalueert, moet 'antwoord' afkomstig zijn van stroomuitvoer ${run.outputs.answer}.

Raadpleeg de informatie in de tabel voor hulp bij de specifieke vereisten voor gegevenstoewijzing voor elke metriek:

Vraag over het beantwoorden van metrische vereisten

| Metrische gegevens | Vraag | Antwoord | Context | Grondwaar |

|---|---|---|---|---|

| Geaardheid | Vereist: Str | Vereist: Str | Vereist: Str | N.v.t. |

| Samenhang | Vereist: Str | Vereist: Str | N.v.t. | N.v.t. |

| Fluency | Vereist: Str | Vereist: Str | N.v.t. | N.v.t. |

| Relevantie | Vereist: Str | Vereist: Str | Vereist: Str | N.v.t. |

| GPT-gelijkenis | Vereist: Str | Vereist: Str | N.v.t. | Vereist: Str |

| F1-score | Vereist: Str | Vereist: Str | N.v.t. | Vereist: Str |

| Inhoud met betrekking tot zelfschade | Vereist: Str | Vereist: Str | N.v.t. | N.v.t. |

| Haatvolle en oneerlijke inhoud | Vereist: Str | Vereist: Str | N.v.t. | N.v.t. |

| Gewelddadige inhoud | Vereist: Str | Vereist: Str | N.v.t. | N.v.t. |

| Seksuele inhoud | Vereist: Str | Vereist: Str | N.v.t. | N.v.t. |

- Vraag: de vraag die de gebruiker heeft gesteld in het vraagantwoord-paar

- Antwoord: het antwoord op de vraag die door het model als antwoord wordt gegenereerd

- Context: de bron die wordt gegenereerd met betrekking tot (dat wil gezegd documenten gronden)

- Grond waarheid: het antwoord op de vraag gegenereerd door gebruiker/mens als het ware antwoord

Controleren en voltooien

Nadat u alle benodigde configuraties hebt voltooid, kunt u controleren en doorgaan met het selecteren van Verzenden om de evaluatieuitvoering te verzenden.

Een evaluatie maken met een aangepaste evaluatiestroom

U kunt uw eigen evaluatiemethoden ontwikkelen:

Op de stroompagina: Selecteer in het samenvouwbare linkermenu promptstroom>>Evaluatie aangepaste evaluatie.

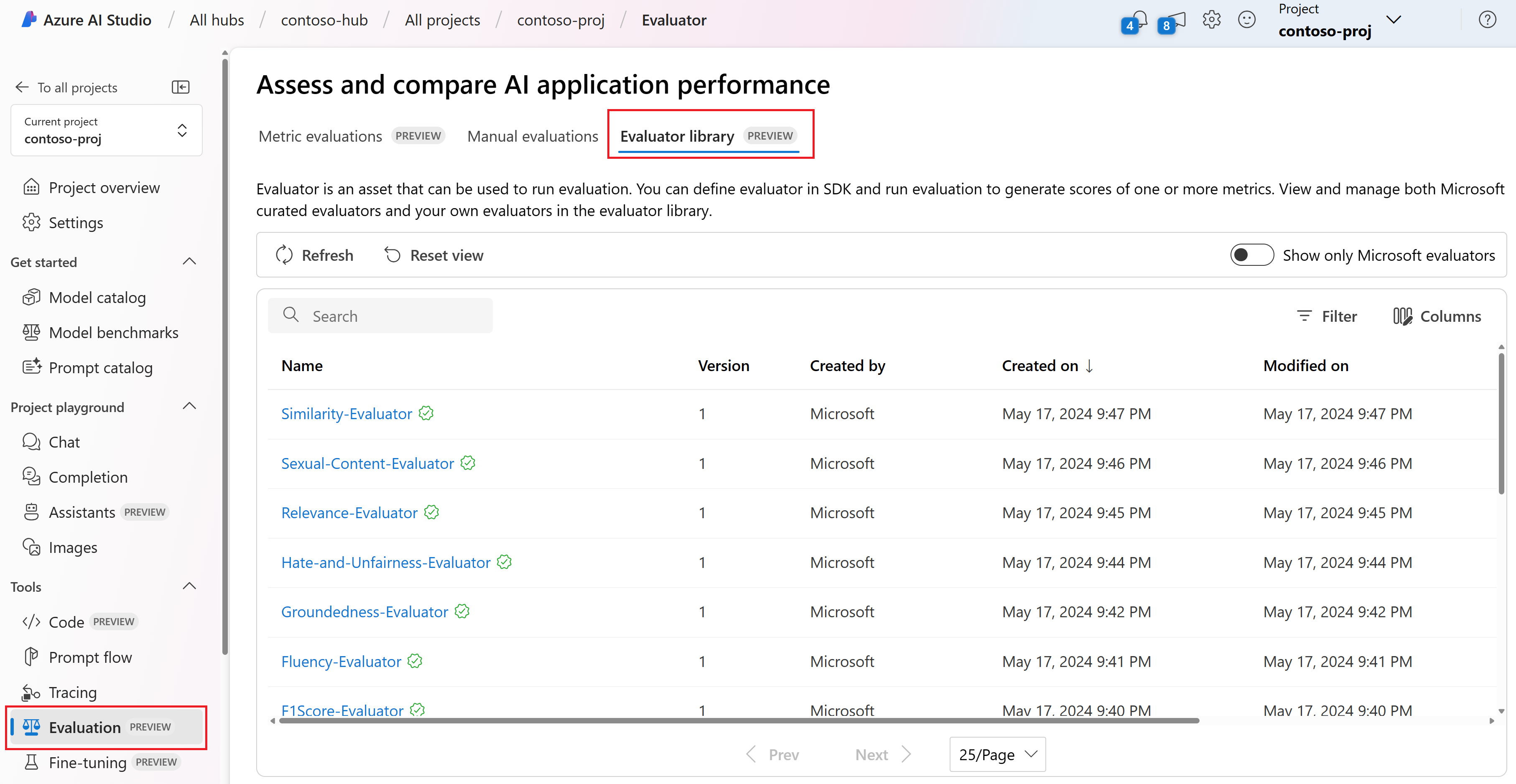

De evaluators in de evaluatorbibliotheek weergeven en beheren

De evaluatorbibliotheek is een centrale locatie waarmee u de details en status van uw evaluators kunt bekijken. U kunt gecureerde evaluators van Microsoft bekijken en beheren.

Tip

U kunt aangepaste evaluators gebruiken via de promptstroom-SDK. Zie Evalueren met de promptstroom-SDK voor meer informatie.

De evaluatorbibliotheek maakt ook versiebeheer mogelijk. U kunt verschillende versies van uw werk vergelijken, eerdere versies herstellen indien nodig en gemakkelijker samenwerken met anderen.

Als u de evaluatorbibliotheek in AI Studio wilt gebruiken, gaat u naar de evaluatiepagina van uw project en selecteert u het tabblad Evaluator-bibliotheek.

U kunt de naam van de evaluator selecteren voor meer informatie. U kunt de naam, beschrijving en parameters zien en alle bestanden controleren die zijn gekoppeld aan de evaluator. Hier volgen enkele voorbeelden van door Microsoft samengestelde evaluators:

- Voor prestatie- en kwaliteits evaluators die door Microsoft zijn samengesteld, kunt u de aantekeningsprompt bekijken op de detailpagina. U kunt deze prompts aanpassen aan uw eigen use-case door de parameters of criteria te wijzigen op basis van uw gegevens en doelstellingen met de promptstroom-SDK. U kunt bijvoorbeeld Groundedness-Evaluator selecteren en het prompty-bestand controleren waarin wordt weergegeven hoe we de metrische gegevens berekenen.

- Voor risico- en veiligheids evaluators die door Microsoft zijn samengesteld, kunt u de definitie van de metrische gegevens bekijken. U kunt bijvoorbeeld de self-harm-related-content-evaluator selecteren en leren wat het betekent en hoe Microsoft de verschillende ernstniveaus voor deze veiligheidsmetriek bepaalt

Volgende stappen

Meer informatie over het evalueren van uw generatieve AI-toepassingen:

- Evalueer uw generatieve AI-apps via de speeltuin

- De evaluatieresultaten weergeven

- Meer informatie over technieken voor schadebeperking.

- Transparantienotitie voor veiligheidsevaluaties van Azure AI Studio.

Feedback

Binnenkort beschikbaar: In de loop van 2024 zullen we GitHub-problemen geleidelijk uitfaseren als het feedbackmechanisme voor inhoud en deze vervangen door een nieuw feedbacksysteem. Zie voor meer informatie: https://aka.ms/ContentUserFeedback.

Feedback verzenden en weergeven voor