Wat is Azure Content Moderator?

Belangrijk

Azure Content Moderator wordt in februari 2024 afgeschaft en wordt in februari 2027 buiten gebruik gesteld. Het wordt vervangen door Azure AI Content Safety, dat geavanceerde AI-functies en verbeterde prestaties biedt.

Azure AI Content Safety is een uitgebreide oplossing die is ontworpen om schadelijke door de gebruiker gegenereerde en AI gegenereerde inhoud in toepassingen en services te detecteren. Azure AI Content Safety is geschikt voor veel scenario's, zoals online marketplaces, gamingbedrijven, platforms voor sociale berichten, zakelijke mediabedrijven en aanbieders van K-12-onderwijsoplossingen. Hier volgt een overzicht van de functies en mogelijkheden:

- Api's voor tekst- en afbeeldingsdetectie: scan tekst en afbeeldingen op seksuele inhoud, geweld, haat en zelfbeschadiging met meerdere ernstniveaus.

- Content Safety Studio: een onlinehulpprogramma dat is ontworpen om mogelijk aanstootgevende, riskante of ongewenste inhoud te verwerken met behulp van onze nieuwste ML-modellen voor con tentmodus ration. Het biedt sjablonen en aangepaste werkstromen waarmee gebruikers hun eigen con tentmodus rationsystemen kunnen bouwen.

- Taalondersteuning: Azure AI Content Safety ondersteunt meer dan 100 talen en is specifiek getraind op Engels, Duits, Japans, Spaans, Frans, Italiaans, Portugees en Chinees.

Azure AI Content Safety biedt een robuuste en flexibele oplossing voor uw con tentmodus rationbehoeften. Door over te schakelen van Content Moderator naar Azure AI Content Safety, kunt u profiteren van de nieuwste hulpprogramma's en technologieën om ervoor te zorgen dat uw inhoud altijd wordt gecontroleerd op uw exacte specificaties.

Meer informatie over Azure AI Content Safety en ontdek hoe deze uw strategie voor con tentmodus ration kan uitbreiden.

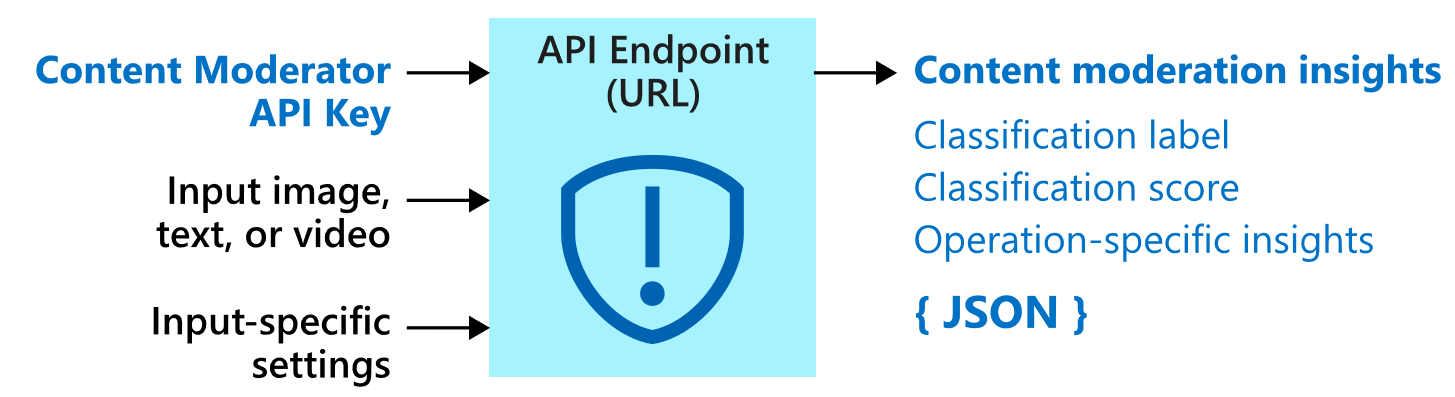

Azure Content Moderator is een AI-service waarmee u inhoud kunt afhandelen die mogelijk aanstootgevend, riskant of anderszins ongewenst is. Het bevat de ai-service voor con tentmodus ration waarmee tekst, afbeeldingen en video's worden gescand en inhoudsvlagmen automatisch worden toegepast.

U kunt software toevoegen voor het filteren van inhoud aan uw app om te voldoen aan de regelgeving of om de beoogde omgeving voor gebruikers te behouden.

Deze documentatie bevat de volgende artikeltypen:

- Quickstarts zijn aan de slag-instructies om u te begeleiden bij het indienen van aanvragen bij de service.

- Instructiegidsen bevatten instructies voor het gebruik van de service op specifiekere of aangepaste manieren.

- Concepten bieden uitgebreide uitleg over de servicefunctionaliteit en -functies.

Volg een trainingsmodule voor Content Moderator voor een meer gestructureerde benadering.

Waar het wordt gebruikt

Hieronder vindt u enkele scenario's waarin een softwareontwikkelaar of -team een service nodig hebben om toezicht te houden op content:

- Onlinemarktplaatsen die toezicht willen houden op productcatalogi en andere door gebruikers gegenereerde inhoud.

- Gamingbedrijven die toezicht willen houden op door gebruikers gegenereerde gameartefacten en chatruimten.

- Platforms voor sociale berichten die toezicht willen houden op afbeeldingen, tekst en video's die door gebruikers worden toegevoegd.

- Grote mediabedrijven die gecentraliseerd toezicht implementeren voor hun inhoud.

- Leveranciers van oplossingen voor lager en voortgezet onderwijs die willen filteren op inhoud die ongepast is voor leerlingen en docenten.

Belangrijk

U kunt Content Moderator niet gebruiken om illegale afbeeldingen van kindermisbruik te detecteren. Gekwalificeerde organisaties kunnen echter het scherm PhotoDNA Cloud Service gebruiken voor dit type inhoud.

De inhoud ervan

De Content Moderator-service bestaat uit verschillende webservice-API's die beschikbaar zijn via zowel REST-aanroepen als een SDK voor .NET.

Beheer-API's

De Content Moderator-service omvat Beheer-API’s, waarmee inhoud wordt gecontroleerd op materiaal dat mogelijk ongeschikt of aanstootgevend is.

In de volgende tabel worden de verschillende typen Beheer-API's beschreven.

| API-groep | Beschrijving |

|---|---|

| Teksttoezicht | Hiermee wordt tekst gescand op aanstootgevende inhoud, expliciet of suggestief seksuele inhoud, grof taalgebruik en persoonlijk gegevens. |

| Aangepaste terminologielijsten | Hiermee wordt tekst vergeleken met een aangepaste lijst met termen, naast de ingebouwde termen. U kunt aangepaste lijsten gebruiken om inhoud te blokkeren of toe te staan volgens uw eigen beleidsregels voor inhoud. |

| Afbeeldingstoezicht | Hiermee worden afbeeldingen gescand op erotische of racistische inhoud, wordt tekst in afbeeldingen gedetecteerd met de OCR-functie (optische tekenherkenning) en worden gezichten gedetecteerd. |

| Aangepaste afbeeldingslijsten | Hiermee worden afbeeldingen vergeleken met een aangepaste lijst van afbeeldingen. U kunt aangepaste afbeeldingslijsten gebruiken om te filteren op exemplaren van veelvoorkomende terugkerende inhoud die u niet opnieuw wilt classificeren. |

| Videotoezicht | Hiermee worden video's gescand op erotische of racistische inhoud en worden tijdmarkeringen voor deze inhoud geretourneerd. |

Gegevensprivacy en -beveiliging

Net als bij alle Azure AI-services moeten ontwikkelaars die de Content Moderator-service gebruiken, rekening houden met het beleid van Microsoft voor klantgegevens. Zie de pagina Azure AI-services in het Vertrouwenscentrum van Microsoft voor meer informatie.

Volgende stappen

- Voltooi een quickstart voor een clientbibliotheek of REST API om de basisscenario's in code te implementeren.