Notitie

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen u aan te melden of de directory te wijzigen.

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen de mappen te wijzigen.

Belangrijk

Items die in dit artikel zijn gemarkeerd (preview) zijn momenteel beschikbaar als openbare preview. Deze preview wordt aangeboden zonder een service level agreement en we raden deze niet aan voor productieworkloads. Bepaalde functies worden mogelijk niet ondersteund of hebben mogelijk beperkte mogelijkheden. Zie Aanvullende gebruiksvoorwaarden voor Microsoft Azure previews voor meer informatie.

Met deze GitHub Action kun je de offline evaluatie van Microsoft Foundry Agents in je CI/CD-pijplijnen uitvoeren. Het is ontworpen om het offline evaluatieproces te stroomlijnen, zodat u potentiële problemen kunt identificeren en verbeteringen kunt aanbrengen voordat u een update naar productie publiceert.

Als u deze actie wilt gebruiken, geeft u een gegevensset op met testquery's en een lijst met evaluators. Met deze actie worden uw agents aangeroepen met de query's, worden de evaluaties uitgevoerd en wordt een overzichtsrapport gegenereerd.

Features

- Agent Evaluation: Automatiseer de evaluatie vooraf van Microsoft Foundry-agents in uw CI/CD-werkstroom.

- Evaluators: Gebruik alle evaluators uit de Foundry-evaluatorcatalogus.

- Statistische analyse: evaluatieresultaten omvatten betrouwbaarheidsintervallen en test op statistische significantie om te bepalen of wijzigingen zinvol zijn en niet vanwege willekeurige variatie.

Categorieën van evaluatoren

- Agent-evaluators: proces- en systeem evaluators voor agentwerkstromen.

- RAG-evaluators: Evalueren end-to-end- en ophaalprocessen in RAG-systemen.

- Risico- en veiligheidsbeoordelaars: Beoordelen risico's en veiligheidsproblemen in oplossingen.

- General purpose evaluators: Kwaliteitsevaluatie zoals samenhang en vloeiendheid.

- OpenAI-gebaseerde graders: Gebruik van OpenAI-graders, inclusief tekenreekscontrole, tekstvergelijking, score-/labelmodel.

- Custom-evaluators: Definieer uw eigen aangepaste evaluators met behulp van Python code of LLM-as-a-judge-patronen.

Vereiste voorwaarden

- Een project. Zie Maak een project voor meer informatie.

- Een Foundry-agent.

Aanbeveling

De aanbevolen manier om te verifiëren is door gebruik te maken van Microsoft Entra ID, zodat u veilig verbinding kunt maken met uw Azure-resources. U kunt het verificatieproces automatiseren met behulp van de actie Azure Login GitHub. Zie Azure aanmeldingsactie met OpenID Connect voor meer informatie.

Hoe AI-agent evaluaties in te stellen

Invoer voor AI-agentevaluaties

Parameterwaarden

| Naam | Vereist? | Description |

|---|---|---|

| azure-ai-project-eindpunt | Ja | Eindpunt van uw Microsoft Foundry-Project. Als u deze waarde wilt vinden, opent u uw project in de Foundry-portal en kopieert u het eindpunt op de overzichtspagina . |

| implementatienaam | Ja | De naam van een Azure AI-modelimplementatie die moet worden gebruikt voor evaluatie. Zoek bestaande implementaties onder Modellen en eindpunten in de Foundry-portal. |

| gegevenspad | Ja | Pad naar het gegevensbestand met de beoordelaars en invoeropdrachten voor evaluaties. |

| agent-ids | Ja | ID van een of meer agents om te evalueren in het formaat agent-name:version (bijvoorbeeld my-agent:1 of my-agent:1,my-agent:2). Meerdere agents worden door komma's gescheiden en vergeleken met statistische testresultaten. |

| basislijn-agent-id | Nee. | Id van de basislijnagent die moet worden vergeleken bij het evalueren van meerdere agents. Als deze niet is opgegeven, wordt de eerste agent gebruikt. |

Opmerking

Als u uw agent-id en versie wilt vinden, opent u uw project in de Foundry-portal, gaat u naar Agents, selecteert u uw agent en kopieert u de agent-id in het detailvenster. De versie is het versienummer van de implementatie (bijvoorbeeld my-agent:1).

Gegevensbestand

Het invoergegevensbestand moet een JSON-bestand met de volgende structuur zijn:

| Veld | Typologie | Vereist? | Description |

|---|---|---|---|

| naam | touw | Ja | Naam van de evaluatiegegevensset. |

| Beoordelaars | string[] | Ja | Lijst met te gebruiken evaluatornamen. Bekijk de lijst met beschikbare evaluators in de evaluatorcatalogus van uw project in De Foundry-portal: Build > Evaluaties > Evaluator-catalogus. |

| gegevens | object[] | Ja | Matrix van invoerobjecten met query en optionele evaluatorvelden zoals ground_truth, context. Automatisch toegewezen aan beoordelaars; gebruik data_mapping om te overschrijven. |

| openai_graders | object | Nee. | Configuratie voor op OpenAI gebaseerde evaluators (label_model, score_model, string_check, enzovoort). |

| evaluator_parameters | object | Nee. | Evaluatiespecifieke initialisatieparameters (bijvoorbeeld drempelwaarden, aangepaste instellingen). |

| gegevenskoppeling | object | Nee. | Aangepaste gegevensveldtoewijzingen (automatisch gegenereerd op basis van gegevens indien niet opgegeven). |

Eenvoudig voorbeeldgegevensbestand

{

"name": "test-data",

"evaluators": [

"builtin.fluency",

"builtin.task_adherence",

"builtin.violence"

],

"data": [

{

"query": "Tell me about Tokyo disneyland"

},

{

"query": "How do I install Python?"

}

]

}

Aanvullende voorbeeldgegevensbestanden

| Bestandsnaam | Description |

|---|---|

| dataset-tiny.json | Gegevensset met een klein aantal testquery's en evaluators. |

| dataset.json | Gegevensset met alle ondersteunde evaluatortypen en voldoende query's voor berekening van betrouwbaarheidsinterval en statistische test. |

| dataset-builtin-evaluators.json | Voorbeeld van ingebouwde Foundry-evaluatoren (bijvoorbeeld coherentie, vloeiendheid, relevantie, gebondenheid, metriekwaarden). |

| dataset-openai-graders.json | Voorbeeld van op OpenAI gebaseerde graders (labelmodellen, scoremodellen, overeenkomsten met tekst, tekenreekscontroles). |

| dataset-custom-evaluators.json | Aangepast evaluator voorbeeld met evaluatorparameters. |

| dataset-data-mapping.json | Voorbeeld van gegevenstoewijzing waarin wordt getoond hoe u automatische veldtoewijzingen overschrijft met aangepaste kolomnamen van gegevens. |

Werkstroom voor evaluaties van AI-agents

Als u de GitHub-actie wilt gebruiken, voegt u de GitHub-actie toe aan uw CI/CD-werkstromen. Geef de triggercriteria op, zoals bij doorvoeren en de bestandspaden om uw geautomatiseerde werkstromen te activeren.

Aanbeveling

Als u de kosten wilt minimaliseren, moet u niet elke doorvoering evalueren.

In dit voorbeeld ziet u hoe u ai-agentevaluatie kunt uitvoeren wanneer u verschillende agents vergelijkt met behulp van agent-id's.

name: "AI Agent Evaluation"

on:

workflow_dispatch:

push:

branches:

- main

permissions:

id-token: write

contents: read

jobs:

run-action:

runs-on: ubuntu-latest

steps:

- name: Checkout

uses: actions/checkout@v4

- name: Azure login using Federated Credentials

uses: azure/login@v2

with:

client-id: ${{ vars.AZURE_CLIENT_ID }}

tenant-id: ${{ vars.AZURE_TENANT_ID }}

subscription-id: ${{ vars.AZURE_SUBSCRIPTION_ID }}

- name: Run Evaluation

uses: microsoft/ai-agent-evals@v3-beta

with:

# Replace placeholders with values for your Foundry Project

azure-ai-project-endpoint: "<your-ai-project-endpoint>"

deployment-name: "<your-deployment-name>"

agent-ids: "<your-ai-agent-ids>"

data-path: ${{ github.workspace }}/path/to/your/data-file

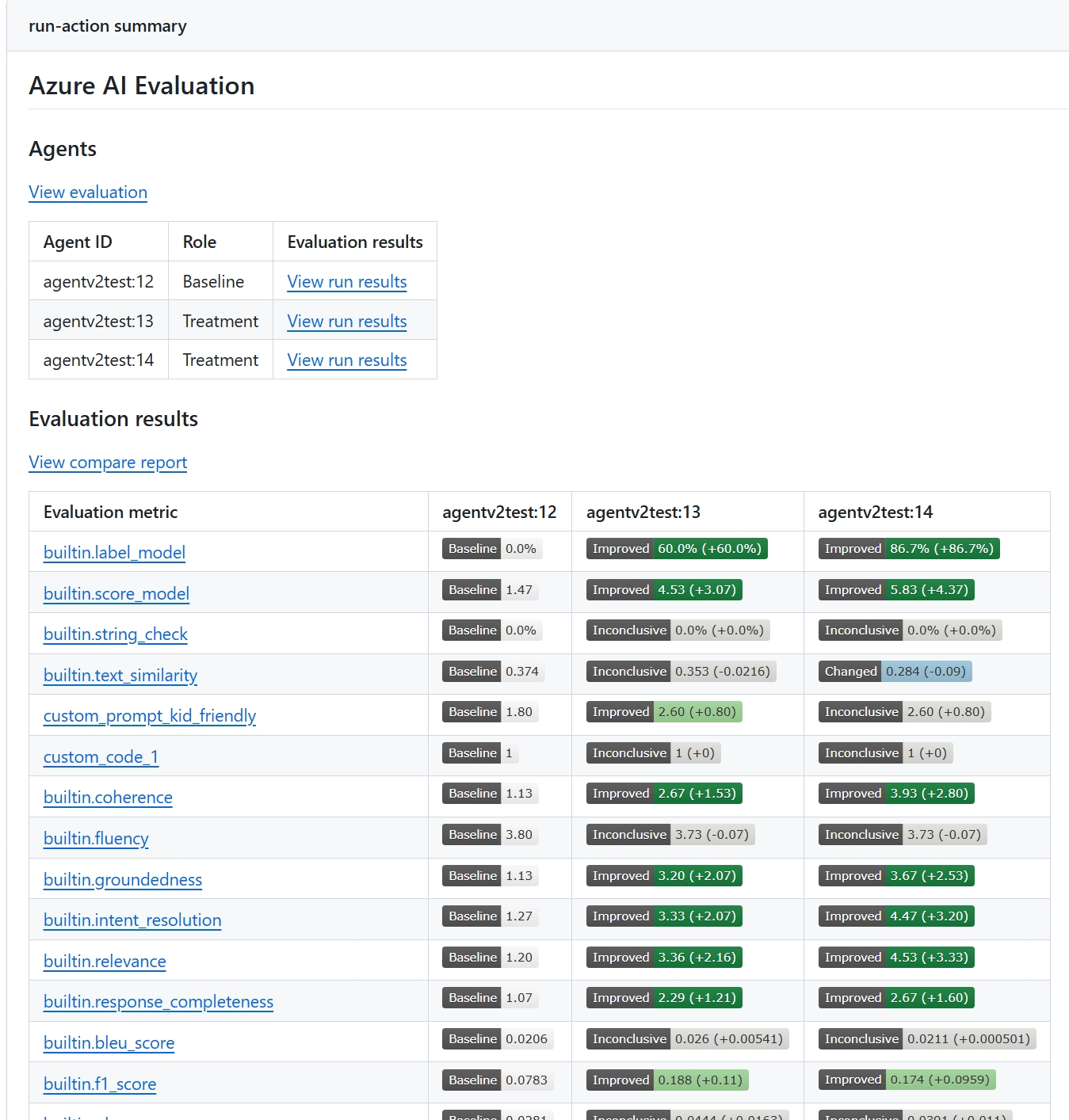

Uitvoer van AI-agentevaluaties

Evaluatieresultaten worden uitgevoerd in de samenvattingssectie voor elke AI-evaluatie-GitHub-actie die wordt uitgevoerd onder Actions in GitHub. In het rapport worden evaluatiescores weergegeven voor elke metrische waarde, betrouwbaarheidsintervallen en , wanneer u meerdere agents evalueert, een paarsgewijze statistische vergelijking die aangeeft of verschillen zinvol of binnen willekeurige variatie zijn.

In de volgende schermopname ziet u een voorbeeldrapport waarin twee agents worden vergeleken.