Notatka

Dostęp do tej strony wymaga autoryzacji. Może spróbować zalogować się lub zmienić katalogi.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

DOTYCZY: Wszystkich poziomów zarządzania API

Punkty końcowe modeli AI wdrożone w Microsoft Foundry można zaimportować do instancji usługi API Management jako interfejsy API. Użyj zasad bramy sztucznej inteligencji i innych funkcji w usłudze API Management, aby uprościć integrację, zwiększyć czytelność i zwiększyć kontrolę nad punktami końcowymi modelu.

Aby dowiedzieć się więcej na temat zarządzania interfejsami API sztucznej inteligencji w usłudze API Management, zobacz:

Opcje zgodności klienta

Usługa API Management obsługuje następujące opcje zgodności klienta dla interfejsów API sztucznej inteligencji firmy Microsoft Foundry. Podczas importowania interfejsu API przy użyciu kreatora wybierz opcję odpowiednią dla wdrożenia modelu. Opcja określa, jak klienci wywołują interfejs API i jak instancja API Management kieruje żądania do narzędzia Foundry.

Azure OpenAI: zarządzanie usługą Azure OpenAI we wdrożeniach modeli rozwiązania Microsoft Foundry.

Klienci nazywają wdrożenie w punkcie końcowym,

/openaitakim jak/openai/deployments/my-deployment/chat/completions. Ścieżka żądania zawiera nazwę wdrożenia. Użyj tej opcji, jeśli narzędzie Foundry obejmuje tylko wdrożenia modelu Usługi Azure OpenAI.Azure AI: zarządzanie punktami końcowymi modelu w rozwiązaniu Microsoft Foundry udostępnianymi za pośrednictwem interfejsu API wnioskowania modelu AI platformy Azure.

Klienci odwołują się do wdrożenia w punkcie końcowym

/models, takim jak/my-model/models/chat/completions. Treść żądania zawiera nazwę wdrożenia. Użyj tej opcji, jeśli chcesz elastycznie przełączać się między modelami udostępnianymi za pośrednictwem interfejsu API inferencji modeli AI Azure a modelami wdrożonymi w Azure OpenAI w ramach Foundry Models.Azure OpenAI v1 — zarządzanie wdrożeniami modeli usługi Azure OpenAI w rozwiązaniu Microsoft Foundry przy użyciu interfejsu API usługi Azure OpenAI w wersji 1.

Klienci wywołają wdrożenie w punkcie końcowym modelu usługi Azure OpenAI w wersji 1, takim jak

openai/v1/my-model/chat/completions. Treść żądania zawiera nazwę wdrożenia.

Wymagania wstępne

Istniejąca instancja usługi API Management. Utwórz go, jeśli jeszcze tego nie zrobiono.

Narzędzie Foundry w ramach subskrypcji z wdrożonym co najmniej jednym modelem. Przykłady obejmują modele wdrożone w rozwiązaniu Microsoft Foundry lub Azure OpenAI.

Jeśli chcesz włączyć buforowanie semantyczne dla interfejsu API, zobacz Włączanie buforowania semantycznego odpowiedzi dla wymagań wstępnych.

Jeśli chcesz wymusić kontrole bezpieczeństwa zawartości w interfejsie API, zobacz Wymuszanie kontroli bezpieczeństwa zawartości dla żądań LLM pod kątem wymagań wstępnych.

Importowanie interfejsu API usługi Microsoft Foundry przy użyciu portalu

Wykonaj poniższe kroki, aby zaimportować interfejs API AI do usługi API Management.

Podczas importowania interfejsu API usługa API Management automatycznie konfiguruje:

- Operacje dla każdego z punktów końcowych REST API.

- Tożsamość przypisana przez system z niezbędnymi uprawnieniami dostępu do wdrożenia narzędzia Foundry.

- Zasób backend oraz zasada set-backend-service, które kierują żądania API do punktu końcowego usług Azure AI Services.

- Uwierzytelnianie w zapleczu przy użyciu przypisanej przez system tożsamości zarządzanej wystąpienia.

- (opcjonalnie) Zasady ułatwiające monitorowanie interfejsu API i zarządzanie nim.

Aby zaimportować interfejs API usługi Microsoft Foundry do usługi API Management:

W portalu Azure przejdź do swojej instancji API Management.

W menu po lewej stronie, w obszarze APIs, wybierz APIs>+ Dodaj API.

W obszarze Utwórz z zasobu Azure wybierz pozycję Microsoft Foundry.

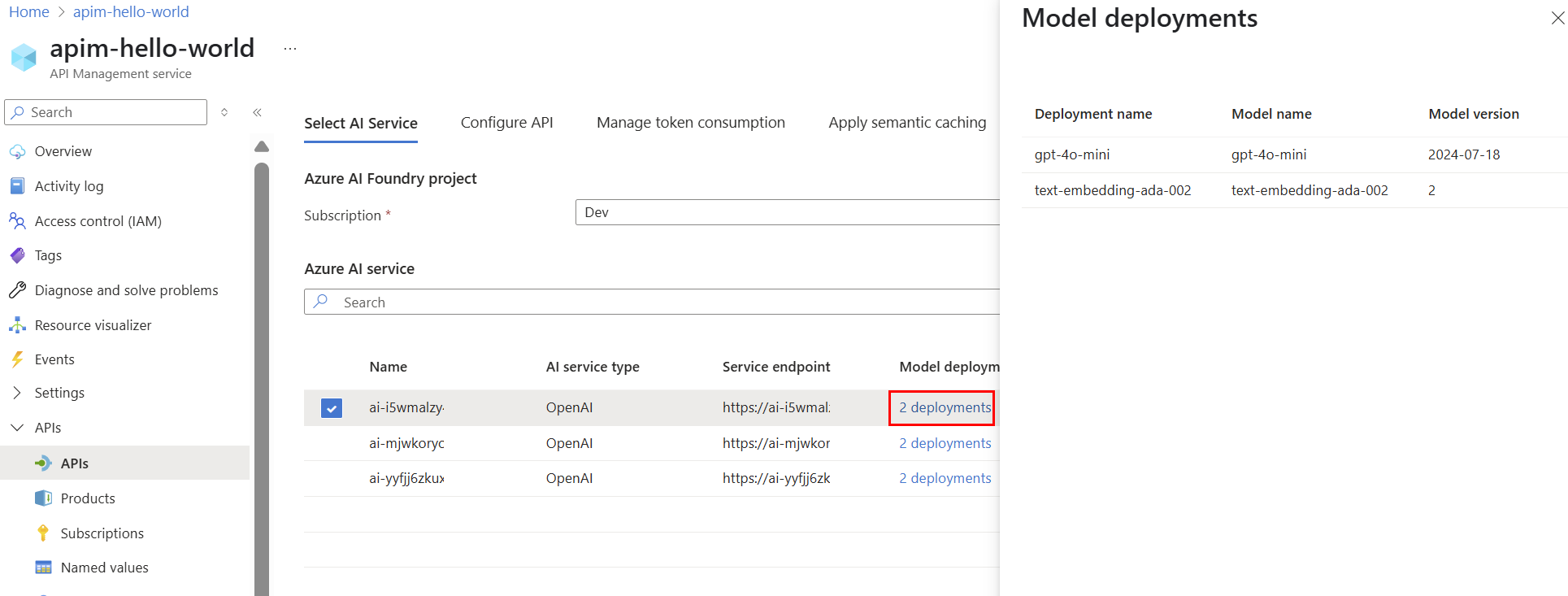

Na karcie Wybierz usługę AI :

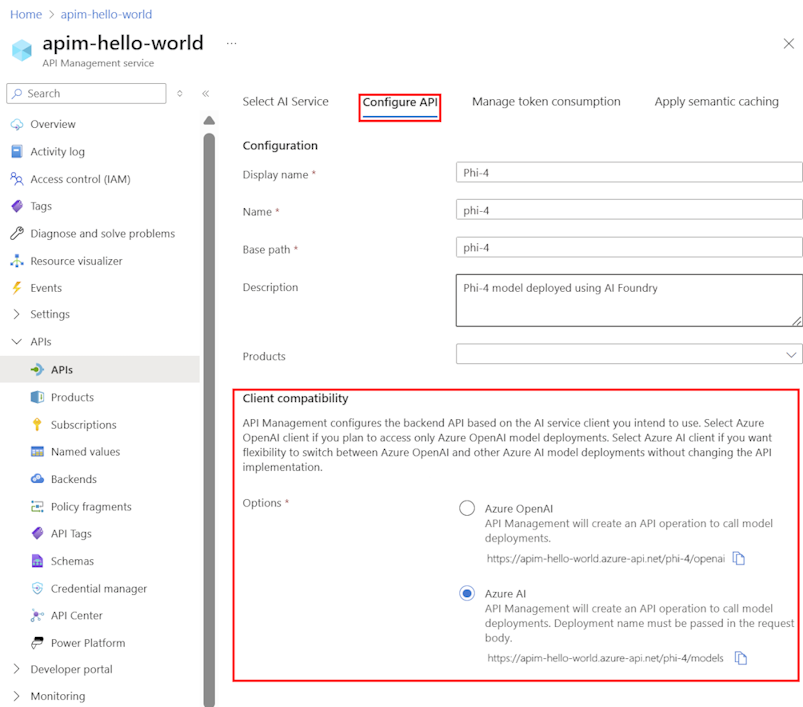

Na karcie Konfiguracja API :

Wprowadź nazwę wyświetlaną i opcjonalny opis dla API.

W ścieżce podstawowej wprowadź ścieżkę używaną przez wystąpienie usługi API Management w celu uzyskania dostępu do punktu końcowego wdrożenia.

Opcjonalnie wybierz co najmniej jeden produkt do skojarzenia z interfejsem API.

W obszarze Zgodność klienta wybierz jedną z następujących opcji na podstawie typów klientów, które mają być obsługiwane. Aby uzyskać więcej informacji, zobacz Opcje zgodności klienta .

- Azure OpenAI — wybierz tę opcję, jeśli klienci muszą uzyskiwać dostęp tylko do Azure OpenAI we wdrożeniach modelu Microsoft Foundry.

- Azure AI — wybierz tę opcję, jeśli klienci muszą uzyskać dostęp do innych modeli w usłudze Microsoft Foundry.

- Azure OpenAI v1 — wybierz tę opcję, jeśli chcesz użyć interfejsu API Usługi Azure OpenAI w wersji 1 z wdrożeniami modelu Foundry.

Wybierz Dalej.

Na karcie Zarządzanie użyciem tokenu opcjonalnie wprowadź ustawienia lub zaakceptuj wartości domyślne, które definiują następujące zasady, aby ułatwić monitorowanie interfejsu API i zarządzanie nim:

Na karcie Zastosuj buforowanie semantyczne opcjonalnie wprowadź ustawienia lub zaakceptuj ustawienia domyślne, które definiują zasady, aby pomóc zoptymalizować wydajność i zmniejszyć opóźnienie dla interfejsu API:

Na karcie Bezpieczeństwo zawartości sztucznej inteligencji opcjonalnie wprowadź ustawienia lub zaakceptuj wartości domyślne, aby skonfigurować usługę Bezpieczeństwa zawartości usługi Azure AI w celu blokowania monitów o niebezpieczną zawartość:

Wybierz opcję Przejrzyj.

Po zweryfikowaniu ustawień w portalu wybierz pozycję Utwórz.

Testuj API sztucznej inteligencji

Aby upewnić się, że interfejs API sztucznej inteligencji działa zgodnie z oczekiwaniami, przetestuj go w konsoli testowej usługi API Management.

Wybierz interfejs API utworzony w poprzednim kroku.

Wybierz kartę Test.

Wybierz operację zgodną z wdrożeniem modelu. Na stronie są wyświetlane pola parametrów i nagłówków.

Wprowadź parametry i nagłówki zgodnie z potrzebami. W zależności od operacji może być konieczne skonfigurowanie lub zaktualizowanie treści żądania. Oto podstawowa przykładowa treść żądania dla operacji uzupełniania czatu:

{ "model": "any", "messages": [ { "role": "user", "content": "Help me plan a trip to Paris", "max_tokens": 100 } ] }Uwaga / Notatka

W konsoli testowej usługa API Management automatycznie dodaje nagłówek Ocp-Apim-Subscription-Key i ustawia klucz subskrypcji dla wbudowanej subskrypcji z pełnym dostępem. Ten klucz zapewnia dostęp do każdego interfejsu API w instancji zarządzania API. Aby opcjonalnie wyświetlić nagłówek Ocp-Apim-Subscription-Key , wybierz ikonę "oko" obok żądania HTTP.

Wybierz Wyślij.

Po pomyślnym zakończeniu testu zaplecze odpowiada z pomyślnym kodem odpowiedzi HTTP i pewnymi danymi. Odpowiedź zawiera dane użycia tokenu, które ułatwiają monitorowanie użycia tokenów modelu językowego i zarządzanie nim.

Treści powiązane

- Ograniczenia importu interfejsu API

- Importowanie specyfikacji interfejsu OpenAPI

- Importuj API SOAP

- Importowanie interfejsu API protokołu SOAP i przekształcenie go na interfejs API REST

- Importowanie API usługi aplikacji

- Importowanie interfejsu API aplikacji kontenera

- Importuj WebSocket API

- Zaimportuj GraphQL API

- Importowanie schematu GraphQL i konfigurowanie rozpoznawania pól

- Zaimportuj API aplikacji funkcji

- Importowanie interfejsu API aplikacji logicznej

- Importowanie usługi Service Fabric

- Importowanie interfejsu API rozwiązania Microsoft Foundry

- Importuj interfejs API Azure OpenAI

- Importowanie interfejsu API LLM

- Importowanie interfejsu API OData

- Eksportowanie interfejsu API REST jako serwera MCP

- Uwidacznia istniejący serwer MCP

- Importowanie interfejsu API agenta A2A

- Importowanie metadanych sap OData

- Zaimportuj API gRPC

- Edytowanie interfejsu API