Notatka

Dostęp do tej strony wymaga autoryzacji. Może spróbować zalogować się lub zmienić katalogi.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

Ważna

Ta funkcja jest obecnie dostępna w wersji zapoznawczej i jest dołączona do planu Microsoft Defender dla usług AI. W trakcie korzystania z wersji zapoznawczej nie są naliczane dodatkowe opłaty za skanowanie modelu sztucznej inteligencji. Jednak włączenie planu Defender dla usług AI może wiązać się z kosztami związanymi z funkcjami ochrony przed zagrożeniami. Ciągłe włączenie funkcji skanowania modelu sztucznej inteligencji w ramach Defender dla usług AI nie jest gwarantowane, gdy stanie się ogólnie dostępna, a wymagania dotyczące licencjonowania mogą ulec zmianie. W takim przypadku powiadomienie zostanie wysłane przed wyłączeniem funkcji z opcjami ponownego włączenia jej w ramach odpowiedniej licencji.

W miarę jak organizacje coraz częściej używają modeli sztucznej inteligencji do napędzania automatyzacji, szczegółowych informacji i inteligentnego podejmowania decyzji, zespoły ds. zabezpieczeń potrzebują wglądu i kontroli w celu oceny bezpieczeństwa i zgodności modeli sztucznej inteligencji wprowadzanych do swoich środowisk. Modele te często mają szeroki dostęp do danych i infrastruktury. Bez tych możliwości coraz trudniej jest wymusić standardy wewnętrzne.

Microsoft Defender dla Chmury Defender dla zabezpieczeń sztucznej inteligencji obsługuje skanowanie modeli sztucznej inteligencji. Skanowanie modelu sztucznej inteligencji zapewnia proaktywne wykrywanie niebezpiecznych lub złośliwych artefaktów i stale monitoruje modele pod kątem ryzyka w całym cyklu życia sztucznej inteligencji.

Zabezpieczenia modelu sztucznej inteligencji automatycznie skanują modele sztucznej inteligencji pod kątem zagrożeń bezpieczeństwa, takich jak osadzone złośliwe oprogramowanie, niebezpieczne operatory i ujawnione wpisy tajne, zanim te modele dotrą do środowiska produkcyjnego. Zintegrowana bezpośrednio z Azure Machine Learning i potokami CI/CD, usługa przedstawia wyniki w czasie rzeczywistym i umożliwia podejmowanie naprawczych działań, dzięki czemu zespoły mogą zapobiegać ryzykownym modelom na wczesnym etapie procesu rozwoju.

Korzystając z zabezpieczeń modelu sztucznej inteligencji, zespoły ds. zabezpieczeń mogą skanować niestandardowe modele sztucznej inteligencji przekazywane do obszarów roboczych i rejestrów Azure Machine Learning w celu zidentyfikowania zagrożeń, takich jak osadzone złośliwe oprogramowanie, niebezpieczne operatory i ujawnione wpisy tajne. Defender dla Chmury przedstawia wyniki, zapewniając zespołom wgląd w wyniki zabezpieczeń wraz z ocenami ważności, wskazówkami korygowania i odpowiednimi metadanymi modelu w celu zapewnienia efektywnego klasyfikacji i priorytetyzacji. Deweloperzy mogą również wyzwalać skanowania modeli podczas etapów kompilacji lub wydania przy użyciu narzędzi CLI zintegrowanych z potokami Azure DevOps lub GitHub, co umożliwia skanowanie statyczne i wczesne wykrywanie ryzyka, zanim modele trafią do produkcji.

Wymagania wstępne

- Musisz mieć subskrypcję Azure, która zawiera modele sztucznej inteligencji zarejestrowane w rejestrach lub przestrzeniach roboczych Azure Machine Learning (Azure Machine Learning).

Uwaga / Notatka

Obszary robocze i rejestry korzystające z łącza prywatnego nie są obsługiwane.

Włączenie planu zarządzania stanem zabezpieczeń Defender dla Chmury.

Należy włączyć ochronę przed zagrożeniami dla usług sztucznej inteligencji i element zabezpieczenia modelu AI planu.

Wymagane uprawnienia: aby włączyć plan, musisz posiadać uprawnienia na poziomie Owner lub Contributor na zasobach Azure Machine Learning.

Obsługiwane formaty plików modelu:

Pickle (.pkl),HDF5 (.h5),TorchScript (.pt),ONNX (.onnx),SafeTensors (.safetensors),TensorFlow SavedModel / TFLite (FlatBuffers),NumPy (.npy),Arrow, MsgPack, dill, joblib,PMML, JSON, POJO, MOJO, GGUF.Limit rozmiaru pliku: 10 GB. Nie można skanować plików modelu większych niż 10 GB.

Skanowanie odbywa się raz w tygodniu.

Lokalizowanie wszystkich modeli sztucznej inteligencji w środowisku

Zaloguj się do portalu Azure.

Wyszukaj i wybierz Microsoft Defender dla Chmury.

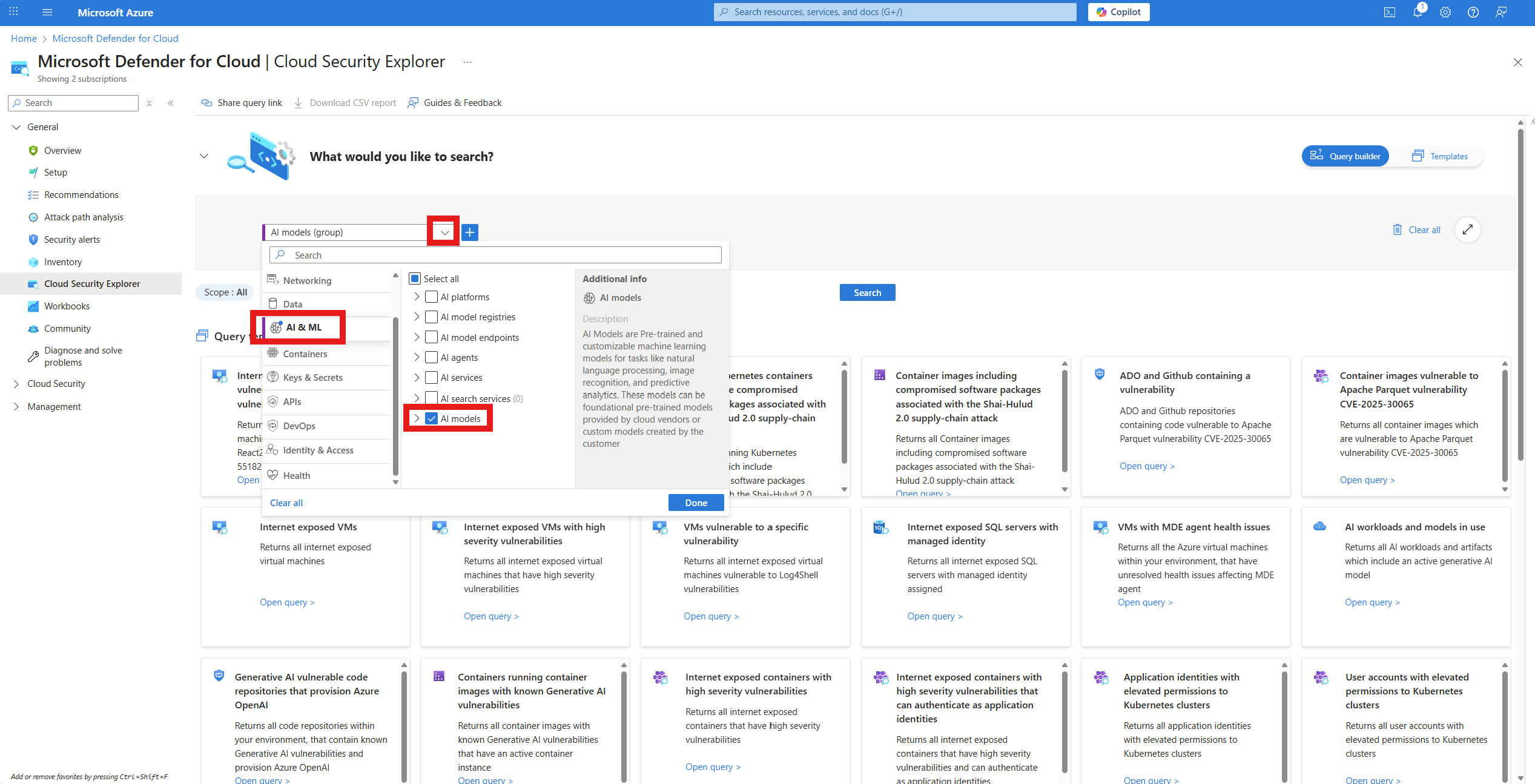

Wybierz pozycję Cloud Security Explorer.

Wybierz AI i uczenie maszynowe>Modele AI.

Wybierz opcję Gotowe.

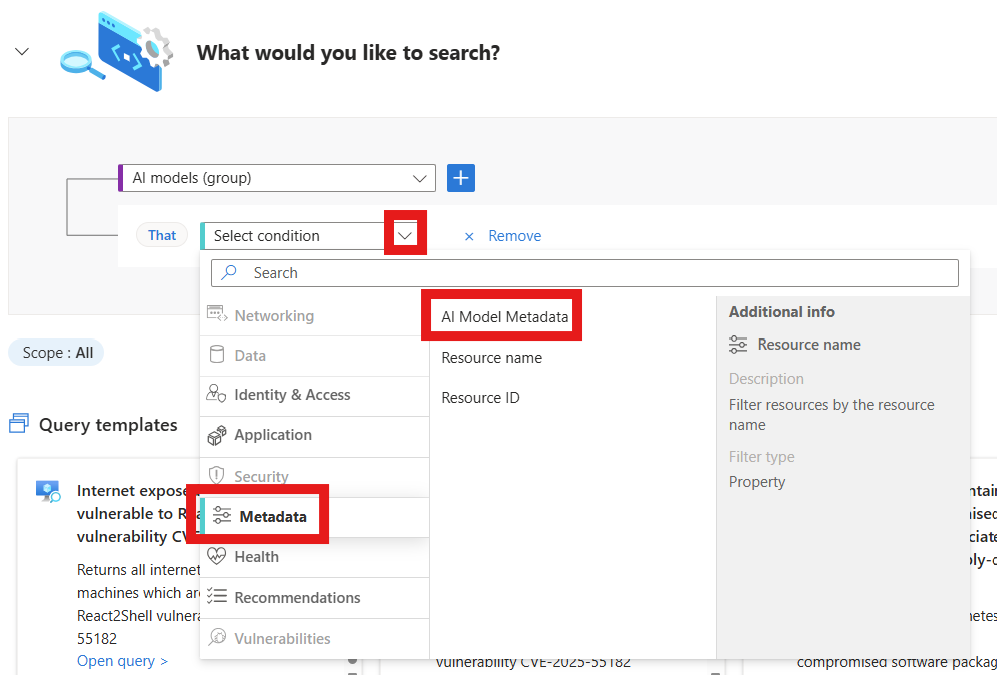

Wybierz opcję +.

Wybierz Metadane>Metadane modelu AI.

Wybierz Wyszukaj.

W Eksploratorze zabezpieczeń w chmurze są wyświetlane wszystkie modele sztucznej inteligencji w danym środowisku. Możesz wybrać widok szczegółów, aby wyświetlić więcej informacji na temat każdego wybranego modelu.

Lokalizowanie modeli sztucznej inteligencji z wykryciami problemów dotyczących bezpieczeństwa

Użyj Eksploratora zabezpieczeń w chmurze, aby znaleźć modele sztucznej inteligencji, które mają aktywne wyniki zabezpieczeń.

Wykonaj kroki 1–7 z sekcji Lokalizowanie wszystkich modeli sztucznej inteligencji w środowisku .

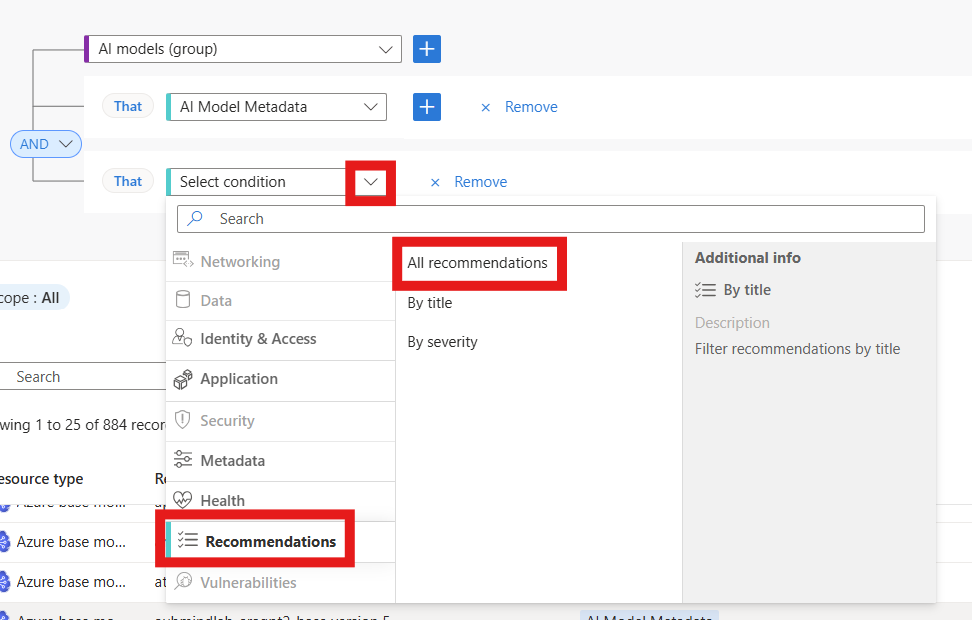

Wybierz opcję +.

Wybierz pozycję Zalecenia>Wszystkie zalecenia.

Wybierz Wyszukaj.

Eksplorator zabezpieczeń w chmurze wyświetla wszystkie modele sztucznej inteligencji w twoim środowisku, które mają aktywne wyniki zabezpieczeń. Wybierz szczegóły widoku , aby wyświetlić więcej informacji na temat każdego modelu i skojarzonych wyników.

Lokalizowanie wszystkich modeli sztucznej inteligencji w środowisku

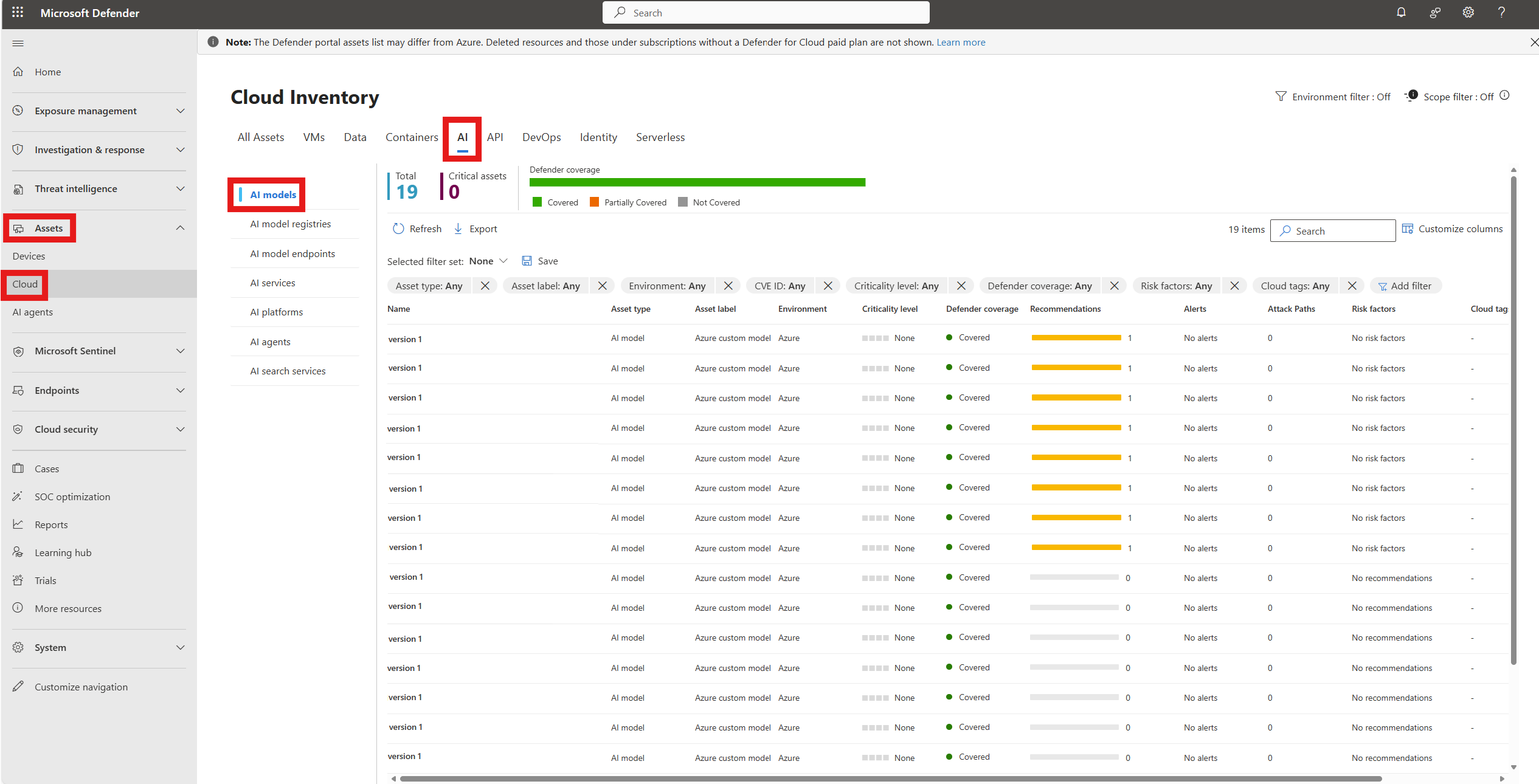

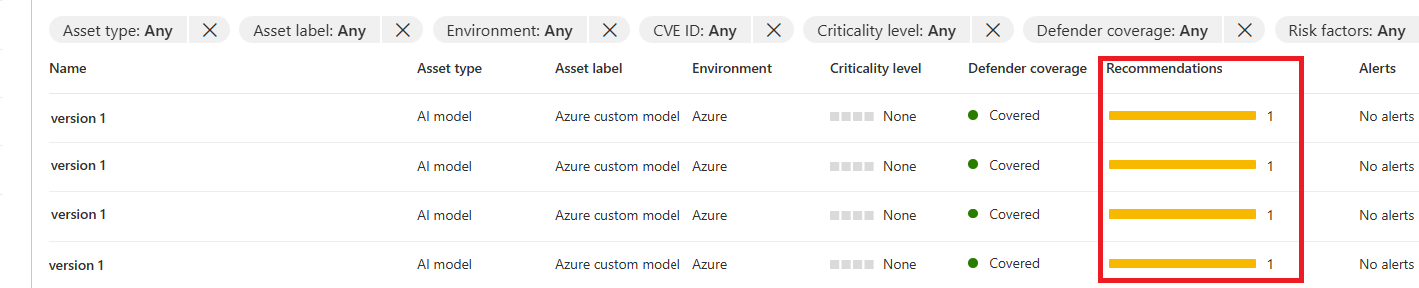

Strona Defender Portal Assets zawiera kompleksowy widok wszystkich modeli sztucznej inteligencji w danym środowisku.

Zaloguj się do portalu Microsoft Defender.

Przejdź do Zasoby>Chmura>AI>Modele AI.

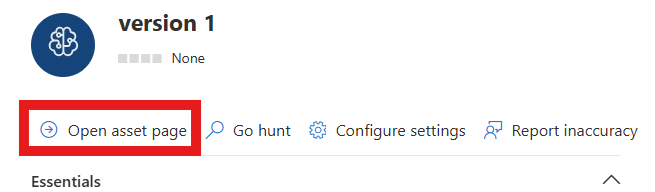

Wybierz model AI z zaleceniami.

Wybierz pozycję Otwórz stronę zasobu.

Wybierz Zalecenia dotyczące zabezpieczeń> odpowiedniego zalecenia.

Należy przejrzeć i skorygować problem z bezpieczeństwem zgodnie z potrzebami.

Rekomendację można również zarządzać w portalu Azure.