Nuta

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zalogować się lub zmienić katalogi.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

Z tego artykułu dowiesz się, jak utworzyć konfigurację platformy Apache Spark dla programu Synapse Studio. Utworzoną konfiguracją Apache Spark można zarządzać w sposób ustandaryzowany, a podczas tworzenia definicji notesu lub zadania dla Apache Spark można wybrać konfigurację, którą chce się używać z pulą Apache Spark. Po jej wybraniu zostaną wyświetlone szczegóły konfiguracji.

Tworzenie konfiguracji platformy Apache Spark

Konfiguracje niestandardowe można tworzyć z różnych punktów wejścia, na przykład ze strony konfiguracji Apache Spark istniejącej puli Spark.

Tworzenie niestandardowych konfiguracji w konfiguracjach platformy Apache Spark

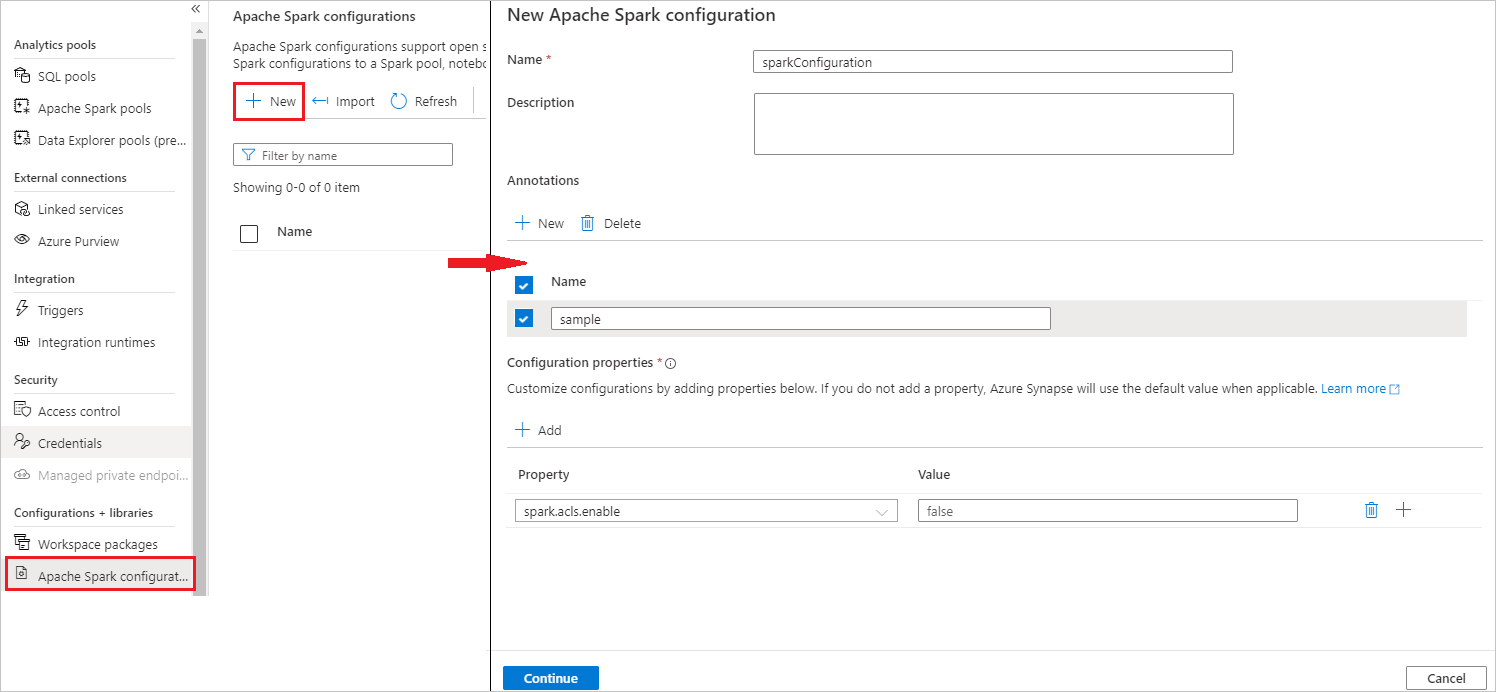

Wykonaj poniższe kroki, aby utworzyć konfigurację platformy Apache Spark w programie Synapse Studio.

Wybierz Zarządzaj>konfiguracjami Apache Spark.

Wybierz przycisk Nowy , aby utworzyć nową konfigurację platformy Apache Spark, lub wybierz pozycję Importuj lokalny plik .json do obszaru roboczego.

Nowa strona konfiguracji platformy Apache Spark zostanie otwarta po wybraniu przycisku Nowy .

W polu Nazwa możesz wprowadzić preferowaną i prawidłową nazwę.

W polu Opis możesz wprowadzić w nim opis.

W obszarze Adnotacje można dodawać adnotacje, klikając przycisk Nowy , a także usunąć istniejące adnotacje, wybierając i klikając przycisk Usuń .

W obszarze Właściwości konfiguracji dostosuj konfigurację, klikając przycisk Dodaj , aby dodać właściwości. Jeśli nie dodasz właściwości, usługa Azure Synapse będzie używać wartości domyślnej, jeśli ma to zastosowanie.

Wybierz przycisk Kontynuuj .

Wybierz przycisk Utwórz , gdy walidacja zakończyła się pomyślnie.

Opublikuj wszystko.

Uwaga

Funkcja przekazywania konfiguracji platformy Apache Spark została usunięta.

Należy zaktualizować pule korzystające z załadowanej konfiguracji. Zaktualizuj konfigurację puli, wybierając istniejącą konfigurację lub tworząc nową konfigurację w menu konfiguracji platformy Apache Spark dla puli. Jeśli nie wybrano nowej konfiguracji, zadania dla tych pul będą uruchamiane przy użyciu konfiguracji domyślnej w ustawieniach systemu Spark.

Tworzenie konfiguracji platformy Apache Spark w istniejącej puli platformy Apache Spark

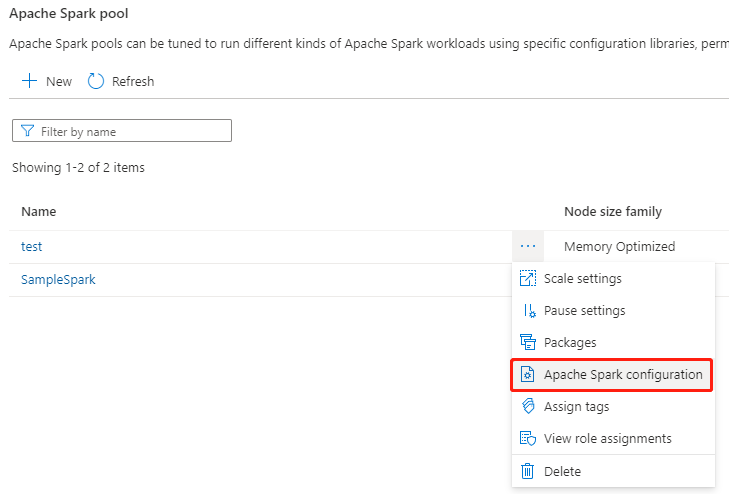

Wykonaj poniższe kroki, aby utworzyć konfigurację platformy Apache Spark w istniejącej puli platformy Apache Spark.

Wybierz istniejącą pulę Apache Spark i kliknij przycisk "..." aby wybrać akcję.

Wybierz konfigurację platformy Apache Spark na liście zawartości.

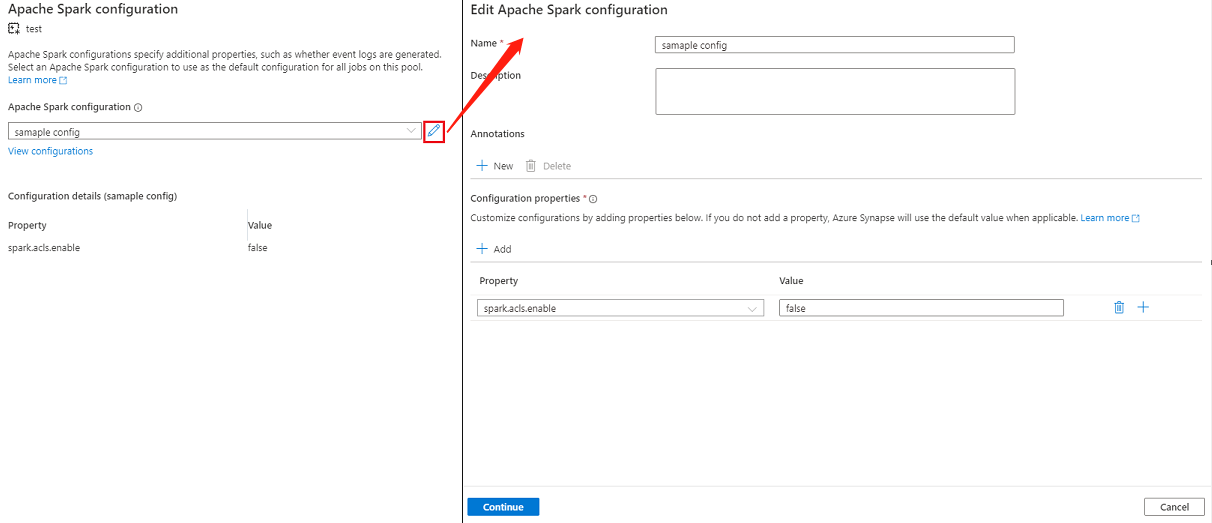

W przypadku konfiguracji platformy Apache Spark możesz wybrać już utworzoną konfigurację z listy rozwijanej lub wybrać pozycję +Nowy , aby utworzyć nową konfigurację.

Jeśli wybierzesz pozycję +Nowy, zostanie otwarta strona Konfiguracja platformy Apache Spark i możesz utworzyć nową konfigurację, wykonując kroki opisane w temacie Tworzenie konfiguracji niestandardowych w konfiguracjach platformy Apache Spark.

Jeśli wybierzesz istniejącą konfigurację, szczegóły konfiguracji zostaną wyświetlone w dolnej części strony, możesz również wybrać przycisk Edytuj , aby edytować istniejącą konfigurację.

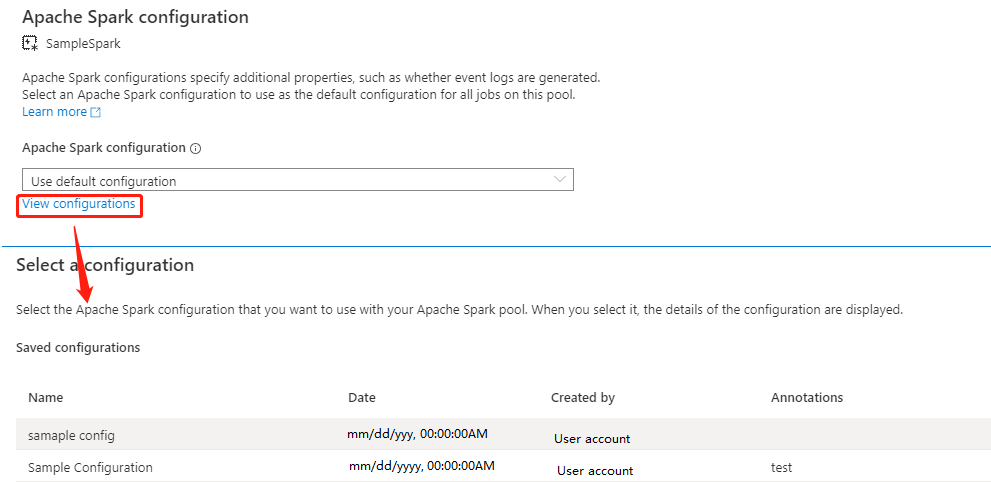

Wybierz pozycję Wyświetl konfiguracje , aby otworzyć stronę Wybierz konfigurację . Wszystkie konfiguracje zostaną wyświetlone na tej stronie. Możesz wybrać konfigurację, której chcesz użyć w tej puli platformy Apache Spark.

Wybierz przycisk Zastosuj , aby zapisać akcję.

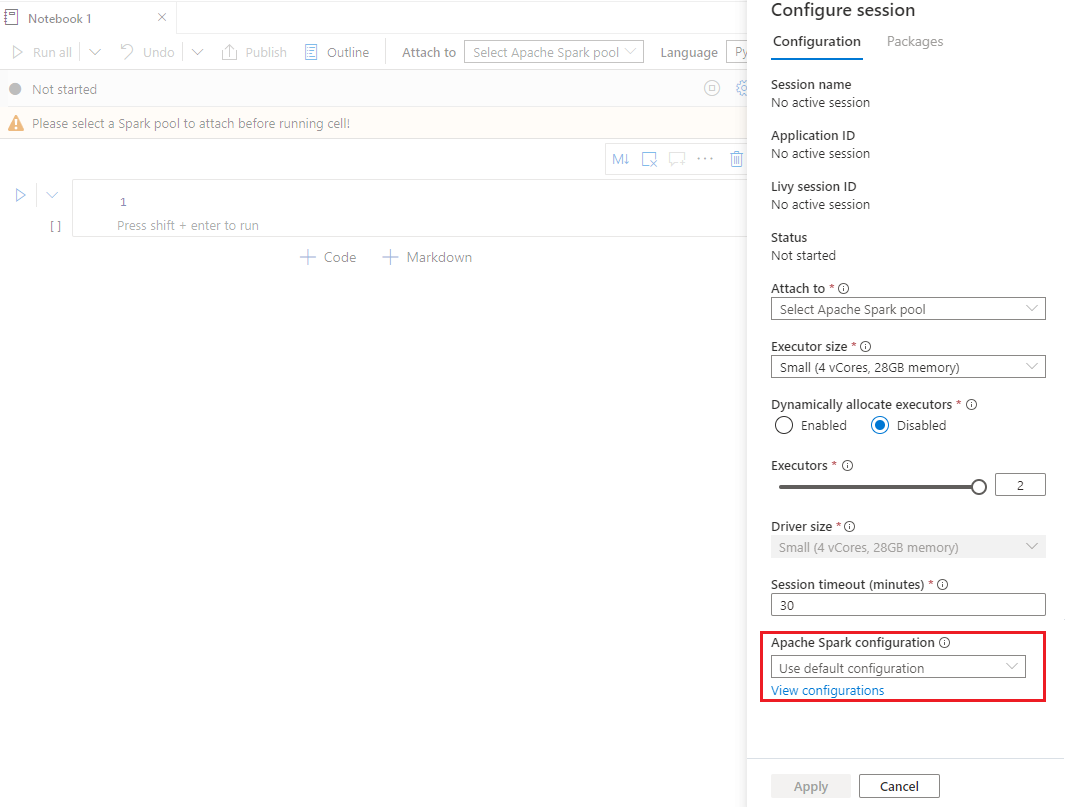

Utwórz konfigurację Apache Spark w sesji konfiguracji notesu

Jeśli podczas tworzenia notesu musisz użyć niestandardowej konfiguracji platformy Apache Spark, możesz ją utworzyć i skonfigurować w sesji konfiguracji, wykonując poniższe kroki.

Utwórz nowy/Otwórz istniejący Notatnik.

Otwórz właściwości tego notesu.

Wybierz pozycję Konfiguruj sesję , aby otworzyć stronę Konfigurowanie sesji.

Przewiń w dół stronę konfiguracji sesji, w obszarze Konfiguracja platformy Apache Spark rozwiń menu rozwijane, następnie możesz wybrać przycisk Nowy, aby utworzyć nową konfigurację. Możesz też wybrać istniejącą konfigurację, jeśli wybierzesz istniejącą konfigurację, wybierz ikonę Edytuj , aby przejść do strony Edytowanie konfiguracji platformy Apache Spark, aby edytować konfigurację.

Wybierz pozycję Wyświetl konfiguracje , aby otworzyć stronę Wybierz konfigurację . Wszystkie konfiguracje zostaną wyświetlone na tej stronie. Możesz wybrać konfigurację, której chcesz użyć.

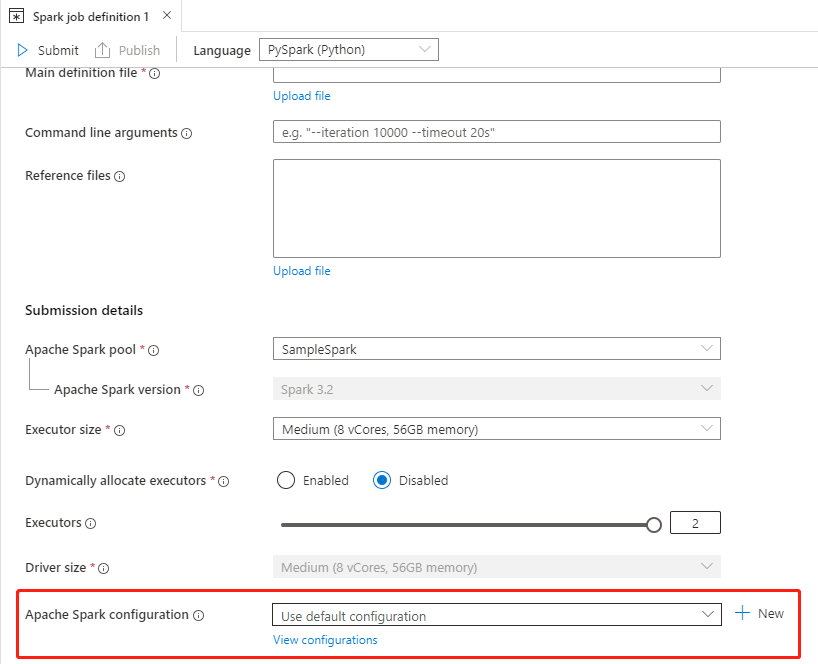

Tworzenie konfiguracji platformy Apache Spark w definicjach zadań platformy Apache Spark

Podczas tworzenia definicji zadania platformy Spark należy użyć konfiguracji platformy Apache Spark, którą można utworzyć, wykonując poniższe kroki:

Utwórz nową/Otwórz istniejącą definicję zadania platformy Apache Spark.

W przypadku konfiguracji platformy Apache Spark możesz wybrać przycisk Nowy , aby utworzyć nową konfigurację. Możesz też wybrać istniejącą konfigurację w menu rozwijanym, jeśli wybierzesz istniejącą konfigurację, wybierz ikonę Edytuj , aby przejść do strony Edytowanie konfiguracji platformy Apache Spark, aby edytować konfigurację.

Wybierz pozycję Wyświetl konfiguracje , aby otworzyć stronę Wybierz konfigurację . Wszystkie konfiguracje zostaną wyświetlone na tej stronie. Możesz wybrać konfigurację, której chcesz użyć.

Uwaga

Jeśli konfiguracja Apache Spark w notesie i zestawieniu zadania Apache Spark nie wprowadza żadnych szczególnych ustawień, podczas uruchamiania zadania zostanie zastosowana domyślna konfiguracja.

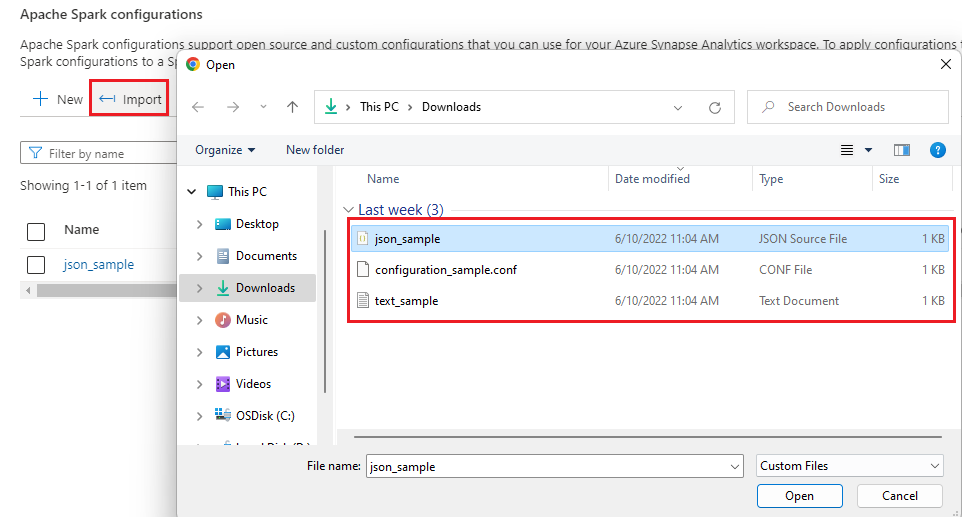

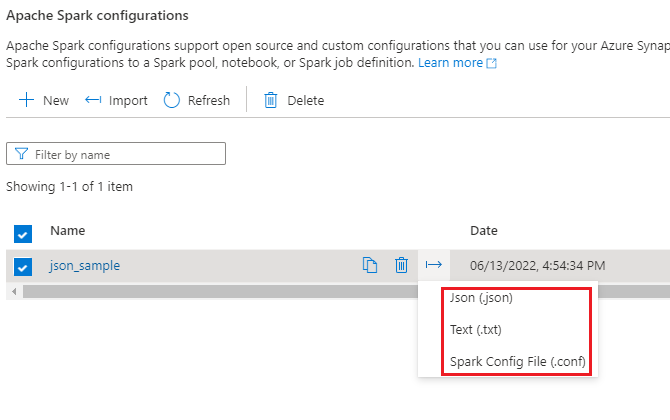

Importowanie i eksportowanie konfiguracji platformy Apache Spark

Możesz zaimportować konfigurację .txt/.conf/.json w trzech formatach, a następnie przekonwertować ją na artefakt i opublikować. Można również eksportować do jednego z tych trzech formatów.

Zaimportuj konfigurację .txt/.conf/.json z lokalizacji lokalnej.

Eksportuj konfigurację .txt/.conf/.json do lokalizacji lokalnej.

W przypadku pliku konfiguracji .txt oraz pliku konfiguracji .conf można zapoznać się z następującymi przykładami:

spark.synapse.key1 sample

spark.synapse.key2 true

# spark.synapse.key3 sample2

W przypadku .json pliku konfiguracji można zapoznać się z następującymi przykładami:

{

"configs": {

"spark.synapse.key1": "hello world",

"spark.synapse.key2": "true"

},

"annotations": [

"Sample"

]

}

Uwaga

Synapse Studio będzie nadal obsługiwać pliki konfiguracyjne oparte na Terraform lub Bicep.