Proteções de segurança e conformidade de dados do Microsoft Purview para o Microsoft Copilot

Orientações de licenciamento do Microsoft 365 para conformidade com & de segurança

Utilize o Microsoft Purview para mitigar e gerir os riscos associados à utilização de IA e implementar controlos de proteção e governação correspondentes.

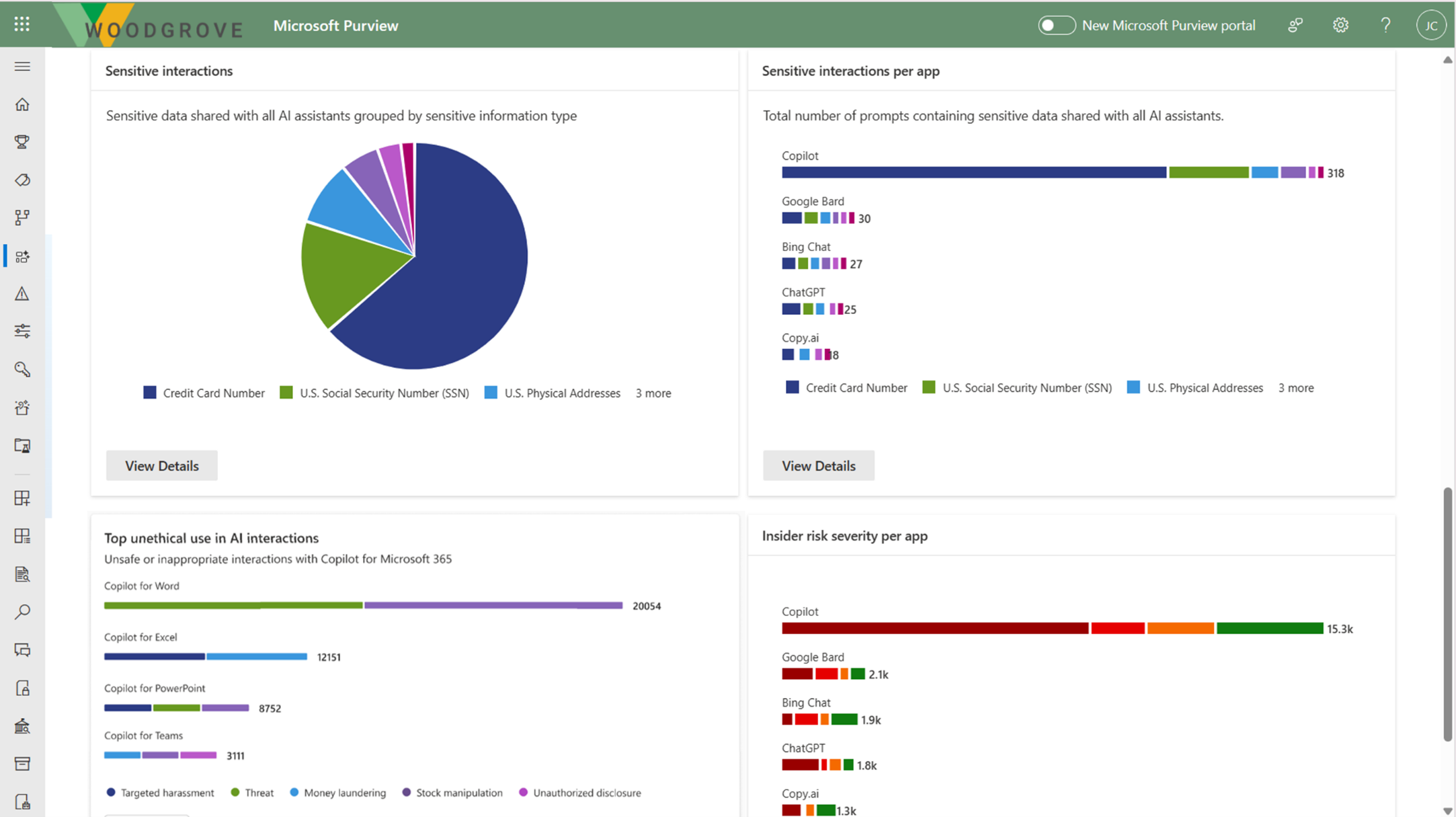

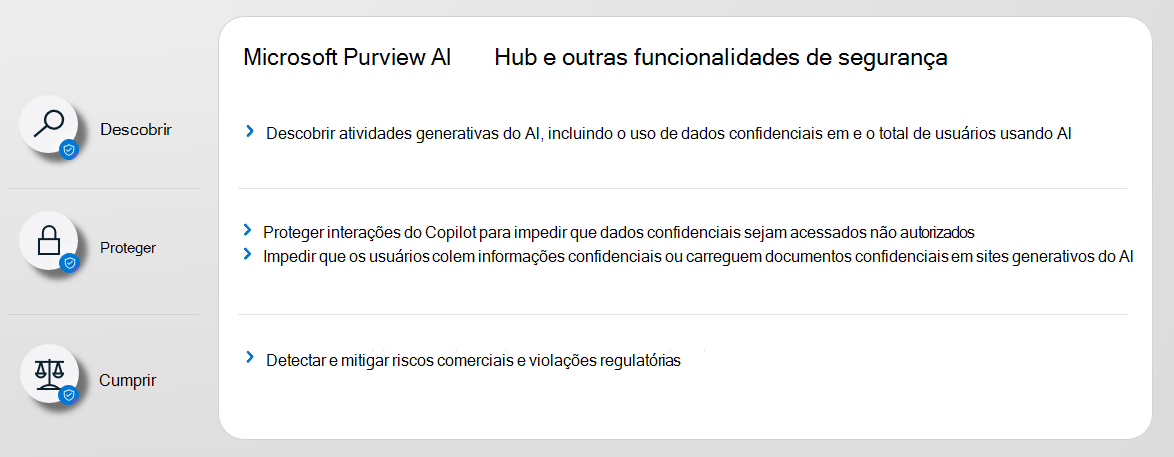

O Hub de IA do Microsoft Purview está atualmente em pré-visualização e fornece ferramentas gráficas e relatórios fáceis de utilizar para obter rapidamente informações sobre a utilização de IA na sua organização. As políticas com um clique ajudam-no a proteger os seus dados e a cumprir os requisitos regulamentares.

Utilize o hub de IA em conjunto com outras capacidades do Microsoft Purview para reforçar a segurança e conformidade dos dados do Microsoft Copilot para Microsoft 365:

- Etiquetas de confidencialidade e conteúdo encriptado pelo Microsoft Purview Information Protection

- Classificação de dados

- Chave de Cliente

- Conformidade em comunicações

- Auditoria

- Pesquisa de conteúdo

- Descoberta eletrônica

- Retenção e exclusão

- Sistema de Proteção de Dados do Cliente

Observação

Para verificar se os planos de licenciamento da sua organização suportam estas capacidades, consulte a ligação de orientação de licenciamento na parte superior da página. Para obter informações de licenciamento para o Microsoft Copilot para o Microsoft 365 propriamente dito, consulte a descrição do serviço do Microsoft Copilot para Microsoft 365.

Utilize as secções seguintes para saber mais sobre o hub de IA e as capacidades do Microsoft Purview que fornecem controlos de conformidade e segurança de dados adicionais para acelerar a adoção da microsoft Copilot pela sua organização e outras aplicações de IA geradoras. Se não estiver familiarizado com o Microsoft Purview, também poderá encontrar uma descrição geral do produto útil: Saiba mais sobre o Microsoft Purview.

Para obter informações mais gerais sobre os requisitos de segurança e conformidade do Copilot para o Microsoft 365, consulte Dados, Privacidade e Segurança do Microsoft Copilot para Microsoft 365.

O Hub de IA do Microsoft Purview fornece informações, políticas e controlos para aplicações de IA

Observação

O Hub de IA do Microsoft Purview está atualmente em pré-visualização e sujeito a alterações.

O hub de IA do portal do Microsoft Purview ou do portal de conformidade do Microsoft Purview fornece uma localização de gestão central para o ajudar a proteger rapidamente os dados das aplicações de IA e a monitorizar proativamente a utilização de IA. Estas aplicações incluem o Microsoft Copilot para o Microsoft 365 e aplicações de IA a partir de módulos de linguagem grandes (LLMs) de terceiros.

O hub de IA oferece um conjunto de capacidades para que possa adotar a IA em segurança sem ter de escolher entre produtividade e proteção:

Informações e análises sobre a atividade de IA na sua organização

Políticas prontas a utilizar para proteger dados e evitar a perda de dados em pedidos de IA

Controlos de conformidade para aplicar políticas de armazenamento e processamento de dados ideais

Para obter uma lista de sites de IA de terceiros suportados, como os utilizados para Bard e ChatGPT, consulte Sites de IA suportados pelo Microsoft Purview para obter proteções de conformidade e segurança de dados.

Como utilizar o hub de IA

Para o ajudar a obter informações mais rapidamente sobre a utilização de IA e proteger os seus dados, o hub de IA fornece algumas políticas pré-configuradas que pode ativar com um único clique. Aguarde, pelo menos, 24 horas para que estas novas políticas recolham dados para apresentar os resultados no hub de IA ou reflita as alterações que fizer às predefinições.

Para começar a utilizar o hub de IA, pode utilizar o portal do Microsoft Purview ou o portal de conformidade do Microsoft Purview. Precisa de uma conta que tenha as permissões adequadas para a gestão da conformidade, como uma conta que seja membro da função de grupo Administrador de Conformidade do Microsoft Entra .

Dependendo do portal que estiver usando, navegue até um dos seguintes locais:

Iniciar sessão no portal> do Microsoft PurviewCartão do hub de IA (pré-visualização).

Se o cartão hub de IA (pré-visualização) não for apresentado, selecione Ver todas as soluções e, em seguida, selecione Hub de IA (pré-visualização) na secção Segurança de Dados .

Iniciar sessão no portal> de conformidade do Microsoft PurviewHub de IA (pré-visualização).

No Analytics, reveja a secção Introdução para saber mais sobre o hub de IA e as ações imediatas que pode efetuar. Selecione cada um deles para apresentar o painel de lista de opções para saber mais, tomar medidas e verificar o seu estado atual.

Ação Mais informações Ativar a Auditoria do Microsoft Purview A auditoria está ativada por predefinição para novos inquilinos, pelo que poderá já cumprir este pré-requisito. Se o fizer e os utilizadores já tiverem licenças atribuídas para a Copilot, começa a ver informações sobre as atividades do Copilot na secção análise de dados de IA mais abaixo na página. Instalar a extensão do browser Microsoft Purview Um pré-requisito para sites de IA de terceiros. Integrar dispositivos no Microsoft Purview Também um pré-requisito para sites de IA de terceiros. Expandir as suas informações para deteção de dados Políticas de um clique para recolher informações sobre utilizadores que visitam sites de IA geradores de terceiros e enviam informações confidenciais aos mesmos. A opção é a mesma que o botão Expandir as suas informações na secção Análise de dados de IA mais abaixo na página. Para obter mais informações sobre os pré-requisitos, veja Pré-requisitos do hub de IA.

Para obter mais informações sobre as políticas pré-configuradas que pode ativar, veja Políticas de um clique a partir do hub de IA.

Em seguida, reveja a secção Recomendações e decida se pretende implementar opções relevantes para o seu inquilino. Por exemplo:

- Selecione Ver detalhes para Obter assistência orientada para os regulamentos de IA que utilizam modelos regulamentares de mapeamento de controlo do Gestor de Conformidade.

- Selecione Ver detalhes para Proteger dados confidenciais referenciados em Respostas do Copilot para identificar conteúdos que foram referenciados pelo Microsoft Copilot para o Microsoft 365 e que não estão protegidos com uma etiqueta de confidencialidade.

Selecione Políticas no hub de IA, onde pode ativar rapidamente as políticas predefinidas para o ajudar a proteger dados confidenciais enviados para sites de IA geradores de terceiros e proteger os seus dados com etiquetas de confidencialidade. Para obter mais informações sobre estas políticas, veja Políticas de um clique no hub de IA. Tem de esperar pelo menos um dia para que os relatórios sejam preenchidos.

Em Recomendações e Fortificar a segurança de dados para IA , selecione Começar para saber mais, tomar medidas e verificar o seu estado atual.

Quando as suas políticas são criadas, incluindo as do Analytics, pode monitorizar o respetivo estado a partir desta página. Para editá-las, utilize a solução de gestão correspondente no portal. Por exemplo, para Controlar o comportamento não ético na IA, pode rever e remediar as correspondências da solução de Conformidade de Comunicações.

Selecione Explorador de atividades no hub de IA para ver os detalhes dos dados recolhidos das suas políticas. Selecionar Ver Detalhes a partir de qualquer um dos gráficos na página Análise ou na página Políticas também o direciona para o Explorador de atividades.

Estas informações mais detalhadas incluem atividade, carga de trabalho e aplicação, utilizador, data e hora e quaisquer tipos de informações confidenciais detetados.

Exemplos de atividades incluem interação de IA, Classificação carimbada, correspondência de regras DLP e visita de IA. Para obter mais informações sobre os eventos, veja Eventos do explorador de atividades.

Exemplos de aplicações incluem o Microsoft Copilot e Outra aplicação de IA.

Para o Microsoft Copilot para Microsoft 365, utilize estas políticas e informações em conjunto com proteções adicionais e capacidades de conformidade do Microsoft Purview.

Microsoft Purview reforça proteção de informações para Copilot

O Copilot utiliza controlos existentes para garantir que os dados armazenados no seu inquilino nunca são devolvidos ao utilizador ou utilizados por um modelo de linguagem grande (LLM) se o utilizador não tiver acesso a esses dados. Quando os dados têm etiquetas de confidencialidade da sua organização aplicadas ao conteúdo, existe uma camada adicional de proteção:

Quando um ficheiro é aberto no Word, Excel, PowerPoint ou, da mesma forma, é aberto um e-mail ou evento de calendário no Outlook, a sensibilidade dos dados é apresentada aos utilizadores na aplicação com o nome da etiqueta e as marcas de conteúdo (como texto de cabeçalho ou rodapé) que foram configurados para a etiqueta.

Quando a etiqueta de confidencialidade aplica encriptação, os utilizadores têm de ter o direito de utilização EXTRAIR, bem como VER, para que o Copilot devolva os dados.

Esta proteção estende-se aos dados armazenados fora do seu inquilino do Microsoft 365 quando são abertos numa aplicação do Office (dados em utilização). Por exemplo, armazenamento local, partilhas de rede e armazenamento na cloud.

Dica

Se ainda não o fez, recomendamos que ative as etiquetas de confidencialidade para o SharePoint e o OneDrive e também se familiarize com os tipos de ficheiro e as configurações de etiquetas que estes serviços podem processar. Quando as etiquetas de confidencialidade não estão ativadas para estes serviços, os ficheiros encriptados aos quais o Copilot para o Microsoft 365 pode aceder estão limitados aos dados em utilização a partir de aplicações do Office no Windows.

Para obter instruções, consulte Ativar etiquetas de confidencialidade para ficheiros do Office no SharePoint e no OneDrive.

Além disso, quando utiliza o chat baseado no Microsoft Copilot Graph (anteriormente Microsoft 365 Chat) que pode aceder a dados de um vasto leque de conteúdos, a sensibilidade dos dados etiquetados devolvidos pela Copilot para o Microsoft 365 torna-se visível para os utilizadores com a etiqueta de confidencialidade apresentada para citações e os itens listados na resposta. Ao utilizar o número de prioridade das etiquetas de confidencialidade definido no portal do Microsoft Purview ou no portal de conformidade do Microsoft Purview, a resposta mais recente em Copilot apresenta a etiqueta de confidencialidade de prioridade mais alta a partir dos dados utilizados para essa conversa copilot.

Embora os administradores de conformidade definam a prioridade de uma etiqueta de confidencialidade, um número de prioridade mais elevado geralmente indica uma maior sensibilidade do conteúdo, com permissões mais restritivas. Como resultado, as respostas copilot são etiquetadas com a etiqueta de confidencialidade mais restritiva.

Observação

Se os itens forem encriptados pelo Microsoft Purview Information Protection, mas não tiverem uma etiqueta de confidencialidade, o Microsoft Copilot para o Microsoft 365 também não devolverá estes itens aos utilizadores se a encriptação não incluir os direitos de utilização EXTRACT ou VIEW para o utilizador.

Se ainda não estiver a utilizar etiquetas de confidencialidade, consulte Introdução às etiquetas de confidencialidade.

Embora as políticas DLP ainda não suportem interações para o Microsoft Copilot para Microsoft 365, a classificação de dados para tipos de informações confidenciais e classificadores treináveis são suportadas para identificar dados confidenciais em pedidos do utilizador para Copilot e respostas.

Proteção copilot com herança de etiquetas de confidencialidade

Quando utiliza o Copilot para criar novos conteúdos com base num item que tenha uma etiqueta de confidencialidade aplicada, a etiqueta de confidencialidade do ficheiro de origem é herdada automaticamente, com as definições de proteção da etiqueta.

Por exemplo, um utilizador seleciona Rascunho com Copilot no Word e, em seguida, Referenciar um ficheiro. Ou um utilizador seleciona Criar apresentação a partir de um ficheiro no PowerPoint. O conteúdo de origem tem a etiqueta de confidencialidade Confidencial\Qualquer pessoa (sem restrições) aplicada e essa etiqueta está configurada para aplicar um rodapé que apresenta "Confidencial". O novo conteúdo é automaticamente identificado como Confidencial\Qualquer Pessoa (sem restrições) com o mesmo rodapé.

Para ver um exemplo disto em ação, veja a seguinte demonstração da sessão do Ignite 2023, Getting your enterprise ready for Microsoft 365 Copilot (Preparar a sua empresa para o Microsoft 365 Copilot). A demonstração mostra como a etiqueta de confidencialidade predefinida de Geral é substituída por uma etiqueta Confidencial quando um utilizador faz rascunhos com o Copilot e faz referência a um ficheiro etiquetado. A barra de informações no friso informa o utilizador de que o conteúdo criado pela Copilot resultou na aplicação automática da nova etiqueta:

Se forem utilizados vários ficheiros para criar novos conteúdos, a etiqueta de confidencialidade com a prioridade mais alta é utilizada para a herança de etiquetas.

Tal como acontece com todos os cenários de etiquetagem automática, o utilizador pode sempre substituir e substituir uma etiqueta herdada (ou remover, se não estiver a utilizar a etiquetagem obrigatória).

Proteção do Microsoft Purview sem etiquetas de confidencialidade

Mesmo que uma etiqueta de confidencialidade não seja aplicada ao conteúdo, os serviços e produtos poderão utilizar as capacidades de encriptação do serviço Azure Rights Management. Como resultado, o Copilot para Microsoft 365 ainda pode verificar os direitos de utilização VER e EXTRAIR antes de devolver dados e ligações para um utilizador, mas não existe nenhuma herança automática de proteção para novos itens.

Dica

Obterá a melhor experiência de utilizador quando utilizar sempre etiquetas de confidencialidade para proteger os seus dados e a encriptação é aplicada por uma etiqueta.

Exemplos de produtos e serviços que podem utilizar as capacidades de encriptação do serviço Azure Rights Management sem etiquetas de confidencialidade:

- Criptografia de Mensagem do Microsoft Purview

- Microsoft Information Rights Management (IRM)

- Conector do Microsoft Rights Management

- Microsoft Rights Management SDK

Para outros métodos de encriptação que não utilizam o serviço Azure Rights Management:

Os e-mails protegidos por S/MIME não serão devolvidos pelo Copilot e o Copilot não está disponível no Outlook quando um e-mail protegido por S/MIME está aberto.

Os documentos protegidos por palavra-passe não podem ser acedidos pela Copilot para Microsoft 365, a menos que já estejam abertos pelo utilizador na mesma aplicação (dados em utilização). As palavras-passe não são herdadas por um item de destino.

Tal como acontece com outros serviços do Microsoft 365, como a Deteção de Dados Eletrónicos e a pesquisa, os itens encriptados com a Chave de Cliente do Microsoft Purview ou a sua própria chave de raiz (BYOK) são suportados e elegíveis para serem devolvidos pela Copilot para o Microsoft 365.

O Microsoft Purview suporta a gestão de conformidade do Copilot

Utilize as capacidades de conformidade do Microsoft Purview para suportar os seus requisitos de risco e conformidade para o Copilot para o Microsoft 365.

As interações com o Copilot podem ser monitorizadas para cada utilizador no seu inquilino. Como tal, pode utilizar a classificação do Purview (tipos de informações confidenciais e classificadores treináveis), a pesquisa de conteúdos, a conformidade de comunicações, a auditoria, a Deteção de Dados Eletrónicos e as capacidades de retenção e eliminação automáticas através de políticas de retenção.

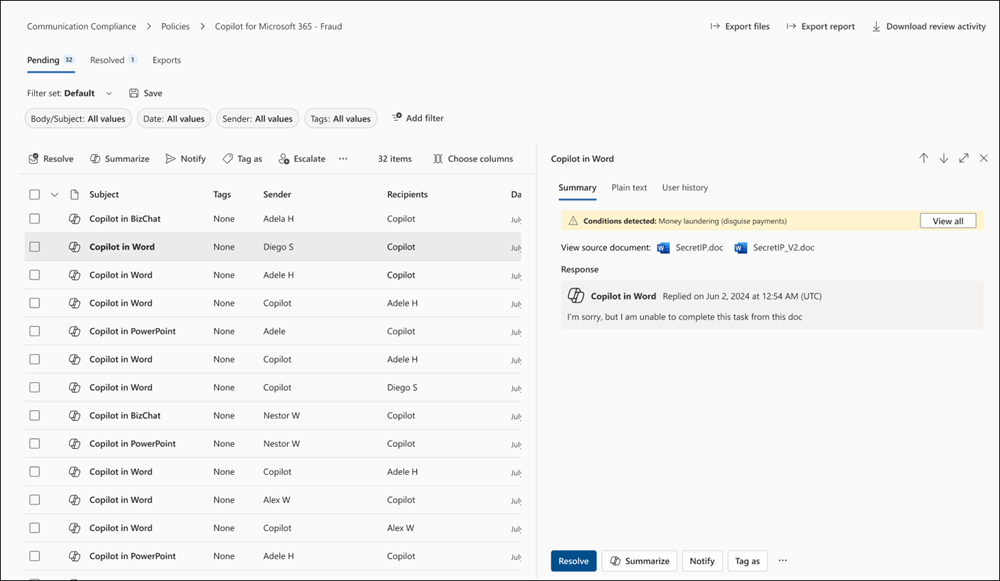

Para a conformidade de comunicação, pode analisar pedidos de utilizador e respostas copilot para detetar interações inadequadas ou arriscadas ou partilhar informações confidenciais. Para obter mais informações, consulte Configurar uma política de conformidade de comunicação para detetar para o Copilot para interações do Microsoft 365.

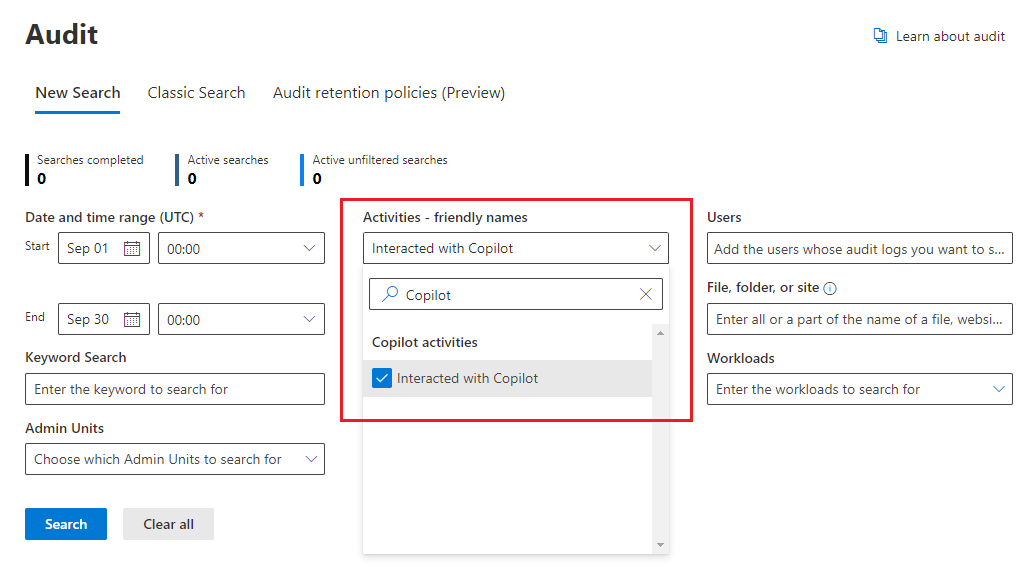

Para auditoria, os detalhes são capturados no registo de auditoria unificado quando os utilizadores interagem com o Copilot. Os eventos incluem como e quando os utilizadores interagem com o Copilot, no qual o serviço microsoft 365 ocorreu, e referências aos ficheiros armazenados no Microsoft 365 que foram acedidos durante a interação. Se estes ficheiros tiverem uma etiqueta de confidencialidade aplicada, também é capturada. Na solução auditoria do portal do Microsoft Purview ou do portal de conformidade do Microsoft Purview, selecione Atividades do Copilot e Interação com o Copilot. Também pode selecionar Copilot como uma carga de trabalho. Por exemplo, no portal de conformidade:

Para pesquisa de conteúdos, uma vez que os pedidos do utilizador para Copilot e as respostas da Copilot são armazenadas na caixa de correio de um utilizador, podem ser pesquisadas e obtidas quando a caixa de correio do utilizador é selecionada como a origem de uma consulta de pesquisa. Selecione e obtenha estes dados a partir da caixa de correio de origem ao selecionar a partir do construtor de consultas Adicionar condição>Tipo>igual a qualquer uma das> interaçõesAdicionar/Remover mais opções>Copilot.

Da mesma forma, para a Deteção de Dados Eletrónicos, utiliza o mesmo processo de consulta para selecionar caixas de correio e obter pedidos de utilizador para Copilot e respostas da Copilot. Depois de a coleção ser criada e criada na fase de revisão na Deteção de Dados Eletrónicos (Premium), estes dados estão disponíveis para realizar todas as ações de revisão existentes. Estas coleções e conjuntos de revisão podem, em seguida, ser colocados em espera ou exportados. Se precisar de eliminar estes dados, consulte Procurar e eliminar dados do Microsoft Copilot para o Microsoft 365.

Para políticas de retenção que suportam retenção e eliminação automáticas, os pedidos do utilizador ao Copilot e as respostas da Copilot são identificados pela localização chats do Teams e interações copilot. Anteriormente designado apenas conversas do Teams, os utilizadores não precisam de utilizar o chat do Teams para que esta política se aplique aos mesmos. Todas as políticas de retenção existentes configuradas anteriormente para conversas do Teams incluem agora automaticamente pedidos de utilizador e respostas de e para o Microsoft Copilot para Microsoft 365:

Para obter informações detalhadas sobre este trabalho de retenção, consulte Saiba mais sobre a retenção do Microsoft Copilot para Microsoft 365.

Tal como acontece com todas as políticas de retenção e retenções, se mais do que uma política para a mesma localização se aplicar a um utilizador, os princípios de retenção resolvem quaisquer conflitos. Por exemplo, os dados são retidos durante a maior duração de todas as políticas de retenção aplicadas ou retenções de Deteção de Dados Eletrónicos.

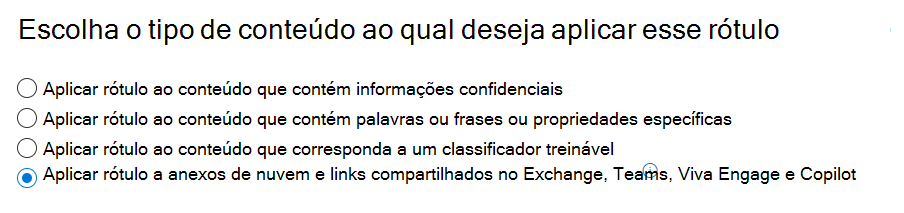

Para que as etiquetas de retenção retenham automaticamente ficheiros referenciados no Copilot, selecione a opção para anexos na nuvem com uma política de etiqueta de retenção de aplicações automáticas: Aplicar etiqueta a anexos na nuvem e ligações partilhadas no Exchange, Teams, Viva Engage e Copilot. Tal como acontece com todos os anexos na nuvem retidos, a versão do ficheiro no momento em que é referenciada é mantida.

Para obter informações detalhadas sobre como funciona esta retenção, veja Como funciona a retenção com anexos na cloud.

Para obter instruções de configuração:

Para configurar políticas de conformidade de comunicação para interações copilot, veja Criar e gerir políticas de conformidade de comunicação.

Para procurar interações do Copilot no registo de auditoria, veja Pesquisar o registo de auditoria.

Para utilizar a pesquisa de conteúdos para encontrar interações do Copilot, veja Procurar conteúdo.

Para utilizar a Deteção de Dados Eletrónicos para interações do Copilot, veja Soluções de Deteção de Dados Eletrónicos do Microsoft Purview.

Para criar ou alterar uma política de retenção para interações copilot, veja Criar e configurar políticas de retenção.

Para criar uma política de etiqueta de retenção automática para ficheiros referenciados no Copilot, consulte Aplicar automaticamente uma etiqueta de retenção para reter ou eliminar conteúdos.

Outra documentação para o hub de IA e Copilot

Anúncio de mensagem de blogue: Proteger os seus dados para tirar partido da IA Geradora com o Microsoft Purview

Para obter informações mais detalhadas, veja Considerações sobre o Hub de IA do Microsoft Purview e proteções de segurança e conformidade de dados para o Microsoft Copilot.

Microsoft Copilot para Microsoft 365:

Comentários

Brevemente: Ao longo de 2024, vamos descontinuar progressivamente o GitHub Issues como mecanismo de feedback para conteúdos e substituí-lo por um novo sistema de feedback. Para obter mais informações, veja: https://aka.ms/ContentUserFeedback.

Submeter e ver comentários