Conectar respostas às perguntas personalizadas ao OpenAI do Azure em seus dados

As respostas às perguntas personalizadas permitem que você crie uma camada de conversação em seus dados baseados em recursos sofisticados de Processamento de Linguagem Natural (NLP) com relevância aprimorada usando um classificador de aprendizado profundo, respostas precisas e suporte regional de ponta a ponta. A maioria dos casos de uso para respostas às perguntas personalizadas depende da localização de respostas apropriadas para entradas ao integrá-las com chatbots, aplicativos de mídia social e aplicativos da área de trabalho habilitados para fala.

No entanto, os runtimes de IA estão evoluindo devido ao desenvolvimento de LLMs (modelos de linguagem grande), como o GPT-35-Turbo e o GPT-4 oferecidos pelo OpenAI do Azure, que podem abordar muitos casos de uso baseados em chat, aos quais talvez você queira se integrar.

Ao mesmo tempo, os clientes geralmente exigem uma experiência de criação de respostas personalizadas para obter um controle mais granular sobre a qualidade e o conteúdo dos pares de perguntas e respostas e permitir que resolvam problemas de conteúdo na produção. Leia este artigo para saber como integrar o OpenAI do Azure em seus dados (versão prévia) a pares de perguntas e respostas de seu projeto de respostas às perguntas personalizadas, usando os índices subjacentes da Pesquisa de IA do Azure do seu projeto.

Pré-requisitos

- Um recurso existente do OpenAI do Azure. Caso você ainda não tenha um recurso do OpenAI do Azure, crie um e implante um modelo.

- Um recurso de Serviço de Linguagem do Azure e um projeto de respostas às perguntas personalizadas. Se você ainda não tem, crie um.

- Verifique se você foi atribuído pelo menos à função de Colaborador do OpenAI de Serviços Cognitivos para o recurso do OpenAI do Azure.

Conectar o OpenAI do Azure aos seus dados e respostas às perguntas personalizadas

Entre no Language Studio e navegue até o seu projeto de respostas às perguntas personalizadas com uma implantação existente.

Selecione a guia Azure Search no menu de navegação à esquerda.

Anote os detalhes do Azure Search, como nome do recurso, assinatura e localização do Azure Search. Você precisará dessas informações ao conectar seu índice do Azure AI Search ao Azure OpenAI.

Navegue até o Estúdio de OpenAI do Azure e entre com as credenciais que têm acesso ao seu recurso de OpenAI do Azure.

Selecione o bloco Traga seus próprios dados para começar a conectar seu índice de pesquisa. Você também pode selecionar o bloco Playground do chat.

E no bloco Configuração do assistente, selecione Adicionar seus dados (versão prévia)>+ Adicionar uma fonte de dados.

No painel exibido, selecione Azure AI Search em Selecionar ou adicionar fonte de dados. Isso atualizará a tela com as opções de Mapeamento de campo de dados que dependem da sua fonte de dados.

Selecione a assinatura, o serviço de Pesquisa de IA do Azure e o Índice de Pesquisa de IA do Azure associados ao seu projeto de respostas às perguntas personalizadas. Selecione a confirmação de que a conexão gerará uso em sua conta. Em seguida, selecione Avançar.

Na tela Mapeamento de campo de dados de índice, selecione a resposta para o campo Dados de conteúdo. Os outros campos, como Nome do arquivo, Título e URL, são opcionais, dependendo da natureza da sua fonte de dados.

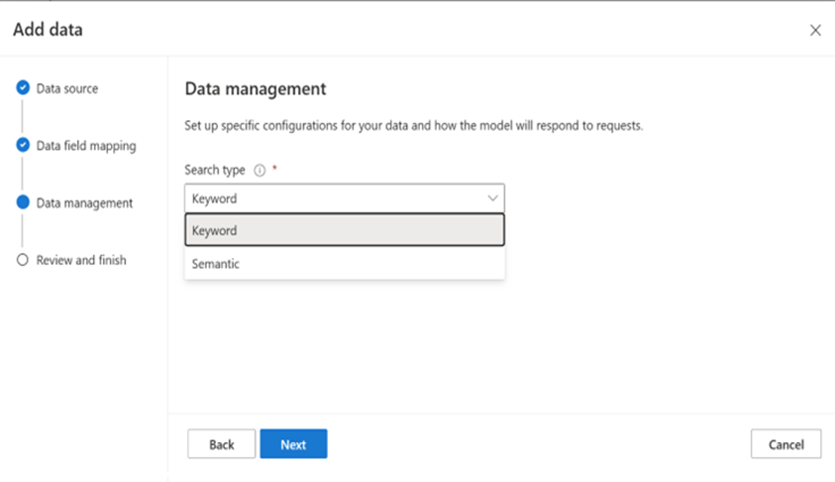

Selecione Avançar. Selecione um tipo de pesquisa no menu suspenso. Você pode escolher Palavra-chave ou Semântica. A pesquisa semântica requer uma configuração de pesquisa semântica existente, que pode ou não estar disponível para o seu projeto.

Revise as informações fornecidas e selecione Salvar e fechar.

Sua fonte de dados foi adicionada. Selecione o nome da implantação de modelo na guia Configuração>Implantação no menu à direita.

Agora você pode começar a explorar os recursos do OpenAI do Azure com uma abordagem sem código por meio do playground de chat. É apenas uma caixa de texto em que você pode enviar um prompt para gerar uma conclusão. Nesta página, você pode iterar e experimentar as funcionalidades rapidamente. Você também pode iniciar um aplicativo Web para conversar com o modelo pela web.