Como avaliar aplicativos de IA generativos com o Estúdio de IA do Azure

Importante

Alguns dos recursos descritos nesse artigo podem estar disponíveis apenas na versão prévia. Essa versão prévia é fornecida sem um contrato de nível de serviço e não recomendamos isso para cargas de trabalho de produção. Alguns recursos podem não ter suporte ou podem ter restrição de recursos. Para obter mais informações, consulte Termos de Uso Complementares de Versões Prévias do Microsoft Azure.

Para avaliar minuciosamente o desempenho do aplicativo de IA generativa quando aplicado a um conjunto de dados substancial, você pode iniciar um processo de avaliação. Durante essa avaliação, seu aplicativo é testado com o conjunto de dados especificado e seu desempenho será medido quantitativamente com métricas baseadas em matemática e métricas assistidas por IA. Essa execução de avaliação fornece insights abrangentes sobre as funcionalidades e limitações do aplicativo.

Para realizar essa avaliação, você pode utilizar a funcionalidade de avaliação no Estúdio de IA do Azure, uma plataforma abrangente que oferece ferramentas e recursos para avaliar o desempenho e a segurança do modelo de IA generativa. No Estúdio de IA, você pode registrar, exibir e analisar métricas de avaliação detalhadas.

Neste artigo, você aprenderá a criar uma execução de avaliação com base em um conjunto de dados de teste ou um fluxo com métricas de avaliação internas da interface do usuário do Estúdio de IA do Azure. Para maior flexibilidade, você pode estabelecer um fluxo de avaliação personalizado e empregar o recurso de avaliação personalizada. Como alternativa, se o objetivo for realizar apenas uma execução em lote sem nenhuma avaliação, você também poderá utilizar o recurso de avaliação personalizada.

Pré-requisitos

Para executar uma avaliação com métricas assistidas por IA, você precisa ter o seguinte pronto:

- Um conjunto de dados de teste em um destes formatos:

csvoujsonl. - Uma conexão do OpenAI do Azure:

- Uma implantação de um destes modelos: modelos GPT 3.5, GPT 4 ou Davinci.

Criar uma avaliação com métricas de avaliação internas

Uma execução de avaliação permite que você gere saídas de métrica para cada linha de dados em seu conjunto de dados de teste. Você pode escolher uma ou mais métricas de avaliação para avaliar a saída de diferentes aspectos. Você pode criar uma execução de avaliação nas páginas de avaliação e prompt flow no Estúdio de IA. Em seguida, um assistente de criação de avaliação aparece para guiá-lo pelo processo de configuração de uma execução de avaliação.

Na página de avaliação

No menu esquerdo recolhível, selecione Avaliação>+ Nova avaliação.

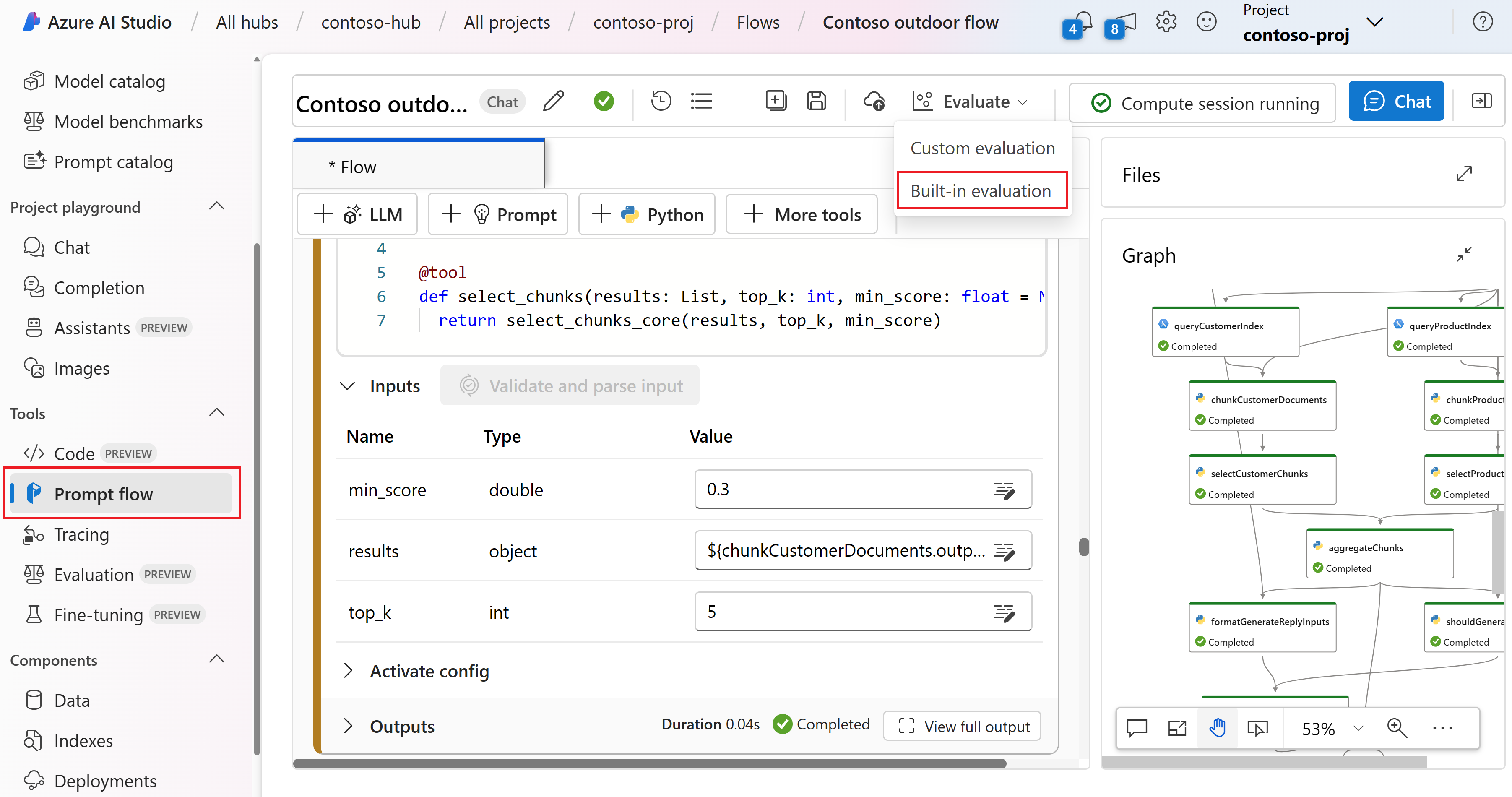

Na página de fluxo

No menu à esquerda recolhível, selecione Prompt flow>Avaliar>Avaliação interna.

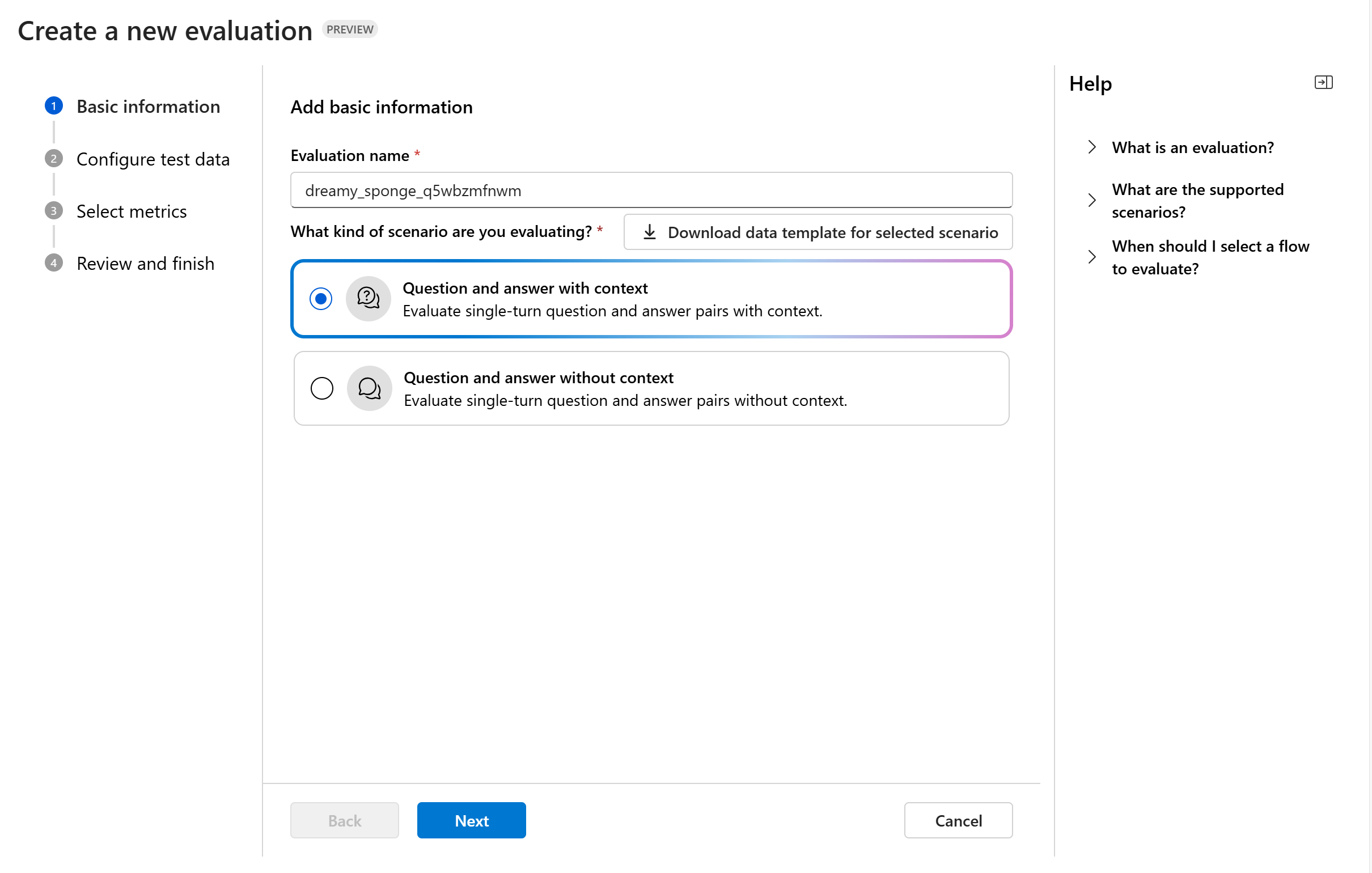

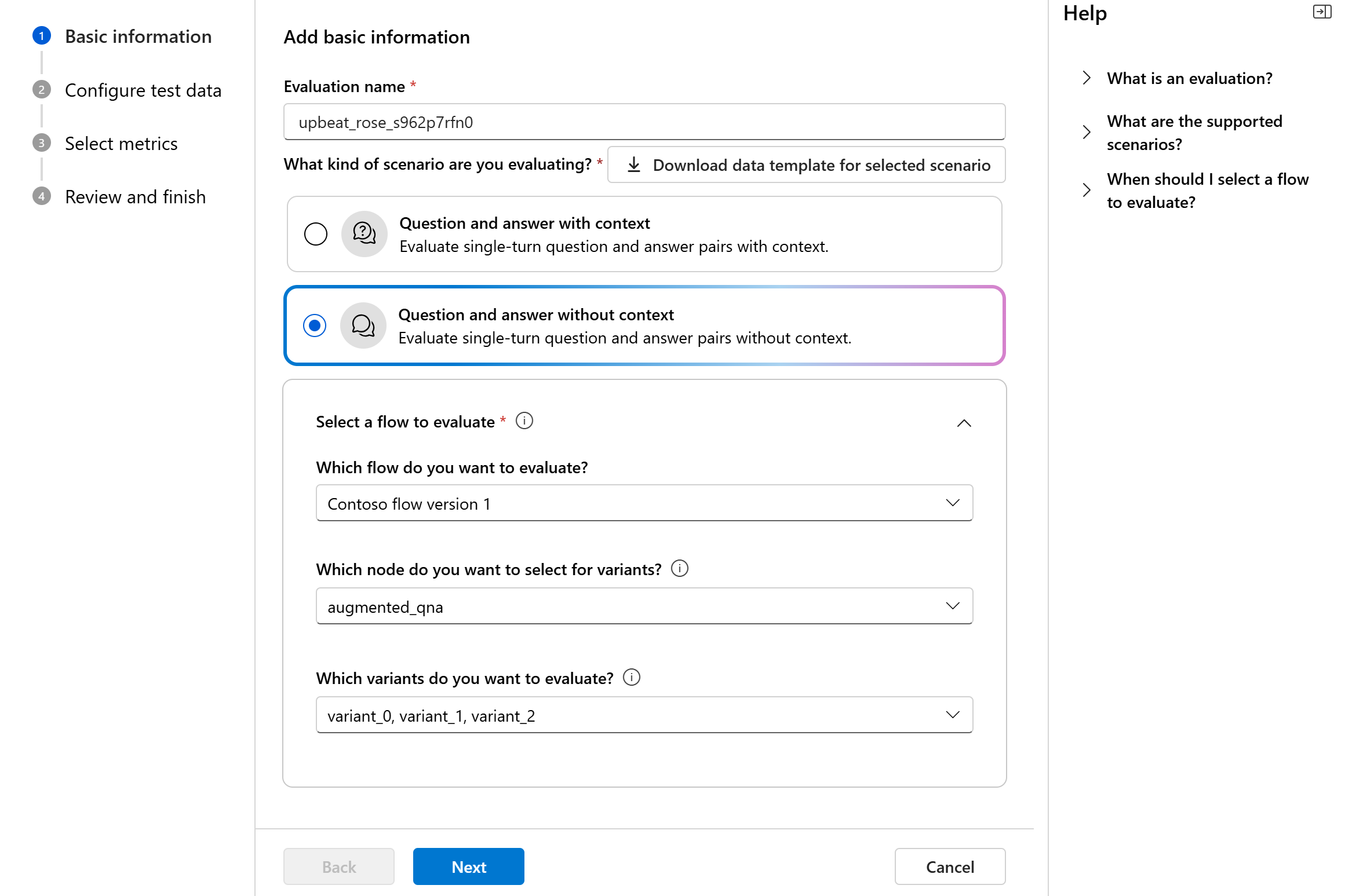

Informações Básicas

Ao inserir o assistente de criação de avaliação, você poderá fornecer um nome opcional para sua execução de avaliação e selecione o cenário que melhor se alinha aos objetivos do aplicativo. Atualmente, oferecemos suporte para os seguintes cenários:

- Pergunta e resposta com contexto: esse cenário foi projetado para aplicativos que envolvem responder consultas de usuário e fornecer respostas com informações de contexto.

- Pergunta e resposta sem contexto: esse cenário foi projetado para aplicativos que envolvem responder consultas de usuário e fornecer respostas sem contexto.

Você pode usar o painel de ajuda para verificar as perguntas frequentes e orientar-se pelo assistente.

Ao especificar o cenário apropriado, podemos adaptar a avaliação à natureza específica do aplicativo, garantindo métricas precisas e relevantes.

- Avaliar com base nos dados: se você já tiver suas saídas geradas pelo modelo em um conjunto de dados de teste, ignore Selecione um fluxo para avaliar e acesse diretamente a próxima etapa para configurar os dados de teste.

- Avaliar do fluxo: se você iniciar a avaliação na página Fluxo, selecionaremos automaticamente o fluxo a ser avaliado. Se você pretende avaliar outro fluxo, poderá selecionar outro. É importante observar que, dentro de um fluxo, você pode ter vários nós, cada um deles pode ter seu próprio conjunto de variantes. Nesses casos, você deve especificar o nó e as variantes que deseja avaliar durante o processo de avaliação.

Configurar dados de teste

Você pode selecionar entre conjuntos de dados pré-existentes ou carregar um novo conjunto de dados especificamente para avaliar. O conjunto de dados de teste precisa ter as saídas geradas pelo modelo a serem usadas para avaliação se não houver nenhum fluxo selecionado na etapa anterior.

Escolha o conjunto de dados existente: você pode escolher o conjunto de dados de teste na coleção de conjuntos de dados estabelecida.

Adicionar novo conjunto de dados: você pode carregar os arquivos do seu armazenamento local. Só damos suporte aos formatos de arquivo

.csve.jsonl.Mapeamento de dados do fluxo: se você selecionar um fluxo para avaliar, certifique-se de que suas colunas de dados estejam configuradas para se alinharem com as entradas necessárias para que o fluxo execute uma execução em lote, gerando saída para avaliação. Em seguida, a avaliação será realizada usando a saída do fluxo. Posteriormente, configure o mapeamento de dados para as entradas de avaliação na próxima etapa.

Selecione métricas

Damos suporte a dois tipos de métricas coletados pela Microsoft para facilitar uma avaliação abrangente do seu aplicativo:

- Métricas de desempenho e qualidade: essas métricas avaliam a qualidade geral e a coerência do conteúdo gerado.

- Métricas de risco e segurança: essas métricas se concentram em identificar possíveis riscos de conteúdo e garantir a segurança do conteúdo gerado.

Você pode consultar a tabela para obter a lista completa de métricas para as quais oferecemos suporte em cada cenário. Para obter informações mais detalhadas sobre cada definição de métrica e como ela é calculada, consulte as Métricas de avaliação e monitoramento.

| Cenário | Métricas de desempenho e qualidade | Métricas de risco e segurança |

|---|---|---|

| Pergunta e resposta com contexto | Fundamentação, relevância, coerência, fluência, similaridade GPT, medida F | Conteúdo relacionado à automutilação, conteúdo odioso e injusto, conteúdo violento, conteúdo sexual |

| Pergunta e resposta sem contexto | Coerência, fluência, similaridade GPT, medida F | Conteúdo relacionado à automutilação, conteúdo odioso e injusto, conteúdo violento, conteúdo sexual |

Ao usar métricas assistidas por IA para avaliação de desempenho e qualidade, especifique um modelo GPT para o processo de cálculo. Escolha uma conexão OpenAI do Azure e uma implantação com GPT-3.5, GPT-4 ou o modelo Davinci, para nossos cálculos.

Para métricas de risco e segurança, não é necessário fornecer uma conexão e implantação. O serviço de back-end de avaliações de segurança do Estúdio de IA do Azure provisiona um modelo GPT-4 que pode gerar pontuações de gravidade de risco de conteúdo e raciocínio para permitir avaliar o aplicativo quanto a danos de conteúdo.

Defina o limite para calcular a taxa de defeitos para as métricas de risco e segurança. A taxa de defeito é calculada levando um percentual de instâncias com níveis de gravidade (muito baixo, baixo, médio, alto) acima de um limite. Por padrão, definimos o limite como “Médio”.

Observação

As métricas de segurança e risco assistidos por IA são hospedadas pelo serviço de back-end de avaliações de segurança do Estúdio de IA do Azure e só estão disponíveis nas seguintes regiões: Leste dos EUA 2, França Central, Sul do Reino Unido, Suécia Central

Mapeamento de dados para avaliação: você deve especificar quais colunas de dados no seu conjunto de dados correspondem às entradas necessárias na avaliação. Diferentes métricas de avaliação exigem tipos distintos de entradas de dados para cálculos precisos.

Observação

Se você estiver avaliando dos dados, “responder” deve mapear para a coluna de resposta no seu conjunto de dados ${data$answer}. Se você estiver avaliando do fluxo, “responder” deve vir da saída do fluxo ${run.outputs.answer}.

Para obter orientação sobre os requisitos específicos de mapeamento de dados relativos a cada métrica, consulte as informações fornecidas na tabela:

Requisitos de métrica de resposta a perguntas

| Indicador | Pergunta | Resposta | Context | Verdade básica |

|---|---|---|---|---|

| Fundamentação | Obrigatório: Str | Obrigatório: Str | Obrigatório: Str | N/D |

| Coerência | Obrigatório: Str | Obrigatório: Str | N/D | N/D |

| Fluência | Obrigatório: Str | Obrigatório: Str | N/D | N/D |

| Relevância | Obrigatório: Str | Obrigatório: Str | Obrigatório: Str | N/D |

| GPT-similarity | Obrigatório: Str | Obrigatório: Str | N/D | Obrigatório: Str |

| Medida F1 | Obrigatório: Str | Obrigatório: Str | N/D | Obrigatório: Str |

| Conteúdo relacionado à automutilação | Obrigatório: Str | Obrigatório: Str | N/D | N/D |

| Conteúdo odioso e injusto | Obrigatório: Str | Obrigatório: Str | N/D | N/D |

| Conteúdo violento | Obrigatório: Str | Obrigatório: Str | N/D | N/D |

| Conteúdo sexual | Obrigatório: Str | Obrigatório: Str | N/D | N/D |

- Pergunta: a pergunta feita pelo usuário no par Resposta a Perguntas

- Resposta: a resposta à pergunta gerada pelo modelo como resposta

- Contexto: a origem à qual a resposta é gerada em relação (ou seja, aterramento de documentos)

- Verdade básica: a resposta à pergunta gerada pelo usuário/humano como a resposta verdadeira

Revisar e concluir

Depois de concluir todas as configurações necessárias, você pode examinar e continuar selecionando "Enviar" para enviar a execução de avaliação.

Criar uma avaliação com fluxo de avaliação personalizado

Você pode desenvolver seus métodos de avaliação:

Na página de fluxo: no menu esquerdo recolhível, selecione Prompt flow>Avaliar>Avaliação personalizada.

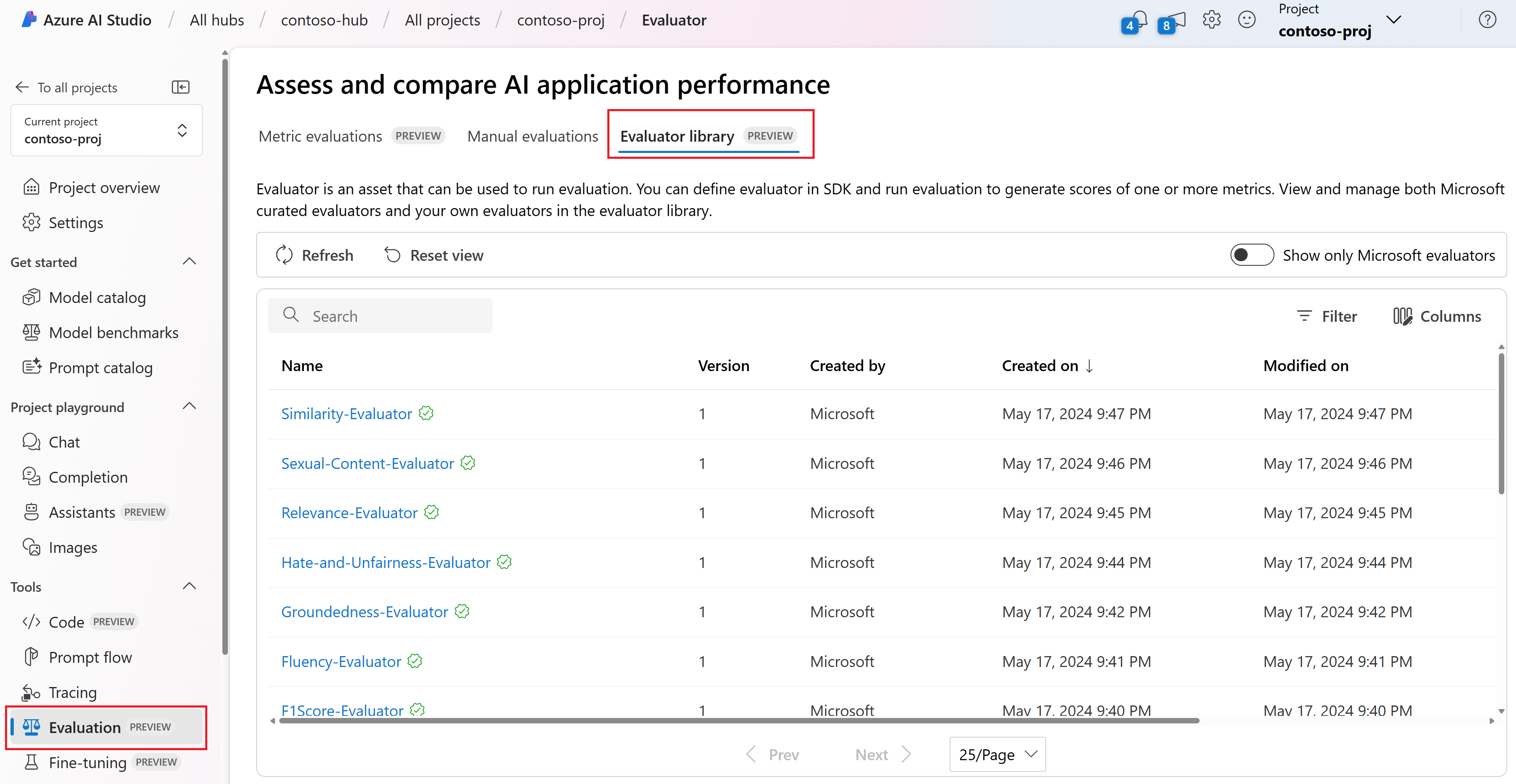

Exibir e gerenciar os avaliadores na biblioteca de avaliadores

A biblioteca de avaliadores é um local centralizado que permite ver os detalhes e o status de seus avaliadores. Você pode exibir e gerenciar avaliadores coletados pela Microsoft.

Dica

Você pode usar avaliadores personalizados por meio do SDK de prompt flow. Para obter mais informações, confira Avaliar com o SDK do prompt flow.

A biblioteca de avaliadores também habilita o gerenciamento de versão. Você pode comparar diferentes versões do seu trabalho, restaurar versões anteriores, se necessário, e colaborar com outras pessoas com mais facilidade.

Para usar a biblioteca de avaliadores no Estúdio de IA, acesse a página Avaliação do projeto e selecione a guia Biblioteca de Avaliadores.

Você pode selecionar o nome do avaliador para ver mais detalhes. Você pode ver o nome, a descrição e os parâmetros e verificar os arquivos associados ao avaliador. Aqui estão alguns exemplos de avaliadores coletados pela Microsoft:

- Para avaliadores de desempenho e qualidade coletados pela Microsoft, você pode exibir o prompt de anotação na página de detalhes. Você pode adaptar esses prompts ao seu caso de uso alterando os parâmetros ou critérios de acordo com seus dados e objetivos com o SDK do prompt flow. Por exemplo, você pode selecionar Avaliador-de-Fundamentação e marcar o arquivo Prompty mostrando como calculamos a métrica.

- Para avaliadores de risco e segurança coletados pela Microsoft, você pode ver a definição das métricas. Por exemplo, você pode selecionar o Avaliador-de-Conteúdo-Relacionado-a-Automutilação e saber o que ele significa e como a Microsoft determina os vários níveis de gravidade para essa métrica de segurança

Próximas etapas

Saiba mais sobre como avaliar seus aplicativos de IA generativa:

Comentários

Em breve: Ao longo de 2024, eliminaremos os problemas do GitHub como o mecanismo de comentários para conteúdo e o substituiremos por um novo sistema de comentários. Para obter mais informações, consulte https://aka.ms/ContentUserFeedback.

Enviar e exibir comentários de