Copiar dados da API do Azure para FHIR para o Azure Synapse Analytics

Importante

A API do Azure para FHIR será desativada em 30 de setembro de 2026. Siga as estratégias de migração para fazer a transição para FHIR® dos Serviços de Dados de Saúde do Azure até essa data. Devido à desativação da API do Azure para FHIR, novas implantações não serão permitidas a partir de 1º de abril de 2025. O serviço dos Serviços de Dados de Saúde do Azure para serviço FHIR é a versão evoluída da API do Azure para FHIR que permite aos clientes gerenciar os serviços FHIR, DICOM e serviço de tecnologia médica com integrações a outros serviços do Azure.

Neste artigo, você aprenderá três maneiras de copiar dados da API do Azure para FHIR® para o Azure Synapse Analytics, que é um serviço de análise ilimitado que reúne integração de dados, data warehouse corporativo e análise de Big Data. Estes são os seguintes.

- Usar a ferramenta OSS do FHIR para o Synapse Sync Agent

- Usar a ferramenta OSS do gerador de pipeline FHIR para CDM

- Usar

$exporte carregar dados no Synapse usando o T-SQL

Usando a ferramenta OSS do FHIR para o Synapse Sync Agent

Observação

O FHIR para o Synapse Sync Agent é uma ferramenta de software livre lançada sob a licença do MIT e não é coberta pelo SLA da Microsoft para serviços do Azure.

O FHIR para o Synapse Sync Agent é um projeto do Microsoft OSS lançado sob a licença do MIT. É uma função do Azure que extrai dados de um servidor FHIR usando APIs de Recurso FHIR, converte-os em arquivos Parquet hierárquicos e os grava no Azure Data Lake quase em tempo real. Ele também contém um script para criar tabelas e exibições externas no pool de SQL do Synapse Serverless apontando para os arquivos Parquet.

Essa solução permite que você consulte todos os dados FHIR com ferramentas como Synapse Studio, SSMS e Power BI. Você também pode acessar os arquivos do Parquet diretamente de um pool do Synapse Spark. Você deve considerar essa solução se quiser acessar todos os seus dados FHIR quase em tempo real e quiser adiar a transformação personalizada para sistemas downstream.

Siga a documentação do OSS para obter instruções de instalação e uso.

Usando a ferramenta OSS do gerador de pipeline FHIR para CDM

Observação

O gerador de pipeline FHIR para CDM é uma ferramenta de software livre lançada sob a licença do MIT e não é coberta pelo SLA da Microsoft para serviços do Azure.

O gerador de pipeline FHIR para CDM é um projeto Microsoft OSS lançado sob a licença MIT. É uma ferramenta para gerar um pipeline do ADF para copiar um instantâneo de dados de um servidor FHIR usando a $export API, transformá-lo no formato csv e gravar em uma pasta CDM no Azure Data Lake Storage Gen 2. A ferramenta requer um arquivo de configuração criado pelo usuário contendo instruções para projetar e nivelar recursos e campos FHIR em tabelas. Você também pode seguir as instruções para criar um pipeline downstream em um workspace do Synapse para mover dados da pasta CDM para um pool de SQL dedicado do Synapse.

Essa solução permite que você transforme os dados em formato tabular à medida que são gravados em uma pasta CDM. Você deve considerar essa solução se quiser transformar dados FHIR em um esquema personalizado depois que eles forem extraídos do servidor FHIR.

Siga a documentação do OSS para obter instruções de instalação e uso.

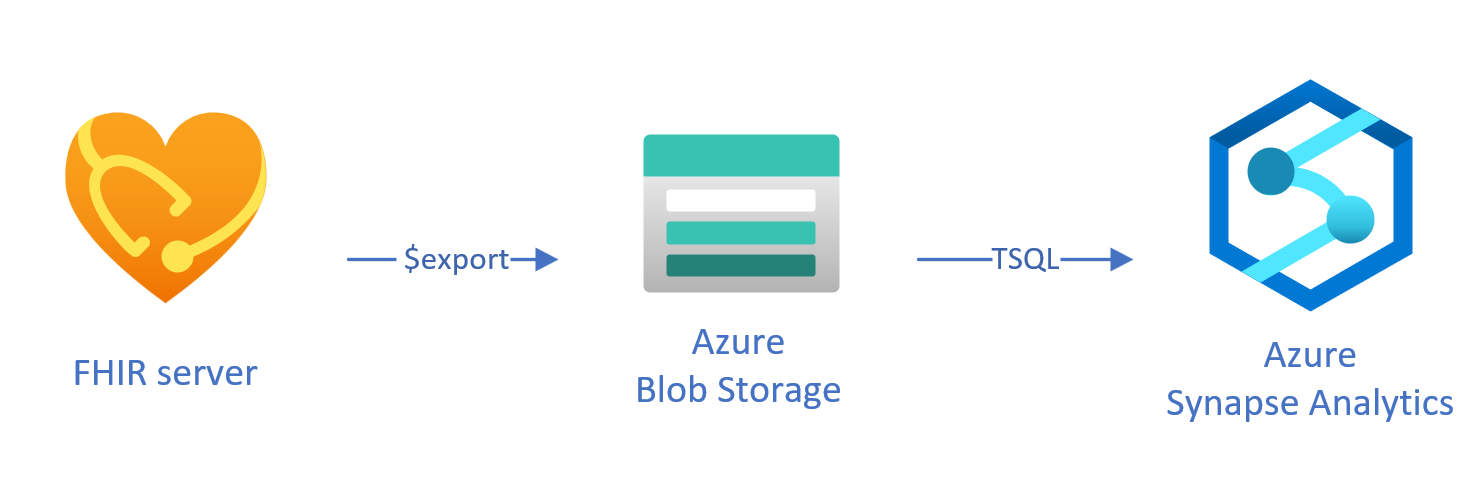

Carregando dados exportados para o Synapse usando o T-SQL

Nessa abordagem, você usa a operação FHIR $export para copiar recursos FHIR em um armazenamento de blobs do Azure Data Lake Gen 2 (ADL Gen 2) no NDJSON formato. Posteriormente, você carrega os dados do armazenamento em pools de SQL dedicados ou sem servidor no Synapse usando o T-SQL. Você pode converter essas etapas em um pipeline robusto de movimentação de dados usando pipelines do Synapse.

Usando $export para copiar dados

Configuração $export no servidor FHIR

A API do Azure para FHIR implementa a $export operação definida pela especificação FHIR para exportar todos ou um subconjunto filtrado de dados FHIR no NDJSON formato. Além disso, ele dá suporte à exportação não identificada para anonimizar os dados FHIR durante a exportação.

Para exportar dados FHIR para o armazenamento de blobs do Azure, primeiro você precisa configurar o servidor FHIR para exportar dados para a conta de armazenamento. Você precisa (1) habilitar a Identidade Gerenciada, (2) ir para Controle de Acesso na conta de armazenamento e adicionar uma atribuição de função, (3) selecionar sua conta de armazenamento para $export. Mais instruções passo a passo podem ser encontradas aqui.

Você pode configurar o servidor para exportar os dados para qualquer tipo de conta de armazenamento do Azure, mas recomendamos exportar para o ADL Gen 2 para melhor alinhamento com o Synapse.

Usando o $export comando

Depois de configurar o servidor FHIR, você pode seguir a documentação para exportar os recursos FHIR no nível do sistema, do paciente ou do grupo. Por exemplo, você pode exportar todos os seus dados FHIR relacionados aos pacientes em um Group com o seguinte $export comando, no qual você especifica o nome do armazenamento de blobs do ADL Gen 2 no campo {{BlobContainer}}:

https://{{FHIR service base URL}}/Group/{{GroupId}}/$export?_container={{BlobContainer}}

Você também pode usar o _type parâmetro na chamada anterior $export para restringir os recursos que deseja exportar. Por exemplo, a chamada a seguir exporta apenas Patient, MedicationRequeste recursos Observation :

https://{{FHIR service base URL}}/Group/{{GroupId}}/$export?_container={{BlobContainer}}&

_type=Patient,MedicationRequest,Condition

Para obter mais informações sobre os diferentes parâmetros suportados, confira nossa $export seção de página sobre os parâmetros de consulta.

Usando o Synapse para análise

Criando um espaço de trabalho do Synapse

Antes de usar o Synapse, você precisa de um workspace do Synapse. Você precisa criar um serviço do Azure Synapse Analytics no portal do Azure. Mais orientações passo a passo podem ser encontradas aqui. Você precisa de uma ADLSGEN2 conta para criar um espaço de trabalho. Seu workspace do Azure Synapse usa essa conta de armazenamento para armazenar os dados do workspace do Synapse.

Depois de criar um workspace, você pode exibir seu workspace no Synapse Studio entrando no workspace em https://web.azuresynapse.netou iniciando o Synapse Studio no portal do Azure.

Criando um serviço vinculado entre o armazenamento do Azure e o Synapse

Para copiar seus dados para o Synapse, você precisa criar um serviço vinculado que se conecte à conta de Armazenamento do Azure, para onde você exportou seus dados com o Synapse. Mais instruções passo a passo podem ser encontradas aqui.

- No Synapse Studio, navegue até a guia Gerenciar . Em Conexões externas, selecione Serviços vinculados.

- Selecione Novo para adicionar um novo serviço vinculado.

- Selecione Azure Data Lake Storage Gen2 na lista e selecione Continuar.

- Insira as credenciais de autenticação. Selecione Criar quando terminar.

Agora que você tem um serviço vinculado entre o armazenamento do ADL Gen 2 e o Synapse, está pronto para usar os pools de SQL do Synapse para carregar e analisar seus dados FHIR.

Decidir entre pool de SQL dedicado e sem servidor

O Azure Synapse Analytics oferece dois pools de SQL diferentes: pool de SQL sem servidor e pool de SQL dedicado. O pool de SQL sem servidor oferece a flexibilidade de consultar dados diretamente no armazenamento de blobs usando o ponto de extremidade SQL sem servidor sem nenhum provisionamento de recursos. O pool de SQL dedicado tem o poder de processamento para alto desempenho e simultaneidade e é recomendado para recursos de data warehouse em escala empresarial. Para obter mais detalhes sobre os dois pools de SQL, confira a página de documentação do Synapse sobre a arquitetura SQL.

Usando o pool de SQL sem servidor

Como não há servidor, não há infraestrutura para configurar ou clusters para manter. Você pode começar a consultar dados do Synapse Studio assim que o workspace for criado.

Por exemplo, a consulta a seguir pode ser usada para transformar campos selecionados em Patient.ndjson uma estrutura tabular.

SELECT * FROM

OPENROWSET(bulk 'https://{{youraccount}}.blob.core.windows.net/{{yourcontainer}}/Patient.ndjson',

FORMAT = 'csv',

FIELDTERMINATOR ='0x0b',

FIELDQUOTE = '0x0b')

WITH (doc NVARCHAR(MAX)) AS rows

CROSS APPLY OPENJSON(doc)

WITH (

ResourceId VARCHAR(64) '$.id',

Active VARCHAR(10) '$.active',

FullName VARCHAR(100) '$.name[0].text',

Gender VARCHAR(20) '$.gender',

...

)

Na consulta anterior, a função acessa OPENROWSET arquivos no Armazenamento do Azure, OPENJSON analisa o texto JSON e retorna as propriedades de entrada JSON como linhas e colunas. Sempre que essa consulta é executada, o pool de SQL sem servidor lê o arquivo do armazenamento de blobs, analisa o JSON e extrai os campos.

Você também pode materializar os resultados no formato Parquet em uma Tabela Externa para obter melhor desempenho de consulta, da seguinte maneira.

-- Create External data source where the parquet file will be written

CREATE EXTERNAL DATA SOURCE [MyDataSource] WITH (

LOCATION = 'https://{{youraccount}}.blob.core.windows.net/{{exttblcontainer}}'

);

GO

-- Create External File Format

CREATE EXTERNAL FILE FORMAT [ParquetFF] WITH (

FORMAT_TYPE = PARQUET,

DATA_COMPRESSION = 'org.apache.hadoop.io.compress.SnappyCodec'

);

GO

CREATE EXTERNAL TABLE [dbo].[Patient] WITH (

LOCATION = 'PatientParquet/',

DATA_SOURCE = [MyDataSource],

FILE_FORMAT = [ParquetFF]

) AS

SELECT * FROM

OPENROWSET(bulk 'https://{{youraccount}}.blob.core.windows.net/{{yourcontainer}}/Patient.ndjson'

-- Use rest of the SQL statement from the previous example --

Usando o pool de SQL dedicado

O pool de SQL dedicado dá suporte a tabelas gerenciadas e um cache hierárquico para desempenho na memória. Você pode importar Big Data com consultas T-SQL simples e, em seguida, usar o poder do mecanismo de consulta distribuído para executar análises de alto desempenho.

A maneira mais simples e rápida de carregar dados do armazenamento para um pool de SQL dedicado é usar o COPY comando no T-SQL, que pode ler arquivos CSV, Parquet e ORC. Como na consulta de exemplo a seguir. Use o COPY comando para carregar as NDJSON linhas em uma estrutura tabular.

-- Create table with HEAP, which is not indexed and does not have a column width limitation of NVARCHAR(4000)

CREATE TABLE StagingPatient (

Resource NVARCHAR(MAX)

) WITH (HEAP)

COPY INTO StagingPatient

FROM 'https://{{yourblobaccount}}.blob.core.windows.net/{{yourcontainer}}/Patient.ndjson'

WITH (

FILE_TYPE = 'CSV',

ROWTERMINATOR='0x0a',

FIELDQUOTE = '',

FIELDTERMINATOR = '0x00'

)

GO

Depois de gerar as linhas JSON na StagingPatient tabela, você pode criar diferentes formatos tabulares dos dados usando a OPENJSON função e armazenando os resultados em tabelas. Veja a seguir um exemplo de consulta SQL para criar uma Patient tabela extraindo alguns campos do Patient recurso.

SELECT RES.*

INTO Patient

FROM StagingPatient

CROSS APPLY OPENJSON(Resource)

WITH (

ResourceId VARCHAR(64) '$.id',

FullName VARCHAR(100) '$.name[0].text',

FamilyName VARCHAR(50) '$.name[0].family',

GivenName VARCHAR(50) '$.name[0].given[0]',

Gender VARCHAR(20) '$.gender',

DOB DATETIME2 '$.birthDate',

MaritalStatus VARCHAR(20) '$.maritalStatus.coding[0].display',

LanguageOfCommunication VARCHAR(20) '$.communication[0].language.text'

) AS RES

GO

Próximas etapas

Neste artigo, você aprendeu três maneiras diferentes de copiar seus dados FHIR para o Synapse.

Em seguida, você pode saber como desidentificar seus dados FHIR ao exportá-los para o Synapse para proteger as PHI (informações pessoais de saúde).

Observação

FHIR® é uma marca registrada da HL7 e é usado com a permissão da HL7.