Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Observação

Os tutoriais do Mixed Reality Academy foram projetados com o HoloLens (1ª geração) e os headsets imersivos de realidade misturada em mente. Dessa forma, achamos que é importante continuar disponibilizando esses tutoriais para os desenvolvedores que ainda buscam obter diretrizes para o desenvolvimento visando esses dispositivos. Esses tutoriais não serão atualizados com os conjuntos de ferramentas mais recentes nem com as interações usadas para o HoloLens 2. Eles serão mantidos para continuar funcionando nos dispositivos compatíveis. Haverá uma nova série de tutoriais que serão postados no futuro que demonstrarão como desenvolver para o HoloLens 2. Este aviso será atualizado com um link para esses tutoriais quando eles forem postados.

Neste curso, você aprenderá a criar e implantar um bot usando o Microsoft Bot Framework V4 e se comunicar com ele por meio de um aplicativo Windows Mixed Reality.

O Microsoft Bot Framework V4 é um conjunto de APIs projetadas para fornecer aos desenvolvedores as ferramentas para criar um aplicativo de bot extensível e escalonável. Para obter mais informações, visite a página do Microsoft Bot Framework ou o Repositório Git V4.

Depois de concluir este curso, você terá criado um aplicativo Windows Mixed Reality, que poderá fazer o seguinte:

- Use um gesto de toque para iniciar o bot ouvindo a voz dos usuários.

- Quando o usuário disser algo, o bot tentará fornecer uma resposta.

- Exiba a resposta dos bots como texto, posicionada perto do bot, na Cena do Unity.

Em sua aplicação, cabe a você como integrará os resultados ao seu design. Este curso foi desenvolvido para ensinar como integrar um Serviço do Azure ao seu projeto do Unity. É seu trabalho usar o conhecimento adquirido com este curso para aprimorar seu aplicativo de realidade misturada.

Suporte a dispositivos

| Curso | HoloLens | Headsets imersivos |

|---|---|---|

| MR e Azure 312: integração de bot | ✔️ | ✔️ |

Observação

Embora este curso se concentre principalmente no HoloLens, você também pode aplicar o que aprendeu neste curso a headsets imersivos (VR) do Windows Mixed Reality. Como os headsets imersivos (VR) não têm câmeras acessíveis, você precisará de uma câmera externa conectada ao seu PC. Ao acompanhar o curso, você verá notas sobre quaisquer alterações que possa precisar empregar para oferecer suporte a headsets imersivos (VR).

Pré-requisitos

Observação

Este tutorial foi desenvolvido para desenvolvedores que têm experiência básica com Unity e C#. Esteja ciente também de que os pré-requisitos e as instruções escritas neste documento representam o que foi testado e verificado no momento da redação (julho de 2018). Você é livre para usar o software mais recente, conforme listado no artigo instalar as ferramentas , embora não se deva presumir que as informações deste curso corresponderão perfeitamente ao que você encontrará em softwares mais recentes do que os listados abaixo.

Recomendamos o seguinte hardware e software para este curso:

- Um computador de desenvolvimento, compatível com Windows Mixed Reality para desenvolvimento de headset imersivo (VR)

- Windows 10 Fall Creators Update (ou posterior) com o modo de desenvolvedor habilitado

- O SDK mais recente do Windows 10

- Unidade 2017.4

- Visual Studio 2017

- Um headset imersivo (VR) Windows Mixed Reality ou Microsoft HoloLens com o modo Desenvolvedor habilitado

- Acesso à Internet para o Azure e para recuperação do Bot do Azure. Para mais informações, siga este link.

Antes de começar

- Para evitar problemas ao criar este projeto, é altamente recomendável que você crie o projeto mencionado neste tutorial em uma pasta raiz ou quase raiz (caminhos de pasta longos podem causar problemas no momento da compilação).

- Configure e teste seu HoloLens. Se você precisar de suporte para configurar seu HoloLens, visite o artigo de configuração do HoloLens.

- É uma boa ideia executar a Calibração e o Ajuste do Sensor ao começar a desenvolver um novo aplicativo HoloLens (às vezes, pode ajudar a executar essas tarefas para cada usuário).

Para obter ajuda sobre a calibração, siga este link para o artigo Calibração do HoloLens.

Para obter ajuda sobre o Ajuste do Sensor, siga este link para o artigo Ajuste do Sensor do HoloLens.

Capítulo 1 – Criar o aplicativo Bot

A primeira etapa é criar seu bot como um aplicativo Web local ASP.Net Core. Depois de concluí-lo e testá-lo, você o publicará no Portal do Azure.

Abra o Visual Studio. Crie um novo projeto, selecione ASP NET Core Web Application como o tipo de projeto (você o encontrará na subseção .NET Core) e chame-o de MyBot. Clique em OK.

Na janela que aparecerá, selecione Vazio. Verifique também se o destino está definido como ASP NET Core 2.0 e se a Autenticação está definida como Sem Autenticação. Clique em OK.

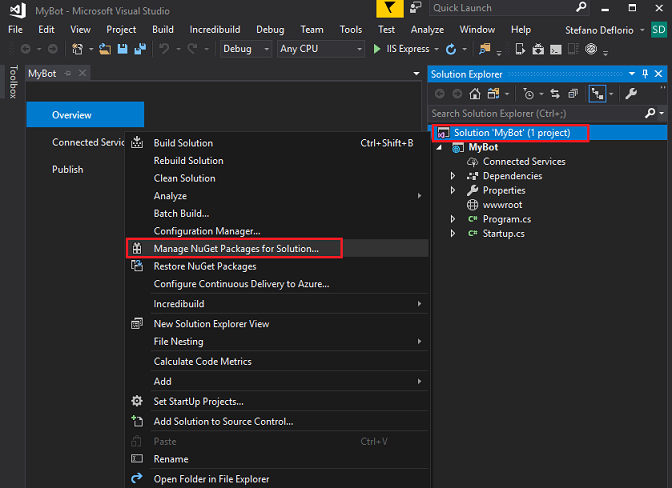

A solução será aberta agora. Clique com o botão direito do mouse em Solution Mybot no Gerenciador de Soluções e clique em Gerenciar Pacotes NuGet para Solução.

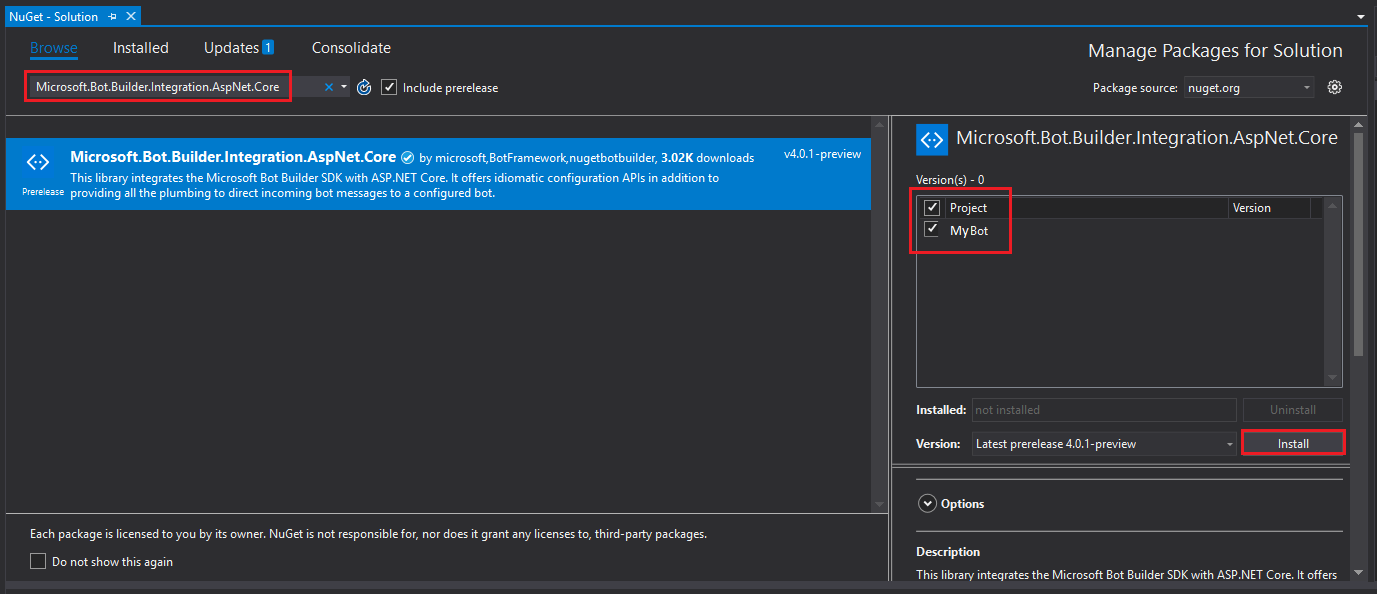

Na guia Procurar, pesquise Microsoft.Bot.Builder.Integration.AspNet.Core (verifique se a opção Incluir pré-lançamento está marcada). Selecione a versão 4.0.1-preview do pacote e marque as caixas do projeto. Em seguida, clique em Instalar. Agora você instalou as bibliotecas necessárias para o Bot Framework v4. Feche a página do NuGet.

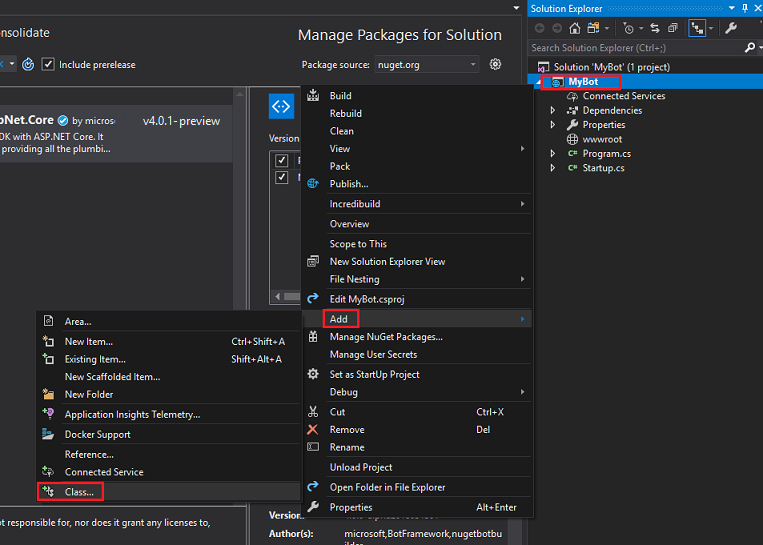

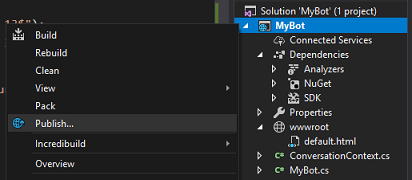

Clique com o botão direito do mouse em seu projeto, MyBot, no Gerenciador de Soluções e clique em Adicionar | Classe.

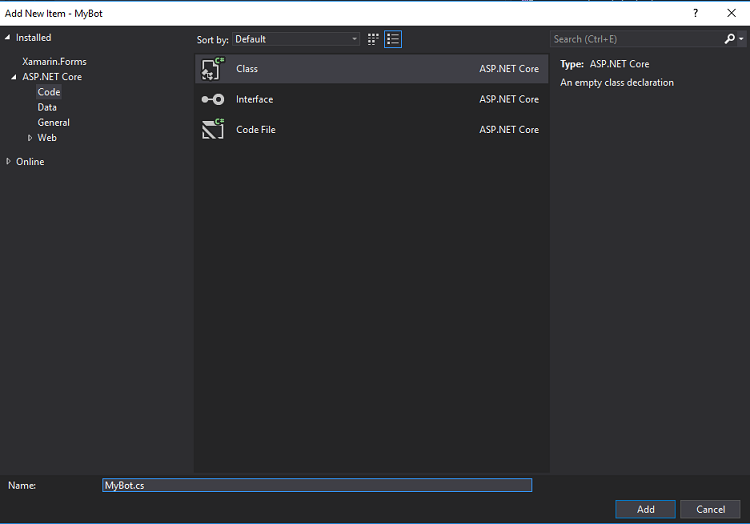

Nomeie a classe MyBot e clique em Adicionar.

Repita o ponto anterior para criar outra classe chamada ConversationContext.

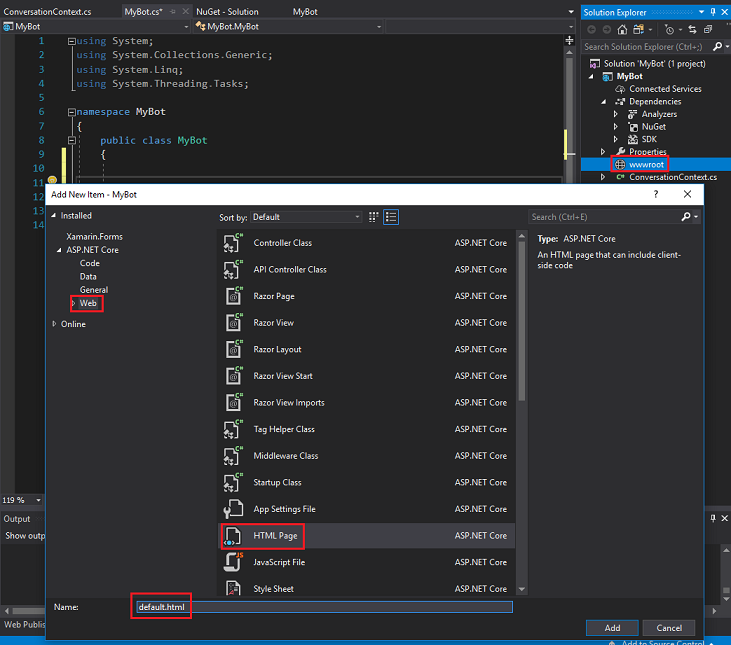

Clique com o botão direito do mouse em wwwroot no Gerenciador de Soluções e clique em Adicionar | Novo Item. Selecione Página HTML (você a encontrará na subseção Web). Nomeie o arquivo default.html. Clique em Adicionar.

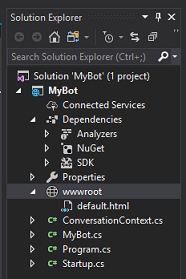

A lista de classes/objetos no Gerenciador de Soluções deve ser semelhante à imagem abaixo.

Clique duas vezes na classe ConversationContext . Essa classe é responsável por manter as variáveis usadas pelo bot para manter o contexto da conversa. Esses valores de contexto de conversa são mantidos em uma instância dessa classe, pois qualquer instância da classe MyBot será atualizada sempre que uma atividade for recebida. Adicione o código a seguir à classe :

namespace MyBot { public static class ConversationContext { internal static string userName; internal static string userMsg; } }Clique duas vezes na classe MyBot . Essa classe hospedará os manipuladores chamados por qualquer atividade de entrada do cliente. Nesta classe, você adicionará o código usado para criar a conversa entre o bot e o cliente. Como mencionado anteriormente, uma instância dessa classe é inicializada sempre que uma atividade é recebida. Adicione o seguinte código a essa classe:

using Microsoft.Bot; using Microsoft.Bot.Builder; using Microsoft.Bot.Schema; using System.Threading.Tasks; namespace MyBot { public class MyBot : IBot { public async Task OnTurn(ITurnContext context) { ConversationContext.userMsg = context.Activity.Text; if (context.Activity.Type is ActivityTypes.Message) { if (string.IsNullOrEmpty(ConversationContext.userName)) { ConversationContext.userName = ConversationContext.userMsg; await context.SendActivity($"Hello {ConversationContext.userName}. Looks like today it is going to rain. \nLuckily I have umbrellas and waterproof jackets to sell!"); } else { if (ConversationContext.userMsg.Contains("how much")) { if (ConversationContext.userMsg.Contains("umbrella")) await context.SendActivity($"Umbrellas are $13."); else if (ConversationContext.userMsg.Contains("jacket")) await context.SendActivity($"Waterproof jackets are $30."); else await context.SendActivity($"Umbrellas are $13. \nWaterproof jackets are $30."); } else if (ConversationContext.userMsg.Contains("color") || ConversationContext.userMsg.Contains("colour")) { await context.SendActivity($"Umbrellas are black. \nWaterproof jackets are yellow."); } else { await context.SendActivity($"Sorry {ConversationContext.userName}. I did not understand the question"); } } } else { ConversationContext.userMsg = string.Empty; ConversationContext.userName = string.Empty; await context.SendActivity($"Welcome! \nI am the Weather Shop Bot \nWhat is your name?"); } } } }Clique duas vezes na classe Startup . Essa classe inicializará o bot. Adicione o código a seguir à classe :

using Microsoft.AspNetCore.Builder; using Microsoft.AspNetCore.Hosting; using Microsoft.Bot.Builder.BotFramework; using Microsoft.Bot.Builder.Integration.AspNet.Core; using Microsoft.Extensions.Configuration; using Microsoft.Extensions.DependencyInjection; namespace MyBot { public class Startup { public IConfiguration Configuration { get; } public Startup(IHostingEnvironment env) { var builder = new ConfigurationBuilder() .SetBasePath(env.ContentRootPath) .AddJsonFile("appsettings.json", optional: true, reloadOnChange: true) .AddJsonFile($"appsettings.{env.EnvironmentName}.json", optional: true) .AddEnvironmentVariables(); Configuration = builder.Build(); } // This method gets called by the runtime. Use this method to add services to the container. public void ConfigureServices(IServiceCollection services) { services.AddSingleton(_ => Configuration); services.AddBot<MyBot>(options => { options.CredentialProvider = new ConfigurationCredentialProvider(Configuration); }); } // This method gets called by the runtime. Use this method to configure the HTTP request pipeline. public void Configure(IApplicationBuilder app, IHostingEnvironment env) { if (env.IsDevelopment()) { app.UseDeveloperExceptionPage(); } app.UseDefaultFiles(); app.UseStaticFiles(); app.UseBotFramework(); } } }Abra o arquivo de classe Program e verifique se o código nele é o mesmo que o seguinte:

using Microsoft.AspNetCore; using Microsoft.AspNetCore.Hosting; namespace MyBot { public class Program { public static void Main(string[] args) { BuildWebHost(args).Run(); } public static IWebHost BuildWebHost(string[] args) => WebHost.CreateDefaultBuilder(args) .UseStartup<Startup>() .Build(); } }Lembre-se de salvar suas alterações, para fazer isso, vá para Arquivo>Salvar Tudo, na barra de ferramentas na parte superior do Visual Studio.

Capítulo 2 – Criar o Serviço de Bot do Azure

Agora que você criou o código para o bot, precisa publicá-lo em uma instância do Serviço de Bot do Aplicativo Web, no Portal do Azure. Este capítulo mostrará como criar e configurar o Serviço de Bot no Azure e, em seguida, publicar seu código nele.

Primeiro, faça logon no Portal do Azure (https://portal.azure.com).

- Se você ainda não tiver uma conta do Azure, precisará criar uma. Se você estiver seguindo este tutorial em uma sala de aula ou laboratório, peça ajuda ao seu instrutor ou a um dos supervisores para configurar sua nova conta.

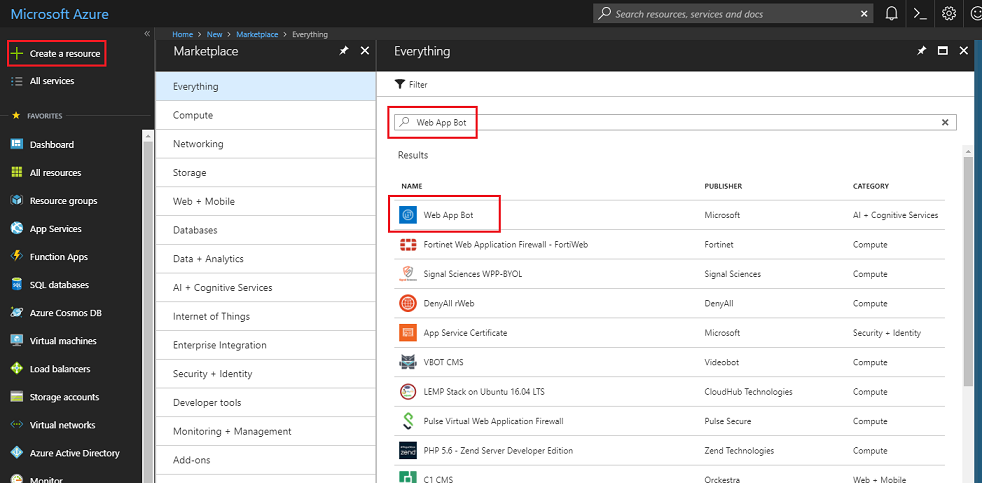

Depois de fazer login, clique em Criar um recurso no canto superior esquerdo, pesquise o bot do Web App e clique em Enter.

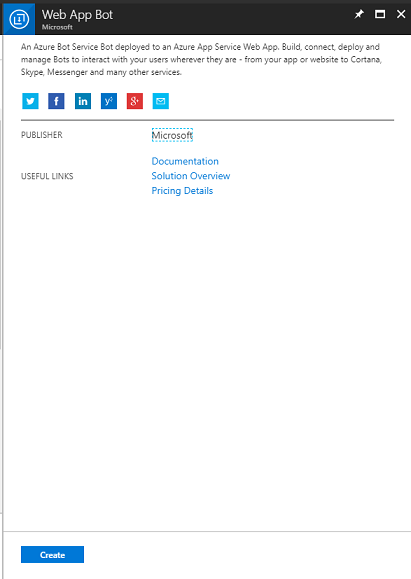

A nova página fornecerá uma descrição do Serviço de Bot do Aplicativo Web. Na parte inferior esquerda desta página, selecione o botão Criar para criar uma associação com este Serviço.

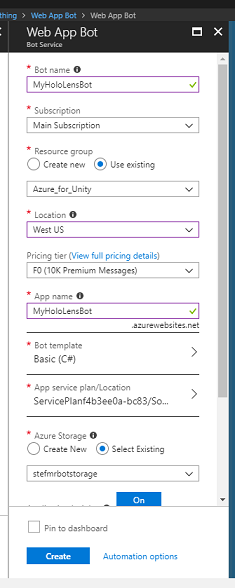

Depois de clicar em Criar:

Insira o Nome desejado para esta instância de Serviço.

Selecione uma Assinatura.

Escolha um grupo de recursos ou crie um novo. Um grupo de recursos fornece uma maneira de monitorar, controlar o acesso, provisionar e gerenciar a cobrança de uma coleção de ativos do Azure. É recomendável manter todos os Serviços do Azure associados a um único projeto (por exemplo, como esses cursos) em um grupo de recursos comum).

Se você deseja ler mais sobre os Grupos de Recursos do Azure, siga este link

Determine o Local do seu grupo de recursos (se você estiver criando um novo Grupo de Recursos). O local seria idealmente na região onde o aplicativo seria executado. Alguns ativos do Azure só estão disponíveis em determinadas regiões.

Selecione o Tipo de Preço apropriado para você, se esta for a primeira vez que cria um Serviço de Bot de Aplicativo Web, uma camada gratuita (chamada F0) deverá estar disponível para você

O nome do aplicativo pode ser deixado igual ao nome do bot.

Deixe o modelo de Bot como Básico (C#).

O plano/local do serviço de aplicativo deve ter sido preenchido automaticamente para sua conta.

Defina o Armazenamento do Azure que você deseja usar para hospedar seu Bot. Se você ainda não tem um, pode criá-lo aqui.

Você também precisará confirmar que entendeu os Termos e Condições aplicados a este Serviço.

Clique em Criar.

Depois de clicar em Criar, você terá que esperar que o Serviço seja criado, isso pode levar um minuto.

Uma notificação será exibida no Portal assim que a instância de serviço for criada.

Clique na notificação para explorar sua nova instância de serviço.

Clique no botão Ir para o recurso na notificação para explorar sua nova instância de serviço. Você será levado para sua nova instância de Serviço do Azure.

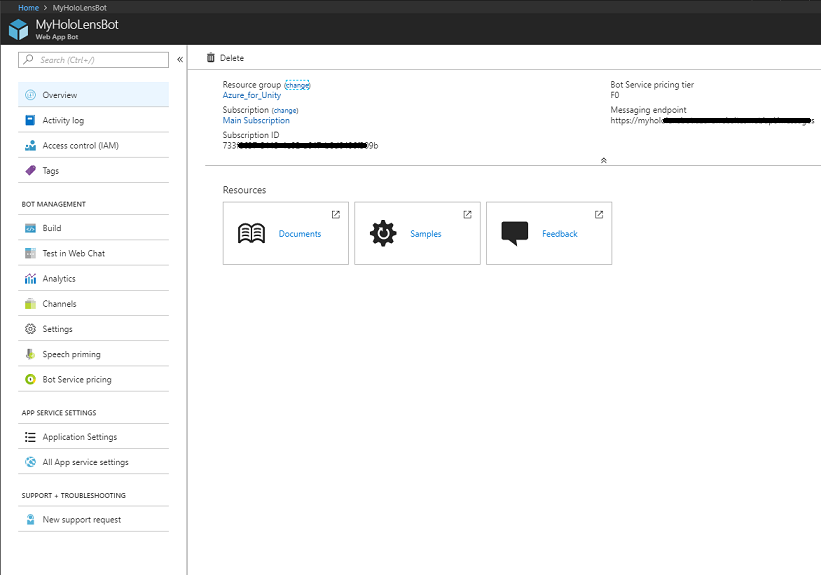

Neste ponto, você precisa configurar um recurso chamado Direct Line para permitir que seu aplicativo cliente se comunique com esse Serviço de Bot. Clique em Canais e, em seguida, na seção Adicionar um canal em destaque, clique em Configurar canal de Linha Direta.

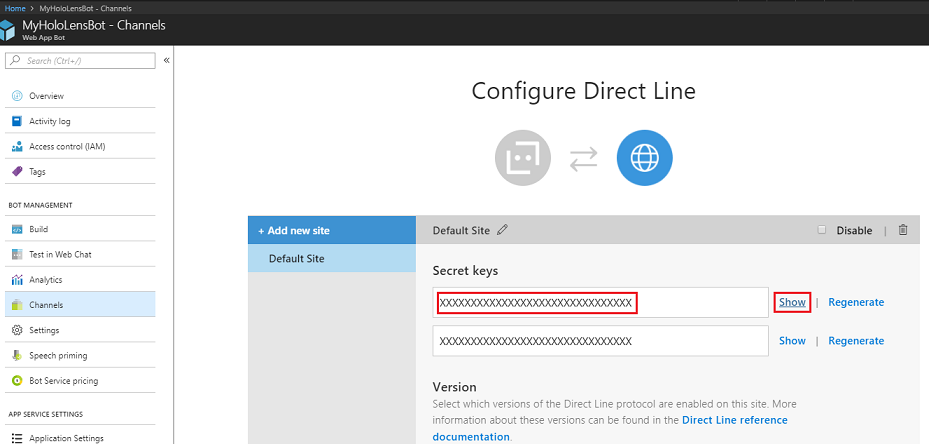

Nesta página, você encontrará as chaves secretas que permitirão que seu aplicativo cliente se autentique com o bot. Clique no botão Mostrar e faça uma cópia de uma das chaves exibidas, pois você precisará disso mais tarde em seu projeto.

Capítulo 3 – Publicar o bot no Serviço de Bot do Aplicativo Web do Azure

Agora que seu Serviço está pronto, você precisa publicar o código do Bot, que você criou anteriormente, no Serviço de Bot do Aplicativo Web recém-criado.

Observação

Você terá que publicar seu Bot no Serviço do Azure sempre que fizer alterações na solução/código do Bot.

Volte para a solução do Visual Studio que você criou anteriormente.

Clique com o botão direito do mouse no projeto MyBot , no Gerenciador de Soluções e clique em Publicar.

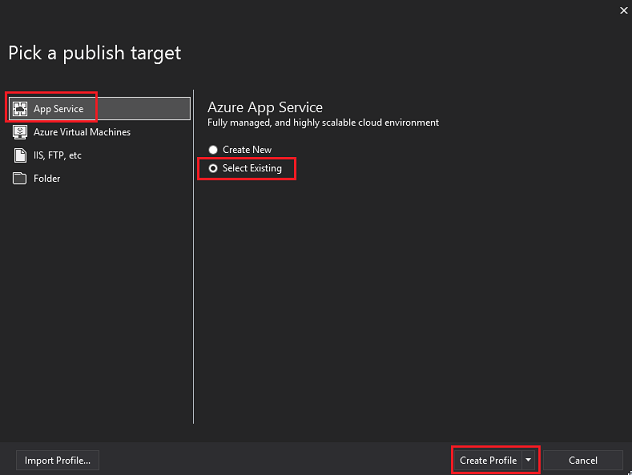

Na página Escolher um destino de publicação, clique em Serviço de Aplicativo, selecione Existente e, por fim, clique em Criar Perfil (talvez seja necessário clicar na seta suspensa ao lado do botão Publicar , se isso não estiver visível).

Se você ainda não está conectado à sua conta da Microsoft, deve fazê-lo aqui.

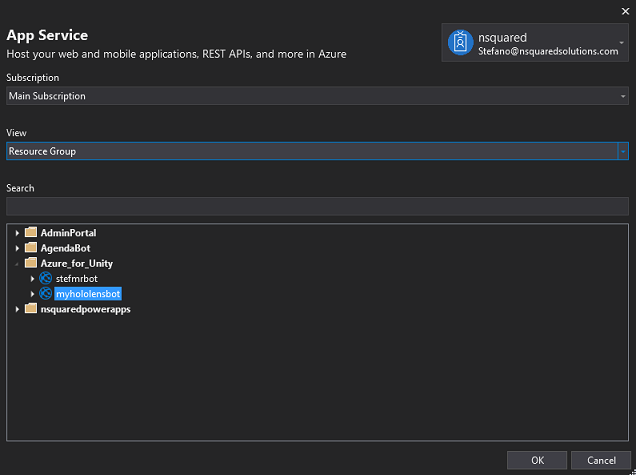

Na página Publicar, você descobrirá que precisa definir a mesma Assinatura usada para a criação do Serviço de Bot do Aplicativo Web. Em seguida, defina Exibir como Grupo de Recursos e, na estrutura de pastas suspensa, selecione o Grupo de Recursos que você criou anteriormente. Clique em OK.

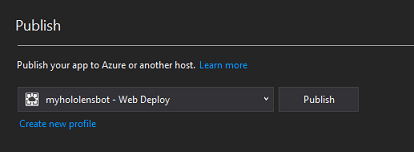

Agora clique no botão Publicar e aguarde a publicação do Bot (pode levar alguns minutos).

Capítulo 4 – Configurar o projeto do Unity

Veja a seguir uma configuração típica para desenvolvimento com realidade misturada e, como tal, é um bom modelo para outros projetos.

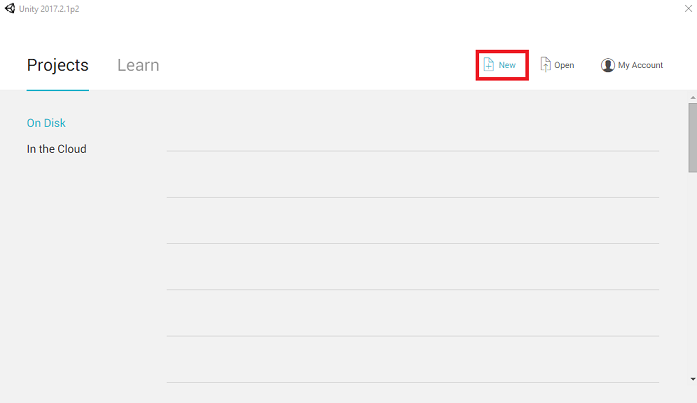

Abra o Unity e clique em Novo.

Agora você precisará fornecer um nome de projeto do Unity. Insira o bot do HoloLens. Certifique-se de que o modelo de projeto esteja definido como 3D. Defina o local para algum lugar apropriado para você (lembre-se, mais perto dos diretórios raiz é melhor). Em seguida, clique em Criar projeto.

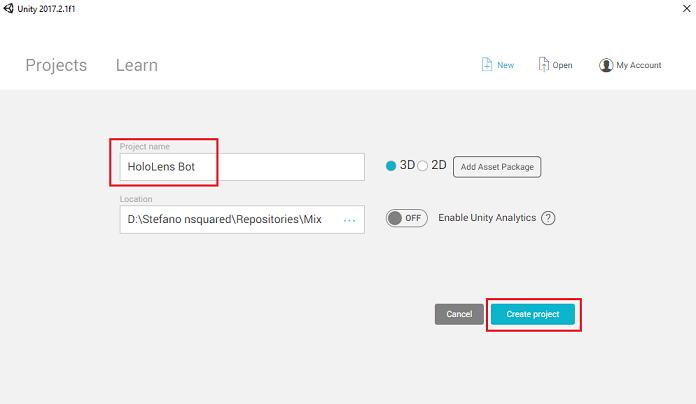

Com o Unity aberto, vale a pena verificar se o Editor de Scripts padrão está definido como Visual Studio. Vá para Editar > preferências e, na nova janela, navegue até Ferramentas externas. Altere o Editor de Script Externo para Visual Studio 2017. Feche a janela Preferências.

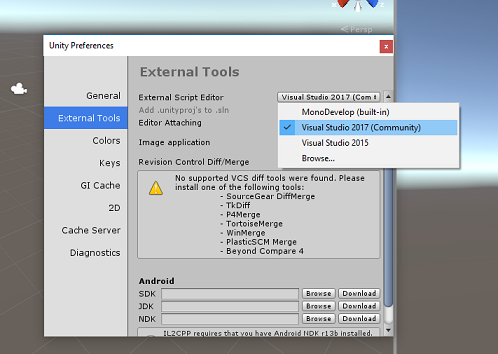

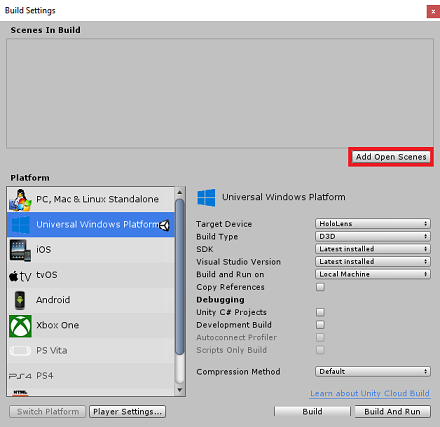

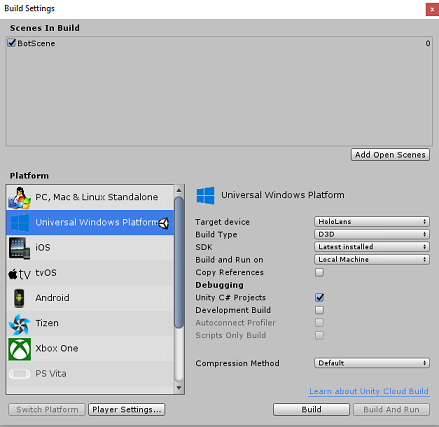

Em seguida, vá para Configurações de compilação de arquivo > e selecione Plataforma Universal do Windows e clique no botão Alternar plataforma para aplicar sua seleção.

Enquanto ainda estiver nas configurações de compilação de arquivo > e certifique-se de que:

O dispositivo de destino está definido como HoloLens

Para os headsets imersivos, defina Dispositivo de destino como Qualquer dispositivo.

O Tipo de Construção está definido como D3D

O SDK está definido como Instalado mais recente

A versão do Visual Studio está definida como Mais recente instalado

Build and Run está definido como Computador Local

Salve a cena e adicione-a à compilação.

Faça isso selecionando Adicionar cenas abertas. Uma janela de salvamento aparecerá.

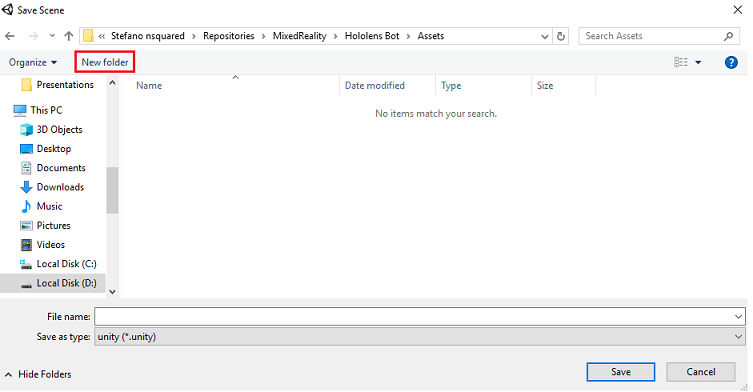

Crie uma nova pasta para esta e qualquer cena futura e, em seguida, selecione o botão Nova pasta , para criar uma nova pasta, nomeie-a como Cenas.

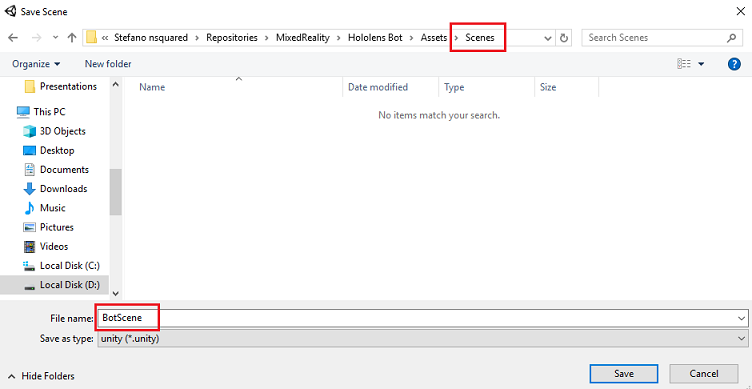

Abra a pasta Cenas recém-criada e, no campo de texto Nome do arquivo:, digite BotScene e clique em Salvar.

As configurações restantes, em Configurações de Build, devem ser deixadas como padrão por enquanto.

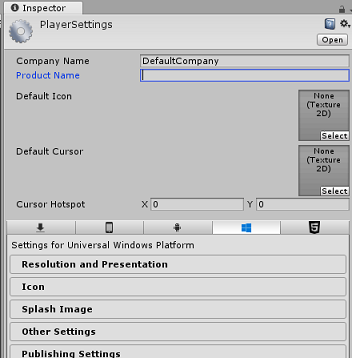

Na janela Configurações de construção, clique no botão Configurações do player, isso abrirá o painel relacionado no espaço onde o Inspetor está localizado.

Neste painel, algumas configurações precisam ser verificadas:

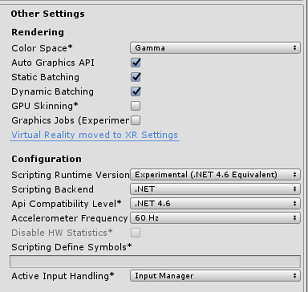

Na guia Outras configurações:

A versão do tempo de execução do script deve ser experimental (equivalente ao NET 4.6); alterar isso exigirá uma reinicialização do Editor.

O back-end de script deve ser .NET

O nível de compatibilidade da API deve ser .NET 4.6

Na guia Configurações de Publicação, em Recursos, marque:

InternetClient

Microfone

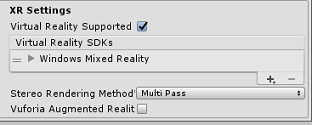

Mais abaixo no painel, em Configurações XR (encontradas abaixo de Configurações de Publicação), marque Realidade Virtual com Suporte, verifique se o SDK do Windows Mixed Reality foi adicionado.

De volta às configurações de compilação Os projetos do Unity C# não estão mais esmaecidos; marque a caixa de seleção ao lado dela.

Feche a janela Configurações de Build.

Salve sua cena e projeto (FILE > SAVE SCENE / FILE > SAVE PROJECT).

Capítulo 5 - Configuração da câmera

Importante

Se você quiser ignorar o componente Configuração do Unity deste curso e continuar direto para o código, sinta-se à vontade para baixar este Azure-MR-312-Package.unitypackage, importá-lo para seu projeto como um Pacote Personalizado e continuar do Capítulo 7.

No painel Hierarquia, selecione a Câmera principal.

Uma vez selecionado, você poderá ver todos os componentes da câmera principal no painel Inspetor.

- O objeto Camera deve ser nomeado Main Camera (observe a ortografia)

- A tag da câmera principal deve ser definida como MainCamera (observe a ortografia)

- Certifique-se de que a Posição de transformação esteja definida como 0, 0, 0

- Defina Sinalizadores claros como cor sólida.

- Defina a Cor de fundo do componente Câmera como Preto, Alfa 0 (Código hexadecimal: #00000000)

Capítulo 6 - Importe a biblioteca Newtonsoft

Para ajudá-lo a desserializar e serializar objetos recebidos e enviados para o Serviço de Bot, você precisa baixar a biblioteca Newtonsoft . Você encontrará uma versão compatível já organizada com a estrutura de pastas correta do Unity aqui.

Para importar a biblioteca Newtonsoft para o seu projeto, use o Pacote Unity que acompanha este curso.

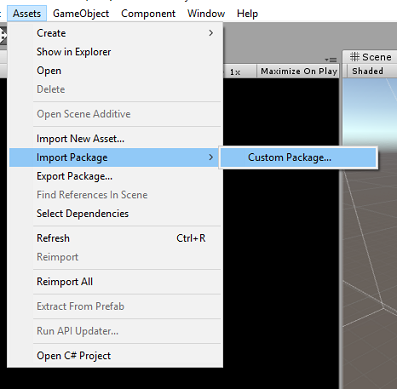

Adicione o .unitypackage ao Unity usando a opção de menu Pacote personalizado do pacote>de importação de ativos.>

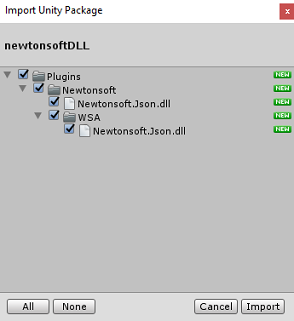

Na caixa Importar pacote do Unity que aparece, certifique-se de que tudo em (e incluindo) Plug-ins esteja selecionado.

Clique no botão Importar para adicionar os itens ao seu projeto.

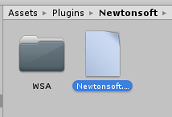

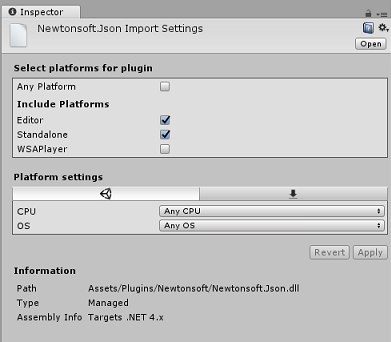

Vá para a pasta Newtonsoft em Plugins na visualização do projeto e selecione o plugin Newtonsoft.

Com o plug-in Newtonsoft selecionado, certifique-se de que Qualquer plataforma esteja desmarcada, certifique-se de que o WSAPlayer também esteja desmarcado e clique em Aplicar. Isso é apenas para confirmar que os arquivos estão configurados corretamente.

Observação

Marcar esses plug-ins os configura para serem usados apenas no Unity Editor. Há um conjunto diferente deles na pasta WSA que será usado depois que o projeto for exportado do Unity.

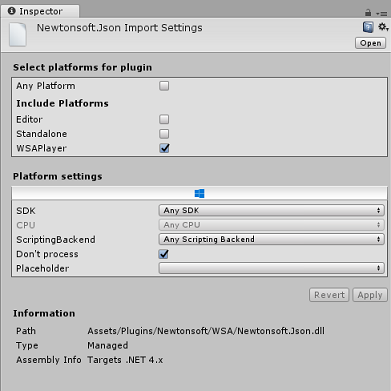

Em seguida, você precisa abrir a pasta WSA, dentro da pasta Newtonsoft. Você verá uma cópia do mesmo arquivo que acabou de configurar. Selecione o arquivo e, no inspetor, verifique se

- Qualquer plataforma está desmarcada

- somente WSAPlayer é verificado

- O processo não é verificado

Capítulo 7 - Criar o BotTag

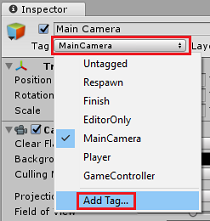

Crie um novo objeto Tag chamado BotTag. Selecione a câmera principal na cena. Clique no menu suspenso Tag no painel Inspetor. Clique em Adicionar tag.

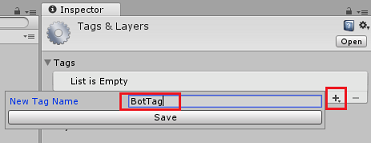

Clique no + símbolo. Nomeie a nova Tag como BotTag, Salve.

Aviso

Não aplique o BotTag à câmera principal. Se você fez isso acidentalmente, certifique-se de alterar a tag Main Camera de volta para MainCamera.

Capítulo 8 – Criar a classe BotObjects

O primeiro script que você precisa criar é a classe BotObjects , que é uma classe vazia criada para que uma série de outros objetos de classe possa ser armazenada no mesmo script e acessada por outros scripts na cena.

A criação dessa classe é puramente uma escolha arquitetônica, esses objetos podem ser hospedados no script Bot que você criará posteriormente neste curso.

Para criar essa classe:

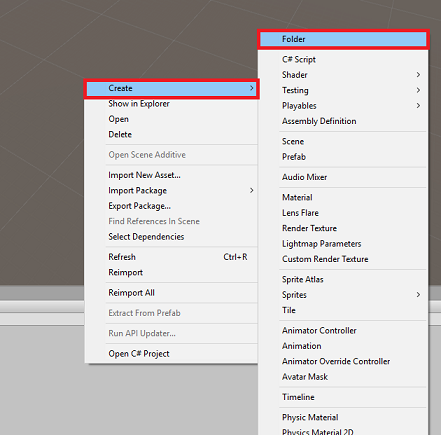

Clique com o botão direito do mouse no painel Projeto e, em seguida , em Criar > pasta. Nomeie a pasta Scripts.

Clique duas vezes na pasta Scripts para abri-la. Em seguida, dentro dessa pasta, clique com o botão direito do mouse e selecione Criar > Script C#. Nomeie o script BotObjects.

Clique duas vezes no novo script BotObjects para abri-lo com o Visual Studio.

Exclua o conteúdo do script e substitua-o pelo seguinte código:

using System; using System.Collections; using System.Collections.Generic; using UnityEngine; public class BotObjects : MonoBehaviour{} /// <summary> /// Object received when first opening a conversation /// </summary> [Serializable] public class ConversationObject { public string ConversationId; public string token; public string expires_in; public string streamUrl; public string referenceGrammarId; } /// <summary> /// Object including all Activities /// </summary> [Serializable] public class ActivitiesRootObject { public List<Activity> activities { get; set; } public string watermark { get; set; } } [Serializable] public class Conversation { public string id { get; set; } } [Serializable] public class From { public string id { get; set; } public string name { get; set; } } [Serializable] public class Activity { public string type { get; set; } public string channelId { get; set; } public Conversation conversation { get; set; } public string id { get; set; } public From from { get; set; } public string text { get; set; } public string textFormat { get; set; } public DateTime timestamp { get; set; } public string serviceUrl { get; set; } }Certifique-se de salvar suas alterações no Visual Studio antes de retornar ao Unity.

Capítulo 9 – Criar a classe GazeInput

A próxima classe que você criará é a classe GazeInput . Esta classe é responsável por:

- Criando um cursor que representará o olhar do jogador.

- Detectando objetos atingidos pelo olhar do jogador e mantendo uma referência aos objetos detectados.

Para criar essa classe:

Vá para a pasta Scripts que você criou anteriormente.

Clique com o botão direito do mouse dentro da pasta, Criar > Script C#. Chame o script de GazeInput.

Clique duas vezes no novo script GazeInput para abri-lo com o Visual Studio.

Insira a seguinte linha bem acima do nome da classe:

/// <summary> /// Class responsible for the User's gaze interactions /// </summary> [System.Serializable] public class GazeInput : MonoBehaviourEm seguida, adicione as seguintes variáveis dentro da classe GazeInput, acima do método Start():

[Tooltip("Used to compare whether an object is to be interacted with.")] internal string InteractibleTag = "BotTag"; /// <summary> /// Length of the gaze /// </summary> internal float GazeMaxDistance = 300; /// <summary> /// Object currently gazed /// </summary> internal GameObject FocusedObject { get; private set; } internal GameObject _oldFocusedObject { get; private set; } internal RaycastHit HitInfo { get; private set; } /// <summary> /// Cursor object visible in the scene /// </summary> internal GameObject Cursor { get; private set; } internal bool Hit { get; private set; } internal Vector3 Position { get; private set; } internal Vector3 Normal { get; private set; } private Vector3 _gazeOrigin; private Vector3 _gazeDirection;O código para o método Start() deve ser adicionado. Isso será chamado quando a classe for inicializada:

/// <summary> /// Start method used upon initialization. /// </summary> internal virtual void Start() { FocusedObject = null; Cursor = CreateCursor(); }Implemente um método que instanciará e configurará o cursor de foco:

/// <summary> /// Method to create a cursor object. /// </summary> internal GameObject CreateCursor() { GameObject newCursor = GameObject.CreatePrimitive(PrimitiveType.Sphere); newCursor.SetActive(false); // Remove the collider, so it does not block Raycast. Destroy(newCursor.GetComponent<SphereCollider>()); newCursor.transform.localScale = new Vector3(0.05f, 0.05f, 0.05f); Material mat = new Material(Shader.Find("Diffuse")); newCursor.GetComponent<MeshRenderer>().material = mat; mat.color = Color.HSVToRGB(0.0223f, 0.7922f, 1.000f); newCursor.SetActive(true); return newCursor; }Implemente os métodos que configurarão o Raycast da câmera principal e acompanharão o objeto focado atual.

/// <summary> /// Called every frame /// </summary> internal virtual void Update() { _gazeOrigin = Camera.main.transform.position; _gazeDirection = Camera.main.transform.forward; UpdateRaycast(); } /// <summary> /// Reset the old focused object, stop the gaze timer, and send data if it /// is greater than one. /// </summary> private void ResetFocusedObject() { // Ensure the old focused object is not null. if (_oldFocusedObject != null) { if (_oldFocusedObject.CompareTag(InteractibleTag)) { // Provide the OnGazeExited event. _oldFocusedObject.SendMessage("OnGazeExited", SendMessageOptions.DontRequireReceiver); } } } private void UpdateRaycast() { // Set the old focused gameobject. _oldFocusedObject = FocusedObject; RaycastHit hitInfo; // Initialize Raycasting. Hit = Physics.Raycast(_gazeOrigin, _gazeDirection, out hitInfo, GazeMaxDistance); HitInfo = hitInfo; // Check whether raycast has hit. if (Hit == true) { Position = hitInfo.point; Normal = hitInfo.normal; // Check whether the hit has a collider. if (hitInfo.collider != null) { // Set the focused object with what the user just looked at. FocusedObject = hitInfo.collider.gameObject; } else { // Object looked on is not valid, set focused gameobject to null. FocusedObject = null; } } else { // No object looked upon, set focused gameobject to null. FocusedObject = null; // Provide default position for cursor. Position = _gazeOrigin + (_gazeDirection * GazeMaxDistance); // Provide a default normal. Normal = _gazeDirection; } // Lerp the cursor to the given position, which helps to stabilize the gaze. Cursor.transform.position = Vector3.Lerp(Cursor.transform.position, Position, 0.6f); // Check whether the previous focused object is this same. If so, reset the focused object. if (FocusedObject != _oldFocusedObject) { ResetFocusedObject(); if (FocusedObject != null) { if (FocusedObject.CompareTag(InteractibleTag)) { // Provide the OnGazeEntered event. FocusedObject.SendMessage("OnGazeEntered", SendMessageOptions.DontRequireReceiver); } } } }Certifique-se de salvar suas alterações no Visual Studio antes de retornar ao Unity.

Capítulo 10 – Criar a classe Bot

O script que você vai criar agora é chamado de Bot. Esta é a classe principal do seu aplicativo, ela armazena:

- Suas credenciais de bot de aplicativo Web

- O método que coleta os comandos de voz do usuário

- O método necessário para iniciar conversas com seu Web App Bot

- O método necessário para enviar mensagens para o Bot do Aplicativo Web

Para enviar mensagens para o Serviço de Bot, a corrotina SendMessageToBot() criará uma atividade, que é um objeto reconhecido pelo Bot Framework como dados enviados pelo usuário.

Para criar essa classe:

Clique duas vezes na pasta Scripts para abri-la.

Clique com o botão direito do mouse dentro da pasta Scripts , clique em Criar > Script C#. Nomeie o script como Bot.

Clique duas vezes no novo script para abri-lo com o Visual Studio.

Atualize os namespaces para serem iguais aos seguintes, na parte superior da classe Bot :

using Newtonsoft.Json; using System.Collections; using System.Text; using UnityEngine; using UnityEngine.Networking; using UnityEngine.Windows.Speech;Dentro da classe Bot , adicione as seguintes variáveis:

/// <summary> /// Static instance of this class /// </summary> public static Bot Instance; /// <summary> /// Material of the sphere representing the Bot in the scene /// </summary> internal Material botMaterial; /// <summary> /// Speech recognizer class reference, which will convert speech to text. /// </summary> private DictationRecognizer dictationRecognizer; /// <summary> /// Use this variable to identify the Bot Id /// Can be any value /// </summary> private string botId = "MRBotId"; /// <summary> /// Use this variable to identify the Bot Name /// Can be any value /// </summary> private string botName = "MRBotName"; /// <summary> /// The Bot Secret key found on the Web App Bot Service on the Azure Portal /// </summary> private string botSecret = "-- Add your Secret Key here --"; /// <summary> /// Bot Endpoint, v4 Framework uses v3 endpoint at this point in time /// </summary> private string botEndpoint = "https://directline.botframework.com/v3/directline"; /// <summary> /// The conversation object reference /// </summary> private ConversationObject conversation; /// <summary> /// Bot states to regulate the application flow /// </summary> internal enum BotState {ReadyToListen, Listening, Processing} /// <summary> /// Flag for the Bot state /// </summary> internal BotState botState; /// <summary> /// Flag for the conversation status /// </summary> internal bool conversationStarted = false;Observação

Certifique-se de inserir sua chave secreta do bot na variável botSecret. Você terá anotado sua Chave Secreta do Bot no início deste curso, no Capítulo 2, etapa 10.

O código para Awake() e Start() agora precisa ser adicionado.

/// <summary> /// Called on Initialization /// </summary> void Awake() { Instance = this; } /// <summary> /// Called immediately after Awake method /// </summary> void Start() { botState = BotState.ReadyToListen; }Adicione os dois manipuladores que são chamados pelas bibliotecas de fala quando a captura de voz começa e termina. O DictationRecognizer interromperá automaticamente a captura da voz do usuário quando o usuário parar de falar.

/// <summary> /// Start microphone capture. /// </summary> public void StartCapturingAudio() { botState = BotState.Listening; botMaterial.color = Color.red; // Start dictation dictationRecognizer = new DictationRecognizer(); dictationRecognizer.DictationResult += DictationRecognizer_DictationResult; dictationRecognizer.Start(); } /// <summary> /// Stop microphone capture. /// </summary> public void StopCapturingAudio() { botState = BotState.Processing; dictationRecognizer.Stop(); }O manipulador a seguir coleta o resultado da entrada de voz do usuário e chama a corrotina responsável por enviar a mensagem para o Serviço de Bot do Aplicativo Web.

/// <summary> /// This handler is called every time the Dictation detects a pause in the speech. /// </summary> private void DictationRecognizer_DictationResult(string text, ConfidenceLevel confidence) { // Update UI with dictation captured Debug.Log($"User just said: {text}"); // Send dictation to Bot StartCoroutine(SendMessageToBot(text, botId, botName, "message")); StopCapturingAudio(); }A corrotina a seguir é chamada para iniciar uma conversa com o Bot. Você observará que, quando a chamada de conversa for concluída, ela chamará o SendMessageToCoroutine() passando uma série de parâmetros que definirão a atividade a ser enviada ao Serviço de Bot como uma mensagem vazia. Isso é feito para solicitar que o Serviço de Bot inicie o diálogo.

/// <summary> /// Request a conversation with the Bot Service /// </summary> internal IEnumerator StartConversation() { string conversationEndpoint = string.Format("{0}/conversations", botEndpoint); WWWForm webForm = new WWWForm(); using (UnityWebRequest unityWebRequest = UnityWebRequest.Post(conversationEndpoint, webForm)) { unityWebRequest.SetRequestHeader("Authorization", "Bearer " + botSecret); unityWebRequest.downloadHandler = new DownloadHandlerBuffer(); yield return unityWebRequest.SendWebRequest(); string jsonResponse = unityWebRequest.downloadHandler.text; conversation = new ConversationObject(); conversation = JsonConvert.DeserializeObject<ConversationObject>(jsonResponse); Debug.Log($"Start Conversation - Id: {conversation.ConversationId}"); conversationStarted = true; } // The following call is necessary to create and inject an activity of type //"conversationUpdate" to request a first "introduction" from the Bot Service. StartCoroutine(SendMessageToBot("", botId, botName, "conversationUpdate")); }A corrotina a seguir é chamada para criar a atividade a ser enviada ao Serviço de Bot.

/// <summary> /// Send the user message to the Bot Service in form of activity /// and call for a response /// </summary> private IEnumerator SendMessageToBot(string message, string fromId, string fromName, string activityType) { Debug.Log($"SendMessageCoroutine: {conversation.ConversationId}, message: {message} from Id: {fromId} from name: {fromName}"); // Create a new activity here Activity activity = new Activity(); activity.from = new From(); activity.conversation = new Conversation(); activity.from.id = fromId; activity.from.name = fromName; activity.text = message; activity.type = activityType; activity.channelId = "DirectLineChannelId"; activity.conversation.id = conversation.ConversationId; // Serialize the activity string json = JsonConvert.SerializeObject(activity); string sendActivityEndpoint = string.Format("{0}/conversations/{1}/activities", botEndpoint, conversation.ConversationId); // Send the activity to the Bot using (UnityWebRequest www = new UnityWebRequest(sendActivityEndpoint, "POST")) { www.uploadHandler = new UploadHandlerRaw(Encoding.UTF8.GetBytes(json)); www.downloadHandler = new DownloadHandlerBuffer(); www.SetRequestHeader("Authorization", "Bearer " + botSecret); www.SetRequestHeader("Content-Type", "application/json"); yield return www.SendWebRequest(); // extrapolate the response Id used to keep track of the conversation string jsonResponse = www.downloadHandler.text; string cleanedJsonResponse = jsonResponse.Replace("\r\n", string.Empty); string responseConvId = cleanedJsonResponse.Substring(10, 30); // Request a response from the Bot Service StartCoroutine(GetResponseFromBot(activity)); } }A corrotina a seguir é chamada para solicitar uma resposta após o envio de uma atividade para o Serviço de Bot.

/// <summary> /// Request a response from the Bot by using a previously sent activity /// </summary> private IEnumerator GetResponseFromBot(Activity activity) { string getActivityEndpoint = string.Format("{0}/conversations/{1}/activities", botEndpoint, conversation.ConversationId); using (UnityWebRequest unityWebRequest1 = UnityWebRequest.Get(getActivityEndpoint)) { unityWebRequest1.downloadHandler = new DownloadHandlerBuffer(); unityWebRequest1.SetRequestHeader("Authorization", "Bearer " + botSecret); yield return unityWebRequest1.SendWebRequest(); string jsonResponse = unityWebRequest1.downloadHandler.text; ActivitiesRootObject root = new ActivitiesRootObject(); root = JsonConvert.DeserializeObject<ActivitiesRootObject>(jsonResponse); foreach (var act in root.activities) { Debug.Log($"Bot Response: {act.text}"); SetBotResponseText(act.text); } botState = BotState.ReadyToListen; botMaterial.color = Color.blue; } }O último método a ser adicionado a esta classe é necessário para exibir a mensagem na cena:

/// <summary> /// Set the UI Response Text of the bot /// </summary> internal void SetBotResponseText(string responseString) { SceneOrganiser.Instance.botResponseText.text = responseString; }Observação

Você pode ver um erro no Console do Editor do Unity sobre a falta da classe SceneOrganiser . Desconsidere esta mensagem, pois você criará essa classe posteriormente no tutorial.

Certifique-se de salvar suas alterações no Visual Studio antes de retornar ao Unity.

Capítulo 11 – Criar a classe Interações

A classe que você vai criar agora é chamada de Interações. Essa classe é usada para detectar a entrada de toque do HoloLens do usuário.

Se o usuário tocar enquanto olha para o objeto Bot na cena e o Bot estiver pronto para ouvir entradas de voz, o objeto Bot mudará de cor para vermelho e começará a ouvir entradas de voz.

Essa classe herda da classe GazeInput e, portanto, é capaz de fazer referência ao método Start() e às variáveis dessa classe, indicadas pelo uso de base.

Para criar essa classe:

Clique duas vezes na pasta Scripts para abri-la.

Clique com o botão direito do mouse dentro da pasta Scripts , clique em Criar > Script C#. Nomeie o script como Interações.

Clique duas vezes no novo script para abri-lo com o Visual Studio.

Atualize os namespaces e a herança de classe para que sejam os mesmos que os seguintes, na parte superior da classe Interactions :

using UnityEngine.XR.WSA.Input; public class Interactions : GazeInput {Dentro da classe Interactions , adicione a seguinte variável:

/// <summary> /// Allows input recognition with the HoloLens /// </summary> private GestureRecognizer _gestureRecognizer;Em seguida, adicione o método Start():

/// <summary> /// Called on initialization, after Awake /// </summary> internal override void Start() { base.Start(); //Register the application to recognize HoloLens user inputs _gestureRecognizer = new GestureRecognizer(); _gestureRecognizer.SetRecognizableGestures(GestureSettings.Tap); _gestureRecognizer.Tapped += GestureRecognizer_Tapped; _gestureRecognizer.StartCapturingGestures(); }Adicione o manipulador que será disparado quando o usuário executar o gesto de toque na frente da câmera do HoloLens

/// <summary> /// Detects the User Tap Input /// </summary> private void GestureRecognizer_Tapped(TappedEventArgs obj) { // Ensure the bot is being gazed upon. if(base.FocusedObject != null) { // If the user is tapping on Bot and the Bot is ready to listen if (base.FocusedObject.name == "Bot" && Bot.Instance.botState == Bot.BotState.ReadyToListen) { // If a conversation has not started yet, request one if(Bot.Instance.conversationStarted) { Bot.Instance.SetBotResponseText("Listening..."); Bot.Instance.StartCapturingAudio(); } else { Bot.Instance.SetBotResponseText("Requesting Conversation..."); StartCoroutine(Bot.Instance.StartConversation()); } } } }Certifique-se de salvar suas alterações no Visual Studio antes de retornar ao Unity.

Capítulo 12 – Criar a classe SceneOrganiser

A última classe necessária neste laboratório é chamada SceneOrganiser. Essa classe configurará a cena programaticamente, adicionando componentes e scripts à Câmera Principal e criando os objetos apropriados na cena.

Para criar essa classe:

Clique duas vezes na pasta Scripts para abri-la.

Clique com o botão direito do mouse dentro da pasta Scripts , clique em Criar > Script C#. Nomeie o script como SceneOrganiser.

Clique duas vezes no novo script para abri-lo com o Visual Studio.

Dentro da classe SceneOrganiser adicione as seguintes variáveis:

/// <summary> /// Static instance of this class /// </summary> public static SceneOrganiser Instance; /// <summary> /// The 3D text representing the Bot response /// </summary> internal TextMesh botResponseText;Em seguida, adicione os métodos Awake() e Start():

/// <summary> /// Called on Initialization /// </summary> private void Awake() { Instance = this; } /// <summary> /// Called immediately after Awake method /// </summary> void Start () { // Add the GazeInput class to this object gameObject.AddComponent<GazeInput>(); // Add the Interactions class to this object gameObject.AddComponent<Interactions>(); // Create the Bot in the scene CreateBotInScene(); }Adicione o seguinte método, responsável por criar o objeto Bot na cena e configurar os parâmetros e componentes:

/// <summary> /// Create the Sign In button object in the scene /// and sets its properties /// </summary> private void CreateBotInScene() { GameObject botObjInScene = GameObject.CreatePrimitive(PrimitiveType.Sphere); botObjInScene.name = "Bot"; // Add the Bot class to the Bot GameObject botObjInScene.AddComponent<Bot>(); // Create the Bot UI botResponseText = CreateBotResponseText(); // Set properties of Bot GameObject Bot.Instance.botMaterial = new Material(Shader.Find("Diffuse")); botObjInScene.GetComponent<Renderer>().material = Bot.Instance.botMaterial; Bot.Instance.botMaterial.color = Color.blue; botObjInScene.transform.position = new Vector3(0f, 2f, 10f); botObjInScene.tag = "BotTag"; }Adicione o seguinte método, responsável por criar o objeto UI na cena, representando as respostas do Bot:

/// <summary> /// Spawns cursor for the Main Camera /// </summary> private TextMesh CreateBotResponseText() { // Create a sphere as new cursor GameObject textObject = new GameObject(); textObject.transform.parent = Bot.Instance.transform; textObject.transform.localPosition = new Vector3(0,1,0); // Resize the new cursor textObject.transform.localScale = new Vector3(0.1f, 0.1f, 0.1f); // Creating the text of the Label TextMesh textMesh = textObject.AddComponent<TextMesh>(); textMesh.anchor = TextAnchor.MiddleCenter; textMesh.alignment = TextAlignment.Center; textMesh.fontSize = 50; textMesh.text = "Hi there, tap on me and I will start listening."; return textMesh; }Certifique-se de salvar suas alterações no Visual Studio antes de retornar ao Unity.

No Editor do Unity, arraste o script SceneOrganiser da pasta Scripts para a Câmera Principal. O componente Organizador de cena agora deve aparecer no objeto Câmera principal, como mostrado na imagem abaixo.

Capítulo 13 – Antes de construir

Para executar um teste completo do aplicativo, você precisará carregá-lo no HoloLens. Antes de fazer isso, certifique-se de que:

- Todas as configurações mencionadas no Capítulo 4 estão definidas corretamente.

- O script SceneOrganiser é anexado ao objeto Main Camera .

- Na classe Bot, verifique se você inseriu a Chave Secreta do Bot na variável botSecret.

Capítulo 14 – Criar e fazer sideload para o HoloLens

Tudo o que é necessário para a seção Unity deste projeto foi concluído, então é hora de construí-lo a partir do Unity.

Navegue até Configurações de compilação, Configurações de compilação de arquivo > ....

Na janela Configurações de Compilação, clique em Compilar.

Se ainda não estiver, marque Projetos C# do Unity.

Clique em Compilar. O Unity abrirá uma janela do Explorador de Arquivos, onde você precisa criar e selecionar uma pasta para criar o aplicativo. Crie essa pasta agora e nomeie-a como App. Em seguida, com a pasta App selecionada, clique em Select Folder.

O Unity começará a criar seu projeto na pasta App .

Depois que o Unity terminar de compilar (pode levar algum tempo), ele abrirá uma janela do Explorador de Arquivos no local da compilação (verifique a barra de tarefas, pois nem sempre ela aparece acima das janelas, mas notificará você sobre a adição de uma nova janela).

Capítulo 15 – Implantar no HoloLens

Para implantar no HoloLens:

Você precisará do endereço IP do HoloLens (para implantação remota) e garantir que o HoloLens esteja no modo de desenvolvedor. Para fazer isso:

- Enquanto estiver usando seu HoloLens, abra as Configurações.

- Ir para Rede e Internet > Wi-Fi > Opções avançadas

- Observe o endereço IPv4 .

- Em seguida, navegue de volta para Configurações e, em seguida, para Atualização e segurança > para desenvolvedores

- Ative o modo de desenvolvedor.

Navegue até o novo build do Unity (a pasta App ) e abra o arquivo de solução com o Visual Studio.

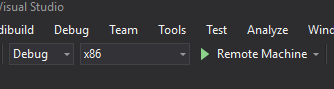

Na Configuração da Solução, selecione Depurar.

Na Plataforma de Soluções, selecione x86, Computador Remoto.

Vá para o menu Compilar e clique em Implantar Solução para fazer o sideload do aplicativo no HoloLens.

Seu aplicativo agora deve aparecer na lista de aplicativos instalados em seu HoloLens, pronto para ser iniciado!

Observação

Para implantar no headset imersivo, defina a Plataforma de Solução como Computador Local e defina a Configuração como Depurar, com x86 como a Plataforma. Em seguida, implante no computador local, usando o menu Compilar, selecionando Implantar Solução.

Capítulo 16 – Usando o aplicativo no HoloLens

Depois de iniciar o aplicativo, você verá o Bot como uma esfera azul à sua frente.

Use o gesto de toque enquanto estiver olhando para a esfera para iniciar uma conversa.

Aguarde o início da conversa (a interface do usuário exibirá uma mensagem quando isso acontecer). Depois de receber a mensagem introdutória do Bot, toque novamente no Bot para que ele fique vermelho e comece a ouvir sua voz.

Depois que você parar de falar, seu aplicativo enviará sua mensagem ao Bot e você receberá imediatamente uma resposta que será exibida na interface do usuário.

Repita o processo para enviar mais mensagens para o seu Bot (você deve tocar sempre que quiser enviar uma mensagem).

Esta conversa demonstra como o Bot pode reter informações (seu nome), ao mesmo tempo em que fornece informações conhecidas (como os itens que estão estocados).

Algumas perguntas a serem feitas ao Bot:

what do you sell?

how much are umbrellas?

how much are raincoats?

Seu aplicativo Web App Bot (v4) concluído

Parabéns, você criou um aplicativo de realidade misturada que aproveita o Bot do Aplicativo Web do Azure, o Microsoft Bot Framework v4.

Exercícios de bônus

Exercício 1

A estrutura de conversação neste laboratório é muito básica. Use o Microsoft LUIS para fornecer recursos de compreensão de linguagem natural ao bot.

Exercício 2

Este exemplo não inclui encerrar uma conversa e reiniciar uma nova. Para completar o recurso Bot, tente implementar o encerramento da conversa.