Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

Neste início rápido, você usa o assistente Importar e vetorizar dados no portal do Azure para começar a pesquisar multimodal. O assistente simplifica o processo de extração, fragmentação, vetorização e carregamento de texto e imagens em um índice pesquisável.

Ao contrário do Guia de início rápido: pesquisa vetorial no portal do Azure, que processa imagens simples contendo texto, este guia de início rápido oferece suporte ao processamento avançado de imagens para cenários RAG multimodais.

Este início rápido usa um PDF multimodal do repositório Azure-Search-Sample-Data. No entanto, você pode usar arquivos diferentes e ainda concluir este início rápido.

Pré-requisitos

Uma conta do Azure com uma assinatura ativa. Crie uma conta gratuitamente.

Um serviço Azure AI Search. Recomendamos a camada Básica ou superior.

Uma conta de Armazenamento do Azure. Use o Armazenamento de Blobs do Azure ou o Azure Data Lake Storage Gen2 (conta de armazenamento com um namespace hierárquico) em uma conta de desempenho padrão (v2 de uso geral). As camadas de acesso podem ser quentes, frescas ou frias.

Familiaridade com o assistente. Consulte Importar assistentes de dados no portal do Azure.

Métodos de extração suportados

Para extração de conteúdo, você pode escolher a extração padrão por meio da Pesquisa de IA do Azure ou a extração aprimorada por meio do Azure AI Document Intelligence. A tabela a seguir descreve ambos os métodos de extração.

| Método | Descrição |

|---|---|

| Extração padrão | Extrai metadados de localização apenas de imagens PDF. Não requer outro recurso de IA do Azure. |

| Extração melhorada | Extrai metadados de localização de texto e imagens para vários tipos de documentos. Requer um recurso multisserviço de serviços de IA do Azure1 em uma região com suporte. |

1 Para fins de cobrança, você deve anexar seu recurso multisserviço do Azure AI ao conjunto de habilidades em seu serviço Azure AI Search. A menos que você use uma conexão sem chave para criar o conjunto de habilidades, ambos os recursos devem estar na mesma região.

Métodos de incorporação suportados

Para incorporação de conteúdo, você pode escolher verbalização de imagem (seguida de vetorização de texto) ou incorporações multimodais. As instruções de implantação para os modelos são fornecidas em uma seção posterior. A tabela a seguir descreve ambos os métodos de incorporação.

| Método | Descrição | Modelos suportados |

|---|---|---|

| Verbalização de imagens | Usa um LLM para gerar descrições de imagens em linguagem natural e, em seguida, usa um modelo de incorporação para vetorizar texto simples e imagens verbalizadas. Requer um recurso do Azure OpenAI1, 2 ou um projeto do Azure AI Foundry. Para vetorização de texto, você também pode usar um recurso multisserviço 3 de serviços de IA do Azure em uma região com suporte. |

LLMs: GPT-4O GPT-4o-mini phi-4 4 Modelos de incorporação: incorporação de texto ada 002 incorporação de texto-3-pequeno incorporação de texto-3-grande |

| Incorporações multimodais | Usa um modelo de incorporação para vetorizar diretamente texto e imagens. Requer um projeto do Azure AI Foundry ou um recurso multisserviço 3 de serviços de IA do Azure em uma região com suporte. |

Cohere-embed-v3-inglês Cohere-embed-v3-multilíngue |

1 O endpoint do seu recurso OpenAI do Azure deve ter um subdomínio personalizado, como https://my-unique-name.openai.azure.com. Se você criou seu recurso no portal do Azure, esse subdomínio foi gerado automaticamente durante a configuração do recurso.

2 Os recursos do Azure OpenAI (com acesso a modelos de incorporação) que foram criados no portal do Azure AI Foundry não são suportados. Você deve criar um recurso do Azure OpenAI no portal do Azure.

3 Para fins de cobrança, você deve anexar seu recurso multisserviço do Azure AI ao conjunto de habilidades em seu serviço Azure AI Search. A menos que você use uma conexão sem chave (visualização) para criar o conjunto de habilidades, ambos os recursos devem estar na mesma região.

phi-4 4 só está disponível para projetos do Azure AI Foundry.

Requisitos do ponto final público

Todos os recursos anteriores devem ter acesso público habilitado para que os nós do portal do Azure possam acessá-los. Caso contrário, o assistente falhará. Depois que o assistente for executado, você poderá habilitar firewalls e pontos de extremidade privados nos componentes de integração para segurança. Para obter mais informações, consulte Conexões seguras nos assistentes de importação.

Se os pontos de extremidade privados já estiverem presentes e não seja possível desativá-los, a alternativa é executar o respetivo fluxo integral de um script ou programa numa máquina virtual. A máquina virtual deve estar na mesma rede virtual que o ponto de extremidade privado. Aqui está um exemplo de código Python para vetorização integrada. O mesmo repositório GitHub tem exemplos em outras linguagens de programação.

Verificar o espaço

Se você está começando com o serviço gratuito, você está limitado a três índices, três fontes de dados, três conjuntos de habilidades e três indexadores. Certifique-se de que tem espaço para itens adicionais antes de começar. Este guia de início rápido cria um de cada objeto.

Configurar o acesso

Antes de começar, certifique-se de que tem permissões para aceder a conteúdos e operações. Recomendamos a autenticação do Microsoft Entra ID e o acesso baseado em função para autorização. Você deve ser um Proprietário ou Administrador de Acesso de Usuário para atribuir funções. Se as funções não forem viáveis, pode usar autenticação baseada em chave em vez disso.

Configure as funções necessárias e as funções condicionais identificadas nesta secção.

Funções obrigatórias

A Pesquisa de IA do Azure e o Armazenamento do Azure são necessários para todos os cenários de pesquisa multimodal.

O Azure AI Search fornece o pipeline multimodal. Configure o acesso para si e para o seu serviço de pesquisa para ler dados, executar o pipeline e interagir com outros recursos do Azure.

No seu serviço Azure AI Search:

Habilite o acesso baseado em função.

Atribua as seguintes funções a si mesmo:

Colaborador do Serviço de Pesquisa

Contribuidor de dados do índice de pesquisa

Leitor de dados de índice de pesquisa

Funções condicionais

As abas a seguir abrangem todos os recursos compatíveis com o assistente para pesquisa multimodal. Selecione apenas as guias que se aplicam ao método de extração e ao método de incorporação escolhidos.

O Azure OpenAI fornece LLMs para verbalização de imagens e modelos de incorporação para vetorização de texto e imagem. Seu serviço de pesquisa requer acesso para chamar a habilidade GenAI Prompt e a habilidade Azure OpenAI Embedding.

No seu recurso do Azure OpenAI:

- Atribua o Usuário OpenAI de Serviços Cognitivos à sua identidade de serviço de pesquisa.

Preparar dados de exemplo

Este guia de início rápido usa um PDF multimodal de exemplo, mas você também pode usar seus próprios arquivos. Caso esteja a utilizar um serviço de pesquisa gratuito, use menos de 20 ficheiros para permanecer dentro do limite gratuito para o processamento de enriquecimento.

Para preparar os dados de exemplo para este início rápido:

Entre no portal do Azure e selecione sua conta de Armazenamento do Azure.

No painel esquerdo, selecione Contêineres de armazenamento de> dados.

Crie um contêiner e, em seguida, carregue o PDF de exemplo para o contêiner.

Crie outro contêiner para armazenar imagens extraídas do PDF.

Implantar modelos

O assistente oferece várias opções para incorporação de conteúdo. A verbalização de imagens requer um LLM para descrever imagens e um modelo de incorporação para vetorizar texto e conteúdo de imagem, enquanto as incorporações multimodais diretas requerem apenas um modelo de incorporação. Estes modelos estão disponíveis através do Azure OpenAI e do Azure AI Foundry.

Observação

Se estiver a utilizar o Azure AI Vision, ignore este passo. As incorporações multimodais são incorporadas ao seu recurso multisserviço de IA do Azure e não exigem implantação de modelo.

Para implantar os modelos para este início rápido:

Inicie sessão no portal do Azure AI Foundry.

Selecione seu recurso do Azure OpenAI ou o projeto do Azure AI Foundry.

No painel esquerdo, selecione Catálogo de modelos.

Implante os modelos necessários para o método de incorporação escolhido.

Iniciar o assistente

Para iniciar o assistente de pesquisa multimodal:

Entre no portal do Azure e selecione seu serviço Azure AI Search.

Na página Visão geral, selecione Importar e vetorizar dados.

Selecione sua fonte de dados: Azure Blob Storage ou Azure Data Lake Storage Gen2.

Selecione Multimodal RAG.

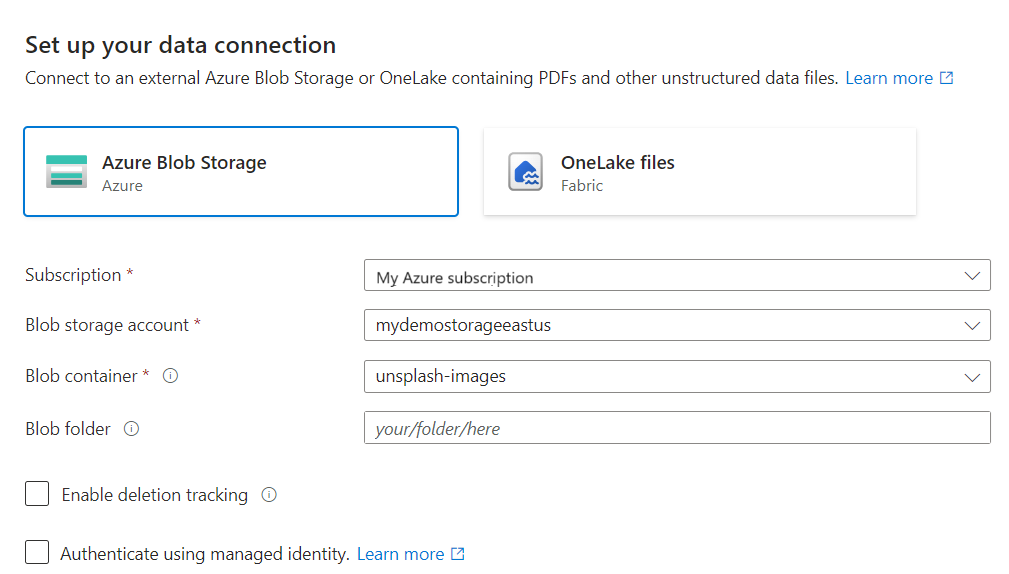

Ligar aos dados

O Azure AI Search requer uma conexão com uma fonte de dados para ingestão e indexação de conteúdo. Nesse caso, a fonte de dados é sua conta de Armazenamento do Azure.

Para se conectar aos seus dados:

Na página Conectar aos seus dados , especifique sua assinatura do Azure.

Selecione a conta de armazenamento e o contêiner para o qual você carregou os dados de exemplo.

Marque a caixa de seleção Autenticar usando identidade gerenciada . Deixe o tipo de identidade como atribuído pelo sistema.

Selecione Seguinte.

Extraia o seu conteúdo

Dependendo do método de extração escolhido, o assistente fornece opções de configuração para quebra e fragmentação de documentos.

O método padrão chama a habilidade Extração de Documentos para extrair conteúdo de texto e gerar imagens normalizadas de seus documentos. A habilidade Divisão de texto é então chamada para dividir o conteúdo de texto extraído em páginas.

Para usar a habilidade Extração de Documentos:

Incorpore o seu conteúdo

Durante esta etapa, o assistente usa o método de incorporação escolhido para gerar representações vetoriais de texto e imagens.

O assistente virtual utiliza uma função para criar texto descritivo para imagens (verbalização de imagem) e outra função para criar representações vetoriais para texto e imagens.

Para verbalização de imagens, a habilidade GenAI Prompt usa seu LLM implantado para analisar cada imagem extraída e produzir uma descrição em linguagem natural.

Para incorporações, a habilidade de incorporação do Azure OpenAI, a habilidade AML ou a habilidade de incorporação multimodal do Azure AI Vision usa seu modelo de incorporação implantado para converter blocos de texto e descrições verbalizadas em vetores de alta dimensão. Estes vetores possibilitam a análise de similaridade e a recuperação híbrida.

Para usar as competências na verbalização de imagens:

Na página Incorporação de conteúdo , selecione Verbalização de imagem.

Na guia Verbalização de imagem :

Para o tipo, selecione o seu provedor LLM: Azure OpenAI ou modelos de catálogo do AI Foundry Hub.

Especifique sua assinatura, recurso e implantação do LLM do Azure.

Para o tipo de autenticação, selecione Identidade atribuída ao sistema.

Marque a caixa de seleção que reconhece os efeitos de faturamento do uso desses recursos.

Na guia Vetorização de texto:

Para o tipo, selecione seu provedor de modelo: Azure OpenAI, modelos de catálogo do AI Foundry Hub ou vetorização do AI Vision.

Especifique sua assinatura, recurso e implantação de modelo de incorporação do Azure.

Para o tipo de autenticação, selecione Identidade atribuída ao sistema.

Marque a caixa de seleção que reconhece os efeitos de faturamento do uso desses recursos.

Selecione Seguinte.

Armazene as imagens extraídas

A próxima etapa é enviar imagens extraídas de seus documentos para o Armazenamento do Azure. No Azure AI Search, esse armazenamento secundário é conhecido como um repositório de conhecimento.

Para armazenar as imagens extraídas:

Na página Saída de imagem , especifique sua assinatura do Azure.

Selecione a conta de armazenamento e o contêiner de blob que você criou para armazenar as imagens.

Marque a caixa de seleção Autenticar usando identidade gerenciada . Deixe o tipo de identidade como atribuído pelo sistema.

Selecione Seguinte.

Mapear novos campos

Na página Configurações avançadas , você pode, opcionalmente, adicionar campos ao esquema de índice. Por predefinição, o assistente gera os campos descritos na tabela a seguir.

| Campo | Aplica-se ao | Descrição | Atributos |

|---|---|---|---|

| id_conteúdo | Vetores de texto e imagem | Campo String. Chave do documento para o índice. | Recuperável, classificável e pesquisável. |

| título do documento | Vetores de texto e imagem | Campo String. Título do documento legível por humanos. | Recuperável e pesquisável. |

| text_document_id | Vetores de texto | Campo String. Identifica o documento pai do qual o bloco de texto se origina. | Recuperável e filtrável. |

| identificador_documento_imagem | Vetores de imagem | Campo String. Identifica o documento pai do qual a imagem se origina. | Recuperável e filtrável. |

| content_text | Vetores de texto | Campo String. Versão legível por humanos do bloco de texto. | Recuperável e pesquisável. |

| incorporação_de_conteúdo | Vetores de texto e imagem | Coleção (Edm.Single). Representação vetorial de texto e imagens. | Recuperável e pesquisável. |

| caminho_do_conteúdo | Vetores de texto e imagem | Campo String. Caminho para o conteúdo no contêiner de armazenamento. | Recuperável e pesquisável. |

| metadadosDeLocalização | Vetores de imagem | Edm.ComplexType. Contém metadados sobre a localização da imagem nos documentos. | Varia de acordo com o campo. |

Não é possível modificar os campos gerados ou seus atributos, mas você pode adicionar campos se sua fonte de dados fornecê-los. Por exemplo, o Armazenamento de Blobs do Azure fornece uma coleção de campos de metadados.

Para adicionar campos ao esquema de índice:

Em Campos de índice, selecione Visualizar e editar.

Selecione Adicionar campo.

Selecione um campo de origem nos campos disponíveis, insira um nome de campo para o índice e aceite (ou substitua) o tipo de dados padrão.

Se quiser restaurar o esquema para sua versão original, selecione Redefinir.

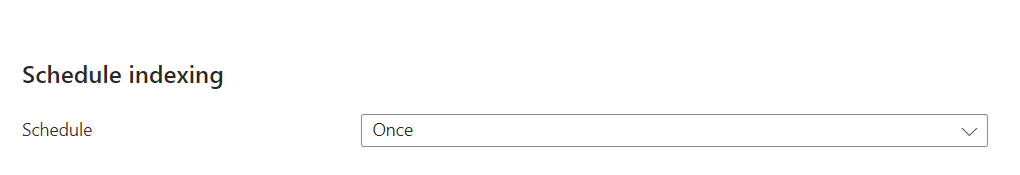

Indexação de agendas

Para fontes de dados em que os dados subjacentes são voláteis, você pode agendar a indexação para capturar alterações em intervalos específicos ou datas e horas específicas.

Para agendar a indexação:

Na página Configurações avançadas , em Indexação de agenda, especifique uma agenda de execução para o indexador. Recomendamos Once para este começo rápido.

Selecione Seguinte.

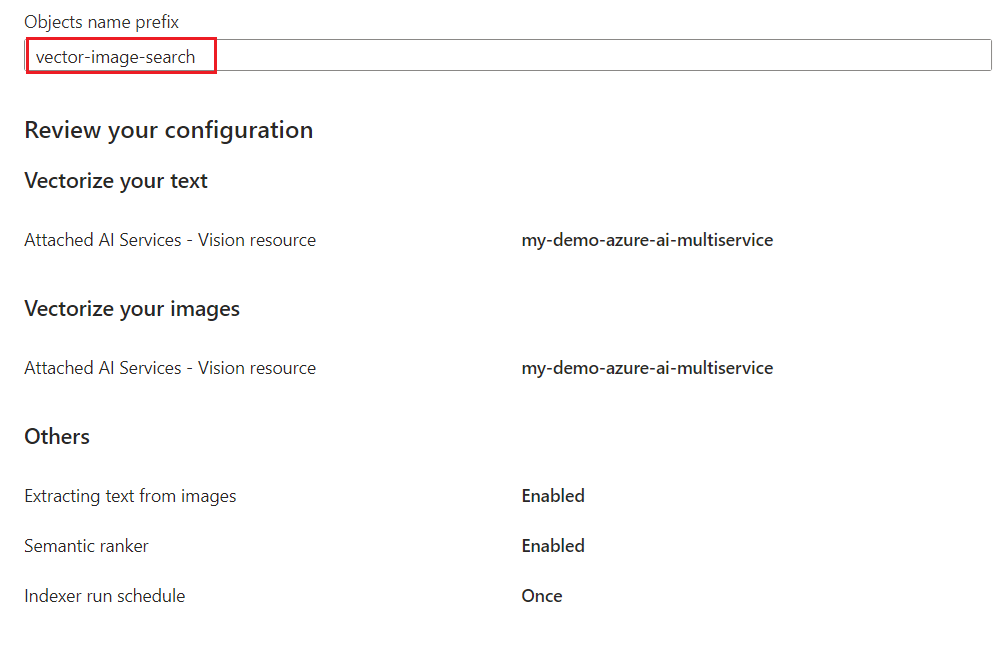

Concluir o assistente

O passo final é rever a sua configuração e criar os objetos necessários para a pesquisa multimodal. Se necessário, volte às páginas anteriores do assistente para ajustar a configuração.

Para concluir o assistente:

Na página Revisar e criar , especifique um prefixo para os objetos que o assistente criará. Um prefixo comum ajuda-o a manter-se organizado.

Selecione Criar.

Quando o assistente conclui a configuração, ele cria os seguintes objetos:

Um indexador que conduz o pipeline de indexação.

Uma conexão de fonte de dados com o Armazenamento de Blobs do Azure.

Um índice com campos de texto, campos vetoriais, vetorizadores, perfis vetoriais e algoritmos vetoriais. Durante o fluxo de trabalho do assistente, não é possível modificar o índice padrão. Os índices estão em conformidade com a API REST 2024-05-01-preview para que você possa usar os recursos de visualização.

Um conjunto de competências com as seguintes aptidões:

A competência de Extração de Documentos ou competência de Layout de Documento extrai texto e imagens de documentos de origem. A habilidade Divisão de Texto acompanha a habilidade Extração de Documentos para fragmentação de dados, enquanto a habilidade Layout de Documento tem fragmentação interna.

A habilidade GenAI Prompt verbaliza imagens em linguagem natural. Se você estiver usando incorporações multimodais diretas, essa habilidade está ausente.

A habilidade de incorporação do Azure OpenAI, a habilidade AML ou a habilidade de incorporação multimodal do Azure AI Vision são chamadas uma vez para vetorização de texto e uma vez para vetorização de imagem.

A habilidade Shaper enriquece a saída com metadados e cria novas imagens com informações contextuais.

Sugestão

Os objetos criados pelo assistente têm definições JSON configuráveis. Para exibir ou modificar essas definições, selecione Gerenciamento de pesquisa no painel esquerdo, onde você pode exibir seus índices, indexadores, fontes de dados e conjuntos de habilidades.

Ver resultados

Este guia de início rápido cria um índice multimodal que suporta pesquisa híbrida em texto e imagens. A menos que você use incorporações multimodais diretas, o índice não aceita imagens como entradas de consulta, o que requer a habilidade AML ou a habilidade de incorporações multimodais do Azure AI Vision com um vetorizador equivalente. Para obter mais informações, consulte Configurar um vetorizador em um índice de pesquisa.

A pesquisa híbrida combina consultas de texto completo e consultas vetoriais. Quando você emite uma consulta híbrida, o mecanismo de pesquisa calcula a semelhança semântica entre sua consulta e os vetores indexados e classifica os resultados de acordo. Para o índice criado neste início rápido, os resultados apresentam conteúdo do campo content_text que está estreitamente alinhado com a sua consulta.

Para consultar o seu índice multimodal:

Entre no portal do Azure e selecione seu serviço Azure AI Search.

No painel esquerdo, selecione Gerenciamento de pesquisa>Índices.

Selecione o seu índice.

Selecione Opções de consulta e, em seguida, selecione Ocultar valores de vetor nos resultados da pesquisa. Esta etapa torna os resultados mais legíveis.

Introduza o texto que pretende pesquisar. O nosso exemplo usa

energy.Para executar a consulta, selecione Pesquisar.

Os resultados JSON devem incluir conteúdo de texto e imagem relacionado ao

energyno seu índice. Se você habilitou o classificador semântico, a matriz fornece@search.answersconcisas e de alta confiança para ajudá-lo a identificar rapidamente correspondências relevantes."@search.answers": [ { "key": "a71518188062_aHR0cHM6Ly9oYWlsZXlzdG9yYWdlLmJsb2IuY29yZS53aW5kb3dzLm5ldC9tdWx0aW1vZGFsLXNlYXJjaC9BY2NlbGVyYXRpbmctU3VzdGFpbmFiaWxpdHktd2l0aC1BSS0yMDI1LnBkZg2_normalized_images_7", "text": "A vertical infographic consisting of three sections describing the roles of AI in sustainability: 1. **Measure, predict, and optimize complex systems**: AI facilitates analysis, modeling, and optimization in areas like energy distribution, resource allocation, and environmental monitoring. **Accelerate the development of sustainability solution...", "highlights": "A vertical infographic consisting of three sections describing the roles of AI in sustainability: 1. **Measure, predict, and optimize complex systems**: AI facilitates analysis, modeling, and optimization in areas like<em> energy distribution, </em>resource<em> allocation, </em>and environmental monitoring. **Accelerate the development of sustainability solution...", "score": 0.9950000047683716 }, { "key": "1cb0754930b6_aHR0cHM6Ly9oYWlsZXlzdG9yYWdlLmJsb2IuY29yZS53aW5kb3dzLm5ldC9tdWx0aW1vZGFsLXNlYXJjaC9BY2NlbGVyYXRpbmctU3VzdGFpbmFiaWxpdHktd2l0aC1BSS0yMDI1LnBkZg2_text_sections_5", "text": "...cross-laminated timber.8 Through an agreement with Brookfield, we aim 10.5 gigawatts (GW) of renewable energy to the grid.910.5 GWof new renewable energy capacity to be developed across the United States and Europe.Play 4 Advance AI policy principles and governance for sustainabilityWe advocated for policies that accelerate grid decarbonization", "highlights": "...cross-laminated timber.8 Through an agreement with Brookfield, we aim <em> 10.5 gigawatts (GW) of renewable energy </em>to the<em> grid.910.5 </em>GWof new<em> renewable energy </em>capacity to be developed across the United States and Europe.Play 4 Advance AI policy principles and governance for sustainabilityWe advocated for policies that accelerate grid decarbonization", "score": 0.9890000224113464 }, { "key": "1cb0754930b6_aHR0cHM6Ly9oYWlsZXlzdG9yYWdlLmJsb2IuY29yZS53aW5kb3dzLm5ldC9tdWx0aW1vZGFsLXNlYXJjaC9BY2NlbGVyYXRpbmctU3VzdGFpbmFiaWxpdHktd2l0aC1BSS0yMDI1LnBkZg2_text_sections_50", "text": "ForewordAct... Similarly, we have restored degraded stream ecosystems near our datacenters from Racine, Wisconsin120 to Jakarta, Indonesia.117INNOVATION SPOTLIGHTAI-powered Community Solar MicrogridsDeveloping energy transition programsWe are co-innovating with communities to develop energy transition programs that align their goals with broader s.", "highlights": "ForewordAct... Similarly, we have restored degraded stream ecosystems near our datacenters from Racine, Wisconsin120 to Jakarta, Indonesia.117INNOVATION SPOTLIGHTAI-powered Community<em> Solar MicrogridsDeveloping energy transition programsWe </em>are co-innovating with communities to develop<em> energy transition programs </em>that align their goals with broader s.", "score": 0.9869999885559082 } ]

Limpeza de recursos

Este guia de início rápido usa recursos faturáveis do Azure. Se já não precisar dos recursos, elimine-os da sua subscrição para evitar encargos.

Próximos passos

Este guia de início rápido apresentou o assistente Importar e vetorizar dados , que cria todos os objetos necessários para a pesquisa multimodal. Para explorar cada etapa em detalhes, consulte os seguintes tutoriais: