Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

Importante

Traduções que não sejam em inglês são fornecidas apenas por conveniência. Consulte a EN-US versão deste documento para obter a versão vinculativa.

Este artigo fornece detalhes sobre como os dados fornecidos por você ao serviço Azure OpenAI são processados, usados e armazenados. O Azure OpenAI armazena e processa dados para fornecer o serviço e monitorizar utilizações que violem os termos do produto aplicáveis. Consulte também o Adendo de Proteção de Dados dos Produtos e Serviços da Microsoft, que rege o processamento de dados pelo Serviço OpenAI do Azure. O Azure OpenAI é um serviço do Azure; saiba mais sobre as ofertas de conformidade do Azure aplicáveis.

Importante

Seus prompts (entradas) e finalizações (saídas), suas incorporações e seus dados de treinamento:

- NÃO estão disponíveis para outros clientes.

- NÃO estão disponíveis para OpenAI.

- NÃO são usados para melhorar os modelos OpenAI.

- NÃO são usados para treinar, re-treinar ou melhorar os modelos de base do Serviço OpenAI do Azure.

- NÃO são utilizados para melhorar quaisquer produtos ou serviços da Microsoft ou de terceiros sem a sua permissão ou instrução.

- Seus modelos ajustados do Azure OpenAI estão disponíveis exclusivamente para seu uso.

O Serviço OpenAI do Azure é operado pela Microsoft como um serviço do Azure; A Microsoft hospeda os modelos OpenAI no ambiente Azure da Microsoft e o Serviço NÃO interage com nenhum serviço operado pela OpenAI (por exemplo, ChatGPT ou a API OpenAI).

Que dados o Serviço OpenAI do Azure processa?

O Azure OpenAI trata os seguintes tipos de dados:

- Prompts e conteúdo gerado. Os comandos são enviados pelo utilizador e o conteúdo é gerado pelo serviço, através das operações de conclusão, conclusão de chat, imagens e incorporações.

- Dados carregados. Você pode fornecer seus próprios dados para uso com determinados recursos de serviço (por exemplo, ajuste fino, API de assistentes, processamento em lote) usando a API de arquivos ou armazenamento vetorial.

- Dados para entidades com estado. Quando o utilizador utiliza determinados recursos opcionais do serviço Azure OpenAI, como o recurso Threads da API Assistentes e Concluídos armazenados, o serviço cria um armazenamento de dados para manter o histórico de mensagens e outros conteúdos, de acordo com a configuração do recurso.

- Dados enriquecidos incluídos com ou através de prompts. Quando utilizas dados associados a entidades com estado, o serviço recupera dados relevantes de um armazenamento de dados configurado e enriquece o prompt para produzir resultados baseados nos teus dados. Os prompts também podem ser aumentados com dados recuperados de uma fonte incluída no próprio prompt, como uma URL.

- Treinamento e validação de dados. Você pode fornecer os seus próprios dados de treino que consistem em pares de introdução e conclusão para a finalidade de ajustar finamente um modelo da OpenAI.

Como é que o Azure OpenAI Service trata dados?

O diagrama abaixo ilustra como é que os seus dados são tratados. Este diagrama abrange vários tipos de processamento:

- Como o Serviço OpenAI do Azure processa seus prompts por meio da inferência para gerar conteúdo (incluindo quando dados adicionais de uma fonte de dados designada são adicionados a um prompt usando o Azure OpenAI em seus dados, Assistentes ou processamento em lote).

- Como o recurso Assistentes armazena dados em relação a Mensagens, Threads e Execuções de Processos.

- Como a funcionalidade de lote processa os dados enviados.

- Como o Serviço OpenAI do Azure cria um modelo ajustado (personalizado) com seus dados carregados.

- Como o Serviço OpenAI do Azure e o pessoal da Microsoft analisam prompts e conclusões (texto e imagem) para conteúdo prejudicial e para padrões que sugerem o uso do serviço de uma maneira que viola o Código de Conduta ou outros termos de produto aplicáveis.

Conforme descrito no diagrama acima, os clientes gerenciados podem se candidatar para modificar o monitoramento de abuso.

Geração de resultados, imagens ou incorporações através do processo de inferência

Os modelos (básicos ou ajustados) implantados em seu recurso processam seus prompts de entrada e geram respostas com texto, imagens ou incorporações. As interações do cliente com o modelo são logicamente isoladas e seguras, empregando medidas técnicas, incluindo, entre outras, criptografia de transporte de TLS1.2 ou superior, perímetro de segurança de computação, tokenização de texto e acesso exclusivo à memória GPU alocada. Os prompts e as conclusões são avaliados em tempo real para tipos de conteúdo nocivo e a geração de conteúdo é filtrada com base nos limites configurados. Saiba mais em Filtragem de conteúdo do Serviço OpenAI do Azure.

Os prompts e respostas são processados dentro da geografia especificada pelo cliente (a menos que você esteja usando um tipo de implantação Global), mas podem ser processados entre regiões dentro da geografia para fins operacionais (incluindo gerenciamento de desempenho e capacidade). Consulte abaixo para obter informações sobre o local de processamento ao usar um tipo de implantação Global.

Os modelos são sem estado: nenhum prompt ou geração é armazenado no modelo. Além disso, prompts e gerações não são usados para treinar, reciclar ou melhorar os modelos básicos.

Noções básicas sobre o local de processamento para os tipos de implantação "Global" e "Data zone"

Além das implantações padrão, o Serviço OpenAI do Azure oferece opções de implantação rotuladas como 'Global' e 'DataZone'. Para qualquer tipo de implantação rotulado como "Global", prompts e respostas podem ser processados em qualquer geografia onde o modelo OpenAI do Azure relevante seja implantado (saiba mais sobre a disponibilidade de modelos de região). Para qualquer tipo de implantação rotulado como 'DataZone', solicitações e respostas podem ser processadas em qualquer geografia dentro da zona de dados especificada, conforme definido pela Microsoft. Se criar uma implementação do DataZone num recurso do Azure OpenAI localizado nos Estados Unidos, os prompts e respostas poderão ser processados em qualquer parte dos Estados Unidos. Se criar uma implementação do DataZone num recurso do Azure OpenAI localizado num Estado-Membro da União Europeia, as solicitações e respostas poderão ser processadas nesse ou em qualquer outro Estado-Membro da União Europeia. Para os tipos de implantação Global e DataZone, todos os dados armazenados em repouso, como dados carregados, são armazenados na geografia designada pelo cliente. Somente o local de processamento é afetado quando um cliente usa um tipo de implantação Global ou um tipo de implantação DataZone no Serviço OpenAI do Azure; Os compromissos de conformidade e processamento de dados do Azure permanecem aplicáveis.

Aumentar os prompts para "basear" os resultados gerados "nos seus dados"

O recurso "Azure OpenAI nos seus dados" permite conectar fontes de dados para fundamentar os resultados gerados com os seus dados. Os dados permanecem armazenados na fonte de dados e no local que você designar; O Serviço OpenAI do Azure não cria um armazenamento de dados duplicado. Quando uma solicitação do utilizador é recebida, o serviço recupera dados relevantes da fonte de dados conectada e enriquece a solicitação. O modelo processa esse prompt aumentado e o conteúdo gerado é retornado conforme descrito acima. Saiba mais sobre como usar o recurso Nos Seus Dados com segurança.

Armazenamento de dados para recursos do Serviço OpenAI do Azure

Algumas funcionalidades do Azure OpenAI Service armazenam dados no serviço. Estes dados são carregados pelo cliente, utilizando a API de Ficheiros ou o arquivo de vetores, ou são armazenados automaticamente relativamente a determinadas entidades com estado, como a funcionalidade Tópicos da API de Assistentes e as Conclusões armazenadas. Dados armazenados para funcionalidades do Azure OpenAI Service:

- É armazenado em repouso no recurso Azure OpenAI no locatário do Azure do cliente, dentro da mesma geografia que o recurso Azure OpenAI;

- É sempre encriptado em repouso com a encriptação AES-256 da Microsoft por predefinição, com a opção de utilizar uma chave gerida pelo cliente (determinadas funcionalidades de pré-visualização podem não suportar chaves geridas pelo cliente).

- Podem ser eliminados pelo cliente em qualquer altura.

Observação

Os recursos do Azure OpenAI na visualização podem não oferecer suporte a todas as condições acima.

Os dados armazenados podem ser usados com os seguintes recursos/capacidades de serviço:

- Criação de um modelo personalizado (ajustado). Saiba mais sobre como funciona o ajuste fino. Os modelos ajustados estão disponíveis exclusivamente para o cliente cujos dados foram usados para criar o modelo ajustado, são criptografados em repouso (quando não implantados para inferência) e podem ser excluídos pelo cliente a qualquer momento. Os dados de treinamento carregados para ajuste fino não são usados para treinar, treinar novamente ou melhorar quaisquer modelos básicos da Microsoft ou de terceiros.

- Processamento em lotes. Saiba mais sobre como funciona o processamento em lote. O processamento em lote é um tipo de implantação global; os dados armazenados em repouso permanecem na geografia designada do Azure até que a capacidade de processamento fique disponível; o processamento pode ocorrer em qualquer geografia onde o modelo OpenAI do Azure relevante é implantado (saiba mais sobre a disponibilidade de modelos de região).

- API de assistentes (pré-visualização). Saiba mais sobre como funciona a API de assistentes. Alguns recursos dos Assistentes, como Threads, armazenam o histórico de mensagens e outros conteúdos.

- Finalizações armazenadas (visualização). As finalizações armazenadas armazenam pares de entrada-saída dos modelos do Azure OpenAI implantados pelo cliente, como GPT-4o, por meio da API de conclusão de bate-papo, e exibem os pares no portal do Azure AI Foundry. Isso permite que os clientes criem conjuntos de dados com seus dados de produção, que podem ser usados para avaliar ou ajustar modelos (conforme permitido nos Termos do Produto aplicáveis).

Prevenir o abuso e a geração de conteúdos nocivos

Para reduzir o risco de uso prejudicial do Serviço Azure OpenAI, o Serviço Azure OpenAI inclui recursos de filtragem de conteúdo e monitoramento de abuso. Para saber mais sobre filtragem de conteúdo, consulte Filtragem de conteúdo do Serviço OpenAI do Azure. Para saber mais sobre o monitoramento de abuso, consulte Monitoramento de abuso.

A filtragem de conteúdo ocorre de forma síncrona à medida que o serviço processa solicitações para gerar conteúdo, conforme descrito acima e aqui. Nenhum prompt ou conteúdo gerado é armazenado nos modelos classificadores de conteúdo, e prompts e resultados não são usados para treinar, reaprender ou melhorar os modelos classificadores sem o seu consentimento.

As avaliações de segurança de modelos ajustados avaliam um modelo ajustado para respostas potencialmente prejudiciais usando as métricas de risco e segurança do Azure. Somente a avaliação resultante (implantável ou não implantável) é registrada pelo serviço.

O sistema de monitoramento de abuso do Azure OpenAI foi projetado para detetar e mitigar instâncias de conteúdo recorrente e/ou comportamentos que sugerem o uso do serviço de uma maneira que pode violar o código de conduta ou outros termos de produto aplicáveis. Como descrito aqui, o sistema emprega algoritmos e heurísticas para detetar indicadores de abuso potencial. Quando esses indicadores são detetados, uma amostra de prompts e conclusões do cliente pode ser selecionada para revisão. A revisão é conduzida pelo LLM por padrão, com revisões adicionais por revisores humanos, conforme necessário. Informações detalhadas sobre IA e revisão humana estão disponíveis em Monitoramento de abuso do Serviço OpenAI do Azure.

Para revisão de IA, os prompts e conclusões do cliente não são armazenados pelo sistema ou usados para treinar o LLM ou outros sistemas. Para revisão humana, o armazenamento de dados onde prompts e finalizações são armazenados é logicamente separado por recurso do cliente (cada solicitação inclui a ID do recurso Azure OpenAI do cliente). Um armazenamento de dados separado está localizado em cada geografia em que o Serviço Azure OpenAI está disponível, e os prompts e o conteúdo gerado de um cliente são armazenados na geografia do Azure onde o recurso de serviço Azure OpenAI do cliente é implantado, dentro do limite do serviço Azure OpenAI. Os revisores humanos que avaliam possíveis abusos podem aceder a sugestões e dados de conclusão somente quando já tiverem sido assinalados pelo sistema de monitorização de abusos. Os revisores humanos são funcionários autorizados da Microsoft que acessam os dados por meio de consultas pontuais usando IDs de solicitação, estações de trabalho de acesso seguro (SAWs) e aprovação de solicitação Just-In-Time (JIT) concedida pelos gerentes de equipe. Para o Serviço OpenAI do Azure implantado no Espaço Econômico Europeu, os funcionários autorizados da Microsoft estão localizados no Espaço Econômico Europeu.

Se o cliente tiver sido aprovado para monitoramento de abuso modificado (saiba mais em Monitoramento de abuso do Serviço OpenAI do Azure), a Microsoft não armazenará os prompts e as conclusões associadas à(s) assinatura(s) do Azure aprovada(s) e o processo de revisão humana descrito acima não será possível e não será executado. No entanto, a revisão de IA ainda pode ser realizada, utilizando LLMs que analisam prompts e resultado final no momento designado ou gerado, conforme o caso.

Observação

Os recursos do Azure Preview, incluindo modelos do Azure OpenAI na visualização, podem empregar diferentes práticas de privacidade, inclusive com relação ao monitoramento de abuso. As Pré-visualizações podem estar sujeitas a termos suplementares em: Termos de utilização suplementares para Pré-visualizações do Microsoft Azure.

Como um cliente pode verificar se o armazenamento de dados para monitoramento de abuso está desativado?

Há duas maneiras de os clientes, uma vez aprovados para desativar o monitoramento de abuso, verificarem se o armazenamento de dados para monitoramento de abuso foi desativado em sua assinatura aprovada do Azure:

- Usando o portal do Azure, ou

- CLI do Azure (ou qualquer API de gerenciamento).

Observação

O valor de "false" para o atributo "ContentLogging" aparece somente se o armazenamento de dados para monitoramento de abuso estiver desativado. Caso contrário, essa propriedade não aparecerá no portal do Azure ou na saída da CLI do Azure.

Pré-requisitos

- Entrar no Azure

- Selecione a Subscrição do Azure que aloja o recurso do Azure OpenAI Service.

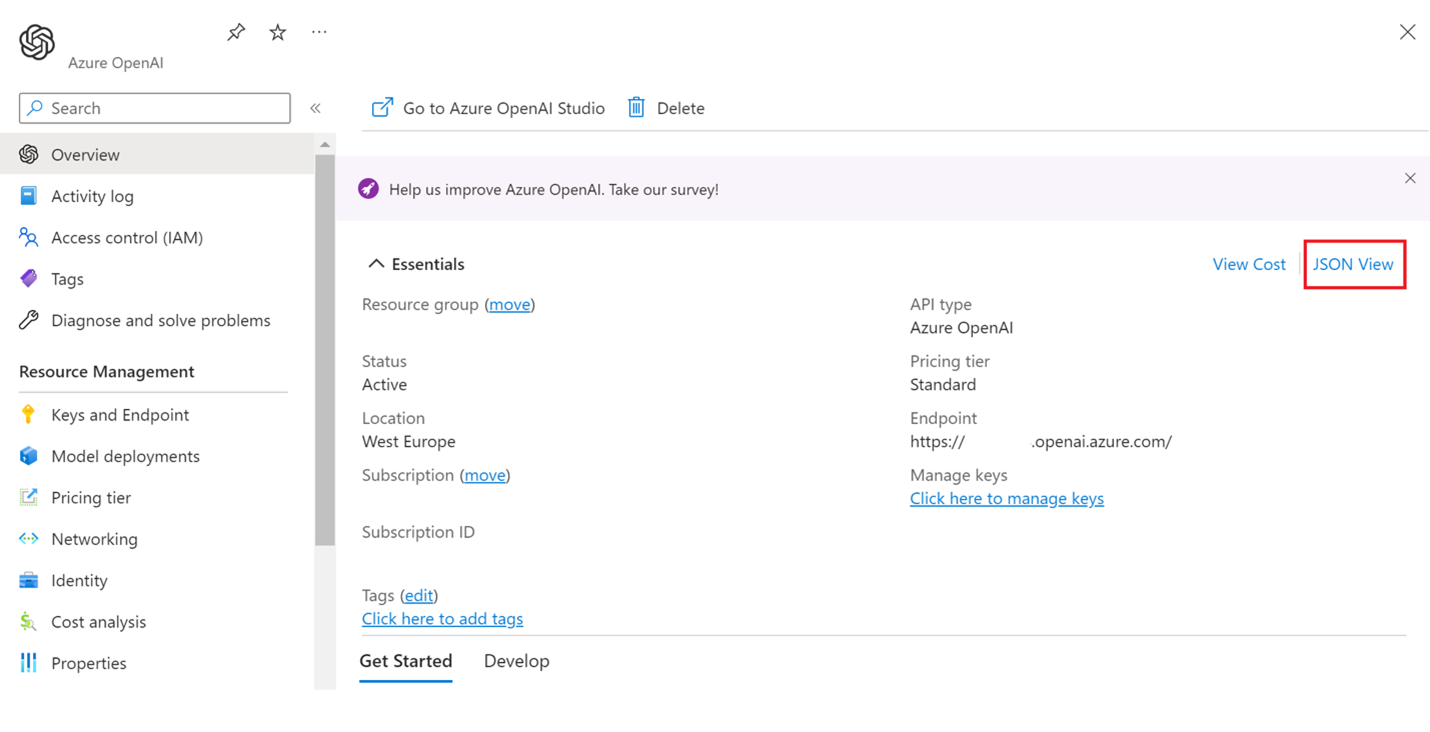

- Navegue até a página Visão geral do recurso do Serviço OpenAI do Azure.

Ir para a página Visão geral do recurso

Clique no link de visualização JSON no canto superior direito, como mostrado na imagem abaixo.

Haverá um valor na lista de recursos chamado "ContentLogging" que aparecerá e será definido como FALSE quando o registro para monitoramento de abuso estiver desativado.

{

"name":"ContentLogging",

"value":"false"

}

Para saber mais sobre os compromissos de privacidade e segurança da Microsoft, consulte a Central de Confiabilidade da Microsoft.

Registo de alterações

| Data | Alterações |

|---|---|

| 17 dezembro 2024 | Adicionadas informações sobre processamento e armazenamento de dados em conexão com o novo recurso de completamentos armazenados; adicionada uma explicação a esclarecer que os recursos do Azure OpenAI em pré-visualização podem não suportar todas as condições de armazenamento de dados; removida a designação de "pré-visualização" para processamento em lote |

| 18 novembro 2024 | Adicionadas informações sobre a localização do processamento de dados para novos tipos de implantação de “Data Zone”; adicionadas informações sobre a nova revisão de prompts e completações pela IA como parte da prevenção de abuso e da geração de conteúdo nocivo. |

| 4 setembro 2024 | Informações adicionadas (e texto existente revisado de acordo) sobre processamento de dados para novos recursos, incluindo API de assistentes (visualização), lote (visualização) e implantações globais; linguagem revisada relacionada à localização do processamento de dados, de acordo com os princípios de residência de dados do Azure; acrescentou informações sobre o processamento de dados para avaliações de segurança de modelos ajustados; clarificação dos compromissos relacionados com a utilização de avisos e conclusão; pequenas revisões para melhorar a clareza |

| 23 junho 2023 | Adicionadas informações sobre o processamento de dados para a nova funcionalidade de dados no Azure; removidas informações sobre o monitoramento de abuso, que agora estão disponíveis em Monitoramento de abuso do Serviço OpenAI do Azure. Nota resumida adicionada. Conteúdo atualizado e simplificado e diagramas atualizados para maior clareza. Registo de alterações adicionado |

Ver também

- Código de conduta para integrações do Serviço OpenAI do Azure

- Descrição geral de práticas de IA Responsável para os modelos do Azure OpenAI

- Nota de transparência e casos de uso para o Serviço OpenAI do Azure

- Residência de dados no Azure

- Comparar o Azure OpenAI no Azure Government

- Acesso limitado ao Azure OpenAI Service

- Denunciar abuso do Serviço OpenAI do Azure através do Portal de Denúncia de Abuso

- Comunicar problemas a cscraireport@microsoft.com