Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

Редактор без кода упрощает разработку задания Stream Analytics для обработки потоковых данных в режиме реального времени. Используйте функции перетаскивания без написания кода. Этот интерфейс предоставляет холст, в котором можно подключиться к источникам входных данных, чтобы быстро просмотреть данные потоковой передачи. Затем его можно преобразовать перед записью в места назначения.

С помощью редактора без кода можно легко:

- Изменение входных схем.

- Выполнение операций подготовки данных, таких как соединения и фильтры.

- Подходите к расширенным сценариям, таким как агрегирование временных окон (скользящие, перекидные и сессионные окна) для групповых операций.

После создания и запуска заданий Stream Analytics вы можете легко настроить и внедрить рабочие нагрузки в производственной среде. Используйте правильный набор встроенных метрик для мониторинга и устранения неполадок. Счета за задания Stream Analytics выставляются в соответствии с моделью ценообразования при их выполнении.

Требования

Прежде чем разрабатывать задания Stream Analytics с помощью редактора кода без кода, убедитесь, что выполнены следующие требования:

- Источники потоковой передачи и целевые ресурсы назначения для задания Stream Analytics должны быть общедоступными и не могут находиться в виртуальной сети Azure.

- Требуются необходимые разрешения для доступа к ресурсам потоковой передачи входных и выходных данных.

- Вам следует поддерживать разрешения на создание и изменение ресурсов Azure Stream Analytics.

Примечание.

В настоящее время редактор без кода недоступен в регионе Китая.

Задание Azure Stream Analytics

Задание Stream Analytics состоит из трех основных компонентов: входы, преобразования и выходы данных потоковой передачи. Можно включить столько компонентов, сколько требуется, например несколько входных данных, параллельных ветвей с несколькими преобразованиями и несколькими выходными данными. Дополнительные сведения см. в документации по Azure Stream Analytics.

Примечание.

Следующие функциональные возможности и типы выходных данных недоступны при использовании редактора без кода:

- Определяемые пользователем функции.

- Редактирование запроса на странице Azure Stream Analytics. Однако вы можете просмотреть запрос, созданный редактором без кода на странице запроса.

- Добавление входных и выходных данных на страницах ввода и вывода в Azure Stream Analytics. Однако можно просмотреть входные и выходные данные, созданные редактором без кода на странице ввода и вывода.

- Следующие типы выходных данных недоступны: функция Azure, Azure Data Lake Storage 1-го поколения, база данных PostgreSQL, очередь или тема служебной шины, хранилище таблиц.

Чтобы получить доступ к редактору без кода для создания задания Stream Analytics, используйте один из следующих подходов:

На портале Azure Stream Analytics (предварительная версия): создайте задание Stream Analytics, а затем выберите редактор кода без кода на вкладке "Начало работы" на странице "Обзор" или выберите редактор без кода на левой панели.

Через портал Центры событий Azure: откройте экземпляр Event Hubs. Выберите "Обработка данных" и выберите любой предопределенный шаблон.

Стандартные шаблоны помогут вам разработать и запустить задание для решения различных сценариев, в том числе:

- Сбор данных из Центров событий в формате Delta Lake (предварительная версия)

- Фильтрация и загрузка данных в Azure Synapse SQL

- Запись данных Event Hubs в формате Parquet в хранилище данных Azure Data Lake Storage 2-го поколения

- Материализация данных в Azure Cosmos DB

- Фильтрация и прием данных в Azure Data Lake Storage 2-го поколения

- Обогащение данных и их отправка в шину событий

- Преобразование и хранение данных в базе данных SQL Azure

- Фильтрация и загрузка в Azure Data Explorer

На следующем снимках экрана показано завершенное задание Stream Analytics. Он выделяет все разделы, доступные вам при написании документа.

- Лента: на ленте разделы следуют порядку классического процесса аналитики: концентратор событий в качестве входных данных (также известный как источник данных), преобразования (операции потокового извлечения, преобразования и загрузки), выходные данные, кнопка для сохранения хода выполнения и кнопка, чтобы запустить задание.

- Представление диаграммы: это графическое представление задания Stream Analytics, от входных данных до операций до выходных данных.

- Боковая область: в зависимости от того, какой компонент вы выбираете в представлении диаграммы, вы увидите параметры для изменения входных, преобразований или выходных данных.

- Вкладки для предварительного просмотра данных, ошибок разработки, журналов среды выполнения и метрик. Для каждой плитки предварительный просмотр данных показывает результаты этого шага (динамически для входных данных; по запросу на преобразования и выходные данные). Кроме того, в этом разделе содержится сводка ошибок и предупреждений, которые могут возникнуть в задании при разработке. При выборе каждой ошибки или предупреждения выбирается это преобразование. Он также предоставляет метрики заданий, позволяющие контролировать состояние выполняющейся задачи.

Вход потоковых данных

Редактор без кода поддерживает потоковую передачу данных из трех типов ресурсов:

- Центры событий Azure

- Центр Интернета вещей Azure

- Azure Data Lake Storage 2-го поколения

Для получения дополнительной информации о потоковых входных данных см. раздел Использование потоковых данных в качестве входных в Stream Analytics.

Примечание.

Редактор без кода на портале Центры событий Azure имеет Event Hub в качестве единственной входной опции.

Центры событий Azure в качестве входных данных потоковой передачи

Центры событий Azure представляют собой платформу потоковой передачи больших данных и службу приема событий. Она может получать и обрабатывать миллионы событий в секунду. Вы можете преобразовать и сохранить данные, отправленные в концентратор событий, с помощью любого поставщика аналитики в режиме реального времени или пакетного адаптера и адаптера хранилища.

Чтобы настроить концентратор событий в качестве входных данных для задания, выберите значок Концентратора событий. В представлении схемы появится соответствующая область, включая боковую панель для ее настройки и подключения.

При подключении к концентратору событий в редакторе без кода создайте новую группу потребителей (которая является параметром по умолчанию). Этот подход помогает предотвратить достижение ограничения одновременных читателей в Центре событий. Дополнительные сведения о группах потребителей и о том, следует ли выбрать существующую группу потребителей или создать новую, см. в разделе "Группы потребителей".

Если концентратор событий находится на уровне "Базовый", можно использовать только существующую группу потребителей $Default . Если концентратор событий находится на уровне "Стандартный" или "Премиум", можно создать новую группу потребителей.

При подключении к концентратору событий при выборе параметра Managed Identity в качестве режима проверки подлинности роль владельца данных Центры событий Azure предоставляется управляемому удостоверению для задания Stream Analytics. Дополнительные сведения об управляемых удостоверениях для концентратора событий см. в статье Использование управляемых удостоверений для доступа к концентратору событий из задания Azure Stream Analytics.

Управляемые удостоверения устраняют ограничения методов проверки подлинности на основе пользователей. Эти ограничения включают необходимость повторной проверки подлинности из-за изменений паролей или истечения срока действия маркера пользователя, которые происходят каждые 90 дней.

После настройки сведений о концентраторе событий и нажатия кнопки "Подключить" можно добавить поля вручную с помощью +Добавить поле , если вы знаете имена полей. Чтобы вместо этого обнаруживать поля и типы данных автоматически на основе образца входящих сообщений, выберите поля автоматического определения. Выбрав символ шестеренки, можно при необходимости редактировать учетные данные.

Поля отображаются в списке, когда задания Stream Analytics обнаруживают их. Вы также увидите динамическую предварительную версию входящих сообщений в таблице предварительного просмотра данных в представлении схемы.

Изменение входных данных

Вы можете изменить имена полей, удалить поля, изменить тип данных или изменить время события (пометить как время события: оператор TIMESTAMP BY, если поле типа даты и времени), выбрав значок многоточия рядом с каждым полем. Вы также можете развернуть, выбрать и изменить все вложенные поля из входящих сообщений, как показано на следующем рисунке.

Совет

Этот процесс также относится к входным данным из Центр Интернета вещей Azure и Azure Data Lake Storage 2-го поколения.

Доступные типы данных:

- DateTime: поле даты и времени в формате ISO.

- Float: Десятичное число.

- Int: целочисленный номер.

- Запись: вложенный объект с несколькими записями.

- Строка: текст.

Центр Интернета вещей Azure в качестве потока входных данных

Центр Интернета вещей Azure — размещенная в облаке управляемая служба, которая выступает в качестве центра сообщений для взаимодействия между приложением Интернета вещей и подключенными устройствами. Данные устройства Интернета вещей, отправленные в Центр Интернета вещей, можно использовать в качестве входных данных для задания Stream Analytics.

Примечание.

Вы можете использовать вход Центр Интернета вещей Azure в редакторе без кода на портале Azure Stream Analytics.

Чтобы добавить Центр Интернета вещей в качестве потокового ввода для задания, выберите Центр Интернета вещей в разделе "Входные данные" на ленте. Затем введите необходимые сведения на правой панели, чтобы подключить центр Интернета вещей к заданию. Дополнительные сведения о каждом поле см. в статье Передача данных из Центра Интернета вещей в задание Stream Analytics.

Azure Data Lake Storage поколения 2 для ввода потоковых данных

Azure Data Lake Storage 2-го поколения (ADLS 2-го поколения) — это облачное решение корпоративного озера данных. Она предназначена для хранения больших объемов данных в любом формате и упрощения аналитических рабочих нагрузок больших данных. Stream Analytics может обрабатывать данные, хранящиеся в ADLS 2-го поколения, в виде потока данных. Чтобы узнать больше об этом типе входных данных, см. статью Stream data from ADLS Gen2 в задание Stream Analytics.

Примечание.

Вы можете использовать Azure Data Lake Storage 2-го поколения в качестве входного источника в редакторе с интерфейсом без написания кода на портале Azure Stream Analytics.

Чтобы добавить ADLS Gen2 в качестве потокового ввода для задания, выберите ADLS Gen2 в разделе Входные данные на панели инструментов. Затем введите необходимые сведения на правой панели, чтобы подключить ADLS 2-го поколения к заданию. Дополнительные сведения о каждом поле см. в разделе "Потоковая передача данных из ADLS Gen2 к заданию Stream Analytics".

Входные ссылочные данные

Справочные данные являются статическими или изменяются медленно с течением времени. Обычно вы используете его для обогащения входящих потоков и выполнения поиска в задаче. Например, можно присоединить входные данные потока данных к эталонным данным, так как вы выполнили бы соединение SQL для поиска статических значений. Дополнительные сведения о входных данных эталонных данных см. в разделе Использование эталонных данных для использования в Stream Analytics.

Редактор без кода теперь поддерживает два эталонных источника данных:

- Azure Data Lake Storage 2-го поколения

- База данных SQL Azure

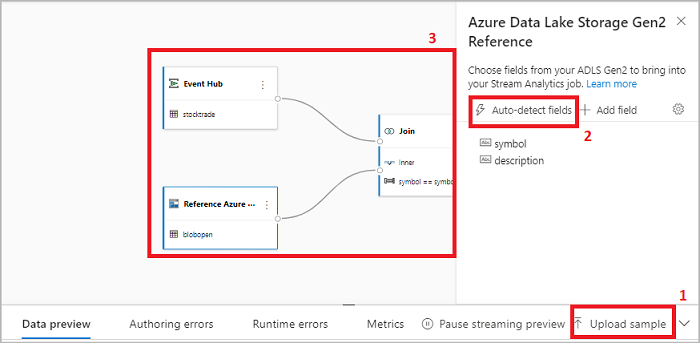

Azure Data Lake Storage 2-го поколения в качестве эталонных данных

Представьте эталонные данные модели в виде последовательности блобов, расположенных в порядке возрастания комбинации даты и времени, указанной в имени блоба. Бинарные объекты можно добавлять в конец последовательности только с использованием даты и времени, которые больше, чем у последнего бинарного объекта, указанного в последовательности. Определите BLOB в входной конфигурации.

Сначала в разделе Входные данные на ленте выберите Ссылка на ADLS Gen2. Дополнительные сведения о каждом поле см. в разделе об Хранилище BLOB-объектов Azure в разделе "Использование справочных данных для поиска в Stream Analytics".

Затем отправьте файл массива JSON. Система обнаруживает поля. Используйте эти справочные данные для преобразования с потоковыми входными данными из Центров событий.

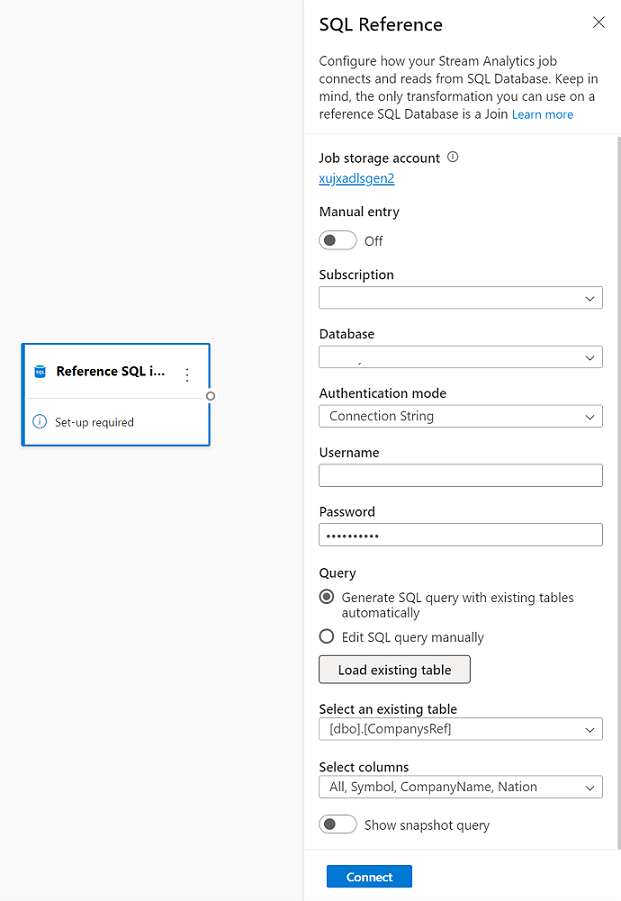

База данных SQL Azure в качестве эталонных данных

Вы можете использовать базы данных Azure SQL в качестве эталонных данных для задания Stream Analytics в редакторе без использования кода. Дополнительные сведения см. в разделе об База данных SQL в разделе "Использование справочных данных для поиска в Stream Analytics".

Чтобы настроить SQL Database в качестве справочных входных данных, выберите Справочная база данных SQL в разделе Входные данные на ленте. Затем заполните сведения для подключения эталонной базы данных и выберите таблицу с необходимыми столбцами. Вы также можете получить справочные данные из таблицы, изменив SQL-запрос вручную.

Преобразования

Преобразования потоковых данных по сути отличаются от преобразований пакетных данных. Почти все потоковые данные имеют компонент времени, который влияет на все задачи подготовки данных.

Чтобы добавить преобразование потоковых данных в задание, выберите символ преобразования в разделе "Операции " на ленте для этого преобразования. В представление схемы добавляется соответствующая плитка. Выбрав его, вы увидите боковую панель, где можно настроить это преобразование.

Фильтр

Используйте преобразование фильтра для фильтрации событий на основе значения поля во входных данных. В зависимости от типа данных (число или текст), преобразование сохраняет значения, соответствующие выбранному условию.

Примечание.

Внутри каждой плитки вы увидите информацию о том, что еще требуется для завершения подготовки преобразования. Например, при добавлении новой плитки отображается сообщение Требуется настройка. Если соединитель узла отсутствует, появится сообщение об ошибке или предупреждение .

Управление полями

Преобразование "Управление полями " позволяет добавлять, удалять или переименовать поля, поступающие из входного или другого преобразования. Параметры на боковой панели позволяют добавить новое поле, выбрав " Добавить поле " или добавив все поля одновременно.

Можно также добавить новое поле с помощью встроенных функций для агрегирования данных из вышестоящего потока. В настоящее время встроенные функции поддерживают некоторые функции в строковых функциях, функциях даты и времени и математических функциях. Дополнительные сведения об определениях этих функций см. в статье "Встроенные функции" (Azure Stream Analytics).

Совет

После настройки плитки представление схемы дает представление о параметрах в плитке. Например, в области "Управление полями" предыдущего изображения можно увидеть первые три поля , которыми управляются, и новые имена, назначенные им. Каждая плитка содержит сведения, относящиеся к нему.

Агрегат

Используйте преобразование "Агрегат" для вычисления агрегирования (суммы, минимального, максимального или среднего) при каждом возникновении нового события в течение определенного периода времени. Эта операция также позволяет фильтровать или разбивать агрегирование по другим измерениям ваших данных. Вы можете включить одну или несколько агрегаций в одно и то же преобразование.

Чтобы добавить агрегирование, щелкните символ преобразования. Затем подключите входные данные, выберите агрегирование, добавьте любые измерения фильтра или среза и выберите период времени, с течением которого вычисляется агрегирование. В этом примере вы рассчитываете сумму платы за проезд по штату, откуда прибыл автомобиль, за последние 10 секунд.

Чтобы добавить еще одну агрегацию в то же преобразование, выберите "Добавить агрегатную функцию". Фильтр или срез применяется ко всем агрегациям в преобразовании.

Присоединиться

Используйте преобразование Join для объединения событий из двух входных данных на основе пар полей, которые вы выбрали. Если вы не выбираете пару полей, соединение зависит от времени по умолчанию. По умолчанию это преобразование отличается от пакетной.

Как и при регулярных соединениях, у вас есть варианты для логики соединения:

- Внутреннее соединение: включите только записи из обеих таблиц, в которых пара совпадает. В этом примере номерной знак совпадает с обоими входными данными.

- Левое внешнее соединение: включите все записи из левой (первой) таблицы и только записи из второй, которые соответствуют паре полей. Если совпадения нет, поля из второго входного ввода пусты.

Чтобы выбрать тип соединения, щелкните символ предпочтительного типа на боковой панели.

Наконец, выберите период, в течение которого требуется вычислить соединение. В этом примере объединение учитывает последние 10 секунд. Чем дольше период, тем реже вывод данных и тем больше вы используете ресурсов обработки для преобразования.

По умолчанию выходные данные включают все поля из обеих таблиц. Префиксы слева (первый узел) и правый (второй узел) помогают различать источник.

Группировать по

Используйте преобразование Группировка по для вычисления агрегатов для всех событий в определенном временном окне. Вы можете выполнять группирование по значениям в одном или нескольких полях. Это похоже на трансформацию Агрегация, но предоставляет больше возможностей для агрегации. Он также включает более сложные варианты для временных интервалов. Как и при агрегировании, вы можете добавить более одной агрегации для каждого преобразования.

Агрегаты, доступные в преобразовании:

- Среднее значение

- Численность

- Максимум

- Минимум

- Процентиль (постоянный и дискретный).

- Стандартное отклонение

- Сумма

- Дисперсия

Чтобы настроить это преобразование, сделайте следующее:

- Выберите предпочтительное агрегирование.

- Выберите поле, в которое требуется агрегировать.

- Выберите необязательное поле для группирования, если вам нужно выполнить агрегатное вычисление по другой размерности или категории. Например: состояние.

- Выберите функцию для временных окон.

Чтобы добавить еще одну агрегацию в то же преобразование, выберите "Добавить агрегатную функцию". Помните, что поле «Сгруппировать по» и оконная функция применяются ко всем агрегациям в преобразовании.

Метка времени окончания периода времени отображается как часть выходных данных преобразования для справки. Дополнительные сведения об оконных интервалах времени, которые поддерживают задания Stream Analytics, см. в Функциях окон (Azure Stream Analytics).

Объединение

Используйте преобразование Union для подключения двух или нескольких входных данных. Добавьте события с общими полями (с тем же именем и типом данных) в одну таблицу. Выходные данные исключают поля, которые не соответствуют.

Развернуть массив

Используйте преобразование "Развернуть массив" для создания новой строки для каждого значения в массиве.

Потоковая передача выходных данных

В настоящее время функция перетаскивания без кода поддерживает несколько приемников выходных данных для хранения обработанных данных в режиме реального времени.

Azure Data Lake Storage 2-го поколения

Data Lake Storage 2-го поколения использует службу хранилища Azure в качестве основы для создания корпоративных хранилищ данных в Azure. Она предназначена для обслуживания нескольких петабайтов информации при поддержании сотен гигабит пропускной способности. Это позволяет легко управлять большим объемом данных. Хранилище BLOB-объектов Azure предлагает экономичное и масштабируемое решение для хранения больших объемов неструктурированных данных в облаке.

В разделе "Выходные данные" на ленте выберите ADLS 2-го поколения в качестве выходных данных для задания Stream Analytics. Затем выберите контейнер, в котором нужно отправить выходные данные задания. Для получения дополнительных сведений о выходных данных задания Stream Analytics в Azure Data Lake 2-го поколения см. в статье Хранилище BLOB-объектов и выходные данные Azure Data Lake 2-го поколения из Azure Stream Analytics.

При подключении к Azure Data Lake Storage 2-го поколения, если выбрать Managed Identity в качестве режима аутентификации, управляемому удостоверению для задания Stream Analytics предоставляется роль участника данных хранилища BLOB. Дополнительные сведения об управляемых удостоверениях для Azure Data Lake Storage 2-го поколения см. в статье «Использование управляемых удостоверений для проверки подлинности задания Azure Stream Analytics для Blob Storage Azure».

Управляемые удостоверения устраняют ограничения методов проверки подлинности на основе пользователей. Эти ограничения включают необходимость повторной проверки подлинности из-за изменений паролей или истечения срока действия маркера пользователя, которые происходят каждые 90 дней.

Доставка ровно один раз (предварительная версия) поддерживается в ADLS поколения Gen2 без вывода редактора кода. Его можно включить в разделе "Режим записи" в конфигурации ADLS 2-го поколения. Дополнительные сведения об этой функции см. в разделе Доставка ровно один раз (предварительная версия) в Azure Data Lake второго поколения.

Поддержка записи в таблицу Delta Lake (предварительная версия) осуществляется в ADLS Gen2 без необходимости вывода через редактор кода. Этот параметр можно получить в разделе Сериализация в конфигурации ADLS 2-го поколения. Дополнительные сведения об этой функции см. в статье "Запись в таблицу Delta Lake".

Azure Synapse Analytics

Задания Azure Stream Analytics могут отправлять выходные данные в выделенную таблицу пула SQL в Azure Synapse Analytics и обрабатывать частоту пропускной способности до 200 МБ в секунду. Stream Analytics поддерживает самые требовательные задачи по аналитике в реальном времени и нужды в обработке данных для рабочих нагрузок, таких как подготовка отчетов и работа с панелями мониторинга.

Внимание

Таблица выделенного пула SQL должна существовать, прежде чем ее можно будет добавить в качестве выходных данных в задание Stream Analytics. Схема таблицы должна соответствовать полям и их типам в выходных данных задания.

В разделе "Выходные данные" на ленте выберите Synapse в качестве выходных данных для задания Stream Analytics. Затем выберите таблицу пула SQL, в которой нужно отправить выходные данные задания. Дополнительные сведения о выходных данных Azure Synapse для задания Stream Analytics см. в разделе Выходные данные Azure Synapse Analytics из Azure Stream Analytics.

Azure Cosmos DB

Azure Cosmos DB — это глобально распределенная служба баз данных, которая предлагает безграничное эластичное масштабирование по всему миру. Он также предлагает широкие возможности запросов и автоматическое индексирование по моделям данных, не зависящих от схемы.

В разделе " Выходные данные" на ленте выберите CosmosDB в качестве выходных данных для задания Stream Analytics. Дополнительные сведения о выходных данных Azure Cosmos DB для задания Stream Analytics см. в разделе выходные данные Azure Cosmos DB из Azure Stream Analytics.

При подключении к Azure Cosmos DB, если выбрать Managed Identity в качестве режима проверки подлинности роль участника предоставляется управляемому удостоверению для задания Stream Analytics. Дополнительные сведения об управляемых удостоверениях для Azure Cosmos DB см. в статье "Использование управляемых удостоверений для доступа к Azure Cosmos DB из задания Azure Stream Analytics (предварительная версия)".

Выходные данные Azure Cosmos DB в редакторе без кода также поддерживают метод проверки подлинности управляемых удостоверений. Этот метод обеспечивает те же преимущества, что и в выходных данных ADLS 2-го поколения.

База данных SQL Azure

База данных SQL Azure — это полностью управляемая платформа как служба (PaaS), которая помогает создавать высокодоступный и высокопроизводительный уровень хранения данных для приложений и решений в Azure. С помощью редактора без кода можно настроить задания Azure Stream Analytics для записи обработанных данных в существующую таблицу в База данных SQL.

Чтобы настроить База данных SQL Azure в качестве выходных данных, выберите База данных SQL в разделе "Выходные данные" на ленте. Затем введите сведения, необходимые для подключения к базе данных SQL, и выберите таблицу, в которую требуется записать данные.

Внимание

Таблица База данных SQL Azure должна существовать, прежде чем добавлять ее в качестве выходных данных в задание Stream Analytics. Схема таблицы должна соответствовать полям и их типам в выходных данных задания.

Для получения дополнительной информации о выходных данных из База данных SQL Azure для задания Stream Analytics см. Выходные данные База данных SQL Azure из Azure Stream Analytics.

Event Hubs

С помощью данных в режиме реального времени, поступающих в ASA, редактор без кода может преобразовывать и обогащать данные, а затем выводить данные в другой концентратор событий. Вы можете выбрать Event Hubs в качестве выхода при настройке задания Azure Stream Analytics.

Чтобы настроить центры событий в качестве выходных данных, выберите Концентратор событий в разделе "Выходные данные " на ленте. Затем введите сведения, необходимые для подключения к концентратору событий, в который требуется записать данные.

Дополнительные сведения о выходных данных Центров событий для задания Stream Analytics см. в разделе "Центры событий" из Azure Stream Analytics.

Azure Data Explorer

Azure Data Explorer — это полностью управляемая, высокопроизводительная платформа аналитики больших данных, которая упрощает анализ больших объемов данных. Вы также можете использовать Azure Data Explorer в качестве выходных данных для задания Azure Stream Analytics с помощью редактора без кода.

Чтобы настроить Azure Data Explorer в качестве выходных данных, выберите Azure Data Explorer в разделе Outputs на ленте. Затем введите необходимые сведения для подключения к базе данных Azure Data Explorer и укажите таблицу, в которую требуется записать данные.

Внимание

Таблица должна существовать в выбранной базе данных, а схема таблицы должна точно соответствовать полям и их типам в выходных данных задания.

Дополнительные сведения о выходных данных Azure Data Explorer для задания Stream Analytics см. в разделе Выходные данные Azure Data Explorer из Azure Stream Analytics (предварительная версия).

Power BI

Power BI предоставляет полный интерфейс визуализации для результата анализа данных. При использовании Power BI для вывода данных в Stream Analytics, обработанные потоковые данные записываются в потоковый набор данных Power BI, который затем можно использовать для создания панели мониторинга Power BI в почти реальном времени.

Чтобы настроить Power BI в качестве выходных данных, выберите Power BI в разделе Outputs на ленте. Затем введите необходимые сведения для подключения к рабочей области Power BI и укажите имена для набора данных потоковой передачи и таблицы, в которую требуется записать данные. Дополнительные сведения о каждом поле см. в статье "Выходные данные Power BI" из Azure Stream Analytics.

Предварительный просмотр данных, ошибки разработки, журналы среды выполнения и метрики

Интерфейс перетаскивания без кода предоставляет средства, помогающие создавать, устранять неполадки и оценивать производительность конвейера аналитики для потоковой передачи данных.

Просмотр данных в реальном времени для входов

При подключении к источнику входных данных, например концентратору событий, и выборе ее плитки в представлении диаграммы (вкладка "Предварительный просмотр данных") отображается динамический просмотр входящих данных, если все следующие условия верны:

- Выполняется отправка данных.

- Входные данные настроены правильно.

- Добавлены поля.

Как показано на следующем снимке экрана, если вы хотите просмотреть или детализировать определенные сведения, можно приостановить предварительную версию (1). Или вы можете начать его снова, если вы закончите.

Кроме того, вы можете просмотреть подробную информацию о конкретной записи (ячейка в таблице). Для этого выберите ее и щелкните элемент Показать/скрыть подробности (2). Экранная копия показывает подробное представление вложенного объекта в записи.

Статический предварительный просмотр для преобразований и выходных данных

После добавления и настройки каких-либо шагов в представлении схемы вы можете проверить их поведение. Для этого выберите элемент Get static preview (Предварительный просмотр статических данных).

При нажатии кнопки задание Stream Analytics оценивает все преобразования и выходные данные, чтобы убедиться, что они настроены правильно. Затем в Stream Analytics отображаются результаты в окне предварительного просмотра статических данных, как показано на следующем изображении.

Вы можете обновить предварительную версию, выбрав "Обновить статическую предварительную версию " (1). При обновлении окна предварительного просмотра задание Stream Analytics принимает новые данные из входа и оценивает все преобразования. Затем он отправляет выходные данные снова с любыми обновлениями, которые вы могли выполнить. Также доступен параметр "Показать и скрыть сведения " (2).

Ошибки разработки

Если у вас есть ошибки авторинга или предупреждения, вкладка Ошибки авторинга перечисляет их, как показано на следующем снимке экрана. Список включает подробную информацию об ошибке или предупреждении, тип карты (вход, преобразование или выход), уровень ошибки и описание ошибки или предупреждения.

Журналы среды выполнения

Журналы среды выполнения отображаются на уровне предупреждений, ошибок или сведений при выполнении задания. Эти журналы полезны, если вы хотите изменить топологию заданий Stream Analytics или конфигурацию для устранения неполадок. Включите журналы диагностики и отправьте их в рабочую область Log Analytics в Settings, чтобы получить дополнительные сведения о выполняемых заданиях для отладки.

В следующем примере снимка экрана пользователь настраивает выходные данные базы данных SQL с схемой таблицы, которая не соответствует полям выходных данных задания.

Метрики

Если задание выполняется, вы можете отслеживать его работоспособность на вкладке Метрики. Четыре метрики, отображаемые по умолчанию, — задержка водяного знака, события ввода, события ввода, находящиеся в резерве, и события вывода. Используйте эти метрики, чтобы понять, поступают ли события в задание и выходят из него без какой-либо очереди входных данных.

В списке можно выбрать дополнительные метрики. Подробные сведения о всех метриках см. в статье о метриках заданий Azure Stream Analytics.

Запуск задания Stream Analytics

Вы можете сохранить задание в любое время при его создании. После настройки входных данных потоковой передачи, преобразований и потоковых выходных данных для задания можно запустить задание.

Примечание.

Хотя редактор без кода на портале Azure Stream Analytics находится в предварительной версии, служба Azure Stream Analytics общедоступна.

Эти параметры можно настроить:

-

Время начала выходных данных. При запуске задания выберите время для начала создания выходных данных.

- Теперь: этот параметр делает начальную точку потока событий вывода таким же, как и при запуске задания.

- Пользователь: выберите начальную точку выходных данных.

- Когда была последняя остановка: этот параметр доступен, если задание ранее было начато, но было остановлено вручную или завершилось сбоем. При выборе этого параметра для перезапуска задания используется последнее выходное время, поэтому данные не будут потеряны.

- Единицы потоковой передачи: единицы потоковой передачи (SUS) представляют объем вычислительных ресурсов и памяти, назначенных заданию во время его выполнения. Если вы не уверены, сколько SUs выбрать, начните с трех и настройте по мере необходимости.

- Обработка ошибок выходных данных. Политики обработки ошибок выходных данных применяются только в том случае, если выходное событие, созданное заданием Stream Analytics, не соответствует схеме целевого приемника. Настройте политику, выбрав "Повторить " или "Удалить". Дополнительные сведения см. в статье Политика обработки ошибок вывода в Azure Stream Analytics.

- Пуск. Эта кнопка запускает задание Stream Analytics.

Список заданий Stream Analytics на портале Центры событий Azure

Чтобы просмотреть список всех заданий Stream Analytics, созданных с помощью опыта без кода, основанного на перетаскивании, в портале Центры событий Azure, выберите Обработка данных>задания Stream Analytics.

Ниже приведены элементы вкладки заданий Stream Analytics :

- Фильтр. Фильтрация списка по имени задания.

- Обновление. В настоящее время список не обновляется автоматически. Нажмите кнопку "Обновить", чтобы обновить список и просмотреть последнее состояние.

- Имя задания: имя в этой области — это имя, которое вы предоставляете на первом шаге создания задания. Его изменить нельзя. Выберите имя задания, чтобы открыть задание в интерфейсе перетаскивания без кода, где можно остановить задание, изменить его и снова запустить.

- Состояние: в этой области отображается состояние задания. Выберите "Обновить" в верхней части списка, чтобы просмотреть последнее состояние.

- Единицы потоковой передачи: в этой области показано количество единиц потоковой передачи, которые вы выбираете при запуске задания.

- Выходная подложка: эта область обеспечивает индикатор активности данных, создаваемых заданием. Все события до отметки времени уже вычислены.

- Мониторинг заданий: выберите "Открыть метрики" , чтобы просмотреть метрики, связанные с этим заданием Stream Analytics. Дополнительные сведения о метриках, которые можно использовать для мониторинга задания Stream Analytics, см. в разделе метрики заданий Azure Stream Analytics.

- Операции: запуск, остановка или удаление задания.

Следующие шаги

Узнайте, как использовать редактор без кода для решения распространенных сценариев с помощью стандартных шаблонов: