Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

Генеративный ИИ (GenAI) принимается с беспрецедентной скоростью, поскольку организации активно взаимодействуют с GenAI в различных направлениях или экспериментируют с ним. Группы безопасности могут более эффективно устранять риски и управлять ими, заранее получая видимость использования искусственного интеллекта в организации и реализуя соответствующие элементы управления. В этой статье описывается, как обнаружить использование приложения ИИ в организации, включая оценку риска для конфиденциальных данных.

Это вторая статья в серии. Прежде чем использовать эту статью, убедитесь, что вы выполнили задачи, описанные в статье "Подготовка к обеспечению безопасности ИИ ", чтобы подготовить среду с возможностями, указанными в этой статье.

Корпорация Майкрософт предоставляет средства, которые помогут вам получить представление о данных, доступе, пользователях и приложениях для искусственного интеллекта, который вы создаете и используете. Эти возможности помогают заранее устранять уязвимости при создании надежной системы безопасности для искусственного интеллекта.

В следующей таблице описывается иллюстрация, а также описаны шаги реализации этих возможностей.

| Этап | Задача | Область действия |

|---|---|---|

| 1 | Получите представление обо всех идентичностях агентов, созданных в Microsoft Copilot Studio и Microsoft Foundry с помощью Microsoft Entra Agent ID. | Агенты, созданные в Microsoft Copilot Studio и Foundry |

| 2 | Получите представление об использовании ИИ с помощью управления состоянием безопасности данных Microsoft Purview (DSPM) для искусственного интеллекта. Применение политик для защиты конфиденциальных данных. | Копилоты, агенты и другие приложения ИИ, использующие сторонние модули больших языковых моделей (LLM), включая поддерживаемые ИИ сайты. |

| 3 | Обнаружение, санкционирование и блокировка приложений ИИ с помощью Microsoft Defender для облачных приложений | Приложения SaaS AI |

| 4 | Обнаружьте развернутые рабочие нагрузки ИИ в вашей среде и получите аналитические сведения о безопасности с помощью Microsoft Defender для управления положением безопасности в облаке (CSPM). | Пользовательские приложения на основе индивидуально разработанного искусственного интеллекта Azure |

Шаг 1. Получите возможность отслеживания агентов с помощью идентификатора агента Entra (версия для предварительного просмотра)

Поскольку организации создают и внедряют агенты ИИ, сложно отслеживать этих нечеловеческих субъектов. То, что делает эти агенты мощными — их способность автономно обрабатывать сложные задачи и действовать как виртуальные товарищи по команде, также вызывает опасения. Поэтому важно отслеживать удостоверения агентов, управлять жизненным циклом и разрешениями и тщательно защищать доступ к ресурсам вашей организации.

Идентификатор агента Microsoft Entra Agent (предварительная версия) предоставляет единый каталог всех удостоверений агента, созданных в Microsoft Copilot Studio и Foundry. Это первый шаг в обеспечении еще большей видимости, защиты и управления быстро растущим объемом агентов в организациях.

| Задача | Рекомендуемые ресурсы |

|---|---|

| Просмотр всех агентов в организации | Войдите в Центр администрирования Microsoft Entra и перейдите к корпоративным приложениям. В строке фильтров в верхней части представления списка установите раскрывающийся список "Тип приложения" на "Agent ID (Preview)". Мгновенно список корпоративных приложений сужается, чтобы показать агентов ИИ (созданных с помощью Copilot Studio или Foundry), зарегистрированных в вашем арендаторе. |

| Дополнительные сведения см. в этом блоге | Объявление об идентификаторе агента Microsoft Entra Agent: защита агентов ИИ и управление ими |

Шаг 2. Получите представление об использовании ИИ с помощью управления позицией безопасности данных (DSPM) для искусственного интеллекта

Microsoft Purview Data Security Posture Management (DSPM) для ИИ фокусируется на том, как ИИ используется в вашей организации, особенно как ваши данные взаимодействуют с средствами искусственного интеллекта. Он работает с сайтами, использующими генеративные ИИ. DSPM для искусственного интеллекта предоставляет более глубокие аналитические сведения для приложений Microsoft Copilots и сторонних приложений SaaS, таких как ChatGPT Enterprise и Google Gemini.

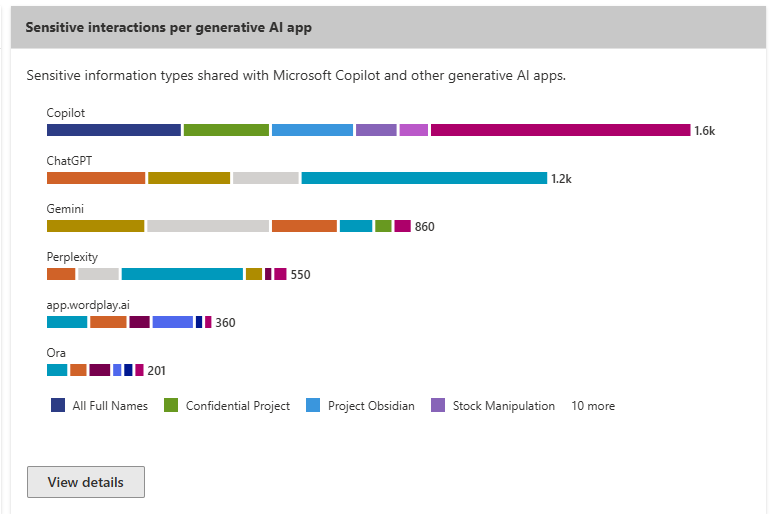

На следующей схеме представлено одно из агрегированных представлений о влиянии использования ИИ на ваши данные — конфиденциальные взаимодействия в рамках генеративного приложения ИИ.

DSPM для искусственного интеллекта предоставляет набор возможностей, которые помогают безопасно внедрять ИИ без необходимости выбирать между производительностью и защитой:

- Понимание и аналитика деятельности ИИ в вашей организации

- Готовые к использованию политики для защиты данных и предотвращения потери данных в запросах ИИ

- Оценка рисков данных для выявления, исправления и мониторинга потенциального чрезмерного распространения данных

- Рекомендуемые действия на основе данных в арендаторе

- Элементы управления соответствием для применения политик оптимальной обработки и хранения данных

Чтобы отслеживать взаимодействие с сторонними сайтами ИИ, устройства должны быть подключены к Microsoft Purview. Если вы выполнили инструкции по подготовке к обеспечению безопасности ИИ, вы зарегистрировали устройства в управлении с помощью Microsoft Intune, а затем настроили эти устройства в Defender для конечной точки. Подключение устройств осуществляется совместно в Microsoft 365 (включая Microsoft Purview) и Microsoft Defender для Endpoint (MDE).

Используйте следующие ресурсы для обнаружения приложений ИИ и данных с помощью DSPM для ИИ.

| Задача | Рекомендуемые ресурсы |

|---|---|

| Убедитесь, что устройства подключены к Microsoft Purview. | Если устройства еще не подключены к Defender для конечной точки, существует несколько методов для их подключения. См. подключение устройств Windows к Microsoft 365. |

| Общие сведения о предварительных требованиях и способах работы DSPM для ИИ | Рекомендации по развертыванию управления безопасностью данных Microsoft Purview для искусственного интеллекта |

| Начало работы с DSPM для искусственного интеллекта | Как использовать управление состоянием безопасности данных для искусственного интеллекта |

| Просмотр поддерживаемых сайтов ИИ | Поддерживаемые сайты ИИ Microsoft Purview для защиты данных и соответствия требованиям |

Шаг 3. Обнаружение, санкции и блокировка приложений ИИ с помощью Microsoft Defender для облачных приложений

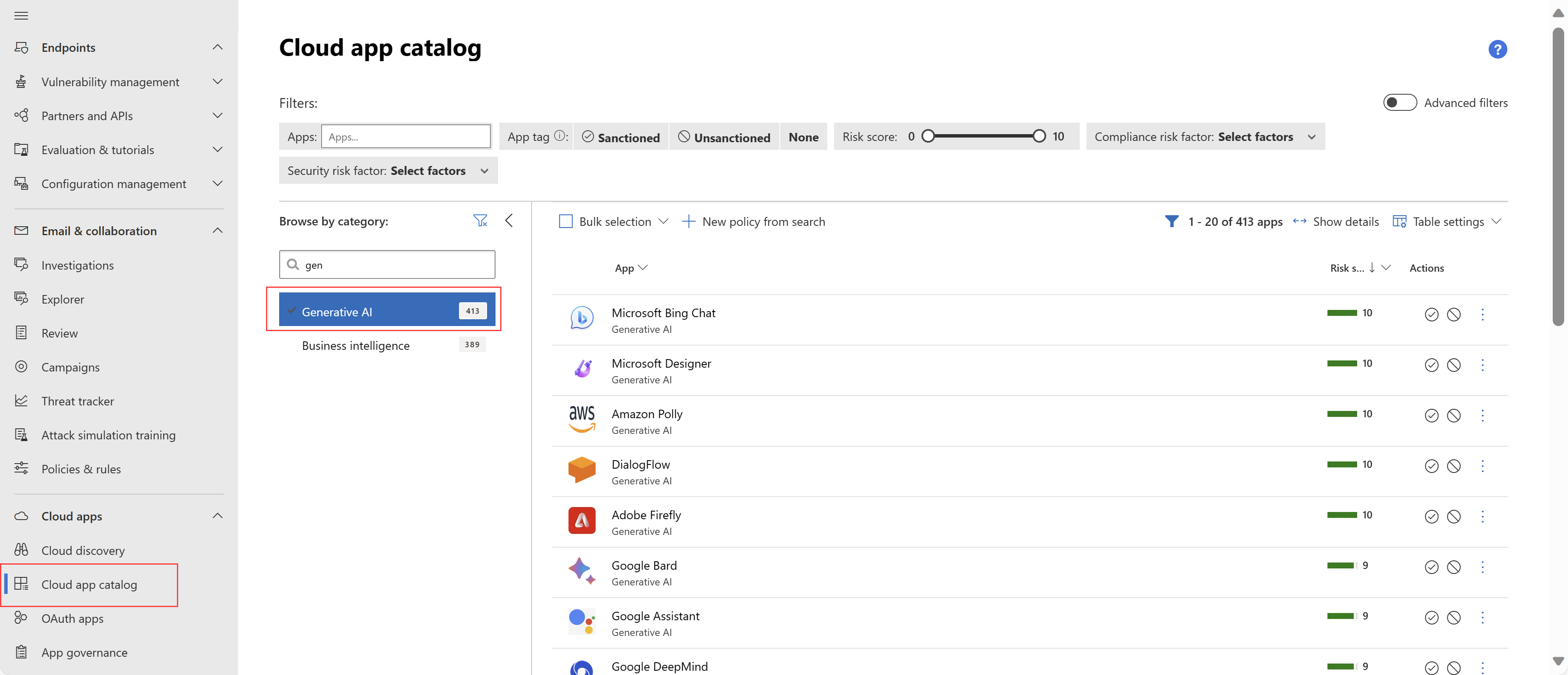

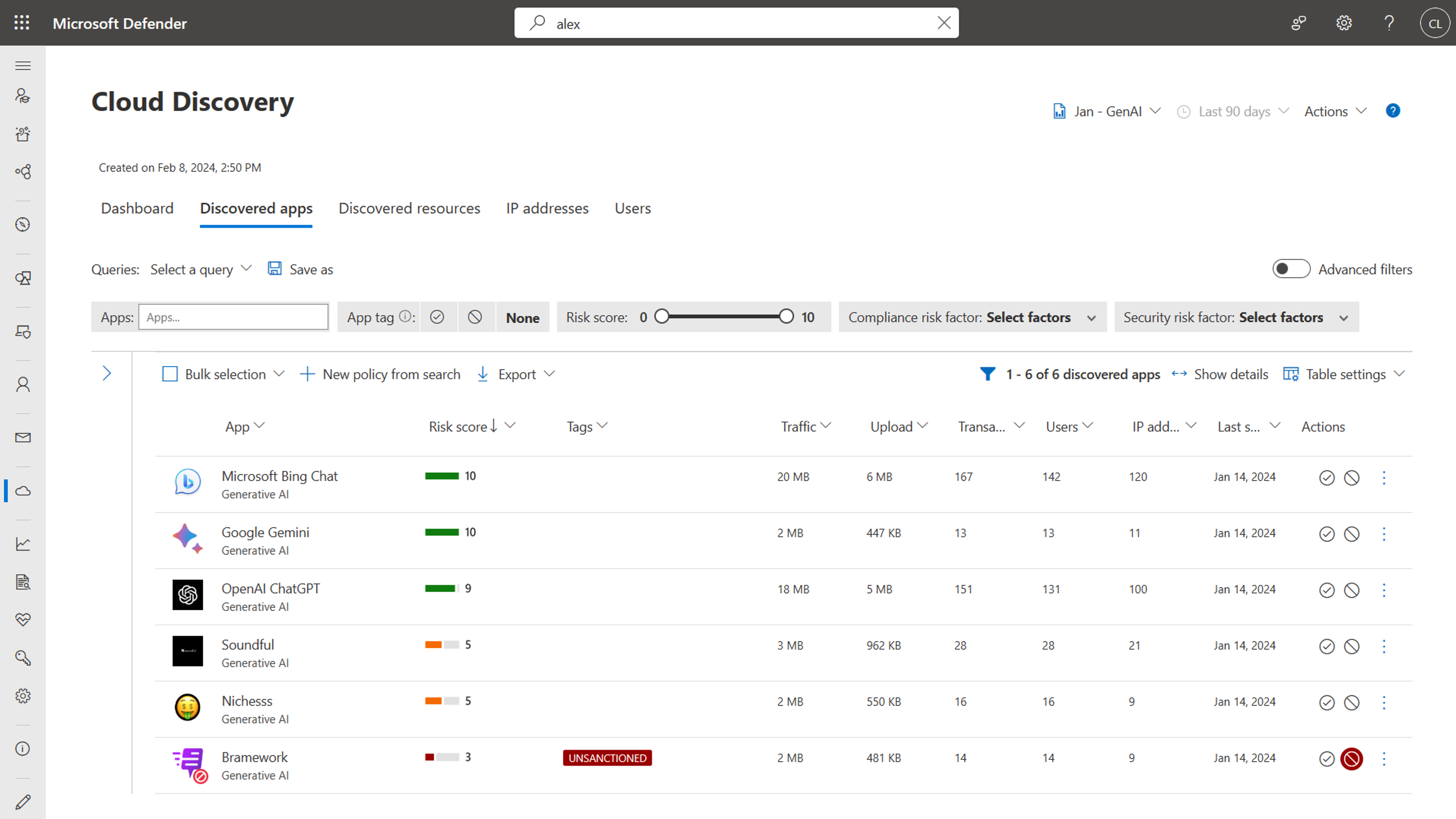

Microsoft Defender для облачных приложений помогает командам безопасности обнаруживать приложения и использование SaaS GenAI.

Каталог приложений Defender для облачных приложений включает категорию Генеративный ИИ для приложений с большими языковыми моделями (LLM), таких как Microsoft Bing Chat, Google Bard, ChatGPT и другие. Defender для облачных приложений добавил более тысячи созданных приложений, связанных с ИИ, в каталог, предоставляя представление о том, как созданные приложения ИИ используются в вашей организации и помогают безопасно управлять ими.

С помощью Defender для облачных приложений вы можете:

- Фильтрация по приложениям сгенерируемым ИИ

- Обнаружение приложений ИИ, используемых в вашей организации

- Просмотр встроенных оценок рисков для каждого приложения, включая 90+ факторов риска в области безопасности и соответствия нормативным требованиям.

- Санкция или отмена (блокировка) использования определенных приложений

- Создайте политики, которые продолжают обнаруживать приложения ИИ на основе заданных критериев, включая оценку риска, количество пользователей в день и другие. Вы можете даже автоматически отменить действия приложений, которые соответствуют критериям.

Чтобы выполнить следующие действия, используйте следующие ресурсы.

| Задача | Рекомендуемые ресурсы |

|---|---|

| Пилотная программа и развертывание Defender для облачных приложений | Как пилотно и развернуть Microsoft Defender для облачных приложений? |

| Ознакомьтесь с этим учебником по видео | Узнайте, какие созданные приложения ИИ используются в вашей среде с помощью Defender для облачных приложений |

| Просмотр обнаруженных приложений | Просмотр обнаруженных приложений с помощью панели мониторинга Cloud Discovery |

| Поиск облачного приложения и вычисление оценки риска | Каталог облачных приложений и оценки рисков — Microsoft Defender для облачных приложений |

| Управление обнаруженными приложениями | Управление обнаруженными приложениями — Microsoft Defender для облачных приложений |

Шаг 4. Обнаружение развернутых рабочих нагрузок ИИ в среде и получение аналитических сведений о безопасности с помощью Microsoft Defender для облака

План управления безопасностью Cloud Security (CSPM) Defender в Microsoft Defender для облака предоставляет возможности управления безопасностью ИИ, начиная с обнаружения приложений ИИ, встроенных в ваши среды:

- Обнаружение перечня материалов для генеративного ИИ (AI BOM), включающего компоненты приложений, данные и артефакты ИИ от кода до облака.

- Укрепление положения безопасности приложений генеративного ИИ с помощью встроенных рекомендаций, а также изучения и устранения рисков безопасности.

- Использование анализа пути атаки для выявления и устранения рисков.

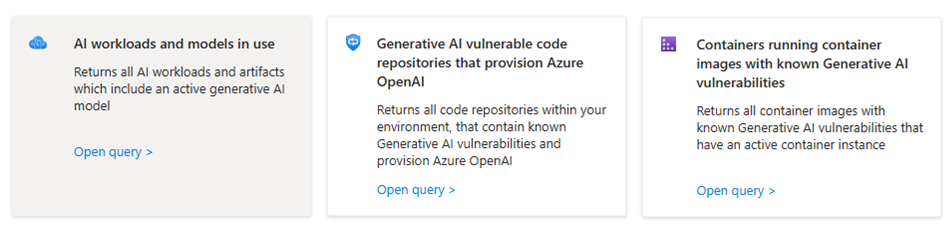

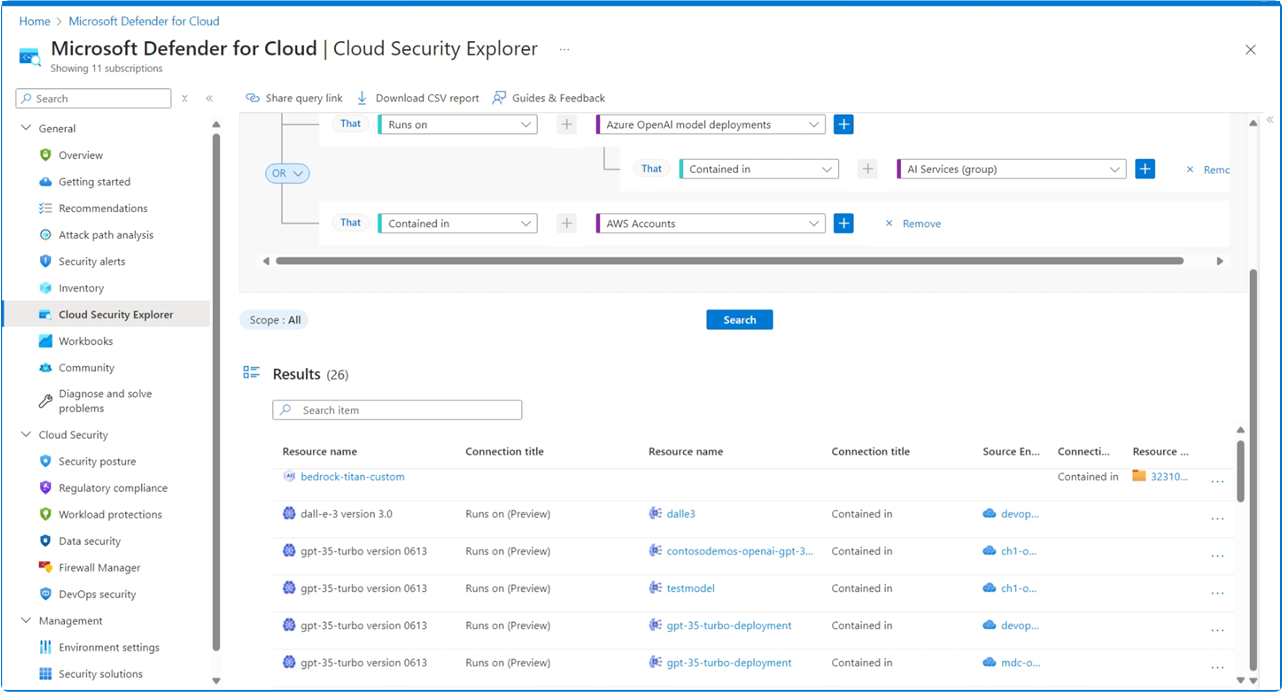

Используйте обозреватель облачной безопасности для идентификации рабочих нагрузок и моделей, работающих в вашей среде. Cloud Security Explorer включает предварительно настроенные запросы:

- Используемые рабочие нагрузки и модели ИИ

- Репозитории кода генеративного ИИ, уязвимые к атакам, которые обеспечивают работу Azure OpenAI

- Контейнеры, использующие образы контейнеров с известными уязвимостями генеративного ИИ.

Вы также можете настроить собственные запросы.

Чтобы выполнить следующие действия, используйте следующие ресурсы.

| Задача | Рекомендуемые ресурсы |

|---|---|

| Узнайте об управлении положением безопасности искусственного интеллекта | Управление безопасностью искусственного интеллекта с помощью Defender для облака |

| Обнаружение рабочих нагрузок ИИ | Используемые рабочие нагрузки и модели ИИ |

| Изучение рисков, связанных с генеративными артефактами ИИ на этапе перед развертыванием | Риски создания артефактов искусственного интеллекта |

Следующий шаг для защиты искусственного интеллекта

После обнаружения использования ИИ в вашей организации следующим шагом является применение защиты:

- Защита конфиденциальных данных, используемых с приложениями ИИ

- Реализация защиты от угроз специально для использования ИИ

См. следующую статью в этой серии: как защитить свою организацию при использовании приложений ИИ?