Kommentar

Åtkomst till den här sidan kräver auktorisering. Du kan prova att logga in eller ändra kataloger.

Åtkomst till den här sidan kräver auktorisering. Du kan prova att ändra kataloger.

AutoML-gränssnittet med låg kod i Fabric gör det enkelt för dig att komma igång med maskininlärning genom att ange ml-uppgiften och några grundläggande konfigurationer. Baserat på dessa val genererar AutoML-användargränssnittet en förkonfigurerad notebook-fil som är skräddarsydd för dina indata. När du kör notebook-filen loggar och spårar den automatiskt alla modellmått och iterationer i befintliga ML-experiment och modellobjekt, vilket ger ett organiserat och effektivt sätt att hantera och utvärdera modellprestanda.

Förutsättningar

Skaffa en Microsoft Fabric-prenumeration. Eller registrera dig för en kostnadsfri Microsoft Fabric utvärderingsversion.

Logga in på Microsoft Fabric.

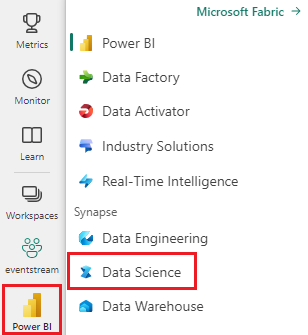

Växla till Fabric med hjälp av upplevelseväxlaren längst ned till vänster på startsidan.

Konfigurera en automatiserad ML-utvärderingsversion

Du kan enkelt starta AutoML-guiden i Fabric direkt från ett befintligt experiment, en modell eller ett notebook-objekt.

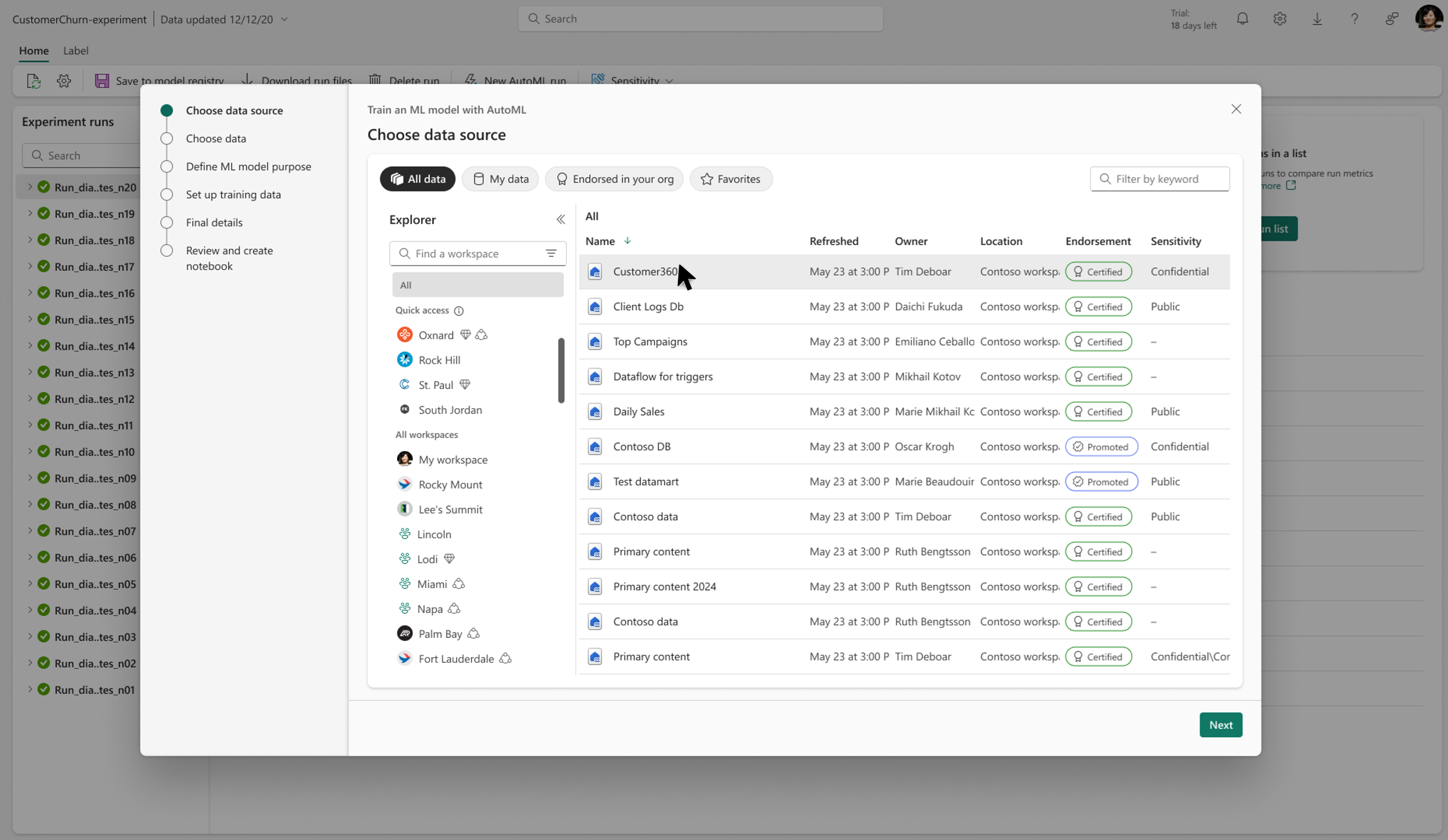

Välj datakälla

Som AutoML-användare i Fabric kan du välja från dina tillgängliga sjöhus, vilket gör det enkelt att komma åt och analysera data som lagras på plattformen. När du har valt ett lakehouse väljer du en specifik tabell eller fil som ska användas för dina AutoML-uppgifter.

Tips

När du väljer ett lakehouse kan du välja en tabell eller en fil som ska användas med AutoML. Filtyper som stöds är CSV, XLS, XLSX och JSON.

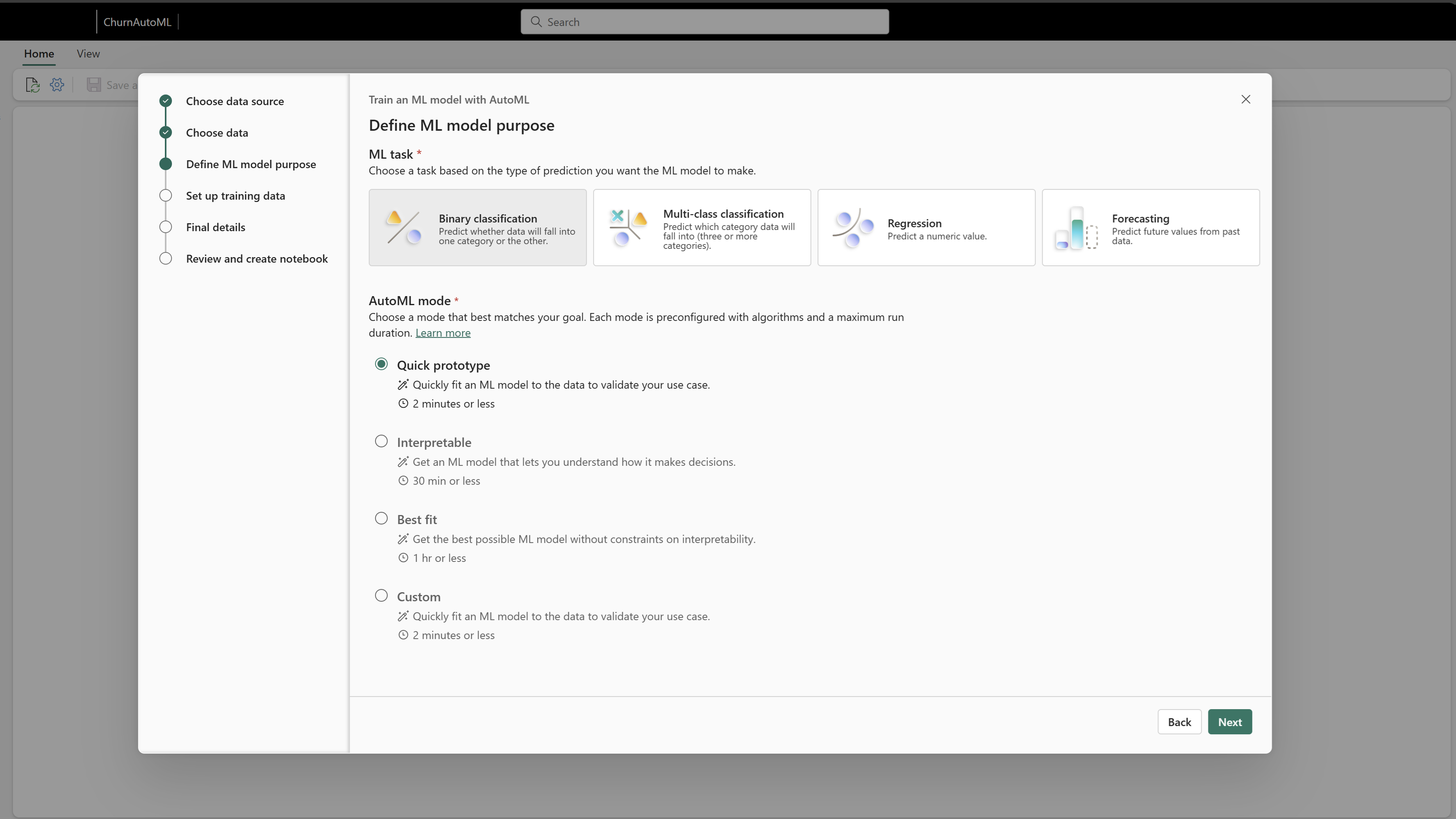

Definiera syftet med ML-modellen

I det här steget definierar användarna syftet med sin modell genom att välja den ML-uppgift som bäst passar deras data och mål.

Fabric AutoML-guiden innehåller följande ML-uppgifter:

- Regression: För att förutsäga kontinuerliga numeriska värden.

- Binär klassificering: För att kategorisera data i en av två klasser.

- Klassificering med flera klasser: För att kategorisera data i en av flera klasser.

- Prognostisering: För att göra förutsägelser över tidsseriedata.

När du har valt din ML-uppgift kan du sedan välja ett AutoML-läge. Varje läge anger standardkonfigurationer för AutoML-utvärderingsversionen, till exempel vilka modeller som ska utforskas och den tid som allokeras för att hitta den bästa modellen. De tillgängliga lägena är:

- Snabb prototyp: Ger snabba resultat, perfekt för testning och iterering snabbt.

- Tolkningsbart läge: Körs lite längre och fokuserar på modeller som är enklare att tolka.

- Best Fit: Genomför en mer omfattande sökning med en längre körtid som syftar till att hitta den bästa möjliga modellen.

- Anpassad: Gör att du kan justera vissa inställningar manuellt i autoML-utvärderingsversionen för en anpassad konfiguration.

Om du väljer rätt ML-uppgift och AutoML-läge ser du till att AutoML-guiden överensstämmer med dina mål, balanserar hastighet, tolkning och prestanda baserat på din valda konfiguration.

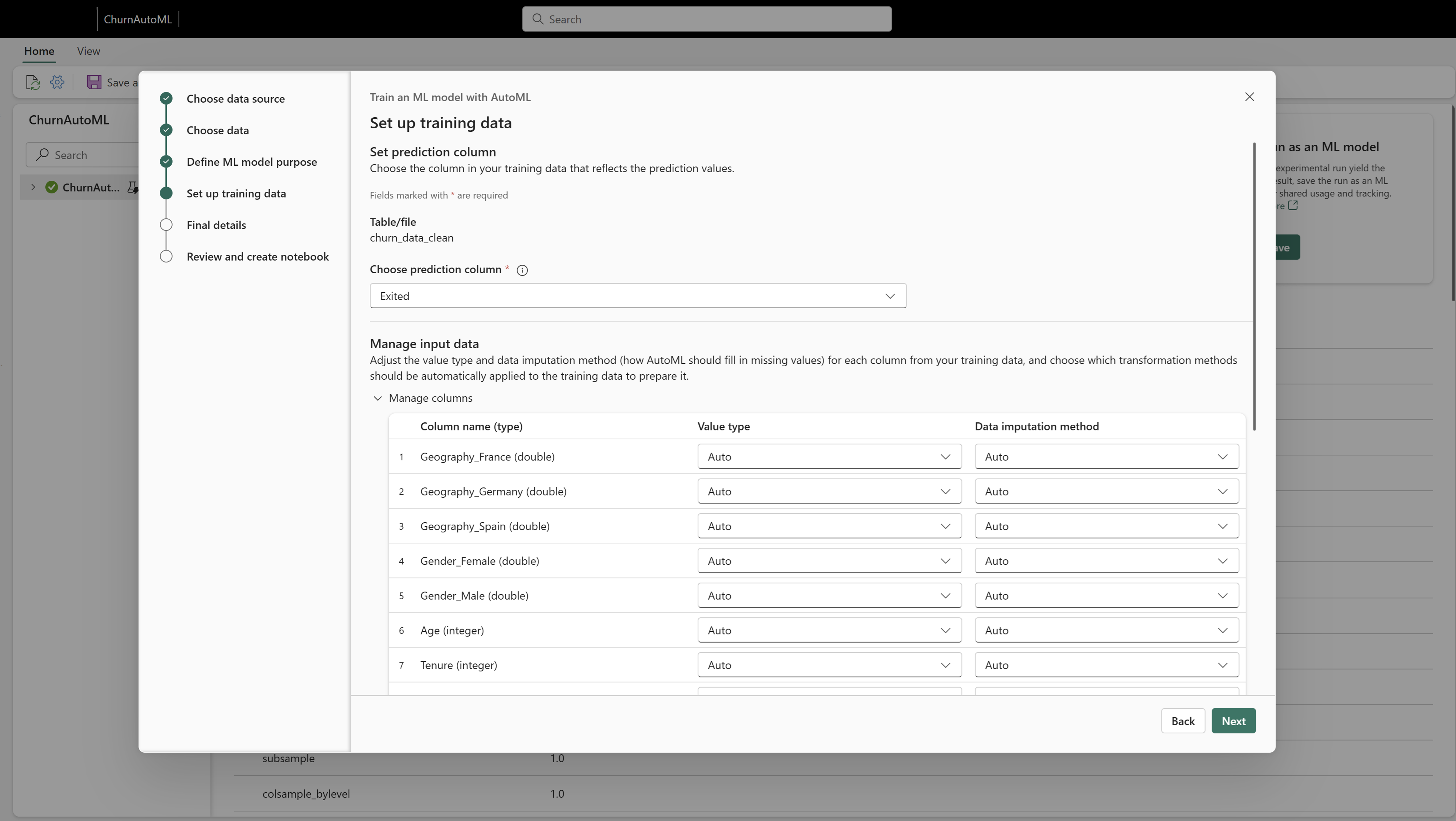

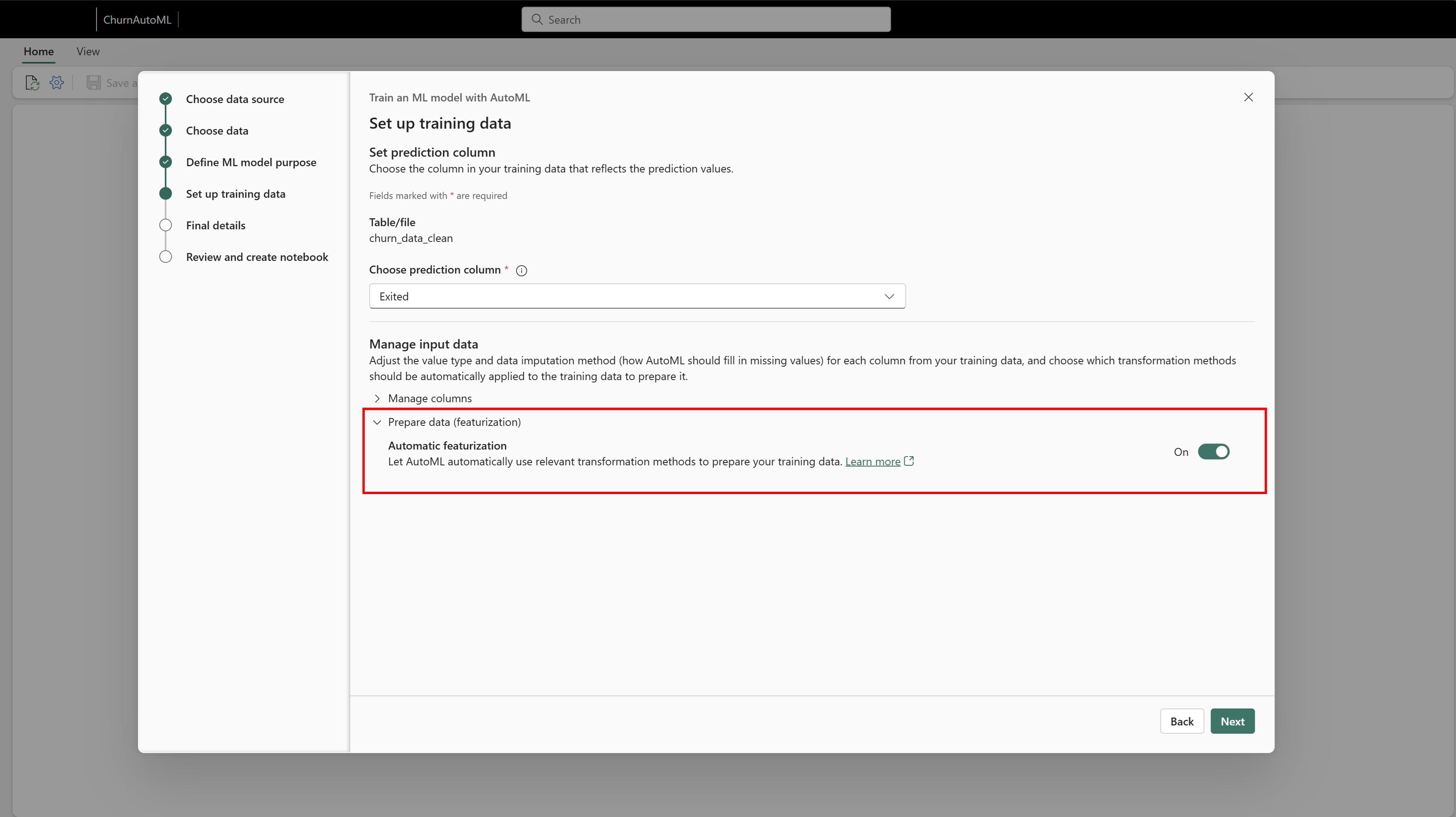

Ställ in träningsdata

I det här steget konfigurerar du träningsdata som AutoML ska använda för att skapa din modell. Börja med att välja förutsägelsekolumnen, det här är målkolumnen som din modell ska tränas att förutsäga.

När du har valt din förutsägelsekolumn kan du ytterligare anpassa hur dina indata hanteras:

- Datatyper: Granska och justera datatyperna för varje indatakolumn för att säkerställa kompatibilitet och optimera modellens prestanda.

- Imputationsmetod: Välj hur du ska hantera saknade värden i datamängden genom att välja en imputationsmetod som fyller luckor i data baserat på dina inställningar.

Du kan också aktivera eller inaktivera inställningen auto featurize . När det är aktiverat genererar auto featurize ytterligare funktioner för träning, vilket kan förbättra modellprestanda genom att extrahera extra insikter från dina data. Genom att definiera dessa datainställningar kan AutoML-guiden tolka och bearbeta datamängden korrekt, vilket förbättrar kvaliteten på utvärderingsresultaten.

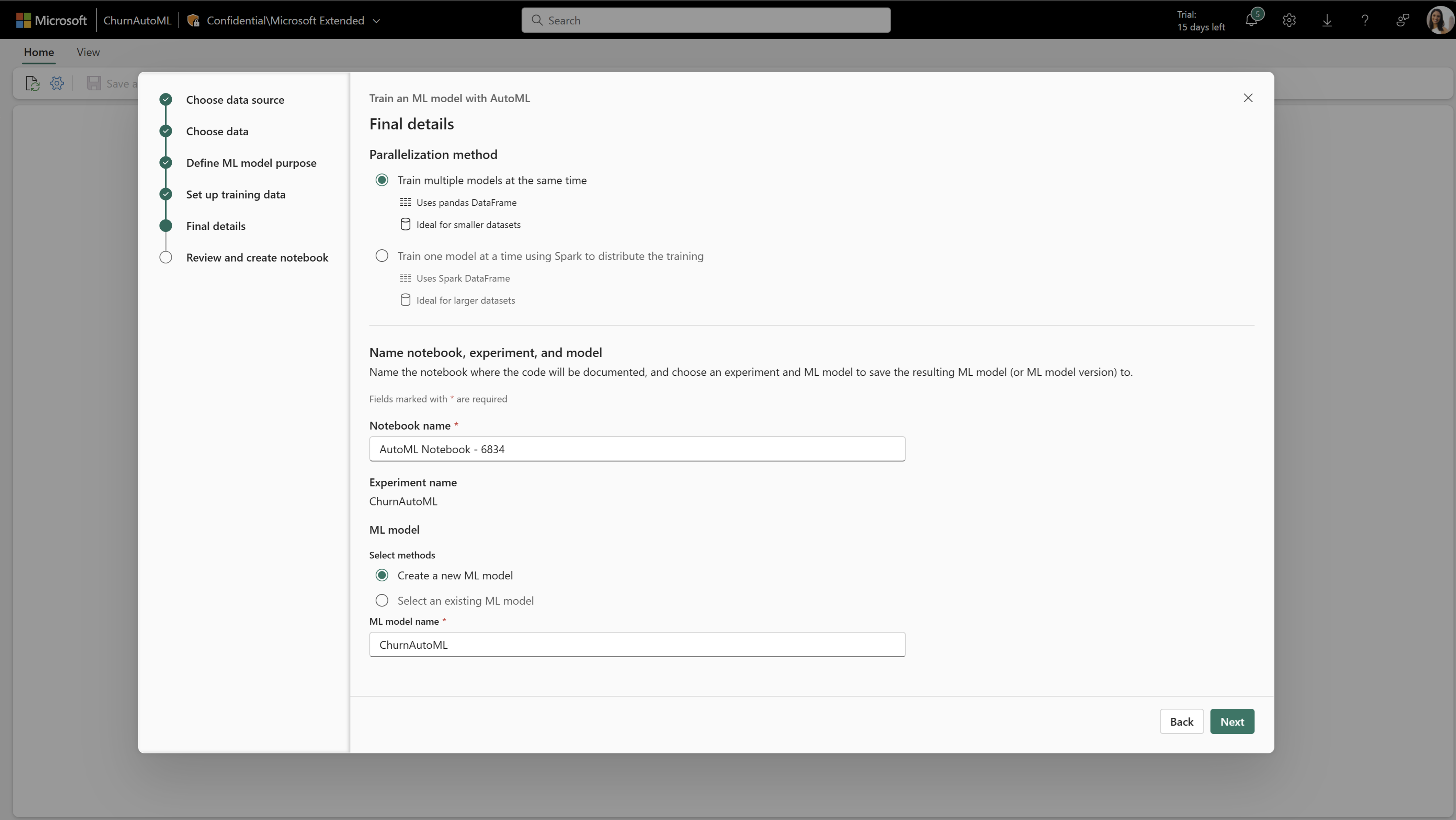

Ange slutlig information

Nu bestämmer du hur du vill att autoML-utvärderingsversionen ska köras, tillsammans med namngivningskonventioner för experimentet och utdata. Du har två alternativ för att köra autoML-utvärderingsversionen:

Träna flera modeller samtidigt: Det här alternativet är perfekt om dina data kan läsas in i en Pandas DataFrame, så att du kan använda ditt Spark-kluster för att köra flera modeller parallellt. Den här metoden påskyndar utvärderingsprocessen genom att träna flera modeller samtidigt.

Träna modeller sekventiellt med Spark: Det här alternativet passar för större datamängder eller de som drar nytta av distribuerad träning. Den använder Spark och SynapseML för att utforska distribuerade modeller och träna en modell i taget med den skalbarhet som Spark tillhandahåller.

Kommentar

Spark-läget stöder för närvarande inte loggning av indata- och utdataschemat för Spark-baserade modeller. Det här schemat är ett obligatoriskt fält för funktionen SynapseML PREDICT . Som en lösning kan du läsa in modellen direkt med MLflow och utföra slutsatsdragning i din notebook-fil, vilket kringgår schemakravet för förutsägelse.

När du har valt körningsläget, slutför du konfigurationen genom att ange namn för din Notebook, Experiment och Model. Dessa namngivningskonventioner hjälper dig att organisera dina AutoML-tillgångar inom Fabric och gör det enkelt att spåra och hantera dina utvärderingsversioner. När det är klart genereras en notebook-fil baserat på dina val, redo att köras och anpassas efter behov.

Granska och skapa notebook-fil

I det sista steget har du möjlighet att granska alla dina AutoML-inställningar och förhandsgranska den genererade koden som överensstämmer med dina val. Det här är din möjlighet att se till att den valda ML-uppgiften, läget, datakonfigurationen och andra konfigurationer uppfyller dina mål.

När du är nöjd kan du slutföra det här steget för att generera en notebook-fil som innehåller alla komponenter i autoML-utvärderingsversionen. Med den här anteckningsboken kan du spåra varje steg i processen, från förberedelse av data till modellutvärdering, och den fungerar som en omfattande dokumentation av ditt arbete. Du kan också anpassa anteckningsboken ytterligare efter behov och justera kod och inställningar för att förfina dina AutoML-utvärderingsresultat.

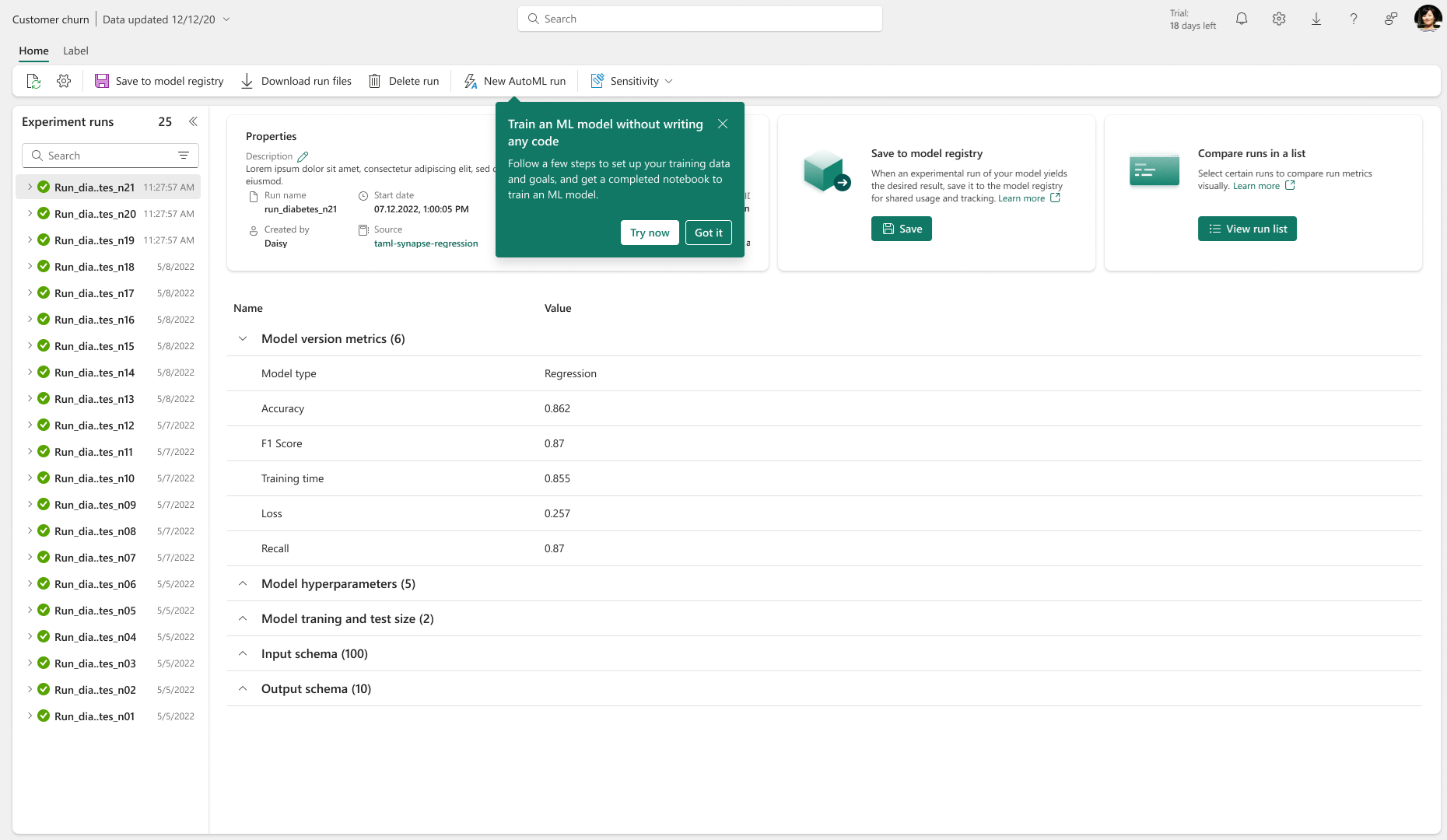

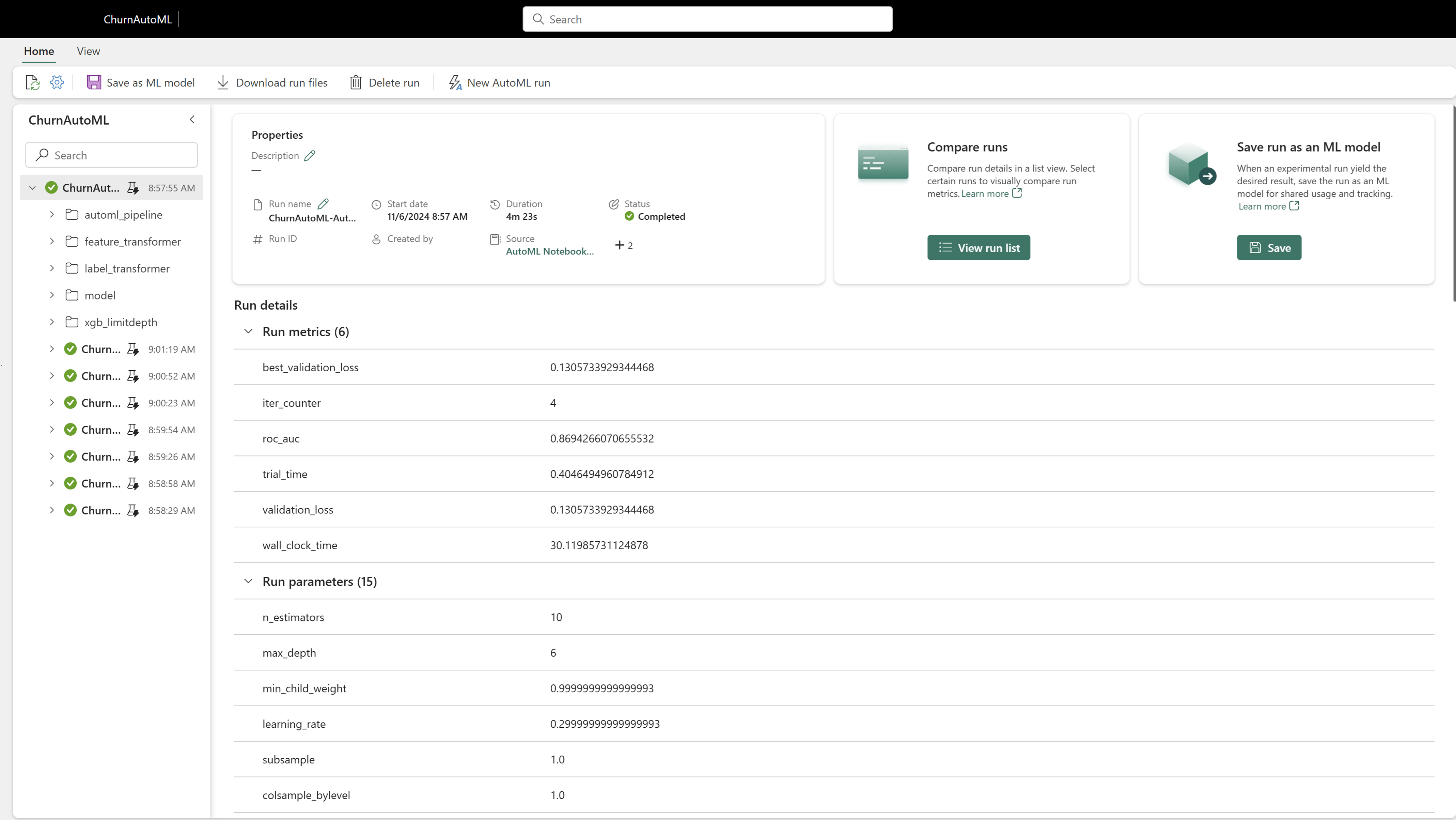

Spåra dina AutoML-körningar

När du kör notebook-filen använder AutoML-koden MLflow-loggning för att automatiskt spåra nyckelmått och parametrar för varje modell som testades under utvärderingsversionen. Med den här sömlösa integreringen kan du övervaka och granska varje iteration av autoML-körningen utan att behöva ytterligare installation.

Så här utforskar du resultatet av din AutoML-utvärderingsversion:

Gå till ml-experimentobjektet: I ett ML-experiment kan du spåra alla olika körningar som skapats av autoML-processen. Varje körning loggar värdefull information, till exempel prestandamått för modeller, parametrar och konfigurationer, vilket gör det enkelt att analysera och jämföra resultat.

Granska AutoML-konfigurationer: För varje AutoML-utvärderingsversion hittar du de AutoML-konfigurationer som används, vilket ger insikter om hur varje modell har konfigurerats och vilka inställningar som ledde till optimala resultat.

Leta upp den bästa modellen: Öppna ML-modellen för att få åtkomst till den slutliga modellen med bästa prestanda från autoML-utvärderingsversionen.

Det här spårningsarbetsflödet hjälper dig att organisera, utvärdera och hantera dina modeller, så att du får fullständig insyn i prestanda och inställningar för varje modell som testas i autoML-utvärderingsversionen. Härifrån kan du använda SynapseML PREDICT-gränssnittet eller generera förutsägelser direkt från dina notebook-filer.