Ögonspårning på HoloLens 2

HoloLens 2 möjliggör en ny nivå av kontext och mänsklig förståelse inom den holografiska upplevelsen genom att ge utvecklare möjlighet att använda information om vad användaren tittar på. Den här sidan förklarar hur utvecklare kan dra nytta av ögonspårning för olika användningsfall och vad de ska leta efter när de utformar ögonögabaserade användarinteraktioner.

API:et för ögonspårning har utformats med en användares integritet i åtanke. Det förhindrar att identifierbar information överförs, särskilt biometriska uppgifter. För ögonspårningskompatibla program måste användaren bevilja appen behörighet att använda ögonspårningsinformation.

Stöd för enheter

| Funktion | HoloLens (första generationen) | HoloLens 2 | Integrerande headset |

| Blick | ❌ | ✔️ | ❌ |

Demo av designkoncept för huvud- och ögonspårning

Om du vill se huvud- och ögonspårningsdesignen i praktiken kan du titta på vår videodemo Designing Holograms - Head Tracking and Eye Tracking nedan. När du är klar kan du fortsätta med en mer detaljerad genomgång av specifika ämnen.

Den här videon är hämtad från appen "Designing Holograms" HoloLens 2. Ladda ned och njut av den fullständiga upplevelsen här.

Kalibrering

För att ögonspårning ska fungera korrekt måste varje användare gå igenom en ögonspårningsanvändares kalibrering för vilken användaren måste titta på en uppsättning holografiska mål. Detta gör att enheten kan justera systemet, vilket ger en bekvämare och mer högkvalitativ visningsupplevelse för användaren och säkerställer korrekt ögonspårning på samma gång.

Ögonspårning bör fungera för de flesta användare, men det finns sällsynta fall där en användare inte kan kalibrera framgångsrikt. Kalibreringen kan misslyckas av olika skäl, inklusive men inte begränsat till:

- Användaren har tidigare avanmält sig från kalibreringsprocessen.

- Användaren blev distraherad och följde inte kalibreringsmålen.

- Användaren har vissa typer av kontaktlinser och glasögon som systemet ännu inte stöder.

- Användaren har vissa ögonfysiologi eller ögontillstånd eller genomgått ögonkirurgi, vilket systemet ännu inte stöder.

- Yttre faktorer som hämmar tillförlitlig ögonspårning såsom fläckar på HoloLens-visorn eller glasögon, intensivt direkt solljus och ocklusioner på grund av hår framför ögonen.

Utvecklare bör se till att ge tillräckligt stöd för användare för vilka ögonspårningsdata kanske inte är tillgängliga (som inte kan kalibreras korrekt). Vi har gett rekommendationer för återställningslösningar i avsnittet längst ned på den här sidan.

Mer information om kalibreringen och hur du säkerställer en smidig upplevelse finns på vår sida för användarkalibrering av ögonspårning .

Tillgängliga ögonspårningsdata

Med ögonspårning på HoloLens 2 kan utvecklare utforma naturliga och intuitiva indata- och interaktionsscenarier. API:et för ögonspårning ger information om vad användaren ser som en enda blickstråle (blickens ursprung och riktning) vid cirka 30 FPS (30 Hz). För att ögonspårning ska fungera korrekt måste varje användare gå igenom en ögonspårningsanvändares kalibrering. Mer detaljerad information om hur du kommer åt ögonspårningsdata finns i våra utvecklarguider för att använda blick i DirectX och blick i Unity.

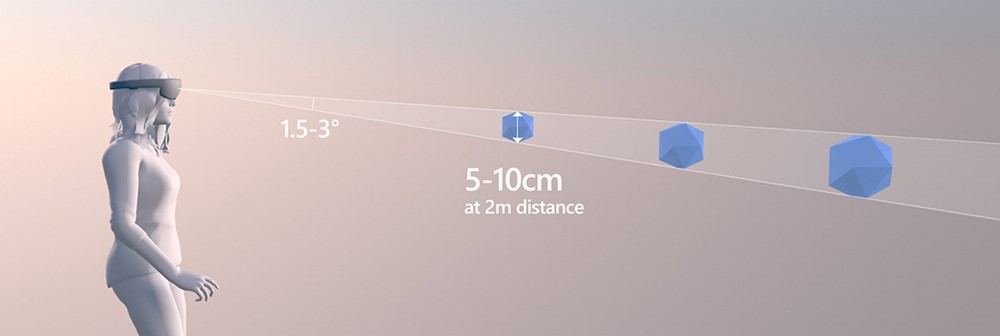

Den förutsagda blicken ligger ungefär inom 1,5 grader i visuell vinkel runt det faktiska målet (se bilden nedan). Små imprecisioner förväntas, så utvecklare bör planera för viss marginal runt detta lägre gränsvärde (till exempel kan 2,0-3,0 grader resultera i en mycket bekvämare upplevelse). Vi diskuterar hur du kan hantera valet av små mål i detalj nedan.

Optimal målstorlek på ett avstånd på 2 meter

Extended Eye Tracking-data

Utökade API:er för ögonspårning gör det möjligt för utvecklare att låsa upp nästa nivå av innovativa scenarier som hälsobedömning, övervakning och terapi genom att ge mer detaljerad information om användarens ögonöga.

Utökade API:er för ögonspårning ger tillgång till befintliga ögonspårningsvärden och nya funktioner som enskilda (vänster och höger) ögonögavektorer, stödda bildfrekvenser och möjligheten att ställa in bildfrekvensen för ögonspårning till 30, 60 eller 90fps. Om du vill använda EXTENDED Eye Tracking-API:et kan du läsa våra utvecklarguider för att använda EXTENDED Eye Tracking-API:er för inbyggda api:er eller Unity.

Användningsfall

Med ögonspårning kan program spåra var användaren söker i realtid. I följande användningsfall beskrivs vissa interaktioner som är möjliga med ögonspårning på HoloLens 2 i mixad verklighet. Dessa användningsfall är ännu inte en del av Holographic Shell-upplevelsen (gränssnittet som visas när du startar HoloLens 2). Du kan prova några av dem i Mixed Reality Toolkit. Toolkit innehåller flera intressanta och kraftfulla exempel för att använda ögonspårning, till exempel snabba och enkla ögonstödda målval och automatiskt bläddra igenom text baserat på vad användaren tittar på.

Användar avsikt

Information om var och vad en användare tittar på ger en kraftfull kontext för andra indata, till exempel röst, händer och kontrollanter. Detta kan användas för olika uppgifter. Användaren kan till exempel snabbt och enkelt rikta in sig på scenen genom att titta på ett hologram och säga "select" (se även blick och incheckning) eller "put this..." (placera det här...) och sedan se var de vill placera hologrammet och säga "... där". Exempel på detta finns i Mixed Reality Toolkit – Eye-supported Target Selection and Mixed Reality Toolkit – Eye-supported Target Positioning (Målplacering som stöds av ögon).

Dessutom kan ett exempel för användarsyfte inkludera användning av information om vad användare tittar på för att förbättra engagemanget med inbäddade virtuella agenter och interaktiva hologram. Virtuella agenter kan till exempel anpassa tillgängliga alternativ och deras beteende baserat på innehåll som visas för närvarande.

Implicita åtgärder

Kategorin implicita åtgärder har nära samband med användarens avsikt. Tanken är att hologram eller användargränssnittselement reagerar på ett instinktivt sätt som kanske inte ens känns som om användaren interagerar med systemet alls, utan snarare att systemet och användaren är synkroniserade. Ett exempel är eye-gaze-based auto scroll där användaren kan läsa en lång text som automatiskt börjar rulla när användaren kommer längst ned i textrutan. Detta håller användaren i flödet av läsning utan att lyfta ett finger. En viktig aspekt av detta är att rullningshastigheten anpassas till användarens läshastighet.

Ett annat exempel är ögonstödd zoom och panorering där användaren kan känna att de dyker exakt mot det de fokuserar på.

Utlösande och kontrollerande zoomhastighet kan styras med röst- eller handinmatning, vilket är viktigt för att ge användaren en känsla av kontroll samtidigt som man undviker att bli överbelastad. Vi går igenom dessa designöverväganden i detalj nedan. När zoomat in kan användaren smidigt följa, till exempel under en gata för att utforska sitt grannskap med hjälp av sin blick. Demoexempel för dessa typer av interaktioner finns i Mixed Reality Toolkit – Eye-stödda navigeringsexempel.

Andra användningsfall för implicita åtgärder kan vara:

- Smarta meddelanden: Blir du någonsin irriterad av meddelanden som dyker upp mitt i din vy? Du kan göra den här upplevelsen bättre genom att förskjuta meddelanden från där användaren för närvarande tittar. Detta begränsar distraktioner och stänger dem automatiskt när användaren är klar med läsningen.

- Uppmärksam hologram: Det här är hologram som reagerar på ett subtilt sätt när de visas. Detta kan variera från något glödande gränssnittselement till en långsamt blommande blomma till en virtuell hund som börjar titta tillbaka på användaren och vifta med svansen. Den här interaktionen kan ge en intressant känsla av anslutning och tillfredsställelse i ditt program.

Uppmärksamhetsspårning

Information om var eller vad användarna tittar på kan vara ett oerhört kraftfullt verktyg. Det kan hjälpa dig att utvärdera användbarheten hos designer och identifiera problem i arbetsflöden för att göra dem mer effektiva. Ögonspårningsvisualisering och analys är en vanlig metod inom olika programområden. Med HoloLens 2 tillhandahåller vi en ny dimension för den här förståelsen. 3D-hologram kan placeras i verkliga sammanhang och utvärderas därefter.

Mixed Reality Toolkit innehåller grundläggande exempel för loggning och inläsning av ögonspårningsdata och hur du visualiserar dem.

Microsoft arbetar för att underlätta innovation och samtidigt säkerställa att användarna får en informerad och transparent upplevelse av hur deras ögonspårningsinformation används. Vi fortsätter att arbeta med våra utvecklare och UX-team för att ge vägledning till tredje part för att säkerställa att upplevelserna är centrerad kring användaren.

Andra program i det här området kan vara:

- Fjärrvisualisering av ögonöga: Visualisera vad fjärrmedarbetare tittar på. Detta kan ge omedelbar feedback och underlätta mer korrekt informationsbearbetning.

- Användarforskningsstudier: Uppmärksamhetsspårning kan ge insikter om hur användare uppfattar och engagerar sig i den naturliga miljön utan att störa. Detta kan hjälpa utvecklare att utforma mer instinktiva interaktioner mellan människa och dator. Ögonspårning kan ge information som inte är direkt artikulerad av deltagarna i studien och lätt kan missas av forskaren.

- Övervakning av träning och prestanda: Öva och optimera körningen av uppgifter genom att identifiera flaskhalsar mer effektivt i körningsflödet. Ögonspårning kan ge naturlig, realtids- och objektiv information för att förbättra utbildning, produktivitet och säkerhet på arbetsplatsen.

- Designutvärderingar, marknadsföring och konsumentforskning: Ögonspårning gör det möjligt för kommersiella företag att utföra marknadsförings- och konsumentstudier i verkliga miljöer eller analysera vad som fångar en användares uppmärksamhet för att förbättra produkt- eller rymddesignen.

Andra användningsfall

- Gaming: Har du någonsin velat ha superkrafter? Här är din chans!

Du kan levitera hologram genom att stirra på dem.

Skjuta laserstrålar från dina ögon - prova det i RoboRaid för HoloLens 2.

Förvandla fiender till sten eller frys dem.

Använd din röntgensyn för att utforska byggnader.

Din fantasi är gränsen! Akta dig för att inte överväldiga användaren. Mer information finns i våra riktlinjer för ögonbaserad indatadesign.

Uttrycksfulla avatarer: Ögonspårning hjälper till med mer uttrycksfulla 3D-avatarer genom att använda live eye tracking-data för att animera avatarens ögon och få dem att följa vad användaren tittar på.

Textpost: Ögonspårning kan användas som ett alternativ för textinmatning med låg ansträngning, särskilt när tal eller händer är obekväma att använda.

Använda blick för interaktion

Det kan vara svårt att skapa en interaktion som drar nytta av snabbrörlig ögoninriktning. Eftersom ögonen kan röra sig snabbt, om du inte är försiktig med hur man använder blickindata, kan användarna tycka att upplevelsen är överväldigande eller distraherande. Men detta är väl värt utmaningen eftersom ögonspårning låter dig skapa verkligt magiska upplevelser som kommer att upphetsa dina användare! För att hjälpa dig kan du ta en titt på vår översikt över viktiga fördelar, utmaningar och designrekommendationer för interaktion med blicken.

Reservlösningar när ögonspårning inte är tillgängligt

I sällsynta fall är ögonspårningsdata kanske inte tillgängliga. Detta kan inträffa av ett antal orsaker – de vanligaste anges nedan:

- Det gick inte att kalibrera användaren.

- Användaren hoppade över kalibreringen.

- Användaren är kalibrerad, men bestämde sig för att inte ge din app behörighet att använda sina ögonspårningsdata.

- Användaren har unika glasögon eller något ögontillstånd som systemet ännu inte stöder.

- Externa faktorer som hämmar tillförlitlig ögonspårning såsom fläckar på HoloLens-visorn eller glasögon, intensivt direkt solljus och ocklusioner på grund av hår framför ögonen.

Utvecklare bör se till att det finns lämpligt reservstöd för dessa användare. På sidan Ögonspårning i DirectX förklarar vi de API:er som krävs för att identifiera om ögonspårningsdata är tillgängliga.

Vissa användare kan besluta att större sekretess är viktigare för dem än den förbättrade upplevelse som ögonspårning kan ge, så att de avsiktligt återkallar åtkomsten till sina ögonspårningsdata. I vissa fall kan dock återkallandet vara oavsiktligt. Om appen använder ögonspårning och detta är en viktig del av upplevelsen rekommenderar vi att du kommunicerar detta tydligt till användaren. Att förklara för användaren hur ögonspårning låser upp programmets fulla potential kan hjälpa dem att bättre förstå vad de ger upp. Om ögonspårning är aktiverat men inte fungerar kan du hjälpa användaren att identifiera och lösa problemet med hjälp av checklistan ovan som en guide. Om du till exempel kan upptäcka att systemet stöder ögonspårning och användaren har kalibrerats och har gett sin behörighet, men inga ögonspårningsdata tas emot, kan detta peka på problem som fläckar eller ögon som occluded.

Det finns sällsynta fall där ögonspårning bara inte fungerar för någon och det finns ingen uppenbar anledning. Var medveten om detta genom att låta användaren stänga eller inaktivera påminnelser för att aktivera ögonspårning i din app.

Gå tillbaka för appar med ögonöga som primär indatapekare

Om din app använder blick som pekarindata för att snabbt välja hologram över hela scenen, men ögonspårningsdata inte är tillgängliga, rekommenderar vi att du faller tillbaka till huvudögon och visar huvudögonmarkören. Vi rekommenderar att du använder en tidsgräns (till exempel 500–1 500 ms) för att avgöra om du vill växla eller inte. Den här åtgärden förhindrar att markörer visas varje gång systemet kort förlorar spårning på grund av snabba ögonrörelser eller blinkningar och blinkningar. Om du är Unity-utvecklare hanteras den automatiska återställningen till huvudsyssla redan i Mixed Reality Toolkit. Om du är DirectX-utvecklare måste du hantera den här växeln själv.

Fall tillbaka för andra ögonspårningsspecifika program

Din app kan använda blicken på ett unikt sätt som är specifikt anpassat för ögonen – till exempel för att animera en avatars ögon eller ögonbaserade uppmärksamhetsvärmekartor som förlitar sig på exakt information om visuell uppmärksamhet. I den här typen av fall finns det ingen tydlig reserv. Om ögonspårning inte är tillgängligt kan dessa funktioner behöva inaktiveras. Återigen rekommenderar vi att du tydligt kommunicerar detta till användaren, som kanske inte känner till att funktionen inte fungerar.

Den här sidan har förhoppningsvis gett dig en bra översikt för att komma igång med att förstå rollen som ögonspårning och blickinmatning för HoloLens 2. För att komma igång med att utveckla kan du kolla in vår information om blickens roll för att interagera med hologram, blick i Unity och blick i DirectX.