適用於: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

提示

試用 Microsoft Fabric 中的 Data Factory,這是適用於企業的全方位分析解決方案。 Microsoft Fabric 涵蓋從資料移動到資料科學、即時分析、商業智慧和報告的所有項目。 了解如何免費開始新的試用!

Azure Data Factory 或 Synapse Analytics 管線中的 HDInsight Hive 活動在您自己或隨選的 HDInsight 叢集上執行 Hive 查詢。 本文是根據 資料轉換活動 一文,它呈現資料轉換和支援的轉換活動的一般概觀。

如果您不熟悉 Azure Data Factory 和 Synapse Analytics,請仔細閱讀 Azure Data Factory 或 Synapse Analytics 的簡介文章,並在閱讀本文之前完成教學課程:轉換資料。

使用 UI 將 HDInsight Hive 活動新增至管線

如果要在管線中使用 Azure Data Lake Analytics 的 HDInsight Hive 活動,請完成下列步驟:

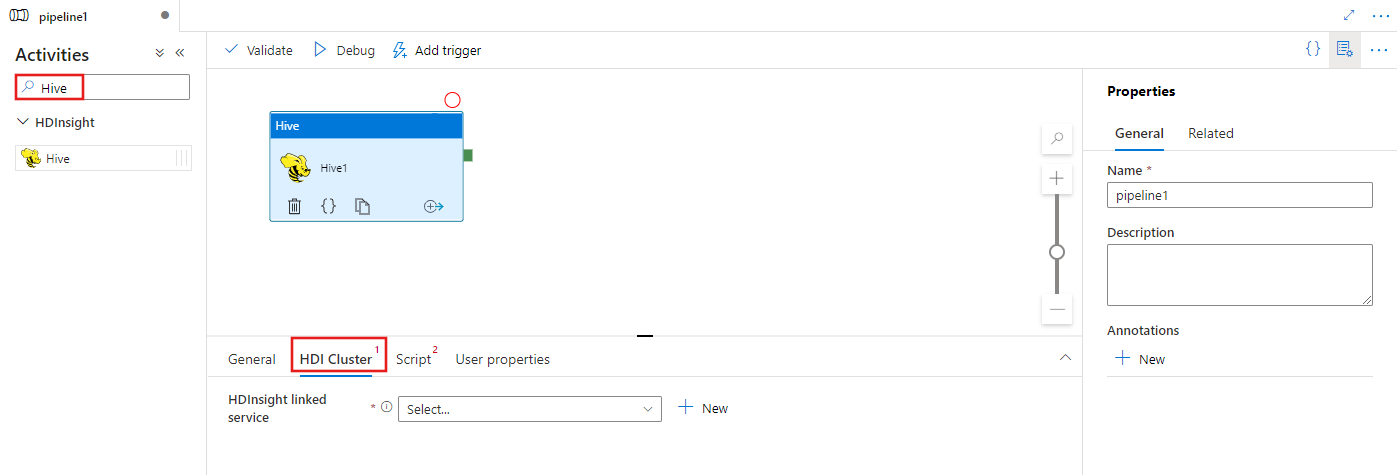

在管線 [活動] 窗格中搜尋 Hive,然後將 Hive 活動拖曳至管線畫布中。

若尚未選取 Hive 活動,請在畫布上選取新的 Hive 活動。

選取 [HDI 叢集] 索引標籤,即可選取或建立 HDInsight 叢集的新連結服務,該叢集會用來執行 Hive 活動。

選取 [指令碼] 索引標籤,以選取或建立新的儲存體連結服務,以及將主控指令碼儲存位置內的路徑。

![顯示Hive活動的 [腳稿] 索引標籤 UI。](media/transform-data-using-hadoop-hive/hive-script-configuration.png)

語法

{

"name": "Hive Activity",

"description": "description",

"type": "HDInsightHive",

"linkedServiceName": {

"referenceName": "MyHDInsightLinkedService",

"type": "LinkedServiceReference"

},

"typeProperties": {

"scriptLinkedService": {

"referenceName": "MyAzureStorageLinkedService",

"type": "LinkedServiceReference"

},

"scriptPath": "MyAzureStorage\\HiveScripts\\MyHiveScript.hql",

"getDebugInfo": "Failure",

"arguments": [

"SampleHadoopJobArgument1"

],

"defines": {

"param1": "param1Value"

}

}

}

語法詳細資料

| 屬性 | 描述 | 必要 |

|---|---|---|

| NAME | 活動的名稱 | Yes |

| description | 說明活動用途的文字 | No |

| type | 對於 Hive 活動,活動類型為 HDinsightHive | Yes |

| linkedServiceName | 註冊為連結服務的 HDInsight 叢集參考。 若要深入了解此已連結的服務,請參閱計算已連結的服務一文。 | Yes |

| scriptLinkedService | Azure 儲存體已連結的服務用來儲存要執行之 Hive 指令碼的參考。 這裡僅支援 Azure Blob 儲存體和 ADLS Gen2 的連結服務。 如果您未指定這項連結服務,則會使用 HDInsight 已連結的服務中定義的 Azure 儲存體已連結的服務。 | No |

| scriptPath | 提供儲存在 scriptLinkedService 引用之 Azure 儲存體中指令碼檔案的路徑。 檔案名稱有區分大小寫。 | Yes |

| getDebugInfo | 指定何時將記錄檔複製到 HDInsight 叢集所使用 (或) scriptLinkedService 所指定的 Azure 儲存體。 允許的值︰None、Always 或 Failure。 預設值:無。 | No |

| 引數 | 指定 Hadoop 作業的引數陣列。 引數會以命令列引數的方式傳遞給每項工作。 | No |

| 定義 | 指定參數作為機碼/值組,以供在 Hive 指令碼內參考。 | No |

| queryTimeout | 查詢逾時值 (單位為分鐘)。 適用於企業安全性套件已啟用的 HDInsight 叢集。 | No |

注意

queryTimeout 的預設值為 120 分鐘。

相關內容

請參閱下列文章,其說明如何以其他方式轉換資料: