Poznámka:

Přístup k této stránce vyžaduje autorizaci. Můžete se zkusit přihlásit nebo změnit adresáře.

Přístup k této stránce vyžaduje autorizaci. Můžete zkusit změnit adresáře.

PLATÍ PRO: Rozšíření Azure CLI ml v2 (aktuální)

Rozšíření Azure CLI ml v2 (aktuální) Python SDK azure-ai-ml v2 (aktuální)

Python SDK azure-ai-ml v2 (aktuální)

Zodpovědná umělá inteligence (zodpovědná umělá inteligence) je přístup k vývoji, posuzování a nasazování systémů AI bezpečně, eticky a s důvěrou. Systémy AI jsou výsledkem mnoha rozhodnutí, která udělali jejich tvůrci. Zodpovědná AI pomáhá řídit tato rozhodnutí – od definování účelu systému až po interakci uživatelů – směrem k přínosnějším a spravedlivým výsledkům. Udržuje lidi a jejich cíle v centru návrhu a respektuje hodnoty, jako je nestrannost, spolehlivost a transparentnost.

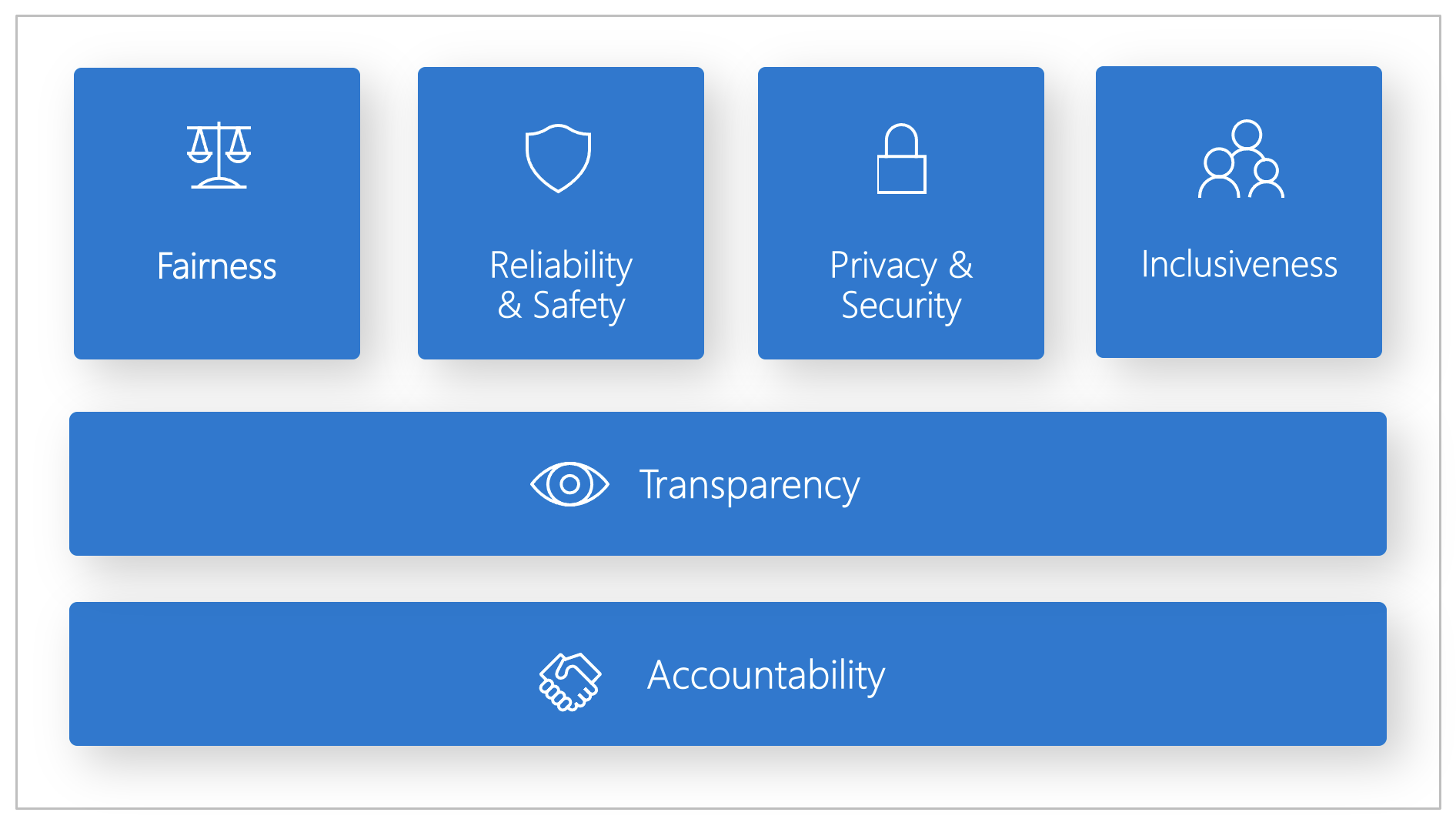

Microsoft vytvořil zodpovědný standard AI, rámec pro vytváření systémů AI založených na šesti principech: nestrannost, spolehlivost a bezpečnost, ochrana osobních údajů a zabezpečení, inkluzivnost, transparentnost a odpovědnost. Tyto principy jsou základem zodpovědného a důvěryhodného přístupu k umělé inteligenci, zejména s tím, jak se inteligentní technologie stávají častějšími v každodenních produktech a službách.

Tento článek vysvětluje, jak Azure Machine Learning poskytuje nástroje, které vývojářům a datovým vědcům pomáhají implementovat a zprovoznit těchto šest principů.

Nestrannost a inkluzivnost

Systémy AI by měly zacházet se všemi poměrně a vyhnout se ovlivnění podobných skupin odlišně. Pokud například systémy AI poskytují pokyny k lékařské léčbě, žádostem o půjčky nebo zaměstnání, měly by stejným doporučením poskytnout lidem s podobnými příznaky, finančními okolnostmi nebo kvalifikacemi.

Nestrannost a inkluzivnost ve službě Azure Machine Learning: Komponenta posouzení nestrannostiřídicího panelu Zodpovědné umělé inteligence pomáhá vyhodnotit nestrannost modelu napříč citlivými skupinami, jako je pohlaví, etnika, věk a další charakteristiky.

Spolehlivost a zabezpečení

Aby systémy AI mohly vytvářet důvěru, musí spolehlivě, bezpečně a konzistentně fungovat. Měly by fungovat tak, jak jsou navrženy, reagovat bezpečně na neočekávané podmínky a odolat škodlivé manipulaci. Jejich chování a schopnost zpracovávat různé podmínky odráží řadu situací, které vývojáři očekávali během návrhu a testování.

Spolehlivost a bezpečnost ve službě Azure Machine Learning: Komponenta analýzy chybna řídicím panelu Zodpovědné umělé inteligence vám pomůže:

- Získejte podrobné informace o tom, jak se pro model distribuuje selhání.

- Identifikujte kohorty (podmnožinu) dat s vyšší chybovostí než celkový srovnávací test.

K těmto nesrovnalostem může dojít, když systém nebo model nedodržuje určité demografické skupiny nebo zřídka pozorované vstupní podmínky v trénovacích datech.

Průhlednost

Když systémy AI informují rozhodnutí, která ovlivňují životy lidí, je důležité, aby lidé pochopili, jak se tato rozhodnutí dělají. Například banka může použít systém AI k rozhodnutí, jestli je osoba úvěrová, nebo společnost může použít jeden z nich k výběru uchazečů o zaměstnání.

Klíčovou součástí transparentnosti je interpretovatelnost: poskytování užitečných vysvětlení chování systému AI. Zlepšení interpretability pomáhá zúčastněným stranám pochopit, jak a proč systémy AI fungují, aby mohly identifikovat problémy s výkonem, pochybnosti o nestrannosti, postupy vyloučení nebo nezamýšlené výsledky.

Transparentnost ve službě Azure Machine Learning: Interpretovatelnost modelu a kontrafaktuální komponenty řídicího panelu Zodpovědné umělé inteligence pomáhají generovat popisy předpovědí modelu, které jsou srozumitelné pro člověka.

Komponenta interpretability modelu poskytuje několik zobrazení chování modelu:

- Globální vysvětlení. Jaké funkce mají například vliv na celkové chování modelu alokace půjčky?

- Místní vysvětlení. Proč byla například žádost o půjčku zákazníka schválena nebo odmítnuta?

- Vysvětlení modelu pro vybranou kohortu datových bodů Jaké funkce mají například vliv na celkové chování modelu přidělování úvěrů pro žadatele s nízkým příjmem?

Kontrafaktuální komponenta citlivostní citlivosti pomáhá pochopit a ladit model strojového učení tím, že ukazuje, jak reaguje na změny funkcí a perturbace.

Azure Machine Learning také podporuje přehled výkonnostních metrik zodpovědné umělé inteligence. Přehled výkonnostních metrik je přizpůsobitelná sestava PDF, kterou můžou vývojáři konfigurovat, generovat, stahovat a sdílet s technickými i netechnickými účastníky. Pomáhá informovat zúčastněné strany o stavu datové sady a modelu, dosáhnout dodržování předpisů a vybudovat důvěru. Přehled výkonnostních metrik může také podporovat kontroly auditu tím, že odhalí charakteristiky modelu strojového učení.

Ochrana osobních údajů a zabezpečení

S tím, jak se AI stává častější, je ochrana osobních údajů a zabezpečení osobních a obchodních informací důležitější a složitější. Ochrana osobních údajů a zabezpečení dat vyžadují úzkou pozornost, protože systémy AI potřebují data k provádění přesných předpovědí a rozhodování. Systémy AI musí dodržovat zákony o ochraně osobních údajů, které:

- Vyžadovat transparentnost shromažďování, používání a ukládání dat.

- Požádejte spotřebitele, aby měli odpovídající kontrolní mechanismy k volbě způsobu jejich použití dat.

Ochrana osobních údajů a zabezpečení ve službě Azure Machine Learning: Azure Machine Learning umožňuje správcům a vývojářům vytvářet zabezpečené konfigurace , které vyhovují firemním zásadám. Se službou Azure Machine Learning a platformou Azure můžete:

- Omezte přístup k prostředkům a operacím podle uživatelského účtu nebo skupiny.

- Omezte příchozí a odchozí síťovou komunikaci.

- Šifrování přenášených a neaktivních uložených dat

- Vyhledejte ohrožení zabezpečení.

- Použijte a auditujte zásady konfigurace.

Microsoft také vytvořil dva opensourcové balíčky, které pomáhají implementovat zásady ochrany osobních údajů a zabezpečení:

SmartNoise: Rozdílová ochrana osobních údajů je sada systémů a postupů, které pomáhají udržovat data jednotlivců v bezpečí a soukromí. V řešeních strojového učení může být pro dodržování právních předpisů vyžadována rozdílová ochrana osobních údajů. SmartNoise je opensourcový projekt (společně vyvinutý Microsoftem), který obsahuje komponenty pro vytváření rozdílových privátních systémů, které jsou globální.

Counterfit: Counterfit je opensourcový projekt, který se skládá z nástroje příkazového řádku a obecné automatizační vrstvy, která vývojářům umožňuje simulovat kybernetické útoky na systémy AI. Nástroj si může stáhnout kdokoli a nasadit ho přes Azure Cloud Shell a spustit ho v prohlížeči nebo ho nasadit místně v prostředí Anaconda Python. Může vyhodnotit modely AI hostované v různých cloudových prostředích, místně nebo na hraničních zařízeních. Nástroj je nezávislý na modelech AI a podporuje různé datové typy, včetně textu, obrázků nebo obecného vstupu.

Odpovědnost

Lidé, kteří navrhují a nasazují systémy AI, musí být zodpovědní za fungování těchto systémů. Organizace by měly používat oborové standardy k vývoji norem odpovědnosti. Tyto normy pomáhají zajistit, aby systémy umělé inteligence nebyly konečným orgánem pro rozhodnutí, která ovlivňují životy lidí, a aby lidé udržovali smysluplnou kontrolu nad vysoce autonomními systémy.

Odpovědnost ve službě Azure Machine Learning: Operace strojového učení (MLOps) jsou založené na principech a postupech DevOps, které zlepšují efektivitu pracovních postupů AI. Azure Machine Learning poskytuje tyto funkce MLOps pro lepší odpovědnost:

- Zaregistrujte, zabalte a nasaďte modely odkudkoli. Můžete také sledovat přidružená metadata, která jsou potřebná k použití modelu.

- Zachyťte data zásad správného řízení pro kompletní životní cyklus strojového učení. Protokolované informace rodokmenu můžou zahrnovat, kdo publikuje modely, proč byly provedeny změny a kdy byly modely nasazeny nebo použity v produkčním prostředí.

- Upozorněte a upozorněte na události v životním cyklu strojového učení. Mezi příklady patří dokončování experimentů, registrace modelu, nasazení modelu a detekce odchylek dat.

- Monitorování provozních problémů a problémů souvisejících s strojovém učením Porovnejte vstupy modelu mezi trénováním a odvozováním, prozkoumejte metriky specifické pro model a poskytněte monitorování a výstrahy ve vaší infrastruktuře strojového učení.

Kromě toho přehled výkonnostních metrik zodpovědné umělé inteligence ve službě Azure Machine Learning vytváří odpovědnost tím, že umožňuje komunikaci mezi stranami. Přehled výkonnostních metrik umožňuje vývojářům konfigurovat, stahovat a sdílet přehledy o stavu modelu s technickými i netechnickými účastníky. Sdílení těchto přehledů pomáhá vytvářet důvěryhodnost.

Azure Machine Learning také podporuje rozhodování tím, že informuje obchodní rozhodnutí prostřednictvím:

- Přehledy řízené daty, které zúčastněným stranám pomáhají pochopit kauzální účinky na léčbu výsledků pomocí historických dat. Například "Jak by lék ovlivnil krevní tlak pacienta?" Tyto přehledy pocházejí ze komponenty příčinné odvozovánířídicího panelu zodpovědné umělé inteligence.

- Modelem řízené přehledy, které odpovídají na otázky uživatelů (například "Co můžu udělat, abych příště získal jiný výsledek než umělá inteligence?"), aby mohli provést akci. Tyto přehledy jsou poskytovány prostřednictvím kontrafaktuální komponenty citlivostní analýzy řídicího panelu Zodpovědné AI.

Další kroky

- Další informace o implementaci zodpovědné umělé inteligence ve službě Azure Machine Learning najdete na řídicím panelu Zodpovědné AI.

- Zjistěte, jak vygenerovat řídicí panel zodpovědné umělé inteligence prostřednictvím rozhraní příkazového řádku a sady SDK nebo studio Azure Machine Learning uživatelského rozhraní.

- Zjistěte, jak vygenerovat přehled výkonnostních metrik Zodpovědné AI na základě přehledů zjištěných na řídicím panelu Zodpovědné AI.

- Přečtěte si o zodpovědném standardu AI pro vytváření systémů AI podle šesti klíčových principů.