Poznámka:

Přístup k této stránce vyžaduje autorizaci. Můžete se zkusit přihlásit nebo změnit adresáře.

Přístup k této stránce vyžaduje autorizaci. Můžete zkusit změnit adresáře.

Platí pro:✅ Datové inženýrství a datové vědy ve Fabricu

Fabric Data Engineering a datová věda běží na plně spravované výpočetní platformě Apache Spark. Spouštěcí fondy poskytují rychlé spuštění relace, typicky za 5 až 10 sekund, bez ručního nastavení. Vlastní fondy Sparku umožňují přizpůsobit velikost uzlů, chování škálování a další nastavení výpočtů pro vaše zatížení. Stručně řečeno, úvodní fondy poskytují rychlý, předem nakonfigurovaný Spark, zatímco vlastní fondy Spark poskytují hlubší kontrolu a flexibilitu.

Startovací bazény

Startovací pooly představují rychlý a snadný způsob, jak použít Spark na platformě Microsoft Fabric doslova během několika sekund. Spark relace můžete využívat okamžitě, aniž byste museli čekat, až vám Spark nastaví uzly, což vám umožní dělat více s daty a rychleji získávat poznatky.

Spouštěcí fondy mají clustery Apache Spark s relacemi, které jsou vždy aktivní a připravené pro vaše požadavky. Používají střední uzly, které se dynamicky škálují na základě vašich potřeb úloh Sparku.

Pokud používáte počáteční fond bez jakýchkoli dodatečných knihovních závislostí nebo individuálních vlastností Sparku, relace obvykle začíná za 5 až 10 sekund. Toto rychlé spuštění je možné, protože cluster je již spuštěný a nevyžaduje čas zřizování.

Poznámka:

Počáteční fondy podporují pouze střední velikost uzlu. Pokud vyberete jinou velikost uzlu nebo přizpůsobíte konfigurace výpočetních prostředků, Fabric použije spuštění relace na vyžádání, což může trvat 2 až 5 minut.

Existuje však několik scénářů, kdy může zahájení relace trvat déle.

Vlastní knihovny nebo vlastnosti Sparku: Pokud jste ve svém prostředí nakonfigurovali knihovny nebo vlastní nastavení, musí Spark relaci po vytvoření přizpůsobit. Další doba závisí na režimu publikování knihovny:

- Rychlý režim: Knihovny se instalují na začátku relace. V závislosti na počtu a velikosti závislostí očekávejte dalších 30 sekund až 5 minut.

- Úplný režim: Nasazení snímku prostředí probíhá při spuštění relace, obvykle přidává 1 až 3 minuty.

- Plný režim s vlastním živým fondem: Snímek je již předem nainstalován na hydratovaných clusterech, takže přizpůsobení knihovny přidává jen minimální režii a relace mohou být spuštěny přibližně za 5 sekund.

Poznámka:

Složka Prostředky poznámkového bloku a instalační příkazy vložené knihovny (například %pip install) jsou ruční přístupy pro jednotlivé relace. Nejsou ovlivněny publikováním prostředí a vždy se nainstalují během aktivní relace.

Startovací fondy ve vašem regionu jsou plně využívány: Ve výjimečných případech mohou být startovací fondy regionu dočasně vyčerpány kvůli vysokému provozu. Když k tomu dojde, Fabric spustí nový cluster tak, aby vyhovoval vašemu požadavku, což trvá přibližně 2 až 5 minut. Jakmile bude nový cluster dostupný, spustí se relace. Pokud máte také vlastní knihovny k instalaci, přidejte dalších 30 sekund až 5 minut potřebných pro přizpůsobení.

Pokročilé síťové funkce nebo funkce zabezpečení (privátní propojení nebo spravované virtuální sítě):: Pokud má váš pracovní prostor síťové funkce, jako jsou privátní propojení tenanta nebo spravované virtuální sítě, úvodní fondy se nepodporují. V této situaci musí Fabric vytvořit cluster na vyžádání, který přidá 2 až 5 minut do doby spuštění relace. Pokud máte také závislosti knihovny, může tento krok personalizace přidat dalších 30 sekund až 5 minut.

Tady je několik ukázkových scénářů, které ilustrují potenciální časy spuštění:

| Scénář | Typický čas spuštění |

|---|---|

| Výchozí nastavení, žádné knihovny | 5 – 10 sekund |

| Výchozí nastavení + závislosti knihovny | 5 – 10 sekund + 30 sekund – 5 min (pro nastavení knihovny) |

| Vysoký provoz v oblasti, žádné knihovny | 2 – 5 minut |

| Vysoký provoz + závislosti knihoven | 2 – 5 minut + 30 sekund – 5 min (pro knihovny) |

| Zabezpečení sítě (privátní propojení/ virtuální síť), žádné knihovny | 2 – 5 minut |

| Zabezpečení sítě + závislosti knihoven | 2 – 5 minut + 30 sekund – 5 min (pro knihovny) |

Pokud jde o fakturaci a spotřebu kapacity, účtuje se vám spotřeba kapacity při spuštění poznámkového bloku nebo definice úlohy Apache Spark. Za dobu nečinnosti clusterů ve fondu vám nejsou účtovány poplatky.

Pokud například odešlete úlohu poznámkového bloku do počátečního fondu, účtuje se vám jenom časové období, ve kterém je relace poznámkového bloku aktivní. Fakturovaný čas nezahrnuje dobu nečinnosti ani čas potřebný k přizpůsobení relace kontextem Sparku. Další informace najdete v tématu Konfigurace počátečních fondů ve službě Fabric.

Fondy úloh Sparku

Fond Sparku je způsob, jak sparku sdělit, jaký druh prostředků potřebujete pro úlohy analýzy dat. Můžete pojmenovat pool Sparku a zvolit, kolik uzlů a jak velké tyto uzly (počítače, které dělají práci) mají být. Sparku také můžete říct, jak upravit počet uzlů v závislosti na tom, kolik práce máte. Vytvoření fondu Sparku je zdarma; platíte jenom v případě, že ve fondu spustíte úlohu Sparku a pak Spark nastaví uzly za vás.

Pokud fond Spark nepoužíváte 2 minuty po vypršení platnosti relace, váš fond Spark bude deallocován. Toto výchozí časové období vypršení platnosti relace je nastavené na 20 minut a pokud chcete, můžete ho změnit. Pokud jste správcem pracovního prostoru, můžete také vytvořit vlastní fondy Sparku pro váš pracovní prostor a nastavit je jako výchozí pro ostatní uživatele. Díky tomu můžete ušetřit čas a vyhnout se nastavení nového fondu Spark při každém spuštění poznámkového bloku nebo úlohy Sparku. Spuštění vlastních fondů Sparku trvá přibližně tři minuty, protože Spark musí získat uzly z Azure. Výjimkou je použití vlastního fondu Sparku nakonfigurovaného jako vlastní živý fond s prostředím v režimu 'Full'; v takovém případě mohou relace začínat přibližně za 5 sekund, protože váš snímek knihovny už byl začleněn do clusteru.

Můžete dokonce vytvořit fondy Spark s jedním uzlem nastavením minimálního počtu uzlů na jeden, takže ovladač a executor běží v jednom uzlu, který je součástí prostředí s obnovitelnou vysokou dostupností a je přizpůsobený pro malé úlohy.

Velikost a počet uzlů, které můžete mít ve vlastním fondu Sparku, závisí na vaší kapacitě Microsoft Fabric. Kapacita je míra výpočetního výkonu, který můžete použít. Jedním ze způsobů, jak si to představit, je, že dvě virtuální jádra Apache Sparku (jednotka výpočetních prostředků Sparku) se rovná jedné kapacitní jednotce.

Poznámka:

V Apache Sparku uživatelé získají dvě virtuální jádra Apache Sparku pro každou jednotku kapacity, kterou si rezervují jako součást své skladové položky. Jedna jednotka kapacity = dvě virtuální jádra Sparku. Například F64 dává 128 virtuálních jader Sparku a násobitel 3x burst zvyšuje tuto hodnotu na 384 virtuálních jader Sparku.

Skladová položka kapacity Fabric F64 má například 64 jednotek kapacity, což odpovídá 384 virtuálním jádrům Sparku (64 × 2 × 3X Burst Multiplier). Pomocí těchto virtuálních jader Sparku můžete vytvořit uzly různých velikostí pro vlastní fond Sparku, pokud celkový počet virtuálních jader Sparku nepřekračuje 384.

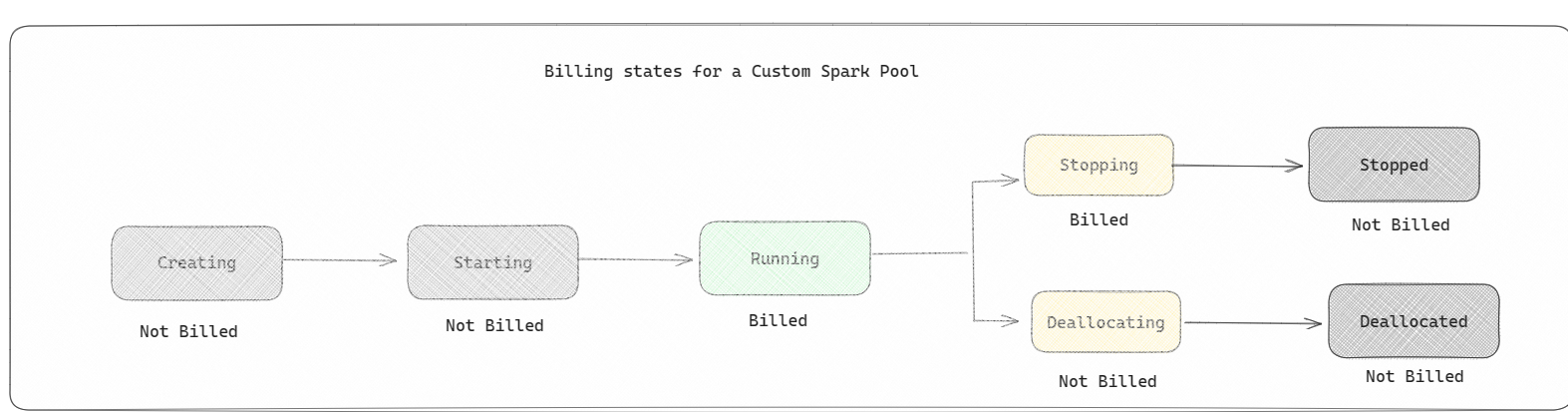

Fondy Sparku se účtují jako počáteční fondy; Za vlastní fondy Sparku, které jste vytvořili, neplatíte, pokud nemáte vytvořenou aktivní relaci Sparku pro spuštění poznámkového bloku nebo definice úlohy Sparku. Účtujeme vám pouze dobu skutečného běhu úlohy. Po dokončení úlohy vám nebudou účtovány činnosti, jako je vytvoření a uvolnění clusteru.

Pokud například odešlete úlohu poznámkového bloku do vlastního fondu Sparku, bude se vám účtovat jenom časové období, kdy je relace aktivní. Fakturace za danou relaci poznámkového bloku se zastaví, jakmile se relace Spark zastaví nebo vyprší její platnost. Za dobu potřebnou k získání instancí clusteru z cloudu ani za dobu potřebnou k inicializaci kontextu Sparku se vám neúčtují poplatky.

Možné vlastní konfigurace fondu pro F64 na základě předchozího příkladu. Menší velikosti uzlů mají kapacitu rozloženou mezi více uzlů, takže maximální počet uzlů je vyšší. Vzhledem k tomu, že větší uzly jsou bohaté na prostředky, takže je potřeba méně uzlů:

| Skladová položka kapacity fabricu | Jednotky kapacity | Maximální Spark VCores s faktorem burstu | Velikost uzlu | Maximální počet uzlů |

|---|---|---|---|---|

| F64 | 64 | 384 | Malý | 96 |

| F64 | 64 | 384 | Střední | 48 |

| F64 | 64 | 384 | Velká | dvacet čtyři |

| F64 | 64 | 384 | X -Large | 12 |

| F64 | 64 | 384 | XX-Large | 6 |

Poznámka:

Pokud chcete vytvořit vlastní fondy, potřebujete oprávnění Správce pro pracovní prostor. Správce kapacity Microsoft Fabric musí také udělit oprávnění, která správcům pracovního prostoru umožní konfigurovat velikost vlastních Spark fondů. Další informace najdete v tématu Začínáme s vlastními fondy Sparku v prostředí Fabric.

Uzly

Instance fondu Apache Spark se skládá z jednoho hlavního uzlu a jednoho nebo více pracovních uzlů. Instance Sparku může začínat minimálně jedním uzlem. Hlavní uzel spouští služby pro správu, jako jsou Livy, YARN Resource Manager, ZooKeeper a ovladač Apache Spark. Všechny uzly spouští služby, jako je agent node a YARN Node Manager. Všechny pracovní uzly spouští službu Apache Spark Executor.

Poznámka:

Ve Fabricu je poměr uzlů k exekutorům vždy 1:1. Při nastavování fondu je jeden uzel vyhrazen pro ovladač a zbývající uzly se používají pro exekutory. Jedinou výjimkou je konfigurace s jedním uzlem, kde jsou prostředky pro ovladač i exekutor halvovány.

Velikosti uzlů

Fond Sparku je možné definovat s velikostmi uzlů v rozsahu od malého výpočetního uzlu (se 4 virtuálními jádry a 32 GB paměti) až po dvojitý velký výpočetní uzel (s 64 virtuálními jádry a 512 GB paměti na uzel). Velikosti uzlů je možné po vytvoření fondu změnit, i když by se aktivní relace musela restartovat.

| Velikost | virtuální jádro | Memory (Paměť) |

|---|---|---|

| Malý | 4 | 32 GB |

| Střední | 8 | 64 GB |

| Velká | 16 | 128 GB |

| X -Large | 32 | 256 GB |

| XX-Large | 64 | 512 GB |

Poznámka:

Velikosti uzlů X-Large a XX-Large jsou povoleny pouze pro nezkušební Fabric SKU.

Automatické škálování

Automatické škálování fondů Apache Spark umožňuje automatické vertikální navýšení a snížení kapacity výpočetních prostředků na základě množství aktivity. Když povolíte funkci automatického škálování, nastavíte minimální a maximální počet uzlů, které se mají škálovat. Když funkci automatického škálování zakážete, počet nastavených uzlů zůstane pevný. Toto nastavení můžete po vytvoření fondu změnit, i když možná budete muset instanci restartovat.

Poznámka:

Ve výchozím nastavení je spark.yarn.executor.decommission.enabled nastaven na hodnotu true a umožňuje automatické vypnutí nevyužitých uzlů za účelem optimalizace efektivity výpočetních prostředků. Pokud je upřednostňované méně agresivní vertikální snížení kapacity, může být tato konfigurace nastavená na false.

Dynamické přidělování

Dynamické přidělování umožňuje aplikaci Apache Spark požadovat více exekutorů, pokud úlohy překračují zatížení, které můžou aktuální exekutory nést. Po dokončení úloh také uvolní exekutory a pokud se aplikace Spark přesune do stavu nečinnosti. Podnikoví uživatelé často obtížně ladí konfigurace exekutoru, protože se výrazně liší v různých fázích procesu provádění úloh Sparku. Tyto konfigurace jsou také závislé na objemu zpracovaných dat, které se mění od času do času. Jako součást konfigurace fondu můžete povolit dynamické přidělování exekutorů, což umožňuje automatické přidělování exekutorů do aplikace Spark na základě uzlů dostupných ve fondu Spark.

Když povolíte možnost dynamického přidělování pro každou odeslanou aplikaci Spark, systém si během kroku odeslání úlohy rezervuje exekutory na základě minimálních uzlů. Zadáte maximální počet uzlů pro podporu úspěšných scénářů automatického škálování.