Übersicht über Azure KI Video Indexer

Azure KI Video Indexer ist eine Cloud-Anwendung, die Teil der Azure KI Services ist und auf Azure KI Services (wie Gesichtserkennung, Übersetzer, Azure KI Vision und Speech) aufbaut. Sie ermöglicht Ihnen, mithilfe der Video- und Audiomodelle von Azure KI Video Indexer Erkenntnisse aus Ihren Videos zu gewinnen.

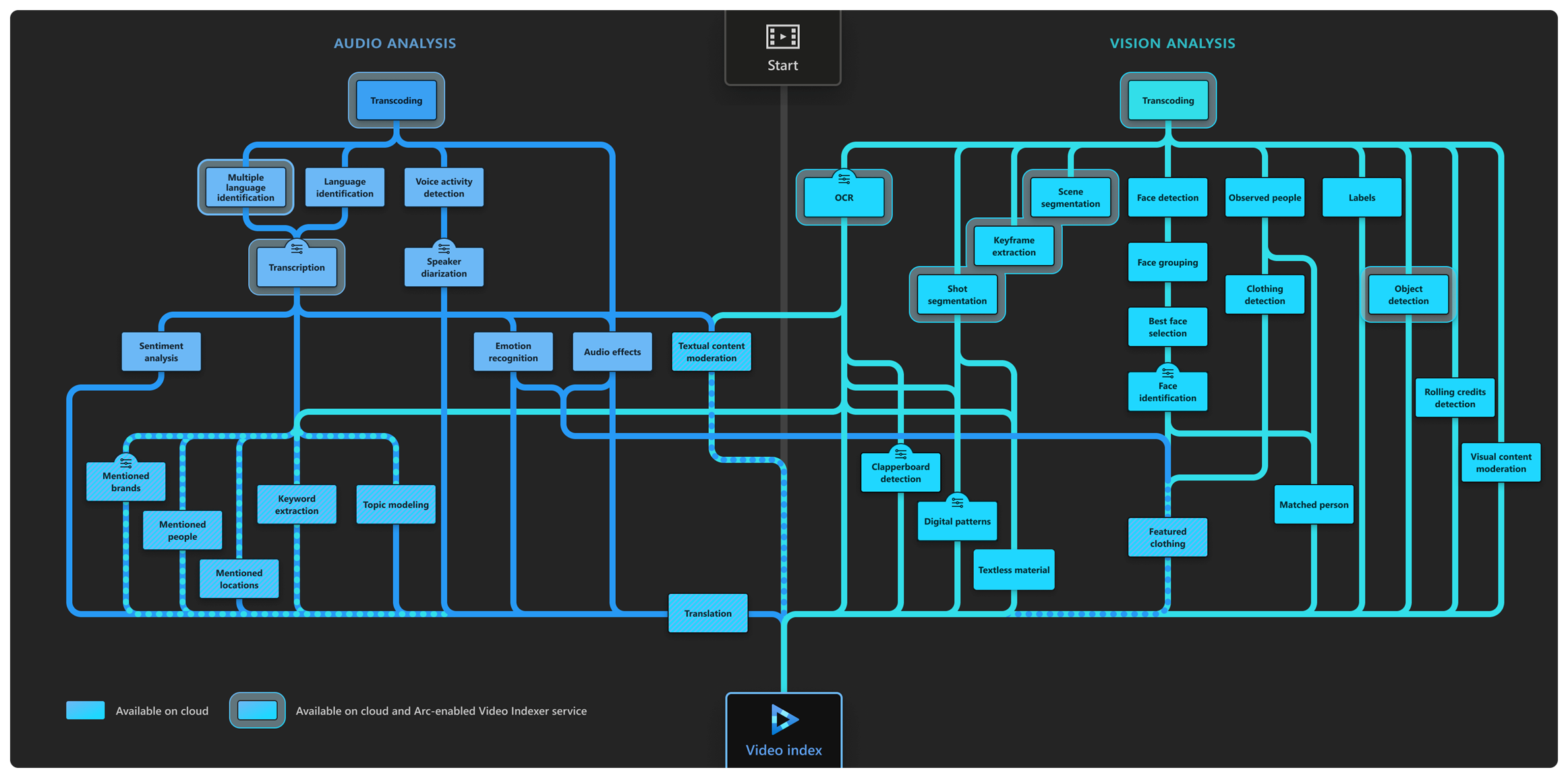

Azure KI Video Indexer analysiert die Video- und Audioinhalte, indem über 30 KI-Modelle ausgeführt und umfassende Einblicke generiert werden. Hier sehen Sie eine Abbildung der Audio- und Videoanalyse, die von Azure KI Video Indexer im Hintergrund ausgeführt wird:

Informationen zum Extrahieren von Erkenntnissen mit Azure KI Video Indexer finden Sie im Abschnitt zu den ersten Schritten.

Welche Möglichkeiten bietet Azure KI Video Indexer?

Die Einblicke von Azure AI Video Indexer können auf viele Szenarien angewendet werden:

- Intensivsuche: Verwenden Sie die aus dem Video extrahierten Erkenntnisse, um die Suchfunktion für eine Videobibliothek zu verbessern. Beispielsweise kann die Indizierung von gesprochenem Text und Gesichtern die Suche nach Stellen in einem Video ermöglichen, in denen eine Person bestimmte Wörter benutzt hat oder zwei Personen zusammen gezeigt werden. Die Suche auf Grundlage solcher Erkenntnisse ist für Nachrichtenagenturen, Bildungseinrichtungen, Rundfunkanstalten, Besitzer von Unterhaltungsinhalten, Branchenanwendungen und im Allgemeinen für alle Branchen von Nutzen, die über eine Videobibliothek verfügen, in der Benutzer eine Suche durchführen müssen.

- Inhaltserstellung: Erstellen Sie Trailer, Highlightkompilationen, Inhalte von sozialen Medien oder Nachrichtenclips basierend auf den Erkenntnissen, die Azure KI Video Indexer aus Ihren Inhalten extrahiert. Keyframes, Szenenmarkierungen und Zeitstempel der Personen- und Bezeichnungsdarstellungen gestalten den Erstellungsprozess viel reibungsloser und einfacher und ermöglichen es Ihnen, problemlos zu den Teilen des Videos zu gelangen, die Sie zum Erstellen von Inhalten benötigen.

- Barrierefreiheit: Unabhängig davon, ob Sie Ihre Inhalte für Menschen mit Behinderungen zur Verfügung stellen möchten oder ob Sie wünschen, dass Ihre Inhalte in verschiedenen Regionen mit verschiedenen Sprachen verteilt werden, können Sie die Transkription und Übersetzung nutzen, die von Azure KI Video Indexer in mehreren Sprachen bereitgestellt wird.

- Monetarisierung: Azure KI Video Indexer kann Sie dabei unterstützen, den kommerziellen Wert von Videos zu steigern. Beispielsweise können Unternehmen aus Branchen, die auf Werbeeinnahmen angewiesen sind (Nachrichtenmedien, soziale Medien usw.) wirkungsvolle Anzeigen schalten, indem sie die extrahierten Erkenntnisse als zusätzliche Signale für den Anzeigenserver nutzen.

- Inhaltsmoderation: Verwenden Sie textbasierte und visuelle Moderationsmodelle, um Ihre Benutzer vor unangemessenen Inhalten zu schützen und zu überprüfen, ob die von Ihnen veröffentlichten Inhalte den Werten Ihrer Organisation entsprechen. Sie können bestimmte Videos automatisch blockieren oder Ihre Benutzer vor dem Inhalt warnen.

- Empfehlungen: Die aus Videos gewonnenen Erkenntnisse können genutzt werden, um die Kundenbindung zu verbessern, indem für die Benutzer relevante Stellen in einem Video hervorgehoben werden. Indem Sie jedes Video mit zusätzlichen Metadaten kennzeichnen, können Sie den Benutzern die relevantesten Videos empfehlen und den Teil des Videos hervorheben, der ihren Anforderungen entspricht.

Features für Video-/Audio-KI

In der folgenden Liste sind die Erkenntnisse aufgeführt, die Sie aus Ihren Videos mithilfe der Video- und Audio-KI-Funktionen (Modelle) von Azure KI Video Indexer abrufen können.

Hinweis

Aufgrund von Datenschutz- und behördlichen Anforderungen verfügen einige dieser Features über eingeschränkte Nutzung und/oder erfordern die Vollständige Nutzung.

Sofern nicht anders angegeben, ist ein Modell allgemein verfügbar.

Videomodelle

Gesichtserkennung: erkennt und gruppiert im Video gezeigte Gesichter.

Prominentenerkennung: Video Indexer kann automatisch mehr als eine Million Prominente erkennen, etwa wichtige Politiker*innen, Schauspieler*innen, Künstler*innen, Sportler*innen, Forscher*innen und Führungskräfte aus dem Wirtschafts- und Technologiebereich von überall auf der Welt. Die Daten zu diesen Prominenten sind auch auf verschiedenen Websites (IMDB, Wikipedia usw.) zu finden.

Kontobasierte Gesichtsidentifikation: trainiert ein Modell für ein bestimmtes Konto. Gesichter im Video werden dann auf Grundlage des trainierten Modells erkannt. Weitere Informationen finden Sie unter Anpassen eines Personenmodells mit der Azure KI Video Indexer-Website und Anpassen eines Personenmodells mit der Azure KI Video Indexer-API.

Extraktion von Gesichtern als Miniaturbild: Identifiziert das am besten aufgenommene Gesicht in der jeweiligen Gruppe von Gesichtern (basierend auf Qualität, Größe und frontaler Position) und extrahiert es als Bildobjekt.

Optische Zeichenerkennung (OCR): Extrahiert Text aus Abbildungen wie Bildern, Straßenschildern und Produkten in Mediendateien, um Erkenntnisse zu gewinnen.

Moderation visueller Inhalte: erkennt nicht jugendfreie bzw. anzügliche visuelle Inhalte.

Identifikation von Beschriftungen: identifiziert angezeigte visuelle Objekte und Aktionen.

Szenensegmentierung: Bestimmt anhand visueller Hinweise, wann sich eine Szene im Video ändert. Eine Szene stellt ein einzelnes Ereignis dar und besteht aus einer Reihe von aufeinanderfolgenden Aufnahmen, die semantisch zusammenhängen.

Szenenwechselerkennung: Bestimmt anhand visueller Hinweise, wann ein Szenenwechsel im Video erfolgt. Eine Aufnahme (Szenenwechsel) umfasst ist eine Reihe von Bildern, die von derselben Filmkamera aufgenommen wurden. Weitere Informationen finden Sie unter Szenen, Aufnahmen und Keyframes.

Erkennung schwarzer Frames: erkennt schwarze Frames im Video.

Extraktion von Keyframes: erkennt stabile Keyframes in einem Video.

Durchlaufender Abspann: Identifiziert den Anfang und das Ende des durchlaufenden Abspanns am Ende von Fernsehsendungen und Filmen.

Erkennung von redaktionellen Aufnahmetypen: Tagging (Kategorisierung) von Aufnahmen auf der Grundlage ihres Typs (etwa Totale, Halbtotale, Nahaufnahme, extreme Nahaufnahme, zwei Personen, mehrere Personen, Außenaufnahme, Innenaufnahme usw.). Weitere Informationen finden Sie unter Erkennung von redaktionellen Aufnahmetypen.

Beobachtete Personenerkennung: Erkennt beobachtete Personen in Videos und liefert Informationen wie die Position der Person im Videoframe (mithilfe von umgebenden Feldern) und den genauen Zeitstempel (Start, Ende) und Konfidenz, wenn eine Person angezeigt wird. Weitere Informationen finden Sie im Artikel zum Verfolgen beobachteter Personen in einem Video.

- Abgeglichene Person: Gleicht Personen ab, die im Video beobachtet wurden, mit den entsprechenden Gesichtern, die erkannt wurden. Die Übereinstimmung zwischen den beobachteten Personen und den Gesichtern enthält einen Zuverlässigkeitsgrad.

- Erkannte Kleidung: Erkennt die Kleidungsarten von Personen, die im Video erscheinen und liefert Informationen wie lange oder kurze Ärmel, lange oder kurze Hosen und Skirt oder Kleid. Die erkannte Bekleidung wird den Personen zugeordnet, die sie tragen, und der genaue Zeitstempel (Start, Ende) sowie ein Konfidenzgrad für die Erkennung stehen zur Verfügung.

- Empfohlene Kleidung: Aufgenommene Kleidungsbilder, die in einem Video angezeigt werden. Sie können Ihre gezielten Anzeigen verbessern, indem Sie die Erkenntnisse zur ausgewählten Kleidung verwenden. Informationen zur Rangbewertung der ausgewählten Kleidung und zum Abrufen der Erkenntnisse finden Sie unter ausgewählte Kleidung.

Die Objekterkennung erkennt eindeutige Objekte, die ebenfalls nachverfolgt werden, sodass sie, wenn sie zum Frame zurückkehren, erkannt werden. Siehe Azure AI Video Indexer-Objekterkennung

Slate-Erkennung: Identifiziert die folgenden Filmeinblicke nach der Produktion, wenn ein Video mithilfe der erweiterten Indizierungsoption indiziert wird:

- Clapperboard-Erkennung mit Metadatenextraktion.

- Erkennung digitaler Muster, einschließlich Farbbalken.

- Textlose Slate-Erkennung, einschließlich Szenenabgleich.

Einzelheiten finden Sie unter Slate-Erkennung.

Erkennung von Textlogos: Entspricht einem bestimmten vordefinierten Text mithilfe von Azure AI Video Indexer OCR. Wenn ein Benutzer beispielsweise ein Textlogo mit „Microsoft“ erstellt hat, werden unterschiedliche Darstellungen des Worts Microsoft als das Microsoft-Logo erkannt. Weitere Informationen finden Sie unter Erkennen eines Textlogos.

Audiomodelle

Audiotranskription: Wandelt Spracherkennung in über 50 Sprachen um und lässt Erweiterungen zu. Weitere Informationen finden Sie unter Azure KI Video Indexer – Sprachunterstützung.

Automatische Spracherkennung: Erkennt automatisch die vorherrschend gesprochene Sprache. Weitere Informationen finden Sie unter Azure KI Video Indexer – Sprachunterstützung. Falls die Sprache nicht zuverlässig identifiziert werden kann, geht Azure KI Video Indexer davon aus, dass die gesprochene Sprache Englisch ist.

Spracherkennung und Transkription für mehrere Sprachen: Erkennt die gesprochene Sprache in verschiedenen Segmenten anhand der Audiodaten. Die Funktion sendet jedes Segment der zu transkribierenden Mediendatei und kombiniert die Transkriptionen dann wieder zu einer einzigen Transkription. Weitere Informationen zur Transkription finden Sie unter Transkription

Untertitelung: erstellt Untertitel in drei Formaten: VTT, TTML und SRT.

Verarbeitung von zwei Kanälen: erkennt automatisch ein getrenntes Transkript und sorgt für eine Zusammenführung auf einer einzelnen Zeitachse.

Rauschunterdrückung: bereinigt (basierend auf Skype-Filtern) Telefonaudio oder verrauschte Aufnahmen.

Transkriptanpassung (CRIS): ermöglicht das Trainieren benutzerdefinierter Spracherkennungsmodelle zur Erstellung branchenspezifischer Transkripte. Weitere Informationen finden Sie unter Anpassen eines Sprachmodells.

Sprecheraufzählung: kann erkennen und zuordnen, welcher Sprecher wann was gesagt hat. In einer einzelnen Audiodatei können sechzehn Sprecher erkannt werden.

Sprecherstatistiken: bietet Statistiken zum Verhältnis zwischen Sprechern und ihrem Anteil an der Konversation.

Moderation von Textinhalten: erkennt im Transkript des Audios anstößigen Text.

Textbasierte Emotionserkennung: Emotionen wie Freude, Traurigkeit, Wut und Angst, die per Transkriptanalyse erkannt wurden.

Übersetzung: Erstellt Übersetzungen des Audiotranskripts in vielen verschiedenen Sprachen. Weitere Informationen finden Sie unter Azure KI Video Indexer – Sprachunterstützung.

Erkennung von Audioeffekten: Erkennt die folgenden Audioeffekte in den Nicht-Sprachsegmenten des Inhalts: Alarm oder Sirenen, Hunderinden, Massenreaktionen (Jubeln, Klatschen und Booing), Schuss oder Explosion, Lachen, Zerbrechen und Schweigen.

Die erkannten Akustikereignisse befinden sich in der Untertiteldatei. Die Datei kann von der Azure KI Video Indexer-Website heruntergeladen werden. Weitere Informationen finden Sie im Artikel zum Erkennen von Audioeffekten.

Hinweis

Die gesamten Ereignisse sind nur verfügbar, wenn in den Uploadvoreinstellungen beim Upload einer Datei die erweiterte Audioanalyse ausgewählt wird. Andernfalls wird nur Stille erkannt.

Audio- und Videomodelle (mehrere Kanäle)

Bei Indizierung nach einem Kanal steht ein Teilergebnis für die folgenden Modelle zur Verfügung.

- Extraktion von Schlüsselwörtern: extrahiert Stichwörter aus Sprache und sichtbarem Text.

- Extraktion benannter Entitäten: Extrahiert mithilfe der Verarbeitung natürlicher Sprache (Natural Language Processing, NLP) Marken, Standorte und Personen aus Sprache und visuellem Text.

- Themenerschließung: Diese extrahiert Themen basierend auf verschiedenen Schlüsselwörtern (d. h. die Schlüsselwörter „Börse“, „Wall Street“ erzeugen das Thema „Wirtschaft“). Das Modell verwendet drei verschiedene Ontologien (IPTC, Wikipedia und die Ontologie des hierarchischen Video Indexer-Themas). Das Modell verwendet Transkription (gesprochener Text), OCR-Inhalte (sichtbarer Text) und Prominente, die im Video mithilfe des Video Indexer-Gesichtserkennungsmodells erkannt werden.

- Artefakte: Extrahiert für jedes der Modelle eine umfangreiche Menge von Artefakten mit höherem Detailgrad.

- Standpunktanalyse: erkennt anhand von Sprache und sichtbarem Text positive, negative und neutrale Stimmungen.

Wie kann ich mich mit Azure KI Video Indexer vertraut machen?

Erfahren Sie, wie Sie erste Schritte mit Azure KI Video Indexer machen können.

Nachdem Sie sich eingerichtet haben, beginnen Sie mit der Verwendung von Insights, und schauen Sie sich weitere Anleitungen an.

Compliance, Datenschutz und Sicherheit

Hinweis

Am 11. Juni 2020 kündigte Microsoft an, dass keine Technologie zur Gesichtserkennung mehr an die Polizeibehörden in den USA verkauft wird, bis es eine strenge, auf den Menschenrechten basierende Regelung gibt. Daher dürfen Kunden keine Gesichtserkennungsfeatures oder in Azure KI Services enthaltenen Funktionen (wie Gesichtserkennung oder Video Indexer) verwenden, wenn es sich bei dem Kunden um eine Polizeibehörde in den USA handelt oder wenn der Kunde die Nutzung derartiger Dienste durch oder für eine Polizeibehörde zulässt.

Hinweis

Der Zugriff auf Funktionen zur Gesichtserkennung, Anpassung und Erkennung von Prominenten ist auf der Grundlage von Berechtigungs- und Nutzungskriterien beschränkt, um unsere Prinzipien der verantwortungsbewussten KI zu unterstützen. Funktionen zur Gesichtserkennung, Anpassung und Erkennung von Prominenten sind nur für von Microsoft verwaltete Kunden und Partner verfügbar. Verwenden Sie das Aufnahmeformular für die Gesichtserkennung, um sich für den Zugriff zu bewerben.

Sie müssen alle anwendbaren Gesetze in Ihrer Verwendung von Azure AI Video Indexer einhalten, und Sie dürfen azure AI Video Indexer oder einen Azure-Dienst nicht auf eine Weise verwenden, die gegen die Rechte anderer verstößt oder die anderen schädlich sein können.

Bevor Sie ein Video/Bild in Azure AI Video Indexer hochladen, müssen Sie über alle geeigneten und rechtlichen Rechte verfügen, um das Video/Bild zu verwenden, einschließlich, sofern gesetzlich vorgeschrieben, alle erforderlichen Zustimmungen von Einzelpersonen (sofern vorhanden) im Video/Bild für die Verwendung, Verarbeitung und Speicherung ihrer Daten in Azure AI Video Indexer und Azure. Je nach Rechtsprechung können besondere rechtliche Anforderungen für die Sammlung, Onlineverarbeitung und Speicherung bestimmter Datenkategorien, z. B. biometrische Daten, gelten. Bevor Sie Azure AI Video Indexer und Azure für die Verarbeitung und Speicherung von Daten verwenden, die speziellen gesetzlichen Anforderungen unterliegen, müssen Sie sicherstellen, dass Ihre Verwendung allen solchen gesetzlichen Anforderungen entspricht, die für Sie und Ihre beabsichtigte Verwendung gelten können.

Informationen zu Compliance, Datenschutz und Sicherheit in Azure KI Video Indexer finden Sie im Trust Center von Microsoft. Informationen zu den Datenschutzauflagen und zur Behandlung Ihrer Daten sowie Datenaufbewahrungsmethoden durch Microsoft, einschließlich Informationen zur Löschung Ihrer Daten, finden Sie in den Datenschutzbestimmungen, in den Lizenzbedingungen für Onlinedienste (Online Services Terms, OST) und im Nachtrag zur Datenverarbeitung (Data Processing Addendum, DPA) von Microsoft. Wenn Sie Azure KI Video Indexer nutzen, erklären Sie sich damit einverstanden, dass Sie OST, DPA und den Datenschutzbestimmungen unterliegen.