Guide pratique de configuration des filtres de contenu avec Azure OpenAI Service

Le système de filtrage de contenu intégré dans Azure OpenAI Service s’exécute en même temps que les modèles de base, notamment les modèles de génération d’image DALL-E. Il utilise un ensemble de modèles de classification multiclasse pour détecter quatre catégories de contenu dangereux (violence, haine, sexualité et automutilation) à quatre niveaux de gravité respectivement (sûr, faible, moyen et élevé) et des classificateurs binaires facultatifs pour détecter le risque de jailbreak, le texte existant et le code dans les référentiels publics. La configuration du filtrage du contenu par défaut est définie pour filtrer au niveau de gravité moyen pour les quatre catégories de contenu pour les invites et les achèvements. Par conséquent, le contenu détecté au niveau de gravité moyen ou élevé est filtré, tandis que le contenu détecté au niveau de gravité faible ou sûr n’est pas filtré par les filtres de contenu. En savoir plus sur les catégories de contenu, les niveaux de gravité et le comportement du système de filtrage de contenu ici. La détection des risques de jailbreak et les modèles de texte et de code protégés sont des modèles facultatifs et désactivés par défaut. Pour les modèles de texte et de code matériels de jailbreak et protégés, la fonctionnalité de configuration permet à tous les clients d’activer et de désactiver les modèles. Les modèles sont désactivés par défaut et peuvent être activés selon votre scénario. Certains modèles doivent être activés pour certains scénarios afin de conserver la couverture en vertu de l’Engagement de copyright du client.

Remarque

Tous les clients ont la possibilité de modifier les filtres de contenu et de configurer les seuils de gravité (bas, moyen, élevé). Une autorisation est requise pour désactiver partiellement ou totalement les filtres de contenu. Seuls les clients gérés peuvent demander un contrôle de filtrage de contenu complet via ce formulaire : Révision d’accès limité Azure OpenAI : filtres de contenu modifiés. Il n’est pas possible de devenir un client géré à l’heure actuelle.

Les filtres de contenu peuvent être configurés au niveau de la ressource. Une fois qu’une configuration est créée, elle peut être associée à un ou plusieurs déploiements. Pour plus d’informations sur le déploiement de modèle, consultez le guide de déploiement de ressources.

Prérequis

- Pour configurer les filtres de contenu, vous devez disposer d’une ressource Azure OpenAI et d’un déploiement de grands modèles de langage (LLM). Pour bien démarrer, suivez un guide de démarrage rapide.

Comprendre la configuration du filtre de contenu

Azure OpenAI Service intègre des paramètres de sécurité par défaut appliqués à tous les modèles, à l’exception d’Azure OpenAI Whisper. Ces configurations vous offrent une expérience responsable par défaut, notamment des modèles de filtrage de contenu, des listes de blocage, la transformation d’invites, desles modèles de filtrage de contenu, et bien d’autres encore. Apprenez-en plus à ce sujet ici.

Tous les clients peuvent également configurer des filtres de contenu et créer des stratégies de sécurité personnalisées adaptées aux exigences de leurs cas d’utilisation. La fonctionnalité de configurabilité permet aux clients d’ajuster les paramètres, séparément pour les prompts et les achèvements, afin de filtrer le contenu pour chaque catégorie de contenu à différents niveaux de gravité, comme décrit dans le tableau ci-dessous. Le contenu détecté au niveau de gravité « sûr » est étiqueté dans les annotations, mais n’est pas soumis à un filtrage et n’est pas configurable.

| Gravité filtrée | Configurable pour les invites | Configurable pour la saisie semi-automatique | Descriptions |

|---|---|---|---|

| Faible, moyen, élevé | Oui | Oui | Configuration de filtrage la plus stricte. Le contenu détecté aux niveaux de gravité bas, moyen et élevé est filtré. |

| Moyen, élevé | Oui | Oui | Le contenu détecté au niveau de gravité faible n’est pas filtré. Le contenu moyen et élevé est filtré. |

| Élevé | Oui | Oui | Le contenu détecté aux niveaux de gravité faible et moyen n'est pas filtré. Seul le contenu au niveau de gravité élevé est filtré. |

| Aucun filtre | En cas d’approbation1 | En cas d’approbation1 | Aucun contenu n’est filtré quel que soit le niveau de gravité détecté. Nécessite une approbation1. |

| Annoter seulement | En cas d’approbation1 | En cas d’approbation1 | Désactive la fonctionnalité de filtrage de sorte que le contenu n’est pas bloqué, mais les annotations sont retournées par la réponse de l’API. Nécessite une approbation1. |

1 Pour les modèles Azure OpenAI, seuls les clients qui ont été approuvés pour le filtrage de contenu modifié disposent d’un contrôle total du filtrage de contenu et peuvent désactiver les filtres de contenu. Demander des filtres de contenu modifiés via ce formulaire : Révision d’accès limité Azure OpenAI : filtres de contenu modifiés. Pour les clients Azure Government, appliquez des filtres de contenu modifiés via ce formulaire : Azure Government – Demander un filtrage de contenu modifié pour Azure OpenAI Service.

Les filtres de contenu configurables pour les entrées (prompts) et les sorties (complétions) sont disponibles pour les modèles Azure OpenAI suivants :

- Série de modèles GPT

- Disponibilité générale* GPT-4 Turbo Vision (

turbo-2024-04-09) - GPT-4o

- GPT-4o mini

- DALL-E 2 et 3

Les filtres de contenu configurables ne sont pas disponibles pour

- o1-preview

- o1-mini

*Disponible uniquement pour GPT-4 Turbo Vision GA, ne s’applique pas à la préversion de GPT-4 Turbo Vision

Les configurations de filtrage de contenu sont créées dans une ressource dans Azure AI Studio et peuvent être associées à des déploiements. Apprenez-en plus sur la configuration ici.

Les clients sont chargés de s’assurer que les applications intégrant Azure OpenAI sont conformes au Code de conduite.

Comprendre les autres filtres

En plus des catégories de filtres par défaut, vous pouvez configurer les catégories de filtres suivantes.

| Catégorie de filtre | État | Paramètre par défaut | Appliqué à l’invite ou à la saisie semi-automatique ? | Description |

|---|---|---|---|---|

| Boucliers contre les prompts utilisés pour les attaques directes (jailbreak) | GA | Activé | Invite utilisateur | Filtre/annote les prompts utilisateur susceptibles de présenter un risque de jailbreak. Pour plus d’informations sur les annotations, consultez Filtrage de contenu d’Azure OpenAI Service. |

| Boucliers contre les prompts utilisés pour les attaques indirectes | GA | Activé | Invite utilisateur | Filtre/annote les attaques indirectes, également appelées attaques par prompt indirectes ou attaques par injection de prompt inter-domaines, une vulnérabilité potentielle dans laquelle des tiers placent des instructions malveillantes à l’intérieur de documents auxquels le système d’IA générative peut accéder et traiter. Obligatoire : mise en forme du document . |

| Matériel protégé – code | GA | Activé | Completion | Filtre le code protégé ou obtient l’exemple de citation et les informations de licence dans les annotations pour les extraits de code qui correspondent à n’importe quelle source de code publique (avec GitHub Copilot). Pour plus d’informations sur l’utilisation des annotations, consultez le guide des concepts de filtrage de contenu |

| Matériel protégé – texte | GA | Activé | Completion | Identifie et bloque l’affichage de texte connu dans la sortie du modèle (par exemple, les paroles de chansons, les recettes et le contenu web sélectionné). |

Configurer des filtres de contenu via Azure OpenAI Studio

Les étapes suivantes montrent comment configurer une configuration de filtrage de contenu personnalisée pour votre ressource.

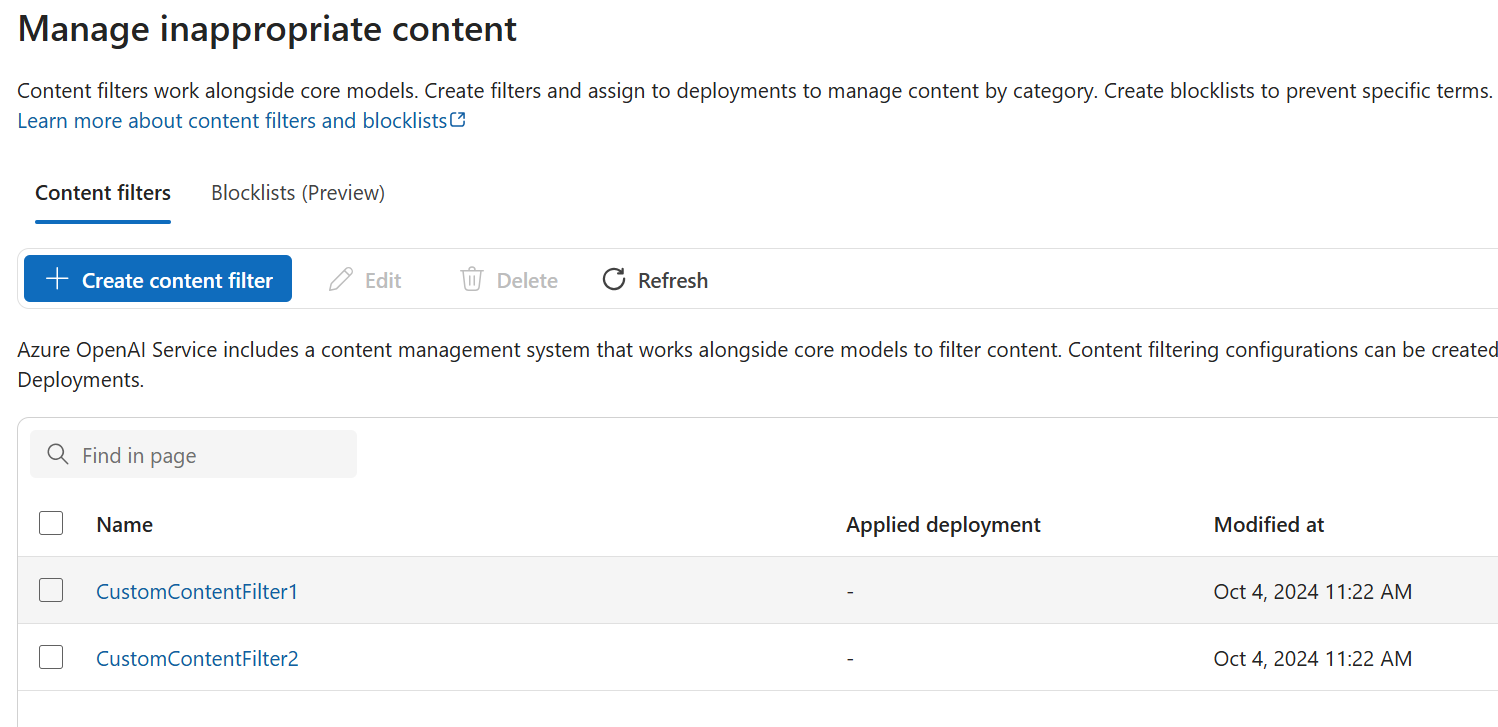

Accédez à Azure OpenAI Studio et accédez à l’onglet Filtres de contenu (dans le volet de navigation inférieur gauche, comme indiqué par la zone rouge ci-dessous).

Créez une configuration de filtrage de contenu personnalisée.

Cela conduit à la vue de configuration suivante, où vous pouvez choisir un nom pour la configuration de filtrage de contenu personnalisé. Après avoir entré un nom, vous pouvez configurer les filtres d’entrée (invites utilisateur) et les filtres de sortie (réponse du modèle). Pour les quatre premières catégories de contenu, il existe trois niveaux de gravité configurables : faible, moyen et élevé. Vous pouvez utiliser les curseurs pour définir le seuil de gravité si vous déterminez que votre application ou votre scénario d’utilisation nécessite un filtrage différent des valeurs par défaut. Certains filtres vous permettent de déterminer si le modèle doit annoter et/ou bloquer. Sélectionner Annoter exécute le modèle respectif et retourne des annotations via la réponse de l’API, mais cette action ne filtre pas le contenu. En plus des annotations, vous pouvez également choisir de filtrer le contenu en activant l’option Filtrer.

Si votre cas d’usage a été approuvé pour les filtres de contenu modifiés comme indiqué ci-dessus, vous recevez un contrôle total sur les configurations de filtrage de contenu et pouvez choisir de désactiver partiellement ou entièrement le filtrage.

Vous pouvez créer plusieurs configurations de filtrage de contenu en fonction de vos besoins.

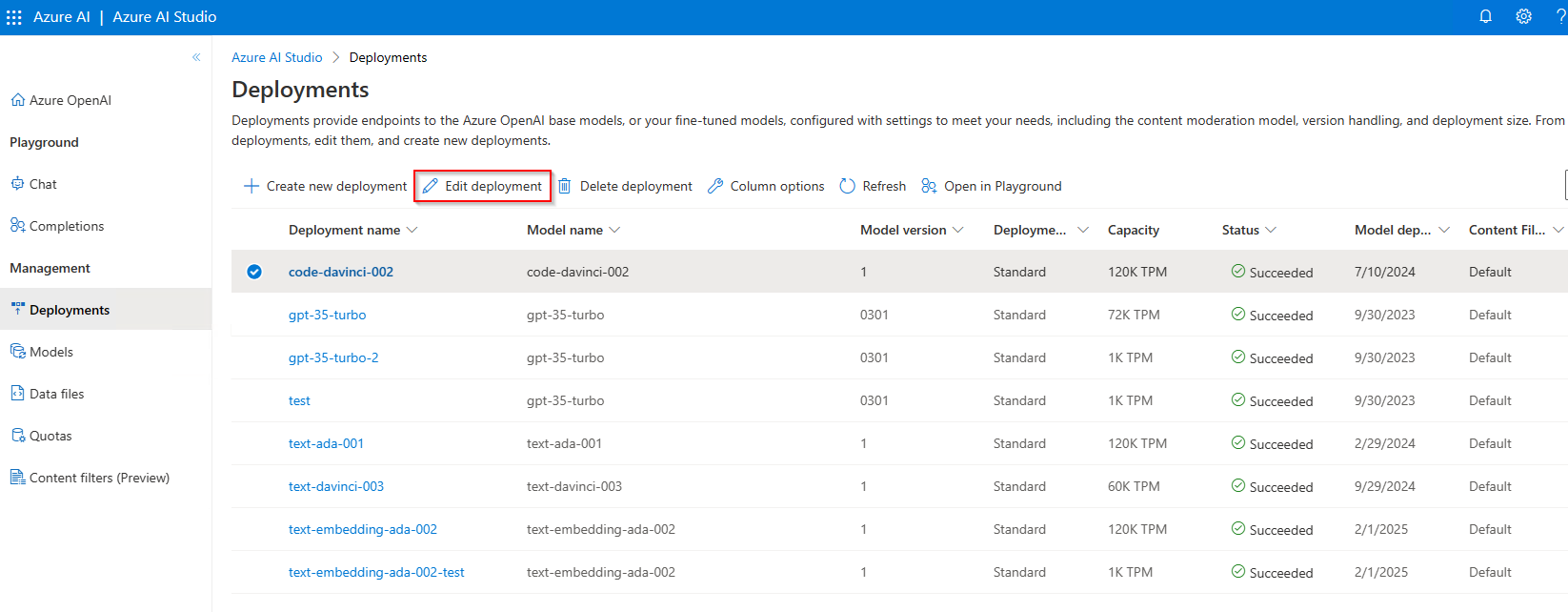

Ensuite, pour rendre une configuration de filtrage de contenu personnalisée opérationnelle, affectez une configuration à un ou plusieurs déploiements dans votre ressource. Pour ce faire, accédez à l’onglet Déploiements et sélectionnez votre déploiement. Sélectionnez ensuite Modifier.

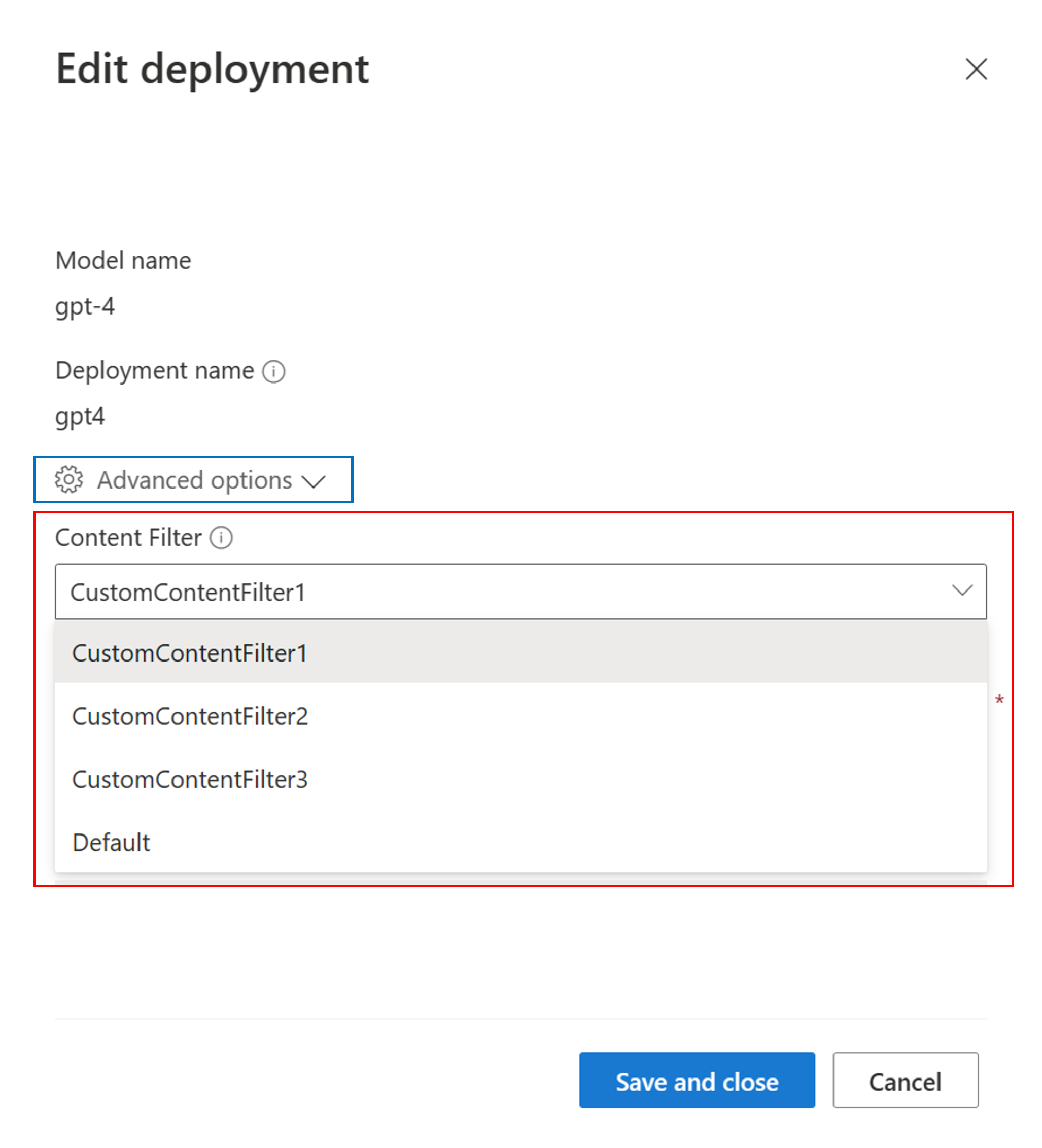

Dans la fenêtre Mettre à jour le déploiement qui s’affiche, sélectionnez votre filtre personnalisé dans le menu déroulant Filtre de contenu. Ensuite, sélectionnez Enregistrer et fermer pour appliquer la configuration sélectionnée au déploiement.

Vous pouvez également modifier et supprimer une configuration de filtre de contenu si nécessaire. Pour ce faire, accédez à l’onglet Filtres de contenu et sélectionnez une configuration. Ensuite, sélectionnez l’action souhaitée. Vous ne pouvez modifier qu’une seule configuration de filtrage à la fois.

Notes

Avant de supprimer une configuration de filtrage de contenu, vous devez la désaffecter de tout déploiement sous l’onglet Déploiements.

Suivre les bonnes pratiques

Nous vous recommandons de prendre vos décisions de configuration de filtrage de contenu sur la base d’une identification itérative (par exemple, des tests d’équipe rouge, des tests de contrainte et l’analyse) et d’un processus de mesure pour résoudre les dommages potentiels pertinents pour un modèle, une application et un scénario de déploiement spécifiques. Après avoir implémenté des atténuations telles que le filtrage de contenu, répétez la mesure pour tester l’efficacité. Vous trouverez des recommandations et des meilleures pratiques pour l’IA responsable pour Azure OpenAI, qui sont ancrées dans la norme d’IA responsable de Microsoft dans Vue d’ensemble de l’IA responsable pour Azure OpenAI.

Contenu connexe

- En savoir plus sur les pratiques d’IA responsable pour Azure OpenAI : Vue d’ensemble des pratiques d’IA responsable pour les modèles Azure OpenAI.

- En savoir plus sur les catégories de filtrage de contenu et les niveaux de gravité avec Azure OpenAI Service.

- Pour en savoir plus sur le « red teaming », consultez notre article Introduction aux modèles LLM (Large Language Models) Red Teaming.