Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

Microsoft Foundry Models adalah pusat terpadu Anda untuk menemukan, mengevaluasi, dan menerapkan model AI yang kuat—baik Anda membangun kopilot kustom, membangun agen, meningkatkan aplikasi yang ada, atau menjelajahi kemampuan AI baru.

Dengan Model Foundry, Anda dapat:

- Jelajahi katalog model canggih yang kaya dari Microsoft, OpenAI, DeepSeek, Hugging Face, Meta, dan banyak lagi.

- Bandingkan dan evaluasi model secara berdampingan menggunakan tugas dunia nyata dan data Anda sendiri.

- Sebarkan dengan percaya diri, berkat alat yang terintegrasi untuk penyempurnaan, pemantauan, dan kecerdasan buatan yang bertanggung jawab.

- Pilih jalur Anda—bawa model Anda sendiri, gunakan model yang dihosting, atau integrasikan dengan mulus dengan layanan Azure.

- Baik Anda seorang pengembang, ilmuwan data, atau arsitek perusahaan, Foundry Models memberi Anda fleksibilitas dan kontrol untuk membangun solusi AI yang menskalakan—dengan aman, bertanggung jawab, dan cepat.

Foundry menawarkan katalog model AI yang komprehensif. Ada lebih dari 1900+ model mulai dari Model Dasar, Model Penalaran, Model Bahasa Kecil, Model Multimodal, Model Khusus Domain, Model Industri, dan banyak lagi.

Katalog kami diatur ke dalam dua kategori utama:

Memahami perbedaan antara kategori ini membantu Anda memilih model yang tepat berdasarkan persyaratan spesifik dan tujuan strategis Anda.

Model yang Dijual Langsung oleh Azure

Ini adalah model yang dihosting dan dijual oleh Microsoft di bawah Ketentuan Produk Microsoft. Model-model ini telah menjalani evaluasi ketat dan diintegrasikan secara mendalam ke dalam ekosistem AI Azure. Model ini berasal dari berbagai penyedia teratas dan menawarkan integrasi yang ditingkatkan, performa yang dioptimalkan, dan dukungan Microsoft langsung, termasuk Perjanjian Tingkat Layanan (SLA) tingkat perusahaan.

Karakteristik model langsung ini:

- Dukungan pihak pertama resmi dari Microsoft

- Integrasi tingkat tinggi dengan layanan dan infrastruktur Azure

- Tolok ukur dan validasi performa yang luas

- Kepatuhan terhadap standar AI Yang Bertanggung Jawab Microsoft

- Skalabilitas, keandalan, dan keamanan tingkat perusahaan

Model-Model ini juga memiliki keuntungan dari Throughput yang Dianggarkan yang fleksibel, yang berarti Anda bisa fleksibel dalam menggunakan kuota dan reservasi Anda untuk setiap model ini.

Model dari Mitra dan Komunitas

Model-model ini merupakan sebagian besar Model Foundry. Model-model ini disediakan oleh organisasi pihak ketiga tepercaya, mitra, laboratorium penelitian, dan kontributor komunitas. Model-model ini menawarkan kemampuan AI khusus dan beragam, mencakup berbagai skenario, industri, dan inovasi.

Karakteristik Model dari Mitra dan Komunitas:

- Dikembangkan dan didukung oleh mitra eksternal dan kontributor komunitas

- Beragam model khusus yang melayani ceruk atau kasus penggunaan luas

- Biasanya divalidasi oleh penyedia itu sendiri, dengan panduan integrasi yang disediakan oleh Azure

- Inovasi berbasis komunitas dan ketersediaan model mutakhir yang cepat

- Integrasi Azure AI standar, dengan dukungan dan pemeliharaan yang dikelola oleh masing-masing penyedia

Model dapat diterapkan dalam opsi Komputasi Terkelola atau Standar (bayar sesuai pemakaian). Penyedia model memilih bagaimana model dapat disebarkan.

Memilih Antara model langsung dan model mitra & komunitas

Saat memilih model dari Model Foundry, pertimbangkan hal berikut:

- Kasus penggunaan dan Persyaratan: Model yang dijual langsung oleh Azure sangat ideal untuk skenario yang memerlukan integrasi Azure mendalam, dukungan terjamin, dan SLA perusahaan. Model Ekosistem Azure unggul dalam kasus penggunaan khusus dan skenario yang dipimpin inovasi.

- Harapan Dukungan: Model yang dijual langsung oleh Azure dilengkapi dengan dukungan dan pemeliharaan yang disediakan Microsoft yang kuat. Model ini didukung oleh penyedianya, dengan berbagai tingkat SLA dan struktur dukungan.

- Inovasi dan Spesialisasi: Model dari Mitra dan Komunitas menawarkan akses cepat ke inovasi khusus dan kemampuan ceruk yang sering dikembangkan oleh laboratorium penelitian terkemuka dan penyedia AI yang muncul.

Koleksi model

Katalog model mengatur model ke dalam koleksi yang berbeda:

Model Azure OpenAI tersedia secara eksklusif di Azure: Model Flagship Azure OpenAI tersedia melalui integrasi dengan Azure OpenAI di Foundry Models. Microsoft mendukung model ini dan penggunaannya sesuai dengan ketentuan produk dan SLA untuk Azure OpenAI di Model Foundry.

Buka model dari hub Hugging Face: Ratusan model dari hub Hugging Face untuk inferensi real time dengan komputasi terkelola. Hugging Face membuat dan memelihara model yang tercantum dalam koleksi ini. Untuk bantuan, gunakan forum Hugging Face atau dukungan Hugging Face. Pelajari selengkapnya di Menyebarkan model terbuka dengan Foundry.

Anda dapat mengirimkan permintaan untuk menambahkan model ke katalog model dengan menggunakan formulir ini.

Gambaran umum kemampuan Katalog Model

Katalog model di portal Foundry adalah hub untuk menemukan dan menggunakan berbagai model untuk membangun aplikasi AI generatif. Katalog model ini menampilkan ratusan model di seluruh penyedia model seperti Azure OpenAI, Mistral, Meta, Cohere, NVIDIA, dan Hugging Face, termasuk model yang dilatih Microsoft. Model dari penyedia lain tha Microsoft adalah Produk Non-Microsoft seperti yang didefinisikan dalam Ketentuan Produk Microsoft dan tunduk pada persyaratan yang disediakan dengan model.

Anda dapat mencari dan menemukan model yang memenuhi kebutuhan Anda melalui pencarian dan filter kata kunci. Katalog model juga menawarkan papan peringkat performa model dan metrik tolok ukur untuk model tertentu. Anda dapat mengaksesnya dengan memilih Telusuri papan peringkat dan Bandingkan Model. Data patokan juga dapat diakses dari tab Tolok Ukur Model Kartu.

Pada filter katalog model, Anda akan menemukan:

- Koleksi: Anda dapat memfilter model berdasarkan koleksi penyedia model.

- Industri: Anda dapat memfilter model yang dilatih pada himpunan data khusus industri.

- Kemampuan: Anda dapat memfilter fitur model unik seperti penalaran dan panggilan alat.

- Opsi penyebaran: Anda dapat memfilter model yang mendukung opsi penyebaran tertentu.

- Standar: opsi ini memungkinkan Anda membayar per panggilan API.

- Disediakan: paling cocok untuk penilaian real-time untuk volume besar yang konsisten.

- Batch: paling cocok untuk pekerjaan berkala yang dioptimalkan untuk biaya, dan bukan untuk latensi. Tidak ada dukungan taman bermain yang disediakan untuk penyebaran batch.

- Komputasi terkelola: opsi ini memungkinkan Anda untuk menyebarkan model pada komputer virtual Azure. Anda akan dikenakan biaya untuk hosting dan proses inferensi.

- Tugas inferensi: Anda dapat memfilter model berdasarkan jenis tugas inferensi.

- Menyempurnakan tugas: Anda dapat memfilter model berdasarkan jenis tugas penyempurnaan.

- Lisensi: Anda dapat memfilter model berdasarkan jenis lisensi.

Pada kartu model, Anda akan menemukan:

- Fakta cepat: Anda akan melihat informasi utama tentang model sekilas.

- Detail: halaman ini berisi informasi terperinci tentang model, termasuk deskripsi, info versi, jenis data yang didukung, dll.

- Tolok ukur: Anda akan menemukan metrik tolok ukur performa untuk model tertentu.

- Penyebaran yang ada: jika Anda telah menyebarkan model, Anda dapat menemukannya dalam tab Penyebaran yang ada.

- Lisensi: Anda akan menemukan informasi hukum yang terkait dengan lisensi model.

- Artefak: tab ini hanya akan ditampilkan untuk model terbuka. Anda dapat melihat aset model dan mengunduhnya melalui antarmuka pengguna.

Penyebaran model: Komputasi terkelola dan penyebaran standar

Selain model Azure OpenAI, katalog model menawarkan dua cara berbeda untuk menyebarkan model untuk penggunaan Anda: komputasi terkelola dan penyebaran standar.

Opsi penyebaran dan fitur yang tersedia untuk setiap model bervariasi, seperti yang dijelaskan dalam tabel berikut. Pelajari selengkapnya tentang pemrosesan data dengan opsi penyebaran.

Kemampuan opsi penyebaran model

| Fitur | Pengolahan terkelola | Penyebaran standar |

|---|---|---|

| Pengalaman penyebaran dan penagihan | Bobot model disebarkan ke komputer virtual khusus dengan komputasi terkelola. Komputasi terkelola, yang dapat memiliki satu atau beberapa penyebaran, menyediakan REST API untuk inferensi. Anda ditagih untuk jam inti komputer virtual yang digunakan penyebaran. | Akses ke model dilakukan melalui penyebaran yang menyediakan API untuk mengakses model. API menyediakan akses ke model yang dihosting dan dikelola Microsoft, untuk inferensi. Anda ditagih untuk input dan output ke API, biasanya dalam token. Informasi harga disediakan sebelum Anda menggunakan. |

| Pengesahan API | Kunci dan autentikasi Microsoft Entra. | Hanya kunci. |

| Keamanan konten | Gunakan API layanan Azure AI Content Safety. | Filter Keamanan Konten Azure AI tersedia dan terintegrasi dengan API inferensi. Filter Keamanan Konten Azure AI ditagih secara terpisah. |

| Isolasi jaringan | Mengonfigurasi jaringan terkelola untuk hub Foundry. | Komputasi terkelola mengikuti pengaturan bendera akses jaringan publik (PNA) hub Anda. Untuk informasi selengkapnya, lihat bagian Isolasi jaringan untuk model yang disebarkan melalui penyebaran standar nanti di artikel ini. |

Model yang tersedia untuk opsi penyebaran yang didukung

Katalog Model menawarkan dua cara berbeda untuk menyebarkan model dari katalog untuk penggunaan Anda: komputasi terkelola dan penyebaran standar. Opsi penyebaran yang tersedia untuk setiap model bervariasi. Pelajari selengkapnya tentang fitur pilihan penyebaran, dan pilihan yang tersedia untuk model tertentu, dalam tabel di bawah. Pelajari selengkapnya tentang pemrosesan data dengan opsi penyebaran.

| Fitur | Pengolahan terkelola | Penyebaran standar |

|---|---|---|

| Pengalaman penyebaran dan penagihan | Bobot model ditempatkan ke Mesin Virtual khusus dengan titik akhir online yang terkelola. Endpoint online terkelola, yang dapat memiliki satu atau beberapa penyebaran, menyediakan API REST untuk inferensi. Anda ditagih untuk jam inti Mesin Virtual yang terpakai dalam penyebaran. | Akses ke model dilakukan melalui penyebaran yang menyediakan API untuk mengakses model. API menyediakan akses ke model yang di-host dalam kumpulan GPU pusat, yang dikelola oleh Microsoft, untuk inferensi. Mode akses ini disebut sebagai "Model sebagai Layanan". Anda ditagih untuk input dan output ke API, biasanya dalam bentuk token; informasi harga disediakan sebelum Anda mendeploi. |

| Pengesahan API | Autentikasi dengan Kunci dan Microsoft Entra ID. Pelajari lebih lanjut. | Hanya kunci. |

| Keamanan konten | Gunakan API layanan Keamanan Konten Azure. | Filter Keamanan Konten Azure AI tersedia dan terintegrasi dengan API inferensi. Filter Keamanan Konten Azure AI mungkin ditagih secara terpisah. |

| Isolasi jaringan | Virtual Network Terkelola dengan Titik Akhir Online. Pelajari lebih lanjut. |

Pengolahan terkelola

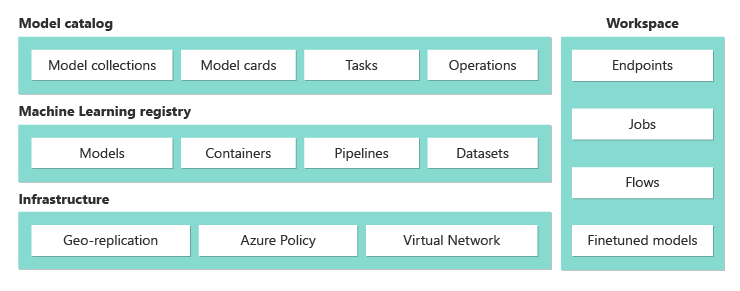

Kemampuan untuk menyebarkan model dengan komputasi terkelola dibangun pada kemampuan platform Azure Machine Learning untuk memungkinkan integrasi tanpa hambatan, di seluruh siklus hidup GenAIOps (kadang-kadang disebut LLMOps), dari berbagai koleksi model dalam katalog model.

Ketersediaan model untuk implementasi sebagai komputasi yang dikelola

Model tersedia melalui registri Azure Pembelajaran Mesin yang memungkinkan pendekatan berorientasi ML untuk menghosting dan mendistribusikan aset Pembelajaran Mesin seperti bobot model, runtime kontainer untuk menjalankan model, rangkaian proses untuk mengevaluasi dan menyempurnakan model, serta himpunan data untuk tolok ukur dan contoh. ML Registries ini dibangun di atas infrastruktur yang sangat dapat diskalakan dan siap untuk perusahaan yang:

Memberikan artifak model akses dengan latensi rendah ke semua wilayah Azure dengan replikasi geografis terintegrasi.

Mendukung persyaratan keamanan perusahaan sebagai membatasi akses ke model dengan Azure Policy dan mengamankan penyebaran dengan jaringan virtual terkelola.

Penyebaran model untuk inferensi dengan komputasi terkelola

Model yang tersedia untuk penyebaran dengan komputasi terkelola dapat disebarkan ke Azure Pembelajaran Mesin titik akhir online untuk inferensi real time atau dapat digunakan untuk inferensi batch Azure Pembelajaran Mesin untuk memproses data Anda secara batch. Menyebarkan ke komputasi terkelola mengharuskan Anda memiliki kuota Komputer Virtual di Langganan Azure Anda untuk SKU tertentu yang diperlukan untuk menjalankan model secara optimal. Beberapa model memungkinkan Anda menyebarkan kuota bersama sementara waktu untuk pengujian model. Pelajari selengkapnya tentang menyebarkan model:

- Menyebarkan model Meta Llama

- Menyebarkan model Terbuka yang Dibuat oleh Azure AI

- Menyebarkan model Hugging Face

Membangun aplikasi AI generatif dengan komputasi terkelola

Alur perintah menawarkan kemampuan untuk membuat prototipe, bereksperimen, melakukan iterasi, dan menyebarkan aplikasi AI Anda. Anda dapat menggunakan model yang diterapkan menggunakan komputasi yang dikelola di Prompt Flow dengan Open Model LLM tool. Anda juga dapat menggunakan REST API yang diekspos oleh komputasi terkelola di alat LLM populer seperti LangChain dengan ekstensi Azure Pembelajaran Mesin.

Keamanan konten untuk model yang disebarkan sebagai komputasi terkelola

Layanan Azure AI Content Safety (AACS) tersedia untuk digunakan dengan model yang disebarkan ke komputasi terkelola untuk menyaring berbagai kategori konten berbahaya seperti konten seksual, kekerasan, kebencian, dan ancaman merugikan diri sendiri dan ancaman tingkat lanjut seperti deteksi risiko Jailbreak dan deteksi teks materi yang dilindungi. Anda dapat merujuk ke notebook ini untuk integrasi referensi dengan AACS untuk Llama 2 atau menggunakan alat Content Safety (Text) di Prompt Flow untuk meneruskan respons dari model ke AACS untuk penyaringan. Anda akan ditagih secara terpisah sesuai harga AACS untuk penggunaan tersebut.

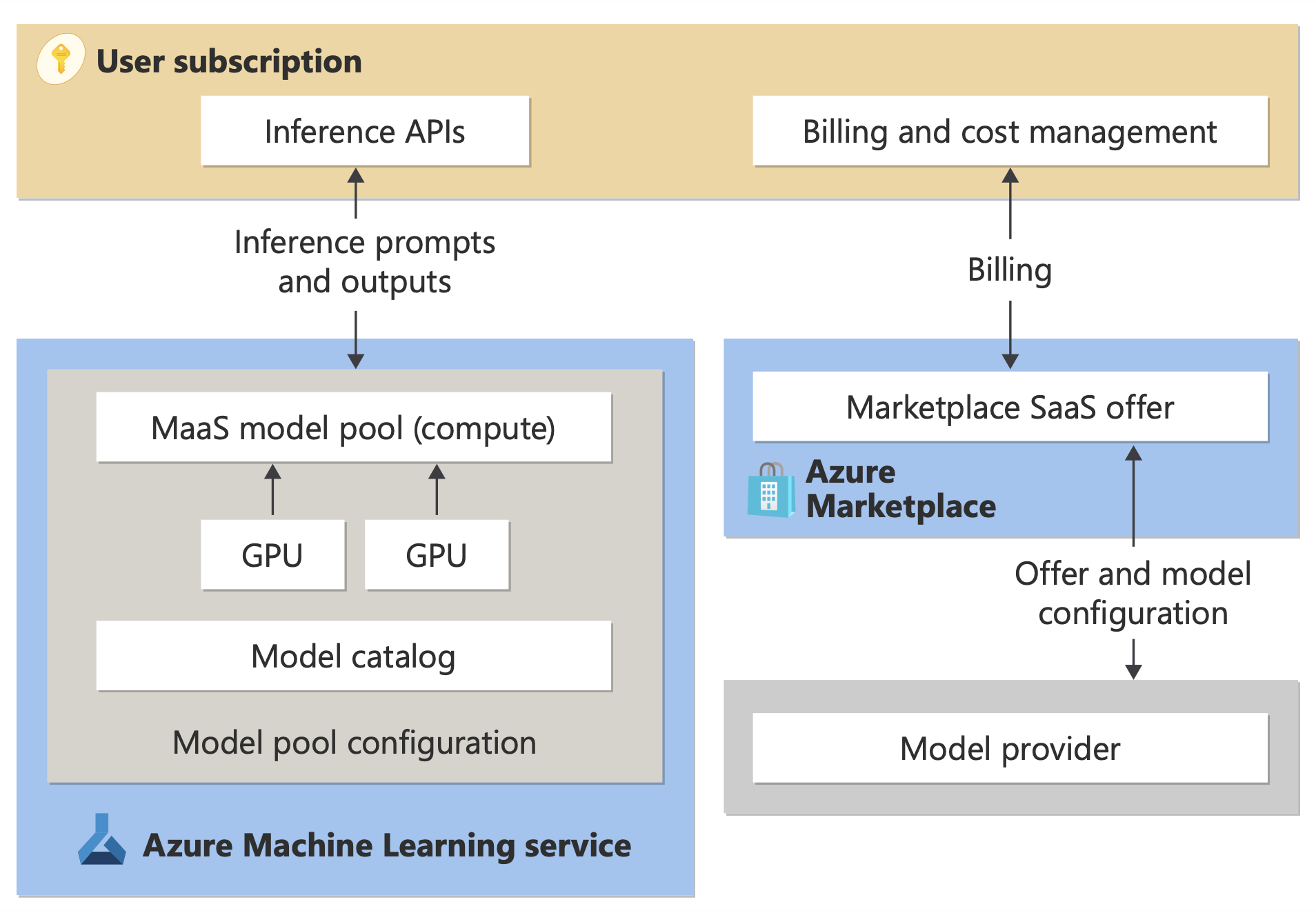

Penyebaran Standar dengan Penagihan Standar

Model tertentu dalam katalog model dapat disebarkan dengan cara standar menggunakan penagihan Standar; metode penyebaran ini dinamakan penyebaran Standar. Model yang tersedia melalui MaaS dihosting dalam infrastruktur yang dikelola oleh Microsoft, yang memungkinkan akses berbasis API ke model penyedia model. Akses berbasis API dapat secara dramatis mengurangi biaya akses model dan secara signifikan menyederhanakan pengalaman provisi. Sebagian besar model MaaS dilengkapi dengan harga berbasis token.

Bagaimana model pihak ketiga tersedia di MaaS?

Model yang tersedia untuk penyebaran sebagai penyebaran standar dengan penagihan Standar ditawarkan oleh penyedia model tetapi dihosting di infrastruktur Azure yang dikelola Microsoft dan diakses melalui API. Penyedia model menentukan persyaratan lisensi dan menetapkan harga untuk penggunaan model mereka, sementara layanan Azure Pembelajaran Mesin mengelola infrastruktur hosting, membuat API inferensi tersedia, dan bertindak sebagai pemroses data untuk permintaan yang dikirimkan dan output konten oleh model yang disebarkan melalui MaaS. Pelajari selengkapnya tentang pemrosesan data untuk MaaS di artikel privasi data.

Nota

Langganan Penyedia Solusi Cloud (CSP) tidak memiliki kemampuan untuk membeli model penyebaran standar.

Penagihan

Pengalaman penemuan, langganan, dan konsumsi untuk model yang disebarkan melalui MaaS ada di portal Foundry dan studio Azure Machine Learning. Pengguna menerima ketentuan lisensi untuk penggunaan model. Informasi harga mengenai konsumsi disediakan selama penerapan.

Model dari penyedia non-Microsoft ditagih melalui Marketplace Azure, sesuai dengan Ketentuan Penggunaan Marketplace Komersial Microsoft.

Model dari Microsoft ditagih melalui meter Azure sebagai Layanan Konsumsi Pihak Pertama. Seperti yang dijelaskan dalam Ketentuan Produk, Anda membeli Layanan Konsumsi Pihak Pertama dengan menggunakan pengukur Azure, tetapi tidak tunduk pada ketentuan layanan Azure. Penggunaan model ini tunduk pada ketentuan lisensi yang disediakan.

Menyempurnakan model

Untuk model yang tersedia melalui MaaS dan mendukung penyempurnaan, pengguna dapat memanfaatkan fasilitas penyempurnaan yang di-host dengan opsi penagihan Standar untuk menyesuaikan model sesuai data yang mereka berikan. Untuk informasi selengkapnya, lihat menyempurnakan model Llama 2 di portal Foundry.

RAG dengan model yang diterapkan sebagai instalasi standar

Foundry memungkinkan pengguna memanfaatkan Indeks Vektor dan Generasi Berbantuan Pengambilan. Model yang dapat disebarkan sebagai penyebaran standar dapat digunakan untuk menghasilkan penyematan dan inferensi berdasarkan data kustom untuk menghasilkan jawaban khusus untuk kasus penggunaannya. Untuk informasi selengkapnya, lihat Retrieval augmented generation dan indeks.

Ketersediaan penawaran dan model regional

Penagihan standar hanya tersedia untuk pengguna yang langganan Azure-nya terdaftar pada akun penagihan di negara/wilayah di mana penyedia model telah menawarkan jasa tersebut. Jika penawaran tersedia di wilayah yang relevan, pengguna harus memiliki Hub/Project di wilayah Azure tempat model tersedia untuk penyebaran atau penyempurnaan, sebagaimana berlaku. Lihat Ketersediaan wilayah untuk model dalam penyebaran standar untuk informasi terperinci.

Keamanan konten untuk model yang disebarkan melalui penyebaran standar

Penting

Fitur ini saat ini dalam pratinjau publik. Versi pratinjau ini disediakan tanpa perjanjian tingkat layanan, dan kami tidak merekomendasikannya untuk beban kerja produksi. Fitur tertentu mungkin tidak didukung atau mungkin memiliki kemampuan terbatas.

Untuk informasi lebih lanjut, lihat Supplemental Terms of Use for Microsoft Azure Previews.

Untuk model bahasa yang disebarkan melalui API tanpa server, Azure AI menerapkan konfigurasi default filter moderasi teks Azure AI Content Safety yang mendeteksi konten berbahaya seperti kebencian, bahaya diri sendiri, konten seksual, dan kekerasan. Untuk mempelajari selengkapnya tentang pemfilteran konten, lihat Pagar pembatas & kontrol untuk Model yang Dijual Langsung oleh Azure.

Petunjuk / Saran

Pemfilteran konten tidak tersedia untuk jenis model tertentu yang disebarkan melalui API tanpa server. Jenis model ini termasuk menyematkan model dan model rangkaian waktu.

Pemfilteran konten terjadi secara sinkron saat layanan memproses permintaan untuk menghasilkan konten. Anda mungkin akan ditagih secara terpisah sesuai dengan skema harga dari Azure AI Content Safety untuk penggunaan tersebut. Anda dapat menonaktifkan pemfilteran konten untuk titik akhir tanpa server individual:

- Pada saat Anda pertama kali menyebarkan model bahasa

- Kemudian, dengan memilih tombol pemfilteran konten pada halaman detail penyebaran

Misalkan Anda memutuskan untuk menggunakan API selain API Inferensi Model untuk bekerja dengan model yang disebarkan melalui API tanpa server. Dalam situasi seperti itu, pemfilteran konten tidak diaktifkan kecuali Anda menerapkannya secara terpisah dengan menggunakan Azure AI Content Safety.

Untuk memulai dengan Azure AI Content Safety, lihat Panduan Memulai: Menganalisis konten teks. Jika Anda tidak menggunakan pemfilteran konten saat bekerja dengan model yang disebarkan melalui API tanpa server, Anda menjalankan risiko yang lebih tinggi untuk mengekspos pengguna ke konten berbahaya.

Isolasi jaringan untuk model yang disebarkan melalui penyebaran standar

Titik akhir untuk model yang disebarkan sebagai penyebaran standar mengikuti pengaturan bendera akses jaringan publik (PNA) ruang kerja tempat penyebaran berada. Untuk mengamankan titik akhir MaaS Anda, nonaktifkan bendera PNA di ruang kerja Anda. Anda dapat mengamankan komunikasi masuk dari klien ke titik akhir Anda dengan menggunakan titik akhir privat untuk ruang kerja.

Untuk mengatur bendera PNA untuk ruang kerja:

- Buka portal Azure.

- Cari Azure Pembelajaran Mesin, dan pilih ruang kerja Anda dari daftar ruang kerja.

- Pada halaman Gambaran Umum, gunakan panel kiri untuk masuk ke Pengaturan>Jaringan.

- Di bawah tab Akses publik, Anda dapat mengonfigurasi pengaturan untuk bendera akses jaringan publik.

- Simpan perubahan Anda. Perubahan Anda mungkin memerlukan waktu hingga lima menit untuk disebarluaskan.

Keterbatasan

- Jika Anda memiliki ruang kerja dengan titik akhir privat yang dibuat sebelum 11 Juli 2024, titik akhir MaaS baru yang ditambahkan ke ruang kerja ini tidak akan mengikuti konfigurasi jaringannya. Sebagai gantinya, Anda perlu membuat titik akhir privat baru untuk ruang kerja dan membuat penyebaran standar baru di ruang kerja sehingga penyebaran baru dapat mengikuti konfigurasi jaringan ruang kerja.

- Jika Anda memiliki ruang kerja dengan penyebaran MaaS yang dibuat sebelum 11 Juli 2024, dan Anda mengaktifkan titik akhir privat di ruang kerja ini, penyebaran MaaS yang ada tidak akan mengikuti konfigurasi jaringan ruang kerja. Agar penyebaran standar di ruang kerja mengikuti konfigurasi ruang kerja, Anda perlu membuat penyebaran lagi.

- Saat ini Pada Data Anda tidak tersedia untuk penyebaran MaaS di ruang kerja privat, karena flag PNA dinonaktifkan di ruang kerja privat.

- Setiap perubahan konfigurasi jaringan (misalnya, mengaktifkan atau menonaktifkan bendera PNA) mungkin memerlukan waktu hingga lima menit untuk disebarluaskan.