Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

BERLAKU UNTUK: Ekstensi ml Azure CLI v2 (saat ini)

Ekstensi ml Azure CLI v2 (saat ini) Python SDK azure-ai-ml v2 (saat ini)

Python SDK azure-ai-ml v2 (saat ini)

Kecerdasan Buatan yang Bertanggung Jawab (Responsible AI) adalah pendekatan untuk mengembangkan, menilai, dan menyebarkan sistem AI dengan aman, etis, dan dengan kepercayaan. Sistem AI dihasilkan dari banyak keputusan yang dibuat oleh pembuatnya. AI yang bertanggung jawab membantu memandu keputusan ini—mulai dari menentukan tujuan sistem hingga interaksi pengguna—menuju hasil yang lebih bermanfaat dan merata. Ini membuat orang dan tujuan mereka di pusat desain dan menghormati nilai-nilai seperti keadilan, keandalan, dan transparansi.

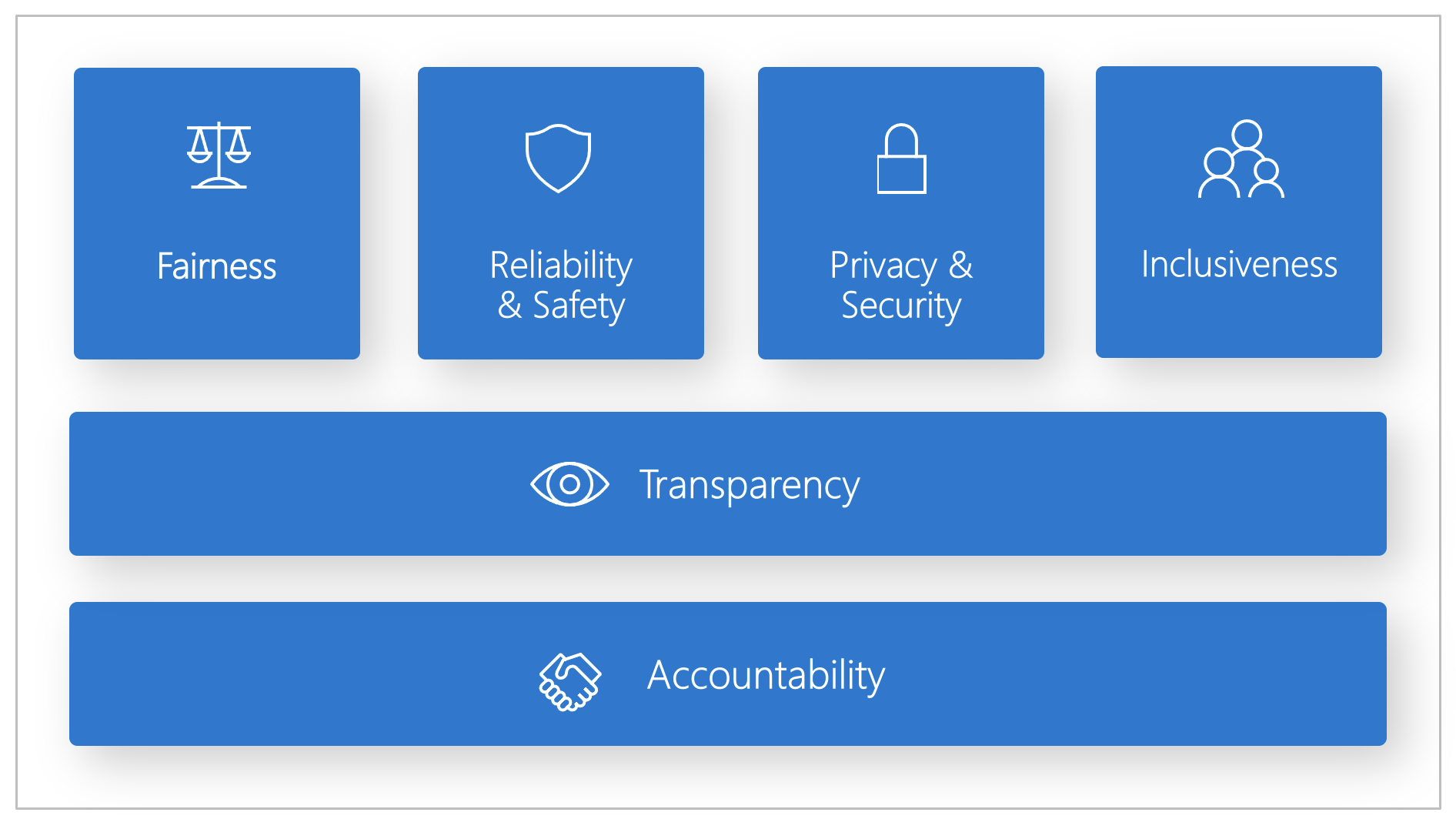

Microsoft membuat Responsible AI Standard, kerangka kerja untuk membangun sistem AI berdasarkan enam prinsip: kewajaran, keandalan dan keselamatan, privasi dan keamanan, inklusifitas, transparansi, dan akuntabilitas. Prinsip-prinsip ini adalah dasar dari pendekatan yang bertanggung jawab dan dapat dipercaya untuk AI, terutama karena teknologi cerdas menjadi lebih umum dalam produk dan layanan sehari-hari.

Artikel ini menjelaskan bagaimana Azure Machine Learning menyediakan alat untuk membantu pengembang dan ilmuwan data menerapkan dan mengoprasionalkan enam prinsip ini.

Keadilan dan inklusivitas

Sistem AI harus memperlakukan semua orang dengan adil dan menghindari mempengaruhi kelompok serupa secara berbeda. Misalnya, ketika sistem AI memberikan panduan tentang perawatan medis, aplikasi pinjaman, atau pekerjaan, mereka harus membuat rekomendasi yang sama kepada orang-orang dengan gejala serupa, keadaan keuangan, atau kualifikasi.

Kewajaran dan inklusifitas dalam Azure Machine Learning: Komponen penilaian kewajarandasbor AI yang Bertanggung Jawab membantu menilai kewajaran model di seluruh kelompok sensitif, seperti jenis kelamin, etnis, usia, dan karakteristik lainnya.

Keandalan dan keamanan

Untuk membangun kepercayaan, sistem AI harus beroperasi dengan andal, aman, dan konsisten. Mereka harus berfungsi seperti yang dirancang, merespons dengan aman terhadap kondisi tak terduga, dan menolak manipulasi berbahaya. Perilaku dan kemampuan mereka untuk menangani kondisi yang berbeda mencerminkan berbagai situasi yang diantisipasi pengembang selama desain dan pengujian.

Keandalan dan keamanan di Azure Machine Learning: Komponen analisis kesalahandasbor AI yang Bertanggung Jawab membantu Anda:

- Mendapatkan pemahaman mendalam mengenai bagaimana kegagalan tersebar untuk model.

- Mengidentifikasi kohor (subset) data dengan tingkat kesalahan yang lebih tinggi daripada tolok ukur keseluruhan.

Perbedaan ini dapat terjadi ketika sistem atau model kurang berfungsi untuk grup demografis tertentu atau untuk kondisi input yang jarang diamati dalam data pelatihan.

Transparansi

Ketika sistem AI menginformasikan keputusan yang berdampak pada kehidupan masyarakat, sangat penting bahwa orang memahami bagaimana keputusan tersebut dibuat. Misalnya, bank mungkin menggunakan sistem AI untuk memutuskan apakah seseorang layak dikreditkan, atau perusahaan mungkin menggunakannya untuk memilih kandidat pekerjaan.

Bagian penting dari transparansi adalah interpretasi: memberikan penjelasan yang berguna tentang perilaku sistem AI. Meningkatkan interpretasi membantu pemangku kepentingan memahami bagaimana dan mengapa sistem AI berfungsi, sehingga mereka dapat mengidentifikasi masalah performa, masalah kewajaran, praktik pengecualian, atau hasil yang tidak diinginkan.

Transparansi dalam Azure Machine Learning: Interpretabilitas model dan komponen bagaimana-jika kontrafaktualdasbor AI yang Bertanggung Jawab membantu menghasilkan deskripsi prediksi model yang dapat dipahami manusia.

Komponen interpretabilitas model menyediakan beberapa tampilan ke dalam perilaku model:

- Penjelasan global. Misalnya, fitur apa yang memengaruhi perilaku keseluruhan model alokasi pinjaman?

- Penjelasan lokal. Misalnya, mengapa aplikasi pinjaman pelanggan disetujui atau ditolak?

- Penjelasan model untuk kohor titik data yang dipilih. Misalnya, fitur apa yang memengaruhi perilaku keseluruhan model alokasi pinjaman untuk pemohon berpenghasilan rendah?

Komponen bagaimana-jika counterfaktual membantu Anda memahami dan men-debug model pembelajaran mesin dengan menunjukkan bagaimana ia bereaksi terhadap perubahan fitur dan perturbasi.

Azure Machine Learning juga mendukung kartu skor AI yang Bertanggung Jawab. Kartu skor adalah laporan PDF yang dapat disesuaikan yang dapat dikonfigurasi pengembang, menghasilkan, mengunduh, dan berbagi dengan pemangku kepentingan teknis dan non-teknis. Ini membantu mendidik pemangku kepentingan tentang himpunan data dan kesehatan model, mencapai kepatuhan, dan membangun kepercayaan. Kartu skor juga dapat mendukung ulasan audit dengan mengungkapkan karakteristik model pembelajaran mesin.

Privasi dan keamanan

Karena AI menjadi lebih umum, melindungi privasi dan mengamankan informasi pribadi dan bisnis lebih penting dan kompleks. Privasi dan keamanan data memerlukan perhatian ketat karena sistem AI membutuhkan data untuk membuat prediksi dan keputusan yang akurat. Sistem AI harus mematuhi hukum privasi yaitu:

- Mengharuskan transparansi tentang pengumpulan, penggunaan, dan penyimpanan data.

- Mengharuskan bahwa konsumen memiliki kontrol yang sesuai untuk memilih bagaimana data mereka digunakan.

Privasi dan keamanan di Azure Machine Learning: Azure Machine Learning memungkinkan administrator dan pengembang membuat konfigurasi aman yang mematuhi kebijakan perusahaan. Dengan Azure Machine Learning dan platform Azure, Anda dapat:

- Membatasi akses ke sumber daya dan operasi berdasarkan akun pengguna atau grup.

- Membatasi komunikasi jaringan masuk dan keluar.

- Mengenkripsi data saat transit dan tidak aktif.

- Memindai kerentanan.

- Menerapkan dan mengaudit kebijakan konfigurasi.

Microsoft juga membuat dua paket sumber terbuka untuk membantu menerapkan prinsip privasi dan keamanan:

SmartNoise: Privasi diferensial adalah set sistem dan praktik yang membantu menjaga data individu tetap aman dan privat. Dalam solusi pembelajaran mesin, privasi diferensial mungkin diperlukan untuk mematuhi peraturan. SmartNoise adalah proyek sumber terbuka (dikembangkan bersama oleh Microsoft) yang berisi komponen untuk membangun sistem privat yang berbeda yang bersifat global.

Counterfit: Counterfit adalah proyek sumber terbuka yang terdiri dari alat baris perintah dan lapisan automasi umum untuk memungkinkan pengembang melakukan simulasi serangan siber terhadap sistem AI. Siapa pun dapat mengunduh alat ini dan menyebarkannya melalui Azure Cloud Shell untuk dijalankan di dalam browser atau menyebarkannya secara lokal di lingkungan Anaconda Python. Ini dapat menilai model AI yang dihosting di berbagai lingkungan cloud, lokal, atau di tepi. Alat ini agnostik terhadap model AI dan mendukung berbagai tipe data, termasuk teks, gambar, atau input umum.

Akuntabilitas

Orang-orang yang merancang dan menyebarkan sistem AI harus bertanggung jawab atas bagaimana sistem tersebut beroperasi. Organisasi harus menggunakan standar industri untuk mengembangkan norma akuntabilitas. Norma-norma ini membantu memastikan bahwa sistem AI bukan otoritas akhir pada keputusan yang memengaruhi kehidupan masyarakat dan bahwa manusia mempertahankan kontrol yang bermakna atas sistem yang sangat otonom.

Akuntabilitas dalam Azure Machine Learning: Operasi pembelajaran mesin (MLOps) didasarkan pada prinsip dan praktik DevOps yang meningkatkan efisiensi alur kerja AI. Azure Machine Learning menyediakan kemampuan MLOps ini untuk akuntabilitas yang lebih baik:

- Mendaftar, mengemas, dan menyebarkan model dari mana saja. Anda juga dapat melacak metadata terkait yang diperlukan untuk menggunakan model.

- Mencatat data pengelolaan untuk siklus hidup pembelajaran mesin yang menyeluruh. Informasi silsilah data yang tercatat dapat termasuk siapa yang menerbitkan model, mengapa perubahan dibuat, dan kapan model disebarkan atau digunakan dalam produksi.

- Beri tahu dan ingatkan terkait peristiwa dalam siklus hidup pembelajaran mesin. Contohnya meliputi penyelesaian eksperimen, pendaftaran model, penyebaran model, dan deteksi penyimpangan model.

- Pantau aplikasi untuk mengantisipasi masalah operasional dan masalah terkait pembelajaran mesin. Membandingkan input model antara pelatihan dan inferensi, menjelajahi metrik khusus model, dan memberikan pemantauan dan peringatan pada infrastruktur pembelajaran mesin Anda.

Selain itu, kartu skor AI yang bertanggung jawab di Azure Machine Learning menciptakan akuntabilitas dengan mengaktifkan komunikasi lintas pemangku kepentingan. Kartu skor memberdayakan pengembang untuk mengonfigurasi, mengunduh, dan berbagi wawasan kesehatan model dengan pemangku kepentingan teknis dan non-teknis. Berbagi wawasan ini membantu membangun kepercayaan.

Azure Machine Learning juga mendukung pengambilan keputusan dengan menginformasikan keputusan bisnis melalui:

- Wawasan berbasis data, yang membantu pemangku kepentingan memahami efek perawatan penyebab pada hasil menggunakan data historis saja. Misalnya, "Bagaimana obat mempengaruhi tekanan darah pasien?" Wawasan ini berasal dari komponen inferensi kausaldasbor AI yang bertanggung jawab.

- Wawasan berbasis model, yang menjawab pertanyaan pengguna (seperti "Apa yang bisa saya lakukan untuk mendapatkan hasil yang berbeda dari AI Anda lain kali?") sehingga mereka dapat mengambil tindakan. Wawasan ini disediakan melalui komponen bagaimana-jika kontrafaktualdasbor AI yang Bertanggung Jawab.

Langkah berikutnya

- Untuk informasi selengkapnya tentang cara menerapkan AI yang Bertanggung Jawab dalam Azure Machine Learning, lihat Dasbor AI yang Bertanggung Jawab.

- Pelajari cara menghasilkan dasbor AI yang Bertanggung Jawab melalui CLI dan SDK atau UI studio Azure Machine Learning.

- Pelajari cara membuat kartu skor AI yang Bertanggung Jawab berdasarkan wawasan yang diamati di dasbor AI yang Bertanggung Jawab Anda.

- Pelajari Standar AI yang Bertanggung Jawab untuk membangun sistem AI menurut enam prinsip utama.