Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Si applica a:SQL Server 2019 (15.x)

Important

I cluster Big Data di Microsoft SQL Server 2019 sono stati ritirati. Il supporto per i cluster Big Data di SQL Server 2019 è terminato a partire dal 28 febbraio 2025. Per altre informazioni, vedere il post di blog sull'annuncio e le opzioni per Big Data nella piattaforma Microsoft SQL Server.

In SQL Server 2019 (15.x), i cluster Big Data di SQL Server consentono di distribuire cluster scalabili di contenitori SQL Server, Spark e HDFS in esecuzione in Kubernetes. Questi componenti vengono eseguiti in modo affiancato per permettere la lettura, la scrittura e l'elaborazione di Big Data da Transact-SQL o Spark, in modo da combinare e analizzare facilmente i dati relazionali di alto valore con volumi elevati di Big Data.

Get started

- Per prima cosa, vedere Introduzione alla distribuzione di cluster Big Data di SQL Server

- Per le nuove funzionalità per la versione più recente, vedere le note sulla versione

- Per domande frequenti, vedere Domande frequenti sui cluster Big Data

Architettura dei cluster Big Data

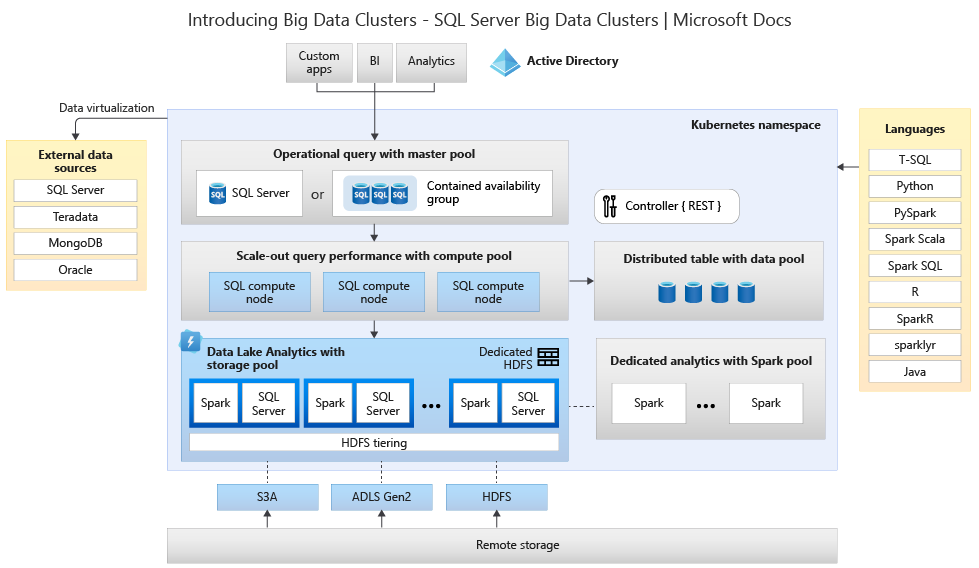

Il diagramma seguente illustra i componenti di un cluster Big Data di SQL Server:

Controller

Il controller fornisce la gestione e la sicurezza per il cluster. Contiene il servizio di controllo, l'archivio di configurazione e altri servizi a livello di cluster, ad esempio Kibana, Grafana e Ricerca elastica.

Compute pool

Il pool di calcolo fornisce risorse di calcolo al cluster. Contiene nodi che eseguono SQL Server in pod Linux. I pod nel pool di calcolo sono suddivisi in istanze di calcolo SQL per attività di elaborazione specifiche.

Data pool

Il pool di dati viene usato per la persistenza dei dati. Il pool di dati è costituito da uno o più pod che eseguono SQL Server in Linux. Viene usato per inserire dati da query SQL o processi Spark.

Storage pool

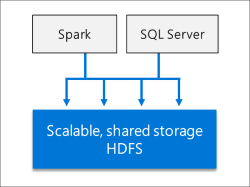

Il pool di archiviazione è costituito da pod del pool di archiviazione costituiti da SQL Server in Linux, Spark e HDFS. Tutti i nodi di archiviazione in un cluster Big Data di SQL Server sono membri di un cluster HDFS.

Tip

Per un'analisi approfondita dell'architettura e dell'installazione di cluster Big Data, vedere Workshop: Architettura dei cluster Big Data di Microsoft SQL Server.

App pool

La distribuzione di applicazioni consente la distribuzione di applicazioni in un cluster Big Data di SQL Server fornendo interfacce per creare, gestire ed eseguire applicazioni.

Scenari e funzionalità

I cluster Big Data di SQL Server offrono flessibilità nel modo in cui si interagisce con i Big Data. È possibile eseguire query su origini dati esterne, archiviare Big Data in HDFS gestito da SQL Server o eseguire query sui dati da più origini dati esterne tramite il cluster. È quindi possibile usare i dati per intelligenza artificiale, Machine Learning e altre attività di analisi.

Usare cluster Big Data di SQL Server per:

- Distribuire cluster scalabili di contenitori SQL Server, Spark e HDFS in esecuzione in Kubernetes.

- Leggere, scrivere ed elaborare Big Data da Transact-SQL o Spark.

- Combinare e analizzare con facilità dati relazionali di alto valore con volumi elevati di Big Data.

- Eseguire query su origini dati esterne.

- Archiviare Big Data in HDFS gestito da SQL Server.

- Eseguire query sui dati da più origini dati esterne tramite il cluster.

- Usare i dati per intelligenza artificiale, Machine Learning e altre attività di analisi.

- Distribuire ed eseguire applicazioni in cluster Big Data.

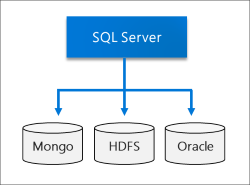

- Virtualizzare i dati con PolyBase. Interrogare i dati da server SQL esterni, Oracle, Teradata, MongoDB e origini dati ODBC generici con tabelle esterne.

- Offrire disponibilità elevata per l'istanza master di SQL Server e per tutti i database usando la tecnologia del gruppo di disponibilità AlwaysOn.

Le sezioni seguenti forniscono altre informazioni su questi scenari.

Data virtualization

Sfruttando PolyBase, i cluster Big Data di SQL Server possono eseguire query su origini dati esterne senza spostare o copiare i dati. SQL Server 2019 (15.x) introduce nuovi connettori alle origini dati. Per altre informazioni, vedere Novità di PolyBase 2019?.

Data lake

Un cluster Big Data di SQL Server include un pool di archiviazione HDFS scalabile. Questa può essere utilizzata per archiviare big data, potenzialmente acquisiti da più fonti esterne. Dopo aver archiviato i Big Data in HDFS nel cluster Big Data, è possibile analizzare ed eseguire query sui dati e combinarli con i dati relazionali.

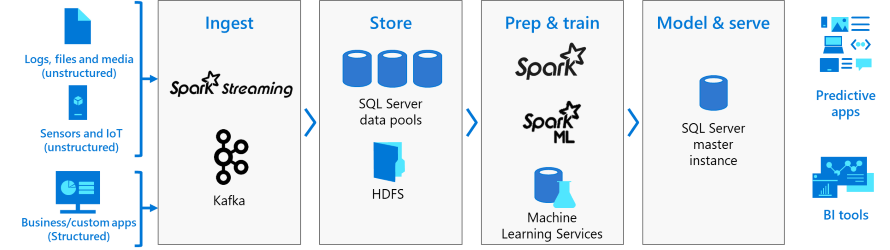

Intelligenza artificiale integrata e Machine Learning

I cluster Big Data di SQL Server consentono attività di intelligenza artificiale e Machine Learning sui dati archiviati nei pool di archiviazione HDFS e nei pool di dati. È possibile usare Spark e gli strumenti di intelligenza artificiale predefiniti in SQL Server usando R, Python, Scala o Java.

Gestione e monitoraggio

La gestione e il monitoraggio vengono forniti tramite una combinazione di strumenti da riga di comando, API, portali e viste a gestione dinamica.

È possibile usare Azure Data Studio per eseguire un'ampia gamma di attività nel cluster Big Data:

- Frammenti integrati per attività di gestione comuni.

- Possibilità di esplorare HDFS, caricare file, visualizzare in anteprima i file e creare directory.

- Possibilità di creare, aprire ed eseguire notebook compatibili con Jupyter.

- Procedura guidata per la virtualizzazione dei dati per semplificare la creazione di origini dati esterne (abilitate dall'estensione per la virtualizzazione dei dati).

Kubernetes concepts

Un cluster Big Data di SQL Server è un cluster di contenitori Linux orchestrati da Kubernetes.

Kubernetes è un agente di orchestrazione dei contenitori open source, che può ridimensionare le distribuzioni dei contenitori in base alle esigenze. La tabella seguente definisce una terminologia importante di Kubernetes:

| Term | Description |

|---|---|

| Cluster | Un cluster Kubernetes è un set di computer, noti come nodi. Un nodo controlla il cluster ed è designato il nodo master; i nodi rimanenti sono nodi di lavoro. Il master Kubernetes è responsabile della distribuzione del lavoro tra i ruoli di lavoro e per il monitoraggio dell'integrità del cluster. |

| Node | Un nodo esegue applicazioni in contenitori. Può essere una macchina fisica o una macchina virtuale. Un cluster Kubernetes può contenere una combinazione di nodi macchina fisica e macchina virtuale. |

| Pod | Un pod è l'unità di distribuzione atomica di Kubernetes. Un pod è un gruppo logico di uno o più contenitori e risorse associate necessarie per eseguire un'applicazione. Ogni pod viene eseguito in un nodo; un nodo può eseguire uno o più pod. Il master Kubernetes assegna automaticamente i pod ai nodi del cluster. |

Nei cluster Big Data di SQL Server Kubernetes è responsabile dello stato del cluster. Kubernetes compila e configura i nodi del cluster, assegna i pod ai nodi e monitora l'integrità del cluster.