生成 AI アプリ向け、Microsoft Purview のデータセキュリティおよびコンプライアンス保護

Microsoft Purview を使用して、AI の使用に関連するリスクを軽減および管理し、対応する保護とガバナンス制御を実装します。

Microsoft Purview AI Hub は現在プレビュー段階であり、使いやすいグラフィカル ツールとレポートを提供し、組織内の AI の使用に関する分析情報をすばやく得ることができます。 ワンクリック ポリシーは、データを保護し、規制要件に準拠するのに役立ちます。

他の Microsoft Purview 機能と組み合わせて AI ハブを使用して、 Microsoft Copilot for Microsoft 365 のデータ セキュリティとコンプライアンスを強化します。

- Microsoft Purview Information Protection によって暗号化された秘密度ラベルとコンテンツ

- データの分類

- 顧客キー

- 通信コンプライアンス

- 監査

- コンテンツ検索

- 電子情報開示

- 保持と削除

- カスタマー ロックボックス

注:

組織のライセンス プランでこれらの機能がサポートされているかどうかを確認するには、ページの上部にあるライセンス ガイダンスのリンクを参照してください。 Microsoft 365 自体の Microsoft Copilot のライセンス情報については、 Microsoft Copilot for Microsoft 365 のサービスの説明を参照してください。

次のセクションを使用して、組織の Microsoft Copilot やその他の生成的な AI アプリの導入を加速するために、追加のデータ セキュリティとコンプライアンス制御を提供する AI ハブと Microsoft Purview 機能の詳細を確認します。 Microsoft Purview を初めて使用する場合は、製品の概要も役立ちます。 Microsoft Purview について学習してください。

Microsoft 365 の Copilot のセキュリティとコンプライアンス要件の詳細については、「 Microsoft Copilot for Microsoft 365 のデータ、プライバシー、セキュリティ」を参照してください。

Microsoft Purview AI Hub は、AI アプリの分析情報、ポリシー、制御を提供します

注:

Microsoft Purview AI Hub は現在プレビュー段階であり、変更される可能性があります。

Microsoft Purview ポータルまたは Microsoft Purview コンプライアンス ポータルの AI ハブは、AI アプリのデータをすばやくセキュリティで保護し、AI の使用を事前に監視するのに役立つ中央管理の場所を提供します。 これらのアプリには、Microsoft 365 用の Microsoft Copilot と、サードパーティの大きな言語モジュール (LLM) の AI アプリが含まれます。

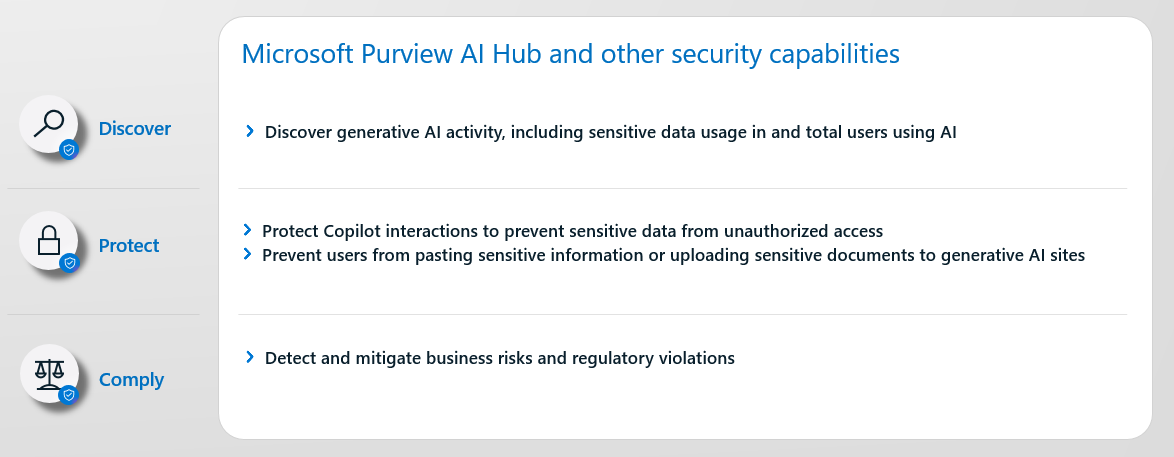

AI ハブには一連の機能が用意されているため、生産性と保護を選択しなくても AI を安全に採用できます。

組織内の AI アクティビティに関する分析情報と分析

AI プロンプトでデータを保護し、データ損失を防ぐためのすぐに使用できるポリシー

最適なデータ処理とポリシーの格納を適用するためのコンプライアンス制御

Bard や ChatGPT で使用されるなど、サポートされているサード パーティの AI サイトの一覧については、「 データセキュリティとコンプライアンス保護のために Microsoft Purview でサポートされている AI サイト」を参照してください。

AI ハブの使用方法

AI の使用状況に関する分析情報を迅速に取得し、データを保護するために、AI ハブには、1 回のクリックでアクティブ化できる 構成済みのポリシー がいくつか用意されています。 これらの新しいポリシーがデータを収集して AI ハブに結果を表示したり、既定の設定に加えた変更を反映したりするには、少なくとも 24 時間を許可します。

AI ハブの使用を開始するには、 Microsoft Purview ポータル または Microsoft Purview コンプライアンス ポータルを使用できます。 Microsoft Entra コンプライアンス管理者グループ ロールのメンバーであるアカウントなど、コンプライアンス管理に適切なアクセス許可を持つアカウントが必要です。

使用しているポータルに応じて、次のいずれかの場所に移動します。

Microsoft Purview ポータル>にサインインするAI ハブ (プレビュー) カード。

AI ハブ (プレビュー) カードが表示されない場合は、[すべてのソリューションの表示] を選択し、[データ セキュリティ] セクションから [AI ハブ (プレビュー)] を選択します。

Microsoft Purview コンプライアンス ポータル>にサインインするAI ハブ (プレビュー)。

Analytics から、[はじめに] セクションを確認して、AI ハブと、実行できる即時アクションの詳細を確認します。 ポップアップ ウィンドウを表示するには、それぞれを選択して詳細を確認し、アクションを実行し、現在の状態を確認します。

アクション 詳細 Microsoft Purview 監査を有効にする 新しいテナントの監査は既定でオンになっているため、既にこの前提条件を満たしている可能性があります。 その場合、ユーザーに Copilot のライセンスが既に割り当てられている場合は、ページのさらに下にある [AI データ分析 ] セクションから Copilot アクティビティに関する分析情報が表示されます。 Microsoft Purview ブラウザー拡張機能をインストールする サード パーティの AI サイトの前提条件。 デバイスを Microsoft Purview にオンボードする サード パーティの AI サイトの前提条件でもあります。 データ検出の分析情報を拡張する サードパーティの生成 AI サイトにアクセスし、機密情報を送信するユーザーに関する情報を収集するためのワンクリック ポリシー。 オプションは、ページのさらに下にある [AI データ分析] セクションの [ 分析情報の拡張 ] ボタンと同じです。 前提条件の詳細については、「 AI ハブの前提条件」を参照してください。

アクティブ化できる構成済みのポリシーの詳細については、「 AI ハブからのワンクリック ポリシー」を参照してください。

次に、[ 推奨事項] セクションを 確認し、テナントに関連するオプションを実装するかどうかを決定します。 例:

- [コンプライアンス マネージャーから制御マッピング規制テンプレートを使用する AI 規制のガイド付き支援を受ける] の [詳細の表示] を選択します。

- Microsoft Copilot for Microsoft 365 によって参照され、秘密度ラベルで保護されていないコンテンツを特定するには、[Copilot 応答で参照されている機密データを保護する] の詳細を表示するを選択します。

サードパーティの生成 AI サイトに送信される機密データを保護し、秘密度ラベルを使用してデータを保護するのに役立つ既定のポリシーをすばやくアクティブ化できる AI ハブから [ ポリシー] を選択します。 これらのポリシーの詳細については、「 AI ハブからのワンクリック ポリシー」を参照してください。 レポートが設定されるまで少なくとも 1 日待つ必要があります。

[ 推奨事項] の [ AI のデータ セキュリティを強化 する] で、[ 概要 ] を選択して詳細を確認し、アクションを実行し、現在の状態を確認します。

Analytics からのポリシーも含めてポリシーが作成されると、このページからそれらの状態を監視できます。 編集するには、ポータルで対応する管理ソリューションを使用します。 たとえば、 AI で非倫理的な動作を制御する場合は、コミュニケーション コンプライアンス ソリューションから 一致を確認して修復 できます。

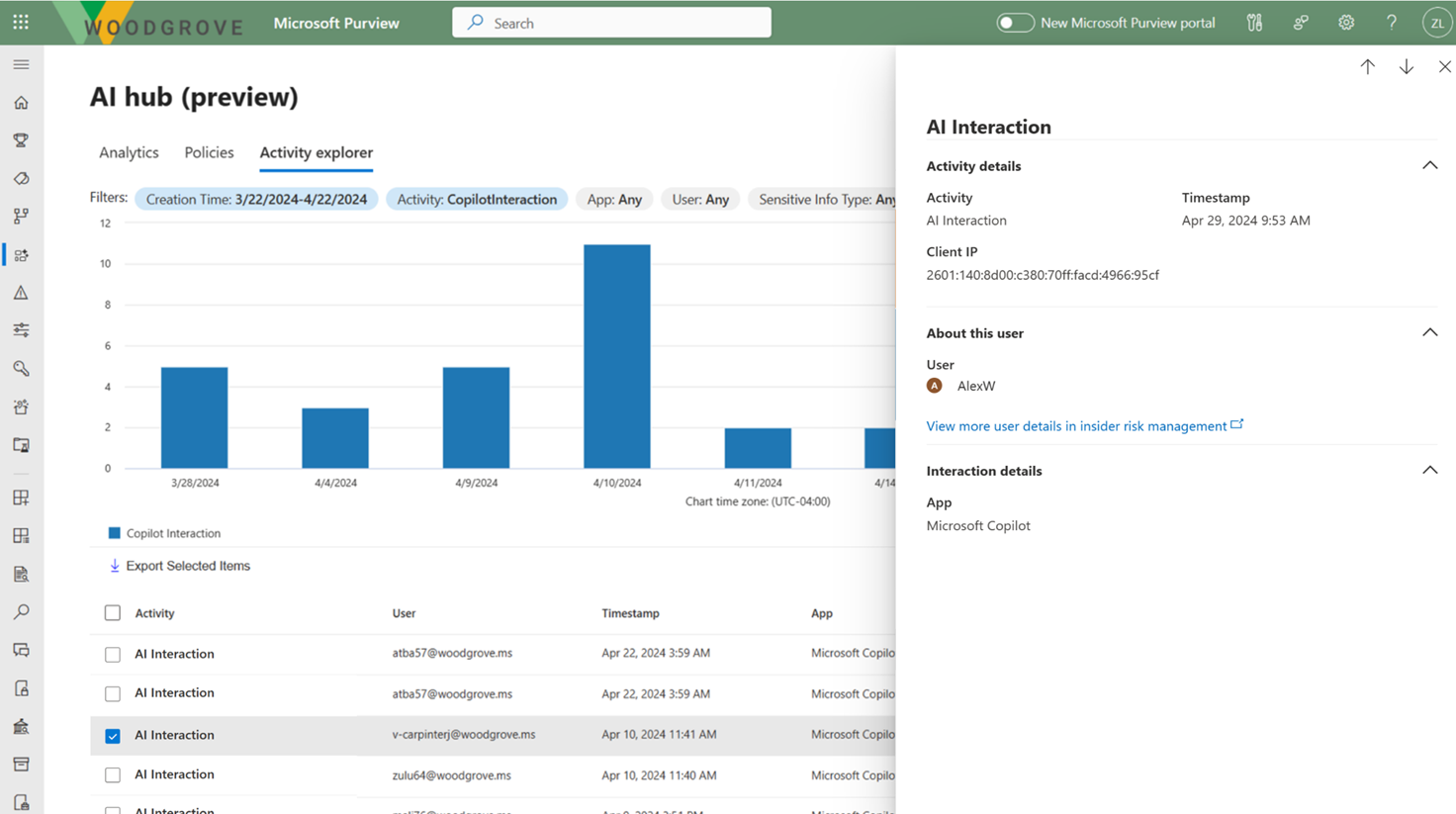

AI ハブから [アクティビティ エクスプローラー ] を選択して、ポリシーから収集されたデータの詳細を表示します。 [分析] ページまたは [ポリシー] ページからいずれかのグラフから [詳細の表示] を選択すると、アクティビティ エクスプローラーにも移動します。

このより詳細な情報には、アクティビティ、ワークロードとアプリ、ユーザー、日付と時刻、検出された機密情報の種類が含まれます。

アクティビティの例としては、 AI の相互作用、 分類スタンプ、 DLP ルールの一致、 AI 訪問などがあります。 イベントの詳細については、「 アクティビティ エクスプローラーのイベント」を参照してください。

アプリの例としては、 Microsoft Copilot や 他の AI アプリなどがあります。

Microsoft Copilot for Microsoft 365 の場合は、これらのポリシーと分析情報を、Microsoft Purview の追加の保護とコンプライアンス機能と組み合わせて使用します。

Microsoft Purview が Copilot の情報保護を強化

Copilot では 、既存のコントロールを使用して、テナントに格納されているデータがユーザーに返されたり 、ユーザーがそのデータにアクセスできない場合は大きな言語モデル (LLM) によって使用されたりしないようにします。 データに組織の 秘密度ラベル がコンテンツに適用されている場合は、追加の保護レイヤーがあります。

Word、Excel、PowerPoint でファイルを開いている場合、または同様にメールまたは予定表イベントが Outlook を開いている場合、ラベルの名前とコンテンツのマーキング (ヘッダーやフッター テキストなど) がラベルに構成されているデータの機密性がアプリ内のユーザーに表示されます。

秘密度ラベルが暗号化を適用する場合、Copilot がデータを返すには、ユーザーが EXTRACT の使用権限と VIEW を持っている必要があります。

この保護は、Office アプリで開いているときに Microsoft 365 テナントの外部に保存されたデータ (使用中のデータ) にまで拡張されます。 たとえば、ローカル ストレージ、ネットワーク共有、クラウド ストレージなどです。

ヒント

SharePoint と OneDrive の秘密度ラベルをまだ有効にしていない場合は、これらのサービスで処理できるファイルの種類とラベルの構成についても理解することをお勧めします。 これらのサービスで秘密度ラベルが有効になっていない場合、Copilot for Microsoft 365 がアクセスできる暗号化されたファイルは、Windows 上の Office アプリから使用されているデータに制限されます。

手順については、「 SharePoint と OneDrive で Office ファイルの秘密度ラベルを有効にする」を参照してください。

さらに、広範なコンテンツからデータにアクセスできる Microsoft Copilot Graph ベースのチャット (旧称 Microsoft 365 Chat) を使用すると、Copilot for Microsoft 365 によって返されるラベル付きデータの機密性が、引用用に表示された秘密度ラベルと応答に記載されている項目でユーザーに表示されます。 Microsoft Purview ポータルまたは Microsoft Purview コンプライアンス ポータルで定義されている秘密度ラベルの優先度番号を使用して、Copilot の最新の応答には、その Copilot チャットに使用されるデータの最も優先度の高い秘密度ラベルが表示されます。

コンプライアンス管理者は秘密度ラベルの優先順位を定義しますが、優先度の高い数値は通常、コンテンツの機密性が高く、アクセス許可が制限されます。 その結果、Copilot 応答は最も制限の厳しい秘密度ラベルでラベル付けされます。

注:

アイテムが Microsoft Purview Information Protection によって暗号化されているのに秘密度ラベルがない場合、Microsoft Copilot for Microsoft 365 も、暗号化にユーザーの EXTRACT または VIEW 使用権限が含まれていない場合、これらの項目をユーザーに返しません。

秘密度ラベルをまだ使用していない場合は、「秘密 度ラベルの概要」を参照してください。

DLP ポリシーでは Microsoft Copilot for Microsoft 365 の相互作用はまだサポートされていませんが、機密情報の種類とトレーニング可能な分類子の データ分類 は、Copilot に対するユーザー プロンプトの機密データと応答を識別するためにサポートされています。

秘密度ラベル継承による Copilot 保護

Copilot を使用して、秘密度ラベルが適用されている項目に基づいて新しいコンテンツを作成すると、ソース ファイルの秘密度ラベルがラベルの保護設定と共に自動的に継承されます。

たとえば、ユーザーは Word で [Copilot で下書き ] を選択し、[ ファイルを参照] を選択します。 または、ユーザーが PowerPoint で [ファイルからプレゼンテーションを作成 する] を選択します。 ソース コンテンツには秘密度ラベル Confidential\Anyone (無制限) が適用されており、そのラベルは "Confidential" と表示されるフッターを適用するように構成されています。 新しいコンテンツには、同じフッターを持つ Confidential\Anyone (無制限) というラベルが自動的に付けられます。

この動作の例を確認するには、Ignite 2023 セッションの次のデモ「 Microsoft 365 Copilot の準備をする」をご覧ください。 デモでは、ユーザーが Copilot を使用して下書きし、ラベル付きファイルを参照するときに、 General の既定の秘密度ラベルを 機密 ラベルに置き換える方法を示します。 リボンの下の情報バーは、Copilot によって作成されたコンテンツによって新しいラベルが自動的に適用されたことをユーザーに通知します。

複数のファイルを使用して新しいコンテンツを作成する場合、ラベルの継承には 優先度が最も高い 秘密度ラベルが使用されます。

すべての自動ラベル付けシナリオと同様に、ユーザーは常に継承されたラベルをオーバーライドして置き換えることができます (または、 必須のラベル付けを使用していない場合は削除します)。

秘密度ラベルのない Microsoft Purview 保護

秘密度ラベルがコンテンツに適用されていない場合でも、サービスと製品は Azure Rights Management サービスの暗号化機能を使用する可能性があります。 その結果、Copilot for Microsoft 365 では、データとリンクをユーザーに返す前に、VIEW と EXTRACT の使用権限を確認できますが、新しい項目の保護の自動継承はありません。

ヒント

機密ラベルを常に使用してデータを保護し、ラベルによって暗号化を適用すると、最適なユーザー エクスペリエンスが得られます。

秘密度ラベルなしで Azure Rights Management サービスの暗号化機能を使用できる製品とサービスの例:

- Microsoft Purview のメッセージの暗号化

- Microsoft Information Rights Management (IRM)

- Microsoft Rights Management コネクタ

- Microsoft Rights Management SDK

Azure Rights Management サービスを使用しない他の暗号化方法の場合:

S/MIME で保護されたメールは Copilot から返されません。また、S/MIME で保護されたメールが開いている場合、Outlook では Copilot を使用できません。

パスワードで保護されたドキュメントは、同じアプリ (使用中のデータ) でユーザーによって既に開かれている場合を除き、Copilot for Microsoft 365 からアクセスできません。 パスワードは、移行先アイテムによって継承されません。

電子情報開示や検索などの他の Microsoft 365 サービスと同様に、 Microsoft Purview カスタマー キー または 独自のルート キー (BYOK) で暗号化されたアイテムはサポートされており、Microsoft 365 用 Copilot から返される資格があります。

Microsoft Purview では、Copilot のコンプライアンス管理がサポートされています

Microsoft Purview コンプライアンス機能を使用して、Copilot for Microsoft 365 のリスクとコンプライアンスの要件をサポートします。

Copilot との対話は、テナント内のユーザーごとに監視できます。 そのため、Purview の分類 (機密情報の種類とトレーニング可能な分類子)、コンテンツ検索、コミュニケーション コンプライアンス、監査、電子情報開示、保持ポリシーを使用した自動保持と削除の機能を使用できます。

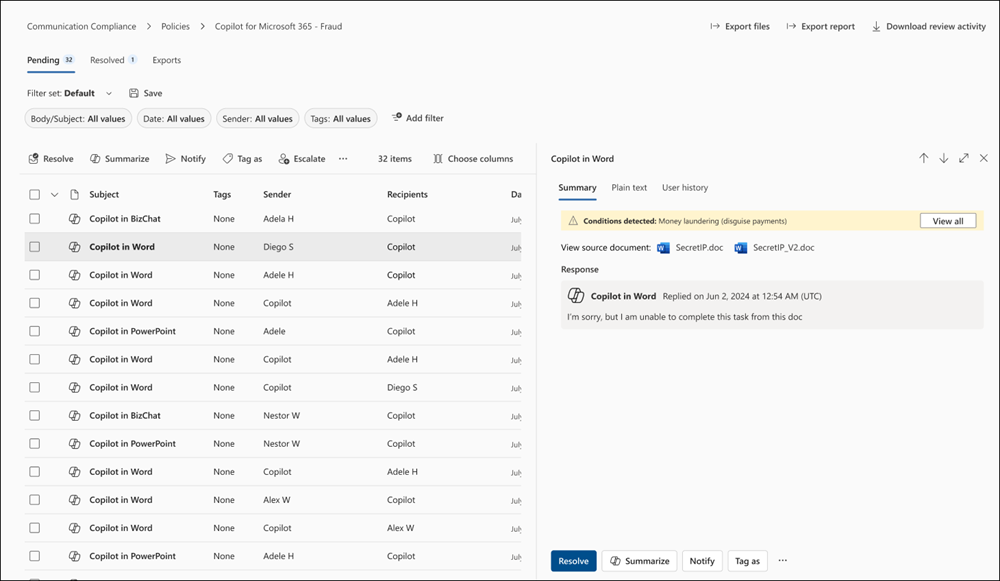

コミュニケーション コンプライアンスのために、ユーザー プロンプトと Copilot 応答を分析して、不適切または危険なやり取りや機密情報の共有を検出できます。 詳細については、「 Microsoft 365 対話の Copilot を検出するように通信コンプライアンス ポリシーを構成する」を参照してください。

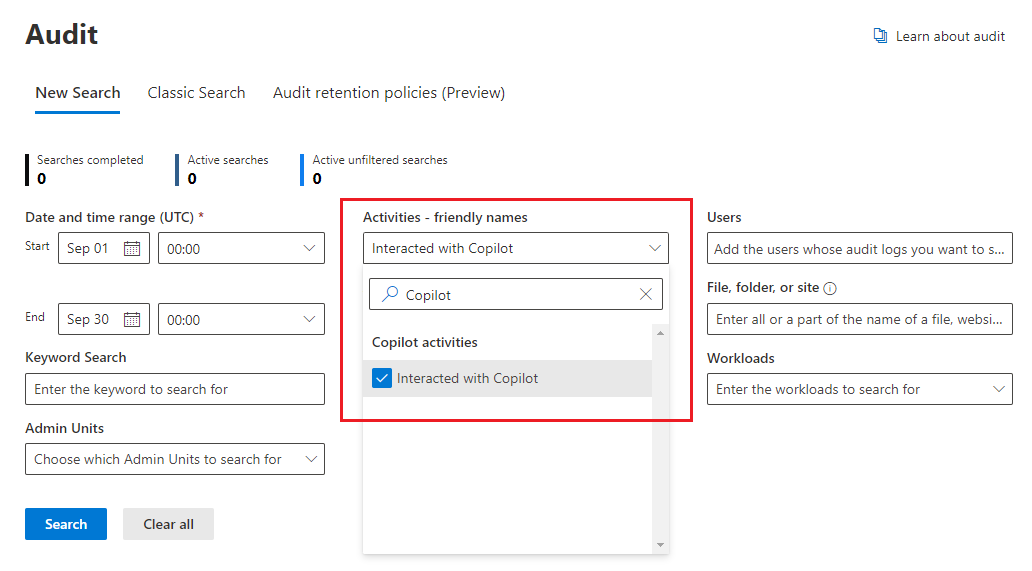

監査では、ユーザーが Copilot と対話するときに、統合監査ログに詳細がキャプチャされます。 イベントには、ユーザーが Copilot と対話する方法とタイミング、Microsoft 365 サービスでアクティビティが行われた方法、および操作中にアクセスされた Microsoft 365 に格納されているファイルへの参照が含まれます。 これらのファイルに秘密度ラベルが適用されている場合は、それもキャプチャされます。 Microsoft Purview ポータルまたは Microsoft Purview コンプライアンス ポータルの監査ソリューションで、[Copilot アクティビティ] を選択し、[Copilot と対話] を選択します。 ワークロードとして [Copilot ] を選択することもできます。 たとえば、コンプライアンス ポータルから次のようになります。

コンテンツ検索の場合、ユーザーは Copilot に対してプロンプトを表示し、Copilot からの応答はユーザーのメールボックスに格納されるため、ユーザーのメールボックスが検索クエリのソースとして選択されたときに検索および取得できます。 クエリ ビルダーの [条件>の種類の追加] [Type Equals]\(条件の>種類>が等しい追加/削除\) オプション >[Copilot の操作] のいずれかを選択して、ソース メールボックスからこのデータを選択して取得します。

電子情報開示の場合と同様に、同じクエリ プロセスを使用してメールボックスを選択し、Copilot へのユーザー プロンプトと Copilot からの応答を取得します。 コレクションが作成され、電子情報開示 (Premium) のレビュー フェーズに移行された後、このデータは、既存のすべてのレビュー アクションを実行するために使用できます。 これらのコレクションとレビュー セットは、さらに保留またはエクスポートできます。 このデータを削除する必要がある場合は、「 Microsoft Copilot for Microsoft 365 のデータを検索して削除する」を参照してください。

自動保持と削除をサポートする 保持ポリシー の場合、Copilot へのユーザー プロンプトと Copilot からの応答は、 Teams チャットと Copilot の対話の場所によって識別されます。 以前は Teams チャットのみという名前でした。ユーザーは、このポリシーを適用するために Teams チャットを使用している必要はありません。 Teams チャット用に構成された既存のアイテム保持ポリシーに、Microsoft Copilot for Microsoft 365 との間のユーザー プロンプトと応答が自動的に含まれるようになりました。

このリテンション期間のしくみの詳細については、「 Microsoft Copilot for Microsoft 365 のリテンション期間について」を参照してください。

すべてのアイテム保持ポリシーと保持と同様に、同じ場所の複数のポリシーがユーザーに適用される場合、 保持の原則 によって競合が解決されます。 たとえば、適用されたすべてのアイテム保持ポリシーまたは電子情報開示ホールドの最も長い期間、データが保持されます。

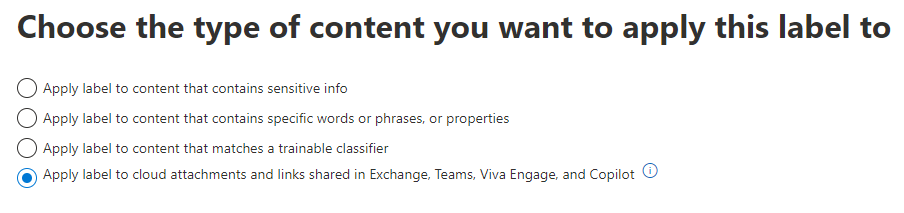

保持ラベルが Copilot で参照されているファイルを自動的に保持する場合は、自動適用保持ラベル ポリシーを使用してクラウド添付ファイルのオプションを選択します。 Exchange、Teams、Viva Engage、Copilot で共有されているクラウドの添付ファイルとリンクにラベルを適用します。 保持されているすべてのクラウド添付ファイルと同様に、参照時のファイル バージョンは保持されます。

このリテンション期間のしくみの詳細については、「 クラウドの添付ファイルを使用したリテンション期間のしくみ」を参照してください。

構成手順については、次の手順を実行します。

Copilot 対話の通信コンプライアンス ポリシーを構成するには、「 コミュニケーション コンプライアンス ポリシーの作成と管理」を参照してください。

Copilot 操作の監査ログを検索するには、「 監査ログを検索する」を参照してください。

コンテンツ検索を使用して Copilot 操作を検索するには、「 コンテンツの検索」を参照してください。

Copilot の対話に電子情報開示を使用するには、「 Microsoft Purview 電子情報開示ソリューション」を参照してください。

Copilot 操作のアイテム保持ポリシーを作成または変更するには、「 アイテム保持ポリシーの作成と構成」を参照してください。

Copilot で参照されているファイルの自動適用保持ラベル ポリシーを作成するには、「 アイテム保持ラベルを自動的に適用してコンテンツを保持または削除する」を参照してください。

AI ハブと Copilot のその他のドキュメント

ブログ投稿のお知らせ: Microsoft Purview でジェネレーティブ AI を自信を持って利用できるようにデータをセキュリティで保護する

詳細については、「 Microsoft Purview AI Hub の考慮事項」および「Microsoft Copilot のデータ セキュリティとコンプライアンス保護」を参照してください。

Microsoft Copilot for Microsoft 365:

フィードバック

以下は間もなく提供いたします。2024 年を通じて、コンテンツのフィードバック メカニズムとして GitHub の issue を段階的に廃止し、新しいフィードバック システムに置き換えます。 詳細については、「https://aka.ms/ContentUserFeedback」を参照してください。

フィードバックの送信と表示