Notitie

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen u aan te melden of de directory te wijzigen.

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen de mappen te wijzigen.

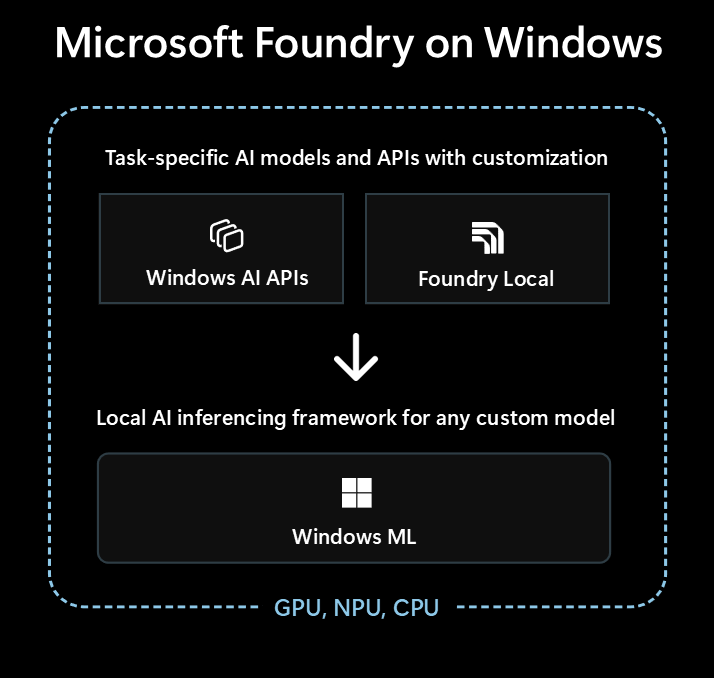

Microsoft Foundry on Windows is de belangrijkste oplossing voor ontwikkelaars die lokale AI-mogelijkheden willen integreren in hun Windows-apps.

Microsoft Foundry on Windows biedt ontwikkelaars...

- Gebruiksklare AI-modellen en API's via Windows AI APIs en Foundry Local

- AI-inferentiekader om elk model lokaal uit te voeren via Windows ML

Ongeacht of u geen ervaring hebt met AI of een ervaren Machine Learning (ML)-expert, Microsoft Foundry on Windows iets voor u heeft.

Kant-en-klare AI-modellen en API's

Uw app kan moeiteloos de volgende lokale AI-modellen en API's in minder dan een uur gebruiken. Distributie en runtime van de modelbestanden worden verwerkt door Microsoft en de modellen worden gedeeld tussen apps. Als u deze modellen en API's gebruikt, hebt u slechts een handvol regels code nodig, zonder ML-expertise.

| Modeltype of API | Wat is het | Opties en ondersteunde apparaten |

|---|---|---|

| Grote taalmodellen (LLM's) | Generatieve tekstmodellen | Phi Silicium via AI APIs (ondersteunt fine-tuning) of 20+ OSS LLM-modellen via Foundry Local Zie Lokale LLM's voor meer informatie. |

| Afbeeldingsbeschrijving | Een tekstbeschrijving in natuurlijke taal van een afbeelding ophalen | Image Description via AI APIs (Copilot+ PC's) |

| Afbeelding voorgrondextractor | De voorgrond van een afbeelding segmenteren | Image Foreground Extractor via AI APIs (Copilot+ PC's) |

| Beeldgeneratie | Afbeeldingen genereren op tekst | Image Generation via AI APIs (Copilot+ pc's) |

| Afbeeldingsobject wissen | Objecten wissen uit afbeeldingen | Image-object wissen via AI APIs (Copilot+ pc's) |

| Extractor van afbeeldingsobject | Specifieke objecten in een afbeelding segmenteren | Image Object Extractor via AI APIs (Copilot+ PC’s) |

| Superresolutie van afbeelding | De resolutie van afbeeldingen vergroten | Image Super Resolution via AI APIs (Copilot+ PC's) |

| Semantisch zoeken | Semantisch zoeken in tekst en afbeeldingen | App Content Search via AI APIs (Copilot+ PC's) |

| Spraakherkenning | Spraak naar tekst converteren | Fluisteren via Foundry Local of Spraakherkenning via Windows SDK Zie Spraakherkenning voor meer informatie. |

| Tekstherkenning (OCR) | Tekst herkennen uit afbeeldingen | OCR via AI APIs (Copilot+ PC's) |

| Video Super Resolution (VSR) | De resolutie van video's verhogen | Video Super-Resolutie met AI APIs (Copilot+ PC's) |

Andere modellen gebruiken met Windows ML

U kunt een groot aantal modellen van Hugging Face of andere bronnen gebruiken, of zelfs uw eigen modellen trainen, en deze lokaal uitvoeren op Windows 10 en latere pc's met behulp van Windows ML(modelcompatibiliteit en prestaties variëren op basis van apparaathardware).

Zie vind of train modellen die gebruikt worden met Windows ML voor meer informatie.

Welke optie u moet beginnen met

Volg deze beslissingsstructuur om de beste benadering voor uw toepassing en scenario te selecteren:

Controleer of de ingebouwde Windows AI APIs uw scenario behandelen en u zich richt op Copilot+ pc's. Dit is het snelste pad naar de markt met minimale ontwikkelingsinspanningen.

Als Windows AI APIs niet beschikt over wat u nodig hebt of als u Windows 10 en hoger moet ondersteunen, kunt u overwegen Foundry Local voor LLM- of spraak-naar-tekstscenario's.

Als u aangepaste modellen nodig hebt, bestaande modellen wilt gebruiken vanuit Hugging Face of andere bronnen, of specifieke modelvereisten hebt die niet onder de bovenstaande opties vallen, biedt Windows ML u de flexibiliteit om uw eigen modellen te vinden of te trainen (en ondersteunt Windows 10 en hoger).

Uw app kan ook een combinatie van alle drie deze technologieën gebruiken.

Technologieën die beschikbaar zijn voor lokale AI

De volgende technologieën zijn beschikbaar in Microsoft Foundry on Windows:

| Windows AI APIs | Foundry Local | Windows ML | |

|---|---|---|---|

| Wat is het | Kant-en-klare AI-modellen en API's voor verschillende taaktypen, geoptimaliseerd voor Copilot+ pc's | Kant-en-klare LLM's en spraak-naar-tekstmodellen | ONNX Runtime framework voor het uitvoeren van modellen die u vindt of traint |

| Ondersteunde apparaten | Copilot+ pc's | Windows 10 en hoger pc's en platformoverschrijdend (Prestaties variëren op basis van beschikbare hardware, niet op alle beschikbare modellen) |

Windows 10 en latere versies van pc's, en is platformonafhankelijk via open-source ONNX Runtime (Prestaties variëren op basis van beschikbare hardware) |

| Beschikbare modeltypen en API's |

LLM Afbeeldingsbeschrijving Afbeelding voorgrondextractor Beeldgeneratie Afbeeldingsobject wissen Extractor van afbeeldingsobject Superresolutie van afbeelding Semantisch zoeken Tekstherkenning (OCR) Video Super Resolutie |

LLM's (meerdere) spraak-naar-tekst Bladeren door meer dan 20 beschikbare modellen |

Uw eigen modellen zoeken of trainen |

| Modeldistributie | Gehost door Microsoft, verkregen tijdens runtime en gedeeld tussen apps | Gehost door Microsoft, verkregen tijdens runtime en gedeeld tussen apps | Distributie die wordt verwerkt door uw app (app-bibliotheken kunnen modellen delen tussen apps) |

| Meer informatie | De AI APIs documenten lezen | De Foundry Local documenten lezen | De Windows ML documenten lezen |

Microsoft Foundry on Windows bevat ook hulpprogramma's voor ontwikkelaars, zoals Foundry Toolkit voor Visual Studio Code en AI Dev Gallery waarmee u ai-mogelijkheden kunt bouwen.

Foundry Toolkit voor Visual Studio Code is een VS Code-extensie waarmee u AI-modellen lokaal kunt downloaden en uitvoeren, inclusief toegang tot hardwareversnelling voor betere prestaties en schaal via DirectML. De Foundry Toolkit kan u ook helpen met:

- Test modellen in een intuïtieve speeltuin of in uw toepassing met een REST API.

- Verfijn uw AI-model, zowel lokaal als in de cloud (op een virtuele machine) om nieuwe vaardigheden te creëren, de betrouwbaarheid van reacties te verbeteren, de toon en indeling van het antwoord in te stellen.

- Het fijn afstemmen van populaire kleine taalmodellen (SLM's), zoals Phi-3 en Mistral.

- Implementeer uw AI-functie in de cloud of met een toepassing die op een apparaat wordt uitgevoerd.

- Gebruik hardwareversnelling voor betere prestaties met AI-functies met DirectML. DirectML is een API op laag niveau waarmee uw Windows apparaathardware de prestaties van ML-modellen kan versnellen met behulp van de GPU of NPU van het apparaat. DirectML koppelen met de ONNX Runtime is doorgaans de eenvoudigste manier voor ontwikkelaars om hardwareversnelde AI op schaal aan hun gebruikers te brengen. Meer informatie: DirectML-overzicht.

- Een model kwantiseren en valideren voor gebruik op NPU met behulp van de mogelijkheden voor modelconversie

Ideeën voor het gebruik van lokale AI

Een aantal manieren waarop Windows apps gebruikmaken van lokale AI om hun functionaliteit en gebruikerservaring te verbeteren, zijn onder andere:

- Apps kunnen Generatieve AI LLM-modellen gebruiken om complexe onderwerpen te begrijpen die u kunt samenvatten, herschrijven, rapporteren of uitbreiden.

- Apps kunnen LLM-modellen gebruiken om vrije inhoud te transformeren in een gestructureerde indeling die uw app kan begrijpen.

- Apps kunnen Semantic Search-modellen gebruiken waarmee gebruikers inhoud kunnen zoeken op betekenis en snel gerelateerde inhoud kunnen vinden.

- Apps kunnen modellen voor natuurlijke taalverwerking gebruiken om redeneren boven complexe vereisten voor natuurlijke taal en acties plannen en uitvoeren om de vraag van de gebruiker te bereiken.

- Apps kunnen modellen voor het bewerken van afbeeldingen gebruiken om afbeeldingen intelligent te wijzigen, onderwerpen te wissen of toe te voegen, op te schalen of nieuwe inhoud te genereren.

- Apps kunnen voorspellende diagnostische modellen gebruiken om problemen te identificeren en te voorspellen en om de gebruiker te helpen of het voor hen te doen.

Cloud AI-modellen gebruiken

Als het gebruik van lokale AI-functies niet het juiste pad voor u is, kan het gebruik van Cloud AI-modellen en -resources een oplossing zijn.

Verantwoorde AI-procedures gebruiken

Wanneer u AI-functies in uw Windows-app opneemt, raden we zeer aan de Ontwikkeling van verantwoorde generatieve AI-toepassingen en -functies voor Windows richtlijnen te volgen.