Monitorar o OpenAI do Azure

Este artigo descreve:

- Os tipos de dados de monitoramento que você pode coletar para esse serviço.

- Maneiras de analisar esses dados.

Observação

Se já estiver familiarizado com esse serviço e/ou com o Azure Monitor e apenas quiser saber como analisar os dados de monitoramento, confira a seção Analisar ao final deste artigo.

Quando seus aplicativos e processos de negócios críticos dependem de recursos do Azure, você precisa monitorar e receber alertas para o seu sistema. O serviço do Azure Monitor coleta e agrega métricas e logs de cada componente do seu sistema. O Azure Monitor lhe fornece uma exibição da disponibilidade, desempenho e resiliência e notifica você em caso de problemas. Você pode usar o portal do Azure, o PowerShell, a CLI do Azure, a API REST ou as bibliotecas de cliente para configurar e exibir dados de monitoramento.

- Para obter mais informações sobre o Azure Monitor, confira a Visão geral do Azure Monitor.

- Para obter mais informações sobre como monitorar os recursos do Azure de modo geral, confira Monitorar os recursos do Azure com o Azure Monitor.

Dashboards

O Azure OpenAI fornece painéis prontos para cada um dos recursos do Azure OpenAI. Para acessar a entrada dos painéis de monitoramento no https://portal.azure.com e selecione o painel de visão geral de um dos recursos do Azure OpenAI.

Os painéis são agrupados em quatro categorias: Solicitações HTTP, Uso Baseado em Tokens, Utilização de PTU e Ajuste Fino.

Coleta e roteamento de dados no Azure Monitor

O OpenAI do Azure coleta os mesmos tipos de dados de monitoramento que outros recursos do Azure. Você pode configurar o Azure Monitor para gerar dados em logs de atividades, logs de recursos, logs de máquina virtual e métricas de plataforma. Para saber mais, consulte Monitoramento de dados de recursos do Azure`.

As métricas de plataforma e o log de atividades são do Azure Monitor são coletados e armazenados automaticamente. Esses dados podem ser roteados para outros locais usando uma configuração de diagnóstico. Os logs de recursos do Azure Monitor não são coletados e armazenados até que você crie uma configuração de diagnóstico e roteie os logs para uma ou mais localizações.

Ao criar uma configuração de diagnóstico, você especifica quais categorias de logs coletar. Para mais informações sobre como criar uma configuração de diagnóstico usando o portal do Azure, a CLI do Azure ou o PowerShell, confira Criar uma configuração de diagnóstico para coletar logs e métricas de plataforma no Azure.

Lembre-se de que usar as configurações de diagnóstico e enviar dados para os Logs do Azure Monitor gera alguns custos adicionais. Para obter mais informações, confira Cálculos e opções de custo dos Logs do Azure Monitor.

As métricas e logs que você pode coletar são discutidos nas seções a seguir.

Tipos de recurso

O Azure usa o conceito de tipos de recursos e IDs para identificar tudo em uma assinatura. Os tipos de recurso também fazem parte das IDs de recursos para cada recurso em execução no Azure. Por exemplo, um tipo de recurso para uma máquina virtual é Microsoft.Compute/virtualMachines. Para obter uma lista de serviços e os tipos de recursos associados a eles, confira Provedores de recursos.

O Azure Monitor organiza os principais dados de monitoramento de maneira similar em métricas e logs com base em tipos de recursos, também chamados de namespaces. Métricas e logs diferentes estão disponíveis para diferentes tipos de recursos. Seu serviço pode estar associado a mais de um tipo de recurso.

Para obter mais informações sobre os tipos de recursos do OpenAI do Azure, consulte Referência de dados de monitoramento do OpenAI do Azure.

Armazenamento de dados

Para o Azure Monitor:

- Os dados de métricas são armazenados no banco de dados de métricas do Azure Monitor.

- Os dados de log são armazenados no repositório de logs do Azure Monitor. O Log Analytics é uma ferramenta no portal do Azure que pode consultar esse repositório.

- O log de atividades do Azure é um repositório separado com uma interface própria no portal do Azure.

Opcionalmente, você pode rotear dados de log de métricas e atividades para o armazenamento de logs do Azure Monitor. Em seguida, você pode usar o Log Analytics para consultar os dados e correlacioná-los com outros dados de log.

Muitos serviços podem usar configurações de diagnóstico para enviar dados de métricas e logs para outros locais de armazenamento fora do Azure Monitor. Os exemplos incluem o Armazenamento do Azure, sistemas de parceiros hospedados e sistemas de parceiros não Azure, usando Hubs de Eventos.

Para obter informações detalhadas sobre como o Azure Monitor armazena dados, confira Plataforma de dados do Azure Monitor.

Métricas de plataforma do Azure Monitor

O Azure Monitor fornece métricas de plataforma para a maioria dos serviços. Essas métricas são:

- Definidas individualmente para cada namespace.

- Armazenadas no banco de dados de métricas da série temporal do Azure Monitor.

- Leves e capazes de dar suporte a alertas quase em tempo real.

- Usadas para acompanhar o desempenho de um recurso ao longo do tempo.

Coleta: O Azure Monitor coleta as métricas da plataforma automaticamente. Nenhuma configuração é necessária.

Roteamento: Você também pode rotear métricas de plataforma para o Azure Monitor Logs/Log Analytics para que possa consultá-las com outros dados de log. Para obter mais informações, confira a Configuração de diagnóstico de métricas. Para saber como definir as configurações de diagnóstico para um serviço, confira Criar configurações de diagnóstico no Azure Monitor.

Para obter uma lista de todas as métricas que é possível coletar para todos os recursos no Azure Monitor, confira Métricas com suporte no Azure Monitor.

O OpenAI do Azure tem uma semelhança com um subconjunto dos Serviços de IA do Azure. Para obter uma lista das métricas disponíveis para o OpenAI do Azure, confira Referência de dados de monitoramento do OpenAI do Azure.

Logs de recursos do Azure Monitor

Os logs de recursos fornecem insights sobre as operações que foram executadas por um recurso do Azure. Os logs são gerados automaticamente, mas você precisa encaminhá-los para os logs do Azure Monitor para serem salvos ou consultados. Os logs são organizados em categorias. Um determinado namespace pode ter várias categorias de logs de recursos.

Coleta: Os logs de recursos não serão coletados nem armazenados enquanto você não criar uma configuração de diagnóstico e encaminhar os logs para um ou mais locais. Ao criar uma configuração de diagnóstico, você especifica quais categorias de logs coletar. Há várias maneiras de criar e manter configurações de diagnóstico, incluindo o portal do Azure, programaticamente e por meio do Azure Policy.

Encaminhamento: O padrão sugerido é encaminhar os logs de recursos para os logs do Azure Monitor para que você possa consultá-los com outros dados de logs. Também estão disponíveis outros locais, como o Armazenamento do Microsoft Azure, os Hubs de Eventos do Azure e determinados parceiros de monitoramento da Microsoft. Para obter mais informações, confira Logs de recursos do Azure e Destinos de logs de recursos.

Para obter informações detalhadas sobre como coletar, armazenar e encaminhar logs de recursos, confira Configurações de diagnóstico no Azure Monitor.

Para obter uma lista de todas as categorias de logs de recursos disponíveis no Azure Monitor, confira Logs de recursos com suporte no Azure Monitor.

Todos os logs de recursos no Azure Monitor têm os mesmos campos de cabeçalho, seguidos de campos específicos do serviço. O esquema comum está descrito em Esquema do log de recursos do Azure Monitor.

Para exibir as categorias de log de recursos disponíveis, suas tabelas do Log Analytics associadas e os esquemas de logs do OpenAI do Azure, confira Referência de dados de monitoramento do OpenAI do Azure.

Log de atividades do Azure

O log de atividades contém eventos de nível de assinatura que acompanham as operações de cada recurso do Azure, conforme visto fora desse recurso, por exemplo, criar um recurso ou iniciar uma máquina virtual.

Coleta: Os eventos do log de Atividades são gerados e coletados automaticamente em um repositório separado para serem vistos no portal do Azure.

Roteamento: você pode enviar dados de log de atividades para os logs do Azure Monitor para analisá-los junto com outros dados de log. Também estão disponíveis outros locais, como o Armazenamento do Microsoft Azure, os Hubs de Eventos do Azure e determinados parceiros de monitoramento da Microsoft. Para obter mais informações sobre como encaminhar o log de atividades, confira Visão geral do log de atividades do Azure.

Analisar dados de monitoramento

Existem várias ferramentas para analisar os dados de monitoramento.

Ferramentas do Azure Monitor

O Azure Monitor dá suporte às seguintes ferramentas básicas:

Explorador de Métricas, uma ferramenta no portal do Azure que permite que você veja e analise as métricas de recursos do Azure. Para obter mais informações sobre essa ferramenta, consulte Analisar métricas com o explorador de métricas do Azure Monitor.

Log Analytics, uma ferramenta no portal do Azure que permite consultar e analisar dados de log usando o KQL (Linguagem de Consulta Kusto). Para obter mais informações, consulte Introdução às consultas de log no Azure Monitor.

O log de atividades, que tem uma interface do usuário no portal do Azure para exibição e pesquisas básicas. Para fazer uma análise mais detalhada, você precisa encaminhar os dados para os logs do Azure Monitor e executar consultas mais complexas no Log Analytics.

As ferramentas que permitem uma visualização mais complexa incluem:

- Painéis, que permitem que você combine diferentes tipos de dados em um único painel no portal do Azure.

- Pastas de Trabalho, relatórios personalizáveis que você pode criar no portal do Azure. As pastas de trabalho podem incluir texto, métricas e consultas de log.

- Grafana, uma ferramenta de plataforma aberta que oferece excelência em termos de painéis operacionais. Você pode usar o Grafana para criar painéis que incluem dados de várias fontes além do Azure Monitor.

- Power BI, um serviço de análises corporativas que fornece visualizações interativas nas diversas fontes de dados. Você pode configurar o Power BI para importar dados de log automaticamente do Azure Monitor a fim de aproveitar essas visualizações.

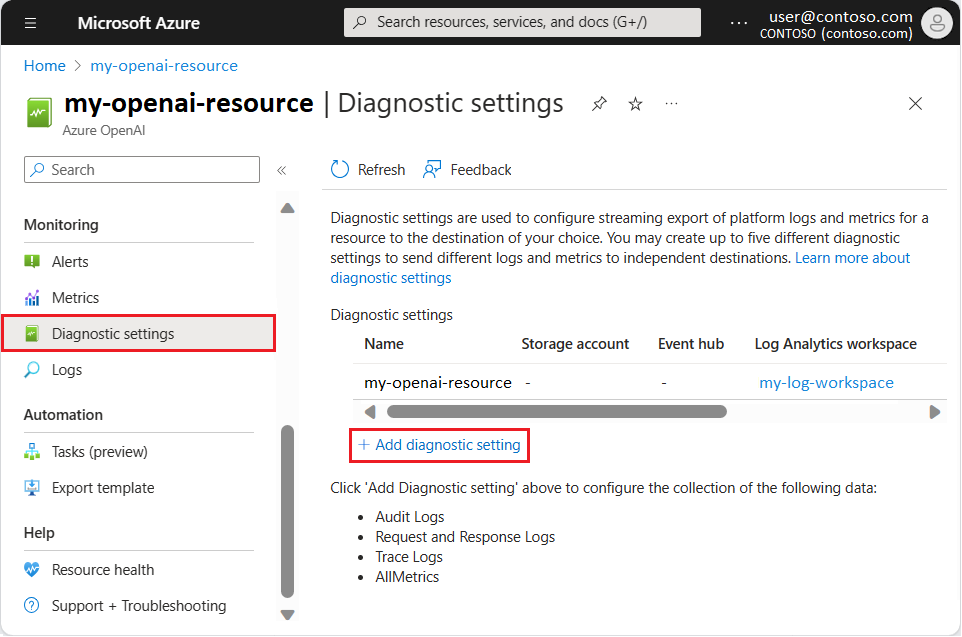

Defina as configurações de diagnóstico

Todas as métricas são exportáveis com configurações de diagnóstico no Azure Monitor. Para analisar logs e dados de métricas com consultas do Log Analytics do Azure Monitor, você precisa definir as configurações de diagnóstico para o seu recurso do OpenAI do Azure e seu workspace do Log Analytics.

Depois de definir as configurações de diagnóstico, você pode trabalhar com métricas e dados de log para o recurso do OpenAI do Azure no seu workspace do Log Analytics.

Ferramentas de exportação do Azure Monitor

Você pode obter dados do Azure Monitor em outras ferramentas usando os seguintes métodos:

Métricas: Use a API REST para métricas para extrair dados de métricas do banco de dados de métricas do Azure Monitor. A API dá suporte a expressões de filtros para refinar os dados recuperados. Para obter mais informações, confira Referência da API REST do Azure Monitor.

Logs: Use a API REST ou as bibliotecas de cliente associadas.

Outra opção é a exportação de dados do workspace.

Para começar a usar a API REST do Azure Monitor, confira o Passo a passo da API REST de monitoramento do Azure.

Consultas do Kusto

Analise os dados de monitoramento nos logs do Azure Monitor/no repositório do Log Analytics usando o KQL (Linguagem de Consulta Kusto).

Importante

Quando você seleciona Logs no menu do serviço no portal, o Log Analytics é aberto com o escopo da consulta definido para o serviço atual. Esse escopo significa que as consultas de log incluirão apenas dados desse tipo de recurso. Se você quiser executar uma consulta que inclua dados de outros serviços do Azure, selecione Logs no menu do Azure Monitor. Confira Escopo da consulta de log e intervalo de tempo no Log Analytics do Azure Monitor para obter detalhes.

Para obter uma lista de consultas comuns para qualquer serviço, confira a Interface de consultas do Log Analytics.

Depois de implantar um modelo do OpenAI do Azure, você pode enviar algumas chamadas de conclusão usando o ambiente playground no Estúdio de IA do Azure.

Qualquer texto inserido no playground de conclusões ou no playground de conclusões de chat gera métricas e dados de log para o recurso do OpenAI do Azure. No workspace do Log Analytics para seu recurso, você pode consultar os dados de monitoramento usando a linguagem de consulta Kusto.

Importante

A opção Abrir consulta na página de recursos do OpenAI do Azure navega até o Azure Resource Graph, o que não está descrito neste artigo. As consultas a seguir usam o ambiente de consulta do Log Analytics. Siga as etapas em Definir configurações de diagnóstico para preparar seu workspace do Log Analytics.

Na página do seu recurso do Azure OpenAI, em Monitoramento no painel esquerdo, selecione Logs.

Selecione o workspace do Log Analytics que você configurou com diagnóstico para o recurso do OpenAI do Azure.

Na página workspace do Log Analytics, em Visão geral no painel esquerdo, selecione Logs.

O portal do Azure exibe uma janela Consultas com exemplos de consultas e sugestões por padrão. Você pode fechar esta janela.

Para os exemplos a seguir, insira a consulta Kusto na região de edição na parte superior da janela Consulta e selecione Executar. Os resultados da consulta são exibidos abaixo do texto dela.

A seguinte consulta Kusto é útil para uma análise inicial de dados do Diagnóstico do Azure (AzureDiagnostics) sobre seu recurso:

AzureDiagnostics

| take 100

| project TimeGenerated, _ResourceId, Category, OperationName, DurationMs, ResultSignature, properties_s

Esta consulta retorna uma amostra de 100 entradas e exibe um subconjunto das colunas de dados disponíveis nos logs. Você também pode selecionar a seta ao lado do nome da tabela para exibir todas as colunas disponíveis e os tipos de dados associados a elas.

Para ver todas as colunas de dados disponíveis, você pode remover a linha | project ... de parâmetros do escopo da consulta:

AzureDiagnostics

| take 100

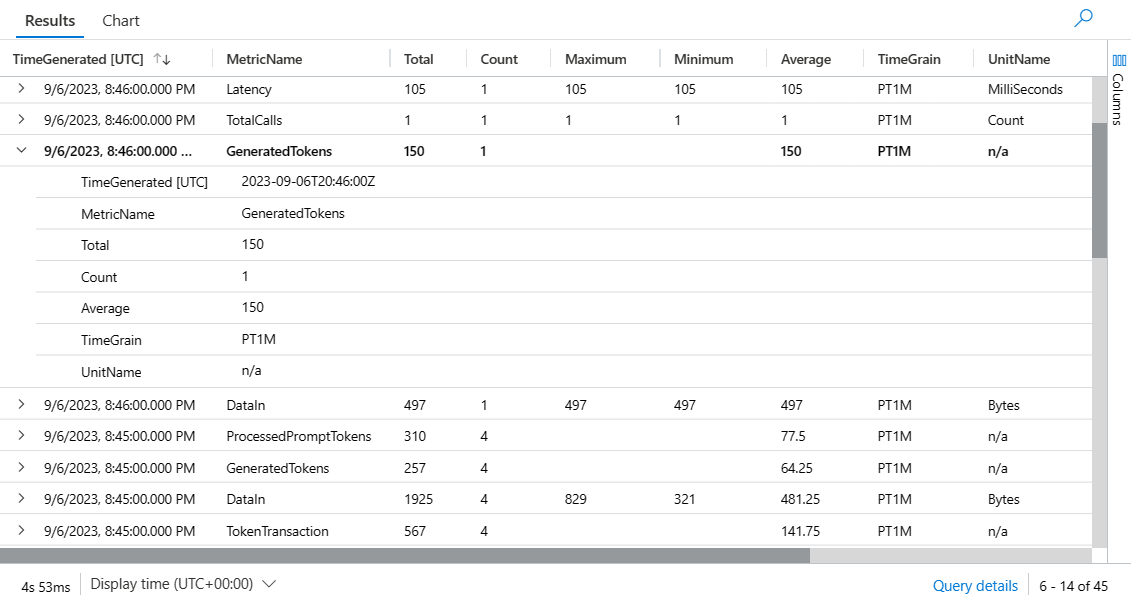

Para examinar os dados das Métricas do Azure (AzureMetrics) para seu recurso, execute a seguinte consulta:

AzureMetrics

| take 100

| project TimeGenerated, MetricName, Total, Count, Maximum, Minimum, Average, TimeGrain, UnitName

A consulta retorna um exemplo de 100 entradas e exibe um subconjunto das colunas disponíveis dos dados das Métricas do Azure:

Observação

Quando você seleciona Monitoramento>Logs no menu do OpenAI do Azure para o seu recurso, o Log Analytics abre com o escopo da consulta definido para o recurso atual. As consultas de log visíveis incluem dados somente desse recurso específico. Se quiser executar uma consulta que inclua dados de outros recursos ou dados de outros serviços do Azure, selecione Logs no menu Azure Monitor no portal do Azure. Para obter mais informações, confira o Escopo da consulta de log e o intervalo de tempo no Log Analytics do Azure Monitor para detalhes.

Alertas

Os alertas do Azure Monitor o notificam proativamente quando condições específicas são encontradas em seus dados de monitoramento. Os alertas permitem que você identifique e resolva problemas no seu sistema antes que os clientes os percebam. Para saber mais, confira Alertas do Azure Monitor.

Existem muitas fontes de alertas comuns para os recursos do Azure. Para obter exemplos de alertas comuns para recursos do Azure, confira Amostra de consultas de alerta de logs. O site Alertas de Linha de Base do Azure Monitor (AMBA) fornece um método semiautomatizado de implementação de alertas, painéis e diretrizes importantes de métrica de plataforma. O site se aplica a um subconjunto de serviços do Azure em contínua expansão, incluindo todos os serviços que fazem parte da Zona de Destino do Azure (ALZ).

O esquema de alerta comum padroniza a consumo do Azure Monitor para notificações de alerta no Azure. Para obter mais informações, confira Esquema de alertas comuns.

Tipos de alertas

Você pode receber alertas sobre qualquer fonte de dados de log ou métrica na plataforma de dados do Azure Monitor. Existem muitos tipos diferentes de alertas dependendo dos serviços que você está monitorando e dos dados de monitoramento que você está coletando. Diferentes tipos de alertas têm diversos benefícios e desvantagens. Para obter mais informações, confira Escolha o tipo de alerta de monitoramento correto para você.

A lista a seguir descreve os tipos de alertas do Azure Monitor que você pode criar:

- Os Alertas de métricas avaliam as métricas de recursos a intervalos regulares. As métricas podem ser métricas de plataforma, métricas personalizadas, logs do Azure Monitor convertidos em métricas ou métricas do Application Insights. Os alertas de métrica também podem aplicar várias condições e limites dinâmicos.

- Os Alertas de logs permitem que os usuários usem uma consulta do Log Analytics para avaliar os logs de recursos com uma frequência predefinida.

- Os Alertas do log de atividades são disparados quando ocorre um novo evento de log de atividades que corresponda às condições definidas. Os alertas do Resource Health e da Integridade do Serviço são alertas do log de atividades que relatam a integridade do serviço e do recurso.

Alguns serviços do Azure também dão suporte a alertas de detecção inteligentes, alertas do Prometheus ou regras de alerta recomendadas.

No caso de alguns serviços, você pode monitorar em larga escala aplicando a mesma regra de alerta de métricas a vários recursos do mesmo tipo que existem na mesma região do Azure. Notificações individuais são enviadas para cada recurso monitorado. Para ver os serviços e as nuvens do Azure com suporte, confira Monitorar vários recursos com uma regra de alerta.

Configurar alertas

As necessidades de alerta de cada organização variam e podem mudar ao longo do tempo. Geralmente, todos os alertas devem ser acionáveis e exigir uma resposta específica caso ocorram. Se um alerta não exigir uma resposta imediata, a condição poderá ser capturada em um relatório em vez de um alerta. Alguns casos de uso podem exigir alertas sempre que determinadas condições de erro ocorrerem. Em outros casos, talvez você precise de alertas para erros que excedam um determinado limite para um período designado.

Erros que ficam abaixo de determinados limites geralmente podem ser avaliados por meio da análise regular de dados nos Logs do Azure Monitor. Ao analisar seus dados de log ao longo do tempo, você pode descobrir que uma determinada condição não ocorre por um período esperado. Você pode acompanhar essa condição usando alertas. Às vezes, a ausência de um evento no log é um sinal de erro tão importante quanto uma entrada explícita no log.

Dependendo do tipo de aplicativo que você está desenvolvendo em conjunto com o uso do OpenAI do Azure, o Application Insights do Azure Monitor pode oferecer benefícios adicionais de monitoramento na camada do aplicativo.

Regras de alerta do OpenAI do Azure

Você pode definir alertas para qualquer métrica, entrada de log ou entrada de log de atividades listada na Referência de dados de monitoramento do OpenAI do Azure.

Recomendações do Assistente

Para alguns serviços, se ocorrerem condições críticas ou alterações iminentes durante operações de recurso, um alerta será exibido na página de Visão geral do serviço no portal. Você pode encontrar mais informações e correções recomendadas para o alerta nas Recomendações do assistente em Monitoramento no menu à esquerda. Durante as operações normais, nenhuma recomendação do assistente será exibida.

Para obter mais informações sobre o Assistente do Azure, confira Visão geral do Assistente do Azure.

Conteúdo relacionado

- Confira Referência de dados de monitoramento do Aplicativo para obter uma referência de métricas, logs e outros valores importantes criados para o OpenAI do Azure.

- Confira Como monitorar recursos do Azure com o Azure Monitor para obter detalhes gerais sobre o monitoramento de recursos do Azure.

- Leia sobre logs em Noções básicas sobre pesquisas de logs nos logs do Azure Monitor.