Dados, privacidade e segurança para uso de modelos por meio do catálogo de modelos no portal do Azure AI Foundry

Importante

Os itens marcados (visualização) neste artigo estão atualmente em visualização pública. Essa visualização é fornecida sem um contrato de nível de serviço e não a recomendamos para cargas de trabalho de produção. Algumas funcionalidades poderão não ser suportadas ou poderão ter capacidades limitadas. Para obter mais informações, veja Termos Suplementares de Utilização para Pré-visualizações do Microsoft Azure.

Este artigo descreve como os dados fornecidos são processados, usados e armazenados quando você implanta modelos do catálogo de modelos. Consulte também o Adendo de Proteção de Dados dos Produtos e Serviços da Microsoft, que rege o processamento de dados pelos serviços do Azure.

Importante

Para obter informações sobre IA responsável no Azure OpenAI e serviços de IA, consulte Uso responsável de IA.

Quais dados são processados para modelos implantados no portal do Azure AI Foundry?

Quando você implanta modelos no portal do Azure AI Foundry, os seguintes tipos de dados são processados para fornecer o serviço:

Prompts e conteúdo gerado. Um usuário envia um prompt e o modelo gera conteúdo (saída) por meio das operações suportadas pelo modelo. Os prompts podem incluir conteúdo adicionado por meio de geração aumentada de recuperação (RAG), metaprompts ou outras funcionalidades incluídas em um aplicativo.

Dados carregados. Para modelos que suportam ajuste fino, os clientes podem carregar seus dados em um armazenamento de dados para ajuste fino.

Geração de saídas de inferência com computação gerenciada

A implantação de modelos para computação gerenciada implanta pesos de modelo em máquinas virtuais dedicadas e expõe uma API REST para inferência em tempo real. Para saber mais sobre como implantar modelos do catálogo de modelos para computação gerenciada, consulte Catálogo e coleções de modelos no portal do Azure AI Foundry.

Você gerencia a infraestrutura para esses recursos de computação gerenciados. Aplicam-se os compromissos de dados, privacidade e segurança do Azure. Para saber mais sobre as ofertas de conformidade do Azure aplicáveis ao Azure AI Foundry, consulte a página Ofertas de conformidade do Azure.

Embora os contêineres para modelos de IA do Azure sejam verificados em busca de vulnerabilidades que possam exfiltrar dados, nem todos os modelos disponíveis no catálogo de modelos são verificados. Para reduzir o risco de exfiltração de dados, você pode ajudar a proteger sua implantação usando redes virtuais. Você também pode usar a Política do Azure para regular os modelos que seus usuários podem implantar.

Geração de saídas de inferência como uma API sem servidor

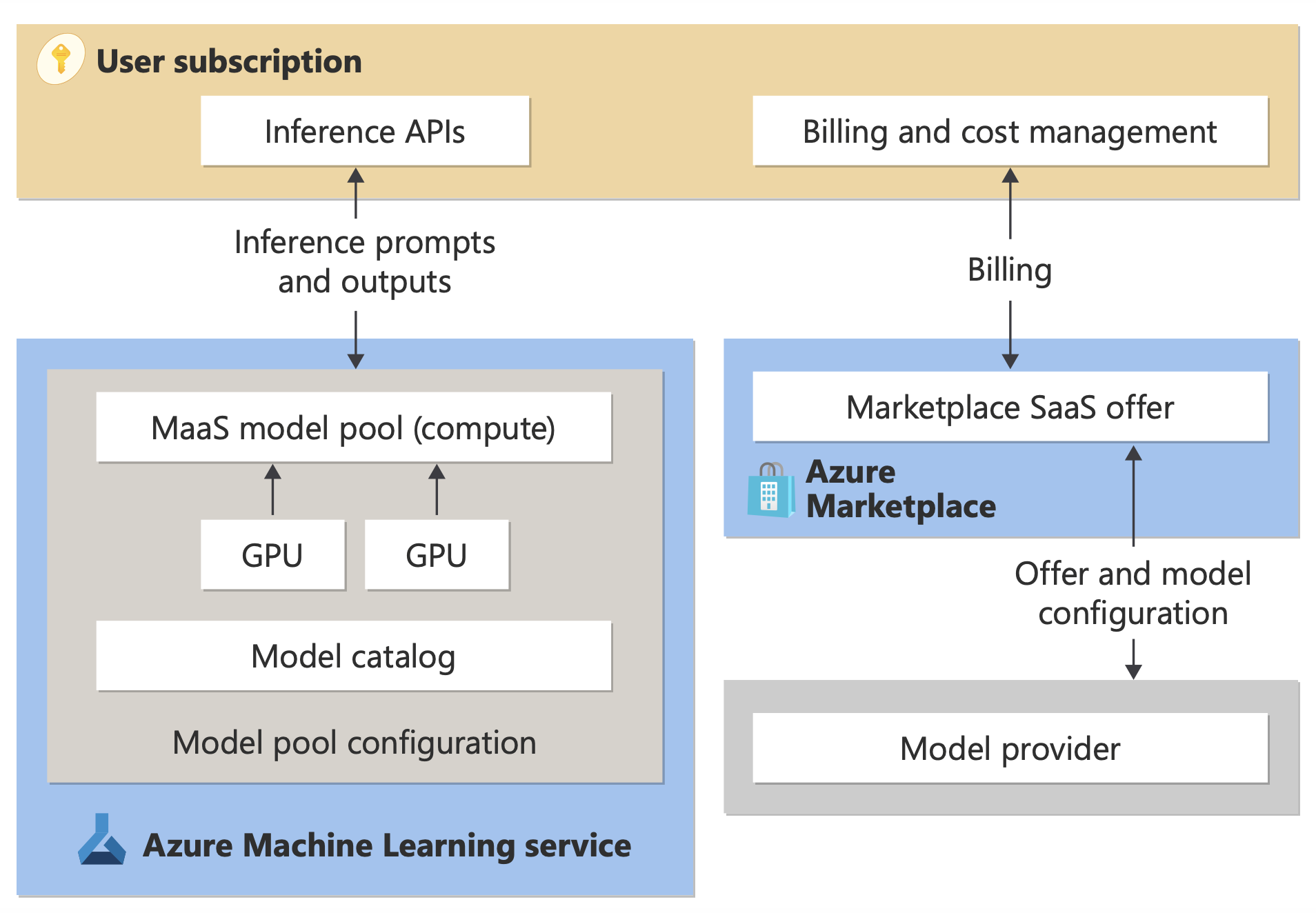

Quando você implanta um modelo do catálogo de modelos (base ou ajustado) usando APIs sem servidor com cobrança paga conforme o uso para inferência, uma API é provisionada. A API dá-lhe acesso ao modelo que o serviço Azure Machine Learning aloja e gere. Saiba mais sobre APIs sem servidor em Catálogo e coleções de modelos.

O modelo processa seus prompts de entrada e gera saídas com base em sua funcionalidade, conforme descrito nos detalhes do modelo. Seu uso do modelo (juntamente com a responsabilidade do provedor pelo modelo e suas saídas) está sujeito aos termos de licença para o modelo. A Microsoft fornece e gerencia a infraestrutura de hospedagem e o ponto de extremidade da API. Os modelos hospedados neste cenário de modelo como serviço (MaaS) estão sujeitos aos compromissos de dados, privacidade e segurança do Azure. Saiba mais sobre as ofertas de conformidade do Azure aplicáveis ao Azure AI Foundry.

A Microsoft atua como o processador de dados para prompts e saídas enviadas e geradas por um modelo implantado para inferência de pagamento conforme o uso (MaaS). A Microsoft não compartilha esses prompts e saídas com o provedor do modelo. Além disso, a Microsoft não usa esses prompts e saídas para treinar ou melhorar os modelos da Microsoft, os modelos do provedor de modelos ou os modelos de terceiros.

Os modelos são sem monitoração de estado e não armazenam prompts ou saídas. Se a filtragem de conteúdo (visualização) estiver habilitada, o serviço Azure AI Content Safety exibirá prompts e saídas para determinadas categorias de conteúdo prejudicial em tempo real. Saiba mais sobre como o Azure AI Content Safety processa dados.

Os prompts e saídas são processados dentro da geografia especificada durante a implantação, mas podem ser processados entre regiões dentro da geografia para fins operacionais. As finalidades operacionais incluem a gestão do desempenho e da capacidade.

Nota

Conforme explicado durante o processo de implantação do MaaS, a Microsoft pode compartilhar informações de contato do cliente e detalhes da transação (incluindo o volume de uso associado à oferta) com o editor do modelo para que o editor possa entrar em contato com os clientes sobre o modelo. Saiba mais sobre as informações disponíveis para editores de modelos em Access insights para o mercado comercial da Microsoft no Partner Center.

Ajuste fino de um modelo para implantação pré-paga conforme o uso (MaaS)

Se um modelo disponível para APIs sem servidor oferecer suporte a ajuste fino, você poderá carregar dados para (ou designar dados já em) um armazenamento de dados para ajustar o modelo. Em seguida, você pode criar uma implantação de API sem servidor para o modelo ajustado. O modelo ajustado não pode ser baixado, mas:

- Está disponível exclusivamente para seu uso.

- Você pode usar criptografia dupla em repouso: a criptografia padrão Microsoft AES-256 e uma chave opcional gerenciada pelo cliente.

- Você pode excluí-lo a qualquer momento.

Os dados de treinamento carregados para ajuste fino não são usados para treinar, treinar novamente ou melhorar qualquer modelo da Microsoft ou não, exceto quando você direciona essas atividades dentro do serviço.

Processamento de dados para modelos descarregados

Se você baixar um modelo do catálogo de modelos, escolherá onde implantá-lo. Você é responsável por como os dados são processados quando você usa o modelo.