Nota

O acesso a esta página requer autorização. Pode tentar iniciar sessão ou alterar os diretórios.

O acesso a esta página requer autorização. Pode tentar alterar os diretórios.

APLICA-SE A:  Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Gorjeta

Experimente o Data Factory no Microsoft Fabric, uma solução de análise tudo-em-um para empresas. O Microsoft Fabric abrange tudo, desde a movimentação de dados até ciência de dados, análises em tempo real, business intelligence e relatórios. Saiba como iniciar uma nova avaliação gratuitamente!

Este artigo descreve como copiar dados do armazenamento compatível com o Amazon Simple Storage Service (Amazon S3). Para saber mais, leia os artigos introdutórios do Azure Data Factory e do Synapse Analytics.

Capacidades suportadas

Esse conector de armazenamento compatível com o Amazon S3 é compatível com os seguintes recursos:

| Capacidades suportadas | IR |

|---|---|

| Atividade de cópia (fonte/-) | (1) (2) |

| Atividade de Pesquisa | (1) (2) |

| Atividade GetMetadata | (1) (2) |

| Excluir atividade | (1) (2) |

(1) Tempo de execução de integração do Azure (2) Tempo de execução de integração auto-hospedado

Especificamente, esse conector de armazenamento compatível com o Amazon S3 oferece suporte à cópia de arquivos como estão ou à análise de arquivos com os formatos de arquivo e codecs de compactação suportados. O conector usa o AWS Signature Versão 4 para autenticar solicitações no S3. Você pode usar esse conector de armazenamento compatível com o Amazon S3 para copiar dados de qualquer provedor de armazenamento compatível com o S3. Especifique a URL do serviço correspondente na configuração do serviço vinculado.

Permissões obrigatórias

Para copiar dados do armazenamento compatível com o Amazon S3, verifique se você recebeu as seguintes permissões para operações de objeto do Amazon S3: s3:GetObject e s3:GetObjectVersion.

Se você usar a interface do usuário para criar, permissões s3:ListAllMyBuckets adicionais serão necessárias para s3:ListBucket/s3:GetBucketLocation operações como testar a conexão com o serviço vinculado e navegar a partir da raiz. Se não quiser conceder essas permissões, você pode escolher as opções "Testar conexão com o caminho do arquivo" ou "Procurar a partir do caminho especificado" na interface do usuário.

Para obter a lista completa de permissões do Amazon S3, consulte Especificação de permissões em uma política no site da AWS.

Introdução

Para executar a atividade Copiar com um pipeline, você pode usar uma das seguintes ferramentas ou SDKs:

- A ferramenta Copiar dados

- O portal do Azure

- O SDK do .NET

- O SDK do Python

- Azure PowerShell

- A API REST

- O modelo do Azure Resource Manager

Criar um serviço vinculado ao armazenamento compatível com o Amazon S3 usando a interface do usuário

Use as etapas a seguir para criar um serviço vinculado ao armazenamento compatível com o Amazon S3 na interface do usuário do portal do Azure.

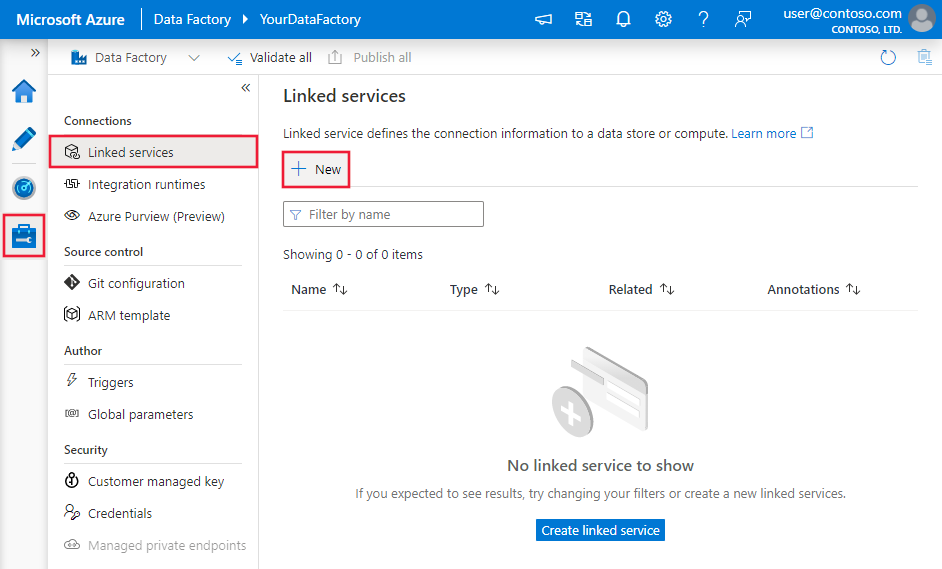

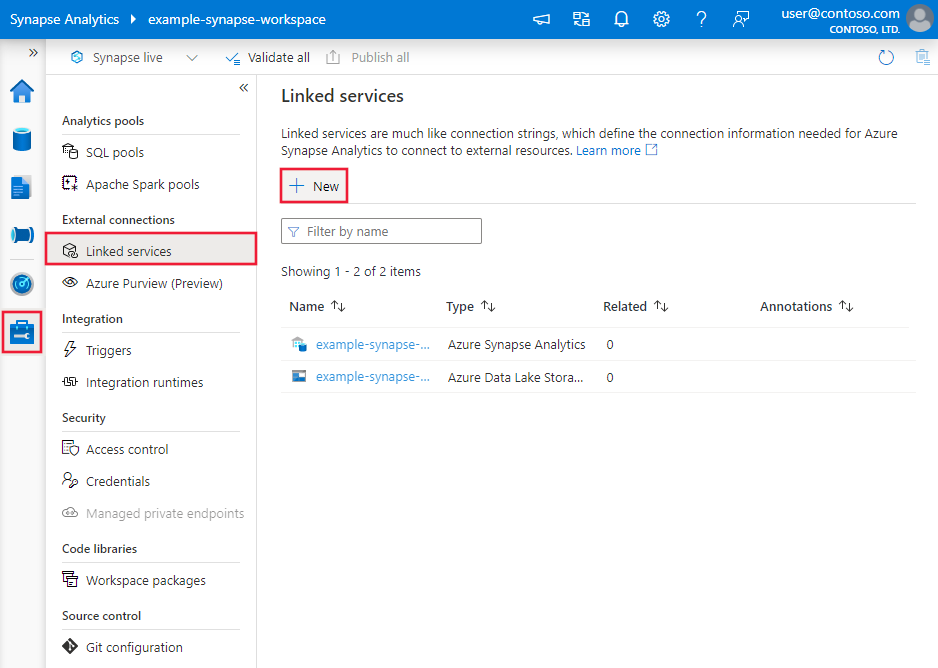

Navegue até a guia Gerenciar em seu espaço de trabalho do Azure Data Factory ou Synapse e selecione Serviços Vinculados e clique em Novo:

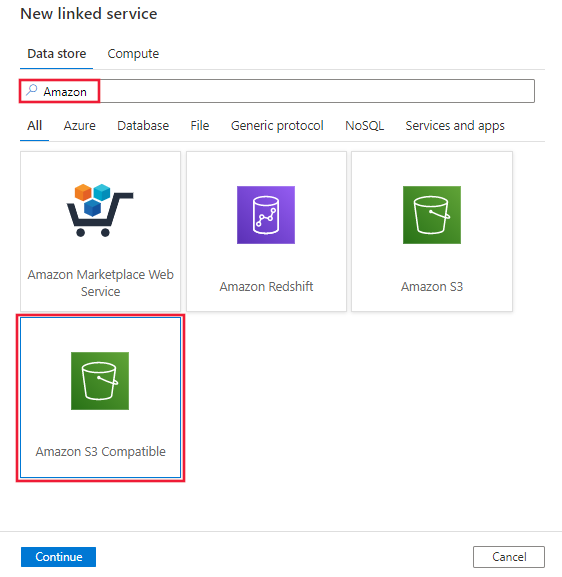

Pesquise por Amazon e selecione o conector de armazenamento compatível com Amazon S3.

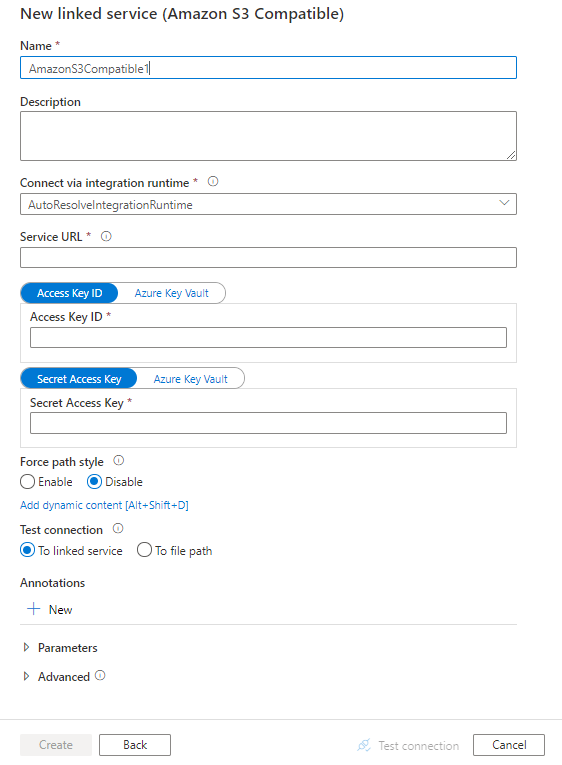

Configure os detalhes do serviço, teste a conexão e crie o novo serviço vinculado.

Detalhes de configuração do conector

As seções a seguir fornecem detalhes sobre as propriedades usadas para definir entidades específicas do armazenamento compatível com o Amazon S3.

Propriedades do serviço vinculado

As seguintes propriedades são compatíveis com um serviço vinculado compatível com o Amazon S3:

| Property | Descrição | Obrigatório |

|---|---|---|

| tipo | A propriedade type deve ser definida como AmazonS3Compatible. | Sim |

| accessKeyId | ID da chave de acesso secreta. | Sim |

| secretAccessKey | A própria chave de acesso secreta. Marque este campo como um SecureString para armazená-lo com segurança ou faça referência a um segredo armazenado no Cofre de Chaves do Azure. | Sim |

| serviceUrl | Especifique o ponto de extremidade https://<service url>personalizado do S3 . |

Não |

| forcePathStyle | Indica se o acesso no estilo de caminho do S3 deve ser usado em vez do acesso no estilo hospedado virtual. Os valores permitidos são: false (default), true. Verifique a documentação de cada armazenamento de dados para saber se o acesso no estilo de caminho é necessário ou não. |

Não |

| ConecteVia | O tempo de execução de integração a ser usado para se conectar ao armazenamento de dados. Você pode usar o tempo de execução de integração do Azure ou o tempo de execução de integração auto-hospedado (se seu armazenamento de dados estiver em uma rede privada). Se essa propriedade não for especificada, o serviço usará o tempo de execução de integração padrão do Azure. | Não |

Exemplo:

{

"name": "AmazonS3CompatibleLinkedService",

"properties": {

"type": "AmazonS3Compatible",

"typeProperties": {

"accessKeyId": "<access key id>",

"secretAccessKey": {

"type": "SecureString",

"value": "<secret access key>"

}

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Propriedades do conjunto de dados

Para obter uma lista completa de seções e propriedades disponíveis para definir conjuntos de dados, consulte o artigo Conjuntos de dados.

O Azure Data Factory suporta os seguintes formatos de ficheiro. Consulte cada artigo para obter as configurações baseadas em formato.

- Formato Avro

- Formato binário

- Formato de texto delimitado

- Formato Excel

- Formato JSON

- Formato ORC

- Formato Parquet

- Formato XML

As seguintes propriedades são compatíveis com o Amazon S3 em location configurações em um conjunto de dados baseado em formato:

| Property | Descrição | Obrigatório |

|---|---|---|

| tipo | A propriedade type em location um conjunto de dados deve ser definida como AmazonS3CompatibleLocation. |

Sim |

| bucketName | O nome do bucket de armazenamento compatível com o S3. | Sim |

| folderPath | O caminho para a pasta sob o bucket fornecido. Se você quiser usar um curinga para filtrar a pasta, ignore essa configuração e especifique isso nas configurações da fonte de atividade. | Não |

| fileName | O nome do arquivo sob o bucket e o caminho da pasta fornecidos. Se você quiser usar um curinga para filtrar arquivos, ignore essa configuração e especifique isso nas configurações da fonte de atividade. | Não |

| versão | A versão do objeto S3 Compatible Storage, se o controle de versão do S3 Compatible Storage estiver habilitado. Se não for especificado, a versão mais recente será buscada. | Não |

Exemplo:

{

"name": "DelimitedTextDataset",

"properties": {

"type": "DelimitedText",

"linkedServiceName": {

"referenceName": "<Amazon S3 Compatible Storage linked service name>",

"type": "LinkedServiceReference"

},

"schema": [ < physical schema, optional, auto retrieved during authoring > ],

"typeProperties": {

"location": {

"type": "AmazonS3CompatibleLocation",

"bucketName": "bucketname",

"folderPath": "folder/subfolder"

},

"columnDelimiter": ",",

"quoteChar": "\"",

"firstRowAsHeader": true,

"compressionCodec": "gzip"

}

}

}

Propriedades da atividade Copy

Para obter uma lista completa de seções e propriedades disponíveis para definir atividades, consulte o artigo Pipelines . Esta seção fornece uma lista de propriedades suportadas pela fonte de armazenamento compatível com o Amazon S3.

Armazenamento compatível com Amazon S3 como tipo de origem

O Azure Data Factory suporta os seguintes formatos de ficheiro. Consulte cada artigo para obter as configurações baseadas em formato.

- Formato Avro

- Formato binário

- Formato de texto delimitado

- Formato Excel

- Formato JSON

- Formato ORC

- Formato Parquet

- Formato XML

As seguintes propriedades são compatíveis com o Amazon S3 Compatible Storage em storeSettings configurações em uma fonte de cópia baseada em formato:

| Property | Descrição | Obrigatório |

|---|---|---|

| tipo | A propriedade type under storeSettings deve ser definida como AmazonS3CompatibleReadSettings. |

Sim |

| Localize os ficheiros a copiar: | ||

| OPÇÃO 1: caminho estático |

Copie do bucket ou caminho de pasta/arquivo especificado no conjunto de dados. Se você quiser copiar todos os arquivos de um bucket ou pasta, especifique wildcardFileName adicionalmente como *. |

|

| OPÇÃO 2: Prefixo de armazenamento compatível com S3 - prefixo |

Prefixo para o nome da chave de armazenamento compatível com o S3 sob o bucket fornecido configurado em um conjunto de dados para filtrar arquivos de armazenamento compatíveis com o S3 de origem. As chaves de armazenamento compatíveis com o S3 cujos nomes começam com bucket_in_dataset/this_prefix são selecionadas. Ele utiliza o filtro do lado do serviço do S3 Compatible Storage, que oferece melhor desempenho do que um filtro curinga.Quando você usa prefixo e opta por copiar para coletor baseado em arquivo com hierarquia de preservação, observe que o subcaminho após o último "/" no prefixo será preservado. Por exemplo, você tem origem bucket/folder/subfolder/file.txte configura o prefixo como folder/sub, então o caminho do arquivo preservado é subfolder/file.txt. |

Não |

| OPÇÃO 3: curinga - wildcardFolderPath |

O caminho da pasta com caracteres curinga sob o bucket fornecido configurado em um conjunto de dados para filtrar pastas de origem. Os curingas permitidos são: * (corresponde a zero ou mais caracteres) e ? (corresponde a zero ou caractere único). Use ^ para escapar se o nome da pasta tiver um curinga ou esse caractere de escape dentro. Veja mais exemplos em Exemplos de filtros de pastas e ficheiros. |

Não |

| OPÇÃO 3: curinga - wildcardFileName |

O nome do arquivo com caracteres curinga sob o bucket e o caminho da pasta fornecidos (ou caminho da pasta curinga) para filtrar os arquivos de origem. Os curingas permitidos são: * (corresponde a zero ou mais caracteres) e ? (corresponde a zero ou caractere único). Use ^ para escapar se o nome do arquivo tiver um curinga ou esse caractere de escape dentro. Veja mais exemplos em Exemplos de filtros de pastas e ficheiros. |

Sim |

| OPÇÃO 4: uma lista de ficheiros - fileListPath |

Indica para copiar um determinado conjunto de arquivos. Aponte para um arquivo de texto que inclua uma lista de arquivos que você deseja copiar, um arquivo por linha, que é o caminho relativo para o caminho configurado no conjunto de dados. Quando estiver usando essa opção, não especifique um nome de arquivo no conjunto de dados. Veja mais exemplos em Exemplos de lista de arquivos. |

Não |

| Configurações adicionais: | ||

| recursiva | Indica se os dados são lidos recursivamente das subpastas ou somente da pasta especificada. Observe que quando recursivo é definido como true e o coletor é um armazenamento baseado em arquivo, uma pasta ou subpasta vazia não é copiada ou criada no coletor. Os valores permitidos são true (padrão) e false. Esta propriedade não se aplica quando você configura fileListPatho . |

Não |

| deleteFilesAfterCompletion | Indica se os arquivos binários serão excluídos do armazenamento de origem depois de serem movidos com êxito para o repositório de destino. A exclusão do arquivo é por arquivo, portanto, quando a atividade de cópia falhar, você verá que alguns arquivos já foram copiados para o destino e excluídos da origem, enquanto outros ainda permanecem no armazenamento de origem. Esta propriedade só é válida no cenário de cópia de arquivos binários. O valor padrão: false. |

Não |

| modifiedDatetimeStart | Os arquivos são filtrados com base no atributo: última modificação. Os arquivos serão selecionados se o tempo da última modificação for maior ou igual a modifiedDatetimeStart e menor que modifiedDatetimeEnd. A hora é aplicada a um fuso horário UTC no formato "2018-12-01T05:00:00Z". As propriedades podem ser NULL, o que significa que nenhum filtro de atributo de arquivo será aplicado ao conjunto de dados. Quando modifiedDatetimeStart tiver um valor datetime, mas modifiedDatetimeEnd for NULL, os arquivos cujo último atributo modificado for maior ou igual ao valor datetime serão selecionados. Quando modifiedDatetimeEnd tiver um valor datetime, mas modifiedDatetimeStart for NULL, os arquivos cujo atributo da última modificação for menor que o valor datetime serão selecionados.Esta propriedade não se aplica quando você configura fileListPatho . |

Não |

| modifiedDatetimeEnd | Mesmo que acima. | Não |

| enablePartitionDiscovery | Para arquivos particionados, especifique se deseja analisar as partições do caminho do arquivo e adicioná-las como colunas de origem adicionais. Os valores permitidos são false (padrão) e true. |

Não |

| partitionRootPath | Quando a descoberta de partições estiver habilitada, especifique o caminho raiz absoluto para ler pastas particionadas como colunas de dados. Se não for especificado, por padrão, - Quando você usa o caminho do arquivo no conjunto de dados ou na lista de arquivos na origem, o caminho da raiz da partição é o caminho configurado no conjunto de dados. - Quando você usa o filtro de pasta curinga, o caminho da raiz da partição é o subcaminho antes do primeiro curinga. - Quando você usa prefixo, o caminho raiz da partição é sub-caminho antes do último "/". Por exemplo, supondo que você configure o caminho no conjunto de dados como "root/folder/year=2020/month=08/day=27": - Se você especificar o caminho da raiz da partição como "root/folder/year=2020", a atividade de cópia gerará mais duas colunas month e day com o valor "08" e "27", respectivamente, além das colunas dentro dos arquivos.- Se o caminho raiz da partição não for especificado, nenhuma coluna extra será gerada. |

Não |

| maxConcurrentConnections | O limite superior de conexões simultâneas estabelecidas para o armazenamento de dados durante a execução da atividade. Especifique um valor somente quando quiser limitar conexões simultâneas. | Não |

Exemplo:

"activities":[

{

"name": "CopyFromAmazonS3CompatibleStorage",

"type": "Copy",

"inputs": [

{

"referenceName": "<Delimited text input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "DelimitedTextSource",

"formatSettings":{

"type": "DelimitedTextReadSettings",

"skipLineCount": 10

},

"storeSettings":{

"type": "AmazonS3CompatibleReadSettings",

"recursive": true,

"wildcardFolderPath": "myfolder*A",

"wildcardFileName": "*.csv"

}

},

"sink": {

"type": "<sink type>"

}

}

}

]

Exemplos de filtros de pastas e ficheiros

Esta seção descreve o comportamento resultante do caminho da pasta e do nome do arquivo com filtros curinga.

| balde | key | recursiva | Estrutura da pasta de origem e resultado do filtro (arquivos em negrito são recuperados) |

|---|---|---|---|

| balde | Folder*/* |

false | balde PastaA File1.csv File2.json Subpasta1 File3.csv File4.json File5.csv OutraPastaB File6.csv |

| balde | Folder*/* |

verdadeiro | balde PastaA File1.csv File2.json Subpasta1 File3.csv File4.json File5.csv OutraPastaB File6.csv |

| balde | Folder*/*.csv |

false | balde PastaA File1.csv File2.json Subpasta1 File3.csv File4.json File5.csv OutraPastaB File6.csv |

| balde | Folder*/*.csv |

verdadeiro | balde PastaA File1.csv File2.json Subpasta1 File3.csv File4.json File5.csv OutraPastaB File6.csv |

Exemplos de lista de ficheiros

Esta seção descreve o comportamento resultante do uso de um caminho de lista de arquivos em uma fonte de atividade Copiar.

Suponha que você tenha a seguinte estrutura de pasta de origem e deseja copiar os arquivos em negrito:

| Estrutura de origem da amostra | Conteúdo em FileListToCopy.txt | Configuração |

|---|---|---|

| balde PastaA File1.csv File2.json Subpasta1 File3.csv File4.json File5.csv Metadados FileListToCopy.txt |

File1.csv Subpasta1/File3.csv Subpasta1/File5.csv |

No conjunto de dados: - Balde: bucket- Caminho da pasta: FolderAEm Copiar fonte da atividade: - Caminho da lista de arquivos: bucket/Metadata/FileListToCopy.txt O caminho da lista de arquivos aponta para um arquivo de texto no mesmo armazenamento de dados que inclui uma lista de arquivos que você deseja copiar, um arquivo por linha, com o caminho relativo para o caminho configurado no conjunto de dados. |

Propriedades da atividade de pesquisa

Para saber detalhes sobre as propriedades, verifique Atividade de pesquisa.

Propriedades de atividade GetMetadata

Para saber detalhes sobre as propriedades, verifique a atividade GetMetadata.

Excluir propriedades de atividade

Para saber detalhes sobre as propriedades, marque Excluir atividade.

Conteúdos relacionados

Para obter uma lista de armazenamentos de dados que a atividade Copiar suporta como fontes e coletores, consulte Armazenamentos de dados suportados.